WO2024018601A1 - Display screen creation system, display screen creation method, and image relay program - Google Patents

Display screen creation system, display screen creation method, and image relay programDownload PDFInfo

- Publication number

- WO2024018601A1 WO2024018601A1PCT/JP2022/028385JP2022028385WWO2024018601A1WO 2024018601 A1WO2024018601 A1WO 2024018601A1JP 2022028385 WJP2022028385 WJP 2022028385WWO 2024018601 A1WO2024018601 A1WO 2024018601A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- images

- image

- processing server

- display screen

- user

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Ceased

Links

Images

Classifications

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/20—Servers specifically adapted for the distribution of content, e.g. VOD servers; Operations thereof

- H04N21/21—Server components or server architectures

- H04N21/226—Characteristics of the server or Internal components of the server

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/20—Servers specifically adapted for the distribution of content, e.g. VOD servers; Operations thereof

- H04N21/23—Processing of content or additional data; Elementary server operations; Server middleware

- H04N21/234—Processing of video elementary streams, e.g. splicing of video streams or manipulating encoded video stream scene graphs

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/20—Servers specifically adapted for the distribution of content, e.g. VOD servers; Operations thereof

- H04N21/25—Management operations performed by the server for facilitating the content distribution or administrating data related to end-users or client devices, e.g. end-user or client device authentication, learning user preferences for recommending movies

- H04N21/266—Channel or content management, e.g. generation and management of keys and entitlement messages in a conditional access system, merging a VOD unicast channel into a multicast channel

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N7/00—Television systems

- H04N7/14—Systems for two-way working

- H04N7/15—Conference systems

Definitions

- One aspect of the present inventionrelates to a display screen creation system, a display screen creation method, and an image relay program.

- a composite display screenmay be created and displayed on a screen installed in the venue.

- Various techniqueshave been proposed for creating such display screens.

- Patent Document 1discloses that in a multipoint conference for holding a conference using a plurality of communication terminals located at multiple points, a multipoint conference connection device connected to the plurality of communication terminals connects the plurality of communication terminals. It is proposed to reduce the load on compositing processing by resizing the transmitted video and then creating a composite video.

- Patent Document 2discloses that by encoding a composite video by selecting values different from those of the transmitting terminal for encoding parameters such as bit rate and frame rate of video transmitted from a plurality of communication terminals, It is proposed to reduce unnecessary traffic on the network.

- Patent Document 3discloses that each input video is scaled by a plurality of magnification factors, a plurality of scaled input videos are created for each input video, and a composite video is created based on video arrangement information. is suggesting.

- the number of terminals expected in a multipoint conferenceis at most 50 or less, and the number is too large to be applied in an event with access from many more users. .

- This inventionwas made in view of the above circumstances, and its purpose is to make it possible to create a display screen containing an image of a user selected from among a large number of users participating remotely with less delay.

- the goalis to provide technology that will

- a display screen creation systemincludes a plurality of lower processing servers each accessed from a plurality of user terminals, an upper processing server communicating with the plurality of lower processing servers, including.

- Each of the plurality of lower processing serversnarrows down the images received from each of the plurality of user terminals to a plurality of images smaller than the total number of received images according to the first narrowing down algorithm, and narrows down the narrowed down images or the narrowed down images. Images obtained by reducing the number of vertical and horizontal pixels of the plurality of images are transmitted to the higher-level processing server.

- the upper processing servernarrows down the images received from each of the plurality of lower processing servers to a plurality of images smaller than the total number of received images according to the second narrowing down algorithm, and narrows down the narrowed down images or the narrowed down plurality of images.

- a display screenis created on which an image with the number of vertical and horizontal pixels of the image reduced is arranged.

- FIG. 1is a block diagram showing an example of the configuration of a display screen creation system according to a first embodiment of the present invention.

- FIG. 2is a block diagram showing an example of the hardware configuration of the lower processing server in the display screen creation system according to the first embodiment.

- FIG. 3is a block diagram showing the software configuration of the lower processing server.

- FIG. 4is a block diagram showing an example of the hardware configuration of the higher-level processing server in the display screen creation system according to the first embodiment.

- FIG. 5is a block diagram showing the software configuration of the higher-level processing server.

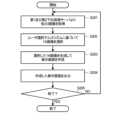

- FIG. 6is a flowchart illustrating an example of the operation of the lower-level processing server.

- FIG. 7is a flowchart showing an example of the operation of the higher-level processing server.

- FIG. 1is a block diagram showing an example of the configuration of a display screen creation system according to a first embodiment of the present invention.

- FIG. 2is a block diagram showing an example of the hardware configuration of the lower processing server in the display

- FIG. 8is a diagram showing an example of a composite image created as a display screen.

- FIG. 9is a block diagram showing the software configuration of the higher-level processing server in the second modification of the first embodiment.

- FIG. 10is a flowchart illustrating an example of the operation of the higher-level processing server in the second modification of the first embodiment.

- FIG. 11is a block diagram showing the software configuration of the lower processing server in the third modification of the first embodiment.

- FIG. 12is a flowchart illustrating an example of the operation of the lower-level processing server in the third modification of the first embodiment.

- FIG. 13is a diagram illustrating an example of a composite image in the fourth modification of the first embodiment.

- FIG. 14is a block diagram showing the software configuration of the lower processing server in the display screen creation system according to the second embodiment of the present invention.

- FIG. 15is a block diagram showing the software configuration of the higher-level processing server in the display screen creation system according to the second embodiment.

- FIG. 16is a flowchart illustrating an example of the operation of the lower-level processing server in the second embodiment.

- FIG. 17is a flowchart illustrating an example of the operation of the higher-level processing server in the second embodiment.

- FIG. 18is a block diagram showing the software configuration of the lower processing server in the second modification of the second embodiment.

- FIG. 19is a block diagram illustrating an example of the configuration of a display screen creation system according to a fourth modification of the second embodiment.

- FIG. 20is a block diagram showing the software configuration of the lower processing server in the fourth modification of the second embodiment.

- FIG. 21is a flowchart illustrating an example of the operation of the lower-level processing server regarding distribution processing in the fourth modification of the second embodiment.

- FIG. 22is a block diagram showing the software configuration of the lower processing server in the display screen creation system according to the third embodiment of the present invention.

- FIG. 23is a flowchart illustrating an example of the operation of the lower-level processing server in the third embodiment.

- FIG. 24is a flowchart illustrating an example of the operation of the higher-level processing server in the third embodiment.

- FIG. 25is a flowchart illustrating an example of the operation of the lower-level processing server in the second modification of the third embodiment.

- FIG. 26is a flowchart illustrating an example of the operation of the higher-level processing server in the second modification of the third embodiment.

- FIG. 27is a block diagram showing an example of the configuration of a display screen creation system according to the fourth embodiment

- FIG. 1is a block diagram showing an example of the configuration of a display screen creation system according to a first embodiment of the present invention.

- the display screen creation systemincludes a plurality of, here two, a first lower-level processing server 10-1 and a second lower-level processing server 10-2, and one higher-level processing server 20. Further, the display screen creation system may include a management server 30.

- the first lower-level processing server 10-1is accessed from a plurality of user terminals, for example, up to 50 user terminals UT1 to UT50, via a network such as the Internet.

- a networksuch as the Internet.

- the first lower-level processing server 10-1receives the user's moving images transmitted via the network from the locations where the user terminals UT1 to UT50 are located.

- the first lower processing server 10-1selects video images for a smaller number of people, for example, 20 people, from among the video images for 50 people, and connects them to a network such as a LAN (Local Area Network) or the Internet.

- the selected moving imagesare transmitted to the higher-level processing server 20 via. The method for selecting moving images will be described later.

- the second lower-level processing server 10-2is accessed from a plurality of user terminals, for example, up to 50 user terminals UT51 to UT100, via the network.

- User terminals UT51 to UT100basically exist in geographically separate locations.

- each of the user terminals UT51 to UT100 and each of the user terminals UT1 to UT50are basically located at geographically different locations.

- the second lower-level processing server 10-2receives the user's moving images transmitted via the network from the locations where the user terminals UT51 to UT100 are located.

- the second lower-level processing server 10-2selects the video images for a smaller number of people, for example, 20 people, from among the video images for the 50 people, and transmits the selected video images via the network. It is transmitted to the upper processing server 20. The method for selecting moving images will be described later.

- the first lower-level processing server 10-1 and the second lower-level processing server 10-2will be described as being accessed from the same number of user terminals, but it goes without saying that this need not be the same number. . Furthermore, when a user terminal attempts to participate in an event, its access destination is automatically assigned to either the first lower-level processing server 10-1 or the second lower-level processing server 10-2 when logging in. .

- the upper-level processing server 20selects video images for a smaller number of people, for example, 16 people, from among the video images for a total of 40 people sent from the first lower-level processing server 10-1 and the second lower-level processing server 10-2. Select the video image. The method for selecting moving images will be described later. Then, the higher-level processing server 20 creates a moving image of the display screen by combining the moving images of the 16 selected people, and sends it to the first lower-level processing server 10-1 and the second lower-level processing server 10-2 via the network. , and send the video of the created display screen.

- the first lower-level processing server 10-1transmits the moving image of the display screen transmitted from the higher-level processing server 20 to the user terminals UT1 to UT50 via the network.

- the second lower-level processing server 10-2transmits the moving image of the display screen transmitted from the higher-level processing server 20 to the user terminals UT51 to UT100 via the network.

- the management server 30controls the operations of the first lower-level processing server 10-1, the second lower-level processing server 10-2, and the higher-level processing server 20 via the network.

- the management server 30can control operations related to video image selection in the servers 10-1, 10-2, and 20.

- first lower-level processing server 10-1 and the second lower-level processing server 10-2will be explained. Note that if the first lower-level processing server 10-1 and the second lower-level processing server 10-2 are not particularly distinguished, they will simply be referred to as the lower-level processing server 10.

- FIG. 2is a block diagram showing an example of the hardware configuration of the lower processing server 10 in the display screen creation system according to the first embodiment.

- the lower processing server 10is a computer such as a PC (Personal Computer) or a server computer.

- the lower processing server 10includes, for example, a processor 11A such as a CPU (Central Processing Unit).

- the processor 11Amay be multi-core/multi-threaded and can execute multiple processes in parallel.

- the lower processing server 10has a program memory 11B, a data memory 12, an input/output interface 13, and a communication interface 14 connected to the processor 11A via a bus 15.

- the program memory 11Bcan be used as a storage medium, for example, non-volatile memory such as HDD (Hard Disk Drive) or SSD (Solid State Drive) that can be written to and read from at any time, and non-volatile memory such as ROM (Read Only Memory). It is used in combination.

- the program memory 11Bstores programs necessary for the processor 11A to execute various processes.

- the programsinclude an image relay program according to one embodiment.

- the data memory 12is a storage that uses a combination of a nonvolatile memory such as an HDD or SSD that can be written to and read from at any time, and a volatile memory such as a RAM (Random Access Memory) as a storage medium.

- the data memory 12is used to store data acquired and created in the process of performing various processes.

- the input/output interface 13is an interface with the input device 16.

- the input device 16includes a keyboard, a pointing device, etc. used by a server administrator who manages the lower processing server 10 to input instructions to the processor 11A. Furthermore, the input device 16 includes a reader for reading files and data to be stored in the data memory 12 from a memory medium such as a USB memory, or a disk device for reading such files and data from a disk medium. obtain.

- the communication interface 14is a wired and/or wireless communication unit for connecting to a network.

- This communication interface 14can exchange user moving images with a plurality of user terminals and the higher-level processing server 20 via the network.

- the communication interface 14can exchange instructions input to the processor 11A and output data from the processor 11A with an external management device such as the management server 30 via the network. Therefore, the lower processing server 10 does not necessarily have to include the input device 16.

- FIG. 3is a block diagram showing the software configuration of the lower processing server 10 in association with the hardware configuration shown in FIG. 2.

- the processing unit 11is composed of the processor 11A and the program memory 11B, and includes a user image receiving unit 111, an image selecting unit 112, and a selected image transmitting unit 113 as software processing function units. These processing functional units are realized by causing the processor 11A to execute programs stored in the program memory 11B.

- the processing unit 11may also be implemented in various other forms including integrated circuits such as ASIC (Application Specific Integrated Circuit), DSP (Digital Signal Processor), FPGA (field-programmable gate array), GPU (Graphics Processing Unit), etc. It may be realized by ASIC (Application Specific Integrated Circuit), DSP (Digital Signal Processor), FPGA (field-programmable gate array), GPU (Graphics Processing Unit), etc. It may be realized by ASIC (Application Specific Integrated Circuit), DSP (Digital Signal Processor), FPGA (field-programmable gate array), GPU (Graphics Processing Unit), etc. It may be realized by ASIC (Application Specific Integrated Circuit), DSP (Digital Signal Processor), FPGA (field-programmable gate

- the storage area of the data memory 12includes a user image storage section 121 and a learning data storage section 122.

- the user image receiving unit 111 of the processing unit 11has a function of acquiring user moving images from a plurality of user terminals via the network via the communication interface 14. That is, the user image receiving unit 111 of the first lower-level processing server 10-1 acquires the user's moving image from each of the 50 user terminals UT1 to UT50, for example, and transmits the user image receiving unit of the second lower-level processing server 10-2 to the user image receiving unit 111 of the first lower-level processing server 10-1. 111 acquires a user's moving image from each of the 50 user terminals UT51 to UT100, for example. The user image receiving unit 111 stores the acquired moving images of 50 users in the user image storage unit 121 of the data memory 12.

- the user image receiving section 111may reduce the number of vertical and horizontal pixels of the acquired moving images of the 50 users before storing them in the user image storage section 121.

- the user terminals UT1 to UT100are not particularly distinguished, they will simply be referred to as user terminals UT.

- the learning data storage unit 122 of the data memory 12stores learning data used to select a user's moving image.

- the learning data storage unit 122stores learning data obtained by learning multiple video images of a person waving a chemical light that emits a specific color by changing the way the person and the chemical light are waving and the background. .

- the image selection unit 112 of the processing unit 11selects the moving images sent from each user, which are stored in the user image storage unit 121 of the data memory 12, to the higher-level processing server 20 based on a prescribed user selection algorithm. It has a function to select moving images to be sent.

- the prescribed user selection algorithmis, for example, based on the degree of matching with a learned moving image stored as learning data in the learning data storage unit 122 from among the moving images of 50 people stored in the user image storage unit 121.

- An algorithmmay be used to select the top 20 video images with the highest values. In this way, the image selection unit 112 selects a smaller number of user moving images than the number of acquired user moving images.

- the image selection unit 112transmits the selection result to the selected image transmission unit 113 of the processing unit 11.

- the selected image transmission unit 113 of the processing unit 11selects video images of 20 people from among the video images of 50 people stored in the user image storage unit 121 of the data memory 12 according to the selection result of the image selection unit 112. It has a function of reading out the moving images and transmitting the read moving images to the host processing server 20 via the communication interface 14. Note that if the moving image stored in the user image storage unit 121 is not a moving image with a reduced number of pixels, the selected image transmitting unit 113 uses the number of vertical and horizontal pixels of the read moving images of 50 people. The data may be transmitted to the higher-level processing server 20 after being reduced in size. Of course, the selected image transmitter 113 may transmit the moving image without reducing the number of pixels as it is.

- FIG. 4is a block diagram showing an example of the hardware configuration of the higher-level processing server 20 according to the first embodiment.

- the upper processing server 20is a computer such as a PC or a server computer, and like the lower processing server 10, has a processor 21A.

- the processor 11Amay be multi-core/multi-threaded and can execute multiple processes in parallel.

- the upper processing server 20has a program memory 21B, a data memory 22, an input/output interface 23, and a communication interface 24 connected to the processor 21A via a bus 25.

- An input device 26 and/or an output device 27may be connected to the input/output interface 23.

- the output device 27includes, for example, a large display installed at the event venue that displays output data from the processor 21A, a projector that projects the output data onto a screen installed at the event venue, and the like.

- the output device 27can include a speaker that outputs audio data and music data.

- FIG. 5is a block diagram showing the software configuration of the higher-level processing server 20 in association with the hardware configuration shown in FIG. 4.

- the processing unit 21is composed of the processor 21A and the program memory 21B, and includes a selected image receiving unit 211, an image selecting unit 212, a display screen creating unit 213, and a display screen output unit 214 as processing function units using software. and. These processing functional units are realized by causing the processor 21A to execute programs stored in the program memory 21B.

- Processing unit 21may also be implemented in a variety of other formats, including integrated circuits such as ASICs, DSPs, FPGAs, GPUs, and the like.

- the storage area of the data memory 22includes an image storage section 221 and a learning data storage section 222.

- the selected image receiving unit 211 of the processing unit 21has a function of receiving a user's moving image transmitted from the lower processing server 10 via the network via the communication interface 24 and storing it in the image storage unit 221 of the data memory 22. are doing. That is, the selected image receiving unit 211 receives the moving images of 20 people transmitted by the first lower-level processing server 10-1 and the moving images of 20 people transmitted by the second lower-level processing server 10-2. Therefore, the image storage unit 221 stores moving images of a total of 40 people. Note that, similarly to the user image receiving unit 111 of the lower-level processing server 10, the selected image receiving unit 211 reduces the number of vertical and horizontal pixels of each moving image received from the lower-level processing server 10, and then transfers the selected image to the image storage unit 221. It is also possible to have it memorized.

- the learning data storage unit 222 of the data memory 22stores, for example, the same learning data as the learning data storage unit 122 of the lower processing server 10.

- the image selection unit 212 of the processing unit 21selects a display screen from among the moving images stored in the image storage unit 221 of the data memory 22, for example, according to the same prescribed user selection algorithm as the image selection unit 112 of the lower processing server 10. It has a function to select the moving image to be used. That is, the image selection unit 212 selects learned moving images stored as learning data in the learning data storage unit 222 of the data memory 22 from among the moving images of 40 people in total stored in the image storage unit 221. For example, the video images of the top 16 people with a high matching degree are selected. The image selection unit 212 transmits the selection result to the display screen creation unit 213 of the processing unit 21.

- the display screen creation unit 213 of the processing unit 21selects video images of 16 people from among the video images of 40 people stored in the image storage unit 221 of the data memory 22 according to the selection result of the image selection unit 212. It has a function to read out and create a display screen that combines the read out moving images of 16 people. For example, the display screen creation unit 213 creates a composite image in which the read moving images are arranged in a tile shape as a display screen. Note that if the moving image stored in the image storage unit 221 is not a moving image with a reduced number of pixels, the display screen creation unit 213 calculates the number of vertical and horizontal pixels of the read moving image of 16 people. It is also possible to reduce the size and then combine the images. Of course, the display screen creation unit 213 may synthesize moving images without reducing the number of pixels as they are.

- the display screen output unit 214 of the processing unit 11has a function of outputting the display screen created by the display screen creation unit 213. Specifically, the display screen output unit 214 displays and outputs the display screen using the output device 27 via the input/output interface 23. Alternatively, the display screen output unit 214 may transmit the information via the communication interface 24 to a controller of a display device installed at the event venue, and output the display screen on the screen of the display device.

- the management server 30is also a computer such as a PC or a server computer, and has the same hardware configuration as the upper processing server 20 shown in FIG.

- the processor of the management server 30transmits a control signal indicating a control command for the lower-level processing server 10 and/or the higher-level processing server 20 input by the administrator from the input device to the lower-level processing server 10 and/or the higher-level processing server 20 via the communication interface. Send to.

- FIG. 6is a flowchart illustrating an example of the operation of the lower processing server 10.

- the processor 11A of the lower processing server 10can perform the processing shown in this flowchart, for example, by executing an image relay program stored in advance in the program memory 11B.

- the processor 11Amay start the operations shown in this flowchart when a start instruction is input from the input device 16 or when a control signal instructing the start is received from the higher-level processing server 20 or the management server 30. can. Note that a description of basic operations such as logging in from the user terminal UT will be omitted.

- the processor 11Afirst operates as the user image receiving unit 111 and acquires a user's moving image from each logged-in user terminal UT (step S101).

- the processor 11Acauses the user image storage unit 121 to store the obtained moving images of the 50 users or the moving images obtained by reducing the number of vertical and horizontal pixels of the obtained moving images of the 50 users.

- the processor 11Aoperates as the image selection section 112, and selects the learning data from among the moving images of 50 people stored in the user image storage section 121 based on a prescribed user selection algorithm. For example, the moving images of the top 20 people with a high degree of matching with the learned moving images stored as data are selected (step S102).

- the processor 11Aoperates as the selected image transmitting unit 113 and transmits the video images of the selected 20 people or the video images obtained by reducing the number of vertical and horizontal pixels of the video images of the selected 20 people to the higher-level processing server. 20 (step S103).

- the processor 11Adetermines whether to end the operation shown in this flowchart (step S104). For example, when the processor 11A receives a termination instruction from the input device 16 or receives a control signal instructing termination from the higher-level processing server 20 or the management server 30, the processor 11A determines to terminate. If the processor 11A determines that the process has not finished yet, the process proceeds to step S101. Furthermore, if it is determined that the process is to end, the processor 11A ends the operation shown in this flowchart.

- FIG. 7is a flowchart illustrating an example of the operation of the higher-level processing server 20.

- the processor 21A of the higher-level processing server 20can perform the processing shown in this flowchart, for example, by executing a program stored in advance in the program memory 21B.

- the processor 21Acan start the operations shown in this flowchart when a start instruction is input from the input device 26 or when a control signal instructing the start is received from the management server 30. Note that when starting the operation shown in this flowchart, the lower processing server 10 may be instructed to start the operation.

- the processor 21Afirst operates as the selected image receiving unit 211 and obtains moving images of 20 people from the first and second lower processing servers 10-1 and 10-2, respectively (step S201).

- the processor 21Acauses the image storage unit 221 to store the acquired moving images of 40 people in total or the moving images obtained by reducing the number of vertical and horizontal pixels.

- the processor 21Aoperates as the image selection unit 212 and selects the learning data storage unit 222 from among the moving images of 40 people in total stored in the image storage unit 221 based on a prescribed user selection algorithm. For example, moving images of the top 16 people with a high degree of matching with learned moving images stored as learning data are selected (step S202).

- the processor 21Athen operates as the display screen creation unit 213 to display a composite of the video images of the selected 16 people or the video images obtained by reducing the number of vertical and horizontal pixels of the video images of the selected 16 people.

- a screenis created (step S203).

- FIG. 8is a diagram showing an example of a composite image created as a display screen.

- the processor 21Acreates a composite image MI in which moving images of 16 selected people, such as moving images Ip and Iq, are arranged in a tile shape as a display screen.

- the processor 21Aoperates as the display screen output unit 214 and outputs the created display screen (step S204).

- the processor 21Adetermines whether to end the operation shown in this flowchart (step S205). For example, the processor 21A determines to end when an end instruction is input from the input device 26 or a control signal instructing to end is received from the management server 30. If it is determined that the process has not ended yet, the processor 21A moves to the process of step S201 described above. Furthermore, if it is determined that the process is to end, the processor 21A ends the operation shown in this flowchart. Note that, when terminating this operation, the lower-level processing server 10 may be instructed to terminate the operation.

- a plurality of, for example, two, lower-level processing servers 10 each accessed from a plurality of, for example, 50 user terminals UTThis is a display screen creation system that includes a higher-level processing server 20 that communicates with a lower-level processing server 10. Then, each of the plurality of lower processing servers 10 divides the moving images received from each of the plurality of user terminals UT into a plurality of moving images, for example, 20 moving images, which is less than the total number of received moving images, 50, according to the first narrowing down algorithm. The selected moving images or the moving images with the vertical and horizontal pixel numbers reduced are transmitted to the higher-level processing server 20.

- a display screenis created on which a plurality of narrowed-down moving images or moving images with reduced vertical and horizontal pixel counts are arranged.

- a plurality of processing serversthat is, a first subordinate server, instead of a single server, are used.

- a processing server 10-1, a second lower-level processing server 10-2, and a higher-level processing server 20are used.

- the lower-level processing server 10can send video images for everyone and decide which users' video images to display.

- the higher-level processing server 20By reducing the number of vertical and horizontal pixels of only the candidate user's video images and transmitting them to the higher-level processing server 20, the amount of data transferred and the reception load on the higher-level processing server 20 can be reduced. can be reduced.

- the upper-level processing server 20uses only the received user's moving image to determine the user's moving image to be finally displayed, and determines the number of vertical and horizontal pixels of the user's moving image based on the determined moving image or as necessary.

- a display screencan be created using a moving image that is reduced in size.

- the processing for selecting usersis also distributed to the first lower-level processing server 10-1, the second lower-level processing server 10-2, and the higher-level processing server 20, the processing load on each server can be reduced. This also has the effect of speeding up the process of selecting a user and reducing overall delay.

- the first embodiment of the present inventionit is possible to create a display screen containing an image of a user selected from among a large number of users participating remotely with little delay.

- the first narrowing down algorithm and the second narrowing down algorithmare the same user selection algorithm.

- each of the plurality of lower processing servers 10 and the upper processing server 20has an image selection section 112, 212 that selects a plurality of images according to a user selection algorithm, and a specific The image selection unit 112, 212 selects a plurality of images having a high degree of matching with the learning data.

- the prescribed user selection algorithmcalculates the degree of similarity to a video image of a person waving a chemical light that emits a specific color, as described in the first embodiment, and selects the video image of the user with the highest ranking. It is not limited to the example. For example, as a simple method, the prescribed user selection algorithm calculates the ratio of the number of pixels in the luminance or color difference range corresponding to a specific color to the total number of pixels of the image sent by the user, and selects the top 20 users. Alternatively, an algorithm may be used to select moving images of 16 users. In this case, you may add conditions such as not only being in the top but also that the ratio is within a specific range. In any case, in this first modification, the learning data storage units 122 and 222 are not required.

- the learning data storage unit 222 of the upper processing server 20stores learning data for a plurality of user selection algorithms, and the image selection unit 212 is configured to select an algorithm to be used from among the plurality of user selection algorithms. You can also do it. Further, even if there is only one user selection algorithm, the image selection unit 212 may be configured to be able to change parameters.

- FIG. 9is a block diagram showing the software configuration of the higher-level processing server 20 in the second modification of the first embodiment.

- the processing section 21includes a control signal acquisition section 215.

- the control signal acquisition unit 215has a function of acquiring a control signal input from the input device 26 or transmitted from the management server 30 and transmitting the acquired control signal to the image selection unit 212.

- the control signalincludes, for example, a user selection algorithm used by the image selection unit 212 and/or a parameter designation command.

- the image selection unit 212 in this modificationdetermines an algorithm to be used from among a plurality of user-selected algorithms, or changes parameters in the algorithm to be used, based on the control signal transmitted from the control signal acquisition unit 215. do.

- the learning data storage unit 222 in this modificationstores learning data for a plurality of user selection algorithms.

- the parameterscan include the number of images to select, selection timing, etc.

- the higher-level processing server 20selects the top 16 people from among the 20 video images received from the first lower-level processing server 10-1 at a certain timing, and selects the top 16 people from the video images of 20 people received from the first lower-level processing server 10-1 at another timing.

- the top 16 peoplecan be selected from the video images of 20 people received from -2. By doing so, it becomes possible to adjust the display screen created by the display screen creation unit 213 to only the moving image of the user accessing one of the lower processing servers 10.

- FIG. 10is a flowchart illustrating an example of the operation of the higher-level processing server 20 in the second modification.

- the processor 21Aoperates as the control signal acquisition unit 215 after acquiring video images of 20 people from each lower processing server 10 in step S201, and determines whether or not there is a control signal. (Step S206).

- the processor 21Areceives a control signal from the input device 26 or the management server 30, it determines that the control signal is present.

- the processor 21Amoves to the process of step S202, operates as the image selection section 212, and selects the prescribed user selection algorithm stored in the learning data storage section 222. Based on this, video images of 16 people are selected from the video images of 40 people stored in the image storage unit 221 according to prescribed parameters.

- the processor 21Aoperates as the image selection unit 212 and determines the user selection algorithm and/or parameters to be used based on the control signal ( Step S207).

- the processor 21Aselects 16 video images from the 40 video images stored in the image storage unit 221 based on the determined user selection algorithm and/or parameters (step S208). . That is, the processor 21A can select the learning data corresponding to the determined user selection algorithm from among the plurality of learning data stored in the learning data storage unit 222 as the learning data to be used for selection. Alternatively, or in addition, processor 21A may change the parameters in the determined or predefined user selection algorithm to the determined parameters. The processor 21A selects a moving image based on the determined or predetermined user selection algorithm using the thus selected learning data and/or changed parameters. After that, the processor 21A moves to the process of step S203.

- the same effects as in the first embodimentcan be achieved, and the display It becomes possible to further narrow down the user's moving images to be included in the screen.

- the upper processing server 20may be able to select an algorithm and/or parameters to be used from among a plurality of algorithms.

- FIG. 11is a block diagram showing the software configuration of the lower processing server 10 in the third modification of the first embodiment.

- the processing section 11includes a control signal acquisition section 114.

- the control signal acquisition unit 114has a function of acquiring a control signal input from the input device 16 or transmitted from the management server 30 and transmitting the acquired control signal to the image selection unit 112.

- the control signalincludes, for example, a user selection algorithm and/or a parameter designation command used by the image selection unit 112.

- the image selection unit 112 in this modificationdetermines an algorithm to be used from among a plurality of user-selected algorithms, or changes parameters in the algorithm to be used, based on the control signal transmitted from the control signal acquisition unit 114. do.

- the learning data storage unit 122 in this modificationstores learning data for a plurality of user selection algorithms.

- the parameterscan include the number of images to select, selection timing, etc.

- the location, communication status, processing load status, etc. of the lower-level processing server 10can be obtained separately, and parameters corresponding to these conditions can be input from the input device 16 or transmitted from the management server 30. Let's do it like this.

- the lower processing server 10can select, for example, moving images of 30 people from among the moving images of 50 people at one timing, and select moving images of 10 people at another timing. By doing so, it becomes possible to adjust the processing load on the lower-level processing server and the communication load with the higher-level processing server 20.

- FIG. 12is a flowchart illustrating an example of the operation of the lower-level processing server 10 in the third modification.

- the processor 11Aoperates as the control signal acquisition unit 114 after acquiring a user's moving image from each user terminal UT in step S101, and determines whether there is a control signal (step S105). ).

- the processor 11Areceives a control signal from the input device 16 or the management server 30, it determines that the control signal is present.

- the processor 11Amoves to the process of step S102, operates as the image selection section 112, and selects the prescribed user selection algorithm stored in the learning data storage section 122. Based on this, video images of 20 people are selected from the video images of 50 people stored in the user image storage unit 121 using prescribed parameters.

- the processor 11Aoperates as the selected image transmitting unit 113 and transmits the video images for the selected number of people or the video images with the vertical and horizontal pixel numbers reduced to the higher-level processing server 20 (step S106).

- step S105if it is determined in step S105 that there is a control signal, the processor 11A operates as the image selection unit 112, and based on the control signal, the processor 11A selects the user selection algorithm and/or parameters to be used. is determined (step S107).

- the processor 11Aselects the predetermined 20 video images from among the 50 video images stored in the user image storage unit 121 or the parameters. Video images for the number of people are selected (step S108). That is, the processor 11A can select the learning data corresponding to the determined user selection algorithm from among the plurality of learning data stored in the learning data storage unit 122 as the learning data to be used for selection. Alternatively, or in addition, processor 11A may change the parameters in the determined or predefined user selection algorithm to the determined parameters. The processor 11A selects a moving image based on the determined or predetermined user selection algorithm using the learning data and/or changed parameters thus selected. After that, the processor 11A moves to the process of step S106.

- FIG. 13is a diagram showing an example of a composite image in the fourth modification of the first embodiment.

- the display screen creation unit 213arranges the video image Ip of the user p selected as the topmost one in the image selection unit 212 in the center, and arranges the video image Ip in a larger area than the video images Iq, etc. of other users. Create a composite image MI as a display screen.

- the moving image Ip of the highest ranking user pmay not be placed in the center, but may simply be combined so that it has a larger area than the moving images of other users.

- the number of user moving images selected by the image selection unit 212 of the higher-level processing server 20may be smaller than the number that can be displayed on the display screen.

- the display screen creation unit 213displays the user's moving images (or reduced moving images) in order of high matching degree in raster scan order starting from the upper left of the display screen, and displays the moving images (or reduced moving images) in the lower right area. Even if you allow the same user's video to be displayed multiple times, increase the display area per user, or display a different image other than the user's video in the remaining area. good.

- the display screen creation unit 213displays a reduced frame rate. It is also possible to combine the images on the screen.

- FIG. 14is a block diagram showing the software configuration of the lower processing server 10 in the second embodiment of the invention.

- the processing unit 11includes a control signal acquisition unit 114 and an attribute information acquisition unit 115 in addition to the configuration of the first embodiment.

- the data memory 12includes an attribute information storage section 123 and a selection condition storage section 124 instead of the learning data storage section 122 in the first embodiment.

- the attribute information acquisition unit 115 of the processing unit 11has a function of acquiring attribute information regarding the user's own attributes from each user terminal UT before an event is held, and storing the acquired attribute information in the attribute information storage unit 123 of the data memory 12.

- the attribute information acquisition unit 115can, for example, transmit questions to each user terminal UT and acquire the answers.

- the management server 30may collect the attribute information of each user in advance, and the attribute information acquisition unit 115 may acquire the attribute information of each user from the management server 30.

- the attribute informationis information that can be used to distinguish the user from other users, such as the user's nationality, place of birth, age, gender, preference, ideology, religion, and the like.

- the control signal acquisition unit 114 of the processing unit 11acquires the control signal input from the input device 16 or transmitted from the management server 30, and stores the selection condition indicated by the acquired control signal in the data memory 12. It has a function of storing data in the unit 124.

- the selection conditionspecifies attribute information that should be selected with priority. That is, the selection condition is that specific attribute information is included. For example, the selection condition may be "My favorite athlete is baseball player Ichiro" regarding preferences. Or conversely, the selection condition may be that specific attribute information is not included. Furthermore, the selection conditions are not limited to one piece of attribute information, and may include conditions regarding a plurality of pieces of attribute information.

- the image selection unit 112 of the processing unit 11 in this embodimentuses a prescribed user selection algorithm from the attribute information stored in the attribute information storage unit 123 of the data memory 12 and the selection conditions stored in the selection condition storage unit 124. Based on this, the user's moving image to be transmitted to the higher-level processing server 20 is selected.

- the prescribed user selection algorithmis to select the video images of, for example, the top 20 users who highly match the attributes of the selection conditions.

- the image selection unit 112transmits the selection result to the selected image transmission unit 113 of the processing unit 11, but in this embodiment, the selection result also includes attribute information of the user of the selected moving image.

- the prescribed user selection algorithm in the image selection unit 112may be such that, when there are multiple users with a high matching degree, moving images of those users are randomly selected.

- the selected image transmitting unit 113 of the processing unit 11 in this embodimenttransmits images of 50 people stored in the user image storage unit 121 of the data memory 12 according to the selection result of the image selection unit 112, as in the first embodiment.

- the video images of 20 peopleare read out from the video images of .

- the selected image transmitting unit 113 in this embodimenthas a function of transmitting the read moving images or reduced-sized moving images together with the attribute information of each user to the higher-level processing server 20 via the communication interface 14. ing.

- FIG. 15is a block diagram showing an example of the software configuration of the higher-level processing server 20 according to the second embodiment of the present invention.

- the processing section 21includes a control signal acquisition section 215 in addition to the configuration of the first embodiment.

- the data memory 22includes a selection condition storage section 223 instead of the learning data storage section 222 in the first embodiment.

- the control signal acquisition unit 215 of the processing unit 21acquires the control signal input from the input device 26 or transmitted from the management server 30, and stores the selection condition indicated by the acquired control signal in the data memory 22. It has a function of storing data in the section 223.

- the selection conditionsare as described for the lower processing server 10.

- the selected image receiving unit 211 of the processing unit 21 in this embodimenthas a function of receiving a user's moving image and its attribute information transmitted from the lower processing server 10 and storing it in the image storage unit 221 of the data memory 22. are doing. That is, the image storage unit 221 of the data memory 22 in this embodiment stores moving images for a total of 40 people (or moving images reduced in size) and attribute information of each moving image.

- the image selection unit 212 of the processing unit 21 in this embodimentselects the attribute information stored in the image storage unit 221 of the data memory 12 and the selection conditions stored in the selection condition storage unit 223 based on a prescribed user selection algorithm. It has a function of selecting a moving image to be used on the display screen from among the moving images stored in the image storage section 221 of the data memory 22. That is, the image selection unit 212 selects, from among the video images of a total of 40 users stored in the image storage unit 221, the video images of, for example, the top 16 users with a high degree of matching of the attributes of the selection condition. As in the first embodiment, the image selection section 212 transmits the selection result to the display screen creation section 213 of the processing section 21.

- the prescribed user selection algorithm in the image selection unit 212may be such that when there are multiple users with a high matching degree, the video images of those users are randomly selected.

- FIG. 16is a flowchart illustrating an example of the operation of the lower-level processing server 10 in the second embodiment.

- the processor 11Afirst operates as the attribute information acquisition unit 115 and determines whether to acquire the attribute information of the user of each logged-in user terminal UT (step S111). If there is a user who has not yet acquired attribute information among the logged-in users of the user terminal UT, the processor 11A acquires the attribute information of that user and stores it in the attribute information storage section of the data memory 12. 123 (step S112). After that, the processor 11A moves to the process of step S111 described above.

- step S111If it is determined in step S111 that the attribute information is not acquired, the processor 11A operates as the control signal acquisition unit 114 and determines whether there is a control signal from the input device 16 or the management server 30 ( Step S113). If there is a control signal, the processor 11A causes the selection condition storage unit 124 of the data memory 12 to store the selection condition indicating the attribute information to be selected with priority, which is indicated by the control signal (step S114). After that, the processor 11A moves to the process of step S111 described above.

- step S113If it is determined in step S113 that there is no control signal, the processor 11A moves to step S101. That is, the processor 11A operates as the user image receiving unit 111, acquires the user's video images from each logged-in user terminal UT, and reduces the number of vertical and horizontal pixels of the acquired user's video images or their vertical and horizontal pixels. The moving image is stored in the user image storage section 121 of the data memory 12.

- the processor 11Aoperates as the image selection section 112 and uses a prescribed user selection algorithm from the attribute information stored in the attribute information storage section 123 of the data memory 12 and the selection conditions stored in the selection condition storage section 124. Based on this, for example, moving images of 20 people are selected from among the moving images of 50 people stored in the user image storage unit 121 (step S115).

- the processor 11Athen operates as the selected image transmitting unit 113 and transmits the video images of the selected 20 people (or the video images obtained by reducing them) and the attribute information of those users to the higher-level processing server 20 ( Step S116).

- step S104the processor 11A moves to the process of step S104, and determines whether or not to end the operation shown in this flowchart.

- FIG. 17is a flowchart illustrating an example of the operation of the higher-level processing server 20 in the second embodiment.

- the processor 21Afirst operates as the control signal acquisition unit 215 and determines whether there is a control signal from the input device 26 or the management server 30 (step S211). If there is a control signal, the processor 21A causes the selection condition storage unit 223 of the data memory 22 to store the selection condition indicating the attribute information to be selected with priority, which is indicated by the control signal (step S212). ). Thereafter, the processor 11A proceeds to the process of step S211.

- step S211If it is determined in step S211 that there is no control signal, the processor 21A operates as the selected image receiving unit 211, and receives data from each of the 20 people from the first and second lower processing servers 10-1 and 10-2.

- the moving images and attribute informationare acquired, and the acquired moving images for a total of 40 people or their reduced vertical and horizontal pixel numbers and attribute information are stored in the image storage unit 221 (step S213).

- the processor 21Aoperates as the image selection section 212 and selects a prescribed user selection algorithm from the attribute information stored in the image storage section 221 of the data memory 12 and the selection conditions stored in the selection condition storage section 223. Based on this, for example, moving images of 16 people are selected from among the moving images of a total of 40 people stored in the image storage section 221 of the data memory 22 (step S214). Thereafter, the processor 21A moves to the process of step S203, operates as the display screen creation unit 213, and creates a display screen that combines the moving images of the selected 16 people or the reduced moving images thereof. I have to go.

- the user selection algorithmis to select a moving image of a user that matches specific attribute information

- Each server 10has an attribute information storage unit 123 that stores attribute information regarding the attributes of each of the users of the plurality of user terminals UT, and selects attribute information from among the moving images received from each of the plurality of user terminals UT according to a user selection algorithm.

- An image selection section 112that selects a plurality of moving images of users having a high degree of matching with specific attribute information among the attribute information stored in the storage section 123, and a plurality of selected moving images or their vertical and horizontal directions.

- the selected image transmitting unit 113transmits a moving image with a reduced number of pixels and attribute information for each of the plurality of moving images to the higher-level processing server 20. Further, the higher-level processing server 20 selects specific attribute information among the attribute information transmitted from the multiple lower-level processing servers 10 according to the user selection algorithm from among the moving images received from each of the multiple lower-level processing servers 10.

- an image selection unit 212that selects a plurality of moving images of users with a high degree of matching; and a display that creates a display screen on which the selected plurality of moving images or moving images obtained by reducing the number of vertical and horizontal pixels of the selected moving images are arranged.

- a screen creation unit 213is provided.

- the lower processing server 10can receive video images and attribute information for everyone, and By determining candidates for displaying user video images and sending only candidate user video images or reduced video images and attribute information to the higher-level processing server 20, data transfer amount and higher-level processing can be reduced.

- the reception load on the server 20can be reduced.

- the higher-level processing server 20can determine the user's moving image to be finally displayed and create a display screen using only the received user's moving image and attribute information.

- the processing for selecting usersis also distributed to the first lower-level processing server 10-1, the second lower-level processing server 10-2, and the higher-level processing server 20, the processing load on each server can be reduced. This also has the effect of speeding up the process of selecting a user and reducing overall delay.

- the attribute information acquisition unit 115 of the lower processing server 10acquires the attribute information answered in advance by each user, but the attribute information is not limited to being collected in advance.

- the attribute information acquisition unit 115may transmit a question to each user terminal UT that is transmitting a moving image, ask for an answer, and acquire the answer. That is, the reception of the user's moving image by the user image reception unit 111 and the acquisition of the user's attribute information by the attribute information acquisition unit 115 may be performed at the same time or at approximately the same time and at close times.

- step S111 shown in the flowchart of FIG. 16the processor 11A does not determine whether there is a user who has not yet acquired attribute information, but rather determines whether to acquire attribute information from any user. I will do it. If there is a user whose attribute information should be acquired among the users of the user terminal UT who have already logged in, the processor 11A moves to step S112 and acquires the attribute information from the user terminal UT of the user. , will be stored in the attribute information storage section 123 of the data memory 12.

- the attribute informationdoes not need to be explicitly transmitted by the user to the lower-level processing server 10 or the management server 30, and may be automatically generated by the lower-level processing server 10, for example.

- FIG. 18is a block diagram showing the software configuration of the lower processing server 10 in a second modification of the present invention.

- the processing unit 11 of the lower processing server 10 in this modificationincludes an attribute information generation unit 116 instead of the attribute information acquisition unit 115.

- the attribute information generation unit 116extracts feature amounts from the video images of each user stored in the user image storage unit 121, measures the communication environment with each user terminal UT, or acquires it from the management server 30. Then, attribute information for each user is automatically generated based on that information. Then, the attribute information generation unit 116 stores the automatically generated attribute information of each user in the attribute information storage unit 123.

- the selection conditions in the lower-level processing server 10 and the selection conditions in the higher-level processing server 20do not need to be the same.

- an event implementercan input selection conditions different from those used in the lower processing server 10 to the upper processing server 20 from the input device 26 or the management server 30.

- the higher-level processing server 20creates a display screen that includes video images of users that match the attributes desired by the event organizer, from among the video images of users narrowed down by the lower-level processing server 10 according to a certain selection condition. do. Therefore, it becomes possible to display on each user's user terminal UT a display screen containing video images of users with attributes that match the call specified by the event organizer, and collaborative actions between users participating remotely are possible. You can expect more.

- the display screen creation systemmay include a plurality of higher-level processing servers 20.

- FIG. 19is a block diagram illustrating an example of the configuration of a display screen creation system according to a fourth modification of the second embodiment.

- FIG. 19shows a system including two higher-level processing servers 20, ie, a first higher-level processing server 20-1 and a second higher-level processing server 20.

- the first higher-level processing server 20-1receives the selected image and attribute information from both the first lower-level processing server 10-1 and the second lower-level processing server 10-2, and creates a display screen.

- the second higher-level processing server 20-2receives the selected image and attribute information from both the first lower-level processing server 10-1 and the second lower-level processing server 10-2 and creates a display screen.

- the first higher-level processing server 20-1creates a display screen consisting of a video image of a user who has a high degree of match with the attribute of "favorite sports player: Ichiro baseball player”

- the second higher-level processing server 20creates a display screen consisting of a video image of a user who has a high degree of matching with the attribute "favorite sports player: Ichiro baseball player.” It is possible to create a display screen consisting of a video image of a user that has a high degree of matching with the attributes of "athlete: soccer player Iniesta.”

- the event managercan switch as appropriate from the management server 30 which display screen to display on the screen or the like at the event venue.

- the taste screens created by the first and second upper processing servers 20-1 and 20-2are sent to the user terminal UT via the first lower processing server 10-1 and the second lower processing server 10-2. You may also do so.

- the first higher-level processing server 20-1transmits the created display screen and the attribute information used for selection to both the first lower-level processing server 10-1 and the second lower-level processing server 10-2.

- the second higher-level processing server 20-2transmits the created display screen and the attribute information used for selection to both the first lower-level processing server 10-1 and the second lower-level processing server 10-2.

- the lower processing server 10which has received the two display screens from the first and second upper processing servers 20-1 and 20-2, distributes the two display screens in accordance with the user's attribute information.

- FIG. 20is a block diagram showing the software configuration of the lower processing server 10 in the fourth modification of the second embodiment.

- the processing unit 11includes a display screen receiving unit 117 and a distribution unit 118 in addition to the configuration of the second embodiment.

- the data memory 12includes a display screen storage section 125 in addition to the configuration of the second embodiment.

- the display screen receiving unit 117 of the processing unit 11has a function of receiving the display screen and attribute information transmitted from the first and second upper processing servers 20-1 and 20-2, respectively, through the communication interface 14.

- the display screen receiving unit 117stores the received display screen and attribute information in the display screen storage unit 125 of the data memory 12.

- the distribution unit 118 of the processing unit 11transmits the display screen to the destination user terminal UT, it checks the attribute information of the user of the user terminal UT from the stored contents of the attribute information storage unit 123 of the data memory 12. Then, the distribution unit 118 selects a display screen having attribute information that matches the confirmed attribute information from among the display screens stored in the display screen storage unit 125, and transmits the selected display screen to the communication It is transmitted to the destination user terminal UT via the interface 14.

- FIG. 21is a flowchart illustrating an example of the operation of the lower-level processing server 10 related to distribution processing in the fourth modification of the second embodiment.

- the processor 11A of the lower processing server 10can perform the processing shown in this flowchart, for example, by executing an image relay program stored in advance in the program memory 11B.

- the image relay programincludes, in addition to a program part for relaying moving images from the user terminal UT to the higher-level processing server 20, a program part for relaying the display screen from the higher-level processing server 20 to the user terminal UT,

- the distribution process shown in FIG. 21is a process related to the latter program part.

- the processor 11Aoperates as the display screen receiving unit 117 and acquires the display screen and attribute information from each of the first and second upper processing servers 20-1 and 20-2 (step S121). That is, the processor 11A receives the display screen and attribute information from both lower-level processing servers 10, and stores the received display screen and attribute information in the display screen storage unit 125.

- the processor 11Atransmits the display screen to each user terminal UT based on the attribute information of each display screen and the attribute information of each user (step S122). For example, a display screen from the first higher-level processing server 20-1 is sent to the user terminal UT of a user who has a high degree of matching of the attribute information "Favorite sports player: Baseball player Ichiro", and the display screen "Favorite sports player: Ichiro baseball player” is sent to the user terminal UT.

- the display image from the second higher-level processing server 20-2is transmitted to the user terminal UT of the user with a high degree of matching with the attribute information of the soccer player "Iniesta.”

- each user's user terminal UTwill display a display screen that includes video images of users similar to his or her own attributes, creating a virtual meeting place for users who participate remotely. .

- the processor 11Adetermines whether to end the operation shown in this flowchart (step S123). For example, when the processor 11A receives a termination instruction from the input device 16 or receives a control signal instructing termination from the higher-level processing server 20 or the management server 30, the processor 11A determines to terminate. If it is determined that the process has not ended yet, the processor 11A moves to the process of step S121 described above. Furthermore, if it is determined that the process is to end, the processor 11A ends the operation shown in this flowchart.

- control signalmay include a parameter designation command so that the number of user-selected moving images can be changed.

- the display screen created by the display screen creation unit 213 of the upper processing server 20can be modified as described in the fourth modification to the sixth modification of the first embodiment. Needless to say.

- FIG. 22is a block diagram showing the software configuration of the lower processing server 10 in the third embodiment of the present invention.

- the processing unit 11includes an input information acquisition unit 119 instead of the attribute information acquisition unit 115 in the configuration of the second embodiment.

- the data memory 12includes an input information storage section 126 instead of the attribute information storage section 123 in the first embodiment.

- the input information acquisition unit 119 of the processing unit 11has a function of acquiring input information transmitted from an input device included in each user terminal UT, and storing the acquired input information in the input information storage unit 126 of the data memory 12. .

- the input information acquisition unit 119can acquire, as input information, for example, audio information input through a microphone included in the user terminal UT.

- the control signal acquisition unit 114 of the processing unit 11 in this embodimentacquires the control signal input from the input device 16 or transmitted from the management server 30, and applies the selection condition indicated by the acquired control signal to the data memory 12. is stored in the selection condition storage unit 124 of.

- the selection condition in this embodimentspecifies input information that should be selected with priority.

- the selection conditioncan be a specific string of characters.

- the image selection unit 112 of the processing unit 11 in this embodimenthas a function of converting input voice information, which is input information stored in the input information storage unit 126 of the data memory 12, into text using the existing Speech to Text technology. Then, the image selection unit 112 transmits the character string converted to text and the selection conditions stored in the selection condition storage unit 124 to the higher-level processing server 20 with a high matching degree based on a prescribed user selection algorithm. Select the video of the user you want to use. In this case, the prescribed user selection algorithm is to select the video images of, for example, the top 20 users who highly match the input information of the selection conditions.

- the image selection unit 112transmits the selection result to the selected image transmission unit 113 of the processing unit 11, but in this embodiment, the selection result also includes input information on the selected moving image.

- the input information in this selection resultmay be the input voice information itself stored in the input information storage section 126, but is preferably converted text in order to reduce the communication load.

- the prescribed user selection algorithm in the image selection unit 112may be such that, when there are multiple users with a high matching degree, moving images of those users are randomly selected.

- the selected image transmitting unit 113 of the processing unit 11 in this embodimenttransmits images of 50 people stored in the user image storage unit 121 of the data memory 12 according to the selection result of the image selection unit 112, as in the second embodiment.

- the video images of 20 peopleare read out from the video images of .

- the selected image transmitting unit 113 in this embodimenttransmits the read moving images or the moving images obtained by reducing the number of vertical and horizontal pixels to the higher-level processing server 20 through the communication interface 14 along with the respective input information. It has the function of

- the software configuration of the host processing server 20 according to the third embodiment of this inventionis the same as that of the second embodiment shown in FIG. 15.

- the selected image receiving unit 211 of the processing unit 21receives the user's moving image and its input information transmitted from the lower processing server 10, and stores it in the image storage unit 221 of the data memory 22. It has the function of That is, the image storage unit 221 of the data memory 22 in this embodiment stores moving images for a total of 40 people (or moving images obtained by reducing the moving images) and input information for each moving image.

- the image selection unit 212 of the processing unit 21 in this embodimentuses a prescribed user selection algorithm from the input information stored in the image storage unit 221 of the data memory 12 and the selection conditions stored in the selection condition storage unit 223. It has a function of selecting a moving image to be used for the display screen from among the moving images stored in the image storage section 221 of the data memory 22 based on the above. That is, the image selection unit 212 selects, for example, the video images of the top 16 users who have a high degree of agreement with the input information of the selection condition from among the video images of a total of 40 users stored in the image storage unit 221. . Similar to the second embodiment, the image selection unit 212 transmits the selection result to the display screen creation unit 213 of the processing unit 21.

- the prescribed user selection algorithm in the image selection unit 212may be such that, when there are multiple users whose input information matches highly, the video images of those users are randomly selected.

- FIG. 23is a flowchart illustrating an example of the operation of the lower-level processing server 10 in the third embodiment.

- the processor 11Afirst executes the process of step S113. That is, the processor 11A operates as the control signal acquisition unit 114 and determines whether there is a control signal from the input device 16 or the management server 30. If there is a control signal, the processor 11A moves to step S114 and sets selection conditions indicating input information to be selected with priority, such as a specific character string, indicated by the control signal. , will be stored in the selection condition storage section 124 of the data memory 12.

- step S113determines whether there is no control signal. If it is determined in step S113 that there is no control signal, the processor 11A moves to step S101. That is, the processor 11A operates as the user image receiving unit 111, acquires the user's moving image from each logged-in user terminal UT, and stores the acquired user's moving image or a reduced version of the user's moving image in the data memory 12. The image is stored in the user image storage unit 121.

- the processor 11Afurther operates as an input information acquisition unit 119 to acquire input information transmitted from an input device included in each user terminal UT, and converts the acquired input information into input information in the data memory 12.

- the informationis stored in the storage unit 126 (step S131).

- the processor 11Aoperates as the image selection section 112 and selects the prescribed selection conditions from the input information stored in the input information storage section 126 of the data memory 12 and the selection conditions stored in the selection condition storage section 124.

- the processor 11ABased on the user selection algorithm, for example, moving images of 20 people are selected from among the moving images of 50 people stored in the user image storage unit 121 (step S132).