WO2020197256A1 - Electronic device for detecting extorted user utterance and method for operating same - Google Patents

Electronic device for detecting extorted user utterance and method for operating sameDownload PDFInfo

- Publication number

- WO2020197256A1 WO2020197256A1PCT/KR2020/004044KR2020004044WWO2020197256A1WO 2020197256 A1WO2020197256 A1WO 2020197256A1KR 2020004044 WKR2020004044 WKR 2020004044WWO 2020197256 A1WO2020197256 A1WO 2020197256A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- sound

- electronic device

- speech

- synthesized sound

- frequency band

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Ceased

Links

Images

Classifications

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04L—TRANSMISSION OF DIGITAL INFORMATION, e.g. TELEGRAPHIC COMMUNICATION

- H04L9/00—Cryptographic mechanisms or cryptographic arrangements for secret or secure communications; Network security protocols

- H04L9/40—Network security protocols

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L17/00—Speaker identification or verification techniques

- G10L17/02—Preprocessing operations, e.g. segment selection; Pattern representation or modelling, e.g. based on linear discriminant analysis [LDA] or principal components; Feature selection or extraction

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L17/00—Speaker identification or verification techniques

- G10L17/06—Decision making techniques; Pattern matching strategies

Definitions

- Various embodiments of the present disclosurerelate to an electronic device for detecting a hijacked user utterance, and a method of operating the same.

- portable digital communication devicesFor many people living in modern times, portable digital communication devices have become an essential element. Consumers want to receive a variety of high-quality services they want anytime, anywhere by using portable digital communication devices.

- the voice recognition serviceis a service for providing various content services to consumers in response to a user's voice received based on a voice recognition interface implemented in portable digital communication devices.

- portable digital transmittersinclude technologies that recognize and analyze human language (eg, automatic speech recognition, natural language understanding, natural language generation, machine translation, dialogue system, question and answer, speech recognition/synthesis, Etc.) is implemented.

- the electronic devicemay receive a speech from a user while an intelligent voice service application is being executed, and provide a service corresponding to the received speech using the intelligent voice service application.

- the user utterancemay be stolen (or recorded) by another recording device in the vicinity of the electronic device.

- the user of the recording deviceie, the hijacker

- personal information of a genuine user of the electronic deviceis leaked to the hijacker while receiving a service from the electronic device, thereby making the security of the personal information vulnerable.

- the electronic device and its operating methodoutput various types of sounds (eg, sound having an inaudible frequency band) each time a user speech is received, and include user speech and various types of sounds. Synthetic sound can be obtained. According to various embodiments, the electronic device and its operation method determine whether or not the currently received user utterance is stolen based on the result of comparing the obtained synthesized sound and the previously stored synthesized sound. It can solve the problem of weak information security.

- soundseg, sound having an inaudible frequency band

- a microphone, a memory, and at least one processorare included, and when instructions stored in the memory are executed, the at least one processor executes an intelligent voice service application, and during execution of the intelligent voice service application Receives a first speech through the microphone, obtains a first synthesized sound based on the first speech and a first sound having an inaudible frequency band, and a first speech related to the first speech among a plurality of pre-stored sounds A comparison result of the second synthesized sound and the first synthesized sound is obtained, and the second synthesized sound includes a second sound having an inaudible frequency band different from that of the first sound, and based on the comparison result, the An electronic device may be provided that enables a service corresponding to the first speech to be provided by an intelligent voice service application.

- a method of operating an electronic deviceexecuting an intelligent voice service application, receiving a first speech through a microphone of the electronic device during execution of the intelligent voice service application, and the first speech And obtaining a first synthesized sound based on the first sound having an inaudible frequency band, obtaining a comparison result of the second synthesized sound related to the first speech among a plurality of pre-stored sounds and the first synthesized sound.

- the second synthesized soundincludes a second sound having an inaudible frequency band different from the first sound, and based on the comparison result, the first speech by the intelligent voice service application

- a method of operationmay be provided, further comprising the step of providing a service corresponding to.

- a databaseat least one processor, and when instructions stored in the memory are executed, the at least one processor obtains a first synthesized sound, and the first synthesized sound is an intelligent voice Confirming a second synthesized sound related to the first utterance among a plurality of sounds obtained based on the first utterance and the first sound having an inaudible frequency band received during execution of the service application, and stored in advance in the database,

- the second synthesized soundincludes a second sound having an inaudible frequency band different from that of the first sound, and the first synthesized sound and the second synthesized sound are compared, and the first synthesized sound and the second

- An electronic devicemay be provided that checks a degree of similarity between synthesized sounds and, based on the confirmed degree of similarity, provides a service corresponding to the first speech by the intelligent voice service application.

- the electronic deviceoutputs various types of sounds (e.g., sounds having an inaudible frequency band) each time a user speech is received, and obtains a synthesized sound including the user speech and various types of sounds. can do.

- the security of the voice recognition service and the security of personal informationare weakened by checking whether the currently received user utterance is stolen based on the result of comparing the obtained synthesized sound and the previously stored synthesized sound.

- FIG. 1is a block diagram illustrating an integrated intelligence system according to various embodiments.

- FIG. 2is a diagram illustrating a form in which relationship information between a concept and an operation is stored in a database according to various embodiments.

- FIG. 3is a diagram illustrating a screen in which a user terminal processes a voice input received through an intelligent app, according to various embodiments.

- FIG. 4is a diagram illustrating an example of a configuration of an intelligent system according to various embodiments.

- FIG. 5is a diagram for describing an example of a configuration of an intelligent system according to various embodiments.

- FIG. 6is a flowchart illustrating an example of an operation of an electronic device and an external electronic device according to various embodiments of the present disclosure.

- FIG. 7is a diagram illustrating an example of an operation of an electronic device and an external electronic device according to various embodiments of the present disclosure.

- FIG. 8is a flowchart illustrating an example of operations of an electronic device and an external electronic device according to various embodiments of the present disclosure.

- FIG. 9is a diagram illustrating an example of an operation of an electronic device and an external electronic device according to various embodiments of the present disclosure.

- FIG. 10is another diagram illustrating an example of an operation of an electronic device and an external electronic device according to various embodiments of the present disclosure.

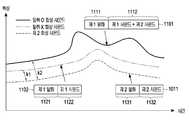

- 11is a diagram illustrating a comparison result between synthesized sounds according to whether or not utterance is deodorized according to various embodiments.

- FIG. 12is a flowchart illustrating another example of operations of an electronic device and an external electronic device according to various embodiments of the present disclosure.

- FIG. 13is a diagram for describing an example of an operation of outputting sound having an inaudible frequency band of an electronic device according to various embodiments of the present disclosure.

- FIG. 14is a diagram illustrating an example of an inaudible frequency band of a captured speech when randomly outputting a sound having an inaudible frequency band according to various embodiments.

- 15is a flowchart illustrating an example of an operation of randomly outputting a sound having an inaudible frequency band of an electronic device according to various embodiments of the present disclosure.

- 16is a diagram for describing an example of an operation of acquiring data to output sounds having different inaudible frequency bands according to various embodiments.

- 17is a diagram for describing another example of an operation of acquiring data to output sounds having different inaudible frequency bands according to various embodiments.

- 18is a diagram for describing another example of an operation of acquiring data to output sounds having different inaudible frequency bands according to various embodiments.

- 19is a flowchart illustrating an example of an operation of an external electronic device according to various embodiments of the present disclosure.

- 20is a diagram for describing an example of an operation of an external electronic device according to various embodiments.

- 21is a flowchart illustrating still another example of operations of an electronic device and an external electronic device according to various embodiments of the present disclosure.

- 22is a diagram for describing still another example of operations of an electronic device and an external electronic device according to various embodiments of the present disclosure.

- FIG 23is another diagram for describing still another example of operations of an electronic device and an external electronic device according to various embodiments of the present disclosure.

- 24is a flowchart illustrating another example of an operation of an electronic device according to various embodiments.

- 25is a block diagram of an electronic device in a network environment according to various embodiments of the present disclosure.

- FIG. 1is a block diagram illustrating an integrated intelligence system, according to various embodiments.

- an integrated intelligent system 10may include a user terminal 100, an intelligent server 200, and a service server 300.

- the user terminal 100may be a terminal device (or electronic device) capable of connecting to the Internet.

- the user terminal 100may be a mobile phone, a smart phone, a personal digital assistant (PDA), or a notebook computer.

- PDApersonal digital assistant

- the user terminal 100may include a communication interface 110, a microphone 120, a speaker 130, a display 140, a memory 150, or a processor 160.

- the components listed abovemay be operatively or electrically connected to each other.

- the communication interface 110may be configured to transmit and receive data by being connected to an external device.

- the microphone 120may receive sound (eg, user speech) and convert it into an electrical signal.

- the speaker 130 of an embodimentmay output an electrical signal as sound (eg, voice).

- the display 140may be configured to display an image or video.

- the display 140 according to an exemplary embodimentmay also display a graphic user interface (GUI) of an executed app (or application program).

- GUIgraphic user interface

- the memory 150may store a client module 151, a software development kit (SDK) 153, and a plurality of apps 155.

- the client module 151 and the SDK 153may constitute a framework (or a solution program) for performing a general function.

- the client module 151 or the SDK 153may configure a framework for processing voice input.

- the plurality of apps 155may be programs for performing a specified function.

- the plurality of apps 155may include a first app 155_1 and a second app 155_3.

- each of the plurality of apps 155may include a plurality of operations for performing a specified function.

- the appsmay include an alarm app, a message app, and/or a schedule app.

- the plurality of apps 155may be executed by the processor 160 to sequentially execute at least some of the plurality of operations.

- the processor 160may control the overall operation of the user terminal 100.

- the processor 160may be electrically connected to and connected to the communication interface 110, the microphone 120, the speaker 130, and the display 140 to perform a designated operation.

- the processor 160may also execute a program stored in the memory 150 to perform a designated function.

- the processor 160may execute at least one of the client module 151 and the SDK 153 to perform the following operation for processing a voice input.

- the processor 160may control the operation of the plurality of apps 155 through, for example, the SDK 153.

- the following operation described as the operation of the client module 151 or the SDK 153may be an operation by execution of the processor 160.

- the client module 151 of an embodimentmay receive a voice input.

- the client module 151may receive a voice signal corresponding to a user's speech sensed through the microphone 120.

- the client module 151may transmit the received voice input to the intelligent server 200.

- the client module 151may transmit state information of the user terminal 100 to the intelligent server 200 together with the received voice input.

- the status informationmay be, for example, information on an execution status of an app.

- the client module 151may receive a result corresponding to the received voice input. For example, when the intelligent server 200 can calculate a result corresponding to the received voice input, the client module 151 may receive a result corresponding to the received voice input. The client module 151 may display the received result on the display 140.

- the client module 151may receive a plan corresponding to the received voice input.

- the client module 151may display a result of executing a plurality of operations of the app on the display 140 according to the plan.

- the client module 151may sequentially display execution results of a plurality of operations on the display, for example.

- the user terminal 100may display only a partial result of executing a plurality of operations (eg, a result of the last operation) on the display.

- the client module 151may receive a request from the intelligent server 200 to obtain information necessary to calculate a result corresponding to a voice input. According to an embodiment, the client module 151 may transmit the necessary information to the intelligent server 200 in response to the request.

- the client module 151may transmit information as a result of executing a plurality of operations according to a plan to the intelligent server 200.

- the intelligent server 200may confirm that the received voice input is correctly processed using the result information.

- the client module 151may include a voice recognition module. According to an embodiment, the client module 151 may recognize a voice input performing a limited function through the voice recognition module. For example, the client module 151 may perform an intelligent app for processing a voice input for performing an organic operation through a designated input (eg, wake up!).

- a voice recognition modulemay recognize a voice input performing a limited function through the voice recognition module. For example, the client module 151 may perform an intelligent app for processing a voice input for performing an organic operation through a designated input (eg, wake up!).

- the intelligent server 200may receive information related to a user voice input from the user terminal 100 through a communication network. According to an embodiment, the intelligent server 200 may change data related to the received voice input into text data. According to an embodiment, the intelligent server 200 may generate a plan for performing a task corresponding to a user voice input based on the text data.

- the planmay be created by an artificial intelligent (AI) system.

- the artificial intelligence systemmay be a rule-based system, or a neural network-based system (e.g., a feedforward neural network (FNN)), a recurrent neural network (RNN). It may be ))). Alternatively, it may be a combination of the above or another artificial intelligence system.

- the planmay be selected from a set of predefined plans, or may be generated in real time in response to a user request. For example, the artificial intelligence system may select at least one of a plurality of predefined plans.

- the intelligent server 200may transmit a result according to the generated plan to the user terminal 100 or may transmit the generated plan to the user terminal 100.

- the user terminal 100may display a result according to the plan on the display.

- the user terminal 100may display a result of executing an operation according to a plan on a display.

- the intelligent server 200 of one embodimentincludes a front end 210, a natural language platform 220, a capsule DB 230, an execution engine 240, and It may include an end user interface 250, a management platform 260, a big data platform 270, or an analytic platform 280.

- the front end 210 of an embodimentmay receive a voice input received from the user terminal 100.

- the front end 210may transmit a response corresponding to the voice input.

- the natural language platform 220includes an automatic speech recognition module (ASR module) 221, a natural language understanding module (NLU module) 223, a planner module ( A planner module 225, a natural language generator module (NLG module) 227, or a text to speech module (TTS module) 229 may be included.

- ASR moduleautomatic speech recognition module

- NLU modulenatural language understanding module

- NTL modulenatural language generator module

- TTS moduletext to speech module

- the automatic speech recognition module 221may convert a voice input received from the user terminal 100 into text data.

- the natural language understanding module 223may determine the user's intention by using text data of voice input. For example, the natural language understanding module 223 may grasp a user's intention by performing syntactic analysis or semantic analysis.

- the natural language understanding module 223 of an embodimentgrasps the meaning of the word extracted from the voice input using the linguistic features (eg, grammatical elements) of a morpheme or phrase, and matches the meaning of the identified word with the intention of the user. You can determine your intentions.

- the planner module 225may generate a plan using the intention and parameters determined by the natural language understanding module 223. According to an embodiment, the planner module 225 may determine a plurality of domains necessary to perform a task based on the determined intention. The planner module 225 may determine a plurality of operations included in each of a plurality of domains determined based on the intention. According to an embodiment, the planner module 225 may determine a parameter required to execute the determined plurality of operations or a result value output by executing the plurality of operations. The parameter and the result value may be defined as a concept of a designated format (or class). Accordingly, the plan may include a plurality of operations and a plurality of concepts determined by the intention of the user.

- the planner module 225may determine a relationship between the plurality of operations and the plurality of concepts in stages (or hierarchical). For example, the planner module 225 may determine an execution order of a plurality of operations determined based on a user's intention based on a plurality of concepts. In other words, the planner module 225 may determine the execution order of the plurality of operations based on parameters required for execution of the plurality of operations and a result output by the execution of the plurality of operations. Accordingly, the planner module 225 may generate a plan including a plurality of operations and related information (eg, ontology) between a plurality of concepts. The planner module 225 may generate a plan using information stored in the capsule database 230 in which a set of relationships between concept and operation is stored.

- the planner module 225may determine an execution order of a plurality of operations determined based on a user's intention based on a plurality of concepts. In other words, the planner module 225 may determine the execution order of the plurality of operations based on parameters required

- the natural language generation module 227may change designated information into a text format.

- the information changed in the text formmay be in the form of natural language speech.

- the text-to-speech module 229may change information in text form into information in voice form.

- some or all functions of the functions of the natural language platform 220may be implemented in the user terminal 100 as well.

- the capsule database 230may store information on a relationship between a plurality of concepts and operations corresponding to a plurality of domains.

- a capsulemay include a plurality of action objects (action objects or action information) and concept objects (concept objects or concept information) included in a plan.

- the capsule database 230may store a plurality of capsules in the form of a concept action network (CAN).

- CANconcept action network

- a plurality of capsulesmay be stored in a function registry included in the capsule database 230.

- the capsule database 230may include a strategy registry in which strategy information necessary for determining a plan corresponding to the voice input is stored.

- the strategy informationmay include reference information for determining one plan when there are a plurality of plans corresponding to the voice input.

- the capsule database 230may include a follow up registry in which information on a follow-up operation for suggesting a follow-up operation to a user in a specified situation is stored.

- the subsequent operationmay include, for example, a subsequent speech.

- the capsule database 230may include a layout registry that stores layout information of information output through the user terminal 100.

- the capsule database 230may include a vocabulary registry in which vocabulary information included in capsule information is stored.

- the capsule database 230may include a dialog registry in which information about a conversation (or interaction) with a user is stored.

- the capsule database 230may update an object stored through a developer tool.

- the developer toolmay include, for example, a function editor for updating an action object or a concept object.

- the developer toolmay include a vocabulary editor for updating vocabulary.

- the developer toolmay include a strategy editor for creating and registering a strategy for determining a plan.

- the developer toolmay include a dialog editor that creates a dialog with a user.

- the developer toolmay include a follow up editor capable of activating a follow-up goal and editing subsequent utterances that provide hints.

- the subsequent targetmay be determined based on a currently set target, user preference, or environmental conditions.

- the capsule database 230may be implemented in the user terminal 100 as well.

- the execution engine 240 of an embodimentmay calculate a result using the generated plan.

- the end user interface 250may transmit the calculated result to the user terminal 100. Accordingly, the user terminal 100 may receive the result and provide the received result to the user.

- the management platform 260may manage information used in the intelligent server 200.

- the big data platform 270according to an embodiment may collect user data.

- the analysis platform 280 of an embodimentmay manage the quality of service (QoS) of the intelligent server 200. For example, the analysis platform 280 may manage components and processing speed (or efficiency) of the intelligent server 200.

- QoSquality of service

- the service server 300may provide a designated service (eg, food order or hotel reservation) to the user terminal 100.

- the service server 300may be a server operated by a third party.

- the service server 300may provide information for generating a plan corresponding to the received voice input to the intelligent server 200.

- the provided informationmay be stored in the capsule database 230.

- the service server 300may provide result information according to the plan to the intelligent server 200.

- the user terminal 100may provide various intelligent services to a user in response to a user input.

- the user inputmay include, for example, an input through a physical button, a touch input, or a voice input.

- the user terminal 100may provide a voice recognition service through an intelligent app (or voice recognition app) stored therein.

- the user terminal 100may recognize a user utterance or voice input received through the microphone, and provide a service corresponding to the recognized voice input to the user. .

- the user terminal 100may perform a specified operation alone or together with the intelligent server and/or service server based on the received voice input. For example, the user terminal 100 may execute an app corresponding to the received voice input and perform a specified operation through the executed app.

- the user terminal 100when the user terminal 100 provides a service together with the intelligent server 200 and/or the service server, the user terminal detects the user's speech using the microphone 120, and A signal (or voice data) corresponding to the detected user's speech may be generated. The user terminal may transmit the voice data to the intelligent server 200 using the communication interface 110.

- the intelligent server 200is a plan for performing a task corresponding to the voice input as a response to a voice input received from the user terminal 100, or performing an operation according to the plan. Can produce results.

- the planmay include, for example, a plurality of operations for performing a task corresponding to a user's voice input, and a plurality of concepts related to the plurality of operations.

- the conceptmay be a parameter input to execution of the plurality of operations or a result value outputted by execution of the plurality of operations.

- the planmay include a plurality of operations and association information between a plurality of concepts.

- the user terminal 100may receive the response using the communication interface 110.

- the user terminal 100outputs a voice signal generated inside the user terminal 100 to the outside using the speaker 130, or externally outputs an image generated inside the user terminal 100 using the display 140.

- FIG. 2is a diagram illustrating a form in which relationship information between a concept and an operation is stored in a database according to various embodiments.

- the capsule database (eg, capsule database 230) of the intelligent server 200may store capsules in the form of a concept action network (CAN) 400.

- the capsule databasemay store an operation for processing a task corresponding to a user's voice input and a parameter necessary for the operation in the form of a concept action network (CAN) 400.

- the capsule databasemay store a plurality of capsules (capsule(A) 401, capsule(B) 404) corresponding to each of a plurality of domains (eg, applications).

- one capsuleeg, capsule(A) 401 may correspond to one domain (eg, location (geo), application).

- one capsuleincludes at least one service provider (eg, CP 1 (402), CP 2 (403), CP 3 (406), or CP 4 (405)) for performing a function for a domain related to the capsule) Can be matched.

- one capsulemay include at least one or more operations 410 and at least one concept 420 for performing a specified function.

- the natural language platform 220may generate a plan for performing a task corresponding to a received voice input using a capsule stored in a capsule database.

- the planner module 225 of the natural language platformmay create a plan using capsules stored in the capsule database. For example, using the actions 4011 and 4013 and concepts 4012 and 4014 of capsule A 410 and the action 4041 and concept 4042 of capsule B 404 to create a plan 407 can do.

- FIG. 3is a diagram illustrating a screen in which a user terminal processes a voice input received through an intelligent app, according to various embodiments.

- the user terminal 100may execute an intelligent app to process user input through the intelligent server 200.

- the user terminal 100processes the voice input.

- You can run intelligent apps for The user terminal 100may, for example, run the intelligent app while running the schedule app.

- the user terminal 100may display an object (eg, an icon) 311 corresponding to an intelligent app on the display 140.

- the user terminal 100may receive a voice input by user utterance. For example, the user terminal 100 may receive a voice input “Tell me about this week's schedule!”.

- the user terminal 100may display a user interface (UI) 313 (eg, an input window) of an intelligent app displaying text data of a received voice input on the display.

- UIuser interface

- the user terminal 100may display a result corresponding to the received voice input on the display.

- the user terminal 100may receive a plan corresponding to the received user input, and display a “this week schedule” on the display according to the plan.

- the intelligent systemis not limited to the configurations illustrated in FIG. 4, and may include more devices than the devices illustrated in FIG. 4, or may include at least one fewer devices.

- the intelligent systemmay include an electronic device 410 and an intelligent server 420 as shown in FIG. 4.

- the electronic device 410 and the intelligent server 420may be implemented like the electronic devices 410 shown in FIG. 1 (eg, 100, 200, 300), and the network environment shown in FIG. 25 ( Since it may be implemented like the electronic device 2501 in 2500), a redundant description will be omitted.

- the electronic device 410may receive the user utterance 412 from the user 411 and provide a service to the received user utterance 412.

- the electronic device 410is based on an input for executing an intelligent voice service application (eg, an intelligent app) (eg, a voice input for calling an intelligent voice service application, a button input, etc.), Service application can be executed.

- the electronic device 410may acquire the user utterance 412 while the intelligent voice service application is being executed.

- the electronic device 410may transmit information on the user utterance to the intelligent server 420 and receive an analysis result of the user utterance 412 in response thereto.

- the information on the user utterancerefers to various types of information representing the received user utterance 412, and is processed as information of a speech signal type in which the user utterance is not processed, or a text corresponding to the received user utterance (e.g. : User utterance is processed by ASR) information of text type, etc. may be included.

- the electronic device 410may receive various additional information together with the user utterance 412.

- Various additional informationmay include context information and/or user information.

- the context informationmay include information on an application or program executed in the electronic device 410, information on a current location, and the like.

- the user informationis analyzed from the user's 411's electronic device usage pattern (eg, application usage pattern), the user's personal information (eg, age, etc.), and the user 411 ) And related unique phonetic information (eg, information related to the fundamental frequency FO), and the like.

- the electronic device 410may provide a service corresponding to the user utterance 412 based on the received analysis result. For example, the electronic device 410 may display content corresponding to the user utterance 412 on the display based on the received analysis result (eg, UI/UX including content corresponding to the user utterance 412). Can be displayed. In addition, for example, the electronic device 410 performs an operation of the application corresponding to the user utterance on the electronic device 410 based on the analysis result (eg, a deep link for executing an application corresponding to the user utterance 412). You can provide the services you provide. In addition, for example, the electronic device 410 may have at least one intelligent server 420 (e.g.: IOT things devices) can be provided.

- IOT things devicese.g.: IOT things devices

- the intelligent server 420will be described.

- the intelligent server 420processes the user utterance 412 received from the electronic device 410 to provide a service corresponding to the user utterance 412. Information can be obtained.

- the intelligent server 420may refer to additional information received along with the user utterance received from the electronic device 410 to process the user utterance 412.

- the intelligent server 420may cause a user utterance to be processed by a voice assistant (eg, capsules).

- a voice assistanteg, capsules

- the intelligent server 420allows the user utterance 412 to be processed by the voice assistant provided in the intelligent server 420 to obtain processing result information from the voice assistant, or interlock with the intelligent server 420

- processing result informationcan be obtained from an external server. Since the voice assistant can perform the same operation as the capsules described above, a redundant description will be omitted.

- the processing result information obtained according to the processing of the speech by the voice assistantmay be a plan for performing the above-described task or a result of performing an operation according to the plan, a duplicate description will be omitted.

- the processing result informationmay further include at least one of a deep link including an access mechanism for accessing a specific screen of a designated application or visual information (UI/UX) for providing a service.

- the intelligent server 420may obtain a voice assistant for processing user utterances from the developer server.

- the intelligent server 420may obtain a capsule for processing user utterances from the developer server.

- a developer of the developer servermay register voice assistants with the intelligent server 420.

- the present inventionis not limited to the above description, and the intelligent server 420 may store voice assistants produced by the intelligent server 420 by itself.

- the hijacker 440 in the vicinity of the electronic device 410performs a recording function while the electronic device 410 receives the utterance from the sincere user 411 in the stolen speech 430. It may be an utterance recorded using another electronic device 410 that is present.

- the captured speech 430may include user speech 412 and various types of sounds (eg, sound having an inaudible frequency band) output through a speaker of the electronic device 410.

- an utterance other than the stolen utterance 430may be defined as an authentic user utterance

- a user 411 of the electronic device 410 from which the utterance is stolenmay be defined as an authentic user.

- the electronic device 410repeatedly outputs various types of sounds (eg, sounds having an inaudible frequency band) each time an utterance is received, and acquires various types of sounds together with the utterance.

- soundseg, sounds having an inaudible frequency band

- the electronic device 410By acquiring the synthesized sound and comparing the obtained synthesized sound with the previously acquired synthesized sound, it is possible to check whether the sound is a hijacked speech.

- various phonetic information added to the soundeg, sound having an inaudible frequency band

- the electronic device 410 and the intelligent server 420are not limited to the configurations illustrated in FIG. 5, and include more or less than the configurations illustrated in FIG. 5. It may also include the composition of. Modules described in this document (for example, the sound output module 506 shown in FIG. 5, the speech analysis module 512, and the speech comparison module 513) are coded so that a specific electronic device can perform a specified operation. It may be a program, computer code, or instructions.

- the electronic device 410stores a plurality of modules (eg, a sound output module 506) in the memory 503, and a plurality of modules included in the stored memory 503 (eg, a sound output module ( 506)) may cause the processor 505 to perform a specified operation.

- the intelligent server 420stores a plurality of modules (eg, speech analysis module 512, speech comparison module 513) in a memory, and a plurality of modules included in the stored memory (eg, speech analysis module) At 512, the utterance comparison module 513 may cause the processor 511 to perform a designated operation.

- the electronic device 410includes a processor 505 including a speaker 501, a microphone 502, a memory 503, and a sound output module 506, as shown in FIG. 5. can do.

- the speaker, microphone 502, memory 503, and processorare the same as those included in the user terminal 100 of FIG. 1 or the electronic device 2501 included in the network environment 2500 shown in FIG. 25 to be described later. Since it can be implemented, duplicate descriptions are omitted.

- the speaker 501may output various types of sounds.

- the electronic device 410may control the speaker 501 to output various types of sounds (eg, sound having an inaudible frequency band) while an intelligent voice service application is being executed.

- various types of sounds output through the speaker 501 of the electronic device 410may be applied to sounds (eg, user speech) received by the electronic device 410 through the microphone 502 from the outside. It may be a sound that has little or no effect (or does not degrade). In other words, when various types of sounds output through the speaker 501 of the electronic device 410 are received together with the sound output to the electronic device 410 from the outside, various types of sounds are transmitted from the external device 410 ) May be a sound that does not significantly affect the intensity of each frequency. For example, when the sound output to the electronic device 410 from the outside is user speech, the sound output through the speaker 501 may include sound or music in an inaudible frequency band.

- the inaudible frequency bandmay mean a frequency band that the user cannot hear.

- the inaudible frequency bandmay be a frequency band included in the 10HZ to 300GHZ band.

- the audible frequency bandmay mean a frequency band that a user can listen to.

- itis not limited to the above-described types (e.g., sound in an inaudible frequency band, music), but affects the sound (e.g., user utterance) output to the electronic device 410 from the outside output through the speaker 501

- various embodimentsare described by taking the case of outputting sound in an inaudible frequency band through the speaker 501 as an example. However, the following various embodiments apply mutatis mutandis to the case of outputting various types of phonetic sounds that do not affect sound (eg, user speech) output from the outside to the electronic device 410 through the speaker 501 Can be.

- the microphone 502may receive various types of sounds received by the electronic device 410.

- the electronic device 410may receive a user's speech through the microphone 502.

- the electronic device 410may receive various types of sounds (eg, sound having an inaudible frequency band) output through the speaker 501 of the electronic device 410 through the microphone 502.

- the electronic device 410may receive various types of synthesized sounds through the microphone 502.

- the synthesized soundmay be a sound including two or more sounds received through the microphone 502.

- the synthesized soundmay be a sound including a user's speech received through the microphone 502 and various kinds of sounds output through the speaker 501.

- the memory 503may store various types of data 504 for generating various types of sounds output through the speaker 501 of the electronic device 410.

- the electronic device 410acquires various types of data 504 stored in the memory 503, generates various types of sounds based on the various types of data 504, and generates various types of sounds.

- the speaker 501can be controlled to output. An operation of outputting various types of sounds (eg, sound having an inaudible frequency band) of the electronic device 410 will be described later with reference to FIGS. 8 to 11.

- the various types of data 504may include text data.

- the various types of data 504may include various types of electronic data for generating various types of sounds in addition to the text data.

- the various types of data 504may include various types of sound source files. Music corresponding to the sound source file based on the sound source file may be output through the speaker 501 of the electronic device 410.

- the sound output module 506may generate various types of sounds based on various types of data 504 stored in the above-described memory 503. For example, the sound output module 506 acquires at least one text data stored in the memory 503, converts the obtained text data into sound data, and modulates the frequency band of the converted sound data to obtain an inaudible frequency. You can create a sound with a band. Also, for example, the sound output module 506 may generate music based on the sound source file stored in the above-described memory 503. The sound generation operation by the sound output module 506 will be described later in FIGS. 8 to 12.

- the intelligent server 420includes a speech analysis module 512, a speech comparison module 513, and a processor 511 including a natural language platform 514, as shown in FIG. 5, and a speech database. (515) may be included.

- the speech analysis module 512may check a sound corresponding to the received sound.

- the speech analysis module 512may check a synthesized sound corresponding to the synthesized sound received from the electronic device 410 among a plurality of sounds stored in the database 515 of the intelligent server 420.

- the comparison operation between the two sounds to identify sounds corresponding to each othermay be performed based on auto speech recognition (ASR) or semantic analysis (NLU analysis) of the sound.

- ASRauto speech recognition

- NLU analysissemantic analysis

- the utterance comparison module 513may compare a sound received from the electronic device 410 with a sound stored in the database 515 corresponding to the received sound, and check similarity between the two sounds. For example, the utterance comparison module 513 may compare the characteristics (eg, intensity, etc.) of two sounds according to time to check the similarity of the two sounds. Techniques for checking the similarity between the two sounds may include linear alignment analysis including Euclidean distance analysis, and the like, and non-linear alignment analysis including dynamic time wrapping (DTW). According to various embodiments, the natural language platform 514 may process a sound received from the electronic device 410 and generate processing result information for providing a service corresponding to the received sound based on the processing result. . Redundant description of the processing result information will be omitted.

- the characteristicseg, intensity, etc.

- the utterance database 515may store a plurality of sounds.

- the utterance database 515includes sounds obtained by the electronic device 410 (eg, user device) received from the electronic device 410 by the intelligent server 420 (eg, the intelligent server 420). You can save 516.

- the intelligent server 420may receive the user utterance from the electronic device 410 and store the received user utterance in the database 515. have.

- the electronic device 410acquires a synthesized sound including user utterances and various types of sounds (eg, sound having an inaudible frequency band)

- the electronic device 410acquires a synthesized sound including user utterances and various types of sounds (eg, sound having an inaudible frequency band)

- the electronic device 410acquires a synthesized sound including user utterances and various types of sounds (eg, sound having an inaudible frequency band)

- the electronic device 410acquires a synthesized sound including user utterances and various types of sounds (eg, sound having an inaudible frequency band)

- the utterance database 515is not limited to those described above, and may store various types of sounds provided from a developer server or a cloud server other than a user device.

- the above-described components of the electronic device 410may be implemented in the intelligent server 420, or the above-described components of the intelligent server 420 may be implemented in the electronic device 410.

- the electronic device 410may include a speech analysis module 512, a speech comparison module 513, and a speech database 515 implemented in the intelligent server 420. Accordingly, the electronic device 410 checks the sound corresponding to the received user's speech among the plurality of sounds 516 stored in the speech database 515 by the speech analysis module 512, and the speech comparison module 513 ), you can compare the sounds.

- the electronic device 410may be implemented as an on-device type device that is implemented to perform operations performed by the intelligent server 420 described below.

- the intelligent server 420may be implemented as an on-device type device that is implemented to perform operations performed by the electronic device 410 described below.

- the electronic device 410may provide a service according to whether or not an utterance is captured based on a comparison result of a synthesized sound currently received and a previously stored synthesized sound.

- FIG. 6is a flowchart 600 illustrating an example of operations of the electronic device 410 and the intelligent server 420 according to various embodiments. According to various embodiments, the operations illustrated in FIG. 6 are not limited to the illustrated order and may be performed in various orders. Further, according to various embodiments, more operations may be performed than the operations illustrated in FIG. 6, or at least one less operation may be performed. Hereinafter, FIG. 6 will be described with reference to FIG. 7.

- FIG. 7is a diagram illustrating an example of operations of the electronic device 410 and the intelligent server 420 according to various embodiments.

- a "+" symbolindicates that each sound is combined and received by the microphone 502 of the electronic device.

- the electronic device 410may obtain the first synthesized sound in operation 601.

- the electronic device 410may provide a sound output from the outside during execution of an intelligent voice service application through the microphone 502 (eg, "Tell me the weather") (eg, 701, Sounds (eg, 702 and 712) output through the speaker 501 of the electronic device 410 and 711 may be received together.

- the electronic device 410includes user speech 701 output from the user 411 and sound output through the speaker 501 while the intelligent voice service application is being executed (eg, a high frequency band). Eggplant sound) 702 may be received together through the microphone 502.

- the electronic device 410is captured by the hijacker 440 during execution of the intelligent voice service application and output from the recording device 441 through the speech 711 and the speaker 501.

- the output sound (eg, sound having a high frequency band) 712may be received together through the microphone 502.

- the electronic device 410may obtain a result of comparing the first synthesized sound and the second synthesized sound in operation 602.

- the electronic device 410obtains a result of comparing the previously stored second synthesized sound and the first synthesized sound corresponding to the currently received first synthesized sound. (Eg, received from the intelligent server 420 or obtained by analyzing the electronic device 410).

- the second synthesized soundmay be an utterance including a second utterance corresponding to the first utterance included in the first synthesized sound.

- the first synthesized soundincludes a first utterance 701 of “tell me the weather”

- the second synthesized soundalso includes a second utterance 711 of “tell me the weather”. It can be sound.

- a second synthesized sound corresponding to the first synthesized soundmay be identified based on an analysis result of the ASR module (ie, analysis of a user speech portion (or audible portion) of the synthesized sound) among a plurality of pre-stored sounds. The operation of confirming the second synthesized sound corresponding to the first synthesized sound among the plurality of sounds will be described later with reference to FIGS. 8 to 10.

- the electronic device 410may obtain a comparison result including various information according to the similarity between the first synthesized sound and the second synthesized sound. . If the similarity between the first synthesized sound and the second synthesized sound is greater than or equal to a preset value, the first utterance 701 is a user utterance, and if the similarity between the first synthesized sound and the second synthesized sound is less than a preset value, It could be an ignition. That is, the comparison result may include various types of information depending on whether the first speech included in the currently received first synthesized sound is a stolen speech. The comparison of the first synthesized sound and the second synthesized sound and the operation of determining whether to take off according to the similarity between the two synthesized sounds will be described later with reference to FIGS. 8 to 10.

- the comparison resultindicates a service corresponding to the first speech.

- Processing result information to be providedeg, UI/UX for indicating information related to the first utterance 701

- Redundant descriptions related to processing result information for providing a servicewill be omitted.

- the comparison resultis the currently received first speech 701 May include information for indicating that is a stolen ignition.

- the electronic device 410(eg, at least one processor 505) has a degree of similarity between the first synthesized sound and the second synthesized sound equal to or greater than a preset value (ie, the first speech is In the case of user speech), a service corresponding to the first synthesized sound may be provided in operation 604.

- the electronic device 410may provide a service corresponding to the first speech based on processing result information included in the above-described comparison result.

- the electronic device 410provides a UI/UX for displaying today's weather information in response to the utterance 701 of “tell me the weather” received from the user. 410).

- the electronic device 410(for example, at least one processor 505) has a similarity between the first synthesized sound and the second synthesized sound less than a preset value in operation 603 (i.e., the utterance from which the first utterance is captured). In this case, in operation 605, provision of a service corresponding to the first synthesized sound may be prohibited.

- the electronic device 410provides an utterance including a specific keyword in order to check whether the user currently using the electronic device 410 is a genuine user. Can be requested. An operation of requesting the provision of speech including a specific keyword will be described later with reference to FIGS. 21 to 23.

- the electronic device 410when the electronic device 410 acquires additional information along with the user's speech, and it is determined that the user providing the current speech based on the additional information is not a genuine user, the above-described synthetic sound Provision of a service corresponding to an utterance can be prohibited without the need to perform a comparison operation.

- the electronic device 410outputs various types of sounds (for example, sounds in an inaudible frequency band) and compares the synthesized sounds obtained accordingly, By prohibiting the provision of the voice service, the security of the voice service and the security of personal information may be improved.

- soundsfor example, sounds in an inaudible frequency band

- the electronic device 410performs an analysis operation for comparing the phonetic characteristics of the actual speech of the user of true intention with the phonetic characteristics of the currently received speech ( Example: An analysis operation based on a learning model using deep learning, etc.) can be performed.

- the electronic device 410stores various data (for example, a learning model) for performing an analysis operation, and determines whether the speech is stolen by performing an operation to check the data. May increase the operational burden.

- whether or not it is a hijacked speechis determined by a relatively small number of processors due to various types of sounds (eg, sound having an inaudible frequency band) added to the currently received speech. Can be confirmed, the relative operational burden can be reduced.

- soundseg, sound having an inaudible frequency band

- the electronic device 410may transmit the currently received synthesized sound to the intelligent server 420.

- the intelligent server 420compares the received synthesized sound with the previously stored synthesized sound to check whether the utterance is deodorized (that is, whether the utterance is an authentic user utterance), and according to whether the utterance is deodorized, the electronic device 410 is It is possible to provide a service corresponding to the speech.

- FIG. 8is a flowchart 800 illustrating an example of operations of the electronic device 410 and the intelligent server 420 according to various embodiments. According to various embodiments, the operations illustrated in FIG. 8 are not limited to the illustrated order and may be performed in various orders. In addition, according to various embodiments, more operations than the operations illustrated in FIG. 8 may be performed, or at least one less operation may be performed. Hereinafter, FIG. 8 will be described with reference to FIGS. 9 to 11.

- FIG. 9is a diagram illustrating an example of operations of the electronic device 410 and the intelligent server 420 according to various embodiments.

- a "+" symbolindicates that each sound is combined and received by the microphone 502 of the electronic device.

- 10is another diagram illustrating an example of operations of the electronic device 410 and the intelligent server 420 according to various embodiments.

- 11is a diagram illustrating a comparison result between synthesized sounds according to whether or not utterance is deodorized according to various embodiments.

- the electronic device 410may execute an intelligent voice service application in operation 801.

- the electronic device 410may control the display to display an execution screen of the intelligent service application based on the execution of the intelligent service application, as illustrated in 901 of FIG. 9.

- the electronic device 410receives a user's wake-up command through the microphone 502, and based on the received wake-up command, a user input (eg, : You can run an intelligent voice service application to receive user speech).

- a user inputeg, : You can run an intelligent voice service application to receive user speech.

- the wakeup commandmay be a user utterance including a designated voice (eg, wake up!, Hi Bixby!) received through the microphones 502 and 111 of the electronic device 410.

- the electronic device 410may store at least one designated voice in the memory 503 and execute an intelligent voice service application when the voice received through the microphone 502 corresponds to at least one designated voice stored therein.

- the wakeup commandmay be a user input received through a hardware key 910 implemented in the electronic device 410.

- the wakeup commandmay be a user input for selecting an icon for executing an intelligent voice service application.

- the electronic device 410(for example, the sound output module 506 of the at least one processor 505) transmits the first sound having an inaudible frequency band through the speaker 501 in operation 802. Can be printed.

- the sound having the inaudible frequency bandmay be a sound including not only sound in the inaudible frequency band, but also in other audible frequency bands. Since the inaudible frequency band has been described above, redundant descriptions will be omitted.

- the electronic device 410determines that the first sound having an inaudible frequency band is

- the speaker 501can be controlled to output. Satisfaction of the various conditions is when the intelligent voice service application is executed, a preset time elapses after the execution of the intelligent voice service application, or a specific event (for example, the microphone 502 of the electronic device 410) during execution of the intelligent application. ), the user's input for activating) is generated.

- the electronic device 410may control the speaker 501 to output a first sound having an inaudible frequency band in response to execution of an intelligent voice service application.

- the electronic device 410controls the speaker 501 to output a first sound having an inaudible frequency band for a specified time. Can be controlled.

- the designated timemay be set to a time period in which the electronic device 410 is likely to receive a speech while the intelligent voice service application is being executed. For example, after the intelligent voice service application is executed, the electronic device 410 may have an inaudible frequency band only for a period of time (for example, 3 seconds) that a speech is likely to be received from the execution time of the intelligent voice service application. 1

- the speaker 501can be controlled to output sound.

- the electronic device 410(for example, the sound output module 506 of the at least one processor 505) generates the first sound having an inaudible frequency band while the intelligent voice service application is being executed.

- At least one of a plurality of data stored in the memory 503may be obtained.

- the electronic device 410may include at least one text data 911 (for example, at least one text data 911) stored in the memory 503 for generating a first sound having an inaudible frequency band.

- First text data, second text datamay be obtained.

- the electronic device 410may randomly obtain data from among the plurality of data 504 in order to randomly generate a sound (eg, a first sound) having an inaudible frequency band. Accordingly, whenever sound having an inaudible frequency band is output, the electronic device 410 may output sounds having different inaudible frequency bands, which will be described later with reference to FIGS. 13 to 19.

- the electronic device 410(for example, the sound output module 506 of the at least one processor 505) generates at least one acquired data as sound data, and makes the generated sound data inaudible. It can be converted to a sound having a frequency band.

- the electronic device 410may convert at least one acquired text data into sound data. Since the operation of generating sound data from the data may be performed by a conventional text-to-speech (TTS) technology, a detailed description thereof will be omitted. In this case, when the number of acquired data is plural, the electronic device 410 may merge the plurality of data and generate sound data based on the merged data.

- TTStext-to-speech

- the electronic device 410may randomly combine texts with the acquired text data or may merge each text by arranging it in a line.

- the electronic device 410may merge them to obtain the text NucleicFloyd.

- the electronic device 410combines them to obtain each preset unit (eg, letter), such as NuclFloydeic. (one letter)) can be combined in any order.

- the acquired datamay be converted into various types of sounds that do not affect speech (eg, user speech) received through the microphone 502. Since various types of sounds are the same as described above, overlapping descriptions will be omitted.

- the electronic device 410(for example, the sound output module 506 of the at least one processor 505) outputs the same sound or a different sound whenever it outputs a sound having an inaudible frequency. Sound can be output. For example, whenever a sound having an inaudible frequency is output, the electronic device 410 may generate and output a sound having an inaudible frequency based on the same data. Also, for example, the electronic device 410 may randomly output a sound having an inaudible frequency so that the second sound and the first sound are different from each other.

- the electronic device 410may receive the first speech through the microphone 502 while the intelligent voice service application is being executed in operation 803. For example, while an intelligent voice service application is being executed, the electronic device 410 may acquire a user utterance for requesting provision of a specific service from the user. In addition, for example, while the intelligent voice service application is being executed, the electronic device 410 may acquire the stolen speech output from the speaker 501 of another intelligent server 420.

- the electronic device 410may obtain a first synthesized sound based on a first sound having a first speech and an inaudible frequency band in operation 804.

- the electronic device 410may obtain a first synthesized sound based on a first sound having a first speech and an inaudible frequency band in operation 804.

- the electronic device 410may obtain a first synthesized sound based on a first sound having a first speech and an inaudible frequency band in operation 804.

- the electronic device 410as shown in 903 of FIG. 9, through the speaker 501 together with the first speech (eg, user speech or hijacked user speech) 913 through the microphone 502

- the first sound 912 of the output inaudible frequency bandmay be received together.

- the first synthesized sound 914may be a sound including a first speech 913 and a first sound 914 in an inaudible frequency band.

- the electronic device 410may transmit information on the first synthesized sound 914 obtained as shown in 904 of FIG. 9. It can be transmitted to the intelligent server 420.

- the information on the first synthesized sound 914may refer to electronic information for indicating the first synthesized sound.

- the information on the first synthesized sound 914may be information obtained as the first synthesized sound 914 is converted into electronic data.

- the intelligent server 420(for example, the speech analysis module 512 of the at least one processor 511) is related to the first speech among a plurality of sounds stored in the memory 503 in operation 806. You can check the second synthesized sound.

- the second synthesized soundmay be a sound including a user speech and a second sound in an inaudible frequency band. Since the plurality of sounds stored in the database 515 of the data of the intelligent server 420 are the same as described above in FIG. 5, a duplicate description will be omitted.

- the second soundmay be the same as, similar to, or different from the first sound having an inaudible frequency band included in the first synthesized sound.

- the synthesized sounds stored in the database 515 of the intelligent server 420have the same or similar ratio. It may include sound having a blue frequency band.

- the synthesized sounds stored in the database 515 of the intelligent server 420are each different in audible frequency bands. It may include a sound with. In this case, as the first sound and the second sound are different, the accuracy of the operation of determining whether the currently received first utterance is a hijacked utterance may be improved. This will be described later in FIGS. 13 to 18.

- the intelligent server 420(for example, the speech analysis module 512 of the at least one processor 511) performs a plurality of sounds stored in the database 515 and the received first synthesized sound. By comparison, the second synthesized sound can be confirmed.

- the intelligent server 420as shown in 1001 of FIG. 10, the first speech included in the first synthesized sound 914 among a plurality of sounds 516 stored in the database 515 ( A second synthesized sound 1001 including an utterance (eg, a second utterance) corresponding to 913 may be identified.

- the second synthesized sound 1011is a plurality of pieces stored in the database 515 of the intelligent server 420 Among the sounds, it may be a synthesized sound including a user utterance of "volume up"

- the intelligent server 420(for example, the speech analysis module 512 of the at least one processor 511) the sound of the audible frequency band of the plurality of synthesized sounds 516 stored in the database 515 By comparing the sound of the audible frequency band of the first synthesized sound 914, the audible frequency band corresponding to the sound of the audible frequency band of the first synthesized sound 914 (for example, having the same or similarity equal to or greater than a preset value) A second synthesized sound 1011 having sound can be identified.

- the intelligent server 420compares semantic information of the plurality of synthesized sounds 516 stored in the database 515 with semantic information of the first synthesized sound 914 Thus, the second synthesized sound 1011 having semantic information corresponding to the semantic information of the first synthesized sound 914 may be identified.

- the intelligent server 420(eg, the speech comparison module 513 of the at least one processor 511) checks the similarity by comparing the first synthesized sound with the second synthesized sound in operation 807. Then, in operation 808, the similarity and the threshold may be compared. The degree of similarity between the first synthesized sound 914 and the second synthesized sound 1011 is determined by comparing the first synthesized sound 914 and the second synthesized sound 1011 with time-specific characteristics (eg, phonetic characteristics such as intensity). Can be confirmed by comparison. For example, the intelligent server 420 may compare the similarity between the first synthesized sound 914 and the second synthesized sound 1011 based on a linear analysis method. In addition, for example, the intelligent server 420, as shown in 1002 of FIG. 10, based on a nonlinear analysis method such as DTW, the similarity between the first synthesized sound 914 and the second synthesized sound 1011 Can be compared.

- a nonlinear analysis methodsuch as DTW

- the intelligent server 420may determine the electronic device 410 according to a comparison result of a similarity and a threshold value between the first synthesized sound and the second synthesized sound. It is possible to check whether the first utterance 913 received in is a stolen utterance. For example, if the similarity between the first synthesized sound 914 and the second synthesized sound is greater than or equal to the threshold value, the intelligent server 420 determines that the first utterance is not a stolen utterance, and the first synthesized sound and the second synthesized sound When the similarity between the synthesized sounds is less than the threshold value, the first utterance may be identified as a deodorized utterance.

- the similarity between the first synthesized sound 914 and the second synthesized sound 1011is determined by the sound 913 and the second synthesized sound 1011 in an inaudible frequency band of the first synthesized sound 914.

- whether the first utterance 913 is a hijacked utteranceis determined between the sound 912 of the inaudible frequency band of the first synthesized sound 914 and the sound of the inaudible frequency band of the second synthesized sound 1011 It can be determined based on the similarity of.

- the first synthesized sound 1101(first synthesized sound 914 in the case of deodorization) and the first synthesized sound 1101 disclosed in FIG. 11 for explaining different characteristics of the first synthesized sound 914 depending on whether or not deodorization

- the synthesized sound 1102(the first synthesized sound 914 if not stolen)

- the inaudible frequency band of the currently received first synthesized sound 914 according to whether the first utterance 913 is stolene.g. : 1112 or 1122

- itmay be determined whether or not at least two or more sounds are superimposed (eg, two or more sounds are superimposed in an inaudible frequency band when deodorizing).

- the degree of similarity between the first synthesized sound 914 and the second synthesized sound 1011may decrease according to whether at least two or more sounds are overlapped in the inaudible frequency band of the first synthesized sound 914.

- a synthesized sound selected for determining similarityis a second sound corresponding to a first utterance in an audible frequency band portion 1131. It may include speech and may include a second sound in the inaudible frequency band portion 1132.

- the synthesized sound 1101 comprising the hijacked utterancecomprises a first utterance in the audible frequency band portion 1111 and a second sound previously recorded by the hijacker in the inaudible frequency band portion 1112 and the current electronic device ( The first sound output through the speaker 501 of 410 may be included.

- the synthesized sound 1102 containing the utterances of the true userincludes the first utterance in the audible frequency band portion 1121 and through the speaker 501 of the current electronic device 410 in the inaudible frequency band portion 1122 It may include the output first sound.

- the intelligent server 420has a similarity k2 between the currently received synthesized sound 1101 and the second synthesized sound 1011. It can be identified as being below the threshold (i.e., determined by a captured ignition).

- the intelligent server 420since only the first sound currently output in the inaudible frequency band 1122 of the synthesized sound 1102 that does not include the deodorized speech exists, the inaudible frequency band 1122 of the synthesized sound 1102 ) And the inaudible frequency band 1132 of the second synthesized sound 1011 are maintained at a certain level, so that the intelligent server 420 has a similarity k1 between the synthesized sound 1102 and the second synthesized sound 1011. ) Is greater than or equal to the threshold (i.e., determined by a captured ignition).

- the threshold valuemay be set to determine whether to deodorize speech according to whether sounds overlap in an inaudible frequency band. That is, referring to FIG. 11, the similarity between the synthesized sound 1101 and the second synthesized sound 1011, which is found when the sound overlaps in the inaudible frequency band of the synthesized sound 1101 including the deodorized speech (

- the threshold valuemay be set higher than k2).

- the intelligent server 420processes to provide a service corresponding to the first utterance based on the result of comparing the similarity and the threshold value in operation 809. Result information can be obtained.

- the intelligent server 420may include various types of processing result information depending on whether the first speech 913 is a stolen speech. .

- the intelligent server 420may be ) Process (e.g., processing using the natural language platform 514 described above), and obtain processing result information including information (e.g., UI/UX, etc.) for providing a service corresponding to the first speech. have. Since the operation of acquiring the processing result information may be performed in the same manner as the operation based on the natural language platform 514 described above, a duplicate description will be omitted.

- the intelligent server 420(for example, at least one processor 511) may be ) Can generate information to indicate that the service cannot be provided.

- the intelligent server 420may transmit processing result information to the electronic device 410 in operation 810 as illustrated in 1003 of FIG. 10. .

- the processing result information including information (eg, UI/UX, etc.) for providing a service corresponding to the first speech 913is received from the intelligent server 420 and the first speech ( 913) can be provided.

- the electronic device 410may display a UI/UX for providing today's weather information in response to a currently received speech (eg, how is today's weather). .

- the electronic device 410receives information indicating that the first utterance 913 is a stolen speech. can do.

- the electronic device 410may display a notification message on the execution screen of the intelligent voice service application based on the received information.

- the notification messagemay include a graphic object (eg, text, image, etc.) for indicating that the currently received speech is a stolen speech, or a graphic object for re-requesting the speech.

- the electronic device 410may re-request the utterance including a specific keyword to re-check whether the user is true or not. This will be described later with reference to FIGS. 22 to 24.

- the electronic device 410may randomly output sound having an inaudible frequency band.

- the electronic device 410may control the speaker 501 to output a sound having an inaudible frequency band generated based on different data whenever sound having an inaudible frequency band is output.

- the intelligent server 420receives from the electronic device 410 synthesized sounds, each of which includes sounds having an inaudible frequency band randomly output from the electronic device 410, and receives the received synthesized sounds from the database ( 515).

- FIG. 12is a flowchart 1200 illustrating another example of operations of the electronic device 410 and the intelligent server 420 according to various embodiments. According to various embodiments, the operations illustrated in FIG. 12 are not limited to the illustrated order and may be performed in various orders. Further, according to various embodiments, more operations may be performed than the operations illustrated in FIG. 12, or at least one less operation may be performed. Hereinafter, FIG. 12 will be described with reference to FIGS. 13 to 14.

- FIG. 13is a diagram illustrating an example of an operation of outputting a sound having an inaudible frequency band of the electronic device 410 according to various embodiments.

- a "+" symbolindicates that each sound is combined and received by the microphone 502 of the electronic device.

- 14is a diagram illustrating an example of an inaudible frequency band of a captured speech when randomly outputting a sound having an inaudible frequency band according to various embodiments. "-" shown in the graph of FIG. 14 may indicate the intensity at the characteristic frequency for each time.

- the electronic device 410executes an intelligent voice service application in operation 1201, and the first sound 1312 having an inaudible frequency band in operation 1202. Can be output through the microphone 502.