WO2020121626A1 - Image processing device, computer program, and image processing system - Google Patents

Image processing device, computer program, and image processing systemDownload PDFInfo

- Publication number

- WO2020121626A1 WO2020121626A1PCT/JP2019/038543JP2019038543WWO2020121626A1WO 2020121626 A1WO2020121626 A1WO 2020121626A1JP 2019038543 WJP2019038543 WJP 2019038543WWO 2020121626 A1WO2020121626 A1WO 2020121626A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- label

- color

- image

- brightness

- image processing

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Ceased

Links

Images

Classifications

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/90—Determination of colour characteristics

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09F—DISPLAYING; ADVERTISING; SIGNS; LABELS OR NAME-PLATES; SEALS

- G09F3/00—Labels, tag tickets, or similar identification or indication means; Seals; Postage or like stamps

Definitions

- the present disclosurerelates to an image processing device, a computer program, and an image processing system.

- This applicationclaims the priority right based on Japanese application No. 2018-232117 filed on December 12, 2018, and incorporates all the contents described in the Japanese application.

- Patent Document 1discloses, as an example of a label, a two-dimensional code including a plurality of color regions called marks. Predetermined information is encoded by the color of the mark and the position of the mark included in the two-dimensional code. That is, the two-dimensional code represents predetermined information. Therefore, it is possible to detect a plurality of marks from an image obtained by capturing a two-dimensional code with a camera and decode the information based on the detected mark color and the mark position.

- An image processing apparatusis an image processing apparatus that detects a label attached to a detection target, and includes an image acquisition unit that acquires a color image captured by a camera and an imaging range of the camera.

- a brightness determination unitthat determines the brightness of the label, and based on the determination result of the brightness determination unit, one or more detection targets from among the colors attached to the label that include a predetermined number or more of color regions.

- a detection target color determination unitthat determines a color, and a label detection that detects the label by extracting the region of the detection target color determined by the detection target color determination unit from the image acquired by the image acquisition unit. And a section.

- a computer programis a computer program for causing a computer to function as an image processing device that detects a label attached to a detection target, and the computer program includes a color image captured by a camera.

- An image acquisition unitthat acquires an image, a brightness determination unit that determines the brightness of the imaging range of the camera, and based on the determination result of the brightness determination unit, the label including a region of a predetermined number or more

- the detection target color determination unitthat determines one or more detection target colors from the colors to be attached, and the detection target color determined by the detection target color determination unit from the image acquired by the image acquisition unit. By extracting the region, it functions as a label detection unit that detects the label.

- An image processing systemincludes a label that is attached to a detection target and that includes a predetermined number or more of color regions, a camera that captures a color image, and the above-described image processing device.

- the present disclosurecan be realized not only as an image processing apparatus including such a characteristic processing unit, but also as an image processing method including steps executed by a characteristic processing unit included in the image processing apparatus.

- the above computer programcan be distributed via a computer-readable non-transitory recording medium such as a CD-ROM (Compact Disc-Read Only Memory) or a communication network such as the Internet. ..

- the present disclosurecan also be realized as a semiconductor integrated circuit that realizes part or all of an image processing device.

- FIG. 1is a diagram showing an attachment example of the image processing system according to the first embodiment.

- FIG. 2is a block diagram showing the configuration of the image processing system according to the first embodiment.

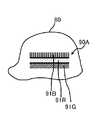

- FIG. 3Ais a side view of a helmet worn by a person.

- FIG. 3Bis a view of a helmet worn by a person viewed from above.

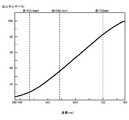

- FIG. 4is a diagram showing an expression in the Munsell color system (JIS Z8721) of each color label.

- FIG. 5is a diagram showing the spectral reflectance of each color label.

- FIG. 6is a diagram showing a spectral distribution of sunlight.

- FIG. 7:is a figure which shows typically the label image

- FIG. 7is a figure which shows typically the label image

- FIG. 8is a figure which shows the spectral distribution of the light of an incandescent lamp.

- FIG. 9is a figure which shows typically the label image

- FIG. 10is a diagram showing an example of the brightness/darkness reference DB.

- FIG. 11Ais a diagram showing an example of a green region and a red region on an image.

- FIG. 11Bis a diagram showing an example of a green region and a red region on the image.

- FIG. 12is a flowchart showing a procedure of processing executed by the image processing apparatus according to the first embodiment.

- FIG. 13is a diagram showing an example of a label attached to a helmet.

- FIG. 14is a flowchart showing a procedure of processing executed by the image processing apparatus according to the second embodiment.

- FIG. 15is a flowchart showing a procedure of processing executed by the image processing apparatus according to the modified example of the second embodiment.

- FIG. 16is a block diagram showing the configuration of the image processing system according to the third embodiment.

- FIG. 17is a diagram showing an example of the brightness/darkness reference DB.

- FIG. 18is a block diagram showing the configuration of the image processing system according to the fourth embodiment.

- FIG. 19is a diagram showing an example of the brightness/darkness reference DB.

- FIG. 20is a diagram showing an example of the brightness/darkness reference DB.

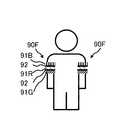

- FIG. 21is a diagram of a person viewed from the front.

- FIG. 22is an external view of a cardboard box.

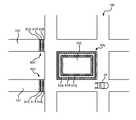

- FIG. 23is a diagram schematically showing a road on which a forklift truck travels.

- the color of the markis easily influenced by the illumination, and even if the mark has the same color, the mark may be captured by the camera as a mark of a different color when the illumination is different. Specifically, when the red mark is photographed under sunlight like outdoors in the daytime, the red mark may appear yellow. Further, when the blue mark is photographed under the light of an incandescent lamp indoors, the blue mark may appear black. If the mark is photographed as an area having a color different from the original color, the two-dimensional code may be erroneously detected or the information may be erroneously recognized.

- the present disclosurehas been made in view of such circumstances, and an image processing device, a computer program, and an image processing system capable of detecting a label including a predetermined number or more of color regions without being affected by illumination.

- the purposeis to provide.

- a label including a predetermined number or more of color regionscan be detected without being affected by illumination.

- An image processing deviceis an image processing device that detects a label attached to a detection target, and an image acquisition unit that acquires a color image captured by a camera, and the camera. Based on the determination result of the brightness determination unit and the brightness determination unit, one or more colors among colors attached to the label including a predetermined number of color regions or more.

- the detection target color determination unitthat determines the detection target color, and the label is detected by extracting the region of the detection target color determined by the detection target color determination unit from the image acquired by the image acquisition unit.

- one or more detection target colorsare determined from the colors of the label including the predetermined number or more of color areas, based on the brightness of the imaging range of the camera.

- the labelincludes a retroreflective material in the area.

- ⁇ Retroreflective materialhas the property that the incident angle of light is equal to the outgoing angle. Therefore, even if the label is inclined in either direction, the camera can receive the reflected light of the light by irradiating the label with light along the optical axis direction of the camera. As a result, the label can be detected with high accuracy even at night.

- the brightness determination unitis configured such that the image acquired by the image acquisition unit, imaging parameter information regarding brightness adjustment acquired from the camera, and illuminance at a position included in an imaging range of the camera.

- the brightnessmay be determined based on at least one piece of illuminance information acquired from an illuminance sensor that measures.

- the detection target color determination unitdetermines, as the detection target color, an intermediate wavelength color that is at least a color other than the color having the longest wavelength and the color having the shortest wavelength among the predetermined number of colors or more. You may.

- the color with a long wavelengthis taken as a color different from the original color

- the color with a short wavelengthis taken as a color different from the original color. To be done. Therefore, at least the intermediate wavelength colors other than these colors are not easily affected by the illumination. Therefore, according to this configuration, the label can be detected without being affected by the illumination.

- the label detection unitmay extract the regions of the detection target color in order from the region of the intermediate wavelength color.

- the labelmay include a red area, a blue area, and a green area.

- the three primary colors of light, red, blue, and green,are colors with wavelengths that are appropriately separated. For this reason, even if one of the areas of one color is photographed as a color area different from the original color due to the influence of the illumination, the other two colors are not affected by the illumination and the Taken as a color area. Therefore, by using the other two colors as the detection target colors, the label can be detected without being affected by the illumination.

- the above image processing apparatusmay further include an output unit that outputs information according to the detection result of the label detection unit.

- a computer programis a computer program for causing a computer to function as an image processing device that detects a label attached to a detection target, and the computer is imaged by a camera.

- An image acquisition unitthat acquires a color image, a brightness determination unit that determines the brightness of the imaging range of the camera, and a predetermined number or more of color regions based on the determination result of the brightness determination unit

- the detection target color determination unitthat determines one or more detection target colors from the colors attached to the label, and the detection that the detection target color determination unit determines from the image acquired by the image acquisition unit By extracting the region of the target color, it functions as a label detection unit that detects the label.

- the computercan be realized as the image processing device described above. Therefore, the same operation and effect as those of the image processing apparatus described above can be obtained.

- An image processing systemincludes a label that is attached to a detection target and includes a predetermined number or more of color regions, a camera that captures a color image, and the image processing device described above. Equipped with.

- This configurationincludes the image processing device described above. Therefore, the same operation and effect as those of the image processing apparatus described above can be obtained.

- FIG. 1is a diagram showing an attachment example of the image processing system according to the first embodiment.

- FIG. 2is a block diagram showing the configuration of the image processing system according to the first embodiment.

- the followingdescribes an image processing system in which a camera and an image processing device are installed on a forklift, but the location where the camera and the image processing device are installed is not limited to the forklift. For example, these may be attached to the automobile, or when the camera is used for monitoring a predetermined area, the camera may be installed at a place where the area can be imaged.

- the image processing system 1is a system for monitoring the periphery of the forklift 25, and includes a camera 20, an illuminance sensor 26, an image processing device 10, a sound output device 30, a display device 40, and a terminal device 50.

- a camera 20an illuminance sensor 26

- an image processing device 10an image processing device 10

- a sound output device 30a display device 40

- a terminal device 50a terminal device 50.

- the camera 20is attached, for example, at a position where the rear of the forklift 25 can be imaged (for example, the rear end position of the head guard of the forklift 25) and captures a color image of the rear of the forklift 25.

- the camera lens of the camera 20is, for example, an ultra wide-angle lens having an angle of view of 120° or more.

- the forklift 25be provided with a light source such as a headlight so that the camera 20 can shoot at night. Further, it is desirable that the light source emits light in the optical axis direction of the camera 20.

- a blind spot region 22that deviates from the imaging region 21 of the forklift 25.

- the boundary 23 between the imaging area 21 and the blind spot area 22is indicated by a broken line.

- a mirror 60is installed in the image pickup area 21 of the forklift 25. That is, by disposing the mirror 60 so that the image pickup area 61 covers the blind spot area 22 when the camera 20 picks up the image through the mirror 60, the camera 20 can pick up the person 72 existing in the blind spot area 22. it can.

- another camera different from the camera 20may be arranged on the forklift 25 in order to image the blind spot area 22.

- Illuminance sensor 26is a sensor that measures the illuminance by converting the light incident on the light receiving element into an electric current.

- the illuminance sensor 26is arranged, for example, on the ceiling portion of the forklift 25 and measures the illuminance at a position included in the imaging range of the camera 20.

- the illuminance sensor 26is preferably provided near the camera 20 or in the imaging area 21. Further, it is desirable that the illuminance sensor 26 is attached at a position where the sensor surface of the illuminance sensor 26 is perpendicular to the optical axis direction so that the illuminance of the camera 20 in the optical axis direction can be measured.

- the illuminance sensor 26does not necessarily have to be installed on the forklift 25.

- the illuminance sensor 26Amay be installed in advance within the travelable range of the forklift 25. That is, the illuminance sensor 26A may be installed on the traveling route of the forklift 25 or in the vicinity of the traveling route.

- the illuminance sensor 26Ais a sensor that measures the illuminance of the surroundings, like the illuminance sensor 26.

- the measurement range of the illuminance by the illuminance sensor 26 or 26Ais preferably included in the shooting range of the camera 20, but the measurement range and the shooting range may be slightly different as long as they are about several meters. This is because it is unlikely that the illuminance will change abruptly due to a slight positional shift, and it is considered that such a shift will not affect the result of image processing.

- the image processing device 10is a computer installed in the forklift 25.

- the image processing device 10is connected to the camera 20 and detects the persons 71 and 72 from the images of the imaging regions 21 and 61 captured by the camera 20.

- the persons 71 and 72are labeled with a predetermined number of color areas arranged in a predetermined positional relationship.

- the predetermined numberis not limited to 3 and may be any other number as long as it is a natural number of 1 or more. That is, it is sufficient that the label has at least one predetermined color region.

- the labelpreferably includes a retroreflective material in the color area.

- the retroreflective materialis, for example, glass beads arranged on the surface of the label, and has a property of reflecting the light from the light source in the glass beads and returning the reflected light to the light source direction.

- FIG. 3Ais a side view of a helmet worn by a person, and FIG. 3B is a top view of the helmet.

- a label 90Ais attached to the helmet 80.

- the label 90Aincludes a blue label 91B, a red label 91R and a green label 91G which are arranged in parallel.

- the label 90Acan have a width of about 60 mm and a length of about 180 to 250 mm.

- a gap area 92is provided between the blue label 91B and the red label 91R and between the red label 91R and the green label 91G.

- the gap area 92is, for example, a black area and has a width of 2 to 3 mm.

- a label 90A similar to the label 90A shown in FIG. 3Ais also attached above the helmet 80.

- the label 90Ais also attached to the opposite side surface of the helmet 80 and to the front and back. 3A, only the label 90A on the left side surface of the helmet 80 is shown for the sake of illustration. In this way, by attaching the label 90A to every place, it is possible to cause the camera 20 to capture an image of any label 90A regardless of the posture of the person (upright, crouching, etc.). it can.

- the label 90Ais composed of a red label 91R, a green label 91G, and a blue label 91B, which are labels of the three primary colors of light.

- FIG. 4is a diagram showing an expression in the Munsell color system (JIS (Japanese Industrial Standards) Z8721) of each color label.

- H, V, and Crespectively indicate the hue, lightness, and saturation in the Munsell color system. That is, the color of the red label 91R includes the Munsell color system hue (H) in the range of 10P to 7.5YR, the lightness (V) of 3 or more, and the saturation (C) of 2 or more. ..

- the color of the green label 91Gincludes the Munsell color system hue (H) in the range of 2.5 GY to 2.5 BG, the lightness (V) of 3 or more, and the saturation (C) of 2 or more. ..

- the color of the blue label 91Bincludes the Munsell color system hue (H) in the range of 5BG to 5P, the lightness (V) of 1 or more, and the saturation (C) of 1 or more.

- the label 90Ais not limited to the label composed of the three primary colors of light, and may be composed of the label of other colors.

- FIG. 5is a diagram showing the spectral reflectance of each color label.

- the horizontal axisrepresents wavelength (nm) and the vertical axis represents spectral reflectance (%).

- the red color indicated by the red label 91Rhas a spectral reflectance peak near a wavelength of 700 nm.

- the green color indicated by the green label 91Ghas a spectral reflectance peak near a wavelength of 546.1 nm.

- the blue color indicated by the blue label 91Bhas a spectral reflectance peak near the wavelength of 435.8 nm.

- the peak of the spectral reflectance of each coloris not limited to the above value.

- redmay have a spectral reflectance peak at a wavelength of 700 ⁇ 30 nm.

- Greenmay have a peak of spectral reflectance at a wavelength of 546.1 ⁇ 30 nm.

- Bluemay have a peak of spectral reflectance at a wavelength of 435.8 ⁇ 30 nm.

- the blue label 91B, the red label 91R, and the green label 91Gare made of fluorescent tape or that these labels are coated with fluorescent paint.

- the labelcan be easily recognized even in an environment where the illuminance is low, such as at night or in cloudy weather. Further, the label can be recognized without using a special camera such as an infrared camera.

- the image processing apparatus 10detects a person by detecting the label 90A from the image captured by the camera 20.

- the detailed configuration of the image processing apparatus 10will be described later.

- the sound output device 30is installed, for example, near the driver's seat of the forklift 25 and includes a speaker.

- the sound output device 30is connected to the image processing device 10 and outputs a notification sound such as a message sound or an alarm sound that notifies the driver that the image processing device 10 has detected the person 71 or the person 72.

- the display device 40is installed, for example, at a position where the driver of the forklift 25 can visually recognize, and is configured to include a liquid crystal display and the like.

- the display device 40is connected to the image processing device 10 and displays an image informing that the image processing device 10 has detected the person 71 or the person 72.

- the terminal device 50is, for example, a computer installed in a place apart from the forklift 25, such as a management room that manages the forklift 25.

- the terminal device 50is connected to the image processing device 10 and outputs an image or a sound notifying that the image processing device 10 has detected the person 71 or the person 72, or detects that the person 71 or the person 72 has been detected together with time information. It is recorded as log information.

- the terminal device 50 and the image processing device 10are connected by a mobile phone line according to a communication standard such as 4G or 5G, or a wireless LAN (Local Area Network) such as Wi-Fi (registered trademark). May be.

- the terminal device 50may be a smartphone or the like carried by the person 71 or 72. Thereby, the terminal device 50 can notify the person 71 or 72 that the person 71 or 72 itself has been detected by the image processing apparatus 10, that is, that the forklift 25 exists near the person 71 or 72. it can.

- the functions of the image processing device 10, the camera 20, the sound output device 30, and the display device 40may be provided in a smartphone, a computer with a camera, or the like.

- the smartphoneprocesses the image captured by the smartphone and detects the persons 71 and 72.

- the smartphonenotifies the detection result by sound or image.

- another tablet device or the likemay be installed at a position visible to the driver, and the tablet device may display the image transmitted from the smartphone.

- the tablet device and the smartphonemay be wirelessly connected according to a wireless communication standard such as Wi-Fi (registered trademark), Bluetooth (registered trademark), Zigbee (registered trademark).

- FIG. 6is a diagram showing the spectral distribution of sunlight.

- the horizontal axisrepresents wavelength and the vertical axis represents radiant energy.

- the red light componentis smaller than the green and blue light components. For this reason, when the camera 20 photographs the red region outdoors using the sun as the light source, the light of the red component received by the camera 20 becomes relatively weak. Therefore, the red area may appear as a yellow area on the image.

- FIG. 7is a figure which shows typically the label image

- the label 90A shown in FIG. 7is the same as the label 90A shown in FIG. 3A.

- the intensity of the red component lightis weak due to the effect of sunlight. Therefore, the red label 91R appears as a yellow label on the image.

- FIG. 8is a diagram showing a spectral distribution of light from an incandescent lamp.

- the horizontal axisrepresents wavelength and the vertical axis represents specific energy.

- the specific energyis a relative intensity when the maximum value of the emission intensity in the measured wavelength range is 100%.

- the blue componentis less than the red and green components. For this reason, when the camera 20 shoots a blue region indoors using an incandescent lamp as a light source, the blue component light received by the camera 20 becomes relatively weak. Therefore, the blue area may appear as a black area on the image.

- FIG. 9is a figure which shows typically the label image

- the label 90A shown in FIG. 9is the same as the label 90A shown in FIG. 3A.

- the intensity of the blue component lightis weak due to the effect of the light from the incandescent lamp. Therefore, the blue label 91B appears as a black label on the image.

- the lighting used in a dark environmentis not limited to incandescent light bulbs, and may be light bulbs of other colors, fluorescent lights or LED (Light Emitting Diode) lighting.

- an image processing device 10that can detect the label 90A without being affected by illumination will be described below.

- the image processing device 10is a general computer including a CPU (Central Processing Unit), a RAM (Random Access Memory), a ROM (Read Only Memory), an HDD (Hard Disk Drive), a communication I/F (interface), a timer, and the like. It is composed of The image processing apparatus 10 has an image acquisition unit 11, a brightness determination unit 12, a detection target color determination unit 13 as a functional configuration realized by executing a computer program read from a HDD or a ROM into a RAM. The label detection unit 14 and the output unit 15 are provided.

- the image processing apparatus 10also includes a storage device 16.

- the image acquisition unit 11acquires a color image captured by the camera 20 via the communication I/F. That is, an image obtained by the camera 20 capturing the image capturing areas 21 and 61 shown in FIG. 1 is acquired.

- the brightness determination unit 12determines the brightness of the imaging range of the camera 20.

- the brightness determination unit 12refers to the brightness/darkness reference DB (database) stored in the storage device 16 described later on the basis of the illuminance information of the imaging range of the camera 20 measured by the illuminance sensor 26 and refers to the camera 20. It is determined whether the imaging range of is a bright environment, a dark environment, or an environment of medium brightness.

- the brightness determination unit 12may directly receive the illuminance information from the illuminance sensor 26A by wireless communication when acquiring the illuminance information from the illuminance sensor 26A installed other than the forklift 25, or the terminal device 50.

- the illuminance informationmay be received from the illuminance sensor 26A via the.

- the brightness determination unit 12specifies the illuminance sensor 26A included in the imaging range of the camera 20 from the position of the forklift 25 and the camera parameters (optical axis direction, zoom magnification, etc.) of the camera 20, and specifies the specified illuminance.

- the illuminance informationis acquired from the sensor 26A.

- the brightness determination unit 12compares the position of the illuminance sensor 26A indicated by the acquired position information with the position of the forklift 25 when the position information can be acquired together with the illuminance information from the illuminance sensor 26A.

- the illuminance sensor 26A included in the imaging range of the camera 20may be specified.

- FIG. 10is a diagram showing an example of the brightness/darkness reference DB 17.

- the brightness/darkness reference DB 17indicates a reference for determining whether the environment having the illuminance is a bright environment, a dark environment, or a medium brightness environment based on the illuminance (IL).

- ILilluminance

- the environment where the illuminance is IL ⁇ 500 lxis a dark environment.

- the environment where the illuminance is 500 ⁇ IL ⁇ 10000is a medium brightness environment.

- the environment in which the illuminance is IL ⁇ 10000is a bright environment.

- the brightness determination unit 12determines that the imaging range of the camera 20 is a dark environment if the illuminance IL measured by the illuminance sensor 26 is IL ⁇ 500 lx. If the illuminance IL measured by the illuminance sensor 26 is 500 ⁇ IL ⁇ 10000, the brightness determination unit 12 determines that the image capturing range of the camera 20 is an environment of medium brightness. Furthermore, if the illuminance IL measured by the illuminance sensor 26 is IL ⁇ 10000, the brightness determination unit 12 determines that the imaging range of the camera 20 is a bright environment. It is needless to say that the numerical values indicated by the brightness/darkness reference DB 17 are examples, and other numerical values may be used. The same applies to subsequent figures.

- the detection target color determination unit 13determines one or more detection target colors from the colors attached to the label 90A based on the determination result of the brightness determination unit 12. Hereinafter, it is assumed that the detection target color determination unit 13 determines two or more detection target colors from the three colors attached to the label 90A. That is, the detection target color determination unit 13 determines, as a detection target color, a color excluding a color whose appearance changes depending on the illumination environment.

- the detection target color determination unit 13determines two colors, green and blue, excluding red, as detection target colors.

- the blue areamay appear as a black area in the image. Therefore, when the brightness determination unit 12 determines that the environment is dark, the detection target color determination unit 13 determines two colors, red and green, excluding blue, as detection target colors.

- the dark environment referred to hereindicates the environment under the light of an incandescent light bulb. Therefore, under other artificial light sources such as fluorescent lamps and LED lighting, the color in which the appearance changes is not always blue. Therefore, when the artificial light source is other than an incandescent light bulb, the detection target color determination unit 13 determines a color excluding a color whose appearance changes according to the type of the artificial light source as the detection target color.

- the detection target color determination unit 13determines three colors of red, green, and blue as the detection target colors when the brightness determination unit 12 determines that the environment has medium brightness.

- the label detection unit 14detects the label 90A by extracting the area of the detection target color determined by the detection target color determination unit 13 from the image acquired by the image acquisition unit 11.

- the label detection unit 14extracts the region of the detection target color based on the pixel value in the color space of each pixel forming the image acquired by the image acquisition unit 11 and a predetermined threshold value.

- the HSV color spaceis assumed as the color space.

- hue (H), saturation (S), and lightness (V)are assumed as pixel values in the HSV color space.

- the label detection unit 14converts the pixel value in the RGB color space into the pixel value in the HSV color space, and then Region extraction processing is performed.

- the conversion from the pixel value of the RGB color space to the pixel value of the HSV color spaceis executed according to the following Expressions 1 to 3, for example.

- R, G, and Brepresent the red component, green component, and blue component of the pixel before conversion, respectively.

- MAXrepresents the maximum value of the red component, green component, and blue component of the pixel before conversion.

- MINrepresents the minimum value of the red component, green component, and blue component of the pixel before conversion.

- the label detection unit 14for example, 95 and 145 are set as the threshold value of the green hue (H), 70 and 100 are set as the threshold value of the green saturation (S), and the green lightness (V) is set. It is assumed that 70 and 100 are set as the threshold values.

- the label detection unit 14has a hue (H) of a pixel of 95 or more and 145 or less, a saturation (S) of 70 or more and 100 or less, and a lightness (V) of 70.

- Hhue

- Ssaturation

- Vlightness

- the label detection unit 14has red (H), saturation (S) and lightness (V) thresholds and blue (H), saturation (S) and lightness (V) thresholds. It is assumed that and are set.

- redis the detection target color

- the label detection unit 14extracts red pixels from the image using the threshold values of the hue (H), saturation (S), and lightness (V) of red.

- blueis the detection target color

- the label detection unit 14extracts blue pixels from the image using the threshold values of blue hue (H), saturation (S), and lightness (V).

- the label detection unit 14performs labeling processing on green pixels, red pixels, or blue pixels, which are pixels of the color to be detected, and sets pixels having the same label (code) by the labeling processing as one area. , Green area, red area or blue area is extracted.

- the label detection unit 14may remove the noise area by performing expansion/contraction processing or area size filtering processing on each of the extracted green area, red area, or blue area.

- the label detection unit 14determines that the image acquired by the image acquisition unit 11 includes the detection target color region when the extracted detection target color regions have a predetermined positional relationship. For example, when the detection target colors are red, green, and blue, the label detection unit 14 determines that a red area exists within a predetermined distance range from the center position of the green area on the image and the center position of the red area is predetermined. When the blue area exists within the distance range, it is determined that the image includes the green area, the red area, and the blue area. When the label detection unit 14 determines that the image includes the region of the detection target color, it is determined that the label 90A is detected in the image. Thereby, the label detection unit 14 can determine that a person is present around the forklift 25.

- the label detection unit 14may change the threshold values of the hue (H), saturation (S), and lightness (V) of each color according to the determination result of the brightness determination unit 12. By changing the threshold value according to the brightness of the imaging range of the camera 20, the label detection unit 14 can more accurately extract the area. For example, the label detection unit 14 may change each threshold so that the hue (H), the saturation (S), and the brightness (V) of each color become larger as the imaging range becomes brighter. Specifically, the label detection unit 14 refers to the table information indicating the correspondence relationship between the brightness of the imaging range and the threshold values of the hue (H), the saturation (S), and the brightness (V) of each color, Each threshold may be changed.

- FIG. 11A and 11Bare diagrams showing an example of a green region and a red region on the image. As shown in FIG. 11A, if the red region 82R is included in a predetermined distance range 84 indicated by a circle centered on the center position 83 of the green region 82G, the center position 83 of the green region 82G is displayed on the image. It is determined that the red area 82R exists within the predetermined distance range 84.

- the red region 82Ris not included in the predetermined distance range 84 indicated by a circle centered on the center position 83 of the green region 82G, the center position of the green region 82G on the image. It is determined that the red region 82R does not exist within the predetermined distance range 84 from 83.

- the diameter of the circle in the predetermined distance range 84may be the length of the longest side of the green region 82G, for example.

- the length of the longest side of the circumscribed rectangle of the green region 82Gmay be the diameter of the circle of the predetermined distance range 84.

- the diametermay be a value other than these.

- the label detection unit 14performs similar processing to determine whether the extracted detection target color regions have a predetermined positional relationship. To determine.

- the output unit 15outputs information according to the detection result of the label detection unit 14. For example, when the label detection unit 14 detects the label 90A, the output unit 15 notifies the sound output device 30 of transmitting a predetermined sound signal to the sound output device 30 via the communication I/F. Output sound. This notifies the driver that there is a person around the forklift 25.

- the output unit 15detects a person on the display device 40 by transmitting a predetermined image signal to the display device 40 via the communication I/F. Display an image to inform you. This notifies the driver that there is a person around the forklift 25.

- the output unit 15transmits information indicating that a person is detected to the terminal device 50 via the communication I/F, so that the terminal device

- the control unit 50causes the sound and image to be output and the log information to be recorded.

- the output unit 15may transmit information on the detection time.

- the storage device 16is a storage device for storing various information including the brightness/darkness reference DB 17, and is configured by a magnetic disk, a semiconductor memory, or the like.

- FIG. 12is a flowchart showing a procedure of processing executed by the image processing apparatus 10 according to the first embodiment.

- the image acquisition unit 11acquires an image captured by the camera 20 (S1).

- the label detection unit 14extracts a green area from the image acquired by the image acquisition unit 11 (S2). Since the green region can be extracted without being affected by the illumination environment, green is an essential detection target color. Therefore, the extraction process of the green region is executed without performing the detection target color determination process (steps S6, S9, and S12 described later) by the detection target color determination unit 13.

- the brightness determination unit 12refers to the brightness/darkness reference DB 17 based on the illuminance of the imaging range of the camera 20 measured by the illuminance sensor 26, and the brightness of the camera 20 is determined. Brightness determination processing is performed to determine whether the imaging range is a bright environment, a dark environment, or an environment of medium brightness (S4).

- step S4when it is determined that the imaging range of the camera 20 is a bright environment (bright in S5), the detection target color determination unit 13 sets green and blue as the detection target colors. Determine (S6)

- the label detection unit 14extracts a blue area that is an unextracted detection target color area (S7).

- the label detection unit 14determines whether a blue area having a predetermined positional relationship with the green area is extracted from the image (S8).

- the label detection unit 14detects the green area and the blue area as the label 90A, and the output unit 15 detects the detection result of the label 90A.

- OutputFor example, the output unit 15 causes the sound output device 30 to output a notification sound by transmitting a predetermined sound signal to the sound output device 30.

- the detection target color determination unit 13sets red and green as the detection target colors. It is determined (S9).

- the label detection unit 14extracts a red area which is an unextracted detection target color area (S10).

- the label detection unit 14determines whether or not a red area having a predetermined positional relationship with the green area is extracted from the image (S11).

- the label detection unit 14detects the red area and the green area as the label 90A, and the output unit 15 detects the detection result of the label 90A. Output (S15).

- the detection target color determination unit 13determines that the red, Green and blue are determined as detection target colors (S12).

- the label detection unit 14extracts a red area and a blue area, which are unextracted detection target color areas (S13).

- the label detection unit 14determines whether or not a red area and a blue area having a predetermined positional relationship with the green area are extracted from the image (S14).

- the label detection unit 14detects the red area, the green area, and the blue area as the label 90A, and the output unit 15 The detection result of the label 90A is output (S15).

- step S14if at least one of the red area and the blue area has a predetermined positional relationship with the green area, it may be determined that the image includes the label 90A.

- the label detection result output processmay be performed even when the label 90A is not detected. That is, the output unit 15 may cause the sound output device 30 to output a notification sound indicating that the label 90A has not been detected, or may cause the display device 40 to display an image indicating that the label 90A has not been detected. May be. Further, the output unit 15 may transmit information indicating that the label 90A has not been detected to the terminal device 50.

- the image processing apparatus 10repeatedly executes the processing shown in FIG. 12 at a predetermined cycle (for example, every 100 msec). Thereby, the label 90A can be detected in real time.

- the detection target color determining unit 13sets the brightness of the image capturing range of the camera 20 to the brightness of the image capturing range of the label 90A that includes a predetermined number or more of color regions. Based on this, one or more colors to be detected are determined. Specifically, the detection target color determination unit 13 determines two or more detection target colors from the colors of the label 90A including the areas of three or more colors, based on the brightness of the imaging range of the camera 20. .. As a result, it is possible to determine the detection target color by excluding the color whose color appearance changes depending on the brightness. Therefore, the label detection unit 14 can detect the label without being affected by the illumination by extracting the region of the detection target color.

- the label 90Aincludes a retroreflective material in the color area.

- the retroreflective materialhas a property that the incident angle of light and the outgoing angle of light become equal. Therefore, even if the label 90A is inclined in any direction, the camera 20 receives the reflected light of the label 90A by irradiating the label 90A with light along the optical axis direction of the camera 20. can do. Accordingly, the label detection unit 14 can detect the label 90A with high accuracy even at night.

- the brightness determination unit 12can determine the brightness of the imaging range of the camera 20 based on the illuminance of the imaging range of the camera 20 measured by the illuminance sensor 26. Therefore, the brightness of the imaging range of the camera 20 can be easily determined.

- the detection target color determination unit 13indispensably detects green of an intermediate wavelength color, which is a color other than red having the longest wavelength and blue having the shortest wavelength, among red, green, and blue, regardless of the illumination environment. Determined as the target color. Since green is a color that is not easily affected by illumination, the label detection unit 14 can detect the label 90A without being affected by illumination.

- the label detection unit 14performs the area extraction processing by giving priority to the green area of the intermediate wavelength color which is an essential detection target color (S2 in FIG. 12). As a result, when the green region cannot be extracted, the label detection unit 14 does not need to extract the red region or the blue region, which is another detection target color, and the processing time can be shortened.

- the label 90Ais composed of a red label 91R, a green label 91G and a blue label 91B.

- the three primary colors of light, red, blue and green,are colors whose wavelengths are appropriately separated. For this reason, even if one of the areas (red or blue) is photographed as a color area different from the original color due to the influence of illumination, the other two colors including the intermediate wavelength color green are The image is captured as a color region of the original color without being affected by lighting. Therefore, by using the other two colors as the detection target colors, the label can be detected without being affected by the illumination.

- the output unit 15When the label detection unit 14 detects the label 90A, the output unit 15 causes the sound output device 30 to output a sound indicating that the label 90A has been detected, a sound such as an alarm sound, or a detection result of the label 90A. It is possible to display an image showing “” on the display device 40.

- the output unit 15can also send information indicating the detection result of the label 90A to the terminal device 50. This allows the user to be notified of the detection result of the label 90A.

- the labelis composed of the blue label 91B, the red label 91R and the green label 91G, but the color of the label is not limited to these.

- the second embodimentan example using a label composed of four color labels will be described.

- FIG. 13is a diagram showing an example of a label attached to a helmet.

- a label 90Cis attached to the helmet 80.

- the label 90Cis composed of a blue label 91B, a red label 91R, a green label 91G and a white label 91W which are arranged in parallel. Further, gap regions 92 are provided between the blue label 91B and the red label 91R, between the red label 91R and the green label 91G, and between the green label 91G and the white label 91W.

- Whiteis an achromatic color with zero saturation and contains various wavelengths. Therefore, the white label 91W is a label that can be detected without being affected by the brightness.

- the label detection unit 14extracts a white pixel in an image

- the saturation (S) and the brightness (V) of each pixelare compared with their respective thresholds.

- the hue (H)is not compared with the threshold value.

- the label detection unit 14extracts from the image the pixels having the saturation (S) and the brightness (V) that exceed the saturation threshold and the brightness threshold of white, respectively, as white pixels, and extracts the extracted white pixels.

- a white areais extracted by performing labeling processing.

- the configuration of the image processing apparatus according to the second embodimentis similar to that shown in FIG. However, the processes of the detection target color determination unit 13 and the label detection unit 14 are partially different. Hereinafter, the processing different from that of the first embodiment will be described with reference to the flowchart shown in FIG.

- FIG. 14is a flowchart showing a procedure of processing executed by the image processing apparatus 10 according to the second embodiment.

- the image processing device 10executes the processes of steps S1 to S4.

- the processing of steps S1 to S4is the same as that shown in FIG.

- the detection target color determination unit 13detects green, blue, and white as detection targets. The color is determined (S6A).

- the label detection unit 14extracts a blue area and a white area, which are unextracted detection target color areas (S7A).

- the label detecting unit 14determines whether or not a blue area and a white area having a predetermined positional relationship with the green area are extracted from the image (S8A).

- the label detection unit 14detects the green region, the blue region, and the white region as the label 90C, and the output unit 15 The detection result of the label 90C is output (S15).

- the label detection unit 14extracts a red area and a white area which are unextracted detection target color areas (S10A).

- the label detection unit 14determines whether or not a red area and a white area having a predetermined positional relationship with the green area are extracted from the image (S11A).

- the label detection unit 14detects the red area, the green area, and the white area as the label 90C, and the output unit 15 The detection result of the label 90C is output (S15).

- the detection target color determination unit 13determines that the red, Green, blue and white are determined as detection target colors (S12A).

- the label detection unit 14extracts a red area, a blue area, and a white area, which are unextracted detection target color areas (S13A).

- the label detection unit 14determines whether a red area, a blue area, and a white area having a predetermined positional relationship with the green area are extracted from the image (S14A).

- the label detection unit 14detects the red area, the green area, the blue area, and the white area as the label 90C.

- the output unit 15outputs the detection result of the label 90C (S15).

- the image processing apparatus 10repeatedly executes the processing shown in FIG. 14 at a predetermined cycle (for example, 100 msec intervals). Thereby, the label 90C can be detected in real time.

- a predetermined cyclefor example, 100 msec intervals.

- label detectioncan be performed using color labels of more colors than in the first embodiment. Therefore, the label can be detected without being affected by the illumination.

- the color of the color label included in the labelis not limited to the above, and for example, a black label may be used instead of the white label 91W.

- the labelis composed of four color labels, as in the second embodiment.

- the procedure of the processing executed by the image processing apparatus 10is different from that in the second embodiment.

- FIG. 15is a flowchart showing a procedure of processing executed by the image processing apparatus 10 according to the modified example of the second embodiment.

- the image processing device 10executes the processes of steps S1 to S3.

- the processing of steps S1 to S3is the same as that shown in FIG.

- the label detection unit 14extracts the white area from the image acquired by the image acquisition unit 11 (S21). Since the white area can be extracted without being affected by the illumination environment, white is an essential detection target color. Therefore, the white region extraction process is executed without performing the detection target color determination process (steps S6A, S9A, and S12A described later) by the detection target color determination unit 13.

- the detection target color determination unit 13detects green, blue, and white as detection targets. The color is determined (S6A).

- the label detection unit 14extracts a blue area that is an unextracted detection target color area (S7).

- the label detecting unit 14determines whether a blue area having a predetermined positional relationship with the green area and the white area is extracted from the image (S8B).

- the label detection unit 14detects the green area, the blue area, and the white area as the label 90C, and the output unit 15 outputs the label 90C.

- the detection resultis output (S15).

- step S4when it is determined that the imaging range of the camera 20 is a dark environment (dark in S5), the detection target color determination unit 13 detects red, green, and white as detection targets. The color is determined (S9A).

- the label detection unit 14determines whether or not a red area having a predetermined positional relationship with the green area and the white area is extracted from the image (S11B).

- the label detection unit 14detects the red area, the green area, and the white area as the label 90C, and the output unit 15 outputs the label 90C.

- the detection resultis output (S15).

- the detection target color determination unit 13determines that the red, Green, blue and white are determined as detection target colors (S12A).

- the label detection unit 14extracts a red area and a blue area, which are unextracted detection target color areas (S13A).

- the label detection unit 14determines whether or not a red area and a blue area having a predetermined positional relationship with the green area and the white area are extracted from the image (S14B).

- the label detection unit 14detects the red area, the green area, the blue area, and the white area as the label 90C, and the output unit 15 outputs the detection result of the label 90C (S15).

- the image processing apparatus 10repeatedly executes the processing shown in FIG. 15 at a predetermined cycle (for example, 100 msec intervals). Thereby, the label 90C can be detected in real time.

- a predetermined cyclefor example, 100 msec intervals.

- the brightness of the imaging range of the camera 20is determined based on the measurement result of the illuminance sensor.

- an example of performing brightness determination without using an illuminance sensorwill be described.

- FIG. 16is a block diagram showing the configuration of the image processing system according to the third embodiment.

- An image processing system 1A shown in FIG. 16includes an image processing apparatus 10A instead of the image processing apparatus 10 in the configuration of the image processing system 1 shown in FIG.

- the image processing device 10Ais configured by a computer like the image processing device 10.

- the image processing apparatus 10Aincludes a brightness determination unit 12A instead of the brightness determination unit 12 as a functional configuration.

- the brightness determination unit 12Ais connected to the image acquisition unit 11 and determines the brightness of the imaging range of the camera 20 based on the image acquired by the image acquisition unit 11. That is, the brightness determination unit 12A calculates the average of the brightness of the pixels included in the image acquired by the image acquisition unit 11, and refers to the brightness/darkness reference DB 17 stored in the storage device 16 based on the calculated brightness average. And determine the brightness.

- FIG. 17is a diagram showing an example of the light/dark reference DB 17.

- the brightness/darkness reference DB 17shows a reference for determining whether the environment having the brightness average is a bright environment, a dark environment, or an environment of medium brightness based on the brightness average (M).

- Mbrightness average

- the environment in which the average brightness is M ⁇ 50is a dark environment.

- the environment where the average luminance is 50 ⁇ M ⁇ 130is a medium brightness environment.

- the environment in which the average brightness is M ⁇ 130is a bright environment. Note that the luminance has 256 gradations as an example.

- the brightness determination unit 12determines that the imaging range of the camera 20 is a dark environment. If the average brightness M is 50 ⁇ M ⁇ 130, the brightness determination unit 12 determines that the imaging range of the camera 20 is an environment of medium brightness. Furthermore, if the average brightness M is M ⁇ 130, the brightness determination unit 12 determines that the imaging range of the camera 20 is a bright environment.

- the procedure of the processing executed by the image processing apparatus 10is the same as in the first or second embodiment.

- the brightnesscan be determined without using the illuminance sensor 26. Therefore, the brightness can be determined at low cost.

- the forklift 25when the forklift 25 is located indoors and the camera 20 is photographing a bright environment outdoors, if the brightness determination is performed using the illuminance sensor 26, it is determined to be a dark environment, and the photographing is performed. The result may differ from the target environment. However, when the brightness is determined by using the average luminance of the images, it is determined that the environment is bright as in the environment in which the camera 20 is an imaging target. Therefore, the label can be detected more accurately.

- FIG. 18is a block diagram showing the configuration of the image processing system according to the fourth embodiment.

- An image processing system 1B shown in FIG. 18includes an image processing device 10B instead of the image processing device 10 in the configuration of the image processing system 1 shown in FIG.

- the image processing device 10Bis configured by a computer like the image processing device 10.

- the image processing apparatus 10Bincludes a brightness determination unit 12B instead of the brightness determination unit 12 as a functional configuration.

- the brightness determination unit 12Bis connected to the camera 20 and determines the brightness of the imaging range of the camera 20 based on the imaging parameter information regarding the adjustment of the brightness acquired from the camera 20.

- the brightness determination unit 12Bacquires information on the exposure time (shutter speed) from the camera 20 as the imaging parameter information. To do.

- the brightness determination unit 12Bdetermines brightness based on the acquired exposure time with reference to the brightness/darkness reference DB 17 stored in the storage device 16.

- FIG. 19is a diagram showing an example of the light/dark reference DB 17.

- the lightness/darkness reference DB 17indicates a reference for determining, based on the exposure time (ET), whether the environment imaged by the camera 20 at the exposure time is a bright environment, a dark environment, or a medium brightness environment. Has been done.

- the environment in which the exposure time is ET>1/30 secondsis a dark environment.

- the environment where the exposure time is 1/100 seconds ⁇ ET ⁇ 1/30 secondsis a medium brightness environment.

- the environment where the exposure time is ET ⁇ 1/100 secondsis a bright environment.

- the brightness determination unit 12determines that the imaging range of the camera 20 is a dark environment if the exposure time (ET) acquired from the camera 20 is ET>1/30 seconds. If the exposure time (ET) is 1/100 seconds ⁇ ET ⁇ 1/30 seconds, the brightness determination unit 12 determines that the imaging range of the camera 20 is an environment of medium brightness. Furthermore, the brightness determination unit 12 determines that the imaging range of the camera 20 is a bright environment if the exposure time (ET) is ET ⁇ 1/100 seconds.

- the procedure of the processing executed by the image processing apparatus 10is the same as in the first or second embodiment.

- the brightness determination unit 12Bacquires the diaphragm value (F value) from the camera 20 as the imaging parameter information.

- the brightness determination unit 12Bdetermines the brightness of the imaging range of the camera 20 with reference to the brightness/darkness reference DB 17 indicating the correspondence between the aperture value and the brightness, based on the acquired aperture value. In a bright environment, the aperture value is increased to reduce the light passing through the lens, and in a dark environment, the aperture value is decreased to increase the light passing through the lens.

- the brightnesscan be determined without using the illuminance sensor 26. Therefore, the brightness can be determined at low cost.

- the brightness of the imaging range of the camera 20is determined based on one item among the illuminance, the average brightness, the exposure time, and the like. However, the brightness may be determined based on two or more items.

- the brightness determination unit 12refers to the brightness/darkness reference DB 17 based on the illuminance of the imaging range of the camera 20 measured by the illuminance sensor 26 and the exposure time of the camera 20, and the brightness of the imaging range of the camera 20. May be determined.

- FIG. 20is a diagram showing an example of the brightness/darkness reference DB 17.

- the light-dark reference DB 17has the illuminance based on the illuminance (IL) and the exposure time (ET), and the environment captured by the camera 20 at the exposure time is a bright environment, a dark environment, or a medium brightness. Criteria for determining whether or not the environment is shown. For example, according to the light-dark reference DB 17 shown in FIG. 20, the environment in which the illuminance is IL ⁇ 500 lx and the exposure time is ET>1/30 seconds is a dark environment. The environment in which the illuminance is IL ⁇ 10000 and the exposure time is ET ⁇ 1/100 seconds is a bright environment. Otherwise, the environment is of medium brightness.

- the brightness determination unit 12refers to the brightness/darkness reference DB 17 and determines the brightness of the imaging range of the camera 20, based on the (IL) measured by the illuminance sensor 26 and the exposure time (ET) acquired from the camera 20. ..

- the brightness of the imaging range of the camera 20can be determined based on a plurality of items. Therefore, the brightness can be determined more accurately.

- the labelmay be attached to clothing or armbands worn by a person.

- FIG. 21is a view of a person as seen from the front.

- the personwears the armband attached with the label 90F on both arms.

- the label 90Fincludes a blue label 91B, a red label 91R, and a green label 91G, and a gap region 92 is provided between the labels.

- the target to which the label is attachedis not limited to a person.

- a labelmay be attached to the object to be detected.

- FIG. 22is an external view of a cardboard box.

- the label 90Dis attached to the cardboard box.

- the label 90Dincludes a blue label 91B, a red label 91R, and a green label 91G, and a gap region 92 is provided between the labels.

- a labelmay be attached to the prohibited place for detection.

- FIG. 23is a diagram schematically showing a road on which the forklift 25 travels.

- the road 100 on which the forklift 25 travelsis provided with, for example, an entry prohibited road 101, an entry prohibited road 102, and an entry prohibited area 103 where entry of the forklift 25 is prohibited.

- Labels 90J and 90Kare attached near the entrances of the prohibited roads 101 and 102. Further, a label 90L is attached around the entry prohibited area 103.

- Each of the labels 90J, 90K and 90Lis composed of a blue label 91B, a red label 91R and a green label 91G.

- the image processing apparatus 10can detect that the forklift 25 has approached the entry prohibited place (the entry prohibited road 101, the entry prohibited road 102, or the entry prohibited area 103).

- the image processing device 10outputs a notification sound from the sound output device 30 or notifies the display device 40 in order to notify the driver of the forklift 25 or a user around the forklift 25 that the forklift 25 has approached the prohibited area.

- a messageis displayed, or information indicating that the vehicle is approaching the prohibited area is transmitted to the terminal device 50.

- the labelis attached to the helmet or the label is attached to the clothing or the armband to attach the label to the detection target, but the method of attaching the label is not limited to this. Not something.

- the labelmay be attached by directly applying the paint of each color forming the label to the detection target.

- the labelmay be attached to the helmet by directly applying the red, green and blue paint and the black paint as the gap area to the helmet.

- a part or all of the constituent elements of the image processing apparatus 10may be composed of one system LSI.

- the system LSIis a super-multifunctional LSI manufactured by integrating a plurality of constituent parts on one chip, and specifically, is a computer system including a microprocessor, ROM, RAM and the like. ..

- a computer programis stored in the RAM.

- the system LSIachieves its function by the microprocessor operating in accordance with the computer program.

- the present disclosurecan also be realized as a computer program that realizes the method described above by a computer.

- a computer programcan be recorded in a computer-readable non-transitory recording medium, for example, an HDD, a CD-ROM, a semiconductor memory or the like for distribution, and can be distributed by an electric communication line, a wireless or wired communication line, It can also be transmitted via a network represented by the Internet, data broadcasting, or the like.

- the image processing device 10may be realized by a plurality of computers.

- some or all of the functions of the image processing device 10may be provided by cloud computing. That is, some or all of the functions of the image processing apparatus 10 may be realized by the cloud server.

- the function of the label detection unit 14is realized by the cloud server, the image processing apparatus 10 transmits the information of the image and the detection target color to the cloud server, and the cloud server detects the label detection result. May be obtained. Further, the above embodiment and the above modifications may be combined.

Landscapes

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Image Analysis (AREA)

- Image Processing (AREA)

Abstract

Description

Translated fromJapanese 本開示は、画像処理装置、コンピュータプログラム、および画像処理システムに関する。

本出願は、2018年12月12日出願の日本出願第2018-232117号に基づく優先権を主張し、前記日本出願に記載された全ての記載内容を援用するものである。The present disclosure relates to an image processing device, a computer program, and an image processing system.

This application claims the priority right based on Japanese application No. 2018-232117 filed on December 12, 2018, and incorporates all the contents described in the Japanese application.

従来、複数の色領域を含むラベルが物体を認識するために用いられている。例えば、特許文献1には、ラベルの一例として、マークと呼ばれる色領域を複数含む二次元コードが開示されている。二次元コードに含まれるマークの色およびマークの位置により、所定の情報がエンコードされる。つまり、二次元コードは、所定の情報を表す。このため、カメラで二次元コードを撮影した画像から、複数のマークを検出し、検出したマークの色およびマークの位置に基づいて、情報をデコードすることができる。Conventionally, labels containing multiple color areas have been used to recognize objects. For example, Patent Document 1 discloses, as an example of a label, a two-dimensional code including a plurality of color regions called marks. Predetermined information is encoded by the color of the mark and the position of the mark included in the two-dimensional code. That is, the two-dimensional code represents predetermined information. Therefore, it is possible to detect a plurality of marks from an image obtained by capturing a two-dimensional code with a camera and decode the information based on the detected mark color and the mark position.

本開示の一実施態様に係る画像処理装置は、検出対象に取り付けられるラベルを検出する画像処理装置であって、カメラで撮像されたカラーの画像を取得する画像取得部と、前記カメラの撮像範囲の明るさを判定する明るさ判定部と、前記明るさ判定部の判定結果に基づいて、所定数以上の色の領域を含む前記ラベルに付される色の中から、1色以上の検出対象色を決定する検出対象色決定部と、前記画像取得部が取得した前記画像から、前記検出対象色決定部が決定した前記検出対象色の領域を抽出することにより、前記ラベルを検出するラベル検出部とを備える。

本開示の他の実施態様に係るコンピュータプログラムは、コンピュータを、検出対象に取り付けられるラベルを検出する画像処理装置として機能させるためのコンピュータプログラムであって、前記コンピュータを、カメラで撮像されたカラーの画像を取得する画像取得部と、前記カメラの撮像範囲の明るさを判定する明るさ判定部と、前記明るさ判定部の判定結果に基づいて、所定数以上の色の領域を含む前記ラベルに付される色の中から、1色以上の検出対象色を決定する検出対象色決定部と、前記画像取得部が取得した前記画像から、前記検出対象色決定部が決定した前記検出対象色の領域を抽出することにより、前記ラベルを検出するラベル検出部として機能させる。

本開示の他の実施態様に係る画像処理システムは、検出対象に取り付けられる、所定数以上の色の領域を含むラベルと、カラーの画像を撮影するカメラと、上述の画像処理装置とを備える。An image processing apparatus according to an embodiment of the present disclosure is an image processing apparatus that detects a label attached to a detection target, and includes an image acquisition unit that acquires a color image captured by a camera and an imaging range of the camera. A brightness determination unit that determines the brightness of the label, and based on the determination result of the brightness determination unit, one or more detection targets from among the colors attached to the label that include a predetermined number or more of color regions. A detection target color determination unit that determines a color, and a label detection that detects the label by extracting the region of the detection target color determined by the detection target color determination unit from the image acquired by the image acquisition unit. And a section.

A computer program according to another embodiment of the present disclosure is a computer program for causing a computer to function as an image processing device that detects a label attached to a detection target, and the computer program includes a color image captured by a camera. An image acquisition unit that acquires an image, a brightness determination unit that determines the brightness of the imaging range of the camera, and based on the determination result of the brightness determination unit, the label including a region of a predetermined number or more The detection target color determination unit that determines one or more detection target colors from the colors to be attached, and the detection target color determined by the detection target color determination unit from the image acquired by the image acquisition unit. By extracting the region, it functions as a label detection unit that detects the label.

An image processing system according to another embodiment of the present disclosure includes a label that is attached to a detection target and that includes a predetermined number or more of color regions, a camera that captures a color image, and the above-described image processing device.

なお、本開示は、このような特徴的な処理部を備える画像処理装置として実現することができるだけでなく、画像処理装置に含まれる特徴的な処理部が実行する処理をステップとして含む画像処理方法として実現することができる。また、上述のコンピュータプログラムを、CD-ROM(Compact Disc-Read Only Memory)等のコンピュータ読取可能な非一時的な記録媒体やインターネット等の通信ネットワークを介して流通させることができるのは、言うまでもない。また、本開示は、画像処理装置の一部又は全部を実現する半導体集積回路として実現することもできる。The present disclosure can be realized not only as an image processing apparatus including such a characteristic processing unit, but also as an image processing method including steps executed by a characteristic processing unit included in the image processing apparatus. Can be realized as It goes without saying that the above computer program can be distributed via a computer-readable non-transitory recording medium such as a CD-ROM (Compact Disc-Read Only Memory) or a communication network such as the Internet. .. Further, the present disclosure can also be realized as a semiconductor integrated circuit that realizes part or all of an image processing device.

[本開示が解決しようとする課題]

マークの色は、照明の影響を受けやすく、同じ色のマークであっても、照明が異なると、異なる色のマークとしてカメラに撮影される場合がある。具体的には、日中の屋外のように太陽光下で赤色マークを撮影した場合には、赤色マークが黄色く映る場合がある。また、屋内の白熱電球光下で青色マークを撮影した場合には、青色マークが黒く映る場合がある。マークが本来の色とは異なる色の領域として撮影された場合には、二次元コードの誤検出や、情報の誤認識を起こしてしまう。[Problems to be solved by the present disclosure]

The color of the mark is easily influenced by the illumination, and even if the mark has the same color, the mark may be captured by the camera as a mark of a different color when the illumination is different. Specifically, when the red mark is photographed under sunlight like outdoors in the daytime, the red mark may appear yellow. Further, when the blue mark is photographed under the light of an incandescent lamp indoors, the blue mark may appear black. If the mark is photographed as an area having a color different from the original color, the two-dimensional code may be erroneously detected or the information may be erroneously recognized.

本開示はこのような事情に鑑みてなされたものであり、照明の影響を受けずに、所定数以上の色領域を含むラベルを検出することのできる画像処理装置、コンピュータプログラム、および画像処理システムを提供することを目的とする。The present disclosure has been made in view of such circumstances, and an image processing device, a computer program, and an image processing system capable of detecting a label including a predetermined number or more of color regions without being affected by illumination. The purpose is to provide.

[本開示の効果]

本開示によると、照明の影響を受けずに、所定数以上の色領域を含むラベルを検出することができる。[Effect of the present disclosure]

According to the present disclosure, a label including a predetermined number or more of color regions can be detected without being affected by illumination.

[本開示の実施形態の概要]

最初に本開示の実施形態の概要を列記して説明する。

(1)本開示の一実施形態に係る画像処理装置は、検出対象に取り付けられるラベルを検出する画像処理装置であって、カメラで撮像されたカラーの画像を取得する画像取得部と、前記カメラの撮像範囲の明るさを判定する明るさ判定部と、前記明るさ判定部の判定結果に基づいて、所定数以上の色の領域を含む前記ラベルに付される色の中から、1色以上の検出対象色を決定する検出対象色決定部と、前記画像取得部が取得した前記画像から、前記検出対象色決定部が決定した前記検出対象色の領域を抽出することにより、前記ラベルを検出するラベル検出部とを備える。[Outline of Embodiment of Present Disclosure]

First, the outline of the embodiments of the present disclosure will be listed and described.

(1) An image processing device according to an embodiment of the present disclosure is an image processing device that detects a label attached to a detection target, and an image acquisition unit that acquires a color image captured by a camera, and the camera. Based on the determination result of the brightness determination unit and the brightness determination unit, one or more colors among colors attached to the label including a predetermined number of color regions or more. The detection target color determination unit that determines the detection target color, and the label is detected by extracting the region of the detection target color determined by the detection target color determination unit from the image acquired by the image acquisition unit. And a label detection unit for

この構成によると、所定数以上の色の領域を含むラベルの色の中から、カメラの撮像範囲の明るさに基づいて、1色以上の検出対象色が決定される。これにより、明るさによっては色の見え方が変化するような色を除いて検出対象色を決定することができる。よって、検出対象色の領域を抽出することで、照明の影響を受けずに、ラベルを検出することができる。According to this configuration, one or more detection target colors are determined from the colors of the label including the predetermined number or more of color areas, based on the brightness of the imaging range of the camera. As a result, it is possible to determine the detection target color by excluding the color whose color appearance changes depending on the brightness. Therefore, by extracting the area of the detection target color, the label can be detected without being affected by the illumination.

(2)好ましくは、前記ラベルは、前記領域に再帰性反射材を含む。(2) Preferably, the label includes a retroreflective material in the area.

再帰性反射材は、光の入射角と出射角が等しくなる性質を有している。このため、ラベルがいずれかの方向に傾いていたとしても、カメラの光軸方向に沿った光をラベルに照射することにより、カメラは当該光のラベルでの反射光を受光することができる。これにより、夜間でもラベルを高精度に検出することができる。▽Retroreflective material has the property that the incident angle of light is equal to the outgoing angle. Therefore, even if the label is inclined in either direction, the camera can receive the reflected light of the light by irradiating the label with light along the optical axis direction of the camera. As a result, the label can be detected with high accuracy even at night.

(3)また、前記明るさ判定部は、前記画像取得部が取得した前記画像、前記カメラから取得される明るさの調整に関する撮像パラメータ情報、および前記カメラの撮像範囲に含まれる位置に係る照度を計測する照度センサから取得される照度情報の少なくとも1つに基づいて、前記明るさを判定してもよい。(3) Further, the brightness determination unit is configured such that the image acquired by the image acquisition unit, imaging parameter information regarding brightness adjustment acquired from the camera, and illuminance at a position included in an imaging range of the camera. The brightness may be determined based on at least one piece of illuminance information acquired from an illuminance sensor that measures.

この構成によると、カメラの撮像範囲の明るさを容易に判定することができる。特に、画像または撮像パラメータに基づいて明るさを判定する場合には、明るさ判定のための特別な装置を設ける必要がないため、低コストで明るさを判定することができる。With this configuration, it is possible to easily determine the brightness of the imaging range of the camera. In particular, when determining the brightness based on an image or an imaging parameter, it is not necessary to provide a special device for determining the brightness, and thus the brightness can be determined at low cost.

(4)また、前記検出対象色決定部は、前記所定数以上の色のうち、少なくとも波長が最長の色および波長が最短の色以外の色である中間波長色を、前記検出対象色と決定してもよい。(4) In addition, the detection target color determination unit determines, as the detection target color, an intermediate wavelength color that is at least a color other than the color having the longest wavelength and the color having the shortest wavelength among the predetermined number of colors or more. You may.