KR20210120712A - Server, method and computer program for providing video call service - Google Patents

Server, method and computer program for providing video call serviceDownload PDFInfo

- Publication number

- KR20210120712A KR20210120712AKR1020200037778AKR20200037778AKR20210120712AKR 20210120712 AKR20210120712 AKR 20210120712AKR 1020200037778 AKR1020200037778 AKR 1020200037778AKR 20200037778 AKR20200037778 AKR 20200037778AKR 20210120712 AKR20210120712 AKR 20210120712A

- Authority

- KR

- South Korea

- Prior art keywords

- image

- user terminal

- video call

- information

- call service

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

Images

Classifications

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N7/00—Television systems

- H04N7/14—Systems for two-way working

- H04N7/141—Systems for two-way working between two video terminals, e.g. videophone

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N20/00—Machine learning

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/222—Studio circuitry; Studio devices; Studio equipment

- H04N5/262—Studio circuits, e.g. for mixing, switching-over, change of character of image, other special effects ; Cameras specially adapted for the electronic generation of special effects

- H04N5/265—Mixing

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/222—Studio circuitry; Studio devices; Studio equipment

- H04N5/262—Studio circuits, e.g. for mixing, switching-over, change of character of image, other special effects ; Cameras specially adapted for the electronic generation of special effects

- H04N5/272—Means for inserting a foreground image in a background image, i.e. inlay, outlay

Landscapes

- Engineering & Computer Science (AREA)

- Signal Processing (AREA)

- Multimedia (AREA)

- Software Systems (AREA)

- Theoretical Computer Science (AREA)

- Evolutionary Computation (AREA)

- Medical Informatics (AREA)

- Physics & Mathematics (AREA)

- Computing Systems (AREA)

- General Engineering & Computer Science (AREA)

- General Physics & Mathematics (AREA)

- Mathematical Physics (AREA)

- Data Mining & Analysis (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Artificial Intelligence (AREA)

- Telephonic Communication Services (AREA)

Abstract

Translated fromKoreanDescription

Translated fromKorean본 발명은 영상 통화 서비스를 제공하는 서버, 방법 및 컴퓨터 프로그램에 관한 것이다.The present invention relates to a server, a method and a computer program for providing a video call service.

최근, 통신 관련 기술이 급속히 발전함에 따라, 화상 통화가 상용화되면서 기존의 음성 통화 및 단문 메시지 송수신 위주의 이동통신 서비스에서 벗어나 장소에 관계없이 사용자 단말기를 이용하여 상대방의 모습을 보면서 통화할 수 있게 되었다.In recent years, with the rapid development of communication-related technologies, with the commercialization of video calls, it is now possible to make calls while looking at the other person's appearance using a user terminal regardless of location, away from the existing mobile communication services that focus on sending and receiving voice and short messages. .

이처럼 영상 통화가 보편화되어 있긴 하지만 영상 통화가 어려운 환경에서는 서로 간에 영상 통화를 계속 진행하기가 쉽지 않다.Although video calls are common, it is not easy to continue video calls with each other in an environment where video calls are difficult.

한편, 특허문헌 1에는 발신 영상 단말과 영상 통화호가 설정된 착신 음성 단말로부터 수신된 음성 데이터를 기설정한 영상 데이터와 합성하여 생성된 영상 통화 데이터를 발신 영상 단말로 전송하는 구성이 개시되어 있다.Meanwhile, Patent Document 1 discloses a configuration for transmitting video call data generated by synthesizing audio data received from an outgoing video terminal and an incoming audio terminal to which a video call is set with preset video data to the outgoing video terminal.

본 발명은 전술한 종래 기술의 문제점을 해결하기 위한 것으로서, 사용자 단말 및 타사용자 단말 간에 영상 통화 서비스가 수행되는 중에 사용자 단말로부터 영상 생성 요청 메시지를 수신하면, 사용자 단말의 실사 영상 대신에 사용자 단말의 사용자가 등장하는 대체 영상을 타사용자 단말에게 전송하고자 한다.The present invention is intended to solve the problems of the prior art described above. When a video call service is performed between a user terminal and another user terminal and an image creation request message is received from the user terminal, the user terminal's image instead of the actual image of the user terminal is received. An alternative image in which a user appears is to be transmitted to another user terminal.

다만, 본 실시예가 이루고자 하는 기술적 과제는 상기된 바와 같은 기술적 과제들로 한정되지 않으며, 또 다른 기술적 과제들이 존재할 수 있다.However, the technical problems to be achieved by the present embodiment are not limited to the technical problems described above, and other technical problems may exist.

상술한 기술적 과제를 달성하기 위한 기술적 수단으로서, 본 발명의 제 1 측면에 따른 영상 통화 서비스를 제공하는 서버는 사용자 단말로부터 수신된 복수의 학습 데이터에 기초하여 영상 생성 모델을 학습하는 모델 학습부; 상기 사용자 단말 및 타사용자 단말 간의 영상 통화 서비스를 수행하는 영상 통화 수행부; 상기 영상 통화 서비스가 수행되는 중에 상기 사용자 단말로부터 영상 생성 요청 메시지를 수신하는 수신부; 및 상기 영상 생성 요청 메시지에 기초하여 상기 영상 생성 모델을 통해 상기 사용자 단말의 사용자가 등장하는 대체 영상을 생성하는 영상 생성부를 포함하고, 상기 영상 통화 수행부는 상기 영상 통화 서비스를 통해 제공되는 상기 사용자 단말에 의해 촬영된 실사 영상 대신 상기 생성된 대체 영상을 상기 타사용자 단말에게 전송할 수 있다.As a technical means for achieving the above-described technical problem, a server providing a video call service according to the first aspect of the present invention includes: a model learning unit for learning an image generation model based on a plurality of learning data received from a user terminal; a video call performing unit for performing a video call service between the user terminal and another user terminal; a receiver configured to receive an image creation request message from the user terminal while the video call service is being performed; and an image generation unit generating an alternative image in which a user of the user terminal appears through the image generation model based on the image generation request message, wherein the video call performing unit is provided through the video call service Instead of the actual image taken by the generated replacement image may be transmitted to the other user terminal.

본 발명의 제 2 측면에 따른 영상 통화 서비스를 제공하는 방법은 사용자 단말로부터 수신된 복수의 학습 데이터에 기초하여 영상 생성 모델을 학습하는 단계; 상기 사용자 단말 및 타사용자 단말 간의 영상 통화 서비스를 수행하는 단계; 상기 영상 통화 서비스가 수행되는 중에 상기 사용자 단말로부터 영상 생성 요청 메시지를 수신하는 단계; 및 상기 영상 생성 요청 메시지에 기초하여 상기 영상 생성 모델을 통해 상기 사용자 단말의 사용자가 등장하는 대체 영상을 생성하는 단계를 포함하고, 상기 영상 통화 서비스를 수행하는 단계는 상기 영상 통화 서비스를 통해 제공되는 상기 사용자 단말에 의해 촬영된 실사 영상 대신 상기 생성된 대체 영상을 상기 타사용자 단말에게 전송하는 단계를 포함할 수 있다.A method of providing a video call service according to a second aspect of the present invention includes: learning an image generation model based on a plurality of learning data received from a user terminal; performing a video call service between the user terminal and another user terminal; receiving an image creation request message from the user terminal while the video call service is being performed; and generating an alternative image in which the user of the user terminal appears through the image generation model based on the image creation request message, wherein performing the video call service is provided through the video call service It may include transmitting the generated replacement image instead of the actual image taken by the user terminal to the other user terminal.

본 발명의 제 3 측면에 따른 영상 통화 서비스를 제공하는 명령어들의 시퀀스를 포함하는 매체에 저장된 컴퓨터 프로그램은 컴퓨팅 장치에 의해 실행될 경우, 사용자 단말로부터 수신된 복수의 학습 데이터에 기초하여 영상 생성 모델을 학습하고, 상기 사용자 단말 및 타사용자 단말 간의 영상 통화 서비스를 수행하고, 상기 영상 통화 서비스가 수행되는 중에 상기 사용자 단말로부터 영상 생성 요청 메시지를 수신하고, 상기 영상 생성 요청 메시지에 기초하여 상기 영상 생성 모델을 통해 상기 사용자 단말의 사용자가 등장하는 대체 영상을 생성하고, 상기 영상 통화 서비스를 통해 제공되는 상기 사용자 단말에 의해 촬영된 실사 영상 대신 상기 생성된 대체 영상을 상기 타사용자 단말에게 전송하는 명령어들의 시퀀스를 포함할 수 있다.When a computer program stored in a medium including a sequence of instructions for providing a video call service according to the third aspect of the present invention is executed by a computing device, it learns an image generation model based on a plurality of learning data received from a user terminal. performing a video call service between the user terminal and another user terminal, receiving an image generation request message from the user terminal while the video call service is being performed, and generating the image generation model based on the image generation request message A sequence of commands for generating an alternative image in which the user of the user terminal appears through the user terminal, and transmitting the generated alternative image to the other user terminal instead of the actual image taken by the user terminal provided through the video call service may include

상술한 과제 해결 수단은 단지 예시적인 것으로서, 본 발명을 제한하려는 의도로 해석되지 않아야 한다. 상술한 예시적인 실시예 외에도, 도면 및 발명의 상세한 설명에 기재된 추가적인 실시예가 존재할 수 있다.The above-described problem solving means are merely exemplary, and should not be construed as limiting the present invention. In addition to the exemplary embodiments described above, there may be additional embodiments described in the drawings and detailed description.

전술한 본 발명의 과제 해결 수단 중 어느 하나에 의하면, 본 발명은 사용자 단말 및 타사용자 단말 간에 영상 통화 서비스가 수행되는 중에 사용자 단말로부터 영상 생성 요청 메시지를 수신하면, 사용자 단말의 실사 영상 대신에 사용자 단말의 사용자가 등장하는 대체 영상을 타사용자 단말에게 전송할 수 있다.According to any one of the above-described problem solving means of the present invention, the present invention receives an image creation request message from a user terminal while a video call service is performed between the user terminal and another user terminal, the user instead of the actual image of the user terminal An alternative image in which the user of the terminal appears may be transmitted to the terminal of another user.

이를 통해, 본 발명은 사용자 또는 타사용자가 영상 통화를 필요로 하는 상황이지만, 실제 영상 통화를 하기 어려운 상황에 놓여 있더라도 상대의 실사 영상 대신에 대체 영상을 제공함으로써 영상 통화를 계속 진행할 수 있도록 한다.Through this, the present invention allows the user or other users to continue the video call by providing an alternative video instead of the actual video even if the user or other user is in a situation in which it is difficult to make a video call, although it is a situation that requires a video call.

또한, 본 발명은 사용자의 실사 영상을 촬영할 수 없는 상황에서도 사용자가 입력한 텍스트 또는, 음성 데이터에 기초하여 대체 영상을 생성하여 타사용자 단말에게 제공함으로써 영상 통화를 계속 진행할 수 있도록 한다.In addition, the present invention generates a replacement image based on the text or voice data input by the user even in a situation where the user's actual image cannot be taken and provides it to other user terminals so that the video call can be continued.

또한, 본 발명은 기존의 아바타 영상이 아닌 실제 사용자가 등장하는 대체 영상을 타사용자 단말에게 제공함으로써 타사용자가 영상 통화시의 실재감을 느낄 수 있도록 한다.In addition, the present invention provides another user terminal with an alternative image in which a real user appears, rather than the existing avatar image, so that other users can feel a sense of reality during a video call.

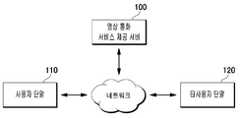

도 1은 본 발명의 일 실시예에 따른, 영상 통화 서비스 제공 시스템의 구성도이다.

도 2는 본 발명의 일 실시예에 따른, 도 1에 도시된 영상 통화 서비스 제공 서버의 블록도이다.

도 3a 내지 3b는 본 발명의 일 실시예에 따른, 영상 생성 모델의 학습 방법을 설명하기 위한 도면이다.

도 4a 내지 4c는 본 발명의 일 실시예에 따른, 대체 영상을 생성하는 방법을 설명하기 위한 도면이다.

도 5a 내지 5d는 본 발명의 일 실시예에 따른, 반응형 영상을 생성하는 방법을 설명하기 위한 도면이다.

도 6은 본 발명의 일 실시예에 따른, 영상 통화 서비스를 제공하는 방법을 나타낸 흐름도이다.

도 7은 본 발명의 일 실시예에 따른, 반응형 영상을 제공하는 방법을 나타낸 흐름도이다.1 is a block diagram of a system for providing a video call service according to an embodiment of the present invention.

2 is a block diagram of a video call service providing server shown in FIG. 1 according to an embodiment of the present invention.

3A to 3B are diagrams for explaining a method of learning an image generation model according to an embodiment of the present invention.

4A to 4C are diagrams for explaining a method of generating an alternative image according to an embodiment of the present invention.

5A to 5D are diagrams for explaining a method of generating a responsive image according to an embodiment of the present invention.

6 is a flowchart illustrating a method of providing a video call service according to an embodiment of the present invention.

7 is a flowchart illustrating a method of providing a responsive image according to an embodiment of the present invention.

아래에서는 첨부한 도면을 참조하여 본 발명이 속하는 기술 분야에서 통상의 지식을 가진 자가 용이하게 실시할 수 있도록 본 발명의 실시예를 상세히 설명한다. 그러나 본 발명은 여러 가지 상이한 형태로 구현될 수 있으며 여기에서 설명하는 실시예에 한정되지 않는다. 그리고 도면에서 본 발명을 명확하게 설명하기 위해서 설명과 관계없는 부분은 생략하였으며, 명세서 전체를 통하여 유사한 부분에 대해서는 유사한 도면 부호를 붙였다.DETAILED DESCRIPTION OF THE PREFERRED EMBODIMENTS Hereinafter, embodiments of the present invention will be described in detail with reference to the accompanying drawings so that those of ordinary skill in the art can easily implement them. However, the present invention may be embodied in many different forms and is not limited to the embodiments described herein. And in order to clearly explain the present invention in the drawings, parts irrelevant to the description are omitted, and similar reference numerals are attached to similar parts throughout the specification.

명세서 전체에서, 어떤 부분이 다른 부분과 "연결"되어 있다고 할 때, 이는 "직접적으로 연결"되어 있는 경우뿐 아니라, 그 중간에 다른 소자를 사이에 두고 "전기적으로 연결"되어 있는 경우도 포함한다. 또한 어떤 부분이 어떤 구성요소를 "포함"한다고 할 때, 이는 특별히 반대되는 기재가 없는 한 다른 구성요소를 제외하는 것이 아니라 다른 구성요소를 더 포함할 수 있는 것을 의미한다.Throughout the specification, when a part is "connected" with another part, this includes not only the case of being "directly connected" but also the case of being "electrically connected" with another element interposed therebetween. . In addition, when a part "includes" a certain component, this means that other components may be further included rather than excluding other components unless otherwise stated.

본 명세서에 있어서 '부(部)'란, 하드웨어에 의해 실현되는 유닛(unit), 소프트웨어에 의해 실현되는 유닛, 양방을 이용하여 실현되는 유닛을 포함한다. 또한, 1 개의 유닛이 2 개 이상의 하드웨어를 이용하여 실현되어도 되고, 2 개 이상의 유닛이 1 개의 하드웨어에 의해 실현되어도 된다.In this specification, a "part" includes a unit realized by hardware, a unit realized by software, and a unit realized using both. In addition, one unit may be implemented using two or more hardware, and two or more units may be implemented by one hardware.

본 명세서에 있어서 단말 또는 디바이스가 수행하는 것으로 기술된 동작이나 기능 중 일부는 해당 단말 또는 디바이스와 연결된 서버에서 대신 수행될 수도 있다. 이와 마찬가지로, 서버가 수행하는 것으로 기술된 동작이나 기능 중 일부도 해당 서버와 연결된 단말 또는 디바이스에서 수행될 수도 있다.Some of the operations or functions described as being performed by the terminal or device in the present specification may be instead performed by a server connected to the terminal or device. Similarly, some of the operations or functions described as being performed by the server may also be performed in a terminal or device connected to the server.

이하, 첨부된 구성도 또는 처리 흐름도를 참고하여, 본 발명의 실시를 위한 구체적인 내용을 설명하도록 한다.Hereinafter, detailed contents for carrying out the present invention will be described with reference to the accompanying configuration diagram or process flow diagram.

도 1은 본 발명의 일 실시예에 따른, 영상 통화 서비스 제공 시스템의 구성도이다.1 is a block diagram of a system for providing a video call service according to an embodiment of the present invention.

도 1을 참조하면, 영상 통화 서비스 제공 시스템은 영상 통화 서비스 제공 서버(100), 사용자 단말(110) 및 타사용자 단말(120)을 포함할 수 있다. 다만, 이러한 도 1의 영상 통화 서비스 제공 시스템은 본 발명의 일 실시예에 불과하므로 도 1을 통해 본 발명이 한정 해석되는 것은 아니며, 본 발명의 다양한 실시예들에 따라 도 1과 다르게 구성될 수도 있다.Referring to FIG. 1 , a system for providing a video call service may include a video call

일반적으로, 도 1의 영상 통화 서비스 제공 시스템의 각 구성요소들은 네트워크(미도시)를 통해 연결된다. 네트워크는 단말들 및 서버들과 같은 각각의 노드 상호 간에 정보 교환이 가능한 연결 구조를 의미하는 것으로, 근거리 통신망(LAN: Local Area Network), 광역 통신망(WAN: Wide Area Network), 인터넷 (WWW: World Wide Web), 유무선 데이터 통신망, 전화망, 유무선 텔레비전 통신망 등을 포함한다. 무선 데이터 통신망의 일례에는 3G, 4G, 5G, 3GPP(3rd Generation Partnership Project), LTE(Long Term Evolution), WIMAX(World Interoperability for Microwave Access), 와이파이(Wi-Fi), 블루투스 통신, 적외선 통신, 초음파 통신, 가시광 통신(VLC: Visible Light Communication), 라이파이(LiFi) 등이 포함되나 이에 한정되지는 않는다.In general, each component of the video call service providing system of FIG. 1 is connected through a network (not shown). A network refers to a connection structure that enables information exchange between each node, such as terminals and servers, and includes a local area network (LAN), a wide area network (WAN), and the Internet (WWW: World). Wide Web), wired and wireless data communication networks, telephone networks, wired and wireless television networks, and the like. Examples of wireless data communication networks include 3G, 4G, 5G, 3rd Generation Partnership Project (3GPP), Long Term Evolution (LTE), World Interoperability for Microwave Access (WIMAX), Wi-Fi, Bluetooth communication, infrared communication, ultrasound Communication, Visible Light Communication (VLC), LiFi, etc. are included, but are not limited thereto.

사용자 단말(110)은 이미지 데이터 및 영상 데이터 중 적어도 하나를 포함하는 복수의 학습 데이터를 영상 통화 서비스 제공 서버(100)에게 전송할 수 있다.The

영상 통화 서비스 제공 서버(100)는 사용자 단말(110)로부터 수신된 복수의 학습 데이터에 기초하여 영상 생성 모델을 학습할 수 있다.The video call

사용자 단말(110)은 영상 통화 서비스 제공 서버(100)에게 타사용자 단말(120)과의 영상 통화를 요청할 수 있다.The

영상 통화 서비스 제공 서버(100)는 사용자 단말(110)로부터 타사용자 단말(120)과의 영상 통화 요청을 수신하면, 사용자 단말(110) 및 타사용자 단말(120) 간의 영상 통화 서비스를 사용자 단말(110) 및 타사용자 단말(120)에게 제공할 수 있다.When the video call

영상 통화 서비스 제공 서버(100)는 영상 통화 서비스가 수행되는 중에 사용자 단말(110)로부터 영상 생성 요청 메시지를 수신할 수 있다. 여기서, 영상 생성 요청 메시지는 사용자 단말(110)이 타사용자 단말(120)과 통화는 지속하고 싶으나, 영상 통화를 할 수 없는 상황에서 보내는 메시지일 수 있다.The video call

영상 통화 서비스 제공 서버(100)는 사용자 단말(110)로부터 수신된 영상 생성 요청 메시지에 기초하여 영상 생성 모델을 통해 사용자 단말(110)의 사용자가 등장하는 대체 영상을 생성할 수 있다.The video call

영상 통화 서비스 제공 서버(100)는 영상 통화 서비스를 통해 제공되는 사용자 단말(110)에 의해 촬영된 실사 영상 대신 생성된 대체 영상을 타사용자 단말(120)에게 전송할 수 있다.The video call

사용자 단말(110) 및 타사용자 단말(120)은 무선 통신이 가능한 모바일 단말을 포함할 수 있고, 본 발명의 다양한 실시예들에 따르면, 사용자 단말(110) 및 타사용자 단말(120)은 다양한 형태의 디바이스일 수 있다. 예를 들어, 사용자 단말(110)은 네트워크를 통해 원격지의 서버에 접속할 수 있는 휴대용 단말일 수 있다. 여기서, 휴대용 단말의 일 예에는 휴대성과 이동성이 보장되는 무선 통신 장치로서, PCS(Personal Communication System), GSM(Global System for Mobile communications), PDC(Personal Digital Cellular), PHS(Personal Handyphone System), PDA(Personal Digital Assistant), IMT(International Mobile Telecommunication)-2000, CDMA(Code Division Multiple Access)-2000, W-CDMA(W-Code Division Multiple Access), Wibro(Wireless Broadband Internet) 단말, 스마트폰(smartphone), 태블릿 PC, 등과 같은 모든 종류의 핸드헬드(Handheld) 기반의 무선 통신 장치가 포함될 수 있다. 다만, 사용자 단말(110)은 앞서 예시된 것들로 한정 해석되는 것은 아니다.The

이하에서는 도 1의 영상 통화 서비스 제공 시스템의 각 구성요소의 동작에 대해 보다 구체적으로 설명한다.Hereinafter, the operation of each component of the video call service providing system of FIG. 1 will be described in more detail.

도 2는 본 발명의 일 실시예에 따른, 도 1에 도시된 영상 통화 서비스 제공 서버(100)의 블록도이다.FIG. 2 is a block diagram of the video call

도 2를 참조하면, 영상 통화 서비스 제공 서버(100)는 모델 학습부(200), 영상 통화 수행부(210), 수신부(220), 영상 생성부(230), 및 분석부(240)를 포함할 수 있다. 다만, 도 2에 도시된 영상 통화 서비스 제공 서버(100)는 본 발명의 하나의 구현 예에 불과하며, 도 2에 도시된 구성요소들을 기초로 하여 여러 가지 변형이 가능하다.Referring to FIG. 2 , the video call

이하에서는 도 3a 내지 5d를 함께 참조하여 도 2를 설명하기로 한다.Hereinafter, FIG. 2 will be described with reference to FIGS. 3A to 5D.

수신부(220)는 사용자 단말(110)로부터 복수의 학습 데이터를 수신할 수 있다. 여기서, 복수의 학습 데이터는 이미지 데이터 및 영상 데이터 중 적어도 하나를 포함할 수 있다. 이 때, 이미지 데이터는 인물 정보 및 위치 정보 중 적어도 어느 하나에 기초하여 사용자 단말(110)에 의해 분류된 데이터이다.The

수신부(220)는 사용자 단말(110)로부터 수신된 학습 데이터가 이미지 데이터인 경우, 분류된 이미지 데이터 별 인물 정보 또는 위치 정보를 사용자 단말(110)로부터 더 수신할 수 있다.When the learning data received from the

또한, 수신부(220)는 사용자 단말(110)로부터 수신된 학습 데이터가 영상 데이터인 경우, 영상 데이터에 등장하는 인물 정보 및 영상 데이터가 촬영된 위치 정보를 사용자 단말(110)로부터 더 수신할 수 있다.In addition, when the learning data received from the

도 3a를 참조하면, 사용자 단말(110)은 사용자 단말(110)의 메모리에 저장된 복수의 이미지 데이터를 사용자 단말(110)의 현재 위치 정보 또는 사용자 단말(110)에 의해 설정된 위치 정보(예컨대, 이미지 데이터가 촬영된 위치 정보)에 기초하여 분류할 수 있다. 예를 들어, 사용자 단말(110)은 영상 데이터의 분류를 위해 설정된 위치 정보가 사용자의 집 위치 정보와 회사 위치 정보인 경우, 복수의 이미지 데이터 중 사용자의 집 위치 정보에 기초하여 사용자의 집에서 촬영된 이미지 데이터(301)를 그룹핑할 수 있고, 사용자의 회사 위치 정보에 기초하여 사용자의 회사에서 촬영된 이미지 데이터를 그룹핑하여 분류할 수 있다. 이 후, 사용자 단말(110)은 위치 정보에 따라 분류된 이미지 데이터를 포함하는 학습 데이터를 영상 통화 서비스 제공 서버(100)에게 전송할 수 있다.Referring to FIG. 3A , the

만일, 사용자 단말(110)은 사용자로부터 위치 정보를 입력받지 않은 경우, 이미지 데이터의 배경 정보 간의 유사도에 기초하여 복수의 이미지 데이터 중 유사 배경 정보를 갖는 이미지 데이터끼리 분류할 수도 있다.If location information is not received from the user, the

또한, 사용자 단말(110)은 사용자로부터 영상 데이터의 분류를 위해 인물 정보를 입력받으면, 입력된 인물 정보에 기초하여 복수의 이미지 데이터를 분류할 수 있다. 예를 들어, 사용자로부터 입력된 인물 정보가 '사용자 본인'과 'A 인물'인 경우, 사용자 단말(110)은 복수의 영상 데이터 중 '사용자'만 등장하는 영상 데이터(303)만을 그룹핑하고, 'A 인물'만 등장하는 영상 데이터만을 그룹핑하여 분류할 수 있다. 이 후, 사용자 단말(110)은 인물 정보에 따라 분류된 이미지 데이터를 포함하는 학습 데이터를 영상 통화 서비스 제공 서버(100)에게 전송할 수 있다. 만일, 사용자 단말(110)은 사용자로부터 인물 정보를 입력받지 않은 경우, 이미지 데이터의 인물간 유사도에 기초하여 복수의 이미지 데이터 중 유사 인물이 포함된 이미지 데이터끼리 분류할 수도 있다.In addition, when receiving person information for classification of image data from the user, the

모델 학습부(200)는 사용자 단말(110)로부터 수신된 복수의 학습 데이터에 기초하여 영상 생성 모델을 학습할 수 있다.The

모델 학습부(200)는 복수의 학습 데이터가 이미지 데이터인 경우, 인물 정보 및 위치 정보 중 적어도 어느 하나에 따라 분류된 이미지 데이터에 기초하여 영상 생성 모델을 학습할 수 있다.When the plurality of training data is image data, the

예를 들어, 도 3b를 참조하면, 모델 학습부(200)는 이미지 데이터에 포함된 객체(인물 정보에 대응되는 객체)의 표정 정보 및 배경 정보(위치 정보에 대응되는 배경)를 분석하여 각 이미지 데이터로부터 특징 요소를 추출할 수 있다. 또한, 모델 학습부(200)는 이미지 데이터로부터 객체와 배경을 분리하는 세그먼테이션(segmentation) 작업을 수행하고, 배경과 분리된 객체의 이미지, 인물 정보 및 해당 이미지 데이터의 특징 요소를 영상 생성 모델(305)에 입력하여 해당 객체의 이미지가 인물 정보에 대응되는 객체로 구분하도록 영상 생성 모델(305)을 학습할 수 있다.For example, referring to FIG. 3B , the

모델 학습부(200)는 복수의 학습 데이터가 영상 데이터인 경우, 인물 정보에 따라 영상 데이터에 포함된 복수의 영상 프레임을 분리하고, 인물 정보 별로 분리된 영상 프레임에 기초하여 영상 생성 모델을 학습할 수 있다.When the plurality of learning data is image data, the

영상 통화 수행부(210)는 사용자 단말(110) 및 타사용자 단말(120) 간의 영상 통화 서비스를 수행할 수 있다. 예를 들어, 영상 통화 수행부(210)는 사용자 단말(110)로부터 타사용자 단말(120)과의 영상 통화 요청을 수신하면, 사용자 단말(110)에게 타사용자 단말(120)에 의해 촬영된 타사용자 실사 영상을 제공하고, 타사용자 단말(120)에게 사용자 단말(110)에 의해 촬영된 사용자 실사 영상을 제공할 수 있다.The video

수신부(220)는 영상 통화 서비스가 수행되는 중에 사용자 단말(110)로부터 영상 생성 요청 메시지를 수신할 수 있다. 여기서, 영상 생성 요청 메시지는 대체 영상 요청 및 사용자 데이터를 포함할 수 있다. 사용자 데이터는 사용자 단말(110)이 타사용자 단말(120)에게 전하고자 하는 대화 내용으로 구성된 사용자의 음성 데이터 또는 텍스트 데이터를 포함할 수 있다. 예를 들어, 도 4a를 참조하면, 사용자 단말(110)이 타사용자 단말(120)과 영상 통화를 하고 있는 중에 영상 통화를 수행하기 어려운 상황이 발생하면, 사용자 단말(110)은 영상 통화 화면에 표시된 영상 생성 요청 인터페이스를 통해 입력할 수 있다.The

사용자 단말(110)이 영상 생성 요청 인터페이스를 통해 영상 생성 요청에 대한 정보를 입력하면, 수신부(220)는 사용자 단말(110)로부터 사용자 실사 영상의 촬영 중지와 관련된 안내 메시지와 함께 타사용자 단말(120)에게 전하고자 하는 대화 내용을 포함하는 영상 생성 요청 메시지를 수신할 수 있다. 또한, 수신부(220)는 사용자 단말(110)로부터 대체 영상의 배경으로 사용될 배경 정보를 더 수신할 수 있고, 사용자 단말(110)의 현재 위치 정보를 더 수신할 수 있다.When the

영상 통화 수행부(210)는 사용자 단말(110) 및 타사용자 단말(120) 간의 실사 영상을 서로에게 제공하여 영상 통화 서비스를 수행할 수 있으며, 영상 통화 서비스의 수행 중에 수신된 영상 생성 요청 메시지에 포함된 대체 영상 요청 및 사용자 데이터(사용자의 음성 데이터 또는 텍스트 데이터)에 따라 실사 영상을 대신하여 대체 영상을 제공할 수 있다.The video

이를 위해, 영상 생성부(230)는 사용자 단말(110)로부터 수신된 영상 생성 요청 메시지에 기초하여 영상 생성 모델을 통해 사용자 단말(110)의 사용자가 등장하는 대체 영상을 생성할 수 있다.To this end, the

영상 생성부(230)는 영상 생성 요청 메시지에 포함된 사용자의 음성 데이터 또는 텍스트 데이터에 기초하여 영상 생성 모델을 통해 대체 영상을 생성할 수 있다. 예를 들면, 사용자의 음성 데이터에 '나 곧 회의 시작해'가 포함되어 있는 경우, 영상 생성부(230)는 사용자가 근무하는 회사의 회사 배경에 사용자가 등장하는 대체 영상을 영상 생성 모델을 통해 생성할 수 있다.The

영상 생성부(230)는 사용자 단말(110)로부터 대체 영상의 배경에 적용될 배경 정보를 수신한 경우, 배경 정보에 해당하는 배경 영상 및 사용자의 이미지 데이터를 합성하여 대체 영상을 생성할 수 있다. 예를 들어, 회사에 근무 중인 사용자 단말(110)로부터 '공원' 배경 정보를 수신하면, 영상 생성부(230)는 '공원' 배경의 영상에 사용자의 이미지 데이터를 합성하여 대체 영상을 생성할 수 있다.When receiving the background information to be applied to the background of the replacement image from the

영상 생성부(230)는 사용자 단말(110)이 대체 영상의 배경 정보를 설정하지 않은 경우, 사용자 단말(110)로부터 영상 생성 요청 메시지가 수신된 시간 정보 및 시간 정보에 대응하는 사용자 단말(110)의 위치 정보에 기초하여 대체 영상을 생성할 수 있다.When the

도 4b를 참조하면, 사용자 단말(110)로부터 수신된 영상 생성 요청 메시지가 텍스트 데이터이고, 사용자 단말(110)이 대체 영상의 배경에 적용될 배경 정보를 설정하지 않은 경우, 영상 생성부(230)는 텍스트 데이터를 수신된 시간 정보 및 시간 정보에 대응하는 사용자 단말(110)의 위치 정보에 대응하는 배경 이미지를 영상 생성 모델로부터 도출하고, 도출된 배경 이미지에 사용자의 이미지를 합성하여 대체 영상을 생성할 수 있다. 또한, 영상 생성부(230)는 텍스트 데이터를 음성으로 변환하여 변환된 음성을 대체 영상에 합성시킬 수 있다. 예를 들어, 회의중인 엄마(사용자 단말(110)의 사용자)에게 자녀(타사용자 단말(120)의 타사용자)가 영상 통화를 요청하는 상황인 경우, 영상 생성부(230)는 사용자 단말(110)이 위치한 회사의 회사 배경에 사용자의 이미지를 합성하여 제 1 대체 영상(40)을 생성할 수 있다.Referring to FIG. 4B , when the image generation request message received from the

또는, 영상 생성부(230)는 사용자의 이미지 데이터에 포함된 배경들 중에서 어느 하나의 배경을 선택하고, 선택된 배경에 사용자의 이미지를 합성하여 제 1 대체 영상을 생성할 수도 있다. 예를 들어, 회의중인 엄마(사용자 단말(110)의 사용자)에게 자녀(타사용자 단말(120)의 타사용자)가 영상 통화를 요청하는 상황인 경우, 영상 생성부(230)는 사용자의 이미지 데이터에 포함된 배경들 중 타사용자에게 친숙한 배경(예컨대, 사용자와 타사용자가 함께 찍은 사진 속의 배경)을 선택하여 이를 배경으로 제 2 대체 영상(42)을 생성할 수 있다.Alternatively, the

다른 예로, 사용자 단말(110)로부터 수신된 영상 생성 요청 메시지가 텍스트 데이터이고, 사용자 단말(110)이 대체 영상의 배경에 적용될 배경 정보를 다른 배경 정보로 변경한 경우, 영상 생성부(230)는 사용자 단말(110)에 의해 변경된 다른 배경 정보에 대응하는 배경 이미지를 사용자의 이미지를 합성하여 대체 영상을 생성할 수 있다.As another example, when the image generation request message received from the

도 4c를 참조하면, 사용자 단말(110)로부터 수신된 영상 생성 요청 메시지가 음성 데이터이고, 사용자 단말(110)이 대체 영상의 배경에 적용될 배경 정보를 설정하지 않은 경우, 영상 생성부(230)는 음성 데이터로부터 사용자의 현재 상황을 도출하고, 도출된 현재 상황에 적합한 배경 이미지에 사용자의 이미지를 합성하여 대체 영상을 생성할 수 있다. 예를 들어, 사용자 단말(110)의 사용자가 이동 중으로 영업 또는 상담을 영상통화로 진행할 수 없는 상황인 경우, 영상 생성부(230)는 무배경 이미지에 사용자의 이미지를 합성한 대체 영상(44)을 생성할 수 있다.Referring to FIG. 4C , when the image generation request message received from the

영상 통화 수행부(210)는 생성된 대체 영상을 영상 통화 서비스를 통해 제공되는 사용자 단말(110)에 의해 촬영된 실사 영상을 대신하여 타사용자 단말(120)에게 전송함으로써 사용자 단말(110) 및 타사용자 단말(120) 간의 영상 통화 서비스를 수행할 수 있다.The video

수신부(220)는 사용자 단말(110) 및 타사용자 단말(120) 각각으로부터 주변 상황 정보, 사용자의 음성 정보 및 행동 정보, 위치 정보 등을 수집할 수 있다.The

분석부(240)는 영상 통화 중에 있는 사용자 단말(110) 및 타사용자 단말(120) 간의 통화 상황 정보를 분석할 수 있다. 여기서, 통화 상황 정보는 도 5a를 참조하면, 사용자 단말(110) 및 타사용자 단말(120) 각각에 대한 위치 정보, 시간 정보, 음성 피치 정보, 얼굴 표정 정보, 행동 정보 및 주변 환경 정보 중 적어도 하나를 포함할 수 있다. 예를 들어, 분석부(240)는 사용자 단말(110)이 전송한 기존 이미지 데이터의 배경들과 사용자 단말(110)의 위치 정보 간의 유사도 분석을 통해 사용자 단말(110)의 주변 환경 정보를 분석할 수 있다.The

또한, 분석부(240)는 영상 통화 중에 있는 사용자 단말(110) 및 타사용자 단말(120) 각각에 대한 통화 상황 정보의 변경 여부를 실시간으로 판단할 수 있다. 예를 들어, 분석부(240)는 사용자 단말(110)의 사용자 또는 타사용자 단말(120)의 사용자 중 음성 피치 정보가 변경된 사용자가 누구인지, 얼굴 표정 정보의 변화가 있는 사용자가 누구인지 여부를 판단할 수 있다.In addition, the

또한, 분석부(240)는 대체 영상을 수신한 타사용자 단말(120)에 대한 통화 상황 정보를 분석할 수 있다. 예를 들어, 도 5b를 함께 참조하면, 분석부(240)는 타사용자 단말(120)의 실사 영상(50)에 포함된 타사용자 얼굴 이미지로부터 타사용자의 감정을 분석하고, 기설정된 감정 유형(분노 감정, 경멸 감정, 역겨움 감정, 두려움 감정, 행복 감정, 중립 감정, 슬픔 감정, 놀람 감정 등) 중 타사용자 단말의 감정이 속하는 감정 유형을 도출할 수 있다. 또한, 분석부(240)는 타사용자 단말(120)의 음성 데이터(52)로부터 음성 피치 정보 및 대화 내용을 분석할 수 있다.In addition, the

영상 생성부(230)는 분석된 통화 상황 정보(또는 변경된 통화 상황 정보)에 기초하여 반응형 영상을 생성할 수 있다. 예를 들어, 영상 생성부(230)는 대체 영상을 수신한 타사용자 단말(120)의 얼굴 표정 정보 또는 음성 피치 정보에 기초하여 배경 정보를 변경하고, 변경된 배경 정보에 사용자의 이미지를 합성하여 반응형 영상을 생성할 수 있다.The

영상 통화 수행부(210)는 대체 영상을 반응형 영상으로 변경하여 타사용자 단말(120)에게 전송할 수 있다.The video

분석부(240)는 반응형 영상을 수신한 타사용자 단말(120)의 반응 정보를 분석할 수 있다. 여기서, 타사용자 단말(120)의 반응 정보는 타사용자의 얼굴 표정 정보 또는 음성 피치 정보로부터 도출될 수 있다. 예를 들어, 도 5c를 참조하면, 분석부(240)는 반응형 영상을 수신한 타사용자 단말(120)의 실사 영상으로부터 타사용자의 얼굴 표정 정보를 도출하고, 도출된 타사용자의 얼굴 표정 정보에 기초하여 기설정된 감정 유형(54) 별 타사용자의 감정 점수를 산출할 수 있다. 또한, 분석부(240)는 기설정된 감정 유형(54) 별 타사용자의 감정 점수에 기초하여 타사용자 단말(120)의 반응 정보를 분석할 수 있다.The

또한, 분석부(240)는 반응형 영상을 수신한 타사용자 단말(120)의 통화 상황 정보로부터 타사용자 단말(120)의 상태 정보(예컨대, 컨디션 상태 등)를 분석할 수 있다.In addition, the

영상 생성부(230)는 분석된 타사용자 단말(120)의 반응 정보 또는 상태 정보에 기초하여 다른 반응형 영상을 생성할 수 있다. 예를 들어, 영상 생성부(230)는 반응형 영상을 수신한 타사용자 단말(120)의 반응 정보 또는 상태 정보에 대응하는 얼굴 표정 정보 또는 음성 피치 정보에 기초하여 배경 정보를 변경하고, 변경된 배경 정보에 사용자의 이미지를 합성하여 다른 반응형 영상을 생성할 수 있다.The

사용자 단말(110)과 타사용자 단말(120) 간의 통화 내용이 이전 통화 내용과 동일하더라도 타사용자 단말(120)의 반응 정보 또는 상태 정보에 따라 상이한 반응형 영상이 생성될 수 있다.Even if the content of the call between the

모델 학습부(200)는 분석된 타사용자 단말(120)의 반응 정보 또는 상태 정보를 피드백 정보로서 영상 생성 모델에 입력하여 영상 생성 모델을 재학습시킬 수 있다. 또한, 모델 학습부(200)는 기설정된 감정 방향에 따라 타사용자 단말(120)의 타사용자가 감정이 변할 수 있도록 하는 다른 반응형 영상을 생성하도록 영상 생성 모델을 재학습할 수 있다. 여기서, 기설정된 감정 방향은 사용자 단말(110)에 의해 설정된 감정 방향이거나 영상 통화 서비스 제공 서버(100)에 의해 설정된 감정 방향일 수 있다.The

영상 생성부(230)는 재학습된 영상 생성 모델을 통해 기설정된 감정 방향으로 타사용자의 감정의 변화를 유도하는 다른 반응형 영상을 생성할 수 있다. 예를 들어, 영상 생성부(230)는 타사용자 단말(120)의 타사용자의 반응 정보가 '슬픔' 감정 정보를 갖고 있는 경우, '슬픔'감정 정보에서 '좋음' 감정 정보로 변화하는 방향으로 유도할 수 있도록 하는 다른 반응형 영상을 영상 생성 모델을 통해 생성할 수 있다. 또는 영상 생성부(230)는 타사용자 단말(120)의 타사용자의 반응 정보가 '분노' 감정 정보를 갖고 있는 경우, '분노' 감정 정보에서 '편안함' 감정 정보로 변화하는 방향으로 유도할 수 있도록 하는 다른 반응형 영상을 영상 생성 모델을 통해 생성할 수 있다.The

영상 통화 수행부(210)는 반응형 영상을 다른 반응형 영상으로 변경하여 타사용자 단말에게 전송할 수 있다.The video

예를 들어, 도 5d를 참조하면, 출근길에 있는 사용자 단말(110)(예컨대, 엄마)이 집에 있는 타사용자 단말(120)(예컨대, 딸)과 영상 통화를 하고 있는 중에 사용자 단말(110)이 회사에 도착한 경우, 분석부(240)는 사용자 단말(110)의 위치 정보가 '출근길'에서 '회사'로 변경되었음을 확인할 수 있다. 또한, 분석부(240)는 사용자 단말(110)과 타사용자 단말(120) 간의 통화 내용(예컨대, '회사 다왔어?') 및 사용자 단말(110)의 음성 피치 정보(예컨대, 볼륨이 감소)에 기초하여 사용자 단말(110)의 통화 상황 정보가 변경되었음을 확인할 수 있다.For example, referring to FIG. 5D , while the user terminal 110 (eg, mother) on the way to work is making a video call with another user terminal 120 (eg, daughter) at home, the

영상 생성부(230)는 변경된 사용자 단말(110)의 위치 정보 및 음성 피치 정보에 기초하여 사용자 단말(110)이 위치한 회사의 회사 배경에 사용자의 이미지를 합성하여 대체 영상을 생성하고, 영상 통화 수행부(210)는 사용자의 실사 영상 대신에 대체 영상을 타사용자 단말(120)에게 전송할 수 있다.The

이 후, 분석부(240)는 대체 영상을 수신한 타사용자 단말(120)과 타사용자 단말(120)에 의해 촬영된 타사용자 실사 영상을 수신한 사용자 단말(110) 간의 통화 내용 및 통화 상황 정보를 분석할 수 있다.Thereafter, the

타사용자 단말(120)의 타사용자의 음성 피치 정보(예컨대, 낮은 음성 피치) 및 얼굴 표정 정보(예컨대, 어두운 표정)가 변경되면, 영상 생성부(230)는 타사용자의 감정을 기설정된 감정 방향으로 변하도록 유도하기 위해 타사용자와 친근한 배경인 집 배경에 사용자의 이미지를 합성하여 제 1 반응형 영상을 생성하고, 영상 통화 수행부(210)는 대체 영상 대신에 제 1 반응형 영상을 타사용자 단말(120)에게 전송할 수 있다.When the other user's voice pitch information (eg, low voice pitch) and facial expression information (eg, dark facial expression) of the

이후, 분석부(240)는 제 1 반응형 영상을 수신한 타사용자 단말(120)과 타사용자 실사 영상을 수신한 사용자 단말(110) 간의 통화 내용 및 통화 상황 정보를 분석할 수 있다.Thereafter, the

영상 생성부(230)는 분석된 타사용자의 음성 피치 정보(예컨대, 높은 음성 피치) 및 얼굴 표정 정보(예컨대, 밝은 표정)에 따른 타사용자의 반응 정보에 기초하여 사용자 단말(110)의 상황이 반영된 회사 배경에 사용자의 이미지를 합성시켜 제 2 반응형 영상을 생성하고, 영상 통화 수행부(210)는 제 1 반응형 영상 대신에 제 2 반응형 영상을 타사용자 단말(120)에게 전송할 수 있다.The

한편, 이하에서는 통화 중 응급 상황이 발생된 경우, 응급 상황에 따른 반응형 영상을 제공하는 일 실시예를 설명한다.Meanwhile, an embodiment of providing a responsive image according to an emergency situation when an emergency situation occurs during a call will be described below.

예를 들어, 분석부(240)는 타사용자 단말(120)(예컨대, 응급 조치가 필요한 사용자의 단말)와 사용자 단말(110)(예컨대, 응급구조사의 단말 등) 간의 통화 내용 및 통화 상황 정보를 분석할 수 있다. 예를 들어, 분석부(240)는 타사용자 단말(120)의 다급한 목소리를 포함하는 음성 피치 정보를 분석하고, 통화 내용을 통해 타사용자 단말(120)의 응급 상황을 분석할 수 있다.For example, the

영상 생성부(230)는 분석된 타사용자 단말(120)의 응급 상황에 대한 정보(예컨대, 과호흡 발생)에 기초하여 타사용자 단말(120)에게 필요한 응급 조치 방법(예컨대, 과호흡 발생시 진정하는 방법)을 포함하는 반응형 영상을 생성하고, 영상 통화 수행부(210)는 응급 조치 방법을 포함하는 반응형 영상을 타사용자 단말(120)에게 전송할 수 있다.The

이하에서는 고객과 상담 업무를 진행하는 과정에서 반응형 영상을 제공하는 일 실시예를 설명한다.Hereinafter, an embodiment in which a responsive image is provided in a process of consulting with a customer will be described.

예를 들어, 사용자 단말(110)(예컨대, 상담사 단말)이 타사용자 단말(120)(예컨대, 고객의 단말)에게 상담을 진행하는 중에 약관 설명이 필요한 경우, 영상 생성부(230)는 약관 설명이 필요한 부분의 약관 정보를 텍스트 처리하여 반응형 영상을 생성하고, 영상 통화 수행부(210)는 약관 정보를 포함하는 반응형 영상을 타사용자 단말(120)에게 전송할 수 있다.For example, when the user terminal 110 (eg, the counselor's terminal) needs to explain the terms and conditions while consulting with the other user's terminal 120 (eg, the customer's terminal), the

분석부(240)를 통해 타사용자 단말(120)의 통화 상황 정보로부터 타사용자 단말(120)이 약관 정보를 이해하지 못한 부분이 있다고 판단되면, 영상 생성부(230)는 타사용자 단말(120)이 이해하지 못한 부분에 대한 추가 보완 영상을 포함하는 다른 반응형 영상을 생성하고, 영상 통화 수행부(210)는 다른 반응형 영상을 타사용자 단말(120)에게 전송할 수 있다.When it is determined that there is a part where the

만일, 타사용자 단말(120)의 타사용자가 운전 중에 있어 다른 반응형 영상을 수신하기 곤란한 상황인 경우, 영상 통화 수행부(210)는 타사용자 단말(120)의 위치 정보에 기초하여 다른 반응형 영상 대신에 사용자 단말(110)의 실사 영상으로 전환하여 사용자 단말(110)의 실사 영상을 타사용자 단말(120)에게 제공할 수 있다.If it is difficult to receive another responsive image while the other user of the

한편, 당업자라면, 모델 학습부(200), 영상 통화 수행부(210), 수신부(220), 영상 생성부(230) 및 분석부(240) 각각이 분리되어 구현되거나, 이 중 하나 이상이 통합되어 구현될 수 있음을 충분히 이해할 것이다.Meanwhile, for those skilled in the art, each of the

도 6은 본 발명의 일 실시예에 따른, 영상 통화 서비스를 제공하는 방법을 나타낸 흐름도이다.6 is a flowchart illustrating a method of providing a video call service according to an embodiment of the present invention.

도 6을 참조하면, 단계 S601에서 영상 통화 서비스 제공 서버(100)는 사용자 단말(110)로부터 수신된 복수의 학습 데이터에 기초하여 영상 생성 모델을 학습할 수 있다.Referring to FIG. 6 , in step S601 , the video call

단계 S603에서 영상 통화 서비스 제공 서버(100)는 사용자 단말(110) 및 타사용자 단말(120) 간의 영상 통화 서비스를 수행할 수 있다.In step S603 , the video call

단계 S605에서 영상 통화 서비스 제공 서버(100)는 영상 통화 서비스가 수행되는 중에 사용자 단말(110)로부터 영상 생성 요청 메시지를 수신할 수 있다.In step S605 , the video call

단계 S607에서 영상 통화 서비스 제공 서버(100)는 사용자 단말(110)로부터 영상 수신된 영상 생성 요청 메시지에 기초하여 영상 생성 모델을 통해 사용자 단말(110)의 사용자가 등장하는 대체 영상을 생성할 수 있다.In step S607 , the video call

단계 S609에서 영상 통화 서비스 제공 서버(100)는 영상 통화 서비스를 통해 제공되는 사용자 단말(110)에 의해 촬영된 실사 영상 대신 생성된 대체 영상을 타사용자 단말(120)에게 전송할 수 있다.In step S609 , the video call

상술한 설명에서, 단계 S601 내지 S609는 본 발명의 구현예에 따라서, 추가적인 단계들로 더 분할되거나, 더 적은 단계들로 조합될 수 있다. 또한, 일부 단계는 필요에 따라 생략될 수도 있고, 단계 간의 순서가 변경될 수도 있다.In the above description, steps S601 to S609 may be further divided into additional steps or combined into fewer steps, according to an embodiment of the present invention. In addition, some steps may be omitted as necessary, and the order between steps may be changed.

도 7은 본 발명의 일 실시예에 따른, 반응형 영상을 제공하는 방법을 나타낸 흐름도이다.7 is a flowchart illustrating a method of providing a responsive image according to an embodiment of the present invention.

도 7을 참조하면, 단계 S701에서 영상 통화 서비스 제공 서버(100)는 영상 통화 중인 사용자 단말(110) 및 타사용자 단말(120) 간의 통화 상황 정보를 분석할 수 있다. 여기서, 통화 상황 정보는 사용자 단말(110) 및 타사용자 단말(120) 각각에 대한 위치 정보, 음성 피치 정보, 행동 정보 및 얼굴 표정 정보 중 적어도 하나를 포함할 수 있다.Referring to FIG. 7 , in step S701 , the video call

단계 S703에서 영상 통화 서비스 제공 서버(100)는 분석된 통화 상황 정보에 기초하여 반응형 영상을 생성할 수 있다.In step S703, the video call

단계 S705에서 영상 통화 서비스 제공 서버(100)는 영상 통화 서비스를 통해 제공되는 사용자 단말(110)의 사용자가 등장하는 대체 영상을 반응형 영상으로 변경하여 타사용자 단말(120)에게 전송할 수 있다.In step S705 , the video call

단계 S707에서 영상 통화 서비스 제공 서버(100)는 반응형 영상을 수신한 타사용자 단말(120)의 반응 정보를 분석할 수 있다.In step S707 , the video call

단계 S709에서 영상 통화 서비스 제공 서버(100)는 타사용자 단말(120)의 반응 정보에 기초하여 다른 반응형 영상을 생성할 수 있다.In step S709 , the video call

단계 S711에서 영상 통화 서비스 제공 서버(100)는 반응형 영상을 다른 반응형 영상으로 변경하여 타사용자 단말(120)에게 전송할 수 있다.In step S711 , the video call

상술한 설명에서, 단계 S701 내지 S711은 본 발명의 구현예에 따라서, 추가적인 단계들로 더 분할되거나, 더 적은 단계들로 조합될 수 있다. 또한, 일부 단계는 필요에 따라 생략될 수도 있고, 단계 간의 순서가 변경될 수도 있다.In the above description, steps S701 to S711 may be further divided into additional steps or combined into fewer steps, according to an embodiment of the present invention. In addition, some steps may be omitted as necessary, and the order between steps may be changed.

본 발명의 일 실시예는 컴퓨터에 의해 실행되는 프로그램 모듈과 같은 컴퓨터에 의해 실행 가능한 명령어를 포함하는 기록 매체의 형태로도 구현될 수 있다. 컴퓨터 판독 가능 매체는 컴퓨터에 의해 액세스될 수 있는 임의의 가용 매체일 수 있고, 휘발성 및 비휘발성 매체, 분리형 및 비분리형 매체를 모두 포함한다. 또한, 컴퓨터 판독가능 매체는 컴퓨터 저장 매체를 모두 포함할 수 있다. 컴퓨터 저장 매체는 컴퓨터 판독가능 명령어, 데이터 구조, 프로그램 모듈 또는 기타 데이터와 같은 정보의 저장을 위한 임의의 방법 또는 기술로 구현된 휘발성 및 비휘발성, 분리형 및 비분리형 매체를 모두 포함한다.An embodiment of the present invention may also be implemented in the form of a recording medium including instructions executable by a computer, such as a program module executed by a computer. Computer-readable media can be any available media that can be accessed by a computer and includes both volatile and nonvolatile media, removable and non-removable media. Also, computer-readable media may include all computer storage media. Computer storage media includes both volatile and nonvolatile, removable and non-removable media implemented in any method or technology for storage of information such as computer readable instructions, data structures, program modules or other data.

전술한 본 발명의 설명은 예시를 위한 것이며, 본 발명이 속하는 기술분야의 통상의 지식을 가진 자는 본 발명의 기술적 사상이나 필수적인 특징을 변경하지 않고서 다른 구체적인 형태로 쉽게 변형이 가능하다는 것을 이해할 수 있을 것이다. 그러므로 이상에서 기술한 실시예들은 모든 면에서 예시적인 것이며 한정적이 아닌 것으로 이해해야만 한다. 예를 들어, 단일형으로 설명되어 있는 각 구성 요소는 분산되어 실시될 수도 있으며, 마찬가지로 분산된 것으로 설명되어 있는 구성 요소들도 결합된 형태로 실시될 수 있다.The above description of the present invention is for illustration, and those of ordinary skill in the art to which the present invention pertains can understand that it can be easily modified into other specific forms without changing the technical spirit or essential features of the present invention. will be. Therefore, it should be understood that the embodiments described above are illustrative in all respects and not restrictive. For example, each component described as a single type may be implemented in a dispersed form, and likewise components described as distributed may be implemented in a combined form.

본 발명의 범위는 상세한 설명보다는 후술하는 특허청구범위에 의하여 나타내어지며, 특허청구범위의 의미 및 범위 그리고 그 균등 개념으로부터 도출되는 모든 변경 또는 변형된 형태가 본 발명의 범위에 포함되는 것으로 해석되어야 한다.The scope of the present invention is indicated by the following claims rather than the detailed description, and all changes or modifications derived from the meaning and scope of the claims and their equivalent concepts should be construed as being included in the scope of the present invention. .

100: 영상 통화 서비스 제공 서버

110: 사용자 단말

120: 타사용자 단말

200: 모델 학습부

210: 영상 통화 수행부

220: 수신부

230: 영상 생성부

240: 분석부100: video call service providing server

110: user terminal

120: other user terminal

200: model learning unit

210: video call performing unit

220: receiver

230: image generating unit

240: analysis unit

Claims (19)

Translated fromKorean사용자 단말로부터 수신된 복수의 학습 데이터에 기초하여 영상 생성 모델을 학습하는 모델 학습부;

상기 사용자 단말 및 타사용자 단말 간의 영상 통화 서비스를 수행하는 영상 통화 수행부;

상기 영상 통화 서비스가 수행되는 중에 상기 사용자 단말로부터 영상 생성 요청 메시지를 수신하는 수신부; 및

상기 영상 생성 요청 메시지에 기초하여 상기 영상 생성 모델을 통해 상기 사용자 단말의 사용자가 등장하는 대체 영상을 생성하는 영상 생성부를 포함하고,

상기 영상 통화 수행부는 상기 영상 통화 서비스를 통해 제공되는 상기 사용자 단말에 의해 촬영된 실사 영상 대신 상기 생성된 대체 영상을 상기 타사용자 단말에게 전송하는 것인, 영상 통화 서비스 제공 서버.

In the server providing a video call service,

a model learning unit for learning an image generation model based on a plurality of training data received from the user terminal;

a video call performing unit for performing a video call service between the user terminal and another user terminal;

a receiver configured to receive an image creation request message from the user terminal while the video call service is being performed; and

and an image generator for generating an alternative image in which the user of the user terminal appears through the image generation model based on the image creation request message,

The video call performing unit will transmit the generated replacement image to the other user terminal instead of the actual image taken by the user terminal provided through the video call service, the video call service providing server.

상기 복수의 학습 데이터는 이미지 데이터를 포함하고,

상기 이미지 데이터는 인물 정보 및 위치 정보 중 적어도 어느 하나에 기초하여 상기 사용자 단말에 의해 분류되고,

상기 모델 학습부는 상기 분류된 이미지 데이터에 기초하여 상기 영상 생성 모델을 학습하는 것인, 영상 통화 서비스 제공 서버.

The method of claim 1,

The plurality of learning data includes image data,

The image data is classified by the user terminal based on at least one of person information and location information,

The model learning unit will learn the image generation model based on the classified image data, a video call service providing server.

상기 복수의 학습 데이터는 영상 데이터를 포함하고,

상기 모델 학습부는 인물 정보에 따라 상기 영상 데이터에 포함된 복수의 영상 프레임을 분리하고, 상기 인물 정보 별로 분리된 영상 프레임에 기초하여 상기 영상 생성 모델을 학습하는 것인, 영상 통화 서비스 제공 서버.

The method of claim 1,

The plurality of learning data includes image data,

The model learning unit separates a plurality of image frames included in the image data according to the person information, and learns the image generation model based on the separated image frames for each person information, a video call service providing server.

상기 영상 생성 요청 메시지는 대체 영상 요청 및 사용자 데이터를 포함하고,

상기 사용자 데이터는 상기 사용자의 음성 데이터 또는 텍스트 데이터를 포함하고,

상기 영상 생성부는 상기 사용자 단말로부터 배경 정보를 수신한 경우, 상기 배경 정보에 해당하는 배경 영상 및 상기 사용자의 이미지 데이터를 합성하여 상기 대체 영상을 생성하는 것인, 영상 통화 서비스 제공 서버.

The method of claim 1,

The image creation request message includes an alternative image request and user data,

The user data includes voice data or text data of the user,

When the background information is received from the user terminal, the image generator generates the replacement image by synthesizing the background image corresponding to the background information and the user's image data.

상기 영상 생성부는 상기 영상 생성 요청 메시지가 수신된 시간 정보 및 상기 시간 정보에 대응하는 상기 사용자 단말의 위치 정보에 기초하여 상기 대체 영상을 생성하는 것인, 영상 통화 서비스 제공 서버.

The method of claim 1,

The image generating unit will generate the replacement image based on the time information at which the image creation request message is received and the location information of the user terminal corresponding to the time information, the video call service providing server.

상기 사용자 단말 및 상기 타사용자 단말 간의 통화 상황 정보를 분석하는 분석부를 더 포함하고,

상기 통화 상황 정보는 상기 사용자 단말 및 상기 타사용자 단말 각각에 대한 위치 정보, 음성 피치 정보, 행동 정보 및 얼굴 표정 정보 중 적어도 하나를 포함하는 것인, 영상 통화 서비스 제공 서버.

The method of claim 1,

Further comprising an analysis unit for analyzing the call situation information between the user terminal and the other user terminal,

The call situation information includes at least one of location information, voice pitch information, behavior information, and facial expression information for each of the user terminal and the other user terminal, a video call service providing server.

상기 영상 생성부는 상기 분석된 통화 상황 정보에 기초하여 반응형 영상을 생성하고,

상기 영상 통화 수행부는 상기 대체 영상을 상기 반응형 영상으로 변경하여 상기 타사용자 단말에게 전송하는 것인, 영상 통화 서비스 제공 서버.

7. The method of claim 6,

The image generator generates a responsive image based on the analyzed call situation information,

The video call performing unit changes the replacement image to the responsive image and transmits it to the other user terminal, the video call service providing server.

상기 분석부는 상기 반응형 영상을 수신한 상기 타사용자 단말의 반응 정보를 분석하는 것인, 영상 통화 서비스 제공 서버.

8. The method of claim 7,

The analyzing unit is to analyze the reaction information of the other user terminal that has received the responsive video, a video call service providing server.

상기 영상 생성부는 상기 타사용자 단말의 반응 정보에 기초하여 다른 반응형 영상을 생성하고,

상기 영상 통화 수행부는 상기 반응형 영상을 상기 다른 반응형 영상으로 변경하여 상기 타사용자 단말에게 전송하는 것인, 영상 통화 서비스 제공 서버.

9. The method of claim 8,

The image generating unit generates another responsive image based on the reaction information of the other user terminal,

The video call performing unit changes the responsive image to the other responsive image and transmits it to the other user terminal, the video call service providing server.

사용자 단말로부터 수신된 복수의 학습 데이터에 기초하여 영상 생성 모델을 학습하는 단계;

상기 사용자 단말 및 타사용자 단말 간의 영상 통화 서비스를 수행하는 단계;

상기 영상 통화 서비스가 수행되는 중에 상기 사용자 단말로부터 영상 생성 요청 메시지를 수신하는 단계; 및

상기 영상 생성 요청 메시지에 기초하여 상기 영상 생성 모델을 통해 상기 사용자 단말의 사용자가 등장하는 대체 영상을 생성하는 단계를 포함하고.

상기 영상 통화 서비스를 수행하는 단계는,

상기 영상 통화 서비스를 통해 제공되는 상기 사용자 단말에 의해 촬영된 실사 영상 대신 상기 생성된 대체 영상을 상기 타사용자 단말에게 전송하는 단계를 포함하는 영상 통화 서비스 제공 방법.

In the method of providing a video call service,

learning an image generation model based on a plurality of training data received from a user terminal;

performing a video call service between the user terminal and another user terminal;

receiving an image creation request message from the user terminal while the video call service is being performed; and

and generating an alternative image in which a user of the user terminal appears through the image generation model based on the image creation request message.

The step of performing the video call service,

and transmitting the generated replacement image to the other user terminal instead of the actual image taken by the user terminal provided through the video call service.

상기 복수의 학습 데이터는 이미지 데이터를 포함하고,

상기 이미지 데이터는 인물 정보 및 위치 정보 중 적어도 어느 하나에 기초하여 상기 사용자 단말에 의해 분류되고,

상기 영상 생성 모델을 학습하는 단계는

상기 분류된 이미지 데이터에 기초하여 상기 영상 생성 모델을 학습하는 단계를 포함하는 것인, 영상 통화 서비스 제공 방법.

11. The method of claim 10,

The plurality of learning data includes image data,

The image data is classified by the user terminal based on at least one of person information and location information,

The step of learning the image generation model is

The method of providing a video call service comprising the step of learning the image generation model based on the classified image data.

상기 복수의 학습 데이터는 영상 데이터를 포함하고,

상기 영상 생성 모델을 학습하는 단계는

인물 정보에 따라 상기 영상 데이터에 포함된 복수의 영상 프레임을 분리하고, 상기 인물 정보 별로 분리된 영상 프레임에 기초하여 상기 영상 생성 모델을 학습하는 단계를 포함하는 것인, 영상 통화 서비스 제공 방법.

11. The method of claim 10,

The plurality of learning data includes image data,

The step of learning the image generation model is

Separating a plurality of image frames included in the image data according to the person information, and learning the image generation model based on the image frames separated for each person information, the method of providing a video call service.

상기 영상 생성 요청 메시지는 대체 영상 요청 및 사용자 데이터를 포함하고,

상기 사용자 데이터는 상기 사용자의 음성 데이터 또는 텍스트 데이터를 포함하고,

상기 대체 영상을 생성하는 단계는

상기 사용자 단말로부터 배경 정보를 수신한 경우, 상기 배경 정보에 해당하는 배경 영상 및 상기 사용자의 이미지 데이터를 합성하여 상기 대체 영상을 생성하는 단계를 포함하는 것인, 영상 통화 서비스 제공 방법.

11. The method of claim 10,

The image creation request message includes an alternative image request and user data,

The user data includes voice data or text data of the user,

The step of generating the replacement image is

When the background information is received from the user terminal, the method comprising the step of generating the replacement image by synthesizing a background image corresponding to the background information and the user's image data.

상기 대체 영상을 생성하는 단계는

상기 영상 생성 요청 메시지가 수신된 시간 정보 및 상기 시간 정보에 대응하는 상기 사용자 단말의 위치 정보에 기초하여 상기 대체 영상을 생성하는 단계를 포함하는 것인, 영상 통화 서비스 제공 방법.

11. The method of claim 10,

The step of generating the replacement image is

and generating the replacement image based on time information at which the image creation request message is received and location information of the user terminal corresponding to the time information.

상기 사용자 단말 및 상기 타사용자 단말 간의 통화 상황 정보를 분석하는 단계를 더 포함하고,

상기 통화 상황 정보는 상기 사용자 단말 및 상기 타사용자 단말 각각에 대한 위치 정보, 음성 피치 정보, 행동 정보 및 얼굴 표정 정보 중 적어도 하나를 포함하는 것인, 영상 통화 서비스 제공 방법.

11. The method of claim 10,

Further comprising the step of analyzing the call situation information between the user terminal and the other user terminal,

The call situation information includes at least one of location information, voice pitch information, behavior information, and facial expression information for each of the user terminal and the other user terminal, the method for providing a video call service.

상기 분석된 통화 상황 정보에 기초하여 반응형 영상을 생성하는 단계를 더 포함하고,

상기 영상 통화 서비스를 수행하는 단계는,

상기 대체 영상을 상기 반응형 영상으로 변경하여 상기 타사용자 단말에게 전송하는 단계를 더 포함하는 것인, 영상 통화 서비스 제공 방법.

16. The method of claim 15,

Further comprising the step of generating a responsive image based on the analyzed call situation information,

The step of performing the video call service,

The method of providing a video call service, further comprising the step of changing the replacement image to the responsive image and transmitting it to the other user terminal.

상기 분석하는 단계는

상기 반응형 영상을 수신한 상기 타사용자 단말의 반응 정보를 분석하는 단계를 포함하는 것인, 영상 통화 서비스 제공 방법.

17. The method of claim 16,

The analysis step is

The method of providing a video call service comprising the step of analyzing the reaction information of the other user terminal that has received the responsive image.

상기 타사용자 단말의 반응 정보에 기초하여 다른 반응형 영상을 생성하는 단계를 더 포함하고,

상기 영상 통화 서비스를 수행하는 단계는,

상기 반응형 영상을 상기 다른 반응형 영상으로 변경하여 상기 타사용자 단말에게 전송하는 단계를 더 포함하는 것인, 영상 통화 서비스 제공 방법.

18. The method of claim 17,

Further comprising the step of generating another responsive image based on the reaction information of the other user terminal,

The step of performing the video call service,

Changing the responsive image to the other responsive image and transmitting it to the other user terminal, the method for providing a video call service.

상기 컴퓨터 프로그램은 컴퓨팅 장치에 의해 실행될 경우,

사용자 단말로부터 수신된 복수의 학습 데이터에 기초하여 영상 생성 모델을 학습하고,

상기 사용자 단말 및 타사용자 단말 간의 영상 통화 서비스를 수행하고,

상기 영상 통화 서비스가 수행되는 중에 상기 사용자 단말로부터 영상 생성 요청 메시지를 수신하고,

상기 영상 생성 요청 메시지에 기초하여 상기 영상 생성 모델을 통해 상기 사용자 단말의 사용자가 등장하는 대체 영상을 생성하고,

상기 영상 통화 서비스를 통해 제공되는 상기 사용자 단말에 의해 촬영된 실사 영상 대신 상기 생성된 대체 영상을 상기 타사용자 단말에게 전송하는 명령어들의 시퀀스를 포함하는, 매체에 저장된 컴퓨터 프로그램.A computer program stored in a medium comprising a sequence of instructions for providing a video call service,

When the computer program is executed by a computing device,

Learning an image generation model based on a plurality of training data received from the user terminal,

performing a video call service between the user terminal and another user terminal;

receiving an image creation request message from the user terminal while the video call service is being performed,

generating an alternative image in which a user of the user terminal appears through the image generation model based on the image creation request message;

A computer program stored in a medium, comprising a sequence of instructions for transmitting the generated replacement image to the other user terminal instead of the actual image taken by the user terminal provided through the video call service.

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020200037778AKR102780186B1 (en) | 2020-03-27 | 2020-03-27 | Server, method and computer program for providing video call service |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020200037778AKR102780186B1 (en) | 2020-03-27 | 2020-03-27 | Server, method and computer program for providing video call service |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| KR20210120712Atrue KR20210120712A (en) | 2021-10-07 |

| KR102780186B1 KR102780186B1 (en) | 2025-03-12 |

Family

ID=78114971

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020200037778AActiveKR102780186B1 (en) | 2020-03-27 | 2020-03-27 | Server, method and computer program for providing video call service |

Country Status (1)

| Country | Link |

|---|---|

| KR (1) | KR102780186B1 (en) |

Citations (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR100928916B1 (en) | 2008-08-18 | 2009-11-30 | (주)티아이스퀘어 | Method and apparatus for providing video call service to video terminal during call between video terminal and audio terminal |

| KR20130022434A (en)* | 2011-08-22 | 2013-03-07 | (주)아이디피쉬 | Apparatus and method for emotion content service of communication terminal device, apparatus and method for emotion recognition therefor, apparatus and method for generating and matching emotion content using same |

| KR20190032473A (en)* | 2016-09-22 | 2019-03-27 | 애플 인크. | Display system with world and user sensors |

| KR102037997B1 (en)* | 2019-01-23 | 2019-10-29 | 한국방송공사 | Electronic apparatus and method for generating contents |

| EP3624442A1 (en)* | 2018-09-14 | 2020-03-18 | Lg Electronics Inc. | Robot and method for operating the same |

- 2020

- 2020-03-27KRKR1020200037778Apatent/KR102780186B1/enactiveActive

Patent Citations (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR100928916B1 (en) | 2008-08-18 | 2009-11-30 | (주)티아이스퀘어 | Method and apparatus for providing video call service to video terminal during call between video terminal and audio terminal |

| KR20130022434A (en)* | 2011-08-22 | 2013-03-07 | (주)아이디피쉬 | Apparatus and method for emotion content service of communication terminal device, apparatus and method for emotion recognition therefor, apparatus and method for generating and matching emotion content using same |

| KR20190032473A (en)* | 2016-09-22 | 2019-03-27 | 애플 인크. | Display system with world and user sensors |

| EP3624442A1 (en)* | 2018-09-14 | 2020-03-18 | Lg Electronics Inc. | Robot and method for operating the same |

| KR102037997B1 (en)* | 2019-01-23 | 2019-10-29 | 한국방송공사 | Electronic apparatus and method for generating contents |

Also Published As

| Publication number | Publication date |

|---|---|

| KR102780186B1 (en) | 2025-03-12 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US20210049356A1 (en) | Method for Detecting Key Points in Skeleton, Apparatus, Electronic Device and Storage Medium | |

| KR20210060196A (en) | Server, method and user device for providing avatar message service | |

| JP5466420B2 (en) | Emotion recognition message system, mobile communication terminal and message storage server | |

| US20060167997A1 (en) | System, method and computer program product for establishing a conference session and synchronously rendering content during the same | |

| US20190065498A1 (en) | System and method for rich conversation in artificial intelligence | |

| US20090157223A1 (en) | Robot chatting system and method | |

| EP1580965B1 (en) | Image transmitting device of user equipment and method thereof | |

| KR20200092166A (en) | Server, method and computer program for recognizing emotion | |

| US9110888B2 (en) | Service server apparatus, service providing method, and service providing program for providing a service other than a telephone call during the telephone call on a telephone | |

| KR102097777B1 (en) | Method for judging learning achievement method based on user's handwritten data, smart device, server and system for the same | |

| CN105764119A (en) | Method for network connection of motion camera through scanning two-dimensional code | |

| US20180139158A1 (en) | System and method for multipurpose and multiformat instant messaging | |

| CN111382748A (en) | Image translation method, device and storage medium | |

| CN108039173A (en) | Voice messaging input method, mobile terminal, system and readable storage medium storing program for executing | |

| CN107580242A (en) | Video method for real-time transmitting, television equipment and storage medium based on television equipment | |

| KR102780186B1 (en) | Server, method and computer program for providing video call service | |

| US9277051B2 (en) | Service server apparatus, service providing method, and service providing program | |

| KR102058190B1 (en) | Apparatus for providing character service in character service system | |

| KR102803468B1 (en) | Common device, method and computer program for providing service based on voice command | |

| CN106909533A (en) | Suitable for multi-platform examination editing system | |

| Kernchen et al. | Multimodal user interfaces for context-aware mobile applications | |

| KR101677622B1 (en) | Image display method and apparatus thereof | |

| KR20210010594A (en) | Method for managing contents using speaker recognition, computer-readable medium and computing device | |

| KR102356404B1 (en) | Media playing device, user device and server for providing call service | |

| KR101189052B1 (en) | System and method for delivering feeling during video call |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| PA0109 | Patent application | St.27 status event code:A-0-1-A10-A12-nap-PA0109 | |

| PG1501 | Laying open of application | St.27 status event code:A-1-1-Q10-Q12-nap-PG1501 | |

| R18-X000 | Changes to party contact information recorded | St.27 status event code:A-3-3-R10-R18-oth-X000 | |

| A201 | Request for examination | ||

| PA0201 | Request for examination | St.27 status event code:A-1-2-D10-D11-exm-PA0201 | |

| D13-X000 | Search requested | St.27 status event code:A-1-2-D10-D13-srh-X000 | |

| D14-X000 | Search report completed | St.27 status event code:A-1-2-D10-D14-srh-X000 | |

| E902 | Notification of reason for refusal | ||

| PE0902 | Notice of grounds for rejection | St.27 status event code:A-1-2-D10-D21-exm-PE0902 | |

| P11-X000 | Amendment of application requested | St.27 status event code:A-2-2-P10-P11-nap-X000 | |

| P13-X000 | Application amended | St.27 status event code:A-2-2-P10-P13-nap-X000 | |

| E701 | Decision to grant or registration of patent right | ||

| PE0701 | Decision of registration | St.27 status event code:A-1-2-D10-D22-exm-PE0701 | |

| PR0701 | Registration of establishment | St.27 status event code:A-2-4-F10-F11-exm-PR0701 | |

| PR1002 | Payment of registration fee | St.27 status event code:A-2-2-U10-U11-oth-PR1002 Fee payment year number:1 | |

| PG1601 | Publication of registration | St.27 status event code:A-4-4-Q10-Q13-nap-PG1601 | |

| R18-X000 | Changes to party contact information recorded | St.27 status event code:A-5-5-R10-R18-oth-X000 |