KR20170121719A - Method and device for providing user interface in the virtual reality space and recordimg medium thereof - Google Patents

Method and device for providing user interface in the virtual reality space and recordimg medium thereofDownload PDFInfo

- Publication number

- KR20170121719A KR20170121719AKR1020170053230AKR20170053230AKR20170121719AKR 20170121719 AKR20170121719 AKR 20170121719AKR 1020170053230 AKR1020170053230 AKR 1020170053230AKR 20170053230 AKR20170053230 AKR 20170053230AKR 20170121719 AKR20170121719 AKR 20170121719A

- Authority

- KR

- South Korea

- Prior art keywords

- space

- user

- information

- advertisement

- search

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Ceased

Links

Images

Classifications

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/011—Arrangements for interaction with the human body, e.g. for user immersion in virtual reality

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/017—Gesture based interaction, e.g. based on a set of recognized hand gestures

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0481—Interaction techniques based on graphical user interfaces [GUI] based on specific properties of the displayed interaction object or a metaphor-based environment, e.g. interaction with desktop elements like windows or icons, or assisted by a cursor's changing behaviour or appearance

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0481—Interaction techniques based on graphical user interfaces [GUI] based on specific properties of the displayed interaction object or a metaphor-based environment, e.g. interaction with desktop elements like windows or icons, or assisted by a cursor's changing behaviour or appearance

- G06F3/04815—Interaction with a metaphor-based environment or interaction object displayed as three-dimensional, e.g. changing the user viewpoint with respect to the environment or object

Landscapes

- Engineering & Computer Science (AREA)

- General Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- Human Computer Interaction (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- User Interface Of Digital Computer (AREA)

- Management, Administration, Business Operations System, And Electronic Commerce (AREA)

Abstract

Translated fromKoreanDescription

Translated fromKorean개시된 실시예는 VR 공간에서 사용자 인터페이스를 제공하는 방법, VR 공간에서 사용자 인터페이스를 제공하는 디바이스 및 VR 공간에서 사용자 인터페이스를 제공하는 방법을 수행하는 프로그램이 기록된 기록매체에 관한 것이다.The disclosed embodiments relate to a method for providing a user interface in a VR space, a device for providing a user interface in the VR space, and a recording medium on which a program for performing a method for providing a user interface in the VR space is recorded.

최근 들어 사용자에게 가상 현실(Virtual Reality, 이하 VR)를 체험할 수 있도록 영상을 제공하는 다양한 기술들이 개발되고 있다. 이러한 가상 현실 체험 기술들은 예를 들어, 사용자의 시야에 따라 출력되는 영상을 렌즈를 통해 왜곡시킴으로써, 사용자가 가상 현실을 체험할 수 있도록 하는 HMD(Head Mount Display) 등의 디바이스를 통해 실현될 수 있다.In recent years, various technologies have been developed to provide images for users to experience virtual reality (VR). Such virtual reality experience techniques can be realized through a device such as an HMD (Head Mount Display) that allows a user to experience a virtual reality by distorting an image output through a lens according to a user's visual field .

한편, 가상 현실을 체험할 수 있도록 하는 디바이스가 개발됨에 따라, 가상 현실 세계에서 사용자에게 제공할 수 있는 서비스에 대한 관심 또한 증가하고 있는 추세이다. 현재 게임과 같이 VR 환경에서 제공될 수 있는 서비스에 대한 개발이 활발하게 이루어지고 있으나, 아직까지 검색 서비스, 광고 제공 서비스와 같은 다양한 서비스에 대한 VR 환경에서의 서비스 제공 방법에 대해서는 개발이 필요한 실정이다.On the other hand, with the development of devices capable of experiencing virtual reality, interest in services that can be provided to users in the virtual reality world is increasing. However, there is a need to develop a service providing method in a VR environment for a variety of services such as a search service and an advertisement providing service .

VR 공간의 특성을 고려하여, 사용자가 정보를 검색할 수 있는 검색 플랫폼 및 검색 중간에 광고를 제공하는 사용자 인터페이스를 제공하는 방법, 디바이스 및 기록매체가 제공된다.There is provided a method, device, and recording medium for providing a search platform in which a user can search for information and a user interface for providing an advertisement in the middle of search in consideration of the characteristics of VR space.

일 실시예에 따른 디바이스가 VR 공간 상에 UI를 제공하는 방법은, 사용자의 입력이 획득됨에 따라, VR 공간 상에 검색창을 표시하는 단계; 표시된 검색창을 통해 객체에 대한 검색 요청이 수신됨에 따라, 객체에 관한 정보를 검색하는 단계; 객체에 관한 정보를 검색하는 동안, VR 공간 상에 적어도 하나의 광고를 표시하는 단계; 및 검색이 완료됨에 따라, 적어도 하나의 광고의 표시를 중단하고, 검색된 객체에 관한 정보를 VR 공간 상에 표시하는 단계를 포함한다.A method according to an embodiment for providing a UI on a VR space comprises: displaying a search window on the VR space as the user's input is acquired; Retrieving information about the object as the search request for the object is received through the displayed search window; Displaying at least one advertisement on the VR space while searching for information about the object; And stopping display of at least one advertisement as the search is completed, and displaying information on the retrieved object on the VR space.

일 실시예에 따른 디바이스가 VR 공간 상에 UI를 제공하는 방법은, 사용자의 프로파일 및 이전에 검색 요청된 적어도 하나의 객체에 관한 히스토리 정보에 기초하여, 복수의 광고들 중 적어도 하나의 광고를 선택하는 단계를 더 포함한다.A method of providing a UI on a VR space according to an embodiment includes selecting at least one of a plurality of advertisements based on a user's profile and historical information about at least one object previously requested to be searched .

일 실시예에 따른 디바이스가 VR 공간 상에 UI를 제공하는 방법에 있어서, 표시하는 단계는, 적어도 하나의 광고를 구성하는 이미지를 기 설정된 방향으로 이동시키는 단계를 포함하고, 이미지의 이동 속도는, 객체에 대한 검색의 종료 시간이 가까워질수록 빨라진다.In a method of providing a UI on a VR space according to an embodiment, the step of displaying comprises moving an image constituting at least one advertisement in a predetermined direction, The closer the end time of the search to the object, the faster.

일 실시예에 따른 디바이스가 VR 공간 상에 UI를 제공하는 방법은, 객체에 관한 정보 검색 중, 사용자로부터 표시된 적어도 하나의 광고를 선택하는 선택 입력이 수신되는 경우, 선택된 광고의 제품에 관한 정보를 VR 공간 상에 표시하는 단계를 더 포함한다.A method of providing a UI on a VR space in accordance with an embodiment includes the steps of retrieving information about a product of a selected advertisement when a selection input for selecting at least one advertisement displayed from the user is received, And displaying on the VR space.

일 실시예에 따른 디바이스가 VR 공간 상에 UI를 제공하는 방법에 있어서, 표시하는 단계는, 객체에 대한 검색이 완료된 경우, 검색 결과와 선택된 광고의 제품에 관한 정보를 함께 상기 VR 공간 상에 표시한다.A method of providing a UI on a VR space in a device according to an exemplary embodiment of the present invention includes displaying the search result and information about a product of the selected advertisement on the VR space when the search for the object is completed do.

일 실시예에 따른 디바이스가 VR 공간 상에 UI를 제공하는 방법에 있어서, 사용자 입력은, 사용자의 제스쳐를 포함하고, 검색창은, 사용자의 제스쳐에 따라, 검색창의 크기, 위치 및 형태가 결정된다.In a method of providing a UI on a VR space according to an embodiment, a user input includes a gesture of a user, and a search window determines a size, a position, and a shape of the search window according to a gesture of the user .

일 실시예에 따른 VR 공간에서 UI(user interface)를 제공하는 디바이스는, 사용자의 입력을 획득하는 센싱부; 사용자의 입력이 획득됨에 따라, VR 공간 상에 검색창을 표시하는 출력부; 및 표시된 검색창을 통해 객체에 대한 검색 요청이 수신됨에 따라, 객체에 관한 정보를 검색하고, 객체에 관한 정보를 검색하는 동안, VR 공간 상에 적어도 하나의 광고를 표시하며, 검색이 완료됨에 따라 적어도 하나의 광고의 표시를 중단하는 프로세서를 포함하고, 출력부는, 검색된 객체에 관한 정보를 VR 공간 상에 표시한다.A device for providing a user interface (UI) in a VR space according to an exemplary embodiment includes a sensing unit for acquiring a user's input; An output unit displaying a search window on the VR space as the input of the user is acquired; And displaying at least one advertisement on the VR space while searching for information about the object as the search request for the object is received through the displayed search window and searching for information about the object, And a processor for stopping display of at least one advertisement, and the output unit displays information on the retrieved object on the VR space.

일 실시예에 따른 VR 공간에서 UI를 제공하는 디바이스에 있어서, 프로세서는, 사용자의 프로파일 및 이전에 검색 요청된 적어도 하나의 객체에 관한 히스토리 정보에 기초하여, 복수의 광고들 중 적어도 하나의 광고를 선택한다.In a device that provides a UI in a VR space according to an embodiment, the processor is configured to generate at least one of a plurality of advertisements based on the user's profile and the history information about the at least one object previously requested to be searched Select.

일 실시예에 따른 VR 공간에서 UI를 제공하는 디바이스에 있어서, 프로세서는, 적어도 하나의 광고를 구성하는 이미지를 기 설정된 방향으로 이동시키고, 이미지의 이동 속도는, 객체에 대한 검색의 종료 시간이 가까워질수록 빨라진다.In a device for providing a UI in a VR space according to an embodiment, the processor moves an image constituting at least one advertisement in a predetermined direction, and the moving speed of the image is set so that the end time of the search for the object is close The faster the quality, the faster.

일 실시예에 따른 VR 공간에서 UI를 제공하는 디바이스에 있어서, 출력부는, 객체에 관한 정보 검색 중 사용자로부터 표시된 적어도 하나의 광고를 선택하는 선택 입력이 수신되는 경우, 선택된 광고의 제품에 관한 정보를 VR 공간 상에 표시한다.In a device for providing a UI in a VR space according to an exemplary embodiment, when the selection input for selecting at least one advertisement displayed from the user is retrieved during retrieval of information about the object, And displays it on the VR space.

일 실시예에 따른 VR 공간에서 UI를 제공하는 디바이스에 있어서, 출력부는, 객체에 대한 검색이 완료된 경우, 검색 결과와 선택된 광고의 제품에 관한 정보를 함께 VR 공간 상에 표시한다.In a device providing a UI in a VR space according to an exemplary embodiment, when the search for an object is completed, the output unit displays information about the search result and the product of the selected advertisement together on the VR space.

일 실시예에 따른 VR 공간에서 UI를 제공하는 디바이스에 있어서, 사용자 입력은, 사용자의 제스쳐를 포함하고, 검색창은, 사용자의 제스쳐에 따라 검색창의 크기, 위치 및 형태가 결정된다.In a device providing a UI in a VR space according to an embodiment, a user input includes a gesture of a user, and a search window determines a size, a position, and a shape of a search window according to a gesture of the user.

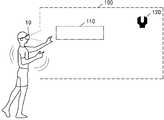

도 1은 일 실시예에 따른 디바이스가 VR 공간에서 UI(user interface)를 제공하는 방법을 설명하기 위한 도면이다.

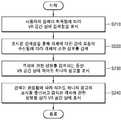

도 2는 일 실시예에 따른 디바이스가 VR 공간에서 UI를 제공하는 방법을 설명하기 위한 흐름도이다.

도 3은 일 실시예에 따른 디바이스가 사용자의 입력을 획득하여 VR 공간 상에 검색창을 표시하는 방법을 설명하기 위한 도면이다.

도 4는 일 실시예에 따른 디바이스가 제공하는 VR 공간에서의 UI를 보다 구체적으로 설명하기 위한 도면이다.

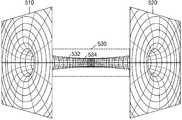

도 5는 일 실시예에 따른 디바이스가 메쉬 형태로 VR 공간을 분할하여, 광고를 제공하는 방법을 설명하기 위한 도면이다.

도 6은 일 실시예에 따른 디바이스가 광고를 제공하는 제 3 가상 공간을 설명하기 위한 도면이다.

도 7은 일 실시예에 따른 디바이스가 VR 공간 상의 UI에 광고 및 검색 결과를 표시하는 방법을 설명하기 위한 흐름도이다.

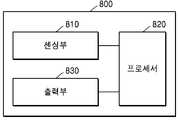

도 8 및 9는 일 실시예에 따라 영상을 처리하는 디바이스의 블록도이다.1 is a diagram illustrating a method of providing a UI (user interface) in a VR space according to an embodiment of the present invention.

2 is a flowchart illustrating a method of providing a UI in a VR space according to an exemplary embodiment of the present invention.

3 is a diagram illustrating a method of acquiring a user's input and displaying a search window on a VR space according to an embodiment of the present invention.

4 is a diagram for more specifically explaining a UI in a VR space provided by a device according to an embodiment.

5 is a diagram for explaining a method of providing a advertisement by dividing a VR space in a mesh form according to an embodiment of the present invention.

6 is a diagram illustrating a third virtual space in which a device according to an embodiment provides an advertisement.

7 is a flowchart illustrating a method of displaying a search result in a UI on a VR space by a device according to an embodiment.

8 and 9 are block diagrams of a device for processing an image according to an embodiment.

본 명세서에서 사용되는 용어에 대해 간략히 설명하고, 본 발명에 대해 구체적으로 설명하기로 한다.The terms used in this specification will be briefly described and the present invention will be described in detail.

본 발명에서 사용되는 용어는 본 발명에서의 기능을 고려하면서 가능한 현재 널리 사용되는 일반적인 용어들을 선택하였으나, 이는 당 분야에 종사하는 기술자의 의도 또는 판례, 새로운 기술의 출현 등에 따라 달라질 수 있다. 또한, 특정한 경우는 출원인이 임의로 선정한 용어도 있으며, 이 경우 해당되는 발명의 설명 부분에서 상세히 그 의미를 기재할 것이다. 따라서 본 발명에서 사용되는 용어는 단순한 용어의 명칭이 아닌, 그 용어가 가지는 의미와 본 발명의 전반에 걸친 내용을 토대로 정의되어야 한다.While the present invention has been described in connection with what is presently considered to be the most practical and preferred embodiment, it is to be understood that the invention is not limited to the disclosed embodiments. Also, in certain cases, there may be a term selected arbitrarily by the applicant, in which case the meaning thereof will be described in detail in the description of the corresponding invention. Therefore, the term used in the present invention should be defined based on the meaning of the term, not on the name of a simple term, but on the entire contents of the present invention.

명세서 전체에서 어떤 부분이 어떤 구성요소를 "포함"한다고 할 때, 이는 특별히 반대되는 기재가 없는 한 다른 구성요소를 제외하는 것이 아니라 다른 구성요소를 더 포함할 수 있음을 의미한다. 또한, 명세서에 기재된 "...부", "모듈" 등의 용어는 적어도 하나의 기능이나 동작을 처리하는 단위를 의미하며, 이는 하드웨어 또는 소프트웨어로 구현되거나 하드웨어와 소프트웨어의 결합으로 구현될 수 있다.When an element is referred to as "including" an element throughout the specification, it is to be understood that the element may include other elements, without departing from the spirit or scope of the present invention. Also, the terms "part," " module, "and the like described in the specification mean units for processing at least one function or operation, which may be implemented in hardware or software or a combination of hardware and software .

아래에서는 첨부한 도면을 참고하여 본 발명의 실시예에 대하여 본 발명이 속하는 기술 분야에서 통상의 지식을 가진 자가 용이하게 실시할 수 있도록 상세히 설명한다. 그러나 본 발명은 여러 가지 상이한 형태로 구현될 수 있으며 여기에서 설명하는 실시예에 한정되지 않는다. 그리고 도면에서 본 발명을 명확하게 설명하기 위해서 설명과 관계없는 부분은 생략하였으며, 명세서 전체를 통하여 유사한 부분에 대해서는 유사한 도면 부호를 붙였다.Hereinafter, embodiments of the present invention will be described in detail with reference to the accompanying drawings so that those skilled in the art can easily carry out the present invention. The present invention may, however, be embodied in many different forms and should not be construed as limited to the embodiments set forth herein. In order to clearly illustrate the present invention, parts not related to the description are omitted, and similar parts are denoted by like reference characters throughout the specification.

도 1은 일 실시예에 따른 디바이스(10)가 VR 공간(100)에서 UI(user interface)를 제공하는 방법을 설명하기 위한 도면이다.1 is a diagram for explaining a method of providing a UI (user interface) in the

도 1을 참고하면, 일 실시예에 따른 디바이스(10)는 VR 공간(100)에서 정보를 검색할 수 있는 검색창(110)이 포함된 UI를 제공할 수 있다. 예를 들어, 디바이스(100)는 사용자로부터 검색창(110)의 표시를 요청하는 사용자의 입력이 획득됨에 따라, VR 공간(100) 내의 UI 상에 검색창(110)을 표시할 수 있다.Referring to FIG. 1, a

일 실시예에 따른 디바이스(10)는 사용자가 음성, 터치 및 제스쳐 등을 통해, 소정 객체에 관한 정보를 입력하는 경우, 입력된 정보를 검색창(110)에 표시할 수 있다. 예를 들어, 디바이스(10)는 사용자가 스마트 기기 A에 대한 정보를 요청하는 경우, 검색창(110)에 스마트 기기 A라는 명칭을 표시할 수 있다.The

또한, 디바이스(10)는 검색창(110)에 사용자가 정보를 원하는 객체가 표시됨에 따라, 디바이스(10)에 연결된 웹 서버 등으로부터 객체에 관한 정보를 검색할 수 있다. 디바이스(10)는 객체에 관한 정보를 검색하는 동안, VR 공간(100) 상의 이미지를 변경하여, 사용자가 객체에 관한 정보를 검색하는 중에, UI 상에서 새로운 정보를 획득할 수 있는 환경을 제공한다. 예를 들어, 디바이스(10)는 VR 공간(100) 상에 표시되는 이미지에는 광고가 포함될 수 있다. 여기에서, 광고는 사용자의 나이, 성별, 직업 등의 사용자의 프로파일 정보를 기초로 선택될 수도 있고, 사용자가 이전에 검색한 검색어를 기초로 선택될 수도 있다. 디바이스(10)가 객체에 관한 정보를 검색하는 중에 광고를 제공하는 방법에 대해서는 도 4 내지 도 6을 참고하여 보다 구체적으로 후술하도록 한다.In addition, the

한편, 디바이스(10)는 객체에 관한 정보가 검색되는 동안, 사용자가 다른 공간으로 이동하는 것과 같은 느낌을 받을 수 있도록 VR 공간(100) 에 표시되는 복수의 광고 이미지를 기 설정된 방향으로 이동시킬 수 있다. 또한, 여기에서, 광고 이미지가 이동되는 속도는 객체에 대한 검색의 종료 시간이 가까워질수록 더 빨라지게 설정될 수 있다.Meanwhile, the

또한, 일 실시예에 따른 디바이스(10)는 VR 공간(100) 상에 표시되는 광고 이미지 중 어느 하나를 사용자가 선택하는 경우, 선택된 광고 이미지에 관한 정보를 수신하여 표시할 수 있다. 디바이스(10)는 광고 이미지에 관한 정보가 표시되는 중에도 사용자가 요청한 검색을 계속 진행할 수 있다. 예를 들어, 디바이스(10)의 VR 공간(100) 상에 복수의 광고 이미지들이 기 설정된 방향으로 이동하면서 표시되고 있는 경우, 사용자가 터치한 광고 이미지의 상품에 관한 정보가 VR 공간(100) 상에 표시될 수 있다. 한편, 사용자가 복수의 광고 이미지들 중 어느 하나를 선택하는 방법이 터치 방식에 국한되는 것은 아니다. 다른 예에 따라 사용자는 음성 입력을 통해 복수의 광고 이미지들 중 어느 하나를 선택할 수도 있다.In addition, when the user selects one of the advertisement images displayed on the

디바이스(10)는 사용자가 복수의 광고 이미지들 중 어느 하나를 선택한 경우에는 복수의 광고 이미지들에 대한 표시를 중단하고, 선택된 광고 이미지의 상품에 관한 정보를 VR 공간 상에 표시할 수 있다.The

한편, 디바이스(10)는 검색이 완료된 경우, 검색된 객체에 관한 정보를 VR 공간(100) 상에 표시할 수 있다. 디바이스(10)는 객체에 관한 정보를 검색하는 중에 사용자가 특정 광고 이미지를 선택한 경우에는 선택된 광고 이미지와 객체에 관한 정보를 함께 표시할 수 있다. 또한, 다른 예에 따라, 사용자가 특정 광고 이미지를 선택하지 않은 경우, 디바이스(10)는 객체에 관한 정보 만을 VR 공간(100) 상에 표시할 수 있다.On the other hand, when the search is completed, the

일 실시예에 따른 디바이스(10)는 VR 공간(100) 상에서 사용자가 객체에 관한 정보 검색을 요청하는 동안, 복수의 광고 이미지들이 VR 공간(100) 상에 일방향으로 이동하는 UI를 제공함으로써, 정보 검색에 소요되는 시간 동안 보다 다양한 정보를 효율적으로 획득할 수 있는 환경을 제공할 수 있다.The

한편, 일 실시예에 따른 디바이스(10)는 다양한 형태로 구현될 수 있다. 예를 들어, 본 명세서에서 기술되는 디바이스(10)는 휴대폰, 스마트 폰(smart phone), 태블릿 PC, 전자북 단말기, 디지털방송용 단말기, PDA(Personal Digital Assistants), PMP(Portable Multimedia Player), 네비게이션, 스마트 TV, 스마트 카, HMD(Head Mounted Display) 등이 있을 수 있으나, 이에 한정되는 것은 아니다.Meanwhile, the

도 2는 일 실시예에 따른 디바이스가 VR 공간에서 UI를 제공하는 방법을 설명하기 위한 흐름도이다.2 is a flowchart illustrating a method of providing a UI in a VR space according to an exemplary embodiment of the present invention.

단계 S210에서, 디바이스는 사용자의 입력이 획득됨에 따라, VR 공간 상에 검색창을 표시할 수 있다.In step S210, the device can display the search window on the VR space as the user's input is acquired.

일 실시예에 따른 디바이스는 VR 공간을 제공할 수 있다. 여기에서, VR 공간은 기 설정된 화각을 갖는 렌즈를 통해 디바이스의 디스플레이 상에 표시되는 영상을 투사시킴으로써 구현할 수 있다. 기 설정된 화각을 갖는 렌즈는 디바이스에 포함될 수도 있으나 이는 일 실시예일 뿐, 기 설정된 화각을 갖는 렌즈는 디바이스의 외부에 존재할 수도 있다.A device according to one embodiment may provide VR space. Here, the VR space can be realized by projecting an image displayed on the display of the device through a lens having a predetermined angle of view. A lens having a predetermined angle of view may be included in the device, but this is only an example, and a lens having a predetermined angle of view may exist outside the device.

한편, 디바이스를 착용한 사용자는 기 설정된 화각을 갖는 렌즈를 통해, 디바이스에서 출력되는 영상을 시청함으로써, 영상이 사용자로부터 원거리에 출력되는 것으로 느낄 수 있다. 이를 통해, 디바이스는 사용자가 이미지가 나타내는 환경에 존재하는 것과 같은 몰입감을 느낄 수 있는 VR 공간을 사용자에게 제공할 수 있다.On the other hand, the user who wears the device can feel that the image is outputted from the user at a long distance by watching the image output from the device through the lens having the predetermined angle of view. This allows the device to provide the user with a VR space that can feel immersive as if the user were present in the environment represented by the image.

디바이스는 사용자로부터 검색창을 요청하는 사용자 입력이 획득되는 경우, VR 공간 상에 검색창을 표시할 수 있다. 한편, 디바이스가 디바이스에 설치된 애플리케이션을 통해 VR 공간 상에서 서비스를 제공하는 중에 검색창을 요청하는 사용자 입력이 획득되는 경우에도, 디바이스는 서비스를 중단하고 검색창을 표시하거나 혹은 서비스와 함께 검색창을 표시할 수 있다.The device may display a search window on the VR space when a user input requesting a search window from the user is obtained. On the other hand, even when a user inputs a request for a search window while acquiring a service in the VR space through an application installed in the device, the device stops the service and displays a search window or displays a search window together with the service can do.

단계 S220에서, 디바이스는 표시된 검색창을 통해 객체에 대한 검색 요청이 수신됨에 따라 객체에 관한 정보를 검색할 수 있다.In step S220, the device can retrieve information about the object as the search request for the object is received through the displayed search window.

일 실시예에 따른 디바이스는 표시된 검색창을 통해 객체에 대한 검색 요청을 수신할 수 있다. 예를 들어, 사용자는 터치 등이 가능한 입력 수단, 제스쳐 및 음성 신호 등을 이용하여, 검색하고자 하는 객체를 특정할 수 있다. 디바이스는 객체가 특정되는 경우, 사용자가 확인할 수 있도록 검색창에 특정된 객체를 표시할 수 있다. 예를 들어, 사용자가 스마트 폰 또는 웨어러블 디바이스를 통해, 객체 A를 특정하는 경우, 디바이스는 특정된 객체 A에 관한 정보를 수신하여 검색창에 객체 A를 표시할 수 있다.A device according to an exemplary embodiment may receive a search request for an object through a displayed search window. For example, the user can specify an object to be searched using input means capable of touching, gesture, voice signal, or the like. When an object is specified, the device can display an object specified in the search window so that the user can check it. For example, when a user specifies an object A through a smartphone or a wearable device, the device can receive the information about the specified object A and display the object A in the search window.

또한, 디바이스는 객체 A에 대한 검색 요청이 수신됨에 따라 객체 A에 관한 정보를 검색할 수 있다. 디바이스는 객체에 관한 정보를 검색하기 위해, 웹 서버 등과 같은 외부의 서버들과 연결을 수행할 수 있다.In addition, the device can retrieve information about object A as the search request for object A is received. A device can perform connections with external servers, such as a web server, to retrieve information about an object.

단계 S230에서, 디바이스는 객체에 관한 정보를 검색하는 동안 VR 공간 상에 적어도 하나의 광고를 표시할 수 있다.In step S230, the device may display at least one advertisement on the VR space while retrieving information about the object.

일 실시예에 따른 디바이스는 객체에 관한 정보를 검색하는 동안 VR 공간 상에 사용자의 프로파일에 따라 선택된 광고를 표시할 수 있다. 예를 들어, 사용자가 30대 남성인 경우, 디바이스는 30대 남성이 선호하는 상품에 관한 광고를 표시할 수 있다.A device according to one embodiment may display selected advertisements according to a user's profile on the VR space while retrieving information about an object. For example, if the user is a male in his thirties, the device can display an advertisement about the merchandise preferred by the male in his thirties.

또한, 디바이스는 사용자가 VR 공간 내의 현재 위치에서 다른 위치로 이동하는 것과 같은 느낌을 받을 수 있도록, 광고 이미지를 이동시켜 가면서 표시할 수 있다. 예를 들어, 사용자의 위치를 기준으로 제 1 방향으로 일련의 광고 이미지들을 이동시킬 수 있다. 또한, 디바이스는 VR 공간을 메쉬 형태로 분할하여 보다 다양한 광고가 각각의 분할된 영역에 표시될 수 있도록 설정할 수 있다. 이에 따라, 사용자는 객체에 대한 검색이 완료되기 전까지 적어도 하나의 광고를 시청할 수 있다.In addition, the device may display the advertisement image while moving it so that the user may feel like moving from the current position to the other position in the VR space. For example, a series of ad images may be moved in a first direction based on a user's location. In addition, the device may divide the VR space into a mesh shape so that more various advertisements can be displayed in each divided area. Accordingly, the user can watch at least one advertisement until the search for the object is completed.

한편, 디바이스는 사용자가 표시되는 적어도 하나의 광고 중 어느 하나를 선택하는 경우, 광고 표시를 중단하고 선택된 광고에 대한 정보를 추가적으로 제공할 수 있다. 이에 대해서는 도 6 및 도 7을 참고하여 보다 구체적으로 후술하도록 한다.On the other hand, when the user selects any one of the displayed at least one advertisement, the device can stop the advertisement display and additionally provide information about the selected advertisement. This will be described later in more detail with reference to FIG. 6 and FIG.

단계 S240에서, 디바이스는 검색이 완료됨에 따라, 적어도 하나의 광고의 표시를 중단하고, 검색된 객체에 관한 정보를 VR 공간 상에 표시할 수 있다.In step S240, as the search is completed, the device may stop displaying the at least one advertisement and display information on the retrieved object on the VR space.

일 실시예에 따른 디바이스는 검색이 완료됨에 따라, 적어도 하나의 광고의 표시를 중단할 수 있다. 디바이스는 검색된 객체에 관한 정보에 포함된 이미지, 텍스트 및 동영상 중 적어도 하나를 VR 공간 상에 표시할 수 있다.The device according to an embodiment may stop displaying the at least one advertisement as the search is completed. The device can display at least one of images, text, and moving images contained in information about the retrieved object on the VR space.

한편, 디바이스는 사용자가 검색이 진행되는 중에 선택한 광고가 존재하는 경우, 검색된 객체에 관한 정보와 선택된 광고의 상품에 관한 정보를 VR 공간 상에 함께 표시할 수 있다.On the other hand, if there is an advertisement selected by the user during the search, the device can display information about the searched object and information about the selected advertisement product on the VR space.

도 3은 일 실시예에 따른 디바이스가 사용자의 입력을 획득하여 VR 공간(310) 상에 검색창(320)을 표시하는 방법을 설명하기 위한 도면이다.3 is a diagram illustrating a method for a device according to an exemplary embodiment to acquire a user's input and display a

도 3을 참고하면, 디바이스는 사용자의 제스처를 감지할 수 있다. 예를 들어, 디바이스는 손가락으로 사각형의 형태를 그리는 사용자의 제스처를 감지할 수 있다. 디바이스는 VR 공간(310)에서 사용자의 제스쳐가 감지된 위치에 검색창(320)이 표시될 수 있도록 기 설정된 화각을 갖는 렌즈를 통해 투사되는 이미지를 생성할 수 있다.Referring to FIG. 3, the device can detect a user's gesture. For example, a device can sense a user's gesture that draws the shape of a rectangle with a finger. The device may generate an image projected through a lens having a predetermined angle of view so that the

또한, 디바이스는 사용자의 감지된 제스처의 종류에 따라 표시되는 검색창의 크기 및 형태를 결정할 수 있다. 예를 들어, 사각형을 그리는 제스쳐가 획득되는 경우, 디바이스는 사각형 형태의 검색창(320)을 표시할 수 있다. 다른 예에 따라 원형을 그리는 제스쳐가 획득되는 경우, 디바이스는 원형 형태의 검색창을 표시할 수 있다. 디바이스는 사용자의 제스쳐를 기초로 표시되는 검색창의 크기를 결정할 수도 있다.The device may also determine the size and shape of the search window displayed according to the type of gesture detected by the user. For example, if a gesture of drawing a rectangle is obtained, the device may display a

디바이스의 사용자는 검색창(320)이 표시됨을 확인함에 따라, 객체에 관한 정보를 디바이스에 요청할 수 있다. 디바이스는 객체에 관한 정보를 텍스트 데이터로 제공할 수 있다. 다른 예에 따라, 디바이스의 사용자는 디바이스 내에 기 저장되어 있던 이미지를 검색창(320)에 드래그하여 객체에 관한 정보를 제공할 수 있다. 또 다른 예에 따라, 디바이스의 사용자는 객체에 관한 정보를 음성 데이터로 제공할 수도 있다.The user of the device can request information about the object from the device by confirming that the

디바이스는 검색창(320)을 통해 사용자가 검색을 원하는 객체가 특정됨에 따라, 객체에 대한 검색을 수행할 수 있다.The device may perform a search for an object as the object desired by the user is specified through the

도 4는 일 실시예에 따른 디바이스(10)가 제공하는 VR 공간에서의 UI를 보다 구체적으로 설명하기 위한 도면이다.4 is a diagram for more specifically explaining the UI in the VR space provided by the

도 4를 참고하면, 디바이스(10)는 검색창이 표시된 공간인 제 1 가상 공간(410)과 검색 결과가 표시되는 공간인 제 2 가상 공간(420)을 제공할 수 있다. 또한, 디바이스(10)는 객체에 관한 검색이 진행되는 동안, 광고가 표시되는 제 3 가상 공간(430)을 제공할 수 있다.Referring to FIG. 4, the

여기에서, 제 1 가상 공간(410), 제 2 가상 공간(420) 및 제 3 가상 공간(430)은 디바이스(10)가 제공하는 VR 공간에서 표시되는 정보의 종류에 따라 구별될 수 있다. 또한, 디바이스(10)는 시간에 따라 제 1 가상 공간(410), 제 2 가상 공간(420) 및 제 3 가상 공간(430)을 VR 공간 상에 구현할 수 있다.Here, the first

일 실시예에 따른 디바이스(10)는 사용자로부터 검색을 요청하는 사용자의 입력이 수신됨에 따라 VR 공간 상에 검색창을 표시할 수 있다. 여기에서, 사용자의 입력에 따라 검색창이 표시되는 공간을 제 1 가상 공간(410)으로 설명할 수 있다.The

한편, 디바이스(10)는 검색이 완료되기까지 VR 공간에서 적어도 하나의 광고를 표시할 수 있다. 여기에서, VR 공간이 표시되는 공간을 제 3 가상 공간(430)으로 설명할 수 있다. 디바이스(10)는 VR 공간의 UI를 적어도 하나의 광고의 이미지, 텍스트 및 동영상으로 변경함으로써 제 3 가상 공간(430)을 구현할 수 있다. 또한, 디바이스(10)는 광고를 구성하는 광고 이미지, 텍스트 및 동영상이 기 설정된 방향으로 이동해가면서 표시하도록 함으로써, 사용자가 가상 공간을 이동하는 느낌을 받을 수 있는 환경을 제공할 수 있다.Meanwhile, the

디바이스(10)는 검색이 완료되는 경우 검색 결과가 제공되는 제 2 가상 공간(420)을 표시할 수 있다. 디바이스(10)는 검색이 완료됨에 따라, VR 공간 상에 이동하면서 표시되는 광고를 중단함으로써, 사용자에게 제 3 가상 공간(430)을 통과하여, 제 2 가상 공간(420)에 위치한 것과 같은 효과를 제공할 수 있다.The

도 5는 일 실시예에 따른 디바이스가 메쉬 형태로 VR 공간을 분할하여, 광고를 제공하는 방법을 설명하기 위한 도면이다.5 is a diagram for explaining a method of providing a advertisement by dividing a VR space in a mesh form according to an embodiment of the present invention.

도 5를 참고하면, 디바이스는 사용자가 정보를 원하는 객체에 대한 검색이 시작됨에 따라, 광고를 제공하는 제 3 가상 공간을 표시할 수 있다. 디바이스는 광고를 제공하는 제 3 가상 공간으로 사용자가 이동하는 것과 같은 효과를 주기 위해, VR 공간을 메쉬 형태로 분할하여, 복수의 광고 이미지들이 표시될 수 있도록 한다. 또한, 메쉬 형태로 분할된 영역에 표시된 복수의 광고 이미지들은 기 설정된 방향으로 이동할 수 있다.Referring to FIG. 5, the device may display a third virtual space providing an advertisement as the user begins searching for an object for which information is desired. The device divides the VR space into a mesh form so that a plurality of advertisement images can be displayed so as to have the same effect as a user moving to a third virtual space for providing an advertisement. In addition, a plurality of advertisement images displayed in the mesh-shaped area may move in a predetermined direction.

한편, 디바이스는 사용자가 메쉬 형태로 분할된 영역에 표시된 복수의 광고 이미지들 중 적어도 하나를 선택하는 경우(예를 들어, 522, 524), 선택된 광고의 상품에 관한 정보를 VR 공간 상에 표시할 수 있다.On the other hand, when the user selects at least one of a plurality of advertisement images displayed in the area divided into the mesh form (for example, 522, 524), the device displays information on the product of the selected advertisement on the VR space .

일 실시예에 따른 디바이스는 제 3 가상 공간 상에서 이동시키는 광고의 이미지들을 검색 시간에 따라 변화시킬 수 있다. 예를 들어, 검색 시작 단계에서 이동하는 광고 이미지(510), 검색 중간 단계에서 이동하는 광고 이미지(520) 및 검색 마지막 단계에서 이동하는 광고 이미지(530)의 속도가 서로 상이할 수 있다. 구체적으로, 검색이 종료되는 시간에 가까운 검색 마지막 단계에서 이동하는 광고 이미지(530)의 속도가 가장 빠를 수 있다.The device according to an embodiment may change the images of the advertisement moving on the third virtual space according to the search time. For example, the speeds of the moving

도 6은 일 실시예에 따른 디바이스(10)가 광고를 제공하는 제 3 가상 공간(610)을 설명하기 위한 도면이다.6 is a diagram illustrating a third

도 6을 참고하면, 디바이스(10)는 VR 공간 상에서 복수의 광고가 표시되는 제 3 가상 공간(610)을 제공할 수 있다. 제 3 가상 공간(510)에는 복수의 광고들 각각을 구성하는 이미지가 표시될 수 있다.Referring to FIG. 6, the

또한, 복수의 광고들 각각을 구성하는 이미지는 기 설정된 방향으로 이동할 수 있다. 예를 들어, 디바이스(10)의 사용자가 제 1 방향을 향해 서있는 경우, 디바이스(10)는 사용자의 시선 방향을 감지하고, 사용자의 시선 방향과 반대 방향으로 복수의 광고들 각각을 구성하는 이미지를 이동시킬 수 있다. 여기에서, 복수의 광고들 각각을 구성하는 일련의 이미지들은 디바이스(10)가 사용자가 요청한 검색을 완료하기 까지 끊김 없이, 제 1 방향의 반대방향인 제 2 방향으로 이동할 수 있다.In addition, the image forming each of the plurality of advertisements can be moved in a predetermined direction. For example, when the user of the

한편, 디바이스(10)의 사용자는 사용자 주변을 이동하여 지나가는 광고 이미지들 중 어느 하나를 선택할 수 있다. 예를 들어, 디바이스(10)는 광고 이미지들 중 어느 하나를 터치하는 제스쳐를 통해 복수의 광고들 중 어느 하나를 선택할 수 있다. 여기에서, 디바이스(10)는 사용자의 제스쳐를 감지하여, 디바이스(10)의 디스플레이 상에 실제 표시되는 광고 이미지들 중 사용자의 제스쳐에 대응되는 광고를 선택할 수 있다. 사용자는 기 설정된 화각을 갖는 렌즈를 통해 디바이스(10)에 표시되는 이미지가 원거리에 있는 것처럼 느끼는 것이므로, 사용자의 제스쳐와 디바이스(10)에 실제 표시되는 광고와의 매칭을 통해, 사용자가 선택한 광고가 어떠한 광고인지 판별할 수 있다.Meanwhile, the user of the

또한, 디바이스(10)는 사용자가 광고 A를 선택한 경우, 광고 A의 제품인 자동차 A의 정보(620)를 VR 공간 상에 표시할 수 있다. 디바이스(10)는 광고 A가 선택됨에 따라 다른 광고들의 표시를 중단하고, 자동차 A의 정보(620)를 VR 공간 상에 표시할 수 있다. 일 실시예에 따른, 디바이스(10)는 검색이 완료되기 전까지 자동차 A의 정보(620)를 표시할 수 있고, 검색이 완료되는 경우 검색 결과가 표시되는 제 2 가상 공간을 VR 공간 상에 구현할 수 있다.Further, the

한편, 디바이스(10)는 사용자의 프로파일을 기초로 제 3 가상 공간(610) 상에 표시되는 광고의 종류를 미리 설정할 수 있다. On the other hand, the

도 7은 일 실시예에 따른 디바이스가 VR 공간 상의 UI에 광고 및 검색 결과를 표시하는 방법을 설명하기 위한 흐름도이다.7 is a flowchart illustrating a method of displaying a search result in a UI on a VR space by a device according to an embodiment.

단계 S710에서, 디바이스는 표시된 검색창을 통해 객체에 대한 검색 요청이 수신됨에 따라 객체에 관한 정보를 검색할 수 있다.In step S710, the device can retrieve information about the object as the search request for the object is received through the displayed search window.

단계 S720에서, 디바이스는 사용자의 프로파일 및 이전에 검색 요청된 적어도 하나의 객체에 관한 히스토리 정보에 기초하여 복수의 광고들 중 적어도 하나의 광고를 선택할 수 있다.In step S720, the device may select at least one of the plurality of advertisements based on the user's profile and the history information about the at least one object previously searched for.

일 실시예에 따른 디바이스는 광고를 제공하는 광고 서버에 사용자의 프로파일 정보를 제공하고, 사용자와 유사한 프로파일을 가진 다른 사용자들이 선호하는 상품에 관한 정보를 제공받을 수 있다. 또한, 다른 실시예에 따라 디바이스는 사용자가 이전에 검색한 객체의 정보를 광고를 제공하는 광고 서버에 제공함으로써, 사용자의 관심도가 높을 것으로 판단되는 상품에 관한 광고를 제공받을 수 있다.A device according to an exemplary embodiment of the present invention provides profile information of a user to an advertisement server that provides advertisements, and information on products preferred by other users having profiles similar to the user can be provided. In addition, according to another embodiment, the device may provide information on an object previously searched by the user to an advertisement server that provides the advertisement, so that the advertisement about the goods that the user is highly interested in may be provided.

단계 S730에서, 디바이스는 객체에 관한 정보를 검색하는 동안 선택된 광고를 표시할 수 있다.In step S730, the device may display the selected advertisement while searching for information about the object.

일 실시예에 따른 디바이스는 객체에 관한 정보의 검색이 진행되는 동안, 선택된 광고를 VR 공간 상에 표시할 수 있다. 선택된 광고가 VR 공간 상에 표시되는 방법은 도 5를 참고하여 전술한 방법과 대응될 수 있다.A device according to an embodiment may display a selected advertisement on VR space while a search for information about an object is in progress. The manner in which the selected advertisement is displayed on the VR space may correspond to the method described above with reference to Fig.

단계 S740에서, 디바이스는 검색이 완료됨에 따라, 적어도 하나의 광고의 표시를 중단하고 검색된 객체에 관한 정보를 VR 공간 상에 표시할 수 있다.In step S740, as the search is completed, the device may stop displaying the at least one advertisement and display information on the retrieved object on the VR space.

일 실시예에 따른 디바이스는 검색이 완료됨에 따라, 적어도 하나의 광고의 표시를 중단할 수 있다. 디바이스는 검색된 객체에 관한 정보에 포함된 이미지, 텍스트 및 동영상 중 적어도 하나를 VR 공간 상에 표시할 수 있다.The device according to an embodiment may stop displaying the at least one advertisement as the search is completed. The device can display at least one of images, text, and moving images contained in information about the retrieved object on the VR space.

한편, 디바이스는 사용자가 검색이 진행되는 중에 선택한 광고가 존재하는 경우, 검색된 객체에 관한 정보와 선택된 광고의 상품에 관한 정보를 VR 공간 상에 함께 표시할 수 있다.On the other hand, if there is an advertisement selected by the user during the search, the device can display information about the searched object and information about the selected advertisement product on the VR space.

도 8 및 9는 일 실시예에 따라 영상을 처리하는 디바이스(800)의 블록도이다.8 and 9 are block diagrams of a

도 8에 도시된 바와 같이, 일 실시예에 따른 디바이스(800)는, 센싱부(810), 프로세서(820) 및 출력부(830)를 포함할 수 있다. 그러나 도시된 구성요소 모두가 필수구성요소인 것은 아니다. 도시된 구성요소보다 많은 구성요소에 의해 디바이스(800)가 구현될 수도 있고, 그보다 적은 구성요소에 의해서도 디바이스(800)는 구현될 수 있다.8, a

예를 들어, 도 10에 도시된 바와 같이, 본 발명의 일 실시예에 따른 디바이스(800)는, 센싱부(810), 프로세서(820) 및 출력부(830) 이외에 A/V 입력부(840), 사용자 입력부(850), 통신부(860) 및 메모리(870)를 더 포함할 수도 있다.10, a

이하 상기 구성요소들에 대해 차례로 살펴본다.Hereinafter, the components will be described in order.

센싱부(810)는, 디바이스(800)의 상태, 디바이스(800) 주변의 상태 및 디바이스(800)를 착용한 사용자의 상태 중 적어도 하나를 감지하고, 감지된 정보를 프로세서(820)로 전달할 수 있다.The

일 실시예에 따른 센싱부(810)는 디바이스(800)를 착용한 사용자의 입력을 획득할 수 있다. 예를 들어, 센싱부(810)는 사용자의 제스쳐 등을 감지하여, 사용자의 입력을 획득할 수 있다. 한편, 이는 일 실시예일 뿐, 디바이스(800)는 사용자 입력부(850)를 통해 사용자의 입력을 획득할 수도 있다. 또한, 센싱부(810)는 디바이스(800)를 착용한 사용자의 움직임을 추적할 수 있다.The

센싱부(810)는, 지자기 센서(Magnetic sensor)(811), 가속도 센서(Acceleration sensor)(812), 온/습도 센서(813), 적외선 센서(814), 자이로스코프 센서(815), 위치 센서(예컨대, GPS)(816), 기압 센서(817), 근접 센서(818), 및 RGB 센서(illuminance sensor)(819) 중 적어도 하나를 포함할 수 있으나, 이에 한정되는 것은 아니다. 각 센서들의 기능은 그 명칭으로부터 당업자가 직관적으로 추론할 수 있으므로, 구체적인 설명은 생략하기로 한다.The

프로세서(820)는, 통상적으로 디바이스(800)의 전반적인 동작을 제어한다. 예를 들어, 프로세서(820)는, 메모리(870)에 저장된 프로그램들을 실행함으로써, 센싱부(810), 출력부(830), A/V 입력부(840), 사용자 입력부(850) 및 통신부(860) 등을 전반적으로 제어할 수 있다.The

일 실시예에 따른 프로세서(820)는 표시된 검색창을 통해 객체에 대한 검색 요청이 수신됨에 따라, 객체에 관한 정보를 검색할 수 있다. 프로세서(820)는 객체에 관한 정보를 검색하는 동안, 출력부(830)를 통해 VR 공간 상에 적어도 하나의 광고를 표시할 수 있다. 또한, 프로세서(820)는 검색이 완료됨에 따라, 적어도 하나의 광고의 표시를 중단할 수 있다.The

일 실시예에 따른 프로세서(820)는 사용자의 프로파일 및 이전에 검색 요청된 적어도 하나의 객체에 관한 히스토리 정보에 기초하여, 복수의 광고들 중 적어도 하나의 광고를 선택할 수 있다.The

일 실시예에 따른 프로세서(820)는 적어도 하나의 광고를 구성하는 이미지를 기 설정된 방향으로 이동시킬 수 있다. 예를 들어, 프로세서(820)는 기 설정된 화각을 갖는 렌즈를 통해 투사되는 이미지가 출력부(830)를 통해 출력되는 속도 및 위치를 변경함으로써, 적어도 하나의 광고를 구성하는 이미지를 기 설정된 방향으로 이동시킬 수 있다. 이미지의 이동 속도는, 객체에 대한 검색의 종료 시간이 가까워질수록 빨라질 수 있다.The

출력부(830)는, 오디오 신호 또는 영상 신호 또는 진동 신호의 출력을 위한 것으로, 이에는 디스플레이부(831)와 음향 출력부(832) 등이 포함될 수 있다.The

디스플레이부(831)는 디바이스(800)에서 처리되는 정보를 표시 출력한다. 예를 들어, 디스플레이부(831)는 객체에 관한 정보 검색 중, 사용자로부터 표시된 적어도 하나의 광고를 선택하는 선택 입력이 수신되는 경우, 선택된 광고의 제품에 관한 정보를 VR 공간 상에 표시할 수 있다.The

또한, 디스플레이부(831)는 객체에 대한 검색이 완료된 경우, 검색 결과와 선택된 광고의 제품에 관한 정보를 함께 VR 공간 상에 표시할 수 있다.In addition, when the search for the object is completed, the

한편, 디스플레이부(831)와 터치패드가 레이어 구조를 이루어 터치 스크린으로 구성되는 경우, 디스플레이부(831)는 출력 장치 이외에 입력 장치로도 사용될 수 있다. 디스플레이부(831)는 액정 디스플레이(liquid crystal display), 박막 트랜지스터 액정 디스플레이(thin film transistor-liquid crystal display), 유기 발광 다이오드(organic light-emitting diode), 플렉시블 디스플레이(flexible display), 3차원 디스플레이(3D display), 전기영동 디스플레이(electrophoretic display) 중에서 적어도 하나를 포함할 수 있다. 그리고 디바이스(800)의 구현 형태에 따라 디바이스(800)는 디스플레이부(831)를 2개 이상 포함할 수도 있다. 이때, 2개 이상의 디스플레이부(831)는 힌지(hinge)를 이용하여 마주보게 배치될 수 있다.Meanwhile, when the

음향 출력부(832)는 통신부(860)로부터 수신되거나 메모리(870)에 저장된 오디오 데이터를 출력한다. 또한, 음향 출력부(832)는 디바이스(800)에서 수행되는 기능(예를 들어, 호신호 수신음, 메시지 수신음, 알림음)과 관련된 음향 신호를 출력한다. 이러한 음향 출력부(1032)에는 스피커(speaker), 버저(Buzzer) 등이 포함될 수 있다.The

A/V(Audio/Video) 입력부(840)는 오디오 신호 또는 영상 신호 입력을 위한 것으로, 이에는 카메라(미도시)와 마이크로폰(미도시) 등이 포함될 수 있다. 카메라는 화상 통화모드 또는 촬영 모드에서 이미지 센서를 통해 정지영상 또는 동영상 등의 화상 프레임을 얻을 수 있다. 이미지 센서를 통해 캡쳐된 이미지는 프로세서(820) 또는 별도의 이미지 처리부(미도시)를 통해 처리될 수 있다.The A / V (Audio / Video)

카메라에서 처리된 화상 프레임은 메모리(870)에 저장되거나 통신부(860)를 통하여 외부로 전송될 수 있다. 카메라는 디바이스(800)의 구성 태양에 따라 2개 이상이 구비될 수도 있다.The image frame processed by the camera can be stored in the

마이크로폰은, 외부의 음향 신호를 입력 받아 전기적인 음성 데이터로 처리한다. 예를 들어, 마이크로폰은 외부 디바이스 또는 화자로부터 음향 신호를 수신할 수 있다. 마이크로폰은 외부의 음향 신호를 입력 받는 과정에서 발생 되는 잡음(noise)을 제거하기 위한 다양한 잡음 제거 알고리즘을 이용할 수 있다.The microphone receives an external acoustic signal and processes it as electrical voice data. For example, the microphone may receive acoustic signals from an external device or speaker. The microphone can use various noise cancellation algorithms to remove noise generated in receiving an external acoustic signal.

한편, 일 실시예에 따른 디바이스(800)는 렌즈(미도시)를 더 포함할 수도 있다. 디바이스(800)의 사용자는 렌즈를 통해 디스플레이부(831)에서 출력되는 영상을 감지할 수 있다.Meanwhile, the

사용자 입력부(850)는, 사용자가 디바이스(800)를 제어하기 위한 데이터를 입력하는 수단을 의미한다. 예를 들어, 사용자 입력부(850)에는 키 패드(key pad), 돔 스위치 (dome switch), 터치 패드(접촉식 정전 용량 방식, 압력식 저항막 방식, 적외선 감지 방식, 표면 초음파 전도 방식, 적분식 장력 측정 방식, 피에조 효과 방식 등), 조그 휠, 조그 스위치 등이 있을 수 있으나 이에 한정되는 것은 아니다.The

사용자 입력부(850)는, 사용자 입력을 수신할 수 있다. 또한, 사용자 입력부(850)는 UI 모듈(871)과 연동되어, 복수의 센서들 각각의 감지 영역 상에 표시되는 아이템들 중 적어도 하나를 선택하는 사용자 입력을 수신할 수도 있다. 다만, 이는 일 실시예일 뿐, 사용자 입력부(850)에서 수신하는 사용자 입력의 종류가 전술한 예에 한정되는 것은 아니다.The

통신부(860)는, 디바이스(800)와 외부 디바이스(예를 들어, HMD) 간의 통신을 하게 하는 하나 이상의 구성요소를 포함할 수 있다. 예를 들어, 통신부(860)는, 근거리 통신부(861), 이동 통신부(862), 방송 수신부(863)를 포함할 수 있다.The

근거리 통신부(short-range wireless communication unit)(861)는, 블루투스 통신부, BLE(Bluetooth Low Energy) 통신부, 근거리 무선 통신부(Near Field Communication unit), WLAN(와이파이) 통신부, 지그비(Zigbee) 통신부, 적외선(IrDA, infrared Data Association) 통신부, WFD(Wi-Fi Direct) 통신부, UWB(ultra wideband) 통신부, Ant+ 통신부 등을 포함할 수 있으나, 이에 한정되는 것은 아니다.The short-range

이동 통신부(862)는, 이동 통신망 상에서 기지국, 외부의 단말, 서버 중 적어도 하나와 무선 신호를 송수신한다. 여기에서, 무선 신호는, 음성 호 신호, 화상 통화 호 신호 또는 문자/멀티미디어 메시지 송수신에 따른 다양한 형태의 데이터를 포함할 수 있다.The

방송 수신부(863)는, 방송 채널을 통하여 외부로부터 방송 신호 및/또는 방송 관련된 정보를 수신한다. 방송 채널은 위성 채널, 지상파 채널을 포함할 수 있다. 구현 예에 따라서 디바이스(800)가 방송 수신부(863)를 포함하지 않을 수도 있다.The

메모리(870)는, 프로세서(820)의 처리 및 제어를 위한 프로그램을 저장할 수도 있고, 입/출력되는 데이터들(예를 들어, 영상들의 픽셀 값)을 저장할 수도 있다.The

메모리(870)는 플래시 메모리 타입(flash memory type), 하드디스크 타입(hard disk type), 멀티미디어 카드 마이크로 타입(multimedia card micro type), 카드 타입의 메모리(예를 들어 SD 또는 XD 메모리 등), 램(RAM, Random Access Memory) SRAM(Static Random Access Memory), 롬(ROM, Read-Only Memory), EEPROM(Electrically Erasable Programmable Read-Only Memory), PROM(Programmable Read-Only Memory), 자기 메모리, 자기 디스크, 광디스크 중 적어도 하나의 타입의 저장매체를 포함할 수 있다. 또한, 디바이스(800)는 인터넷(internet)상에서 메모리(870)의 저장 기능을 수행하는 웹 스토리지(web storage) 또는 클라우드 서버를 운영할 수도 있다.The

메모리(870)에 저장된 프로그램들은 그 기능에 따라 복수 개의 모듈들로 분류할 수 있는데, 예를 들어, UI 모듈(871) 및 터치 스크린 모듈(872) 등으로 분류될 수 있다.The programs stored in the

UI 모듈(871)은, 애플리케이션 별로 디바이스(800)와 연동되는 특화된 UI, GUI 등을 제공할 수 있다. 터치 스크린 모듈(872)은 사용자의 터치 스크린 상의 터치 제스처를 감지하고, 터치 제스처에 관한 정보를 프로세서(820)로 전달할 수 있다. 일 실시예에 따른 터치 스크린 모듈(872)은 터치 코드를 인식하고 분석할 수 있다. 터치 스크린 모듈(872)은 컨트롤러를 포함하는 별도의 하드웨어로 구성될 수도 있다.The

터치스크린의 터치 또는 근접 터치를 감지하기 위해 터치스크린의 내부 또는 근처에 다양한 센서가 구비될 수 있다. 터치스크린의 터치를 감지하기 위한 센서의 일례로 촉각 센서가 있다. 촉각 센서는 사람이 느끼는 정도로 또는 그 이상으로 특정 물체의 접촉을 감지하는 센서를 말한다. 촉각 센서는 접촉면의 거칠기, 접촉 물체의 단단함, 접촉 지점의 온도 등의 다양한 정보를 감지할 수 있다.Various sensors may be provided in or near the touch screen to sense the touch or near touch of the touch screen. An example of a sensor for sensing the touch of the touch screen is a tactile sensor. A tactile sensor is a sensor that detects the contact of a specific object with a degree or more that a person feels. The tactile sensor can detect various information such as the roughness of the contact surface, the rigidity of the contact object, and the temperature of the contact point.

또한, 터치스크린의 터치를 감지하기 위한 센서의 일례로 근접 센서가 있다.In addition, a proximity sensor is an example of a sensor for sensing the touch of the touch screen.

근접 센서는 소정의 검출면에 접근하는 물체, 혹은 근방에 존재하는 물체의 유무를 전자계의 힘 또는 적외선을 이용하여 기계적 접촉이 없이 검출하는 센서를 말한다. 근접 센서의 예로는 투과형 광전 센서, 직접 반사형 광전 센서, 미러 반사형 광전 센서, 고주파 발진형 근접 센서, 정전용량형 근접 센서, 자기형 근접 센서, 적외선 근접 센서 등이 있다. 사용자의 터치 제스처에는 탭, 터치&홀드, 더블 탭, 드래그, 패닝, 플릭, 드래그 앤드 드롭, 스와이프 등이 있을 수 있다.The proximity sensor refers to a sensor that detects the presence or absence of an object approaching a predetermined detection surface or a nearby object without mechanical contact using the force of an electromagnetic field or infrared rays. Examples of proximity sensors include a transmission type photoelectric sensor, a direct reflection type photoelectric sensor, a mirror reflection type photoelectric sensor, a high frequency oscillation type proximity sensor, a capacitive proximity sensor, a magnetic proximity sensor, and an infrared proximity sensor. The user's touch gestures can include tap, touch & hold, double tap, drag, panning, flick, drag and drop, swipe, and the like.

본 발명에 따른 장치는 프로세서, 프로그램 데이터를 저장하고 실행하는 메모리, 디스크 드라이브와 같은 영구 저장부(permanent storage), 외부 장치와 통신하는 통신 포트, 터치 패널, 키(key), 버튼 등과 같은 사용자 인터페이스 장치 등을 포함할 수 있다. 소프트웨어 모듈 또는 알고리즘으로 구현되는 방법들은 상기 프로세서상에서 실행 가능한 컴퓨터가 읽을 수 있는 코드들 또는 프로그램 명령들로서 컴퓨터가 읽을 수 있는 기록 매체 상에 저장될 수 있다. 여기서 컴퓨터가 읽을 수 있는 기록 매체로 마그네틱 저장 매체(예컨대, ROM(read-only memory), RAM(random-access memory), 플로피 디스크, 하드 디스크 등) 및 광학적 판독 매체(예컨대, 시디롬(CD-ROM), 디브이디(DVD: Digital Versatile Disc)) 등이 있다. 컴퓨터가 읽을 수 있는 기록 매체는 네트워크로 연결된 컴퓨터 시스템들에 분산되어, 분산 방식으로 컴퓨터가 판독 가능한 코드가 저장되고 실행될 수 있다. 매체는 컴퓨터에 의해 판독가능하며, 메모리에 저장되고, 프로세서에서 실행될 수 있다.An apparatus according to the present invention may include a processor, a memory for storing and executing program data, a permanent storage such as a disk drive, a communication port for communicating with an external device, a user interface such as a touch panel, a key, Devices, and the like. Methods implemented with software modules or algorithms may be stored on a computer readable recording medium as computer readable codes or program instructions executable on the processor. Here, the computer-readable recording medium may be a magnetic storage medium such as a read-only memory (ROM), a random-access memory (RAM), a floppy disk, a hard disk, ), And a DVD (Digital Versatile Disc). The computer-readable recording medium may be distributed over networked computer systems so that computer readable code can be stored and executed in a distributed manner. The medium is readable by a computer, stored in a memory, and executable on a processor.

본 발명에서 인용하는 공개 문헌, 특허 출원, 특허 등을 포함하는 모든 문헌들은 각 인용 문헌이 개별적으로 및 구체적으로 병합하여 나타내는 것 또는 본 발명에서 전체적으로 병합하여 나타낸 것과 동일하게 본 발명에 병합될 수 있다.All documents, including publications, patent applications, patents, etc., cited in the present invention may be incorporated into the present invention in the same manner as each cited document is shown individually and specifically in conjunction with one another, .

본 발명의 이해를 위하여, 도면에 도시된 바람직한 실시 예들에서 참조 부호를 기재하였으며, 본 발명의 실시 예들을 설명하기 위하여 특정 용어들을 사용하였으나, 특정 용어에 의해 본 발명이 한정되는 것은 아니며, 본 발명은 당업자에 있어서 통상적으로 생각할 수 있는 모든 구성 요소들을 포함할 수 있다.In order to facilitate understanding of the present invention, reference will be made to the preferred embodiments shown in the drawings, and specific terminology is used to describe the embodiments of the present invention. However, the present invention is not limited to the specific terminology, Lt; / RTI > may include all elements commonly conceivable by those skilled in the art.

본 발명은 기능적인 블록 구성들 및 다양한 처리 단계들로 나타내어질 수 있다. 이러한 기능 블록들은 특정 기능들을 실행하는 다양한 개수의 하드웨어 또는/및 소프트웨어 구성들로 구현될 수 있다. 예를 들어, 본 발명은 하나 이상의 마이크로프로세서들의 제어 또는 다른 제어 장치들에 의해서 다양한 기능들을 실행할 수 있는, 메모리, 프로세싱, 로직(logic), 룩업 테이블(look-up table) 등과 같은 직접 회로 구성들을 채용할 수 있다. 본 발명에의 구성 요소들이 소프트웨어 프로그래밍 또는 소프트웨어 요소들로 실행될 수 있는 것과 유사하게, 본 발명은 데이터 구조, 프로세스들, 루틴들 또는 다른 프로그래밍 구성들의 조합으로 구현되는 다양한 알고리즘을 포함하여, C, C++, 자바(Java), 어셈블러(assembler) 등과 같은 프로그래밍 또는 스크립팅 언어로 구현될 수 있다. 기능적인 측면들은 하나 이상의 프로세서들에서 실행되는 알고리즘으로 구현될 수 있다. 또한, 본 발명은 전자적인 환경 설정, 신호 처리, 및/또는 데이터 처리 등을 위하여 종래 기술을 채용할 수 있다. "매커니즘", "요소", "수단", "구성"과 같은 용어는 넓게 사용될 수 있으며, 기계적이고 물리적인 구성들로서 한정되는 것은 아니다. 상기 용어는 프로세서 등과 연계하여 소프트웨어의 일련의 처리들(routines)의 의미를 포함할 수 있다.The present invention may be represented by functional block configurations and various processing steps. These functional blocks may be implemented in a wide variety of hardware and / or software configurations that perform particular functions. For example, the present invention may include integrated circuit configurations, such as memory, processing, logic, look-up tables, etc., that may perform various functions by control of one or more microprocessors or other control devices Can be adopted. Similar to the components of the present invention that may be implemented with software programming or software components, the present invention may be implemented as a combination of C, C ++, and C ++, including various algorithms implemented with data structures, processes, routines, , Java (Java), assembler, and the like. Functional aspects may be implemented with algorithms running on one or more processors. Further, the present invention can employ conventional techniques for electronic environment setting, signal processing, and / or data processing. Terms such as "mechanism", "element", "means", "configuration" may be used broadly and are not limited to mechanical and physical configurations. The term may include the meaning of a series of routines of software in conjunction with a processor or the like.

본 발명에서 설명하는 특정 실행들은 일 실시 예들로서, 어떠한 방법으로도 본 발명의 범위를 한정하는 것은 아니다. 명세서의 간결함을 위하여, 종래 전자적인 구성들, 제어 시스템들, 소프트웨어, 상기 시스템들의 다른 기능적인 측면들의 기재는 생략될 수 있다. 또한, 도면에 도시된 구성 요소들 간의 선들의 연결 또는 연결 부재들은 기능적인 연결 및/또는 물리적 또는 회로적 연결들을 예시적으로 나타낸 것으로서, 실제 장치에서는 대체 가능하거나 추가의 다양한 기능적인 연결, 물리적인 연결, 또는 회로 연결들로서 나타내어질 수 있다. 또한, "필수적인", "중요하게" 등과 같이 구체적인 언급이 없다면 본 발명의 적용을 위하여 반드시 필요한 구성 요소가 아닐 수 있다.The specific acts described in the present invention are, by way of example, not intended to limit the scope of the invention in any way. For brevity of description, descriptions of conventional electronic configurations, control systems, software, and other functional aspects of such systems may be omitted. Also, the connections or connecting members of the lines between the components shown in the figures are illustrative of functional connections and / or physical or circuit connections, which may be replaced or additionally provided by a variety of functional connections, physical Connection, or circuit connections. Also, unless explicitly mentioned, such as "essential "," importantly ", etc., it may not be a necessary component for application of the present invention.

본 발명의 명세서(특히 특허청구범위에서)에서 "상기"의 용어 및 이와 유사한 지시 용어의 사용은 단수 및 복수 모두에 해당하는 것일 수 있다. 또한, 본 발명에서 범위(range)를 기재한 경우 상기 범위에 속하는 개별적인 값을 적용한 발명을 포함하는 것으로서(이에 반하는 기재가 없다면), 발명의 상세한 설명에 상기 범위를 구성하는 각 개별적인 값을 기재한 것과 같다. 마지막으로, 본 발명에 따른 방법을 구성하는 단계들에 대하여 명백하게 순서를 기재하거나 반하는 기재가 없다면, 상기 단계들은 적당한 순서로 행해질 수 있다. 반드시 상기 단계들의 기재 순서에 따라 본 발명이 한정되는 것은 아니다. 본 발명에서 모든 예들 또는 예시적인 용어(예들 들어, 등등)의 사용은 단순히 본 발명을 상세히 설명하기 위한 것으로서 특허청구범위에 의해 한정되지 않는 이상 상기 예들 또는 예시적인 용어로 인해 본 발명의 범위가 한정되는 것은 아니다. 또한, 당업자는 다양한 수정, 조합 및 변경이 부가된 특허청구범위 또는 그 균등물의 범주 내에서 설계 조건 및 팩터에 따라 구성될 수 있음을 알 수 있다.The use of the terms "above" and similar indication words in the specification of the present invention (particularly in the claims) may refer to both singular and plural. In addition, in the present invention, when a range is described, it includes the invention to which the individual values belonging to the above range are applied (unless there is contradiction thereto), and each individual value constituting the above range is described in the detailed description of the invention The same. Finally, the steps may be performed in any suitable order, unless explicitly stated or contrary to the description of the steps constituting the method according to the invention. The present invention is not necessarily limited to the order of description of the above steps. The use of all examples or exemplary language (e.g., etc.) in this invention is for the purpose of describing the present invention only in detail and is not to be limited by the scope of the claims, It is not. It will also be appreciated by those skilled in the art that various modifications, combinations, and alterations may be made depending on design criteria and factors within the scope of the appended claims or equivalents thereof.

Claims (7)

Translated fromKorean사용자의 입력이 획득됨에 따라, 상기 VR 공간 상에 검색창을 표시하는 단계;

상기 표시된 검색창을 통해 객체에 대한 검색 요청이 수신됨에 따라, 상기 객체에 관한 정보를 검색하는 단계;

상기 객체에 관한 정보를 검색하는 동안, 상기 VR 공간 상에 적어도 하나의 광고를 표시하는 단계; 및

상기 검색이 완료됨에 따라, 상기 적어도 하나의 광고의 표시를 중단하고, 상기 검색된 객체에 관한 정보를 상기 VR 공간 상에 표시하는 단계를 포함하는 방법.A method for providing a user interface (UI) in a VR space by a device,

Displaying a search window on the VR space as the user's input is obtained;

Retrieving information about the object upon receiving a search request for the object through the displayed search window;

Displaying at least one advertisement on the VR space while searching for information about the object; And

Stopping the display of the at least one advertisement as the search is completed, and displaying information about the searched object on the VR space.

상기 사용자의 프로파일 및 이전에 검색 요청된 적어도 하나의 객체에 관한 히스토리 정보에 기초하여, 복수의 광고들 중 상기 적어도 하나의 광고를 선택하는 단계를 더 포함하는 방법.The method according to claim 1,

Further comprising selecting the at least one of the plurality of advertisements based on the user's profile and the history information about the at least one object previously requested to be searched.

상기 적어도 하나의 광고를 구성하는 이미지를 기 설정된 방향으로 이동시키는 단계를 포함하고,

상기 이미지의 이동 속도는, 상기 객체에 대한 검색의 종료 시간이 가까워질수록 빨라지는, 방법.2. The method of claim 1,

And moving an image constituting the at least one advertisement in a predetermined direction,

Wherein the moving speed of the image is faster as the ending time of the search for the object approaches.

상기 객체에 관한 정보 검색 중, 상기 사용자로부터 표시된 적어도 하나의 광고를 선택하는 선택 입력이 수신되는 경우, 상기 선택된 광고의 제품에 관한 정보를 상기 VR 공간 상에 표시하는 단계를 더 포함하는 방법.The method according to claim 1,

Further comprising displaying, during retrieval of information about the object, information on a product of the selected advertisement on the VR space when a selection input is received that selects at least one advertisement displayed from the user.

상기 객체에 대한 검색이 완료된 경우, 상기 검색 결과와 상기 선택된 광고의 제품에 관한 정보를 함께 상기 VR 공간 상에 표시하는 방법.5. The method of claim 4,

And when the search for the object is completed, displaying the search result and information on the product of the selected advertisement together on the VR space.

상기 사용자의 제스쳐를 포함하고,

상기 검색창은,

상기 사용자의 제스쳐에 따라, 상기 검색창의 크기, 위치 및 형태가 결정되는 방법.The method of claim 1,

A gesture of the user,

The search window includes:

Wherein the size, position, and shape of the search window are determined according to the gesture of the user.

사용자의 입력을 획득하는 센싱부;

상기 사용자의 입력이 획득됨에 따라, 상기 VR 공간 상에 검색창을 표시하는 출력부; 및

상기 표시된 검색창을 통해 객체에 대한 검색 요청이 수신됨에 따라, 상기 객체에 관한 정보를 검색하고, 상기 객체에 관한 정보를 검색하는 동안, 상기 VR 공간 상에 적어도 하나의 광고를 표시하며, 상기 검색이 완료됨에 따라, 상기 적어도 하나의 광고의 표시를 중단하는 프로세서를 포함하고,

상기 출력부는,

상기 검색된 객체에 관한 정보를 상기 VR 공간 상에 표시하는 디바이스.1. A device for providing a user interface (UI) in a VR space,

A sensing unit for acquiring a user's input;

An output unit for displaying a search window on the VR space as the input of the user is acquired; And

Searching for information about the object as the search request for the object is received through the displayed search window, displaying at least one advertisement on the VR space while searching for information about the object, And stopping the display of the at least one advertisement,

The output unit includes:

And displays information about the searched object on the VR space.

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR20160050121 | 2016-04-25 | ||

| KR1020160050121 | 2016-04-25 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| KR20170121719Atrue KR20170121719A (en) | 2017-11-02 |

Family

ID=60159900

Family Applications (4)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020170053231AExpired - Fee RelatedKR101894021B1 (en) | 2016-04-25 | 2017-04-25 | Method and device for providing content and recordimg medium thereof |

| KR1020170053230ACeasedKR20170121719A (en) | 2016-04-25 | 2017-04-25 | Method and device for providing user interface in the virtual reality space and recordimg medium thereof |

| KR1020170053229AActiveKR101981774B1 (en) | 2016-04-25 | 2017-04-25 | Method and device for providing user interface in the virtual reality space and recordimg medium thereof |

| KR1020170053232AExpired - Fee RelatedKR101894022B1 (en) | 2016-04-25 | 2017-04-25 | Method and device for payment processing in virtual reality space |

Family Applications Before (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020170053231AExpired - Fee RelatedKR101894021B1 (en) | 2016-04-25 | 2017-04-25 | Method and device for providing content and recordimg medium thereof |

Family Applications After (2)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020170053229AActiveKR101981774B1 (en) | 2016-04-25 | 2017-04-25 | Method and device for providing user interface in the virtual reality space and recordimg medium thereof |

| KR1020170053232AExpired - Fee RelatedKR101894022B1 (en) | 2016-04-25 | 2017-04-25 | Method and device for payment processing in virtual reality space |

Country Status (2)

| Country | Link |

|---|---|

| KR (4) | KR101894021B1 (en) |

| WO (1) | WO2017188696A1 (en) |

Families Citing this family (14)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR102067493B1 (en)* | 2018-01-02 | 2020-01-17 | 주식회사 한글과컴퓨터 | Hmd device for displaying vr based presentation document and operating method thereof |

| CN108227927B (en)* | 2018-01-09 | 2021-07-23 | 北京小米移动软件有限公司 | VR-based product display method, device and electronic equipment |

| KR20190104753A (en)* | 2018-03-02 | 2019-09-11 | 주식회사 브이알이지이노베이션 | Method and Apparatus for providing virtual reality cinema service |

| KR102084970B1 (en)* | 2018-05-02 | 2020-03-05 | (주)포트러시 | Virtual reality viewing method and virtual reality viewing system |

| KR102346681B1 (en)* | 2019-01-10 | 2022-01-03 | 제이에스씨(주) | System for health care service for realistic experience based on virtual reality and augmented reality |

| KR102389335B1 (en)* | 2019-04-01 | 2022-04-20 | 주식회사 케이티 | Apparatus and method for displaying videoes of a plurality of broadcast channels |

| KR102298101B1 (en)* | 2019-07-31 | 2021-09-02 | 박준영 | System of Selling Products for Adult and Driving Method Thereof |

| KR102272503B1 (en)* | 2020-09-18 | 2021-07-02 | 주식회사 메이크잇 | Method and system for trading financial product through head mounted display device |

| KR102272841B1 (en)* | 2020-11-27 | 2021-07-06 | 주식회사 비욘드테크 | System for providing broadcast video and billing settlement for providing 360-degree broadcast video content service and method thereof |

| TWI802909B (en)* | 2021-06-15 | 2023-05-21 | 兆豐國際商業銀行股份有限公司 | Financial transaction system and operation method thereof |

| KR102671635B1 (en)* | 2021-09-15 | 2024-06-05 | 사회복지법인 삼성생명공익재단 | Method, Computer Program And System For Biofeedback Using Video Content |

| KR102627728B1 (en)* | 2021-11-02 | 2024-01-23 | 주식회사 엘지유플러스 | Metaverse personalized content creation and authentication method and apparutus and system therefor |

| US20240365175A1 (en)* | 2023-04-26 | 2024-10-31 | Samsung Electronics Co., Ltd. | Metaverse services with network slicing |

| KR102654350B1 (en)* | 2023-04-28 | 2024-04-03 | 주식회사 젭 | Method and system for controlling access to specific area in metaverse space based on blockchain-recorded data |

Family Cites Families (19)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20020074349A (en)* | 2001-03-20 | 2002-09-30 | 엘지전자주식회사 | service system for making of homepage and operation method of this system |

| KR20020076973A (en)* | 2001-03-31 | 2002-10-11 | 데이타박스(주) | A cookig and food analizing system for using a fuzzy-neural networe and a method thereof |

| KR100408989B1 (en)* | 2002-10-08 | 2003-12-11 | Robopia Co Ltd | Running machine and operating system and method thereof |

| KR20060134290A (en)* | 2005-06-22 | 2006-12-28 | 원용진 | Invocation Method of Web-based Information Retrieval Means and Initiation System of Web-based Information Retrieval Means |

| KR100953826B1 (en)* | 2007-08-14 | 2010-04-20 | 광주과학기술원 | Portable terminal having user health management function and user health management method using same |

| KR100952394B1 (en)* | 2007-12-26 | 2010-04-14 | 에스케이커뮤니케이션즈 주식회사 | Space Management Method for Virtual Reality Service |

| JP2011039860A (en)* | 2009-08-13 | 2011-02-24 | Nomura Research Institute Ltd | Conversation system, conversation method, and computer program using virtual space |

| KR20110131680A (en)* | 2010-05-31 | 2011-12-07 | 영남이공대학 산학협력단 | Virtual Internet Shopping Mall Service System Using 3D Virtual Reality Technology |

| KR101505060B1 (en)* | 2010-08-24 | 2015-03-26 | 한국전자통신연구원 | System and method for providing virtual reality linking service |

| KR20120075565A (en)* | 2010-12-15 | 2012-07-09 | 고스트리트(주) | Mobile sports guide system and method using augmented reality |

| KR20140065180A (en)* | 2012-11-21 | 2014-05-29 | 한국전자통신연구원 | Apparatus and method for providing user experiential contents based on real time broadcast contents |

| KR20160002681A (en)* | 2013-01-16 | 2016-01-08 | 인썸(인스티튜트 내셔날 드 라 싼테 에 드 라 리셰르셰메디칼르) | A soluble fibroblast growth factor receptor 3 (fgr3) polypeptide for use in the prevention or treatment of skeletal growth retardation disorders |

| KR20140135276A (en)* | 2013-05-07 | 2014-11-26 | (주)위메이드엔터테인먼트 | Method and Apparatus for processing a gesture input on a game screen |

| JP2015177403A (en)* | 2014-03-17 | 2015-10-05 | セイコーエプソン株式会社 | Head-mounted display device and method of controlling head-mounted display device |

| KR101569465B1 (en)* | 2013-07-05 | 2015-11-17 | 서용창 | Method for transmitting a message, method for selling a message box and computer readable recording medium storing program for the same |

| KR101517436B1 (en)* | 2013-08-30 | 2015-05-06 | 주식회사 지스푼 | Method and system for providing augmented reality |

| KR101878144B1 (en)* | 2013-11-06 | 2018-07-13 | 엘지전자 주식회사 | An Apparatus and Method of Providing User Interface on Head Mounted Display and a Head Mounted Display Thereof |

| US10203762B2 (en)* | 2014-03-11 | 2019-02-12 | Magic Leap, Inc. | Methods and systems for creating virtual and augmented reality |

| KR102227659B1 (en)* | 2014-03-12 | 2021-03-15 | 삼성전자주식회사 | System and method for displaying vertual image via head mounted device |

- 2017

- 2017-04-25KRKR1020170053231Apatent/KR101894021B1/ennot_activeExpired - Fee Related

- 2017-04-25WOPCT/KR2017/004365patent/WO2017188696A1/ennot_activeCeased

- 2017-04-25KRKR1020170053230Apatent/KR20170121719A/ennot_activeCeased

- 2017-04-25KRKR1020170053229Apatent/KR101981774B1/enactiveActive

- 2017-04-25KRKR1020170053232Apatent/KR101894022B1/ennot_activeExpired - Fee Related

Also Published As

| Publication number | Publication date |

|---|---|

| KR101894022B1 (en) | 2018-08-31 |

| KR20170121721A (en) | 2017-11-02 |

| WO2017188696A1 (en) | 2017-11-02 |

| KR101981774B1 (en) | 2019-05-27 |

| KR20170121720A (en) | 2017-11-02 |

| KR20170121718A (en) | 2017-11-02 |

| KR101894021B1 (en) | 2018-08-31 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| KR20170121719A (en) | Method and device for providing user interface in the virtual reality space and recordimg medium thereof | |

| US11386600B2 (en) | System and method for displaying virtual image through HMD device | |

| US10101884B2 (en) | Wearable device and controlling method thereof | |

| US10080096B2 (en) | Information transmission method and system, and device | |

| CN105630282B (en) | Apparatus for adjusting window size and control method thereof | |

| US11915671B2 (en) | Eye gaze control of magnification user interface | |

| US20110319130A1 (en) | Mobile terminal and method of operation | |

| US11209930B2 (en) | Method of controlling device using various input types and device for performing the method | |

| KR102219910B1 (en) | Method and device for displaying contents | |

| KR102057196B1 (en) | Method and system for transmitting information, device and computer readable recording medium thereof | |

| KR102307349B1 (en) | Apparatus and method for search | |

| KR102840430B1 (en) | Electronic device and operating method for detecting a plane in an image | |

| US20200326786A1 (en) | Device and method of controlling device | |

| CN111666027B (en) | Methods for displaying an object and its device on a device | |

| US10853958B2 (en) | Method and device for acquiring depth information of object, and recording medium | |

| KR102317683B1 (en) | Method and device for processing an image and recordimg medium thereof | |

| KR102306535B1 (en) | Method for controlling device and the device | |

| KR102399589B1 (en) | Method and apparatus for displaying object and recording medium thereof | |

| KR20150121565A (en) | Method and apparatus for performing mirroring service | |

| KR20160023567A (en) | Method and apparatus for providing a summrized content to users | |

| KR20180083131A (en) | Display apparatus and method for controlling the display apparatus thereof | |

| KR20180079759A (en) | Method and terminal for recognizing a text | |

| AU2014213152A1 (en) | Method of performing function of device and device for performing the method |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A201 | Request for examination | ||

| PA0109 | Patent application | Patent event code:PA01091R01D Comment text:Patent Application Patent event date:20170425 | |

| PA0201 | Request for examination | ||

| PG1501 | Laying open of application | ||

| E902 | Notification of reason for refusal | ||

| PE0902 | Notice of grounds for rejection | Comment text:Notification of reason for refusal Patent event date:20180105 Patent event code:PE09021S01D | |

| E90F | Notification of reason for final refusal | ||

| PE0902 | Notice of grounds for rejection | Comment text:Final Notice of Reason for Refusal Patent event date:20180629 Patent event code:PE09021S02D | |

| E601 | Decision to refuse application | ||

| E801 | Decision on dismissal of amendment | ||

| PE0601 | Decision on rejection of patent | Patent event date:20190225 Comment text:Decision to Refuse Application Patent event code:PE06012S01D Patent event date:20180629 Comment text:Final Notice of Reason for Refusal Patent event code:PE06011S02I Patent event date:20180105 Comment text:Notification of reason for refusal Patent event code:PE06011S01I | |

| PE0801 | Dismissal of amendment | Patent event code:PE08012E01D Comment text:Decision on Dismissal of Amendment Patent event date:20190225 Patent event code:PE08011R01I Comment text:Amendment to Specification, etc. Patent event date:20181001 Patent event code:PE08011R01I Comment text:Amendment to Specification, etc. Patent event date:20180305 |