KR20170069096A - Driver Assistance Apparatus and Vehicle Having The Same - Google Patents

Driver Assistance Apparatus and Vehicle Having The SameDownload PDFInfo

- Publication number

- KR20170069096A KR20170069096AKR1020150176349AKR20150176349AKR20170069096AKR 20170069096 AKR20170069096 AKR 20170069096AKR 1020150176349 AKR1020150176349 AKR 1020150176349AKR 20150176349 AKR20150176349 AKR 20150176349AKR 20170069096 AKR20170069096 AKR 20170069096A

- Authority

- KR

- South Korea

- Prior art keywords

- vehicle

- information

- unit

- vehicle driving

- processor

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Withdrawn

Links

- 238000004891communicationMethods0.000claimsabstractdescription64

- 230000033001locomotionEffects0.000claimsabstractdescription12

- 238000000034methodMethods0.000claimsdescription41

- 230000002093peripheral effectEffects0.000claimsdescription6

- 239000003086colorantSubstances0.000claims1

- 230000006870functionEffects0.000description26

- 238000012544monitoring processMethods0.000description17

- 238000012545processingMethods0.000description17

- 238000001514detection methodMethods0.000description15

- 238000005516engineering processMethods0.000description14

- 238000010586diagramMethods0.000description11

- 230000003287optical effectEffects0.000description11

- 230000001133accelerationEffects0.000description9

- 238000007781pre-processingMethods0.000description8

- 230000011218segmentationEffects0.000description7

- 230000007774longtermEffects0.000description6

- 230000008569processEffects0.000description6

- 230000008859changeEffects0.000description5

- 239000000446fuelSubstances0.000description5

- 239000011521glassSubstances0.000description5

- 239000007788liquidSubstances0.000description5

- 238000012795verificationMethods0.000description5

- 239000004973liquid crystal related substanceSubstances0.000description4

- 230000005236sound signalEffects0.000description4

- 239000000725suspensionSubstances0.000description4

- 238000003491arrayMethods0.000description3

- 230000005540biological transmissionEffects0.000description3

- 238000002485combustion reactionMethods0.000description3

- 238000004378air conditioningMethods0.000description2

- 238000004458analytical methodMethods0.000description2

- 238000010276constructionMethods0.000description2

- 230000000694effectsEffects0.000description2

- 239000000284extractSubstances0.000description2

- 230000001815facial effectEffects0.000description2

- 239000012530fluidSubstances0.000description2

- 230000014509gene expressionEffects0.000description2

- 230000001678irradiating effectEffects0.000description2

- 238000010295mobile communicationMethods0.000description2

- 238000012986modificationMethods0.000description2

- 230000004048modificationEffects0.000description2

- 239000007921spraySubstances0.000description2

- 238000005507sprayingMethods0.000description2

- 230000003068static effectEffects0.000description2

- 238000012706support-vector machineMethods0.000description2

- 239000010409thin filmSubstances0.000description2

- UFHFLCQGNIYNRP-UHFFFAOYSA-NHydrogenChemical compound[H][H]UFHFLCQGNIYNRP-UHFFFAOYSA-N0.000description1

- 125000002066L-histidyl groupChemical group[H]N1C([H])=NC(C([H])([H])[C@](C(=O)[*])([H])N([H])[H])=C1[H]0.000description1

- 206010039203Road traffic accidentDiseases0.000description1

- XUIMIQQOPSSXEZ-UHFFFAOYSA-NSiliconChemical compound[Si]XUIMIQQOPSSXEZ-UHFFFAOYSA-N0.000description1

- 208000027418Wounds and injuryDiseases0.000description1

- 230000003044adaptive effectEffects0.000description1

- 238000013459approachMethods0.000description1

- 238000013528artificial neural networkMethods0.000description1

- 230000003190augmentative effectEffects0.000description1

- 230000008901benefitEffects0.000description1

- 230000004397blinkingEffects0.000description1

- 238000004364calculation methodMethods0.000description1

- 238000006243chemical reactionMethods0.000description1

- 238000012790confirmationMethods0.000description1

- 230000006378damageEffects0.000description1

- 238000011161developmentMethods0.000description1

- 230000018109developmental processEffects0.000description1

- 239000002803fossil fuelSubstances0.000description1

- 239000007789gasSubstances0.000description1

- 231100001261hazardousToxicity0.000description1

- 239000001257hydrogenSubstances0.000description1

- 229910052739hydrogenInorganic materials0.000description1

- 230000001939inductive effectEffects0.000description1

- 208000014674injuryDiseases0.000description1

- 238000005259measurementMethods0.000description1

- 239000003595mistSubstances0.000description1

- 230000000116mitigating effectEffects0.000description1

- 238000002156mixingMethods0.000description1

- 230000007935neutral effectEffects0.000description1

- 230000037361pathwayEffects0.000description1

- 230000010363phase shiftEffects0.000description1

- 230000009467reductionEffects0.000description1

- 230000008054signal transmissionEffects0.000description1

- 229910052710siliconInorganic materials0.000description1

- 239000010703siliconSubstances0.000description1

- 239000007787solidSubstances0.000description1

- 239000013589supplementSubstances0.000description1

- 230000000007visual effectEffects0.000description1

- XLYOFNOQVPJJNP-UHFFFAOYSA-NwaterSubstancesOXLYOFNOQVPJJNP-UHFFFAOYSA-N0.000description1

Images

Classifications

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W50/00—Details of control systems for road vehicle drive control not related to the control of a particular sub-unit, e.g. process diagnostic or vehicle driver interfaces

- B60W50/0098—Details of control systems ensuring comfort, safety or stability not otherwise provided for

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60R—VEHICLES, VEHICLE FITTINGS, OR VEHICLE PARTS, NOT OTHERWISE PROVIDED FOR

- B60R21/00—Arrangements or fittings on vehicles for protecting or preventing injuries to occupants or pedestrians in case of accidents or other traffic risks

- B60R21/01—Electrical circuits for triggering passive safety arrangements, e.g. airbags, safety belt tighteners, in case of vehicle accidents or impending vehicle accidents

- B60R21/013—Electrical circuits for triggering passive safety arrangements, e.g. airbags, safety belt tighteners, in case of vehicle accidents or impending vehicle accidents including means for detecting collisions, impending collisions or roll-over

- B60R21/0134—Electrical circuits for triggering passive safety arrangements, e.g. airbags, safety belt tighteners, in case of vehicle accidents or impending vehicle accidents including means for detecting collisions, impending collisions or roll-over responsive to imminent contact with an obstacle, e.g. using radar systems

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W10/00—Conjoint control of vehicle sub-units of different type or different function

- B60W10/18—Conjoint control of vehicle sub-units of different type or different function including control of braking systems

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W30/00—Purposes of road vehicle drive control systems not related to the control of a particular sub-unit, e.g. of systems using conjoint control of vehicle sub-units

- B60W30/08—Active safety systems predicting or avoiding probable or impending collision or attempting to minimise its consequences

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W50/00—Details of control systems for road vehicle drive control not related to the control of a particular sub-unit, e.g. process diagnostic or vehicle driver interfaces

- B60W50/08—Interaction between the driver and the control system

- B60W50/14—Means for informing the driver, warning the driver or prompting a driver intervention

- B60W2050/0081—

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W50/00—Details of control systems for road vehicle drive control not related to the control of a particular sub-unit, e.g. process diagnostic or vehicle driver interfaces

- B60W50/08—Interaction between the driver and the control system

- B60W50/14—Means for informing the driver, warning the driver or prompting a driver intervention

- B60W2050/146—Display means

- B60W2550/22—

Landscapes

- Engineering & Computer Science (AREA)

- Automation & Control Theory (AREA)

- Mechanical Engineering (AREA)

- Transportation (AREA)

- Human Computer Interaction (AREA)

- Chemical & Material Sciences (AREA)

- Combustion & Propulsion (AREA)

- Radar, Positioning & Navigation (AREA)

- Remote Sensing (AREA)

- Traffic Control Systems (AREA)

Abstract

Translated fromKoreanDescription

Translated fromKorean본 발명은 차량에 구비되는 차량 운전 보조장치, 그 제어 방법 및 이를 포함하는 차량에 관한 것이다.BACKGROUND OF THE

차량은 탑승하는 사용자가 원하는 방향으로 이동시키는 장치이다. 대표적으로 자동차를 예를 들 수 있다.A vehicle is a device that moves a user in a desired direction by a boarding user. Typically, automobiles are examples.

자동차는 사용되는 원동기에 따른 분류에 의하면 내연기관(internal combustion engine) 자동차, 외연기관(external combustion engine) 자동차, 가스터빈(gas turbine) 자동차 또는 전기자동차(electric vehicle) 등이 있다.The automobiles are internal combustion engine cars, external combustion engine cars, gas turbine cars or electric vehicles according to the prime mover used.

전기자동차는 전기를 에너지 삼아 전기 모터를 돌리는 자동차를 뜻하며, 순수 전기자동차, 하이브리드 전기차(HEV), 플러그인 하이브리드 전기차(PHEV), 수소연료전지차(FCEV) 등이 있다.Electric vehicles are electric vehicles that use electric energy to drive electric motors. They include pure electric vehicles, hybrid electric vehicles (HEV), plug-in hybrid electric vehicles (PHEV), and hydrogen fuel cell vehicles (FCEV).

한편, 최근 운전자, 보행자 등의 안전이나 편의를 위해 지능형 자동차(Smart Vehicle)의 개발이 활발히 되고 있다.Meanwhile, in recent years, the development of an intelligent vehicle (Smart Vehicle) has been actively developed for safety and convenience of drivers, pedestrians, and the like.

지능형 자동차는 정보기술(IT) 기술을 융합한 최첨단 자동차로 스마트 자동차라고도 한다. 지능형 자동차는 자동차 자체의 첨단 시스템 도입은 물론 지능형 교통 시스템(ITS)과의 연동을 통한 최적의 교통 효율을 제공한다.Intelligent automobiles are also called smart automobiles, cutting-edge vehicles that combine information technology (IT) technology. Intelligent automobiles provide optimum transportation efficiency through interworking with intelligent transportation system (ITS) as well as introducing advanced system of automobile itself.

예를 들어, 지능형 자동차는 ACC(Adaptive Cruise Control), 장애물 감지, 충돌 감지 또는 경감 장치 등과 같은 안전에 관련된 핵심 기술의 개발로 운전자, 탑승자 만 아니라 보행자의 안전까지 극대화하는 기술적 장점을 갖고 있다.For example, intelligent vehicles have the technical advantage of maximizing the safety of the occupants as well as the occupants by developing key safety-related technologies such as Adaptive Cruise Control (ACC), obstacle detection, collision detection or mitigation.

또한, 최근 인접해서 달리는 자동차끼리 자동으로 무선 통신을 주고받으면서 운전을 하도록 유도하는 V2V(Vehicle to Vehicle) 기술이 주목 받고 있다. 이러한 V2V 기술을 통해, 자동차들은 스스로 도로 위에서 서로 일정한 거리를 유지하며 달릴 수 있다. 자세히, 근처 차량 위치와 속도 정보 등을 실시간으로 공유하여 주행함으로써, 갑작스러운 교통사고의 예방이 가능할 수 있다.In addition, recently, V2V (Vehicle to Vehicle) technology which attracts automobiles to run while exchanging wireless communication between automobiles running adjacent to each other is getting attention. With this V2V technology, automobiles can run at constant distance from each other on the road. In detail, it is possible to prevent a sudden traffic accident by sharing the location and speed information of the nearby vehicle in real time.

한편, 차량 주행 중에 발생하는 사고는 사각지대에서 갑자기 진입한 오브젝트에 의해 많이 발생하게 된다.On the other hand, accidents that occur while driving are caused by objects that have suddenly entered the blind spot.

즉, 현재의 차량 기술로는 사각 지대에서 진입하는 오브젝트에 대한 인식이 어려우며, 무단횡단하는 보행자에 대한 방어 운전이 어려운 문제점이 있다.That is, it is difficult to recognize an object entering from a blind spot with current vehicle technology, and it is difficult to defend against an unauthorized traverse.

본 발명에 따른 실시 예에서는, 차선에 진입한 오브젝트 정보를 인식 및 추적하여 이에 따른 위험 정보를 주변 차량에게 알릴 수 있는 차량 운전 보조장치 및 이를 포함하는 차량을 제공한다.The embodiments of the present invention provide a vehicle driving assistant device capable of recognizing and tracking object information that has entered a lane and informing neighboring vehicles of the danger information accordingly, and a vehicle including the same.

또한, 본 발명에 따른 실시 예에서는, 차선에 진입한 오브젝트에게 주변 차량의 접근을 알리는 경고 정보를 제공할 수 있는 차량 운전 보조장치 및 이를 포함하는 차량을 제공한다.In addition, the embodiment of the present invention provides a vehicle driving assistant device capable of providing warning information informing an approaching object to an object that has entered a lane, and a vehicle including the same.

제안되는 실시 예에서 이루고자 하는 기술적 과제들은 이상에서 언급한 기술적 과제들로 제한되지 않으며, 언급되지 않은 또 다른 기술적 과제들은 아래의 기재로부터 제안되는 실시 예가 속하는 기술분야에서 통상의 지식을 가진 자에게 명확하게 이해될 수 있을 것이다.It is to be understood that the technical objectives to be achieved by the embodiments are not limited to the technical matters mentioned above and that other technical subjects not mentioned are apparent to those skilled in the art to which the embodiments proposed from the following description belong, It can be understood.

본 발명의 실시 예에 따른 차량 운전 보조장치는 차량 주변의 제 1 오브젝트를 감지하는 센서부; 상기 감지된 제 1 오브젝트를 인식하고, 상기 인식한 제 1 오브젝트의 이동 상태를 기준으로 상기 제 1 오브젝트에 대한 위험 정보를 생성하는 프로세서; 및 상기 프로세서를 통해 생성된 위험 정보를 외부로 전송하는 통신부를 포함한다.A vehicle driving assist apparatus according to an embodiment of the present invention includes: a sensor unit for sensing a first object around a vehicle; A processor for recognizing the sensed first object and generating risk information for the first object based on the recognized movement state of the first object; And a communication unit for transmitting the risk information generated through the processor to the outside.

또한, 차량 주변에 존재하는 오브젝트를 감지하는 센서부; 상기 차량 주변의 교통 상황에 대한 이미지를 표시하는 표시부; 및, 상기 오브젝트가 감지되면, 상기 감지된 오브젝트의 위치를 기준으로 상기 이미지 상에 상기 오브젝트의 정보가 표시되도록 하는 프로세서를 포함하고, 상기 프로세서는, 상기 이미지를 복수의 영역으로 분할하고, 상기 분할된 영역 중 상기 오브젝트의 위치에 대응하는 영역에 상기 오브젝트의 정보를 표시하여, 상기 오브젝트의 정보는, 상기 오브젝트의 위험 정도에 따라 서로 다른 방법으로 상기 이미지 상에 표시된다.A sensor unit for sensing an object existing in the vicinity of the vehicle; A display unit for displaying an image of a traffic situation around the vehicle; And a processor for, when the object is sensed, displaying information of the object on the image based on the position of the sensed object, wherein the processor divides the image into a plurality of regions, The information of the object is displayed in an area corresponding to the position of the object among the areas, and information of the object is displayed on the image in different ways according to the degree of danger of the object.

본 발명에 따른 실시 예에 의하면, 카메라 영상을 통해 차선에 진입한 오브젝트(예를 들어, 보행자, 자전거 및 오토바이 등)를 검출하고, 상기 검출한 오브젝트의 이동 방향을 예측하여 주변 차량 및 보행자에 위험 정보를 전달해줌으로써, 예측하기 어려운 위치에서 진입하는 보행자의 사고 발생률을 감소시킬 수 있다.According to the embodiment of the present invention, it is possible to detect an object (for example, a pedestrian, a bicycle, a motorcycle or the like) that has entered a lane through a camera image, predict a moving direction of the detected object, By transmitting the information, it is possible to reduce the accident occurrence rate of the pedestrian entering from a position difficult to predict.

또한, 본 발명에 따른 실시 예에 의하면 차량간 통신 기술 및 보행자 어시스트 기능을 활용함으로써, 보다 안정적인 주행 환경을 제공할 수 있다.Further, according to the embodiment of the present invention, by utilizing the inter-vehicle communication technology and the pedestrian assist function, a more stable driving environment can be provided.

도 1은 본 발명의 실시예에 따른 차량 운전 보조장치를 구비하는 차량의 외관을 나타낸다.

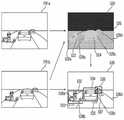

도 2는 본 발명의 실시예에 따른 차량 운전 보조장치의 블록도를 나타낸 것이고, 도 3은 본 발명의 실시예에 따른 센서부를 구비한 차량의 평면을 나타낸 것이며, 도 4는 본 발명의 실시예에 따른 카메라의 일례를 나타낸 도면이며, 도 5 및 도 6은 본 발명의 실시예에 따른 카메라의 영상에서 영상 정보를 생성하는 방법의 일례를 설명하기 위한 도면들이고, 도 7은 본 발명의 실시예에 따른 인디케이터 출력부를 설명하기 위한 도면이다.

도 8은 본 발명의 실시 예에 따른 차량 운전 보조장치(100)의 위험 정보 전송 방법을 단계별로 설명하기 위한 흐름도이다.

도 9는 본 발명의 실시 예에 따른 사각지대에서 진입하는 오브젝트를 설명하기 위한 도면이고, 도 10은 본 발명의 실시 예에 따른 무단횡단하는 오브젝트 또는 인식 불가한 위치에서 추월하는 오브젝트를 설명하기 위한 도면이다.

도 11은 본 발명의 실시 예에 따른 통신 구조를 설정하기 위한 도면이다.

도 12는 본 발명의 실시 예에 따른 서버(500)와 차량들 사이의 통신 구조를 설명하기 위한 도면이다.

도 13은 본 발명의 실시 예에 따른 위험 정도를 설명하기 위한 도면이다.

도 14는 본 발명의 실시 예에 따른 내부 디스플레이부를 통해 표시되는 위험 정보를 설명하기 위한 도면이다.

도 15 내지 도 19는 본 발명의 실시 예에 따른 알림 정보를 설명하기 위한 도면이다.

도 20 및 도 21은 본 발명의 실시 예에 따른 교통 상황 이미지를 나타낸 도면이다.

도 22는 전술한 차량 운전 보조장치를 포함하는 도 1 차량의 내부 블록도의 일 예이다.BRIEF DESCRIPTION OF THE DRAWINGS Fig. 1 shows an appearance of a vehicle equipped with a vehicle driving assist system according to an embodiment of the present invention.

FIG. 2 is a block diagram of a vehicle driving assist system according to an embodiment of the present invention. FIG. 3 is a plan view of a vehicle having a sensor unit according to an embodiment of the present invention. 5 and 6 are views for explaining an example of a method of generating image information from a camera image according to an embodiment of the present invention, FIG. 7 is a diagram for explaining an indicator output unit according to FIG.

8 is a flowchart for explaining steps of transmitting the risk information of the

FIG. 9 is a view for explaining an object entering in a blind spot according to an embodiment of the present invention, FIG. 10 is a view for explaining an object which is traversed in an unauthorized position or in an unrecognizable position according to an embodiment of the present invention FIG.

11 is a diagram for setting a communication structure according to an embodiment of the present invention.

12 is a view for explaining a communication structure between the

13 is a diagram for explaining the degree of danger according to the embodiment of the present invention.

14 is a view for explaining danger information displayed through an internal display unit according to an embodiment of the present invention.

15 to 19 are diagrams for explaining notification information according to an embodiment of the present invention.

20 and 21 are views showing a traffic situation image according to an embodiment of the present invention.

Fig. 22 is an example of an internal block diagram of the vehicle of Fig. 1 including the above-described vehicle driving assist system.

이하, 첨부된 도면을 참조하여 본 명세서에 개시된 실시 예를 상세히 설명하되, 도면 부호에 관계없이 동일하거나 유사한 구성요소는 동일한 참조 번호를 부여하고 이에 대한 중복되는 설명은 생략하기로 한다. 이하의 설명에서 사용되는 구성요소에 대한 접미사 "모듈" 및 "부"는 명세서 작성의 용이함만이 고려되어 부여되거나 혼용되는 것으로서, 그 자체로 서로 구별되는 의미 또는 역할을 갖는 것은 아니다. 또한, 본 명세서에 개시된 실시 예를 설명함에 있어서 관련된 공지 기술에 대한 구체적인 설명이 본 명세서에 개시된 실시 예의 요지를 흐릴 수 있다고 판단되는 경우 그 상세한 설명을 생략한다. 또한, 첨부된 도면은 본 명세서에 개시된 실시 예를 쉽게 이해할 수 있도록 하기 위한 것일 뿐, 첨부된 도면에 의해 본 명세서에 개시된 기술적 사상이 제한되지 않으며, 본 발명의 사상 및 기술 범위에 포함되는 모든 변경, 균등물 내지 대체물을 포함하는 것으로 이해되어야 한다.Hereinafter, embodiments of the present invention will be described in detail with reference to the accompanying drawings, wherein like reference numerals are used to designate identical or similar elements, and redundant description thereof will be omitted. The suffix "module" and " part "for the components used in the following description are given or mixed in consideration of ease of specification, and do not have their own meaning or role. In the following description of the embodiments of the present invention, a detailed description of related arts will be omitted when it is determined that the gist of the embodiments disclosed herein may be blurred. It is to be understood that both the foregoing general description and the following detailed description are exemplary and explanatory and are intended to provide further explanation of the invention as claimed. , ≪ / RTI > equivalents, and alternatives.

제1, 제2 등과 같이 서수를 포함하는 용어는 다양한 구성요소들을 설명하는데 사용될 수 있지만, 상기 구성요소들은 상기 용어들에 의해 한정되지는 않는다. 상기 용어들은 하나의 구성요소를 다른 구성요소로부터 구별하는 목적으로만 사용된다.Terms including ordinals, such as first, second, etc., may be used to describe various elements, but the elements are not limited to these terms. The terms are used only for the purpose of distinguishing one component from another.

어떤 구성요소가 다른 구성요소에 "연결되어" 있다거나 "접속되어" 있다고 언급된 때에는, 그 다른 구성요소에 직접적으로 연결되어 있거나 또는 접속되어 있을 수도 있지만, 중간에 다른 구성요소가 존재할 수도 있다고 이해되어야 할 것이다. 반면에, 어떤 구성요소가 다른 구성요소에 "직접 연결되어" 있다거나 "직접 접속되어" 있다고 언급된 때에는, 중간에 다른 구성요소가 존재하지 않는 것으로 이해되어야 할 것이다.It is to be understood that when an element is referred to as being "connected" or "connected" to another element, it may be directly connected or connected to the other element, . On the other hand, when an element is referred to as being "directly connected" or "directly connected" to another element, it should be understood that there are no other elements in between.

단수의 표현은 문맥상 명백하게 다르게 뜻하지 않는 한, 복수의 표현을 포함한다.The singular expressions include plural expressions unless the context clearly dictates otherwise.

본 출원에서, "포함한다" 또는 "가지다" 등의 용어는 명세서상에 기재된 특징, 숫자, 단계, 동작, 구성요소, 부품 또는 이들을 조합한 것이 존재함을 지정하려는 것이지, 하나 또는 그 이상의 다른 특징들이나 숫자, 단계, 동작, 구성요소, 부품 또는 이들을 조합한 것들의 존재 또는 부가 가능성을 미리 배제하지 않는 것으로 이해되어야 한다.In the present application, the terms "comprises", "having", and the like are used to specify that a feature, a number, a step, an operation, an element, a component, But do not preclude the presence or addition of one or more other features, integers, steps, operations, elements, components, or combinations thereof.

본 명세서에서 기술되는 차량은, 자동차, 오토바이를 포함하는 개념일 수 있다. 이하에서는, 차량에 대해 자동차를 위주로 기술한다.The vehicle described herein may be a concept including a car, a motorcycle. Hereinafter, the vehicle will be described mainly with respect to the vehicle.

본 명세서에서 기술되는 차량은, 동력원으로서 엔진을 구비하는 내연기관 차량, 동력원으로서 엔진과 전기 모터를 구비하는 하이브리드 차량, 동력원으로서 전기 모터를 구비하는 전기 차량 등을 모두 포함하는 개념일 수 있다.The vehicle described in the present specification may be a concept including both an internal combustion engine vehicle having an engine as a power source, a hybrid vehicle having an engine and an electric motor as a power source, and an electric vehicle having an electric motor as a power source.

이하의 설명에서 차량의 좌측은 차량의 주행 방향의 좌측을 의미하고, 차량의 우측은 차량의 주행 방향의 우측을 의미한다.In the following description, the left side of the vehicle means the left side in the running direction of the vehicle, and the right side of the vehicle means the right side in the running direction of the vehicle.

이하의 설명에서 별도로 언급되지 않는 한 LHD(Left Hand Drive) 차량을 중심으로 설명한다.

Unless otherwise mentioned in the following description, the LHD (Left Hand Drive) vehicle will be mainly described.

이하, 도면들을 참조하여 실시예에 따른 차량 운전 보조장치에 대해 상세히 설명한다.DETAILED DESCRIPTION OF THE PREFERRED EMBODIMENTS Hereinafter, a vehicle driving assistance device according to an embodiment will be described in detail with reference to the drawings.

도 1은 본 발명의 실시예에 따른 차량 운전 보조장치를 구비하는 차량의 외관을 나타낸다.BRIEF DESCRIPTION OF THE DRAWINGS Fig. 1 shows an appearance of a vehicle equipped with a vehicle driving assist system according to an embodiment of the present invention.

도 1을 참조하면, 실시예에 따른 차량(700)은, 동력원에 의해 회전하는 바퀴(13FL, 13RL) 및 차량 운전 보조장치를 포함할 수 있다.Referring to Fig. 1, a

실시예에서 차량 운전 보조장치(100)는 별도의 장치로서, 차량(700)과 데이터 통신을 통해 필요 정보를 주고 받으며, 상기 차량(700)의 주변에 존재하는 주변 차량에게 필요 정보를 전송할 수 있다. 또한, 상기 차량 운전 보조장치(100)는 인디케이터 표시기능을 실행할 수 있다. 상기 인디케이터 표시 기능은, 상기 차량(700)의 주변에 존재하는 주변 차량에게 특정 오브젝트의 존재를 알리기 위한 기능일 수 있다. 또한, 상기 인디케이터 표시 기능은, 상기 차량(700)의 주변에 존재하는 오브젝트에게 상기 주변 차량의 접근을 알리기 위한 기능일 수 있다.In the embodiment, the vehicle

또한, 차량(700)의 유닛 중 일부의 집합을 차량 운전 보조장치(100)로 정의할 수도 있다. A set of some of the units of the

만약, 차량 운전 보조장치(100)가 별도의 장치일 때, 차량 운전 보조장치(100)의 각 유닛들(도 2 참조) 중 적어도 일부는 차량 운전 보조장치(100)에 포함되지 않고, 차량(700) 또는 차량(700)에 탑재된 다른 장치의 유닛일 수도 있다. 그리고 이러한 외부 유닛들은 차량 운전 보조장치(100)의 인터페이스부를 통해 데이터를 송수신함으로써, 차량 운전 보조장치(100)에 포함되는 것으로 이해할 수 있다.2) of the vehicle

또한, 차량 운전 보조장치(100)는 상기 차량(700)과 데이터를 주고 받는 기능뿐 아니라, 상기 차량(700)의 주변에 존재하는 주변 차량과도 데이터를 주고 받을 수 있다. 바람직하게, 상기 차량 운전 보조장치(100)는 자신이 획득한 오브젝트에 대한 위험 정보를 상기 차량(700)의 주변에서 주행 중안 다른 주변 차량에게 전달한다.In addition, the vehicle driving

다시 말해서, 상기 다른 주변 차량들은 상기 차량(700)에 의해 상기 오브젝트를 감지하지 못하는 상황이 발생할 수 있다. 따라서, 상기 차량 운전 보조장치(100)는 상기 오브젝트에 대한 위험 정보를 생성하고, 상기 생성한 위험 정보를 상기 차량(700)의 주변에 존재하는 다른 주변 차량들에게 전달하여, 상기 다른 주변 차량들이 상기 오브젝트의 존재를 인식할 수 있도록 한다.In other words, the other nearby vehicles may not be able to detect the object by the

이하 설명의 편의를 위하여, 실시예에 따른 차량 운전 보조장치(100)는 도 2에 도시한 각 유닛들을 직접 포함하는 것으로 설명한다.

For convenience of explanation, it is assumed that the vehicle driving

이러한 차량 운전 보조장치(100)는, 차량 주변의 오브젝트를 감지하고, 상기 감지한 오브젝트의 이동 상태를 기준으로 상기 오브젝트에 대한 위험 정보를 생성한다.The vehicle driving assistant device (100) senses an object in the vicinity of the vehicle, and generates danger information on the object based on the sensed movement state of the object.

이때, 상기 차량 운전 보조장치(100)는 상기 오브젝트의 이동 상태에 따라 상기 오브젝트의 위험 수준을 결정하고, 상기 결정한 위험 수준에 대한 정보를 포함하는 위험 정보를 생성한다.At this time, the vehicle driving

여기에서, 상기 오브젝트의 이동 상태는, 상기 오브젝트의 이동 방향 및 이동 속도 중 적어도 하나를 포함할 수 있다. 바람직하게, 상기 이동 상태는 상기 오브젝트의 이동 속도를 포함할 수 있다.Here, the moving state of the object may include at least one of moving direction and moving speed of the object. Preferably, the moving state may include a moving speed of the object.

그리고, 차량 운전 보조장치(100)는 상기 오브젝트의 이동 속도를 토대로 상기 오브젝트의 위험 수준을 결정하고, 상기 결정된 위험 수준에 대한 정보를 포함하여 상기 오브젝트에 대한 위험 정보를 생성한다.Then, the vehicle driving assistant (100) determines a risk level of the object based on the moving speed of the object, and generates risk information for the object, including information on the determined risk level.

상기 위험 수준은 아래의 표 1과 같이 정의될 수 있다.The risk level can be defined as shown in Table 1 below.

(보행자, 유모차, 자동차 등)Objects moving at low speed

(Pedestrian, stroller, car, etc.)

(자전거 또는 뛰는 보행자 등)Objects moving with speed

(Such as a bicycle or a running pedestrian)

(오토바이, 자동차 및 자전거 등)Objects passing at high speed

(Such as motorcycles, cars and bicycles)

상기에서, 위험 수준이 높을 수록 사고 시에 부상 위험이 클 수 있으며, 이에 따라 상기 차량 운전 보조장치(100)는 상기 오브젝트에 대한 위험 정보를 전달 시에 상기 위험 수준에 대한 정보를 포함시켜 전달한다.In the above, the higher the risk level, the greater the risk of injury in the event of an accident. Accordingly, the

그리고, 상기 차량 운전 보조장치(100)는 상기 차량(700)의 주변에 존재하는 주변 차량을 검출한다. 상기 주변 차량은 카메라를 통해 촬영된 영상을 이용하여 검출될 수 있으며, 이와 다르게 근접 센서와 같은 센서를 통해 검출될 수 있다.The vehicle driving assistant (100) detects a peripheral vehicle existing in the vicinity of the vehicle (700). The neighboring vehicle can be detected using an image photographed through a camera, or alternatively can be detected through a sensor such as a proximity sensor.

또한, 차량 운전 보조장치(100)는 상기 주변 차량이 검출되면, 상기 검출된 주변 차량으로 상기 생성한 위험 정보를 전송한다. 즉, 상기 주변 차량은 상기 차량(700)에 의해 가려진 상기 오브젝트의 존재를 감지하지 못할 수 있으며, 이에 따라 상기 차량 운전 보조장치(100)에서 상기 오브젝트를 감지하여 이에 따른 위험 정보를 상기 주변 차량에게 전달한다.Further, when the surrounding vehicle is detected, the vehicle driving

이때, 상기 차량 운전 보조장치(100)는 상기 검출된 모든 주변 차량에게 상기 위험 정보를 제공할 수 있으며, 이와 다르게 특정 주변 차량에게만 상기 위험 정보를 제공할 수 있다.At this time, the vehicle driving

즉, 상기 차량 운전 보조장치(100)는 상기 오브젝트의 이동 방향 및 이동 속도와, 상기 주변 차량의 위치, 이동 방향 및 이동 속도를 기준으로, 상기 주변 차량 중 상기 오브젝트의 위치로 이동 중인 인접 차량을 검출하고, 상기 검출한 인접 차량에게만 상기 위험 정보를 제공할 수 있다.That is, the vehicle driving

다시 말해서, 상기 차량 운전 보조장치(100)는 상기 오브젝트가 감지되어, 상기 오브젝트의 감지를 알리기 위한 알림 상황 검출시, 상기와 같은 위험 정보를 생성하여 주변 차량 또는 인접 차량에게 전송한다. 또한, 차량 운전 보조장치(100)는 상기 위험 정보의 존재를 알리기 위한 인디케이터(I) 및 상기 인디케이터의 표시방법을 결정하고, 상기 인디케이터(I)를 결정된 표시방법에 따라 출력하여, 위험 상황 등을 외부에 알려 사고를 미연에 방지하고 운전자가 원활한 주행을 수행하도록 협조를 구할 수 있다.In other words, the vehicle driving

이때, 상기 인디케이터(I)는 상기 차량 운전 보조장치(100)에서 결정된 알림 대상에게 경고 정보를 제공하기 위해 출력된다. 이때, 상기 알림 대상은, 상기 차량 운전 보조장치(100)에서 감지된 오브젝트일 수 있으며, 이와 다르게 상기 차량(700)의 주변에 존재하는 주변 차량 또는 인접 차량일 수 있다.At this time, the indicator I is output in order to provide warning information to the notification target determined in the vehicle driving

또한, 알림 상황은, 상기 차량(700)의 주위에서 특정 오브젝트가 존재하거나, 상기 오브젝트가 특정 방향으로 이동하여 접근하고 있는 상황 등을 포함할 수 있다.Also, the notification status may include a situation where a specific object exists around the

또한, 인디케이터 표시방법은, 인디케이터 표시위치, 크기, 명도, 채도, 색상, 위상 및 인디케이터 이미지 등을 결정하여 인디케이터를 차량 외부에 표시하는 다양한 방법을 의미한다.

In addition, the indicator display method refers to various methods of determining an indicator display position, size, brightness, saturation, color, phase, and indicator image and displaying the indicator outside the vehicle.

이하, 상기 위험 정보를 전송하기 위한 차량 운전 보조장치(100)를 구성하는 각 유닛에 대해 도 2 내지 도 7을 참조하여 상세히 설명한다.Hereinafter, each unit constituting the vehicle driving

도 2는 본 발명의 실시예에 따른 차량 운전 보조장치의 블록도를 나타낸 것이고, 도 3은 본 발명의 실시예에 따른 센서부를 구비한 차량의 평면을 나타낸 것이며, 도 4는 본 발명의 실시예에 따른 카메라의 일례를 나타낸 도면이며, 도 5 및 도 6은 본 발명의 실시예에 따른 카메라의 영상에서 영상 정보를 생성하는 방법의 일례를 설명하기 위한 도면들이고, 도 7은 본 발명의 실시예에 따른 인디케이터 출력부를 설명하기 위한 도면이다.FIG. 2 is a block diagram of a vehicle driving assist system according to an embodiment of the present invention. FIG. 3 is a plan view of a vehicle having a sensor unit according to an embodiment of the present invention. 5 and 6 are views for explaining an example of a method of generating image information from a camera image according to an embodiment of the present invention, FIG. 7 is a diagram for explaining an indicator output unit according to FIG.

도 2를 참조하면, 이러한 차량 운전 보조장치(100)는 입력부(110), 통신부(120), 인터페이스부(130), 메모리(140), 모니터링부(150), 센서부(190), 프로세서(170), 디스플레이부(180), 오디오 출력부(185) 및 전원 공급부(190)를 포함할 수 있다. 다만, 도 2에 도시된 차량 운전 보조장치(100)의 유닛들은 차량 운전 보조장치(100)를 구현하는데 있어서 필수적인 것은 아니어서, 본 명세서 상에서 설명되는 차량 운전 보조장치(100)는 위에서 열거된 구성요소들 보다 많거나, 또는 적은 구성요소들을 가질 수 있다.2, the vehicle driving

구성에 대한 설명으로 돌아와, 먼저, 차량 운전 보조장치(100)는 사용자의 입력을 감지하는 입력부(110)를 포함할 수 있다.Returning to the description of the configuration, first, the vehicle driving

예를 들어, 사용자는 입력부(110)를 통해 위험 정보의 전송을 위한 전송 조건을 입력하거나, 상기 차량 운전 보조장치(100)의 전원을 온(on)/오프(off)시키는 실행 입력 등을 할 수 있다.For example, the user inputs a transmission condition for transmitting the danger information through the

이러한 입력부(110)는 사용자 제스쳐를 감지하는 제스쳐 입력부(예를 들어 (optical sensor) 등), 터치를 감지하는 터치 입력부(예를 들어, 터치 센서(touch sensor), 터치키(touch key), 푸시키(mechanical key) 등) 및 음성 입력을 감지하는 마이크로폰(microphone) 중 적어도 하나 이상을 포함하여, 사용자 입력을 감지할 수 있다.

The

다음으로, 차량 운전 보조장치(100)는 타차량(510), 단말기(600) 및 서버(500) 등과 통신하는 통신부(120)를 포함할 수 있다.Next, the vehicle driving

차량 운전 보조장치(100)는 통신부(120)를 통해 내비게이션(Navigation) 정보, 타차량 주행정보 및 교통 정보 중 적어도 하나의 정보를 수신할 수 있다. 그리고 통신부(120)가 수신한 정보는 주변의 교통 상황이나 주변에 존재하는 오브젝트를 검출하기 위한 추가 정보로 이용될 수 있다.The vehicle driving

또한, 차량 운전 보조장치(100)는 통신부(120)를 주변의 교통 상황이나 오브젝트를 감지하기 위하여, 서버(500)의 빅 데이터를 이용할 수도 있다.In addition, the vehicle driving

또한, 차량 운전 보조장치(100)는 오브젝트를 감지하고, 상기 감지한 오브젝트에 대한 정보를 상기 서버(500)에 전송하고, 상기 서버(500)에서 상기 감지된 오브젝트에 대한 위험 정보를 수신함으로써, 상기 차량의 주변에 존재하는 주변 차량 또는 인접 차량에게 위험 정보를 전송할 수 있다.In addition, the vehicle driving

상기 서버(500)는 ITS(Intelligent Transport System) 서버를 포함할 수 있다.The

이때, 상기 차량 운전 보조장치(100)는 상기 오브젝트가 감지되고, 상기 오브젝트에 대한 위험 정보가 생성되면, 상기 생성된 위험 정보를 상기 주변 차량 또는 인접 차량뿐 아니라, 상기 서버(500)에도 전송한다.At this time, when the object is sensed and the risk information for the object is generated, the

이에 따라, 오브젝트에 대응하는 보행자가 횡단보도를 미처 건너지 못한 상황에서 보행 신호가 변경되는 경우, 상기 위험 정보를 토대로 상기 서버(500)에서 상기 보행 신호를 일정 시간 연장시킬 수 있도록 하여 상기 보행자의 안전을 확보할 수 있도록 한다.Accordingly, when the walking signal is changed in a situation where the pedestrian corresponding to the object does not cross the pedestrian crossing, the

또한, 통신부(120)는 이동 단말기(600) 또는/및 서버(500)로부터 위치 정보, 날씨 정보 및 도로의 교통 상황 정보(예를 들면, TPEG(Transport Protocol Expert Group) 등) 중 적어도 하나의 정보를 더 수신할 수 있다.The

또한, 통신부(120)는 지능형 교통 시스템(ITS)을 갖춘 서버(500)로부터 교통 정보를 수신할 수 있다. 여기서, 교통 정보는 신호등 정보, 차선 정보 등을 포함할 수 있다.In addition, the

또한, 통신부(120)는 서버(500) 또는/및 이동 단말기(600)로부터 내비게이션 정보를 수신할 수도 있다. 여기서, 내비게이션 정보는 차량 주행과 관련된 맵(map) 정보, 차선 정보, 차량의 위치 정보, 설정된 목적지 정보 및 목적지에 따른 경로 정보 중 적어도 하나 이상의 정보를 포함할 수 있다.In addition, the

특히, 통신부(120)는 내비게이션 정보로 차량(700)의 실시간 위치를 수신할 수 있다. 예를 들어, 통신부(120)는 GPS(Global Positioning System) 모듈 또는 WiFi(Wireless Fidelity) 모듈을 포함하여 차량의 위치를 획득할 수 있다.In particular, the

또한, 통신부(120)는 타차량(510)으로부터 타차량(510)의 주행정보를 수신하고, 차량(700)의 주행정보를 송신하여, 차량간 주행정보를 공유할 수도 있다.The

여기서, 서로 공유하는 차량 주행정보는 방향 정보, 위치 정보, 차속 정보, 가속도 정보, 이동경로 정보, 전진/후진 정보, 인접차량 정보 및 턴 시그널 정보 중 적어도 하나 이상의 정보를 포함할 수 있다.Here, the common vehicle running information may include at least one of direction information, position information, vehicle speed information, acceleration information, movement route information, forward / backward information, adjacent vehicle information, and turn signal information.

이에 따라, 상기 차량 운전 보조장치(100)는 상기 타차량(510)으로부터 전송되는 차량 주행 정보를 토대로 상기 차량(700)의 주변에 존재하는 주변 차량 또는 인접 차량을 검출할 수 있으며, 상기 검출한 주변 차량 또는 인접 차량으로 상기 위험 정보를 전송할 수 있다.Accordingly, the vehicle driving

또한, 사용자가 차량(700)에 탑승한 경우, 사용자의 이동 단말기(600)와 차량 운전 보조장치(100)는 자동으로 또는 사용자의 애플리케이션 실행에 의해 서로 페어링(pairing)을 수행할 수도 있다.In addition, when the user is boarding the

이러한 통신부(120)는 타차량(510), 이동 단말기(600) 또는 서버(500)와 무선(wireless) 방식으로 데이터를 교환할 수 있다.The

자세히, 통신부는 무선테이터 통신 방식을 이용하여 무선 통신할 수 있다. 무선 데이터 통신 방식으로는 이동통신을 위한 기술표준들 또는 통신방식(예를 들어, GSM(Global System for Mobile communication), CDMA(Code Division Multi Access), CDMA2000(Code Division Multi Access 2000), EV-DO(Enhanced Voice-Data Optimized or Enhanced Voice-Data Only), WCDMA(Wideband CDMA), HSDPA(High Speed Downlink Packet Access), HSUPA(High Speed Uplink Packet Access), LTE(Long Term Evolution), LTE-A(Long Term Evolution-Advanced) 등)을 이용할 수 있다.More specifically, the communication unit can wirelessly communicate using a wireless data communication system. Wireless data communication schemes include, but are not limited to, technical standards or communication schemes for mobile communication (e.g., Global System for Mobile communications (GSM), Code Division Multi Access (CDMA), Code Division Multi Access 2000 (Enhanced Voice-Data Optimized or Enhanced Voice-Data Only), WCDMA (Wideband CDMA), HSDPA (High Speed Downlink Packet Access), HSUPA (Long Term Evolution), LTE Term Evolution-Advanced) or the like can be used.

또한, 통신부(120)는 무선 인터넷 기술을 이용할 수 있으며, 예를 들어, 무선 인터넷 기술로 WLAN(Wireless LAN), Wi-Fi(Wireless-Fidelity), Wi-Fi(Wireless Fidelity) Direct, DLNA(Digital Living Network Alliance), WiBro(Wireless Broadband), WiMAX(World Interoperability for Microwave Access), HSDPA(High Speed Downlink Packet Access), HSUPA(High Speed Uplink Packet Access), LTE(Long Term Evolution), LTE-A(Long Term Evolution-Advanced) 등을 이용할 수 있다.In addition, the

또한, 통신부(120)는 근거리 통신(Short range communication)을 이용할 수 있으며, 예를 들어, 블루투스(Bluetooth™), RFID(Radio Frequency Identification), 적외선 통신(Infrared Data Association; IrDA), UWB(Ultra Wideband), ZigBee, NFC(Near Field Communication), Wi-Fi(Wireless-Fidelity), Wi-Fi Direct, Wireless USB(Wireless Universal Serial Bus) 기술 중 적어도 하나를 이용하여, 근거리 통신을 지원할 수 있다.In addition, the

또한, 차량 운전 보조장치(100)는 근거리 통신 방식을 이용하여 차량 내부의 이동 단말기와 페어링(paring)하고, 이동 단말기의 무선 통신 모듈을 이용하여 타차량 및 서버 등과 무선으로 데이터를 교환할 수도 있다.

In addition, the vehicle driving

다음으로, 차량 운전 보조장치(100)는 차량 관련 데이터를 수신하거나 프로세서(170)에서 처리 또는 생성된 신호를 외부로 전송하는 인터페이스부(130)를 포함할 수 있다.Next, the vehicle driving

자세히, 차량 운전 보조장치(100)는 인터페이스부(130)를 통해 내비게이션 정보 및 센서 정보 중 적어도 하나의 정보를 수신할 수 있다.In detail, the vehicle driving

그리고 이러한 내비게이션 정보 및 센서 정보는 프로세서(170)가 오브젝트 및 상기 오브젝트에 따른 위험 상황을 검출하는데 추가 정보로 이용될 수 있다.Such navigation information and sensor information may be used as additional information by the

또한, 차량 운전 보조장치(100)는 인터페이스부(130)를 통해 차량 운전 보조기능 실행을 위한 제어 신호나, 차량 운전 보조장치(100)에서 생성한 정보 등을 송신할 수 있다.Further, the vehicle driving

이를 위해, 인터페이스부(130)는 유선 통신 또는 무선 통신 방식에 의해 차량 내부의 제어부(770), AVN(Audio Video Navigation) 장치(400) 및 센싱부(760) 중 적어도 하나와 데이터 통신을 수행할 수 있다.To this end, the

자세히, 인터페이스부(130)는 제어부(770), AVN 장치(400) 또는/및 별도의 내비게이션 장치와의 데이터 통신에 의해 내비게이션 정보를 수신할 수 있다.In detail, the

또한, 인터페이스부(130)는 제어부(770) 또는 센싱부(760)로부터 센서 정보를 수신할 수 있다.The

여기서, 센서 정보는 차량(700)의 방향 정보, 위치 정보, 차속 정보, 가속도 정보, 기울기 정보, 전진/후진 정보, 연료 정보, 전후방 차량과의 거리 정보, 차량과 차선과의 거리 정보 및 턴 시그널 정보 중 적어도 하나 이상의 정보를 포함할 수 있다.Here, the sensor information includes direction information of the

또한, 센서 정보는 헤딩 센서(heading sensor), 요 센서(yaw sensor), 자이로 센서(gyro sensor), 포지션 모듈(position module), 차량 전진/후진 센서, 휠 센서(wheel sensor), 차량 속도 센서, 차체 경사 감지센서, 배터리 센서, 연료 센서, 타이어 센서, 핸들 회전에 의한 스티어링 센서, 차량 내부 온도 센서, 차량 내부 습도 센서, 도어 센서 등으로부터 획득될 수 있다. 한편, 포지션 모듈은, GPS 정보 수신을 위한 GPS 모듈을 포함할 수 있다.Also, the sensor information may include a heading sensor, a yaw sensor, a gyro sensor, a position module, a vehicle forward / backward sensor, a wheel sensor, a vehicle speed sensor, A vehicle body inclination sensor, a battery sensor, a fuel sensor, a tire sensor, a steering sensor by steering wheel rotation, a vehicle internal temperature sensor, a vehicle internal humidity sensor, and a door sensor. On the other hand, the position module may include a GPS module for receiving GPS information.

그리고 인터페이스부(130)는 차량(700)의 사용자 입력부(110)를 통해 수신되는 사용자 입력을 수신할 수 있다. 인터페이스부(130)는 사용자 입력을 차량(700)의 입력부로부터 수신하거나 제어부(770)를 거쳐 수신할 수 있다. 즉, 입력부가 차량 자체 내에 구성으로 배치된 경우, 인터페이스부(130)를 통해 사용자 입력을 전달받을 수 있다.The

또한, 인터페이스부(130)는 서버(500)로부터 획득된 교통 정보를 수신할 수도 있다. 서버(500)는 교통을 관제하는 교통 관제소에 위치하는 서버일 수 있다. 예를 들면, 차량(700)의 통신부(120)를 통해 서버(500)로부터 교통 정보가 수신되는 경우 인터페이스부(130)는 교통 정보를 제어부(770)로부터 수신할 수도 있다.

In addition, the

다음, 메모리(140)는 프로세서(170)의 처리 또는 제어를 위한 프로그램 등 차량 운전 보조장치(100) 전반의 동작을 위한 다양한 데이터를 저장할 수 있다.Next, the

자세히, 메모리(140)는 차량 운전 보조장치(100)에서 구동되는 다수의 응용 프로그램(application program 또는 애플리케이션(application)), 차량 운전 보조장치(100)의 동작을 위한 데이터들, 명령어들을 저장할 수 있다. 이러한 응용 프로그램 중 적어도 일부는, 무선 통신을 통해 외부 서버로부터 다운로드 될 수 있다. 또한 이러한 응용 프로그램 중 적어도 일부는, 차량 운전 보조장치(100)의 기본적인 기능(예를 들어, 차량 운전 보조기능)을 위하여 출고 당시부터 차량 운전 보조장치(100) 상에 존재할 수 있다.The

그리고 이러한 응용 프로그램은, 메모리(140)에 저장되고, 프로세서(170)에 의하여 차량 운전 보조장치(100)의 동작(또는 기능)을 수행하도록 구동될 수 있다.And this application program is stored in the

또한, 메모리(140)는 알림 상황에 따라 표시할 다양한 인디케이터들(예를 들어, 정지 아이콘, 오브젝트 아이콘(보행자, 오토바이, 자전거 등) 등)을 저장할 수 있다. 예를 들어, 메모리(140)는 상기 검출된 오브젝트의 이미지에 대응하는 아이콘을 저장할 수 있다. 이에 따라, 차량 운전 보조장치(100)는 상기 주변 차량 또는 인접 차량이 상기 차량(700)의 주변에 존재하는 오브젝트의 종류를 쉽게 인지할 수 있도록 한다.In addition, the

한편, 메모리(140)는 영상에 포함되는 오브젝트 확인을 위한 데이터를 저장할 수 있다. 예를 들면, 메모리(140)는, 카메라(160)를 통해 획득된 차량 주변 영상에서, 소정 오브젝트가 검출되는 경우, 소정 알고리즘에 의해, 상기 오브젝트가 무엇에 해당하는지 확인하기 위한 데이터를 저장할 수 있다.Meanwhile, the

예를 들면, 메모리(140)는, 카메라(160)를 통해 획득된 영상에 차선, 교통 표지판, 이륜차, 보행자와 같은 소정의 오브젝트가 포함되면, 소정 알고리즘에 의해, 상기 오브젝트가 무엇에 해당하는지 확인하기 위한 데이터를 저장할 수 있다. For example, when the image acquired through the

이러한 메모리(140)는 하드웨어적으로, 플래시 메모리 타입(flash memory type), 하드디스크 타입(hard disk type), SSD 타입(Solid State Disk type), SDD 타입(Silicon Disk Drive type), 멀티미디어 카드 마이크로 타입(multimedia card micro type), 카드 타입의 메모리(예를 들어 SD 또는 XD 메모리 등), 램(random access memory; RAM), SRAM(static random access memory), 롬(read-only memory; ROM), EEPROM(electrically erasable programmable read-only memory), PROM(programmable read-only memory), 자기 메모리, 자기 디스크 및 광디스크 중 적어도 하나의 타입의 저장매체를 포함할 수 있다.The

또한, 차량 운전 보조장치(100)는 인터넷(internet)상에서 메모리(140)의 저장 기능을 수행하는 웹 스토리지(web storage)와 관련되어 동작될 수도 있다.

In addition, the vehicle driving

다음으로, 모니터링부(150)는 사용자의 생체 인식 정보를 획득할 수 있다.Next, the

자세히, 모니터링부(150)는 사용자의 동작이나 생체 인식 정보를 감지하여, 모니터링 정보를 획득할 수 있다. 그리고 획득된 모니터링 정보는 상기 감지된 오브젝트의 위험 수준을 결정하는데 이용될 수 있다.In detail, the

자세히, 모니터링부(150)는 사용자의 생체 인식을 위한 이미지를 획득할 수 있다. 즉, 모니터링부(150)는 차량 내부에 배치된 영상 획득 모듈을 포함할 수 있다.In detail, the

예를 들어, 모니터링부(150)는 차량 내부 영상을 촬영하는 모니터링 카메라를 포함하여, 차량 내부를 촬영할 수 있다. 그리고 프로세서(170)는 차량 내부에서 촬영된 영상을 이미지 처리하여, 운전자나 동승자의 상태를 실시간으로 모니터링할 수 있다.For example, the

그리고 모니터링부(150)가 감지하는 생체 인식 정보는, 사용자를 촬영한 영상 정보, 지문 인식(Fingerprint) 정보, 홍채 인식(Iris-scan) 정보, 망막 인식(Retina-scan) 정보, 손모양(Hand geo-metry) 정보, 안면 인식(Facial recognition) 정보, 음성 인식(Voice recognition) 정보 중 적어도 하나 이상의 정보를 포함할 수 있다. 그리고 모니터링부(150)는 이러한 생체 인식 정보를 센싱하는 센서를 포함할 수 있다.

The biometric information detected by the

다음으로, 차량 운전 보조장치(100)는 차량 주변의 오브젝트를 감지하는 센서부(150)를 더 포함할 수 있다.Next, the vehicle driving

이때, 전술한 바와 같이 차량 운전 보조장치(100)는 별도의 센서부(150)를 포함하여 주변 오브젝트를 감지할 수 있으며, 차량(700) 자체의 센싱부(770)에서 얻어진 센서 정보를 인터페이스부(130)를 통해 수신할 수도 있다.As described above, the vehicle driving

이러한 센서부(150)는 오브젝트의 위치를 감지하는 거리 센서(191)를 포함할 수 있다.The

그리고 거리 센서(191)는 본 차량(700)에서 오브젝트가 이격된 방향, 거리 및 오브젝트의 이동 방향 등을 정밀하게 감지할 수 있다. 또한, 거리 센서(191)는 감지된 오브젝트와의 위치관계를 지속적으로 측정하여, 위치관계에 대한 변화를 정확하게 감지할 수 있다.The

이러한 거리 센서(191)는 차량(700)의 전후좌우에 위치한 오브젝트를 감지할 수 있다. 이를 위해, 거리 센서(191)는 차량(700)의 다양한 위치에 배치될 수 있다.The

자세히, 도 3를 참조하면, 거리 센서(191)는 차량(700)의 바디의 전후좌우(191a, 191b, 191c, 191d) 및 천장(191e) 중 적어도 하나의 위치에 배치될 수 있다.3, the

이러한 거리 센서(191)는 라이다(lidar) 센서, 레이저(laser) 센서, 초음파(ultrasonic waves) 센서 및 스테레오 카메라(stereo camera) 등 다양한 거리 측정 센서를 포함할 수 있다.The

예를 들어, 거리 센서는 레이저 센서로서, 레이저 신호 변조 방법에 따라 시간 지연 방식(time-of-flight, TOF) 또는/및 위상 변조 방식(phase-shift)을 사용하여, 차량(700)과 오브젝트 사이의 위치 관계를 측정할 수 있다. 자세히, 시간 지연 방식은, 펄스 레이저 신호를 방출하고 측정 범위 내에 있는 오브젝트들로부터의 반사 펄스 신호들이 수신기에 도착하는 시간을 측정하여 오브젝트와의 이격 거리 및 이격 방향을 측정할 수 있다.

For example, the distance sensor may be a laser sensor, which may be a laser sensor, which uses a time-of-flight (TOF) or / and a phase-shift according to a laser signal modulation method, Can be measured. More specifically, the time delay method can measure the distance between the object and the object by emitting a pulsed laser signal and measuring the time that the reflected pulse signals from the objects within the measurement range arrive at the receiver.

한편, 오브젝트가 알림 대상에 해당하는지 여부, 알림 상황을 판단하기 위한 오브젝트의 속성은 카메라(160)가 촬영한 영상을 프로세서(170)가 분석하여 얻어질 수 있다.On the other hand, whether or not the object corresponds to the notification target and the attribute of the object for determining the notification status can be obtained by analyzing the image captured by the

이를 위해, 센서부(150)는 카메라(160)를 포함할 수 있다.To this end, the

자세히, 차량 운전 보조장치(100)는, 차량 주변 영상을 획득하는 카메라(160)를 포함할 수 있다. 그리고 획득된 차량 주변 영상은 프로세서(170)가 차량 주변 오브젝트를 검출하고, 오브젝트의 속성을 검출하여, 영상 정보를 생성할 수 있다.More specifically, the vehicle driving

여기서, 영상 정보는 오브젝트의 종류, 오브젝트가 표시하는 교통 신호 정보, 오브젝트와 차량 사이의 거리 및 오브젝트의 위치 중 적어도 하나의 정보로서, 센서 정보에 포함될 수 있다.Here, the image information may be included in the sensor information as at least one of the type of the object, the traffic signal information displayed by the object, the distance between the object and the vehicle, and the position of the object.

자세히, 프로세서(170)는 이미지 처리를 통해 촬영된 영상에서 오브젝트를 검출하고, 오브젝트를 트래킹하고, 오브젝트와의 거리를 측정하고, 오브젝트를 확인하는 등의 오브젝트 분석을 수행함으로써, 영상 정보를 생성할 수 있다.More specifically, the

프로세서(170)가 오브젝트 분석을 좀더 수월하게 수행하기 위하여, 카메라(160)는 영상을 촬영하고, 촬영된 영상 내의 오브젝트와 거리를 측정하는 스테레오 카메라일 수 있다. 다만, 실시예가 이에 한정되는 것은 아니다.In order for the

이러한 카메라(160)는 차량 내부에서 차량의 전방을 촬영하여 전방 영상을 획득하는 내부 카메라를 포함할 수도 있다.The

이러한 카메라(160)는 차량 외부의 다양한 위치에 구비될 수도 있다.The

도 3을 참조하면, 복수의 카메라(160)는, 각각 차량(700)의 좌측, 후방, 우측, 전방 및 천장 중 적어도 하나 이상에 배치될 수 있다.3, a plurality of

좌측 카메라(160b)는, 좌측 사이드 미러를 둘러싸는 케이스 내에 배치될 수 있다. 또는, 좌측 카메라(160b)는, 좌측 사이드 미러를 둘러싸는 케이스 외부에 배치될 수 있다. 또는, 좌측 카메라(160b)는 좌측 프런트 도어, 좌측 리어 도어 또는 좌측 휀더(fender) 외측 일 영역에 배치될 수 있다.The

우측 카메라(160c)는, 우측 사이드 미러를 둘러싸는 케이스 내에 배치될 수 있다. 또는 우측 카메라(160c)는, 우측 사이드 미러를 둘러싸는 케이스 외부에 배치될 수 있다. 또는, 우측 카메라(160c)는 우측 프런트 도어, 우측 리어 도어 또는 우측 펜터(fendere) 외측 일 영역에 배치될 수 있다.The

또한, 후방 카메라(160d)는, 후방 번호판 또는 트렁크 스위치 부근에 배치될 수 있다. 전방 카메라(160a)는, 앰블럼 부근 또는 라디에이터 그릴 부근에 배치될 수 있다.Further, the

프로세서(170)는 사방에서 촬영된 영상을 합성하여 차량(700)을 탑뷰에서 바라본 어라운드 뷰 이미지를 제공할 수 있다. 어라운드 뷰 이미지 생성시, 각 이미지 영역 사이의 경계 부분이 발생한다. 이러한 경계 부분은 이미지 블렌딩(blending) 처리하여 자연스럽게 표시될 수 있다.The

또한, 천장 카메라(160e)는 차량(700)의 천장 상에 배치되어 차량(700)의 전후좌우를 모두 촬영할 수도 있다.Further, the

이러한 카메라(160)는 이미지 센서와 영상 처리 모듈을 직접 포함할 수도 있다. 카메라(160)는 이미지 센서(예를 들면, CMOS 또는 CCD)에 의해 얻어지는 정지영상 또는 동영상을 처리할 수 있다. 또한, 영상 처리 모듈은 이미지 센서를 통해 획득된 정지영상 또는 동영상을 가공하여, 필요한 영상 정보를 추출하고, 추출된 영상 정보를 프로세서(170)에 전달할 수도 있다.

Such a

실시예에서, 센서부(150)는 거리 센서(191)와 카메라(160)를 포함하는 스테레오 카메라를 포함할 수 있다. 즉, 스테레오 카메라는 영상을 획득할 수 있고, 오브젝트의 위치를 감지할 수 있다.In an embodiment, the

이하, 도 4내지 도 6을 참조하여, 프로세서(170)가 스테레오 카메라를 이용하여 위치 정보와, 영상 정보를 검출하는 방법을 좀더 상세히 설명한다.Hereinafter, with reference to Figs. 4 to 6, a method for the

먼저, 도 4를 참조하면, 스테레오 카메라(160)는 제1 렌즈(163a)를 구비하는 제1 카메라(160a), 제2 렌즈(163b)를 구비하는 제2 카메라(160b)를 포함할 수 있다.4, the

또한, 스테레오 카메라(160)는, 각각, 제1 렌즈(163a)와 제2 렌즈(163b)에 입사되는 광을 차폐하기 위한, 제1 광 차폐부(light shield)(162a), 제2 광 차폐부(162b)를 더 구비할 수 있다.The

이러한 차량 운전 보조장치(100)는 제1 및 제2 카메라(160a, 160b)로부터, 차량 주변에 대한 스테레오 이미지를 획득하고, 스테레오 이미지에 기초하여, 디스패러티(disparity) 검출을 수행하고, 디스패러티 정보에 기초하여, 적어도 하나의 스테레오 이미지에 대한, 오브젝트 검출을 수행하며, 오브젝트 검출 이후, 계속적으로, 오브젝트의 움직임을 트래킹할 수 있다.

This vehicle driving

도 5를 참조하면, 프로세서(170)의 내부 블록도의 일예로서, 차량 운전 보조장치(100) 내의 프로세서(170)는, 영상 전처리부(410), 디스패러티 연산부(420), 오브젝트 검출부(434), 오브젝트 트래킹부(440), 및 어플리케이션부(450)를 포함할 수 있다. 도 5와 이하 설명에서는 영상 전처리부(410), 디스패러티 연산부(420), 오브젝트 검출부(434), 오브젝트 트래킹부(440), 및 어플리케이션부(450) 순으로 영상이 처리되는 것으로 설명하나, 이에 한정되지는 않는다.5, the

영상 전처리부(image preprocessor)(410)는, 카메라(160)로부터의 이미지를 수신하여, 전처리(preprocessing)를 수행할 수 있다.An image preprocessor 410 may receive an image from the

구체적으로, 영상 전처리부(410)는, 이미지에 대한, 노이즈 리덕션(noise reduction), 렉티피케이션(rectification), 캘리브레이션(calibration), 색상 강화(color enhancement), 색상 공간 변환(color space conversion;CSC), 인터폴레이션(interpolation), 카메라(160) 게인 컨트롤(camera gain control) 등을 수행할 수 있다. 이에 따라, 카메라(160)에서 촬영된 스테레오 이미지 보다 선명한 이미지를 획득할 수 있다.Specifically, the image preprocessing unit 410 may perform a noise reduction, a rectification, a calibration, a color enhancement, a color space conversion (CSC Interpolation,

디스패러티 연산부(disparity calculator)(420)는, 영상 전처리부(410)에서 신호 처리된, 이미지를 수신하고, 수신된 이미지들에 대한 스테레오 매칭(stereo matching)을 수행하며, 스테레오 매칭에 따른, 디스패러티 맵(dispartiy map)을 획득할 수 있다. 즉, 차량 전방에 대한, 스테레오 이미지에 대한 디스패러티 정보를 획득할 수 있다.The disparity calculator 420 receives the image signal processed by the image preprocessing unit 410, performs stereo matching on the received images, and performs disparity calculation based on stereo matching, A disparity map can be obtained. That is, it is possible to obtain the disparity information about the stereo image with respect to the front of the vehicle.

이때, 스테레오 매칭은, 스테레오 이미지들의 픽셀 단위로 또는 소정 블록 단위로 수행될 수 있다. 한편, 디스패러티 맵은, 스테레오 이미지, 즉 좌,우 이미지의 시차(時差) 정보(binocular parallax information)를 수치로 나타낸 맵을 의미할 수 있다.At this time, the stereo matching may be performed on a pixel-by-pixel basis of stereo images or on a predetermined block basis. On the other hand, the disparity map may mean a map in which binaural parallax information of stereo images, i.e., left and right images, is numerically expressed.

세그멘테이션부(segmentation unit)(432)는, 디스패러티 연산부(420)로부터의 디스페러티 정보에 기초하여, 이미지 중 적어도 하나에 대해, 세그먼트(segment) 및 클러스터링(clustering)을 수행할 수 있다.The segmentation unit 432 may perform segmenting and clustering on at least one of the images based on the disparity information from the disparity calculating unit 420. [

구체적으로, 세그멘테이션부(432)는, 디스페러티 정보에 기초하여, 스테레오 이미지 중 적어도 하나에 대해, 배경(background)과 전경(foreground)을 분리할 수 있다.Specifically, the segmentation unit 432 can separate the background and the foreground for at least one of the stereo images based on the disparity information.

예를 들면, 디스패리티 맵 내에서 디스페러티 정보가 소정치 이하인 영역을, 배경으로 연산하고, 해당 부분을 제외시킬 수 있다. 이에 의해, 상대적으로 전경이 분리될 수 있다. 다른 예로, 디스패리티 맵 내에서 디스페러티 정보가 소정치 이상인 영역을, 전경으로 연산하고, 해당 부분을 추출할 수 있다. 이에 의해, 전경이 분리될 수 있다.For example, an area having dispaly information within a disparity map of a predetermined value or less can be calculated as a background, and the corresponding part can be excluded. Thereby, the foreground can be relatively separated. As another example, an area in which the dispetity information is equal to or greater than a predetermined value in the disparity map can be calculated with the foreground, and the corresponding part can be extracted. Thereby, the foreground can be separated.

이와 같이, 스테레오 이미지에 기반하여 추출된 디스페러티 정보 정보에 기초하여, 전경과 배경을 분리함으로써, 이후의, 오브젝트 검출시, 신호 처리 속도, 신호 처리 양 등을 단축할 수 있게 된다.Thus, by separating the foreground and the background based on the disparity information information extracted based on the stereo image, it becomes possible to shorten the signal processing speed, signal processing amount, and the like at the time of object detection thereafter.

다음, 오브젝트 검출부(object detector)(434)는, 세그멘테이션부(432)로부터의 이미지 세그먼트에 기초하여, 오브젝트를 검출할 수 있다.Next, the object detector 434 can detect the object based on the image segment from the segmentation unit 432. [

즉, 오브젝트 검출부(434)는, 디스페러티 정보 정보에 기초하여, 이미지 중 적어도 하나에 대해, 오브젝트를 검출할 수 있다.That is, the object detecting unit 434 can detect an object for at least one of the images based on the disparity information.

구체적으로, 오브젝트 검출부(434)는, 이미지 중 적어도 하나에 대해, 오브젝트를 검출할 수 있다. 예를 들면, 이미지 세그먼트에 의해 분리된 전경으로부터 오브젝트를 검출할 수 있다.More specifically, the object detecting unit 434 can detect an object for at least one of the images. For example, an object can be detected from a foreground separated by an image segment.

다음, 오브젝트 확인부(object verification unit)(436)는, 분리된 오브젝트를 분류하고(classify), 확인할 수 있다(verify).The object verification unit 436 then classifies and verifies the isolated object.

이를 위해, 오브젝트 확인부(436)는, 뉴럴 네트워크(neural network)를 이용한 식별법, SVM(Support Vector Machine) 기법, Haar-like 특징을 이용한 AdaBoost에 의해 식별하는 기법, 또는 HOG(Histograms of Oriented Gradients) 기법 등을 사용할 수 있다.For this purpose, the object identifying unit 436 identifies the objects using a neural network identification method, a SVM (Support Vector Machine) method, a AdaBoost identification method using a Haar-like feature, or a Histograms of Oriented Gradients (HOG) Technique can be used.

한편, 오브젝트 확인부(436)는, 메모리(140)에 저장된 오브젝트들과, 검출된 오브젝트를 비교하여, 오브젝트를 확인할 수 있다.On the other hand, the object checking unit 436 can check the objects by comparing the objects stored in the

예를 들면, 오브젝트 확인부(436)는, 차량 주변에 위치하는, 주변 차량, 차선, 도로면, 표지판, 위험 지역, 터널 등을 확인할 수 있다.For example, the object identifying unit 436 can identify nearby vehicles, lanes, roads, signs, hazardous areas, tunnels, etc., located in the vicinity of the vehicle.

오브젝트 트래킹부(object tracking unit)(440)는, 확인된 오브젝트에 대한 트래킹을 수행할 수 있다. 예를 들면, 순차적으로, 획득되는 스테레오 이미지들에 내의, 오브젝트를 확인하고, 확인된 오브젝트의 움직임 또는 움직임 벡터를 연산하며, 연산된 움직임 또는 움직임 벡터에 기초하여, 해당 오브젝트의 이동 등을 트래킹할 수 있다. 이에 따라, 차량 주변에 위치하는, 주변 차량, 차선, 도로면, 표지판, 위험 지역, 터널 등을 트래킹할 수 있게 된다.The object tracking unit 440 may perform tracking on the identified object. For example, it sequentially identifies an object in the acquired stereo images, calculates a motion or a motion vector of the identified object, and tracks movement of the object based on the calculated motion or motion vector . Accordingly, it is possible to track nearby vehicles, lanes, roads, signs, dangerous areas, tunnels, etc., located in the vicinity of the vehicle.

다음, 어플리케이션부(450)는, 차량 주변에, 위치하는 다양한 오브젝트들, 예를 들면, 다른 차량, 차선, 도로면, 표지판 등에 기초하여, 차량의 위험도 등을 연산할 수 있다. 또한, 앞차와의 추돌 가능성, 차량의 슬립 여부 등을 연산할 수 있다.Next, the application unit 450 can calculate the risk of the vehicle and the like based on various objects located in the vicinity of the vehicle, for example, other vehicles, lanes, roads, signs and the like. It is also possible to calculate the possibility of a collision with a preceding vehicle, whether the vehicle is slipping or the like.

그리고, 어플리케이션부(450)는, 연산된 위험도, 추돌 가능성, 또는 슬립 여부 등에 기초하여, 사용자에게, 이러한 정보를 알려주기 위한, 메시지 등을, 차량 운전 보조 정보로서, 출력할 수 있다. 또는, 차량의 자세 제어 또는 주행 제어를 위한 제어 신호를, 차량 제어 정보로서, 생성할 수도 있다.Then, the application unit 450 can output a message or the like for notifying the user to the user as vehicle driving assistance information, based on the calculated risk, possibility of collision, or slip. Alternatively, a control signal for attitude control or running control of the vehicle may be generated as the vehicle control information.

한편, 영상 전처리부(410), 디스페러티 연산부(420), 세그먼테이션부(432), 오브젝트 검출부(434), 오브젝트 확인부(436), 오브젝트 트래킹부(440) 및 어플리케이션부(450)는 프로세서(170)내의 영상 처리부의 내부 구성일 수 있다.The object preprocessing unit 440 and the application unit 450 are connected to the processor 440. The image processing unit 410, the dispatcher unit 420, the segmentation unit 432, the object detection unit 434, the object verification unit 436, And may be an internal configuration of the image processing unit in the

한편, 실시예에 따라, 프로세서(170)는 영상 전처리부(410), 디스페러티 연산부(420), 세그먼테이션부(432), 오브젝트 검출부(434), 오브젝트 확인부(436), 오브젝트 트래킹부(440) 및 어플리케이션부(450) 중 일부만을 포함할 수 있다. 가령, 카메라(160)가 모노 카메라(160) 또는 어라운드 뷰 카메라(160)로 구성되는 경우, 디스패러티 연산부(420)는 제외될 수 있다. 또한, 실시예에 따라, 세그먼테이션부(432)는 제외될 수도 있다.

The

도 6을 참조하면, 제1 프레임 구간 동안, 카메라(160)는, 스테레오 이미지를 획득할 수 있다.Referring to FIG. 6, during the first frame period, the

프로세서(170) 내의 디스패러티 연산부(420)는, 영상 전처리부(410)에서 신호 처리된, 스테레오 이미지(FR1a, FR1b)를 수신하고, 수신된 스테레오 이미지(FR1a, FR1b)에 대한 스테레오 매칭을 수행하여, 디스패러티 맵(dispartiy map)(520)을 획득한다.The disparity calculating unit 420 in the

디스패러티 맵(dispartiy map)(520)은, 스테레오 이미지(FR1a, FR1b) 사이의 시차를 레벨화한 것으로서, 디스패러티 레벨이 클수록, 차량과의 거리가 가깝고, 디스패러티 레벨이 작을수록, 차량과의 거리가 먼 것으로 연산할 수 있다.The

한편, 이러한 디스패러티 맵을 디스플레이 하는 경우, 디스패러티 레벨이 클수록, 높은 휘도를 가지고, 디스패러티 레벨이 작을수록 낮은 휘도를 가지도록 표시할 수도 있다.On the other hand, when such a disparity map is displayed, it may be displayed so as to have a higher luminance as the disparity level becomes larger, and a lower luminance as the disparity level becomes smaller.

도면에서는, 디스패러티 맵(520) 내에, 제1 차선 내지 제4 차선(528a, 528b, 528c, 528d) 등이 각각 해당하는 디스패러티 레벨을 가지며, 공사 지역(522), 제1 전방 차량(524), 제2 전방 차량(526)이 각각 해당하는 디스패러티 레벨을 가지는 것을 예시한다.In the figure, first to

세그멘테이션부(432)와, 오브젝트 검출부(434), 오브젝트 확인부(436)는, 디스패러티 맵(520)에 기초하여, 스테레오 이미지(FR1a, FR1b) 중 적어도 하나에 대한, 세그먼트, 오브젝트 검출, 및 오브젝트 확인을 수행한다.The segmentation unit 432, the object detection unit 434 and the object identification unit 436 determine whether or not the segments, the object detection, and the object detection information for at least one of the stereo images FR1a and FR1b based on the

도면에서는, 디스패러티 맵(520)을 사용하여, 제2 스테레오 이미지(FR1b)에 대한, 오브젝트 검출, 및 확인이 수행되는 것을 예시한다.In the figure, using the

즉, 이미지(530) 내에, 제1 차선 내지 제4 차선(538a, 538b, 538c, 538d), 공사 지역(532), 제1 전방 차량(534), 제2 전방 차량(536)이, 오브젝트 검출 및 확인이 수행될 수 있다.That is, the first to

이와 같은 이미지 처리로, 차량 운전 보조장치(100)는 센서부(150)를 이용하여 주변 오브젝트가 무엇인지, 어디에 위치하는지 등을 정확하게 감지할 수 있다. 이를 통해, 차량 운전 보조장치(100)는 알림이 필요한 상황인지 여부와, 알림 대상을 검출할 수 있고, 알림 대상에게 표시할 알림 정보가 무엇인지를 검출할 수 있다.

With the image processing as described above, the vehicle driving

또한, 차량 운전 보조장치(100)는 위험 상황에 대한 알림 정보를 차량(700) 내외부에 출력하는 출력부를 포함할 수 있다.In addition, the vehicle driving

또한, 차량 운전 보조장치(100)는 내외부에 알림이 필요한 경우, 디스플레이부를 통해 인디케이터를 표시하거나, 오디오를 출력하여 내외부 알림 대상에게 알림을 줄 수 있다.In addition, when the vehicle driving

이를 위해, 출력부는 인디케이터 출력부(181), 디스플레이부(183) 및 오디오 출력부(185)를 포함할 수 있다.

To this end, the output unit may include an

먼저, 인디케이터 출력부(181)는 인디케이터를 차량 외부에 광원으로 표시할 수 있다. 예를 들어, 인디케이터 출력부(181)는 노면에 레이저를 조사하여 인디케이터의 화상이 노면에 맺히는 방식으로 인디케이터를 표시할 수 있다.First, the

이러한 인디케이터 출력부(181)는 차량 주변의 적어도 일측 영역에 인디케이터를 표시할 수 있다.The

또한, 인디케이터 출력부(181)는 헤드 램프로 안개와 같은 알림 정보를 발생할 수 있다. 다시 말해서, 인디케이터 출력부는 상기 안개를 발생시키는 안개 발생부를 포함할 수 있다.In addition, the

또한, 인디케이터 출력부(181)는 윈드 실드 또는 헤드 램프에 구비되어 워셔액을 분사하는 워셔액 분사부를 포함할 수 있다. 다시 말해서, 상기 워셔액 분사부를 통해 분사되는 워셔액은 상기 위험 상황을 알리기 위한 하나의 인디케이터로 활용될 수 있다.Further, the

이하, 도 7을 참조하여 인디케이터 출력부(181)의 인디케이터 표시방법에 대해 좀더 상세히 설명한다. 도 7의 인디케이터 출력부(181)는 차량 외부로 특정 이미지와 같은 인디케이터를 레이저로 출력하는 기능을 수행한다.Hereinafter, an indicator display method of the

자세히, 인디케이터 출력부(181)는 복수의 인디케이터 출력부를 포함하고 차량(700)에 서로 다른 위치에 레이저를 조사하도록 배치하여, 인디케이터를 차량의 전후좌우 모든 영역(UA)에 인디케이터를 표시할 수 있다.In detail, the

도 7을 참조하면, 차량의 좌측 헤드램프 부근에 제 1 인디케이터 출력부(181a)를 배치하고, 차량의 좌측면 바디에 제 2 인디케이터 출력부(181b)를 배치하고 좌측 테일램프 부근에 제 3 인디케이터 출력부(181c)를 배치함으로써, 차량의 좌측의 상하 영역에 인디케이터를 출력할 수 있다.7, a

또한, 차량(700)의 우측 헤드램드 부근에 제 4 인디케이터 출력부(181d)를 배치하고, 차량의 우측면 바디에 제 5 인디케이터 출력부(181e)를 배치하고, 우측 테일램프 부근에 제 6 인디케이터 출력부(181f)를 배치함으로써, 차량의 우측 상하 영역에 인디케이터를 출력할 수 있다.A

이러한 인디케이터 출력부들은 각각 배치된 위치 측에 레이저를 조사하여 인디케이터를 차량 주변에 표시할 수 있다.The indicator output units can display the indicator around the vehicle by irradiating laser beams to the arranged positions.

또한, 차량의 천장에 제 7 인디케이터 출력부(181g)를 배치하여 차량의 전후좌우 모든 영역에 인디케이터를 표시할 수도 있다.In addition, the seventh

이러한 복수의 인디케이터 출력부(181)는 차량의 전후뿐만 아니라, 좌우 영역에도 인디케이터를 표시하여, 알림 대상과의 위치관계에 따라 적절한 위치에 인디케이터를 표시할 수 있다.The plurality of

예를 들어, 차량(700)의 우측에서 접근하는 오브젝트의 존재를 상기 차량(700)의 좌측에서 주행중인 주변 차량에게 알리기 위하여, 상기 차량의 좌측면 바디에 배치된 제 2 인디케이터 출력부(181b)를 상기 오브젝트의 접근을 알라는 인디케이터를 표시하여, 상기 오브젝트의 안전을 확보할 수 있도록 하면서, 상기 주변 차량의 안전한 주행을 유도할 수 있다.A

즉, 이러한 복수의 인디케이터 출력부(181)는 알림 대상(예를 들어, 주변차량 또는 인접 차량 또는 감지된 오브젝트)의 시야 영역에 인디케이터를 표시할 수 있다.That is, the plurality of

따라서, 인디케이터 출력부(181)는 알림 대상과의 위치관계가 변화하면, 그에 대응되는 영역에 인디케이터를 표시함으로써, 인디케이터 식별력을 향상시킬 수 있다.Accordingly, the

예를 들어, 인디케이터 출력부(181)는 후방 좌측에서 전방으로 이동하는 알림 대상에는 차량의 좌측 영역에 인디케이터를 출력하여, 알림 대상의 시야 영역에 인디케이터를 표시할 수 있고, 알림 대상의 이동방향이 우측으로 변화하면 차량 후방이나 후방 우측 영역에 인디케이터를 표시할 수 있다.For example, the

한편, 전술한 인디케이터 출력부들의 배치는 일례로서, 위 인디케이터 중 일부만 포함하는 다른 실시예와 같이, 차량 전후좌우에 인디케이터를 표시할 수 있는 다양한 인디케이터 출력부 배치가 가능할 것이다.The arrangement of the above-described indicator output units is an example, and it is possible to arrange various indicator output units capable of displaying indicators on the front, rear, left and right sides of the vehicle as in the other embodiments including only a part of the above indicators.

그리고 인디케이터 출력부(181)는 다양한 이미지를 포함하는 인디케이터를 표시할 수 있다. 즉, 인디케이터 출력부(181)는 상황 별로 각기 다른 이미지를 나타내는 인디케이터를 외부에 표시하여, 알림 대상에게 정확한 알림 정보를 전달할 수 있다.The

인디케이터 출력부(181)는 알림 정보를 나타내는 기호 이미지를 포함하는 인디케이터를 표시할 수 있다. The

한편, 출력부(190)는 외부에 표시되는 인디케이터에 대한 정보, 설정 정보 등을 차량 내부에 출력할 수 있고, 알림 정보도 내부에도 알림할 수 있다.On the other hand, the

또한, 상기 출력부(190)는 외부의 다른 주변 차량 또는 인접 차량으로부터 전송되는 위험 정보를 출력할 수 있다.In addition, the

이를 위해, 출력부(190)는 디스플레이부(183)와, 오디오 출력부(185)를 포함할 수 있다.To this end, the

먼저, 디스플레부(183)는 상기 오브젝트에 대한 위험 정보를 차량 내부에 표시할 수 있다. 상기 오브젝트는 자신이 감지된 오브젝트일 수 있으며, 자신이 감지하지 못하는 상황에서 타차량에서 감지된 오브젝트일 수 있다. 이하에서는, 상기 자신이 감지한 오브젝트를 '제 1 오브젝트'라할고, 타차량에서 감지한 오브젝트를 '제 2 오브젝트'라 한다.First, the

일단, 상기 프로세서(170)는 상기 제 1 오브젝트가 감지되면, 상기 제 1 오브젝트에 대한 위험 정보를 생성하고, 상기 주변 차량 또는 인접 차량에게 상기 위험 정보가 전송되도록 한다. 이하에서는, 상기 주변 차량과 인접 차량을 타차량으로 통칭하기로 한다.Once the first object is detected, the

그리고, 상기 프로세서(170)는 상기 감지된 제 1 오브젝트에 대한 위험 정보를 상기 디스플레이부(183)를 통해 디스플레이한다.The

또한, 프로세서(170)는 통신부(120)를 통해 외부에서 전송되는 상기 제 2 오브젝트에 대한 위험 정보가 수신되면, 상기 수신된 제 2 오브젝트에 대한 위험 정보를 상기 디스플레이부(183)에 표시한다.The

이러한 디스플레이부(183)는 복수의 디스플레이부를 포함할 수 있다.The

이러한 디스플레이부(183)는 차량(700)의 윈드실드(W)(windshield)에 이미지를 투사할 수 있다.Such a

즉, 디스플레이부(183)는 HUD(Head Up Display)로, 윈드실드(W)에 이미지를 투사하는 투사 모듈을 포함할 수 있다. 그리고 투사 모듈이 투사하는 투사 이미지는 일정 투명도를 가져, 사용자는 투사 이미지 뒤 모습과 투사 이미지를 동시에 볼 수도 있다.That is, the

이러한 디스플레이부(183)에서 표시되는 투사 이미지는 윈드실드(W)에 투영되는 투영 이미지와 겹쳐셔 증강현실(Augmented Reality, AR)을 이룰 수 있다.The projection image displayed on the

또한, 디스플레이부(183)는 사이드 글라스(G)에 이미지를 표시할 수 있다.In addition, the

즉, 디스플레이부(183)는 운전자 좌석을 기준으로, 좌측 사이드 글라스에 이미지를 표시하고, 우측 사이드 글라스에 이미지를 표시하고, 후방 좌측 사이드 글라스에 이미지를 표시하고, 후방 우측 사이드 글라스에 이미지를 표시할 수 있다.That is, the

또한, 디스플레이부(183)는 차량 내부에 별도로 설치되어 이미지를 디스플레이할 수 있다.Also, the

자세히, 디스플레이부(183)는 차량 내비게이션 장치의 디스플레이나 차량 내부 전면의 클러스터(cluster)일 수 있다.More specifically, the

또한, 디스플레이부(183)는 액정 디스플레이(liquid crystal display, LCD), 박막 트랜지스터 액정 디스플레이(thin film transistor-liquid crystal display, TFT LCD), 유기 발광 다이오드(organic light-emitting diode, OLED), 플렉서블 디스플레이(flexible display), 3차원 디스플레이(3D display), 전자잉크 디스플레이(e-ink display) 중에서 적어도 하나를 포함할 수 있다.The

이러한 디스플레이부(183)는 터치 입력부와 결합되어 터치 스크린(touch screen)을 이룰 수 있다.

The

또한, 차량 운전 보조장치(100)는 오디오 출력부(185) 및 전원 공급부(145)를 더 포함할 수 있다.In addition, the vehicle driving

자세히, 오디오 출력부(185)는 차량 운전 보조장치(100)의 기능에 대한 설명, 실행 여부 등을 확인하는 메시지, 알림 정보를 오디오로 출력할 수 있다. 즉, 차량 운전 보조장치(100)는 디스플레이부(183)를 통한 시각적인 표시와 더불어 오디오 출력부(185)의 음향 출력을 통해 차량 운전 보조장치(100)의 기능에 대한 설명을 서로 보완할 수 있다.In detail, the

예를 들어, 오디오 출력부(185)는 상기 감지된 오브젝트에 대한 위험 정보를 토대로 운전 주의를 요구하는 인디케이터와 함께 비프 경고음을 출력하여, 알림 정보에 대한 전달력을 향상킬 수 있다.For example, the

또한, 전원 공급부(145)는 프로세서(170)의 제어에 의해 외부의 전원, 내부의 전원을 인가 받아 각 구성요소들의 동작에 필요한 전원을 공급할 수 있다.In addition, the

특히, 전원 공급부(145)는 차량의 시동이 오프된 상태에서도 상기 제 1 오브젝트의 감지 및 상기 감지된 제 1 오브젝트에 대한 위험 정보의 전송을 위해 특정 구성요소에 계속하여 전원을 공급한다.In particular, the

즉, 상기 전원 공급부(145)는 시동 오프가 된 상태에서도 프로세서(170), 통신부(120) 및 센서부(190)에 계속하여 전원을 공급한다.That is, the

즉, 일반적으로 차로의 갓길에 정차 또는 주차된 차량 사이로 오브젝트가 이동하는 경우, 상기 정차 또는 주차된 차량에 의해 상기 오브젝트가 가려지게 되며, 이에 따라 상기 갓길 주위에서 주행중인 차량이나 운전자는 상기 오브젝트를 감지하지 못하는 상황에 발생한다.That is, in general, when an object moves between vehicles parked or parked on a shoulder of a lane, the object is covered by the parked or parked vehicle, so that a vehicle or a driver, It occurs in a situation that can not be detected.

따라서, 본 발명에서는 상기와 같은 상황에서 상기 정차 또는 주차된 차량에 의해서도 상기 오브젝트의 감지 및 이에 따른 위험 정보의 전송이 이루어질 수 있도록 특정 구성요소에는 계속하여 전원 공급이 이루어지도록 한다.Accordingly, in the present invention, power is continuously supplied to specific components so that detection of the object and transmission of danger information according to the stopped or parked vehicle can be performed.

마지막으로, 차량 운전 보조장치(100)는 차량 운전 보조장치(100) 내의 각 유닛의 전반적인 동작을 제어하는 프로세서(170)를 포함할 수 있다.Finally, the vehicle driving

또한, 프로세서(170)는 응용 프로그램을 구동하기 위하여, 도 2와 함께 살펴본 구성요소들 중 적어도 일부를 제어할 수 있다. 나아가, 프로세서(170)는 상기 응용 프로그램의 구동을 위하여, 차량 운전 보조장치(100)에 포함된 구성요소들 중 적어도 둘 이상을 서로 조합하여 동작시킬 수 있다.In addition,

이러한 프로세서(170)는 하드웨어 측면에서, ASICs (application specific integrated circuits), DSPs(digital signal processors), DSPDs(digital signal processing devices), PLDs(programmable logic devices), FPGAs(field programmable gate arrays), 프로세서(170)(processors), 제어기(controllers), 마이크로 컨트롤러(micro-controllers), 마이크로 프로세서(170)(microprocessors), 기타 기능 수행을 위한 전기적 유닛 중 적어도 하나를 이용하여 구현될 수 있다.Such a

그리고 이러한 프로세서(170)는 제어부의 제어를 받거나, 제어부를 통해 차량(700)을 여러 기능을 제어할 수 있다.The

그리고 프로세서(170)는 상기 메모리(140)에 저장된 응용 프로그램과 관련된 동작 외에도, 통상적으로 차량 운전 보조장치(100)의 전반적인 동작을 제어한다. 프로세서(170)는 위에서 살펴본 구성요소들을 통해 입력 또는 출력되는 신호, 데이터, 정보 등을 처리하거나 메모리(170)에 저장된 응용 프로그램을 구동함으로써, 사용자에게 적절한 정보 또는 기능을 제공 또는 처리할 수 있다.In addition to the operations associated with the application programs stored in the

이하에서는 도 8 내지 21을 참조하여, 본 발명의 실시 예에 따른 차량 운전 보조장치(100)의 동작에 대해 보다 구체적으로 설명하기로 한다.Hereinafter, the operation of the vehicle driving

도 8은 본 발명의 실시 예에 따른 차량 운전 보조장치(100)의 위험 정보 전송 방법을 단계별로 설명하기 위한 흐름도이다.8 is a flowchart for explaining steps of transmitting the risk information of the

먼저, 도 8을 참조하면, 차량 운전 보조장치(100)는 차량(700)의 주변에 존재하는 오브젝트를 감지한다(100단계).First, referring to FIG. 8, the

상기 오브젝트는, 사각지대에서 갑자기 차선으로 진입한 보행자일 수 있고, 이와 다르게 무단횡단이나 신호가 변경되었을 때 진입하는 보행자일 수 있다.The object may be a pedestrian suddenly entering a lane in a blind spot, or alternatively a pedestrian entering when an unauthorized traverse or a signal change.

도 9는 본 발명의 실시 예에 따른 사각지대에서 진입하는 오브젝트를 설명하기 위한 도면이고, 도 10은 본 발명의 실시 예에 따른 무단횡단하는 오브젝트 또는 인식 불가한 위치에서 추월하는 오브젝트를 설명하기 위한 도면이다.FIG. 9 is a view for explaining an object entering in a blind spot according to an embodiment of the present invention, FIG. 10 is a view for explaining an object which is traversed in an unauthorized position or in an unrecognizable position according to an embodiment of the present invention FIG.

도 9를 참조하면, (a)에서와 같이, 차로에는 차량(700), 제 1 타차량(800a) 및 제 2 타차량(800b)이 주행하고 있는 상태이고, 횡단보도에는 제 1 오브젝트(900)가 상황에서, 상기 차량(700)과 제 1 타차량(800a)은 상기 제 1 오브젝트(900)를 감지할 수 있다.9, a

그러나, 상기 제 2 타차량(800b)은 상기 차량(700) 또는 상기 제 1 타차량(800a)에 가려진 상기 제 1 오브젝트(900)를 감지하지 못하는 상황이 발생할 수 있다.However, the

또한, (b)에서와 같이, 차로에는 차량(700), 제 1 타차량(800a) 및 제 2 타차량(800b)이 주행하고 있는 상태이고, 제 1 오브젝트(900)가 갑자기 차로를 통해 횡단보도로 진입하는 상황에서, 상기 차량(700)과 제 1 타차량(800a)은 상기 제 1 오브젝트(900)를 감지할 수 있다.As shown in (b), the

그러나, 상기 제 2 타차량(800b)은 상기 차량(700)에 가려진 상기 제 1 오브젝트(900)를 감지하지 못하는 상황이 발생할 수 있다.However, the

또한, 도 10을 참조하면, (a)에서와 같이, 차로에는 차량(700), 제 1 타차량(800a)이 주행하고 있는 상태이고, 제 1 오브젝트(900)가 갑자기 차로로 진입하는 무단횡단 상황에서, 상기 차량(700)은 상기 제 1 오브젝트(900)를 감지할 수 있다.10, the

그러나, 상기 제 1 타차량(800a)은 상기 차량(700)에 가려진 상기 제 1 오브젝트(900)를 감지하지 못하는 상황이 발생할 수 있다.However, the

또한, (b)에서와 같이, 차로에는 차량(700)과 제 1 타차량(800a) 및 제 1 오브젝트(900)가 주행하고 있고, 상기 제 1 오브젝트(900)가 상기 차량(700)의 전방을 통해 상기 제 1 타차량(800a)의 전방으로 추월하는 상태에서, 상기 차량(700)은 상기 제 1 오브젝트(900)의 존재 및 추월 여부를 감지할 수 있다.As shown in (b), the

그러나, 상기 제 1 타차량(800a)은 상기 차량(700)에 가려진 상기 제 1 오브젝트(900)의 존재 및 추월 여부를 감지하지 못하는 상황이 발생할 수 있다.However, the

상기와 같은 상황에서, 상기 차량(700)에 구비된 차량 운전 보조장치(100)는 상기 제 1 오브젝트(900)의 존재를 감지하고, 상기 감지한 제 1 오브젝트(900)에 대한 위험 정보를 생성하며, 상기 생성한 위험 정보를 상기 제 1 타차량(800a) 또는 제 2 타차량(800b)에 전송한다.In such a situation, the vehicle driving

이때, 상기 차량 운전 보조장치(100)는 상기 제 1 오브젝트(900)의 이동 상태를 기준으로 위험 수준을 결정하고, 상기 결정한 위험 수준에 대한 정보를 포함하여 상기 위험 정보를 생성하며, 상기 생성한 위험 정보를 전송한다.At this time, the vehicle driving assistant (100) determines a risk level based on the moving state of the first object (900), generates the risk information including information on the determined risk level, Transmit risk information.

도 11은 본 발명의 실시 예에 따른 통신 구조를 설정하기 위한 도면이다.11 is a diagram for setting a communication structure according to an embodiment of the present invention.

도 11을 참조하면, 차로에는 차량(700), 제 1 타차량(800a), 제 2 타차량(800b) 및 제 3 타차량(800c)이 주행하고 있는 상태에서, 상기 차량(700), 제 1 타차량(800a), 제 2 타차량(800b) 및 제 3 타차량(800c)은 상호 연결되어 정보를 주고 받을 수 있다.11, in a state where the

이에 따라, 제 1 오브젝트(900)의 감지는 차량(700), 제 1 타차량(800a) 및 제 2 타차량(800b)에서 이루어질 수 있으며, 상기 차량(700) 및 제 1 타차량(800a), 제 2 타차량(800b)에서 상기 감지된 제 1 오브젝트(900)에 대한 위험 정보가 상기 제 3 타차량(800c)으로 전송될 수 있다.

Accordingly, the detection of the

이를 위해, 차량 운전 보조장치(100)는 상기 오브젝트가 감지되면, 감지된 오브젝트의 존재를 알리기 위한 알림 대상을 결정한다.To this end, when the object is sensed, the vehicle driving

즉, 차량 운전 보조장치(100)는 주변에 존재하는 타차량을 감지한다(110단계). 상기 타차량은 상기 설명한 바와 같이, 상기 차량(700)의 주변에 존재하는 주변 차량일 수 있고, 이와 다르게 상기 차량(700)과 인접해있는 인접 차량일 수 있다. 그리고, 차량 운전 보조장치(100)는 상기 감지한 타차량에게 모두 상기 오브젝트의 존재를 알리기 위한 위험 정보를 전송한다.That is, the vehicle driving

이와 다르게, 상기 차량 운전 보조장치(100)는 상기 감지된 타차량 중 상기 감지된 오브젝트와 충돌 위험이 있는 타차량이 존재하는지를 판단한다(120단계).Alternatively, the

즉, 차량 운전 보조장치(100)는 상기 타차량의 이동 방향, 이동 속도 및 위치와, 상기 오브젝트의 위치, 이동 방향 및 이동 속도를 기준으로 상기 오브젝트와 충돌 가능성이 있는 타차량이 존재하는지를 감지한다.That is, the vehicle driving

그리고, 상기 오브젝트와 충돌 위험이 있는 타차량에 감지되면, 상기 차량 운전 보조장치(100)는 상기 충돌 위험이 있는 타차량에게 상기 감지된 오브젝트에 대한 위험 정보를 전송한다(130단계).If it is detected that the vehicle is in danger of collision with the object, the

또한, 상기 오브젝트와 충돌 위험이 있는 타차량이 감지되지 않으면, 다시 말해서 상기 차량 운전 보조장치(100)는 상기 오브젝트와 충돌 위험이 없는 타차량에게는 상기 오브젝트의 존재를 알리는 경고 정보만을 전송할 수 있다(160단계).In addition, if no other vehicle with a risk of collision with the object is sensed, in other words, the

그리고, 차량 운전 보조장치(100)는 상기 오브젝트에 상기 주변에 타차량에 존재함에 따라 충돌 위험이 있음을 알리는 알림 정보를 출력한다(140단계).Then, the

또한, 차량 운전 보조장치(100)는 상기 타차량에 상기 오브젝트의 존재를 알리는 알림 정보(다시 말해서, 인디케이터)를 출력한다(150단계).In addition, the

한편, 도로 위에는 지능형 교통 시스템(ITS)을 갖춘 서버(500)가 존재한다. 상기 서버(500)는 상기 도로 위에 존재하는 교통 신호등 등을 관리한다.On the road, there is a

이에 따라, 상기 차량 운전 보조장치(100)는 상기 오브젝트에 대한 위험 정보가 생성되면, 상기 서버(500)로 상기 생성한 위험 정보를 전송한다.Accordingly, the

도 12는 본 발명의 실시 예에 따른 서버(500)와 차량들 사이의 통신 구조를 설명하기 위한 도면이다.12 is a view for explaining a communication structure between the

도 12를 참조하면, 도로 위에는 서버(500)가 구비되고, 상기 구비된 서버와, 상기 도로 위를 주행하는 차량들은 상호 데이터를 주고 받을 수 있다.Referring to FIG. 12, a

이에 따라, 상기 차량 운전 보조장치(100)는 상기 생성한 위험 정보를 상기 타차량뿐 아니라, 상기 서버(500)로도 전송한다. 즉, 보행 신호가 변경되기 직전에도 횡단보도에 진입하는 오브젝트가 검출된 경우, 상기 보행 신호의 변경에 따라 상기 오브젝트가 위험에 노출될 수 있다. 따라서, 상기 차량 운전 보조장치(100)는 상기 오브젝트의 위험 정보를 상기 서버(500)에 전송하여, 상기 서버(500)를 통해 상기 보행 신호가 일정 시간 연장될 수 있도록 하여 상기 오브젝트의 안전을 확보할 수 있도록 한다.Accordingly, the vehicle driving

한편, 상기 차량 운전 보조장치(100)는 상기 위험 정보를 전송할 때, 상기 오브젝트와 상기 타차량 사이의 위치 관계에 따른 위험 정도를 검출하고, 상기 검출한 위험 정도에 대한 정보가 포함된 상기 위험 정보를 전송한다.Meanwhile, when the vehicle driving

도 13은 본 발명의 실시 예에 따른 위험 정도를 설명하기 위한 도면이다.13 is a diagram for explaining the degree of danger according to the embodiment of the present invention.

도 13을 참조하면, 차량(700)을 기준으로 주변에는 제 1 타차량(800a) 및 제 2 타차량(800b)이 존재한다.Referring to FIG. 13, the

이때, 상기 차량(700)의 주변 영역은 위치에 따라 복수의 영역으로 구분되고, 상기 구분된 복수의 영역에는 서로 다른 위험 정도가 설정된다. 예를 들어, 상기 복수의 영역 중 상기 차량(700)과 가까운 영역은 높은 위험 정도가 설정되고, 상기 차량(700)과 다소 먼 영역은 보다 낮은 위험 정도가 설정된다.At this time, the peripheral region of the

다시 말해서, 상기 차량(700)을 중심으로, 주변 영역은 제 1 영역(Z1), 제 2 영역(Z2) 및 제 3 영역(Z3)으로 구분될 수 있다. 그리고, 상기 제 1 영역(Z1)은 크리티컬 존에 속하여 이에 따른 높은 위험 정도가 설정되고, 제 2 영역(Z2)은 메이저 존에 속하여, 이에 따른 중간 정도의 위험 정도가 설정되며, 제 3 영역(Z3)은 마이너 존에 속하여, 이에 따른 보다 낮은 위험 정도가 설정된다.In other words, around the

이에 따라, 상기 차량 운전 보조장치(100)는 상기 제 1 타차량(800a) 및 제 2 타차량(800b)에게 오브젝트에 대한 위험 정보를 전송하는데, 상기 제 1 타차량(800a) 및 제 2 타차량(800b)에게 각각 전송되는 위험 정보는 서로 다르다. 즉, 상기 제 1 타차량(800a)은 크리티컬 존에 위치하여, 이에 따라 높은 위험 정도를 포함하는 위험 정보가 전송되고, 상기 제 2 타차량(800b)은 마이너 존에 위치하여, 이에 따라 낮은 위험 정도를 포함하는 위험 정보가 전송된다.Accordingly, the vehicle driving

한편, 상기 차량 운전 보조장치(100)는 상기 오브젝트와 상기 타차량 사이의 위치 관계에 따른 충돌 소요 시간을 검출하고, 상기 검출한 충돌 시간에 대한 정보를 포함한 위험 정보를 전송한다.Meanwhile, the vehicle driving

또한, 상기 차량 운전 보조장치(100)는 외부의 타차량에서 전송되는 위험 정보를 수신할 수도 있다. 이에 따라, 자신의 디스플레이부(183) 또는 타차량의 디스플레이부에는 상기 오브젝트에 대한 위험 정보가 표시된다.In addition, the vehicle driving

도 14는 본 발명의 실시 예에 따른 내부 디스플레이부를 통해 표시되는 위험 정보를 설명하기 위한 도면이다.14 is a view for explaining danger information displayed through an internal display unit according to an embodiment of the present invention.

도 14를 참조하면, 디스플레이부(183)에는 상기 위험 정보를 나타내는 오브젝트에 대한 종류를 나타내는 제 1 정보(IF1)와, 자신의 차량과 상기 오브젝트 사이의 거리에 따른 충돌 소요 시간을 나타내는 제 2 정보(IF2)와, 상기 충돌 시간에 따라 자동 활성화되는 차량 기능을 나타내는 제 3 정보(IF3)가 표시된다.Referring to FIG. 14, the

이때, 상기 차량 기능은 자동 풀 브레이크 기능을 포함할 수 있다.At this time, the vehicle function may include an automatic full brake function.

예를 들어, 상기 차량의 현재 속도와, 상기 충돌 소요 시간을 토대로 현 시점에서 브레이트가 작동한다 하더라도, 상기 브레이크 동작 압력이 부족하여 상기 충돌 소요 시간 내에 상기 차량이 멈추지 못하는 경우, 상기 차량 운전 보조장치(100)는 자동으로 풀 브레이크를 동작시켜 상기 차량이 상기 오브젝트와 충돌 전에 멈출 수 있도록 한다.For example, when the brake operation pressure is insufficient and the vehicle can not be stopped within the collision required time even if the brake is operated at the present time based on the current speed of the vehicle and the collision required time, (100) automatically activates the full brake so that the vehicle can stop before colliding with the object.

한편, 상기 차량 운전 보조장치(100)는 상기 설명한 바와 같은 알림 정보를 출력할 수 있다. 상기 알림 정보는 오브젝트에게 제공되는 정보일 수 있으며, 이와 다르게 상기 타차량에게 제공되는 정보일 수 있다.On the other hand, the vehicle driving

도 15 내지 도 19는 본 발명의 실시 예에 따른 알림 정보를 설명하기 위한 도면이다. 15 to 19 are diagrams for explaining notification information according to an embodiment of the present invention.

도 15를 참조하면, 상기 차량 운전 보조장치(100)는 상기 오브젝트에게 주변에 존재하는 타차량의 존재를 알리기 위해 경적(E1)을 발생시킬 수 있다. 이에 따라, 상기 오브젝트의 주의를 잠시라도 상기 차량(700)에게 유도시킨다.Referring to FIG. 15, the

도 16을 참조하면, 상기 차량 운전 보조장치(100)는 윈드 쉴드(W)에 존재하는 워셔액 분사기를 동작시켜 워셔액이 분사(E2)되도록 하여, 상기 오브젝트의 시선을 유도한다. 이와 다르게, 차량 운전 보조장치(100)는 헤드 램프에 존재하는 워셔액 분사기를 동작시키고 그에 따라 안개를 발생시켜(E3), 상기 오브젝트의 시선을 유도한다.Referring to FIG. 16, the vehicle driving

도 17을 참조하면, 상기 차량 운전 보조장치(100)는 상기 오브젝트가 존재하는 방향으로 광(E4)이 발생하도록 램프 구동 신호를 발생한다. 이때, 상기 광(E4)은 야간 도로에서 상기 오브젝트가 감지됨에 따라 주변 차량들이 상기 오브젝트를 쉽게 인식할 수 있도록 하기 위함이다. 또한, 상기 차량 운전 보조장치(100)는 상기 오브젝트의 감지가 용이하게 이루어질 수 있도록 상기 광(E4)의 색상을 변경할 수 있다. 이때, 차량 운전 보조장치(100)는 상기 오브젝트에게 불편함을 주지 않기 위해, 상기 오브젝트의 가슴 높이 까지만 상기 광을 발생시킨다. 그리고, 상기 차량 운전 보조장치(100)는 상기 오브젝트가 이동함에 따라 상기 오브젝트의 이동 방향으로 상기 광의 위치를 변경한다.Referring to FIG. 17, the

또한, 도 18을 참조하면, 상기 차량 운전 보조장치(100)는 사이드 미러에 구비된 디스플레이부(183)를 통해 주변 차량에게 상기 오브젝트의 존재를 알리기 위한 알림 정보를 출력한다.Referring to FIG. 18, the vehicle driving

이때, 도 18의 (a)와 같이, 상기 알림 정보는 상기 오브젝트의 존재에 따라 멈춤 신호를 발생시키기 위한 멈춤 정보(E5)일 수 있으며, 이와 다르게 (b)와 같이 상기 오브젝트의 종류에 대한 아이콘(E6)일 수 있다.18 (a), the notification information may be stop information E5 for generating a stop signal according to the existence of the object. Alternatively, as shown in (b) of FIG. 18, (E6).

또한, 도 19를 참조하면, 상기 차량 운전 보조장치(100)는 상기 설명한 바와 같이, 레이저를 통해 차량 외부로 특정 인디케이터(E7)를 출력한다.Referring to FIG. 19, the vehicle driving

한편, 상기 전송되는 위험 정보는 상기 설명한 위험 수준에 대한 정보나, 위험 정도에 대한 정보뿐 아니라, 오브젝트의 위치 정보, 이동 상태 정보를 더 포함할 수 있으며, 이에 따라 타차량에서 보다 정확한 오브젝트의 감지가 이루어질 수 있도록 한다.The transmitted risk information may further include not only the above-described information on the risk level, but also information on the degree of danger, as well as location information and movement state information of the object. Accordingly, .

한편, 상기 차량 운전 보조장치(100)는 디스플레이부(183)를 통해 주변 교통 상황에 대한 이미지를 표시하고, 상기 표시된 이미지를 이용하여 상기 오브젝트의 위험 정보의 전송 여부 및 전송 대상을 결정할 수 있다.Meanwhile, the vehicle driving

도 20 및 도 21은 본 발명의 실시 예에 따른 교통 상황 이미지를 나타낸 도면이다.20 and 21 are views showing a traffic situation image according to an embodiment of the present invention.

도 20 및 도 21을 참조하면, 차량(700)을 기준으로 도로 위에는 다수의 오브젝트가 위치하고 있다. 그리고, 상기 다수의 오브젝트는 상기 도로 위에서 이동한다.Referring to FIGS. 20 and 21, a plurality of objects are positioned on the road based on the

이때, 상기 차량 운전 보조장치(100)는 상기 교통 상황 이미지를 생성하기 위해, 내부의 센서부를 활용하거나, 외부에서 다양한 정보를 수신할 수 있다.At this time, the vehicle driving

즉, 상기 차량 운전 보조장치(100)는 도로 위에서 이동하는 오브젝트 및 상기 오브젝트의 위험 정보를 획득하기 위해, 서버 정보, 전방 카메라, 후속 차량 정보, 전방 차량 정보, 대항 차량 정보, TSR(Traffic Sign Recognition), 신호등 정보 등을 수집한다.That is, the vehicle driving

그리고, 상기 차량 운전 보조장치(100)는 상기 획득한 정보를 이용하여 현재 자신의 차량(700)을 중심으로 주변에 배치된 다양한 오브젝트의 정보를 포함하는 이미지를 표시한다.Then, the vehicle driving

이때, 상기 이미지는 복수의 영역으로 분할되고, 상기 분할된 영역 중 상기 각각의 오브젝트의 위치에 대응하는 영역에 해당 오브젝트의 정보가 표시된다.At this time, the image is divided into a plurality of areas, and information of the corresponding objects is displayed in an area corresponding to the position of each of the divided areas.

이때, 상기 오브젝트의 정보는 상기 오브젝트의 위험 정도에 따라 서로 다른 방향으로 상기 이미지 상에 표시된다. 다시 말해서, 상기 이미지 상에서 상기 분할된 영역 중 상기 오브젝트에 대한 정보가 표시되는 영역은 상기 오브젝트의 위험 정도에 따라 서로 다른 색상 또는 패턴으로 구분되어 표시된다.At this time, the information of the object is displayed on the image in different directions depending on the degree of danger of the object. In other words, an area in which the information on the object is displayed among the divided areas on the image is displayed in a different color or pattern according to the degree of danger of the object.

예를 들어, 위험 정도가 높은 오브젝트가 위치한 영역은 빨간색으로 표시되고, 위험 정도가 낮은 오브젝트가 위치한 영역은 파란색으로 표시될 수 있다. 이와 다르게 도 21에 도시된 바와 같이 상기 위험 정도에 따라 서로 다른 패턴으로 표시할 수도 있다.For example, the area where the high-risk object is located is displayed in red, and the area where the low-risk object is located may be displayed in blue. Alternatively, as shown in FIG. 21, different patterns may be displayed according to the degree of danger.

그리고, 상기 차량 운전 보조장치(100)는 상기 이미지 상에서 서로 다른 오브젝트가 표시된 영역이 서로 중첩되는 경우, 다시 말해서, 제 1 오브젝트가 표시된 영역과, 제 2 오브젝트가 표시된 영역이 서로 중첩되는 경우, 상기 제 1 오브젝트와 제 2 오브젝트에게 상호 충돌 위험이 있음을 알리는 정보를 전송한다.When the areas in which the different objects are displayed on the image overlap each other, that is, when the area in which the first object is displayed and the area in which the second object are displayed overlap each other, Information indicating that there is a risk of mutual collision is transmitted to the first object and the second object.

다시 말해서, 상기 영역이 서로 중첩되는 경우는 상기 제 1 오브젝트와 제 2 오브젝트가 서로 충돌됨을 의미하므로, 상기 차량 운전 보조장치(100)는 상기 영역의 중첩에 따라 상기 충돌 위험 정보를 전송한다.In other words, when the areas overlap each other, it means that the first object and the second object collide with each other. Therefore, the

이때, 상기 이미지 상에서 분할된 영역 중 오브젝트가 위치하지 않은 영역은 빈 영역으로 표시된다. 여기에서, 상기 빈 영역은 상기 차량이 이동할 수 있는 안전 영역과, 이동할 수 없거나 이동 위험이 있는 위험 영역으로 구분될 수 있다.At this time, an area where the object is not located among the divided areas on the image is displayed as a blank area. Here, the free area may be classified into a safe area in which the vehicle can move, and a danger area in which the vehicle can not move or is in danger of moving.

이에 따라, 상기 차량 운전 보조장치(100)는 상기와 같이 주변에서 충돌 위험이 있으면, 상기 이미지 상에서 빈 영역 중 안전 영역에 대응하는 위치로 상기 차량의 이동이 이루어지도록 하여, 상기 충돌에 따라 발생할 수 있는 위험 상황을 사전에 방지할 수 있도록 한다.Accordingly, if there is a risk of a collision in the surroundings as described above, the vehicle driving

본 발명에 따른 실시 예에 의하면, 카메라 영상을 통해 차선에 진입한 오브젝트(예를 들어, 보행자, 자전거 및 오토바이 등)를 검출하고, 상기 검출한 오브젝트의 이동 방향을 예측하여 주변 차량 및 보행자에 위험 정보를 전달해줌으로써, 예측하기 어려운 위치에서 진입하는 보행자의 사고 발생률을 감소시킬 수 있다.According to the embodiment of the present invention, it is possible to detect an object (for example, a pedestrian, a bicycle, a motorcycle or the like) that has entered a lane through a camera image, predict a moving direction of the detected object, By transmitting the information, it is possible to reduce the accident occurrence rate of the pedestrian entering from a position difficult to predict.

또한, 본 발명에 따른 실시 예에 의하면 차량간 통신 기술 및 보행자 어시스트 기능을 활용함으로써, 보다 안정적인 주행 환경을 제공할 수 있다.Further, according to the embodiment of the present invention, by utilizing the inter-vehicle communication technology and the pedestrian assist function, a more stable driving environment can be provided.

도 22를 참조하면, 전술한 차량 운전 보조장치(100)는 차량 내에 포함될 수 있다.Referring to Fig. 22, the above-described vehicle driving

자세히, 차량(700)은 통신부(710), 입력부(720), 센싱부(760), 출력부(740), 차량 구동부(750), 메모리(730), 인터페이스부(780), 제어부(770), 전원부(790), 차량 운전 보조장치(100) 및 AVN 장치(400)를 포함할 수 있다. 여기서, 차량 운전 보조장치(100)의 유닛과 차량(700)의 유닛 중 중복되는 유닛은 차량에 구비된 것으로 설명하나, 이에 한정되지는 않는다.The

통신부(710)는, 차량과 이동 단말기(600) 사이, 차량과 외부 서버(510) 사이 또는 차량과 타차량(520)과의 무선 통신을 가능하게 하는 하나 이상의 모듈을 포함할 수 있다. 또한, 통신부(710)는 차량을 하나 이상의 망(network)에 연결하는 하나 이상의 모듈을 포함할 수 있다.The

통신부(710)는, 방송 수신 모듈(711), 무선 인터넷 모듈(712), 근거리 통신 모듈(713), 위치 정보 모듈(714) 및 광통신 모듈(715)을 포함할 수 있다.The

방송 수신 모듈(711)은, 방송 채널을 통하여 외부의 방송 관리 서버로부터 방송 신호 또는 방송 관련된 정보를 수신한다. 여기서, 방송은 라디오 방송 또는 TV 방송을 포함한다.The