KR20160088223A - Method and apparatus for pose correction on face image - Google Patents

Method and apparatus for pose correction on face imageDownload PDFInfo

- Publication number

- KR20160088223A KR20160088223AKR1020150171235AKR20150171235AKR20160088223AKR 20160088223 AKR20160088223 AKR 20160088223AKR 1020150171235 AKR1020150171235 AKR 1020150171235AKR 20150171235 AKR20150171235 AKR 20150171235AKR 20160088223 AKR20160088223 AKR 20160088223A

- Authority

- KR

- South Korea

- Prior art keywords

- dimensional

- landmarks

- posture

- face image

- face

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

Images

Classifications

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T13/00—Animation

- G06T13/20—3D [Three Dimensional] animation

- G06T13/40—3D [Three Dimensional] animation of characters, e.g. humans, animals or virtual beings

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/20—Special algorithmic details

- G06T2207/20092—Interactive image processing based on input by user

- G06T2207/20101—Interactive definition of point of interest, landmark or seed

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/30—Subject of image; Context of image processing

- G06T2207/30196—Human being; Person

- G06T2207/30201—Face

Landscapes

- Processing Or Creating Images (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- Image Analysis (AREA)

- Image Processing (AREA)

Abstract

Translated fromKoreanDescription

Translated fromKorean아래의 실시예들은 얼굴 영상의 자세를 보정하는 방법 및 장치에 관한 것이다.The following embodiments relate to a method and apparatus for correcting the posture of a facial image.

얼굴 식별은 사용자를 인증하는 데에 사용되는 방법 중 하나로서, 예를 들어, HCI(Human-Computer Interaction), 금융 등 많은 영역에 광범위하게 응용되고 있다. 수집한 얼굴 영상과 데이터베이스에 저장된 얼굴 영상 간의 매칭(matching)을 통해 얼굴을 식별할 수 있으나, 통제를 받지 않는 조건에서 수집한 얼굴의 자세가 다양하게 변화되는 것은 피할 수 없다. 예를 들어, 수집한 얼굴 영상이 정면이 아니고 일정한 각도를 이루었을 때 얼굴 영상을 식별하는 것은 매우 어렵다.Face identification is one of the methods used to authenticate a user and is widely applied to many areas such as HCI (Human-Computer Interaction) and finance. The face can be identified through matching between the collected face image and the face image stored in the database, but it is inevitable that the face posture collected under the uncontrolled condition varies in various ways. For example, it is very difficult to identify a facial image when the collected facial image has a certain angle rather than a frontal view.

일 측에 따르면, 얼굴 영상의 자세를 보정하는 방법은 2차원 얼굴 영상으로부터 2차원 랜드마크들을 검출하는 단계; 상기 2차원 랜드마크들에 기초하여 3차원 얼굴 모델의 초기 자세를 결정함으로써, 상기 3차원 얼굴 모델에 포함된 3차원 랜드마크들을 설정하는 단계; 상기 3차원 얼굴 모델의 자세 및 형상을 반복적으로 조절함으로써, 상기 3차원 랜드마크들을 갱신하는 단계; 및 상기 갱신된 3차원 랜드마크들에 기초하여 상기 2차원 얼굴 영상의 자세(pose)를 보정하는 단계를 포함한다.According to one aspect, a method of correcting a posture of a face image includes: detecting two-dimensional landmarks from a two-dimensional face image; Setting three-dimensional landmarks included in the three-dimensional face model by determining an initial posture of the three-dimensional face model based on the two-dimensional landmarks; Updating the three-dimensional landmarks by repeatedly adjusting the posture and shape of the three-dimensional face model; And correcting a pose of the two-dimensional face image based on the updated three-dimensional landmarks.

상기 3차원 랜드마크들을 설정하는 단계는 상기 2차원 랜드마크들에 기초하여 상기 3차원 얼굴 모델의 초기 자세(initial pose)를 나타내는 초기 기하 파라미터(initial geometric parameter)를 결정하는 단계를 포함할 수 있다.The step of setting the 3D landmarks may include determining an initial geometric parameter indicative of an initial pose of the 3D face model based on the 2D landmarks .

상기 초기 기하 파라미터는 상기 3차원 얼굴 모델의 초기 자세 정보를 포함하고, 상기 초기 자세 정보는 상기 3차원 얼굴 모델에 대한 회전(roll) 정보, 척도(pitch) 정보, 및 평행 이동(yaw) 정보를 포함하는 자세 정보 벡터에 의해 표현될 수 있다.The initial geometric parameter includes initial position information of the 3D face model, and the initial position information includes roll information, pitch information, and yaw information for the 3D face model. And can be represented by an included posture information vector.

상기 초기 기하 파라미터를 결정하는 단계는 상기 2차원 랜드마크들에 기초하여 상기 2차원 랜드마크들의 초기 가중치를 결정하는 단계; 및 상기 초기 가중치, 상기 2차원 랜드마크들, 및 상기 3차원 랜드마크들에 기초하여, 제1 에너지 함수를 최소화하는 상기 초기 기하 파라미터를 결정하는 단계를 포함할 수 있다.Wherein determining the initial geometric parameter comprises: determining an initial weight of the two-dimensional landmarks based on the two-dimensional landmarks; And determining the initial geometric parameter that minimizes the first energy function based on the initial weight, the two-dimensional landmarks, and the three-dimensional landmarks.

상기 초기 가중치를 결정하는 단계는 상기 2차원 랜드마크들 각각에 대하여, 미리 저장된 얼굴 영상 데이터베이스에 저장된 2차원 얼굴 샘플 영상의 실제 검출된 랜드마크와 상기 2차원 랜드마크 사이의 편차(deviation)를 측정하는 단계; 및 상기 측정된 편차에 기초하여 상기 2차원 랜드마크들의 초기 가중치를 결정하는 단계를 포함할 수 있다.The method of

상기 측정된 편차에 기초하여 상기 2차원 랜드마크들의 초기 가중치를 결정하는 단계는 상기 측정된 편차를 기초로 상기 2차원 랜드마크들을 정렬하는 단계; 상기 정렬된 2차원 랜드마크들 중 상기 측정된 편차가 미리 설정된 기준보다 높은 값을 가지는 일부 2차원 랜드마크들을 선택하는 단계; 및 상기 일부 2차원 랜드마크들에게 상기 측정된 편차와 반비례하게 상기 초기 가중치를 할당하는 단계를 포함할 수 있다.Wherein determining the initial weights of the two-dimensional landmarks based on the measured deviations comprises: aligning the two-dimensional landmarks based on the measured deviations; Selecting some of the aligned two-dimensional landmarks, wherein the measured deviation has a value higher than a predetermined reference; And assigning the initial weights to the 2D landmarks in inverse proportion to the measured deviation.

상기 얼굴 영상 데이터베이스는 복수 개의 2차원 얼굴 샘플 영상들, 상기 2차원 얼굴 샘플 영상의 실제 검출된 랜드마크들, 및 상기 2차원 얼굴 샘플 영상들에서 실제 측정된 기하 파라미터 중 적어도 하나를 포함할 수 있다.The face image database may include at least one of a plurality of two-dimensional face sample images, actual detected landmarks of the two-dimensional face sample image, and geometric parameters actually measured in the two-dimensional face sample images .

상기 3차원 랜드마크들을 갱신하는 단계는 상기 초기 기하 파라미터에 기초하여 상기 3차원 랜드마크들을 갱신하는 단계; 상기 갱신된 3차원 랜드마크들의 가중치를 결정하는 단계; 및 상기 가중치에 기초하여, 제2 에너지 함수를 최소화하는 상기 3차원 얼굴 모델의 기하 파라미터 및 형상 파라미터를 결정하는 단계를 포함할 수 있다.Wherein updating the three-dimensional landmarks comprises: updating the three-dimensional landmarks based on the initial geometric parameter; Determining a weight of the updated three-dimensional landmarks; And determining geometric parameters and shape parameters of the three-dimensional face model that minimize the second energy function based on the weights.

상기 초기 기하 파라미터에 기초하여 상기 3차원 랜드마크들을 갱신하는 단계는 상기 초기 기하 파라미터에 기초하여 상기 3차원 얼굴 모델의 자세를 조정(adjust)하는 단계; 상기 자세가 조정된 3차원 얼굴 모델을 2차원으로 투영하여 2차원 텍스처 영상을 획득하는 단계; 상기 2차원 텍스처 영상으로부터 새로운 2차원 랜드마크들을 검출하는 단계; 상기 새로운 2차원 랜드마크들에 대응되는 상기 3차원 랜드마크들을 탐색하는 단계; 및 상기 탐색된 3차원 랜드마크들에 의해 상기 3차원 랜드마크들을 갱신하는 단계를 포함할 수 있다.Wherein updating the three-dimensional landmarks based on the initial geometric parameter comprises: adjusting an orientation of the three-dimensional face model based on the initial geometric parameter; A step of projecting the three-dimensional face model with the posture adjusted in two dimensions to obtain a two-dimensional texture image; Detecting new two-dimensional landmarks from the two-dimensional texture image; Searching for the three-dimensional landmarks corresponding to the new two-dimensional landmarks; And updating the three-dimensional landmarks by the searched three-dimensional landmarks.

상기 갱신된 3차원 랜드마크들의 가중치를 결정하는 단계는 상기 초기 기하 파라미터로부터 상기 3차원 얼굴 모델의 현재 자세 정보를 획득하는 단계; 미리 저장된 얼굴 영상 데이터베이스에서 상기 3차원 얼굴 모델의 현재 자세 정보에 인접한 자세 정보를 검색하는 단계; 상기 얼굴 영상 데이터베이스에서 상기 인접한 자세 정보에 대응되는 2차원 얼굴 샘플 영상을 검색하는 단계; 및 상기 검색된 2차원 얼굴 샘플 영상에 대응하는 2차원 랜드마크들과 상기 새로운 2차원 랜드마크들 사이의 제2 편차에 기초하여 상기 2차원 랜드마크의 가중치를 결정하는 단계를 포함할 수 있다.Wherein the step of determining the weight of the updated three-dimensional landmarks comprises: obtaining current position information of the three-dimensional face model from the initial geometric parameter; Retrieving posture information adjacent to the current posture information of the three-dimensional face model in a previously stored facial image database; Searching a two-dimensional face sample image corresponding to the adjacent posture information in the face image database; And determining a weight of the two-dimensional landmark based on the second deviation between the two-dimensional landmarks corresponding to the searched two-dimensional face sample image and the new two-dimensional landmarks.

상기 2차원 랜드마크의 가중치를 결정하는 단계는 상기 제2 편차의 평균값을 산출하는 단계; 및 상기 제2 편차의 평균값에 반비례하여 상기 2차원 랜드마크의 가중치를 결정하는 단계를 포함할 수 있다.Wherein determining the weight of the two-dimensional landmark comprises: calculating an average value of the second deviation; And determining a weight of the two-dimensional landmark in inverse proportion to the average value of the second deviation.

상기 현재 자세 정보에 인접한 자세 정보는 상기 현재 자세 정보와 상기 인접한 자세 정보 사이의 편차가 미리 설정된 한계값 범위 내에 있는 자세 정보를 포함할 수 있다.The attitude information adjacent to the current attitude information may include attitude information in which a deviation between the current attitude information and the adjacent attitude information is within a preset threshold value range.

상기 3차원 랜드마크들을 갱신하는 단계는 상기 3차원 얼굴 모델에 대하여 i-2번째 반복 수행에서 획득한 기하 파라미터와 i-1번째 반복 수행에서 획득한 기하 파라미터 사이의 편차가 미리 설정된 임계치보다 작은지 여부, 또는 상기 반복 수행의 횟수가 미리 설정된 횟수에 도달했는지 여부에 기초하여 상기 3차원 얼굴 모델의 자세 및 형상을 반복적으로 조절하는 단계를 포함할 수 있다.The updating of the 3D landmarks may include updating the 3D landmarks by determining whether the deviation between the geometric parameters obtained in the (i-2) -th iterative execution and the geometric parameters acquired in the (i-1) -th iterative execution is smaller than a predetermined threshold And repeatedly adjusting the posture and shape of the three-dimensional face model based on whether or not the number of iterations has reached a predetermined number of times.

상기 2차원 얼굴 영상의 자세를 보정하는 단계는 상기 반복 수행에 의해 최종적으로 산출된 최종 기하 파라미터 및 최종 형상 파라미터에 기초하여 상기 3차원 얼굴 모델을 재구성하는 단계; 및 상기 재구성된 3차원 얼굴 모델을 2차원으로 투영하여 상기 2차원 얼굴 영상의 자세를 보정하는 단계를 포함할 수 있다.Wherein the step of correcting the posture of the two-dimensional facial image comprises: reconstructing the three-dimensional facial model based on the final geometrical parameter and final shape parameter finally calculated by the iterative execution; And correcting the posture of the two-dimensional face image by projecting the reconstructed three-dimensional face model in two dimensions.

상기 얼굴 영상의 자세를 보정하는 방법은 상기 자세가 보정된 2차원 얼굴 영상에 대하여 배경 보존 텍스처(background preserving texture)를 맵핑하는 단계를 더 포함할 수 있다.The method of correcting the posture of the face image may further include mapping a background preserving texture to the posture-corrected two-dimensional face image.

상기 배경 보존 텍스처를 맵핑하는 단계는 상기 2차원 얼굴 영상의 픽셀 색상을 기초로, 상기 재구성된 3차원 얼굴 모델에 색상을 부여하여 3차원 텍스처 모델을 결정하는 단계; 및 상기 3차원 텍스처 모델을 2차원으로 투영한 얼굴 영상에서 얼굴 영역 이외의 배경 영역에 대한 픽셀 색상을 결정하는 단계를 포함할 수 있다.Wherein mapping the background preservation texture comprises: determining a three-dimensional texture model by applying a color to the reconstructed three-dimensional face model based on pixel colors of the two-dimensional face image; And determining a pixel color for a background area other than the face area in the face image in which the three-dimensional texture model is projected two-dimensionally.

상기 3차원 텍스처 모델을 결정하는 단계는 상기 최종 기하 파라미터 및 상기 최종 형상 파라미터에 기초하여 상기 2차원 얼굴 영상에 상기 재구성된 3차원 얼굴 모델의 정점들(vertexes)을 피팅(fitting)하는 단계; 상기 재구성된 3차원 얼굴 모델의 정점들에 상기 피팅된 2차원 얼굴 영상의 텍스처를 할당하는 단계; 상기 최종 기하 파라미터 및 상기 최종 형상 파라미터에 기초하여, 상기 3차원 얼굴 모델에서 가려진 정점(occluded vertex)을 결정하는 단계; 및 상기 가려진 정점에 대한 텍스처를 할당하는 단계를 포함할 수 있다.Wherein determining the 3D texture model comprises: fitting vertices of the reconstructed 3D face model to the 2D face image based on the final geometry parameter and the final shape parameter; Assigning a texture of the fitted two-dimensional face image to vertices of the reconstructed three-dimensional face model; Determining an occluded vertex in the 3D face model based on the final geometry parameter and the final shape parameter; And assigning a texture for the hidden vertex.

상기 가려진 정점에 대한 텍스처를 할당하는 단계는 상기 3차원 얼굴 모델에서 상기 가려진 정점의 대칭점이 가려졌는지 여부를 판단하는 단계; 및 상기 판단 결과, 상기 대칭점이 가려졌다면, 상기 3차원 텍스처 모델의 텍스처 값의 평균을 상기 정점에 할당하고, 상기 대칭점이 가려지지 않았다면, 상기 대칭점의 텍스처를 상기 가려진 정점에 할당하는 단계를 포함할 수 있다.Wherein the step of assigning the texture to the obscured vertex comprises: determining whether the symmetry of the obscured vertex is obscured in the 3D face model; And assigning an average of texture values of the 3D texture model to the vertexes if the symmetry points are obscured as a result of the determination, and assigning the texture of the symmetry points to the obscured vertices if the symmetry points are not occluded .

상기 배경 영역에 대한 픽셀 색상을 결정하는 단계는 상기 2차원으로 투영한 얼굴 영상에서 상기 배경 영역에 대한 추가 랜드마크들을 설정하는 단계; 상기 3차원 텍스처 모델에서 상기 추가 랜드마크들의 대응점을 검색하는 단계; 및 구간적 아핀 변환(piece-wise affine transformation)을 수행하여 상기 추가 랜드마크들의 대응점에 대한 색상 값을 획득하는 단계를 포함할 수 있다.Determining pixel color for the background region comprises: setting additional landmarks for the background region in the two-dimensionally projected face image; Retrieving a corresponding point of the additional landmarks in the 3D texture model; And performing a piece-wise affine transformation to obtain a color value for a corresponding point of the additional landmarks.

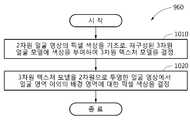

도 1은 일 실시예에 따른 2차원 얼굴 영상과 3차원 얼굴 모델에서 대응하는 랜드마크들을 나타낸 도면.

도 2는 일 실시예에 따른 얼굴 영상의 자세를 보정하는 방법을 나타낸 흐름도.

도 3은 일 실시예에 따른 3차원 랜드마크들을 설정하는 방법을 나타낸 흐름도.

도 4는 일 실시예에 따른 얼굴 영상 데이터베이스에 저장된 2차원 얼굴 샘플 영상들을 나타낸 도면.

도 5는 일 실시예에 따른 3차원 랜드마크들을 갱신하는 방법을 나타낸 흐름도.

도 6은 일 실시예에 따른 초기 기하 파라미터에 기초하여 3차원 랜드마크들을 갱신하는 방법을 나타낸 흐름도.

도 7은 일 실시예에 따른 갱신된 3차원 랜드마크들의 가중치를 결정하는 방법을 나타낸 흐름도.

도 8은 일 실시예에 따른 2차원 얼굴 영상의 자세를 보정하는 방법을 나타낸 흐름도.

도 9는 다른 실시예에 따른 얼굴 영상의 자세를 보정하는 방법을 나타낸 흐름도.

도 10은 일 실시예에 따른 배경 보존 텍스처를 맵핑하는 방법을 나타낸 흐름도.

도 11은 일 실시예에 따른 3차원 텍스처 모델을 결정하는 방법을 나타낸 흐름도.

도 12는 일 실시예에 따른 가려진 정점에 대한 텍스처를 할당하는 방법을 나타낸 흐름도.

도 13은 일 실시예에 따른 배경 영역에 대한 픽셀 영상을 결정하는 방법을 나타낸 흐름도.

도 14는 다른 실시예에 따른 얼굴 영상의 자세를 보정하는 방법을 나타낸 흐름도.

도 15는 일 실시예에 따른 신뢰도를 산출하는 방법을 나타낸 흐름도.

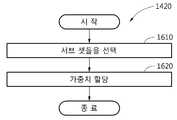

도 16은 일 실시예에 따른 랜드마크들의 가중치를 초기화하는 방법을 나타낸 흐름도.

도 17은 일 실시예에 따른 3차원 랜드마크들을 갱신하는 방법을 나타낸 흐름도.

도 18은 일 실시예에 따른 랜드마크들의 가중치를 갱신하는 방법을 나타낸 흐름도.

도 19는 일 실시예에 따른 배경 보존 텍스처를 맵핑하는 방법을 나타낸 흐름도.

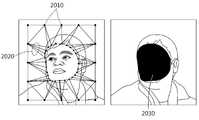

도 20은 일 실시예에 따른 배경을 워핑하는 방법을 설명하기 위한 도면.

도 21은 일 실시예에 따른 얼굴 영상의 자세를 보정하는 방법의 수행 과정에서 출력되는 영상들을 나타낸 도면.

도 22는 일 실시예에 따른 얼굴 영상의 자세를 보정하는 장치의 블록도.

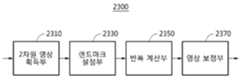

도 23은 다른 실시예에 따른 얼굴 영상의 자세를 보정하는 장치의 블록도.BRIEF DESCRIPTION OF THE DRAWINGS FIG. 1 is a diagram illustrating a two-dimensional face image and corresponding landmarks in a three-dimensional face model according to an exemplary embodiment; FIG.

2 is a flowchart illustrating a method of correcting a posture of a face image according to an exemplary embodiment.

3 is a flow diagram illustrating a method for setting three-dimensional landmarks according to one embodiment.

4 illustrates two-dimensional face sample images stored in a facial image database according to one embodiment.

5 is a flow diagram illustrating a method for updating three-dimensional landmarks according to an embodiment;

6 is a flow diagram illustrating a method for updating three-dimensional landmarks based on an initial geometric parameter in accordance with an embodiment.

7 is a flow diagram illustrating a method for determining weights of updated three-dimensional landmarks according to an embodiment;

8 is a flowchart illustrating a method of correcting a posture of a two-dimensional face image according to an exemplary embodiment.

9 is a flowchart illustrating a method of correcting a posture of a face image according to another embodiment.

10 is a flow diagram illustrating a method for mapping a background preservation texture according to one embodiment.

11 is a flow diagram illustrating a method for determining a three-dimensional texture model according to one embodiment.

12 is a flow diagram illustrating a method for assigning a texture to an obscured vertex according to an embodiment;

13 is a flow diagram illustrating a method for determining a pixel image for a background region according to an embodiment.

14 is a flowchart illustrating a method of correcting a posture of a face image according to another embodiment.

15 is a flow diagram illustrating a method for computing reliability in accordance with one embodiment.

16 is a flow diagram illustrating a method for initializing weights of landmarks according to an embodiment;

17 is a flow diagram illustrating a method for updating three-dimensional landmarks according to an embodiment;

18 is a flow diagram illustrating a method for updating the weights of landmarks according to an embodiment;

19 is a flow diagram illustrating a method for mapping a background preservation texture according to one embodiment.

20 is a diagram for explaining a method of warping a background according to an embodiment;

21 is a view illustrating images output in a process of performing a method of correcting a posture of a face image according to an exemplary embodiment.

22 is a block diagram of an apparatus for correcting a posture of a face image according to an embodiment;

23 is a block diagram of an apparatus for correcting a posture of a face image according to another embodiment;

본 명세서에서 개시되어 있는 특정한 구조적 또는 기능적 설명들은 단지 실시예들을 설명하기 위한 목적으로 예시된 것으로서, 실시예들은 다양한 다른 형상으로 실시될 수 있으며 본 명세서에 설명된 실시예들에 한정되지 않는다.The specific structural or functional descriptions disclosed herein are illustrated for purposes of illustration only and the embodiments may be embodied in various other forms and are not limited to the embodiments described herein.

제1 또는 제2 등의 용어를 다양한 구성요소들을 설명하는데 사용될 수 있지만, 이런 용어들은 하나의 구성요소를 다른 구성요소로부터 구별하는 목적으로만 이해되어야 한다. 예를 들어 제1 구성요소는 제2 구성요소로 명명될 수 있고, 유사하게 제2 구성요소는 제1 구성요소로도 명명될 수 있다.The terms first or second may be used to describe various elements, but such terms should be understood only for the purpose of distinguishing one element from another. For example, the first component may be referred to as a second component, and similarly, the second component may also be referred to as a first component.

어떤 구성요소가 다른 구성요소에 "연결되어" 있다거나 "접속되어" 있다고 언급된 때에는, 그 다른 구성요소에 직접적으로 연결되어 있거나 또는 접속되어 있을 수도 있지만, 중간에 다른 구성요소가 존재할 수도 있다고 이해되어야 할 것이다. 반면에, 어떤 구성요소가 다른 구성요소에 "직접 연결되어" 있다거나 "직접 접속되어" 있다고 언급된 때에는, 중간에 다른 구성요소가 존재하지 않는 것으로 이해되어야 할 것이다. 구성요소들 간의 관계를 설명하는 표현들, 예를 들어 "~간의에"와 "바로~간의에" 또는 "~에 이웃하는"과 "~에 직접 이웃하는" 등도 마찬가지로 해석되어야 한다.It is to be understood that when an element is referred to as being "connected" or "connected" to another element, it may be directly connected or connected to the other element, . On the other hand, when an element is referred to as being "directly connected" or "directly connected" to another element, it should be understood that there are no other elements in between. Expressions that describe the relationship between components, such as "between" and "between" or "neighboring to" and "directly adjacent to" should be interpreted as well.

단수의 표현은 문맥상 명백하게 다르게 뜻하지 않는 한, 복수의 표현을 포함한다. 본 명세서에서, "포함하다" 또는 "가지다" 등의 용어는 설명된 특징, 숫자, 단계, 동작, 구성요소, 부분품 또는 이들을 조합한 것이 존재함으로 지정하려는 것이지, 하나 또는 그 이상의 다른 특징들이나 숫자, 단계, 동작, 구성요소, 부분품 또는 이들을 조합한 것들의 존재 또는 부가 가능성을 미리 배제하지 않는 것으로 이해되어야 한다.The singular expressions include plural expressions unless the context clearly dictates otherwise. In this specification, the terms "comprises ", or" having ", and the like, are used to specify one or more of the described features, numbers, steps, operations, elements, But do not preclude the presence or addition of steps, operations, elements, parts, or combinations thereof.

다르게 정의되지 않는 한, 기술적이거나 과학적인 용어를 포함해서 여기서 사용되는 모든 용어들은 해당 기술 분야에서 통상의 지식을 가진 자에 의해 일반적으로 이해되는 것과 동일한 의미를 가진다. 일반적으로 사용되는 사전에 정의되어 있는 것과 같은 용어들은 관련 기술의 문맥상 가지는 의미와 일치하는 의미를 갖는 것으로 해석되어야 하며, 본 명세서에서 명백하게 정의하지 않는 한, 이상적이거나 과도하게 형식적인 의미로 해석되지 않는다.Unless otherwise defined, all terms used herein, including technical or scientific terms, have the same meaning as commonly understood by one of ordinary skill in the art. Terms such as those defined in commonly used dictionaries are to be interpreted as having a meaning consistent with the meaning of the context in the relevant art and, unless explicitly defined herein, are to be interpreted as ideal or overly formal Do not.

하기에서 설명될 실시예들은 운전자를 모니터링하는 데에 사용될 수 있다. 실시예들은 태블릿 컴퓨터, 스마트 폰, 스마트 가전 기기, 지능형 자동차, 웨어러블 장치 등 다양한 형상의 제품으로 구현될 수 있다. 예를 들어, 실시예들은 스마트 폰, 웨어러블 장치, 모바일 기기, 지능형 자동차 등에서 사용자로부터 측정된 심박수를 이용하여 사용자의 건강에 이상이 발생했다거나, 사용자가 졸고 있는지를 판단하여 적절한 대응책을 제공하는 데에 적용될 수 있다. 실시예들은 차량의 운행 모드가 자율 운행 모드 또는 수동 운전 모드 간의 전환이 가능한 지능형 자동차 등에 적용될 수 있다. 이하, 실시예들을 첨부된 도면을 참조하여 상세하게 설명한다. 각 도면에 제시된 동일한 참조 부호는 동일한 부재를 나타낸다.The embodiments described below can be used to monitor a driver. Embodiments can be implemented in various forms of products such as tablet computers, smart phones, smart home appliances, intelligent cars, and wearable devices. For example, in embodiments, smartphones, wearable devices, mobile devices, intelligent automobiles, etc. use heart rate measured by the user to determine whether the user's health is abnormal or whether the user is sleeping, and provide appropriate countermeasures Lt; / RTI > Embodiments can be applied to an intelligent vehicle or the like, in which a vehicle's operating mode can switch between an autonomous driving mode or a manual driving mode. Hereinafter, embodiments will be described in detail with reference to the accompanying drawings. Like reference symbols in the drawings denote like elements.

도 1은 일 실시예에 따른 2차원 얼굴 영상과 3차원 얼굴 모델에서 대응하는 랜드마크들을 나타낸 도면이다. 도 1(a)을 참조하면, 얼굴 자세(pose)가 정면을 바라보는 2차원 얼굴 영상(110)과 2차원 얼굴 영상에 대응되는 3차원 얼굴 모델(130)이 도시된다. 또한, 도 1(b)를 참조하면, 얼굴 자세가 정면이 아닌 2차원 얼굴 영상들(140, 160, 180)과 2차원 얼굴 영상들(140, 160, 180)에 대응되는 3차원 얼굴 모델들(150, 170, 190)이 도시된다.FIG. 1 is a diagram illustrating corresponding two-dimensional face images and corresponding landmarks in a three-dimensional face model according to an exemplary embodiment. Referring to FIG. 1 (a), a two-

2차원 얼굴 영상(110)은 촬영 장비를 이용하여 수집될 수 있다. 또한, 2차원 얼굴 영상(110)의 랜드마크들은 미리 트레이닝 한 랜드마크 검출기에 의해 자동으로 검출될 수 있다. 3차원 얼굴 모델(130)의 랜드마크들은 2차원 얼굴 영상(110)에서 검출한 랜드마크들을 3차원 얼굴 모델(130)에 대응시켜 검출할 수 있다. 2차원 얼굴 영상(110)에서 검출된 2차원 랜드마크들에 기초하여 3차원 얼굴 모델에서 2차원 랜드마크들에 대응되는 3차원 랜드마크들을 설정하는 방법은 당업자에게 잘 알려져 있으므로 이에 대한 구체적인 설명은 생략한다.The two-dimensional

이하에서는 설명의 편의를 위하여, 2차원 얼굴 영상에서 검출한 랜드마크를 '2차원 랜드마크'라고 부르고, 3차원 얼굴 모델에서 검출한 랜드마크를 '3차원 랜드마크'라고 부르기로 한다.Hereinafter, a landmark detected in a two-dimensional face image will be referred to as a " two-dimensional landmark ", and a landmark detected in a three-dimensional face model will be referred to as a " three-dimensional landmark "

도 1(a)와 같이 얼굴 자세가 정면인 경우, 2차원 랜드마크들과 3차원 랜드마크들은 서로 대응되지만, 도 1(b)와 같이, 얼굴 자세가 정면이 아닌 경우, 2차원 랜드마크들과 3차원 랜드마크들은 서로 대응 관계가 유지되지 않을 수 있다.When the face posture is the front as shown in FIG. 1 (a), the two-dimensional landmarks and the three-dimensional landmarks correspond to each other. However, And the three-dimensional landmarks may not be maintained to correspond to each other.

도 2는 일 실시예에 따른 얼굴 영상의 자세를 보정하는 방법을 나타낸 흐름도이다. 도 2를 참조하면, 일 실시예에 따른 얼굴 영상의 자세를 보정하는 장치(이하, '보정 장치')는 2차원 얼굴 영상으로부터 2차원 랜드마크들을 검출한다(210).2 is a flowchart illustrating a method of correcting a posture of a face image according to an embodiment. Referring to FIG. 2, an apparatus for correcting a posture of a face image according to an exemplary embodiment (hereinafter referred to as a 'correction apparatus') detects two-dimensional landmarks from a two-dimensional face image (210).

단계(210)에서, 보정 장치는 2차원 얼굴 영상에서 얼굴 영역의 위치를 결정할 수 있다. 보정 장치는 예를 들어, MB-LBP(Multi-scale Block Local Binary Patten) 기법과 Adaboost(adaptive Boosting) 기법의 반복 알고리즘을 결합한 얼굴 검출기를 이용하여 2차원 얼굴 영상으로부터 얼굴 영역의 위치를 결정할 수 있다.In

이후, 보정 장치는 예를 들어, ASM(Active Shape Model) 방법, AAM(Active Appearance Model) 방법, 및 SDM(Supervised Descent Method) 방법 등을 사용하여 2차원 얼굴 영상의 얼굴 영역으로부터 2차원 랜드마크들을 검출할 수 있다. 보정 장치는 SDM 방법을 사용하여 2차원 얼굴 영상의 얼굴 영역으로부터 자동으로 검출한 얼굴 부위의 특징점들을 2차원 얼굴 영상의 2차원 랜드마크들로 검출할 수 있다. 이때, 자동으로 검출한 얼굴 부위의 특징점들은 수동으로 측정한 랜드마크들의 개수와 동일할 수 있다. 보정 장치는 2차원 얼굴 영상에 대하여 예를 들어, 68개의 2차원 랜드마크들을 검출할 수 있다.Thereafter, the correction device extracts the two-dimensional landmarks from the face region of the two-dimensional face image using, for example, an Active Shape Model (ASM) method, an Active Appearance Model (AAM) method, and a Supervised Descent Method Can be detected. The correction unit can detect the feature points of the face region automatically detected from the face region of the two-dimensional face image as the two-dimensional landmarks of the two-dimensional face image by using the SDM method. At this time, the feature points of the automatically detected face region may be the same as the number of landmarks measured manually. The correction device can detect, for example, 68 two-dimensional landmarks on the two-dimensional face image.

보정 장치는 검출된 2차원 랜드마크들에 기초하여 3차원 얼굴 모델의 초기 자세를 결정함으로써, 3차원 얼굴 모델에 포함된 3차원 랜드마크들을 설정한다(220). 보정 장치는 2차원 랜드마크들에 기초하여 3차원 얼굴 모델의 초기 자세(initial pose)를 나타내는 초기 기하 파라미터(initial geometric parameter)를 결정할 수 있다. 보정 장치는 초기 기하 파라미터에 기초하여 3차원 랜드마크들을 설정할 수 있다.The correction device sets the three-dimensional landmarks included in the three-dimensional face model by determining the initial posture of the three-dimensional face model based on the detected two-dimensional landmarks (220). The correction device may determine an initial geometric parameter indicative of an initial pose of the three-dimensional face model based on the two-dimensional landmarks. The correction device may set three-dimensional landmarks based on the initial geometric parameters.

초기 기하 파라미터는 3차원 얼굴 모델의 초기 자세 정보를 포함할 수 있다. 초기 자세 정보는 3차원 얼굴 모델에 대한 회전(roll) 정보, 척도(pitch) 정보, 및 평행 이동(yaw) 정보를 포함하는 자세 정보 벡터에 의해 표현될 수 있다. 3차원 얼굴 모델의 자세 정보는 기하 파라미터에 기초하여 결정될 수 있다.The initial geometric parameters may include initial position information of the 3D face model. The initial attitude information can be represented by an attitude information vector including roll information, pitch information, and yaw information for the three-dimensional face model. The attitude information of the three-dimensional face model can be determined based on the geometric parameters.

3차원 얼굴 모델의 초기 기하 파라미터는 다양한 방법들에 의해 결정될 수 있다. 3차원 얼굴 모델의 초기 기하 파라미터는 예를 들어, 경험에 기초하여 결정되거나, 일정 규칙에 의한 계산을 통해 결정될 수도 있다. 3차원 얼굴 모델의 초기 기하 파라미터를 결정하는 방법은 후술한다. 보정 장치가 3차원 랜드마크들을 설정하는 구체적인 방법은 도 3을 참조하여 설명한다.The initial geometric parameters of the 3D face model can be determined by various methods. The initial geometric parameters of the three-dimensional face model may be determined on the basis of experience, for example, or may be determined through calculation by a predetermined rule. A method for determining the initial geometric parameters of the three-dimensional face model will be described later. The specific method by which the correction device sets three-dimensional landmarks will be described with reference to Fig.

보정 장치는 3차원 얼굴 모델의 자세 및 형상을 반복적으로 조절함으로써, 3차원 랜드마크들을 갱신한다(230). 보정 장치는 3차원 얼굴 모델의 초기 기하 파라미터를 기초로 반복 수행에 의해 3차원 랜드마크들을 갱신할 수 있다. 보정 장치는 이전 반복 과정에서 획득한 3차원 얼굴 모델의 기하 파라미터를 기초로, 3차원 랜드마크들을 갱신하고, 갱신된 3차원 랜드마크들에 기초하여 이번 반복에서의 3차원 얼굴 모델의 기하 파라미터를 획득할 수 있다.The correction device updates the three-dimensional landmarks by repeatedly adjusting the posture and shape of the three-dimensional face model (230). The correction device can update the three-dimensional landmarks by iteration based on the initial geometric parameters of the three-dimensional face model. The correction device updates the three-dimensional landmarks based on the geometric parameters of the three-dimensional face model obtained in the previous iterative process, and updates the geometric parameters of the three-dimensional face model in this repetition based on the updated three- Can be obtained.

보정 장치는 3차원 얼굴 모델의 기하 파라미터에 대한 반복 갱신을 통해 3차원 얼굴 모델의 자세를 조절할 수 있다. 다시 말해, 보정 장치는 3차원 얼굴 모델의 기하 파라미터에 기초하여 3차원 얼굴 모델의 얼굴 자세를 확정할 수 있다.The correction device can adjust the posture of the 3D face model by repeatedly updating the geometric parameters of the 3D face model. In other words, the correction device can determine the face posture of the three-dimensional face model based on the geometric parameters of the three-dimensional face model.

보정 장치는 예를 들면, 처음 반복 과정에서 3차원 얼굴 모델의 초기 기하 파라미터에 기초하여 3차원 랜드마크를 갱신하고, 갱신한 3차원 랜드마크에 기초하여 처음 반복한 3차원 얼굴 모델의 기하 파라미터를 계산할 수 있다. 다시 말하면, 보정 장치는 3차원 얼굴 모델의 초기의 기하 파라미터를 이전에 반복한 3차원 얼굴 모델의 기하 파라미터로 하여 3차원 랜드마크를 갱신하고, 갱신한 3차원 랜드마크에 기초하여 이번에 반복하는 3차원 얼굴 모델의 기하 파라미터를 계산할 수 있다.For example, in the first iterative process, the correction device updates the three-dimensional landmark based on the initial geometric parameters of the three-dimensional face model, and updates the geometric parameters of the first repeated three-dimensional face model based on the updated three- Can be calculated. In other words, the correction device updates the three-dimensional landmark with the initial geometric parameter of the three-dimensional face model as the geometric parameter of the previously repeated three-dimensional face model, and updates the three-dimensional landmark based on the updated three- The geometric parameters of the 2D face model can be calculated.

보정 장치는 갱신한 3차원 랜드마크에 기초하여 3차원 얼굴 모델의 기하 파라미터를 산출하는 과정에서, 3차원 얼굴 모델의 형상 파라미터 또한 함께 산출할 수 있다.The correction device can also calculate shape parameters of the three-dimensional face model in the process of calculating the geometrical parameters of the three-dimensional face model based on the updated three-dimensional landmark.

전술한 바와 같이 보정 장치가 3차원 랜드마크들을 갱신하는 과정은 3차원 얼굴 모델의 자세 및 형상을 반복적으로 조절함으로써 수행될 수 있으며, 이때, 반복은 반복 중지 조건을 만족하는지 여부에 의해 종료될 수 있다.As described above, the process of updating the three-dimensional landmarks by the correction device can be performed by repeatedly adjusting the posture and shape of the three-dimensional face model, wherein the iteration can be terminated by whether or not the iteration stop condition is satisfied have.

보정 장치는 예를 들어, 3차원 얼굴 모델에 대하여 i-2번째 반복 수행에서 획득한 기하 파라미터와 i-1번째 반복 수행에서 획득한 기하 파라미터 사이의 편차가 미리 설정된 임계치보다 작거나, 또는, 반복 수행의 횟수가 미리 설정된 횟수(예를 들어, n 번)에 도달한 경우에 반복을 종료할 수 있다. 여기서, i는 2보다 크거나 같은 자연수이고, n은 반복 수행 과정에서 총 반복 차수를 나타낼 수 있다.For example, if the deviation between the geometric parameter obtained in the (i-2) -th iterative execution and the geometric parameter acquired in the (i-1) -th iterative execution is smaller than a predetermined threshold value or is repeated The iteration can be terminated when the number of times of execution reaches a preset number of times (for example, n times). Where i is a natural number greater than or equal to 2, and n can represent the total repeat order in the iterative process.

이때, 기하 파라미터들 사이의 편차는 기하 파라미터들 사이의 유클리디언 거리로도 대체될 수 있다. 임계치 및 미리 설정된 횟수는 경험칙에 의해 결정되거나, 그 외의 방법에 의한 계산을 통해 결정될 수 있다.At this time, the deviation between the geometric parameters may be replaced by the Euclidean distance between the geometric parameters. The threshold value and the preset number of times can be determined by an empirical rule or can be determined through calculation by other methods.

보정 장치는 매 번의 반복 과정을 마친 후, 반복 수행이 반복 중지 조건을 만족하는지 여부를 판단할 수 있다. 반복 수행의 결과가 반복 중지 조건을 만족하는 경우, 보정 장치는 반복을 중지하고, 마지막 반복 과정에서 획득한 3차원 얼굴 모델의 기하 파라미터 및 형상 파라미터를 최종 기하 파라미터 및 형상 파라미터로 결정할 수 있다. 반복 수행의 결과가 반복 중지 조건을 만족하지 않는 경우, 보정 장치는 다음 번 반복 과정을 수행할 수 있다. 보정 장치가 3차원 랜드마크들을 갱신하는 방법은 도 5 내지 도 7을 참조하여 설명한다.After each iteration, the correction device can determine whether the iteration satisfies the iteration stop condition. If the result of the iteration satisfies the iteration stop condition, the correction device can stop the iteration and determine the geometric parameters and shape parameters of the 3D face model obtained in the last iteration process as the final geometric parameters and shape parameters. If the result of the iteration does not satisfy the iteration stop condition, the correcting device can perform the next iteration. The method by which the correction device updates the three-dimensional landmarks will be described with reference to Figs. 5 to 7. Fig.

보정 장치는 갱신된 3차원 랜드마크들에 기초하여 2차원 얼굴 영상의 자세를 보정한다(240). 보정 장치는 갱신된 3차원 랜드마크들에 기초하여 최종 반복한 3차원 얼굴 모델의 기하 파라미터를 확정하고, 확정된 기하 파라미터에 기초하여 자세 보정 후의 2차원 얼굴 영상을 확정할 수 있다. 보정 장치가 2차원 얼굴 영상의 자세를 보정하는 보다 구체적인 방법은 도 8을 참조하여 설명한다.The correction device corrects the posture of the two-dimensional face image based on the updated three-dimensional landmarks (240). The correction device can determine the geometric parameters of the finally repeated three-dimensional face model based on the updated three-dimensional landmarks, and determine the postural-correction two-dimensional face image based on the determined geometric parameters. A more specific method for the correction device to correct the posture of the two-dimensional face image will be described with reference to Fig.

일 실시예에서는 현재의 3차원 얼굴 모델의 기하 파라미터에 기초하여 3차원 랜드마크들을 갱신함으로써 현재의 3차원 얼굴 모델의 기하 파라미터에 의해 확정된 3차원 랜드마크들이 2차원 랜드마크들과 여전히 대응 관계를 유지하도록 할 수 있다. 또한, 3차원 랜드마크들에 의해 최종 확정된 3차원 얼굴 모델의 기하 파라미터는 더욱 높은 정확도를 가질 수 있다.In one embodiment, by updating the three-dimensional landmarks based on the geometric parameters of the current three-dimensional face model, the three-dimensional landmarks determined by the geometric parameters of the current three-dimensional face model still correspond to the two- Can be maintained. Further, the geometric parameters of the three-dimensional face model finalized by the three-dimensional landmarks can have higher accuracy.

일 실시예에서는 높은 정확도를 가지는 3차원 얼굴 모델의 기하 파라미터를 이용하여 자세를 보정한 2차원 얼굴 영상을 확정함으로써 자세를 보정한 2차원 얼굴 영상과 실제 정면 얼굴 영상 사이의 차이를 줄여 얼굴 인증 또는 식별 성능을 향상시킬 수 있다.In one embodiment, the two-dimensional face image corrected for the posture is determined using the geometric parameters of the three-dimensional face model having high accuracy, thereby reducing the difference between the two-dimensional face image corrected for the posture and the actual front face image, The identification performance can be improved.

도 3은 일 실시예에 따른 3차원 랜드마크들을 설정하는 방법을 나타낸 흐름도이다. 도 3을 참조하면, 일 실시예에 따른 보정 장치는 단계(210)에서 검출된 2차원 랜드마크들 각각에 대하여, 얼굴 영상 데이터베이스에 저장된 2차원 얼굴 샘플 영상의 실제 측정된 랜드마크들과 검출된 2차원 랜드마크들 사이의 편차(deviation)를 측정한다(310). 이때, 2차원 얼굴 샘플 영상의 실제 측정된 랜드마크들의 개수와 검출된 2차원 랜드마크들의 개수는 서로 동일하다.3 is a flow diagram illustrating a method for setting three-dimensional landmarks according to one embodiment. 3, for each of the detected two-dimensional landmarks in

얼굴 영상 데이터베이스는 예를 들어, 복수 개의 2차원 얼굴 샘플 영상들, 2차원 얼굴 샘플 영상의 실제 측정된 랜드마크들, 및 2차원 얼굴 샘플 영상들에서 실제 측정된 기하 파라미터 등을 포함할 수 있다. 얼굴 영상 데이터베이스에 저장된 2차원 얼굴 샘플 영상들의 일 예는 도 4에 도시된다.The face image database may include, for example, a plurality of two-dimensional face sample images, actual measured landmarks of the two-dimensional face sample image, and geometric parameters actually measured in the two-dimensional face sample images. An example of two-dimensional face sample images stored in the facial image database is shown in FIG.

보정 장치는 측정된 편차에 기초하여 2차원 랜드마크들의 초기 가중치를 결정할 수 있다.The correction device may determine an initial weight of the two-dimensional landmarks based on the measured deviation.

보정 장치는 2차원 랜드마크들 각각에 대하여 2차원 랜드마크들의 검출 값(좌표 값)와 2차원 얼굴 샘플 영상에서 대응되는 랜드마크들의 실제 좌표 값 사이의 유클리디언 거리(편차)를 계산할 수 있다. 보정 장치는 계산한 유클리디언 거리에 기초하여 2차원 랜드마크의 초기 가중치를 결정할 수 있다. 이때, 유클리디언 거리(편차)가 클수록 2차원 랜드마크들에 대한 신뢰도는 낮아지고, 유클리디언 거리(편차)가 작을수록 2차원 랜드마크들에 대한 신뢰도는 높아질 수 있다.The correction device can calculate the Euclidean distance (deviation) between the detected values (coordinate values) of the two-dimensional landmarks and the actual coordinate values of the corresponding landmarks in the two-dimensional face sample image for each of the two-dimensional landmarks . The correction device can determine the initial weight of the two-dimensional landmark based on the calculated Euclidean distance. At this time, the greater the Euclidean distance (deviation), the lower the reliability with respect to the two-dimensional landmarks, and the smaller the Euclidean distance (deviation), the higher the reliability with respect to the two-dimensional landmarks.

다른 실시예에 따르면, 보정 장치는 입력된 2차원 얼굴 영상으로부터 검출된 2차원 랜드마크들과 가장 유사한 랜드마크들을 가지는 2차원 얼굴 샘플 영상을 얼굴 영상 데이터베이스로부터 추출할 수 있다. 두 영상들(2차원 얼굴 영상 및 2차원 얼굴 샘플 영상)의 랜드마크들이 서로 유사하는 것은 두 영상들 사이에서 서로 대응되는 랜드마크들의 위치가 유사하다는 것을 의미할 수 있다. 보정 장치는 추출된 2차원 얼굴 샘플 영상의 랜드마크들의 편차를 입력 영상으로부터 검출된 2차원 랜드마크들의 편차로 설정할 수 있다. 여기서, 추출된 2차원 얼굴 샘플 영상의 랜드마크들의 편차는 미리 계산되어 데이터베이스에 저장되어 있을 수 있다. 보정 장치는 검출된 랜드마크들의 편차에 기초하여 초기 가중치를 결정할 수 있다.According to another embodiment, the correction device can extract a two-dimensional face sample image having the landmarks most similar to the two-dimensional landmarks detected from the input two-dimensional face image, from the face image database. The similarity of the landmarks of two images (two-dimensional face image and two-dimensional face sample image) may mean that the positions of corresponding landmarks are similar between two images. The correction device can set the deviation of the landmarks of the extracted two-dimensional face sample image to the deviation of the two-dimensional landmarks detected from the input image. Here, the deviation of the landmarks of the extracted two-dimensional face sample image may be calculated in advance and stored in the database. The correction device may determine the initial weight based on the deviation of the detected landmarks.

보정 장치는 측정된 편차를 기초로 2차원 랜드마크들을 정렬할 수 있다(320).The correction device may align 320 the two-dimensional landmarks based on the measured deviations.

보정 장치는 정렬된 2차원 랜드마크들 중 측정된 편차가 미리 설정된 기준보다 높은 값을 가지는 일부 2차원 랜드마크들을 선택할 수 있다(330).The correction device may select some of the two-dimensional landmarks having the measured deviation of the aligned two-dimensional landmarks higher than the predetermined reference (330).

보정 장치는 일부 2차원 랜드마크들에게 측정된 편차와 반비례하게 초기 가중치를 산출할 수 있다(340). 이때, 가중치는 가중 행렬의 형태를 가질 수 있다. 보정 장치는 예를 들어, 측정된 편차가 클수록 초기 가중치를 작게 할당하고, 측정된 편차가 작을수록, 초기 가중치를 크게 할당할 수 있다.The correction device may calculate an initial weight in inverse proportion to the measured deviation for some two-dimensional landmarks (340). At this time, the weights may have the form of a weighting matrix. For example, the larger the measured deviation, the smaller the initial weight, and the smaller the measured deviation, the larger the initial weight.

보정 장치는 제1 에너지 함수를 최소화하는 초기 기하 파라미터를 결정할 수 있다(350). 보정 장치는 단계(340)에서 산출한 초기 가중치, 단계(210)에서 검출된 2차원 랜드마크들에 기초하여 3차원 얼굴 모델의 초기 기하 파라미터를 산출할 수 있다. 보정 장치는 예를 들어, 아래의 <수학식 1>과 같은 제1 에너지 함수(E1)를 최소화하는 초기 기하 파라미터를 산출할 수 있다.The correction device may determine an initial geometric parameter that minimizes the first energy function (350). The correction device may calculate an initial geometric parameter of the three-dimensional face model based on the initial weight calculated in

여기서,은 단계(340)에서 산출한 초기 가중치(초기 가중 행렬)이고,은 초기 기하 파라미터 g 에 대응되는 3차원 랜드마크들을 2차원으로 투영하여 획득한 2차원 랜드마크들의 투영 좌표 값을 포함한 행렬이다.은 단계(210)에서 검출된 2차원 랜드마크의 검출 값(좌표 값)을 포함한 행렬이다.here, Is an initial weight (initial weighting matrix) calculated in

2차원 랜드마크들의 검출 값(좌표 값)이 실제 값에 근접할수록 2차원 랜드마크들의 초기 가중치는 커지고, 2차원 랜드마크들의 검출 값이 실제 값에서 멀어질수록 2차원 랜드마크들의 초기 가중치는 작아질 수 있다.As the detected value (coordinate value) of the two-dimensional landmarks approaches the actual value, the initial weight of the two-dimensional landmarks becomes larger, and as the detected value of the two-dimensional landmarks becomes farther away from the actual value, the initial weight of the two- Can be.

일 실시예에 따른 에너지 함수는 랜드마크 검출기가 검출한, 편차가 비교적 작은 2차원 랜드마크들에 의한 영향을 강화하고, 편차가 비교적 큰 2차원 랜드마크들에 의한 영향을 감소시킴으로써 3차원 얼굴 모델의 초기 기하 파라미터의 정확도를 향상시킬 수 있다.The energy function according to an embodiment enhances the influence of two-dimensional landmarks with relatively small deviations detected by the landmark detector and reduces the influence of relatively large two-dimensional landmarks, It is possible to improve the accuracy of the initial geometric parameters of the first embodiment.

보정 장치는 예를 들어, 기울기 감소(Gradient Descent) 알고리즘을 이용하여 제1 에너지 함수를 최소화하는 초기 기하 파라미터를 결정할 수 있다. 기울기 감소 알고리즘은 임의의 함수에 대한 최소값을 찾는 알고리즘으로 당업자에게 잘 알려져 있으므로 이에 대한 추가적인 설명은 생략한다.The correction device may use, for example, a Gradient Descent algorithm to determine an initial geometric parameter that minimizes the first energy function. Since the slope reduction algorithm is well known to those skilled in the art as an algorithm for finding a minimum value for an arbitrary function, a further description thereof will be omitted.

보정 장치는 초기 기하 파라미터에 기초하여 3차원 랜드마크들을 설정할 수 있다(360). 보정 장치가 초기 기하 파라미터를 이용하여 3차원 랜드마크들을 설정하는 방법의 일 예는 다음과 같다.The correction device may set the three-dimensional landmarks based on the initial geometric parameters (360). An example of how the correction device sets three-dimensional landmarks using initial geometric parameters is as follows.

초기 기하 파라미터가 산출되면, 보정 장치는 3차원 모델을 초기 기하 파라미터 값을 기준으로 회전시킬 수 있다, 보정 장치는 회전시킨 3차원 모델을 2D로 투영(projection)하여 2D 텍스쳐 영상을 획득할 수 있다. 보정 장치는 획득한 2D 텍스쳐 영상으로부터 랜드마크(2D 랜드마크)(들)을 검출할 수 있다. 이때, 보정 장치는 앞서 3차원 모델을 2D로 프로젝션 하였으므로, 2D 데이터에 대응되는 3D 데이터를 알 수 있다. 보정 장치는 2D 텍스쳐 영상에서의 2D 랜드마크(들)에 대응되는 3차원 모델 상에서의 랜드마크(들)의 위치를 찾아 3D 랜드마크들을 설정할 수 있다.Once the initial geometric parameters are calculated, the correction device can rotate the three-dimensional model based on the initial geometric parameter values. The correction device can project the rotated three-dimensional model in 2D to obtain a 2D texture image . The correction device can detect the landmark (2D landmark) s from the acquired 2D texture image. At this time, since the correction device has previously projected the 3D model to 2D, 3D data corresponding to the 2D data can be known. The correction device can locate 3D landmarks by finding the location of the landmark (s) on the three-dimensional model corresponding to the 2D landmark (s) in the 2D texture image.

도 4는 일 실시예에 따른 얼굴 영상 데이터베이스에 저장된 2차원 얼굴 샘플 영상들을 나타낸 도면이다. 도 4를 참조하면, 얼굴 영상 데이터베이스는 미리 수집된 복수의 2차원 얼굴 샘플 영상들을 포함할 수 있다. 2차원 얼굴 샘플 영상들은 자유로운 환경(unconstrained circumstances) 하에서 수집된 것일 수 있다.4 is a diagram illustrating two-dimensional face sample images stored in a face image database according to an exemplary embodiment. Referring to FIG. 4, the face image database may include a plurality of two-dimensional face sample images collected in advance. The two-dimensional face sample images may be collected under unconstrained circumstances.

2차원 얼굴 샘플 영상들의 얼굴 영역에 대한 랜드마크들(410)은 수동으로 설정될 수 있다. 2차원 얼굴 샘플 영상들의 얼굴 영역에 대하여는 예를 들어, 68개의 랜드마크들이 설정될 수 있다. 수동으로 설정된 랜드마크들(410)은 2차원 얼굴 샘플 영상의 실제 측정된 2차원 랜드마크들이 될 수 있다. 2차원 얼굴 샘플 영상의 실제 측정된 2차원 랜드마크들은 얼굴 영상의 자세를 보정하는 후속 과정에서 2차원 랜드마크들 간의 평균 편차와 2차원 랜드마크의 가중치를 결정하는 데에 이용될 수 있다.The

얼굴 영상 데이터베이스에 포함된 모든 2차원 얼굴 샘플 영상의 (얼굴 영역에 대한) 자세 정보(430) 또한 수동으로 측정될 수 있다. 2차원 얼굴 샘플 영상들의 자세 정보(430)는 실제 측정된 기하 파라미터를 포함하는 자세 정보 벡터에 의해 표현될 수 있다. 자세 정보 벡터는 예를 들어, (회전(roll), 척도(pitch), 및 평행 이동(yaw))의 형태로 표현될 수 있다.The attitude information 430 (for the face region) of all the two-dimensional face sample images included in the face image database can also be manually measured. The

도 4에 도시된 2차원 얼굴 샘플 영상들의 자세 정보 벡터는 좌에서 우로, 각각 (6.2,0.2,18.2), (-1.6,5.6,34.7), (-4.6,9.6,-29.5), (-9.3,7.4,13.9)와 (5.4,11.3,6.9)일 수 있다.4. The posture information vector of the two-dimensional face sample images shown in FIG. 4 is from left to right (6.2, 0.2, 18.2), (-1.6, 5.6, 34.7) , 7.4, 13.9) and (5.4, 11.3, 6.9).

도 5는 일 실시예에 따른 3차원 랜드마크들을 갱신하는 방법을 나타낸 흐름도이다. 도 5를 참조하면, 일 실시예에 따른 보정 장치는 단계(350)에서 결정된 초기 기하 파라미터에 기초하여 3차원 랜드마크들을 갱신할 수 있다(510).5 is a flow diagram illustrating a method for updating three-dimensional landmarks according to one embodiment. Referring to FIG. 5, the correction device according to one embodiment may update the three-dimensional landmarks based on the initial geometric parameters determined at step 350 (510).

보정 장치가 초기 기하 파라미터에 기초하여 3차원 랜드마크들을 갱신하는 방법은 도 6을 참조하여 설명한다.The method by which the correction device updates the three-dimensional landmarks based on the initial geometrical parameters will be described with reference to Fig.

보정 장치는 갱신된 3차원 랜드마크들의 가중치를 결정할 수 있다(520). 보정 장치가 3차원 랜드마크들의 가중치를 결정하는 방법은 도 7을 참조하여 설명한다.The correction device may determine the weight of the updated three-dimensional landmarks (520). The method by which the correction device determines the weight of the three-dimensional landmarks will be described with reference to Fig.

보정 장치는 가중치에 기초하여, 제2 에너지 함수를 최소화하는 3차원 얼굴 모델의 기하 파라미터 및 형상 파라미터를 결정할 수 있다(530). 보정 장치는 가중치 외에도 단계(510)에서 갱신된 3차원 랜드마크들 및 2차원 텍스처 영상으로부터 검출된 새로운 2차원 랜드마크들에 기초하여 3차원 얼굴 모델의 기하 파라미터 및 형상 파라미터를 결정할 수 있다. 여기서, '새로운 2차원 랜드마크들'은 초기 기하 파라미터에 기초하여 자세가 조정된 3차원 얼굴 모델을 2차원으로 투영하여 획득한 2차원 텍스처 영상으로부터 검출된 랜드마크들로 이해될 수 있다.Based on the weights, the correction device may determine geometric parameters and shape parameters of the three-dimensional face model that minimizes the second energy function (530). In addition to the weights, the correction device may determine the geometry parameters and shape parameters of the three-dimensional face model based on the updated two-dimensional landmarks detected from the three-dimensional landmarks and the two-dimensional texture images updated at

보정 장치는 예를 들어, 아래의 <수학식 2>와 같은 제2 에너지 함수()를 이용하여 3차원 얼굴 모델의 기하 파라미터와 형상 파라미터를 결정할 수 있다.For example, the correction device may calculate a second energy function < RTI ID = 0.0 > ) Can be used to determine geometric and geometric parameters of a three-dimensional face model.

여기서,은 단계(520)에서 결정된 갱신된 3차원 랜드마크들의 가중 행렬(가중치)을 나타낸다.는 기하 파라미터 g 및 형상 파라미터 c에 대응되는 3차원 랜드마크들을 2차원으로 투영하여 획득한 2차원 랜드마크의 투영 좌표 값을 포함한 행렬을 나타낸다. η 은 재구성 후의 3차원 형상이 얼굴 공간 내에 위치하고, 자연스럽게 보이는 것을 보증하는 정규화 파라미터(regularization parameter)이다.here, (Weight) of the updated three-dimensional landmarks determined in

2차원 랜드마크들의 검출 값(좌표 값)이 실제 값에 근접할수록 2차원 랜드마크들의 가중치는 커지고, 2차원 랜드마크들의 검출 값이 실제 값에서 멀어질수록 2차원 랜드마크들의 가중치는 작아질 수 있다.As the detected value (coordinate value) of the two-dimensional landmarks approaches the actual value, the weight of the two-dimensional landmarks becomes larger, and as the detected value of the two-dimensional landmarks becomes farther away from the actual value, have.

일 실시예에 따른 제2 에너지 함수()는 반복 과정을 통해 편차가 비교적 작은 2차원 랜드마크들에 의한 영향을 강화하고, 편차가 비교적 큰 2차원 랜드마크들에 의한 영향을 감소시킴으로써 3차원 얼굴 모델의 기하 파라미터의 정확도를 향상시킬 수 있다.A second energy function according to one embodiment ) Can improve the accuracy of the geometric parameters of the three-dimensional face model by enhancing the effect of the relatively small deviation of the two-dimensional landmarks through the iterative process and reducing the influence of the relatively large two-dimensional landmarks have.

일 실시예에서는 최종 반복에 의해 3차원 얼굴 모델의 기하 파라미터로 확정된 3차원 얼굴 모델의 자세 정보의 정확도를 향상시킴으로써 3차원 얼굴 모델로 투영한 2차원 얼굴 영상의 정확도를 향상시켜 얼굴 식별 성능을 향상시킬 수 있다.In one embodiment, by improving the accuracy of the attitude information of the 3D face model determined as the geometric parameters of the 3D face model by the final iteration, the accuracy of the 2D face image projected on the 3D face model is improved, Can be improved.

도 6은 일 실시예에 따른 초기 기하 파라미터에 기초하여 3차원 랜드마크들을 갱신하는 방법을 나타낸 흐름도이다.6 is a flow diagram illustrating a method for updating three-dimensional landmarks based on an initial geometric parameter according to an embodiment.

도 6을 참조하면, 일 실시예에 따른 보정 장치는 단계(350)에서 결정된 초기 기하 파라미터에 기초하여 3차원 얼굴 모델의 자세를 조정(adjust)할 수 있다(610).Referring to FIG. 6, a correction device according to one embodiment may adjust (610) the orientation of the 3D face model based on the initial geometric parameters determined at step 350.

보정 장치는 자세가 조정된 3차원 얼굴 모델을 2차원으로 투영하여 2차원 텍스처 영상을 획득할 수 있다(620).The correction device can obtain a two-dimensional texture image by projecting the three-dimensional face model adjusted in posture in two dimensions (620).

보정 장치는 2차원 텍스처 영상으로부터 새로운 2차원 랜드마크들을 검출하고(630), 새로운 2차원 랜드마크들에 대응되는 3차원 랜드마크들을 탐색할 수 있다(640).The correction device may detect (630) new 2D landmarks from the 2D texture image and search 640 the 3D landmarks corresponding to the new 2D landmarks.

보정 장치는 탐색된 3차원 랜드마크들에 의해 3차원 랜드마크들을 갱신할 수 있다(650).The correction device may update the three-dimensional landmarks by the detected three-dimensional landmarks (650).

도 7은 일 실시예에 따른 갱신된 3차원 랜드마크들의 가중치를 결정하는 방법을 나타낸 흐름도이다. 도 7을 참조하면, 일 실시예에 따른 보정 장치는 단계(350)에서 결정된 초기 기하 파라미터로부터 3차원 얼굴 모델의 현재 자세 정보를 획득할 수 있다(710).7 is a flowchart illustrating a method for determining weights of updated three-dimensional landmarks according to one embodiment. Referring to FIG. 7, the correction apparatus according to an exemplary embodiment may obtain the current position information of the 3D face model from the initial geometric parameters determined at step 350 (710).

보정 장치는 미리 저장된 얼굴 영상 데이터베이스에서, 3차원 얼굴 모델의 현재 자세 정보에 인접한 자세 정보를 검색할 수 있다(720).The correction device can search for attitude information adjacent to the current attitude information of the three-dimensional face model in the previously stored facial image database (720).

보정 장치는 얼굴 영상 데이터베이스에서 인접한 자세 정보에 대응되는 2차원 얼굴 샘플 영상을 검색할 수 있다(730). 보정 장치는 미리 수집한 얼굴 영상 데이터베이스에서 현재 자세 정보와 동일 또는 인접한 자세 정보의 2차원 얼굴 샘플 영상을 검색할 수 있다. 여기서, '현재 자세 정보에 인접한 자세 정보'는 현재 자세 정보와 동일한 또는 인접한 자세 정보 사이의 편차가 미리 설정된 한계값 범위 내에 있는 자세 정보를 포함할 수 있다.The correction apparatus can search for a two-dimensional face sample image corresponding to the adjacent posture information in the face image database (730). The correction device can search a two-dimensional face sample image of attitude information that is the same as or adjacent to the current attitude information in the previously acquired face image database. Here, the 'posture information adjacent to the current posture information' may include posture information in which a deviation between the same or adjacent posture information as the current posture information is within a preset threshold value range.

보정 장치는 검색된 2차원 얼굴 샘플 영상에 대응하는 2차원 랜드마크들과 새로운 2차원 랜드마크들 사이의 제2 편차에 기초하여, 2차원 랜드마크들의 가중치를 결정할 수 있다(740). 단계(740)에서, 보정 장치는 제2 편차의 평균값을 산출하고, 제2 편차의 평균값에 반비례하여 2차원 랜드마크의 가중치를 결정할 수 있다.The correction device may determine 740 the weight of the two-dimensional landmarks based on the second deviation between the two-dimensional landmarks corresponding to the retrieved two-dimensional face sample image and the new two-dimensional landmarks. In

보정 장치는 단계(740)에서 결정된 2차원 랜드마크의 가중치를 3차원 랜드마크들의 가중치로 갱신할 수 있다(750).The correction device may update the weight of the two-dimensional landmark determined in

도 8은 일 실시예에 따른 2차원 얼굴 영상의 자세를 보정하는 방법을 나타낸 흐름도이다. 도 8을 참조하면, 일 실시예에 따른 보정 장치는 반복 수행에 의해 최종적으로 산출된 최종 기하 파라미터 및 최종 형상 파라미터에 기초하여 3차원 얼굴 모델을 재구성(또는 변환)할 수 있다(810).FIG. 8 is a flowchart illustrating a method of correcting a posture of a two-dimensional face image according to an exemplary embodiment. Referring to FIG. 8, the correction device according to an embodiment may reconstruct (or convert) a 3D face model based on final geometrical parameters and final shape parameters finally calculated by iterative execution (810).

보정 장치는 재구성된 3차원 얼굴 모델을 2차원으로 투영하여 2차원 얼굴 영상의 자세를 보정함으로써 자세가 보정된 2차원 얼굴 영상을 획득할 수 있다(820).The correction device can obtain a two-dimensional face image in which the posture is corrected by projecting the reconstructed three-dimensional face model two-dimensionally and correcting the posture of the two-dimensional face image (820).

도 9는 다른 실시예에 따른 얼굴 영상의 자세를 보정하는 방법을 나타낸 흐름도이다. 도 9를 참조하면, 일 실시예에 따른 보정 장치는 2차원 얼굴 영상을 획득하고(910), 획득한 2차원 얼굴 영상으로부터 2차원 랜드마크들을 검출할 수 있다(920). 도 9의 단계(920) 내지 단계(950)의 과정은 도 2의 단계(210) 내지 단계(240)의 과정과 동일하므로 해당 부분의 설명을 참고하기로 한다.9 is a flowchart illustrating a method of correcting a posture of a face image according to another embodiment. Referring to FIG. 9, a correction apparatus according to an exemplary embodiment may acquire a 2D face image (910), and may detect 2D landmarks from the obtained 2D face image (920). The process from

보정 장치는 단계(950)에서 자세가 보정된 2차원 얼굴 영상에 대하여 배경 보존 텍스처(background preserving texture)를 맵핑할 수 있다(960). 보정 장치가 배경 보존 텍스처를 맵핑하는 방법은 도 10을 참조하여 설명한다.The correction device may map 960 a background preserving texture for the posture-corrected two-dimensional face image at

도 10은 일 실시예에 따른 배경 보존 텍스처를 맵핑하는 방법을 나타낸 흐름도이다. 도 10을 참조하면, 일 실시예에 따른 보정 장치는 2차원 얼굴 영상의 픽셀 색상을 기초로, 재구성된 3차원 얼굴 모델(의 정점)에 색상을 부여하여 3차원 텍스처 모델을 결정할 수 있다(1010). 보정 장치는 예를 들어, 최종 반복으로 획득한 3차원 얼굴 모델의 기하 파라미터 및 형상 파라미터를 기초로, 3차원 얼굴 모델에서 가려진 정점의 대칭점 또한 가려졌는지를 판단하여 정점의 대칭점의 텍스처(또는 색상)이나 3차원 텍스처 모델의 텍스처의 평균(색상의 평균)을 정점에 할당할 수 있다. 보정 장치가 3차원 텍스처 모델을 결정하는 방법은 도 11을 참조하여 설명한다.10 is a flow diagram illustrating a method for mapping a background preservation texture according to one embodiment. Referring to FIG. 10, a correction apparatus according to an exemplary embodiment may determine a three-dimensional texture model by applying a color to (a vertex of) a reconstructed three-dimensional face model based on pixel colors of a two-dimensional face image ). Based on the geometric parameters and shape parameters of the three-dimensional face model acquired in the final iteration, for example, the correction apparatus judges whether the symmetry points of the vertices obscured in the three-dimensional face model are also obscured, and determines the texture (or color) Or an average of the textures of the 3D texture model (the average of the colors) can be assigned to the vertices. The method by which the correction device determines the three-dimensional texture model will be described with reference to FIG.

보정 장치는 3차원 텍스처 모델을 2차원으로 투영한 얼굴 영상에서 얼굴 영역 이외의 배경 영역에 대한 픽셀 색상을 결정할 수 있다(1020). 보정 장치는 예를 들어, 이중 선형 보간법(Bilinear interpolation)을 이용하여 3차원 얼굴 얼굴 모델에 대응하는 2차원 얼굴 영상 중 검은 점(black dot)로 채워진 부분과 같이 색상 값이 부여되지 않은 배경 영역에 색상 값을 부여할 수 있다. 보정 장치가 배경 영역에 대한 픽셀 색상을 결정하는 방법은 도 13을 참조하여 설명한다.The correction device can determine the pixel color for the background area other than the face area in the face image projected in two dimensions in the 3D texture model (step 1020). For example, a correction device may be constructed by using bilinear interpolation to convert a two-dimensional face image corresponding to a three-dimensional face model into a background area that is not assigned a color value, such as a portion filled with a black dot Color values can be assigned. The method by which the correction device determines the pixel color for the background area will be described with reference to FIG.

도 11은 일 실시예에 따른 3차원 텍스처 모델을 결정하는 방법을 나타낸 흐름도이다. 도 11을 참조하면, 일 실시예에 따른 보정 장치는 최종 기하 파라미터 및 최종 형상 파라미터에 기초하여 2차원 얼굴 영상에 재구성된 3차원 얼굴 모델의 정점들(vertexes)을 피팅(fitting)할 수 있다(1110).11 is a flowchart illustrating a method for determining a three-dimensional texture model according to an embodiment. Referring to FIG. 11, a correction device according to one embodiment may fit vertices of a reconstructed three-dimensional face model to a two-dimensional face image based on a final geometry parameter and a final shape parameter (e.g., 1110).

보정 장치는 재구성된 3차원 얼굴 모델의 정점들에 피팅된 2차원 얼굴 영상의 텍스처를 할당할 수 있다(1120).The correction device may assign a texture of the two-dimensional face image fitted to the vertices of the reconstructed three-dimensional face model (1120).

보정 장치는 최종 기하 파라미터 및 최종 형상 파라미터에 기초하여, 3차원 얼굴 모델에서 가려진 정점(occluded vertex)을 결정할 수 있다(1130).The correction device may determine an occluded vertex in the three-dimensional face model based on the final geometry parameter and the final shape parameter (1130).

보정 장치는 가려진 정점에 대한 텍스처를 할당할 수 있다(1140). 보정 장치가 가려진 정점에 대한 텍스처를 할당하는 방법은 도 12를 참조하여 설명한다.The correction device may assign a texture to the hidden vertices (1140). A method of assigning a texture to the vertexes covered by the correction apparatus will be described with reference to FIG.

도 12는 일 실시예에 따른 가려진 정점에 대한 텍스처를 할당하는 방법을 나타낸 흐름도이다. 도 12를 참조하면, 일 실시예에 따른 보정 장치는 3차원 얼굴 모델에서 가려진 정점의 대칭점이 가려졌는지 여부를 판단할 수 있다(1210).12 is a flowchart illustrating a method of assigning a texture to an obscured vertex according to an embodiment. Referring to FIG. 12, a correction apparatus according to an exemplary embodiment may determine whether a symmetric point of a vertex hidden in a 3D face model is obscured (1210).

단계(1210)의 판단 결과, 대칭점이 가려졌다면, 보정 장치는 3차원 텍스처 모델의 텍스처의 평균(색상의 평균)을 정점에 할당할 수 있다(1220).As a result of the determination in

단계(1210)의 판단 결과, 대칭점이 가려지지 않았다면, 보정 장치는 대칭점의 텍스처(또는 색상)를 가려진 정점에 할당할 수 있다(1230).As a result of the determination in

도 13은 일 실시예에 따른 배경 영역에 대한 픽셀 영상을 결정하는 방법을 나타낸 흐름도이다. 도 13을 참조하면, 일 실시예에 따른 보정 장치는 2차원으로 투영한 얼굴 영상에서 배경 영역에 대한 추가 랜드마크들을 설정할 수 있다(1310).13 is a flowchart illustrating a method for determining a pixel image for a background region according to an embodiment. Referring to FIG. 13, a correction apparatus according to an exemplary embodiment may set additional landmarks for a background region in a two-dimensionally projected face image (1310).

보정 장치는 3차원 텍스처 모델에서 추가 랜드마크들의 대응점(또는 대응 픽셀)을 검색할 수 있다(1320).The correction device may retrieve 1320 the corresponding points (or corresponding pixels) of additional landmarks in the three-dimensional texture model.

보정 장치는 구간적 아핀 변환(piece-wise affine transformation)을 수행하여 추가 랜드마크들의 대응점에 대한 색상 값을 획득할 수 있다(1330). 아핀 변환은 세 개의 점들에 의해 기하학적으로 성립될 수 있다. 하나의 기하체에 아핀 변환을 적용하게 되면 변환된 기하체는 원래 기하체와 평행 관계를 유지하게 된다. 이때, 기하체의 이동, 회전, 스케일(scale), 그리고 이들의 결합 등이 아핀 변환에 해당될 수 있다.The correction device may perform a piece-wise affine transformation to obtain a color value for the corresponding point of the additional landmarks (1330). The affine transformation can be geometrically established by three points. If an affine transformation is applied to a single body, the converted body remains in parallel with the original body. At this time, the movement, rotation, scale, and combination of the lower body may correspond to the affine transformation.

보정 장치는 획득된 색상 값을 배경 영역에 대한 픽셀 색상으로 결정할 수 있다(1340).The correction device may determine the acquired color value as a pixel color for the background region (1340).

도 14는 다른 실시예에 따른 얼굴 영상의 자세를 보정하는 방법을 나타낸 흐름도이다.FIG. 14 is a flowchart illustrating a method of correcting a posture of a face image according to another embodiment.

도 14를 참조하면, 일 실시예에 따른 보정 장치는 2차원 얼굴 영상을 획득하고, 획득한 2차원 얼굴 영상으로부터 2차원 랜드마크들을 검출할 수 있다(1410). 보정 장치는 다양한 종류의 랜드마크 검출기들에 의해 2차원 랜드마크들을 검출할 수 있다.Referring to FIG. 14, a correction apparatus according to an embodiment may acquire a two-dimensional face image and detect two-dimensional landmarks from the obtained two-dimensional face image (1410). The correction device can detect two-dimensional landmarks by various kinds of landmark detectors.

보정 장치는 2차원 랜드마크들의 가중치를 초기화할 수 있다(1420). 보정 장치가 2차원 랜드마크들의 가중치를 초기화하는 방법은 도 16을 참조하여 설명한다.The correction device may initialize the weights of the two-dimensional landmarks (1420). The method by which the correction device initializes the weights of the two-dimensional landmarks will be described with reference to Fig.

보정 장치는 기하 파라미터를 초기화 할 수 있다(1430). 보정 장치는 전술한 <수학식 1>을 이용하여 기하 파라미터를 초기화할 수 있다. 보정 장치는 기울기 감소 알고리즘에 의해 <수학식 1>의 에너지 함수를 최소화하는 기하 파라미터를 구할 수 있다.The correction device may initialize the geometric parameters (1430). The correction device can initialize the geometric parameters using Equation (1). The correction apparatus can obtain a geometric parameter that minimizes the energy function of Equation (1) by a slope reduction algorithm.

보정 장치는 초기화된 기하 파라미터에 기초하여 3차원 랜드마크들을 갱신할 수 있다(1440). 보정 장치가 3차원 랜드마크들을 갱신하는 방법은 도 17을 참조하여 설명한다.The correction device may update the three-dimensional landmarks based on the initialized geometric parameters (1440). The method by which the correction device updates the three-dimensional landmarks will be described with reference to Fig.

보정 장치는 갱신된 3차원 랜드마크들의 가중치를 갱신할 수 있다(1450). 보정 장치가 3차원 랜드마크들의 가중치를 갱신하는 방법은 도 18을 참조하여 설명한다.The correction device may update the weight of the updated three-dimensional landmarks (1450). The method by which the correction device updates the weight of the three-dimensional landmarks will be described with reference to Fig.

보정 장치는 단계(1420) 및 단계(1450)에서, 얼굴 영상 데이터베이스(1405)에 저장된 2차원 얼굴 샘플 영상의 실제 검출된 랜드마크와 2차원 랜드마크(또는 3차원 랜드마크) 사이에 산출된 신뢰도(1415)를 이용할 수 있다. 보정 장치가 신뢰도를 산출하는 방법은 도 15를 참조하여 설명한다.The correction device determines in

보정 장치는 산출된 신뢰도에 기초하여 2차원 랜드마크들(또는 3차원 랜드마크들)의 가중치를 갱신하고(1450), 갱신된 가중치에 기초하여 기하 파라미터 및 형상 파라미터를 갱신할 수 있다(1460).The correction device may update 1450 the weights of the two-dimensional landmarks (or three-dimensional landmarks) based on the calculated confidence and update the geometric and geometric parameters based on the updated

보정 장치는 갱신된 기하 파라미터와 갱신 이전의 기하 파라미터 간의 편차(유클리디언 거리)가 미리 설정된 기준값(예를 들어, 5 도(degree))에 수렴하는지 여부를 판단할 수 있다(1470).The correction device may determine 1470 whether the deviation (Euclidean distance) between the updated geometric parameter and the geometric parameter before update is converging to a preset reference value (e.g., 5 degrees).

단계(1470)의 판단 결과, 편차가 미리 설정된 기준값에 수렴하지 않는다면, 보정 장치는 3차원 랜드마크들을 다시 갱신할 수 있다(1440).As a result of the determination in

일 실시예에서는 3차원 얼굴 모델의 3차원 랜드마크들을 반복적으로 갱신함으로써 현재의 얼굴 영상의 자세에서 확정한 3차원 랜드마크들과 2차원 랜드마크들 간의 대응 관계가 유지되도록 할 수 있다.In one embodiment, the 3D landmarks of the 3D face model are updated repetitively so that the correspondence between the 3D landmarks and the 2D landmarks determined in the current face image attitude can be maintained.

또한, 일 실시예에서는 3차원 얼굴 모델의 3차원 랜드마크들을 점차적으로 갱신함으로써 대응 관계가 없는 2차원 랜드마크와 3차원 랜드마크를 사용하여 계산할 때에 발생할 수 있는 실제 정면의 얼굴 영상과 보정된 얼굴 영상 간의 오차를 줄일 수 있다.Further, in one embodiment, the three-dimensional landmarks of the three-dimensional face model are gradually updated, so that the actual frontal face image and the corrected face image, which may be generated when calculating using the two-dimensional landmark and the three- The error between images can be reduced.

단계(1470)의 판단 결과, 편차가 미리 설정된 기준값에 수렴한다면, 보정 장치는 최종적으로 자세가 보정된 2차원 얼굴 영상에 대하여 배경 보존 텍스처를 맵핑할 수 있다(1480). 일 실시예에서는 최종적으로 자세가 보정된 2차원 얼굴 영상에 대하여 배경 보존 텍스처를 맵핑함으로써 얼굴 영역 주변에 대하여 부정확한 설정된 랜드마크들로 인한 텍스처 맵핑 에러를 해결할 수 있다. 보정 장치가 배경 보존 텍스처를 맵핑하는 방법은 도 19를 참조하여 설명한다.As a result of the determination in

도 15는 일 실시예에 따른 신뢰도를 산출하는 방법을 나타낸 흐름도이다. 도 15를 참조하면, 일 실시예에 따른 보정 장치는 얼굴 영상 데이터베이스에 저장된 2차원 얼굴 샘플 영상에 대한 랜드마크들을 실제 검출할 수 있다(1510).15 is a flowchart illustrating a method of calculating reliability according to an embodiment. Referring to FIG. 15, a correction apparatus according to an exemplary embodiment may actually detect landmarks for a two-dimensional face sample image stored in a face image database (1510).

보정 장치는 단계(1510)에서 검출된 랜드마크들과 2차원 얼굴 영상으로부터 검출된 2차원 랜드마크들 사이의 편차(또는 유클리디안 거리)를 산출할 수 있다(1520).The correction device may calculate 1520 the deviation (or Euclidean distance) between the detected landmarks and the two-dimensional landmarks detected from the two-dimensional face image in

보정 장치는 편차의 통계(예를 들어, 평균 편차)를 산출할 수 있다(1530). 보정 장치는 얼굴 영상 데이터베이스에 저장된 특정 기하 파라미터에 인접한 모든 2차원 얼굴 샘플 영상에 대하여 검출된 랜드마크들과 2차원 얼굴 영상으로부터 검출된 2차원 랜드마크들 사이의 평균 편차를 산출할 수 있다.The correction device may calculate the deviation statistics (e.g., average deviation) (1530). The correction apparatus can calculate the average deviation between the detected landmarks and the two-dimensional landmarks detected from the two-dimensional face images for all the two-dimensional face sample images adjacent to the specific geometric parameter stored in the face image database.

보정 장치는 얼굴 영상 데이터베이스 중 모든 정면 자세에서의 2차원 얼굴 샘플 영상에서 오프라인으로 검출한 랜드마크들의 검출값과 2차원 얼굴 영상으로부터 검출된 2차원 랜드마크들의 검출값 사이의 평균 편차를 산출할 수 있다. 보정 장치는 평균 편차가 작은 일부 2차원 랜드마크들을 선택하고, 선택한 2차원 랜드마크들에 대하여 평균 편차에 반비례하게 서로 다른 가중치를 부여할 수 있다. 보정 장치는 예를 들어, 얼굴 영상에 대한 68개의 2차원 랜드마크들 중 평균 편차가 작은 상위의 25개의 2차원 랜드마크들을 선택하고, 선택된 2차원 랜드마크들에 대하여 평균 편차에 반비례하게 서로 다른 가중치를 부여할 수 있다.The correction apparatus can calculate the average deviation between the detection values of the landmarks detected offline and the detection values of the two-dimensional landmarks detected from the two-dimensional face images in the two-dimensional face sample images in all frontal positions in the face image database have. The correction device can select some two-dimensional landmarks having a small average deviation and give different weights to the selected two-dimensional landmarks in inverse proportion to the average deviation. The correction device selects, for example, 25 upper two-dimensional landmarks with a smaller average deviation among the 68 two-dimensional landmarks for the facial image, and selects 25 different two-dimensional landmarks with different mean deviations Weighting can be given.

도 16은 일 실시예에 따른 랜드마크들의 가중치를 초기화하는 방법을 나타낸 흐름도이다. 도 16을 참조하면, 일 실시예에 따른 보정 장치는 N 개의 검출된 2차원 랜드마크들 중 서브 셋들(subsets)을 선택할 수 있다(1610). 보정 장치는 N 개의 검출된 2차원 랜드마크들에 대하여 2차원 얼굴 샘플 영상의 실제 검출된 랜드마크들과의 사이의 편차를 산출하고, 산출된 편차를 기초로 2차원 랜드마크들을 정렬할 수 있다. 보정 장치는 예를 들어, 측정된 편차가 증가하는 순서로 N 개의 2차원 랜드마크들을 정렬할 수 있다. 보정 장치는 정렬된 N 개의 2차원 랜드마크들 중 측정된 편차가 미리 설정된 기준보다 낮은 값을 가지는 상위 n 개의 2차원 랜드마크들을 선택할 수 있다.16 is a flowchart illustrating a method of initializing weights of landmarks according to an embodiment. Referring to FIG. 16, a correction device according to an embodiment may select subsets of N detected two-dimensional landmarks (1610). The correction device may calculate the deviation between the detected two-dimensional landmarks with the actual detected landmarks of the two-dimensional face sample image and arrange the two-dimensional landmarks based on the calculated deviation . The correction device may, for example, align the N two-dimensional landmarks in the order in which the measured deviations increase. The correction device may select the top n two-dimensional landmarks having a measured deviation of the aligned N two-dimensional landmarks lower than a preset reference.

보정 장치는 선택된 서브 셋들(상위 n 개의 2차원 랜드마크들)에 대하여 가중치를 할당할 수 있다(1620). 보정 장치는 측정된 편차가 미리 설정된 기준보다 낮은 값을 가지는 n 개의 2차원 랜드마크들에 대해 측정된 편차와 반비례하게 가중치(초기 가중치)를 할당할 수 있다.The correction device may assign a weight to the selected subsets (the top n two-dimensional landmarks) (1620). The correction device may assign weights (initial weights) in inverse proportion to the measured deviations for the n two-dimensional landmarks whose measured deviations have a value lower than a preset reference.

도 17은 일 실시예에 따른 3차원 랜드마크들을 갱신하는 방법을 나타낸 흐름도이다. 도 17을 참조하면, 일 실시예에 따른 보정 장치는 현재의 기하 파라미터에 의해 회전시켜 가며 3차원 얼굴 모델의 자세를 조절할 수 있다(1710).17 is a flow diagram illustrating a method for updating three-dimensional landmarks according to one embodiment. Referring to FIG. 17, a correction apparatus according to an exemplary embodiment may adjust the posture of the 3D face model by rotating the current geometric parameter (1710).

보정 장치는 자세가 조절된 3차원 얼굴 모델에 대한 텍스처를 맵핑할 수 있다(1720). 보정 장치는 자세가 조정된 3차원 얼굴 모델을 2차원으로 투영하여 2차원 텍스처 영상을 획득함으로써 자세가 조절된 3차원 얼굴 모델에 대한 텍스처를 맵핑할 수 있다.The correction device may map a texture to a three-dimensional face model with adjusted posture (1720). The correction device can map the texture of the three-dimensional face model with the posture adjusted by projecting the two-dimensional texture image by projecting the three-dimensional face model adjusted in two dimensions.

보정 장치는 랜드마크들을 검출할 수 있다(1730). 보정 장치는 2차원 텍스처 영상으로부터 새로운 2차원 랜드마크들을 검출할 수 있다.The correction device may detect the landmarks (1730). The correction device can detect new two-dimensional landmarks from the two-dimensional texture image.

보정 장치는 2차원 랜드마크들을 3차원 랜드마크들로 맵핑할 수 있다(1740).The correction device may map the two-dimensional landmarks to the three-dimensional landmarks (1740).

보정 장치는 새로운 2차원 랜드마크들에 대응되는 3차원 랜드마크들을 탐색하고, 탐색된 3차원 랜드마크들에 의해 3차원 랜드마크들을 갱신할 수 있다.The correction device may search for the three-dimensional landmarks corresponding to the new two-dimensional landmarks and update the three-dimensional landmarks by the detected three-dimensional landmarks.

도 18은 일 실시예에 따른 랜드마크들의 가중치를 갱신하는 방법을 나타낸 흐름도이다. 도 18을 참조하면, 일 실시예에 따른 보정 장치는 기하 파라미터들을 추정할 수 있다(1810).18 is a flowchart illustrating a method of updating the weights of landmarks according to an embodiment. Referring to FIG. 18, a correction device according to an embodiment may estimate

보정 장치는 단계(1810)에서 추정된 기하 파라미터들에 기초하여 이웃(neighborhood)을 검색할 수 있다(1820). 여기서, '이웃'은 3차원 얼굴 모델의 현재 자세 정보에 인접한 자세 정보, 다시 말해, 현재 자세 정보와 인접한 자세 정보 사이의 편차가 미리 설정된 한계값 범위 내에 있는 자세 정보로 이해될 수 있다.The correction device may search for a neighborhood based on the geometric parameters estimated in step 1810 (1820). Here, 'neighbor' can be understood as attitude information adjacent to the current attitude information of the three-dimensional face model, that is, attitude information in which the deviation between the current attitude information and the adjacent attitude information is within a predetermined threshold value range.

보정 장치는 미리 저장된 얼굴 영상 데이터베이스에서 3차원 얼굴 모델의 현재 자세 정보에 인접한 자세 정보를 검색할 수 있다.The correction device can retrieve attitude information adjacent to the current attitude information of the three-dimensional face model in the previously stored facial image database.

보정 장치는 이웃에 대하여 가중치를 할당할 수 있다(1830). 보정 장치는 얼굴 영상 데이터베이스에서 인접한 자세 정보에 대응되는 2차원 얼굴 샘플 영상을 검색할 수 있다. 보정 장치는 검색된 2차원 얼굴 샘플 영상에 대응하는 2차원 랜드마크들과 새로운 2차원 랜드마크들 사이의 제2 편차에 기초하여 2차원 랜드마크들의 가중치를 결정할 수 있다. 보정 장치는 제2 편차에 반비례하게 2차원 랜드마크들의 가중치를 결정할 수 있다.The correction device may assign a weight to the neighbor (1830). The correction device can search a two-dimensional face sample image corresponding to adjacent posture information in the face image database. The correction device may determine the weight of the two-dimensional landmarks based on the second deviation between the two-dimensional landmarks corresponding to the retrieved two-dimensional face sample image and the new two-dimensional landmarks. The correction device may determine the weight of the two-dimensional landmarks in inverse proportion to the second deviation.

도 19는 일 실시예에 따른 배경 보존 텍스처를 맵핑하는 방법을 나타낸 흐름도이다. 도 19를 참조하면, 일 실시예에 따른 보정 장치는 정점의 색상을 할당할 수 있다(1910). 보정 장치는 2차원 얼굴 영상에 재구성된 3차원 얼굴 모델의 정점들(vertexes)을 피팅(fitting)함으로써 정점의 색상을 할당할 수 있다.19 is a flowchart illustrating a method for mapping a background preservation texture according to one embodiment. Referring to FIG. 19, a correction apparatus according to an embodiment may assign a color of a vertex (1910). The correction device can assign the vertex color by fitting the vertexes of the reconstructed three-dimensional face model to the two-dimensional face image.

보정 장치는 텍스처를 맵핑할 수 있다(1920). 보정 장치는 재구성된 3차원 얼굴 모델의 정점들에 피팅된 2차원 얼굴 영상의 텍스처를 할당하고, 최종 기하 파라미터 및 최종 형상 파라미터에 기초하여, 3차원 얼굴 모델에서 가려진 정점(occluded vertex)을 결정할 수 있다. 보정 장치는 가려진 정점에 대한 텍스처를 할당할 수 있다.The correction device may map the texture (1920). The correction device may assign a texture of the two-dimensional face image fitted to the vertices of the reconstructed three-dimensional face model, and determine an occluded vertex in the three-dimensional face model based on the final geometry parameter and the final shape parameter have. The correction device can assign a texture to the hidden vertices.

보정 장치는 이중 선형 보간(bilinear interpolation)을 수행할 수 있다(1930). 보정 장치는 이중 선형 보간을 이용하여 3차원 텍스처 모델을 2차원으로 투영한 얼굴 영상에서 얼굴 영역 이외의 배경 영역에 대한 픽셀 색상을 결정할 수 있다.The correction device may perform bilinear interpolation (1930). The correction device can determine the pixel color for the background area other than the face area in the face image in which the three-dimensional texture model is projected in two dimensions by using bilinear interpolation.

보정 장치는 배경을 워핑(warping)할 수 있다(1940). 워핑은 영상을 늘리거나 크기를 조절하는 기하학적인 처리를 말한다. 워핑은 스케일링(scaling)과 달리 크기 변화의 정도가 영상 전체에 대해 균일하지 않을 수 있다. 보정 장치가 배경을 워핑하는 방법은 도 20을 참조하여 설명한다.The correction device may warp the background (1940). Warping refers to a geometric process of stretching or resizing an image. Unlike scaling, the degree of magnitude variation may not be uniform over the entire image. The manner in which the correction device warps the background will be described with reference to Fig.

도 20은 일 실시예에 따른 배경을 워핑하는 방법을 설명하기 위한 도면이다. 도 20을 참조하면, 일 실시예에 따른 보정 장치는 단계(1930)에서 배경 영역에 대한 픽셀 색상이 결정된 후, 2차원 얼굴 영상에서 배경 영역에 대한 추가 랜드마크들(2010)을 설정할 수 있다. 보정 장치는 최종적으로 자세가 보정된 2차원 얼굴 영상에서 얼굴 영역 외각에 대응하는 픽셀 정점들을 설정할 수 있다.20 is a diagram for explaining a method of warping a background according to an embodiment. Referring to FIG. 20, a correction device according to an embodiment may set

보정 장치는 삼각 측량을 이용하여 픽셀 정점들에 대응하는 3각형(2020)들 간의 구간적 아핀 변환을 수행하여 추가 랜드마크들의 대응점(대응 픽셀)의 색상 값을 획득할 수 있다. 이를 통해 일 실시예에서는 부정확한 랜드마크의 위치에 의해 발생하는 얼굴 영역의 분실 문제를 피할 수 있고, 얼굴 영상의 정확률을 향상시킬 수 있다. 보정 장치는 최종적으로 자세가 보정된 2차원 얼굴 영상을 2030 부분에 결합할 수 있다.The correction device can perform a periodic affine transformation between the

도 21은 일 실시예에 따른 얼굴 영상의 자세를 보정하는 방법의 수행 과정에서 출력되는 영상들을 나타낸 도면이다. 일 실시예에 따라 얼굴 영상의 자세를 보정하는 과정에 따른 영상의 변화는 다음과 같다.FIG. 21 is a diagram illustrating images output in a process of performing a method of correcting a posture of a face image according to an exemplary embodiment. The change of the image according to the process of correcting the posture of the face image according to an embodiment is as follows.

도 21(a)는 보정 장치로 입력되는 2차원 얼굴 영상을 나타낸다. 이때, 2차원 얼굴 영상은 도 21(a)와 같은 비정면 자세일 수도 있다.21 (a) shows a two-dimensional face image input to the correction device. At this time, the two-dimensional face image may be a non-frontal posture as shown in FIG. 21 (a).

보정 장치는 도 21(a)의 2차원 얼굴 영상으로부터 도 21(b)와 같이 2차원 랜드마크들을 자동으로 검출할 수 있다.The correction device can automatically detect the two-dimensional landmarks from the two-dimensional face image of Fig. 21 (a) as shown in Fig. 21 (b).

보정 장치는 도 21(c)와 같이 3차원 얼굴 모델의 랜드마크들을 자동으로 검출하여 랜드마크들의 초기 가중치를 결정할 수 있다.The correction apparatus can automatically detect the landmarks of the three-dimensional face model and determine the initial weights of the landmarks as shown in FIG. 21 (c).

보정 장치는 도 21(d)와 같이, 3차원 얼굴 모델에 대하여 자세를 보정하고, 자세가 보정된 3차원 얼굴 모델에서 랜드마크들을 자동으로 검출하여 랜드마크들의 가중치를 결정할 수 있다.As shown in Fig. 21 (d), the correction apparatus can determine the weight of the landmarks by correcting the attitude of the three-dimensional face model and automatically detecting the landmarks in the three-dimensional face model in which the attitude is corrected.

보정 장치는 도 21(e)와 같이, 2차원 랜드마크들과 3차원 얼굴 모델의 3차원 랜드마크들을 매칭할 수 있다. 보정 장치는 랜드마크들의 매칭 결과에 기초하여, 도 21(f)와 같이 3차원 얼굴 모델을 재구성할 수 있다.The correction device can match the two-dimensional landmarks with the three-dimensional landmarks of the three-dimensional face model as shown in Fig. 21 (e). The correction apparatus can reconstruct the three-dimensional face model as shown in Fig. 21 (f) based on the matching results of the landmarks.

보정 장치는 도 21(g)와 같이, 3차원 얼굴 모델의 정점에 대하여 색상을 부여할 수 있다. 보정 장치는 도 21(h)와 같이, 3차원 얼굴 모델을 2차원으로 투영하여 자세가 보정된 2차원 얼굴 영상을 획득하고, 얼굴 영역 이외의 배경 영역의 정점(픽셀 포인트)에 대하여 색상을 부여할 수 있다.As shown in Fig. 21 (g), the correction device can give a color to the vertices of the three-dimensional face model. 21 (h), the correction device projects the two-dimensional face image of the three-dimensional face model in two dimensions to acquire the two-dimensional face image whose posture is corrected, and assigns a color to the vertex (pixel point) can do.

도 21(i)는 실제의 정면 얼굴 영상을 나타낸다.Fig. 21 (i) shows an actual front face image.

도 21(h)와 도 21(i)를 비교하면, 일 실시예에 따라 얼굴 영상의 자세를 보정하여 획득한 2차원 얼굴 영상과 실제의 정면 얼굴 영상이 비교적 근접함을 알 수 있다.21 (h) and FIG. 21 (i) are compared with each other, it can be seen that the two-dimensional face image obtained by correcting the posture of the face image is relatively close to the actual front face image according to an embodiment.

도 22는 일 실시예에 따른 얼굴 영상의 자세를 보정하는 장치의 블록도이다.22 is a block diagram of an apparatus for correcting a posture of a face image according to an embodiment.

도 22를 참조하면, 일 실시예에 따른 보정 장치(2200)는 수신부(2210), 프로세서(2230), 및 메모리(2250)를 포함한다. 수신부(2210), 프로세서(2230), 및 메모리(2250)는 버스(2270)를 통하여 서로 통신할 수 있다.22, a

수신부(2210)는 2차원 얼굴 영상을 수신한다.The receiving

프로세서(2230)는 2차원 얼굴 영상으로부터 검출한 2차원 랜드마크들에 기초하여 3차원 얼굴 모델의 초기 자세를 결정함으로써, 3차원 얼굴 모델에 포함된 3차원 랜드마크들을 설정한다. 프로세서(2230)는 3차원 얼굴 모델의 자세 및 형상을 반복적으로 조절함으로써 3차원 랜드마크들을 갱신하고, 갱신된 3차원 랜드마크들에 기초하여 2차원 얼굴 영상의 자세를 보정한다.The

메모리(2250)는 얼굴 영상 데이터베이스를 저장할 수 있다. 얼굴 영상 데이터베이스는 예를 들어, 복수 개의 2차원 얼굴 샘플 영상들, 2차원 얼굴 샘플 영상의 실제 검출된 랜드마크들, 및 2차원 얼굴 샘플 영상들에서 실제 측정된 기하 파라미터 등을 포함할 수 있다.

이 밖에도, 프로세서(2230)는 도 1 내지 도 21을 통하여 전술한 적어도 하나의 방법을 수행할 수 있다. 프로세서(2230)는 프로그램을 실행하고, 보정 장치(2200)를 제어할 수 있다. 프로세서(2230)에 의하여 실행되는 프로그램 코드는 메모리(2250)에 저장될 수 있다. 보정 장치(2200)는 입출력 장치(도면 미 표시)를 통하여 외부 장치(예를 들어, 퍼스널 컴퓨터 또는 네트워크)에 연결되고, 데이터를 교환할 수 있다.In addition, the

도 1 내지 도 21을 통하여 전술한 적어도 하나의 방법은 태블릿, 스마트 폰, 또는 웨어러블 디바이스 내의 프로세서에서 동작하는 앱 형상으로도 구현되거나, 칩 형상으로 구현되어 스마트 폰, 웨어러블 디바이스, 지능형 자동차 또는 기타 사용자 인증 장치 내에 내장될 수 있다.1 to 21 may be implemented in an app form running on a processor in a tablet, smart phone, or wearable device, or implemented in a chip form to form a smart phone, a wearable device, an intelligent car, or other user And can be embedded in the authentication device.

도 23은 다른 실시예에 따른 얼굴 영상의 자세를 보정하는 장치의 블록도이다. 도 23을 참조하면, 일 실시예에 따른 보정 장치(2300)는 2차원 영상 획득부(2310), 랜드마크 설정부(2330), 반복 수행부(2350) 및 영상 보정부(2370)를 포함할 수 있다.23 is a block diagram of an apparatus for correcting a posture of a face image according to another embodiment. 23, a

2차원 영상 획득부(2310)는 보정할 2차원 얼굴 영상을 획득한다.The two-dimensional

랜드마크 설정부(2330)는 보정할 2차원 얼굴 영상의 2차원 랜드마크를 검출하고, 또한 3차원 얼굴 모델에서 검출한 2차원 랜드마크와 대응하는 3차원 랜드마크를 확정한다.The

반복 수행부(2350)는 랜드마크 확정부(701)가 확정한 3차원 랜드마크에 기초하여 반복 계산의 방법을 이용하여 3차원 랜드마크를 갱신 한다.The

실제 응용에서, 반복 계산부(702)는 반복 계산 과정에서 그전에 반복한 3차원 얼굴 모델의 기하 파라미터를 응용하여 3차원 랜드마크를 갱신하고 갱신한 3차원 랜드마크에 기초하여 이번에 반복한 기하 파라미터를 계산한다.In an actual application, the iterative calculation unit 702 updates the 3D landmark by applying the geometric parameters of the 3D face model that has been repeated before in the iterative calculation process, and updates the 3D geometric parameters based on the updated 3D landmark .

반복 계산부(702)가 반복 계산을 할 때의 반복 중지 조건은 구체적으로 인접한 두 번의 반복 과정으로 획득한 3차원 얼굴 모델의 기하 파라미터 사이의 유클리디언 거리가 한계 값보다 작거나 또는 반복 차수가 설정 값에 도달하는 것일 수 있다.The repetition stop condition when the iterative calculation unit 702 performs the iterative calculation is that the Euclidean distance between the geometric parameters of the three-dimensional face model acquired in the two adjacent iterative processes is smaller than the threshold or the repetition degree It may be that the set value is reached.