KR20150104007A - Display device for managing a plurality of time source data and method for controlling the same - Google Patents

Display device for managing a plurality of time source data and method for controlling the sameDownload PDFInfo

- Publication number

- KR20150104007A KR20150104007AKR1020140075856AKR20140075856AKR20150104007AKR 20150104007 AKR20150104007 AKR 20150104007AKR 1020140075856 AKR1020140075856 AKR 1020140075856AKR 20140075856 AKR20140075856 AKR 20140075856AKR 20150104007 AKR20150104007 AKR 20150104007A

- Authority

- KR

- South Korea

- Prior art keywords

- time

- source data

- application

- time source

- broadcast

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

Images

Classifications

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/41—Structure of client; Structure of client peripherals

- H04N21/422—Input-only peripherals, i.e. input devices connected to specially adapted client devices, e.g. global positioning system [GPS]

- H04N21/42204—User interfaces specially adapted for controlling a client device through a remote control device; Remote control devices therefor

- H04N21/42206—User interfaces specially adapted for controlling a client device through a remote control device; Remote control devices therefor characterized by hardware details

- H04N21/42212—Specific keyboard arrangements

- H04N21/42213—Specific keyboard arrangements for facilitating data entry

- H04N21/42215—Specific keyboard arrangements for facilitating data entry by measuring the time interval during which a key is pressed, e.g. for inputting sequences of digits when selecting a television channel

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04L—TRANSMISSION OF DIGITAL INFORMATION, e.g. TELEGRAPHIC COMMUNICATION

- H04L65/00—Network arrangements, protocols or services for supporting real-time applications in data packet communication

- H04L65/60—Network streaming of media packets

- H04L65/61—Network streaming of media packets for supporting one-way streaming services, e.g. Internet radio

- H04L65/611—Network streaming of media packets for supporting one-way streaming services, e.g. Internet radio for multicast or broadcast

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/43—Processing of content or additional data, e.g. demultiplexing additional data from a digital video stream; Elementary client operations, e.g. monitoring of home network or synchronising decoder's clock; Client middleware

- H04N21/4302—Content synchronisation processes, e.g. decoder synchronisation

- H04N21/4307—Synchronising the rendering of multiple content streams or additional data on devices, e.g. synchronisation of audio on a mobile phone with the video output on the TV screen

- H04N21/43074—Synchronising the rendering of multiple content streams or additional data on devices, e.g. synchronisation of audio on a mobile phone with the video output on the TV screen of additional data with content streams on the same device, e.g. of EPG data or interactive icon with a TV program

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/43—Processing of content or additional data, e.g. demultiplexing additional data from a digital video stream; Elementary client operations, e.g. monitoring of home network or synchronising decoder's clock; Client middleware

- H04N21/434—Disassembling of a multiplex stream, e.g. demultiplexing audio and video streams, extraction of additional data from a video stream; Remultiplexing of multiplex streams; Extraction or processing of SI; Disassembling of packetised elementary stream

- H04N21/4344—Remultiplexing of multiplex streams, e.g. by modifying time stamps or remapping the packet identifiers

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/43—Processing of content or additional data, e.g. demultiplexing additional data from a digital video stream; Elementary client operations, e.g. monitoring of home network or synchronising decoder's clock; Client middleware

- H04N21/443—OS processes, e.g. booting an STB, implementing a Java virtual machine in an STB or power management in an STB

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/45—Management operations performed by the client for facilitating the reception of or the interaction with the content or administrating data related to the end-user or to the client device itself, e.g. learning user preferences for recommending movies, resolving scheduling conflicts

- H04N21/462—Content or additional data management, e.g. creating a master electronic program guide from data received from the Internet and a Head-end, controlling the complexity of a video stream by scaling the resolution or bit-rate based on the client capabilities

- H04N21/4627—Rights management associated to the content

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04Q—SELECTING

- H04Q2213/00—Indexing scheme relating to selecting arrangements in general and for multiplex systems

- H04Q2213/1336—Synchronisation

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Databases & Information Systems (AREA)

- Computer Networks & Wireless Communication (AREA)

- Software Systems (AREA)

- Computer Security & Cryptography (AREA)

- Human Computer Interaction (AREA)

- Controls And Circuits For Display Device (AREA)

Abstract

Translated fromKoreanDescription

Translated fromKorean본 발명은 다양한 디스플레이 디바이스에 적용 가능한 기술에 관한 것으로서, 보다 상세하게는 방송 시간 정보, 네트워크 시간 정보, 매뉴얼(Manual) 시간 정보 등 다양한 타임 소스 데이터가 있을 경우, 특정 어플리케이션의 시간 세팅 시 어떠한 타임 소스 데이터를 이용할지에 대한 알고리즘(Algorithm)을 결정하기 위한 디스플레이 디바이스 및 그 제어 방법에 대한 것이다.BACKGROUND OF THE

디스플레이 디바이스는 적어도 하나 이상의 튜너(Tuner)를 포함하는 방송 서비스 모듈(Broadcast Service Module)을 통해 방송 신호를 수신할 수 있다. 그리고, 디스플레이 디바이스는 사용자 인터페이스(User Interface)를 통해 다양한 데이터를 사용자로부터 입력 받을 수 있다. 그리고, 디스플레이 디바이스는 다양한 유/무선 통신 모듈을 이용하여 외부 서버와 데이터 통신을 수행할 수 있다. 또한, 디스플레이 디바이스는 휘발성 메모리 및 비휘발성 메모리를 포함할 수 있다. 상기 디스플레이 디바이스는, 예를 들어 휴대폰, 스마트폰, 컴퓨터(Computer), 태블릿 PC, 노트북, 넷북, TV(Television), 기타 방송 수신 디바이스 등에 해당한다.The display device may receive a broadcast signal through a broadcast service module including at least one tuner. The display device can receive various data from a user through a user interface. The display device can perform data communication with an external server using various wired / wireless communication modules. The display device may also include volatile memory and non-volatile memory. The display device corresponds to, for example, a mobile phone, a smart phone, a computer, a tablet PC, a notebook, a netbook, a television, and other broadcast receiving devices.

본 발명의 일실시예가 이루고자 하는 기술적 과제는, 복수 개의 타임 소스(Time Source) 데이터가 존재할 경우, 특정 어플리케이션의 시간 세팅 시 어떠한 타임 소스 데이터를 이용하여 시간을 세팅할지를 결정하는 것이다.According to an embodiment of the present invention, when there are a plurality of time source data, it is determined which time source data is used to set a time when setting a time of a specific application.

또한, 본 발명의 다른 일실시예가 이루고자 하는 기술적 과제는, 사용자로부터 입력 받은 매뉴얼 오프셋(Manual Offset) 정보를 이용하여, 외부에서 수신되는 타임 소스 데이터를 보정하는 방법을 설계하도록 하는 것이다.According to another aspect of the present invention, there is provided a method of correcting time source data received from outside using manual offset information input from a user.

그리고, 본 발명의 또 다른 일실시예가 이루고자 하는 기술적 과제는, 디스플레이 디바이스의 시스템 내에 적절한 타임 소스 데이터가 존재하지 않을 경우, 기 설정된 공장 출고 기본 설정 시간 데이터를 이용하여 특정 어플리케이션의 시간을 세팅하도록 함으로써, 사용자 편의성을 증대시키도록 하는 해결 방안 내지는 솔루션을 구체적으로 정의하는 것이다.According to another embodiment of the present invention, there is provided a method of setting a time of a specific application by using preset factory default setting time data when proper time source data does not exist in a system of a display device , And to define a solution or solution that will enhance user convenience.

본 발명의 일실시예에 의한 복수의 타임 소스(Time Source) 데이터를 관리하는 디스플레이 디바이스에 있어서, 사용자로부터 제1 타임 소스 데이터를 입력 받는 사용자 인터페이스(User Interface)부, 방송 신호를 수신하는 방송 서비스 모듈(Broadcast Service Module), NTP(Network Time Protocol) 서버와 데이터 통신을 수행하는 커뮤니케이션 모듈, 상기 복수의 타임 소스 데이터를 저장하는 메모리 및 상기 디스플레이 디바이스의 작동을 제어하는 컨트롤러를 포함하고, 상기 컨트롤러는 상기 사용자 인터페이스부와 연결된 세팅 어플리케이션(Setting Application)으로부터 추출되는 제1 타임 소스 데이터, 방송 서비스 모듈(Broadcast Service Module)로부터 추출되는 제2 타임 소스 데이터, NTP(Network Time Protocol) 서버로부터 수신하는 제3 타임 소스 데이터 중 적어도 하나 이상의 타임 소스 데이터를 추출하고, 추출된 타임 소스 데이터 및 어플리케이션의 타입에 기초하여, 기 설정된 우선 순위에 따라 어플리케이션의 시간을 세팅하는 디스플레이 디바이스를 설계한다.A display device for managing a plurality of time source data according to an embodiment of the present invention includes a user interface unit for receiving first time source data from a user, A communication module for performing data communication with a network time protocol (NTP) server, a memory for storing the plurality of time source data, and a controller for controlling operation of the display device, A first time source data extracted from a setting application connected to the user interface unit, a second time source data extracted from a broadcast service module, a third time source data extracted from a network time protocol (NTP) At least one of the time source data Extracts the data, and designs a display device that sets the time of the application according to the predetermined priority based on the extracted time source data and the type of the application.

그리고, 본 발명의 일실시예에 의한 복수의 타임 소스 데이터를 관리하는 디스플레이 디바이스의 제어 방법에 있어서, 세팅 어플리케이션으로부터 추출되는 제1 타임 소스 데이터, 방송 서비스 모듈로부터 추출되는 제2 타임 소스 데이터, NTP 서버로부터 수신하는 제3 타임 소스 데이터 중 적어도 하나 이상의 타임 소스 데이터를 추출하는 단계 및 추출된 타임 소스 데이터 및 어플리케이션의 타입에 기초하여, 기 설정된 우선 순위에 따라 어플리케이션의 시간을 세팅하는 단계를 포함하도록 설계한다.The first time source data extracted from the setting application, the second time source data extracted from the broadcast service module, the NTP Extracting at least one time source data among the third time source data received from the server and setting the time of the application according to the predetermined priority based on the extracted time source data and the type of the application Design.

본 발명의 일실시예에 의하면, 복수 개의 타임 소스 데이터가 존재할 경우, 특정 어플리케이션의 시간 세팅 시 어떠한 타임 소스 데이터를 이용하여 시간을 세팅할지를 결정하는 기술적 효과가 있다.According to an embodiment of the present invention, when there are a plurality of time source data, there is a technical effect of determining which time source data is used to set a time when setting a time of a specific application.

또한, 본 발명의 다른 일실시예에 의하면, 사용자로부터 입력 받은 매뉴얼 오프셋(Manual Offset) 정보를 이용하여, 외부에서 수신되는 타임 소스 데이터를 보정하는 방법을 설계하도록 하는 장점이 있다.According to another embodiment of the present invention, there is an advantage of designing a method of correcting time source data received from the outside by using manual offset information input from a user.

그리고, 디스플레이 디바이스의 시스템 내에 적절한 타임 소스 데이터가 존재하지 않을 경우, 기 설정된 공장 출고 기본 설정 시간 데이터를 이용하여 특정 어플리케이션의 시간을 세팅하도록 함으로써, 사용자 편의성을 증대시키도록 하는 해결 방안 내지는 솔루션을 구체적으로 정의하는 장점이 있다.When there is no appropriate time source data in the system of the display device, a solution or solution for increasing the convenience of the user by setting the time of the specific application by using the preset factory default setting time data is concretely described As shown in Fig.

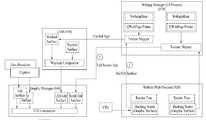

도 1은 본 발명의 일 실시 예에 따른 디스플레이 디바이스를 포함한 서비스 시스템(Service system)을 개략적으로 설명하기 위해 도시한 도면이다.

도 2는 본 발명의 일 실시 예에 따른 디스플레이 디바이스를 설명하기 위해 도시한 구성 블록도이다.

도 3은 본 발명의 다른 실시 예에 따른 디스플레이 디바이스를 설명하기 위해 도시한 구성 블록도이다.

도 4는 본 발명의 또 다른 실시 예에 따른 디스플레이 디바이스를 설명하기 위해 도시한 구성 블록도이다.

도 5는 본 발명의 일 실시 예에 따라 도 2 내지 4의 제어부의 상세 구성을 설명하기 위해 도시한 구성 블록도이다.

도 6은 본 발명의 일 실시 예에 따른 도 2 내지 4의 디스플레이 디바이스와 연결된 입력 수단을 도시한 도면이다.

도 7은 본 발명의 일 실시 예에 따른 Web OS 아키텍처를 설명하기 위해 도시한 도면이다.

도 8은 본 발명의 일 실시 예에 따른 Web OS 디바이스의 아키텍처를 설명하기 위해 도시한 도면이다.

도 9는 본 발명의 일실시예에 따른 Web OS 디바이스에서 그래픽 컴포지션 플로우(graphic composition flow)를 설명하기 위해 도시한 도면이다.

도 10은 본 발명의 일 실시 예에 따른 미디어 서버를 설명하기 위해 도시한 도면이고, 도 11은 본 발명의 일 실시 예에 따른 미디어 서버의 구성 블록도를 설명하기 위해 도시한 도면이고, 도 12는 본 발명의 일 실시 예에 따른 미디어 서버와 TV 서비스의 관계를 설명하기 위해 도시한 도면이다.

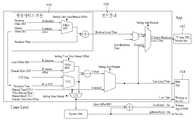

도 13은 본 발명의 다른 일 실시예에 의한 디스플레이 디바이스의 구성 모듈을 상세히 도시한 블록도이다.

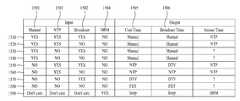

도 14는 본 발명의 일 실시예에 의한 디스플레이 디바이스가 복수의 타임 소스 데이터를 관리하는 일 예를 설명하기 위한 도면이다.

도 15는 본 발명의 일 실시예에 의한 디스플레이 디바이스에서 복수의 타임 소스 데이터를 이용하여 어플리케이션의 시간을 설정하기 위한 우선 순위 결정 방식을 설명하기 위한 도면이다.

도 16은 본 발명의 일 실시예에 의한 디스플레이 디바이스에서 복수의 타임 소스 데이터를 이용하여 어플리케이션의 시간을 설정하기 위한 우선 순위 결정 방식을 설명하기 위한 다른 도면이다.

도 17은 본 발명의 일 실시예에 의한 디스플레이 디바이스에서 DRM 컨텐츠의 시간을 관리하는 일 예를 설명하기 위한 도면이다.

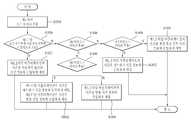

도 18은 본 발명의 일 실시예에 의한 디스플레이 디바이스가 복수의 타임 소스 데이터를 이용하여 어플리케이션의 시간을 세팅하는 알고리즘을 설명하기 위한 플로우 차트이다.

도 19는 본 발명의 일 실시예에 의한 디스플레이 디바이스에서 방송 신호로부터 방송 시간 정보를 추출하는 일 예를 설명하기 위한 도면이다.

도 20 내지 도 21은 본 발명의 일 실시예에 의한 디스플레이 디바이스의 세팅 어플리케이션을 통해 사용자가 시간 정보 및 매뉴얼 오프셋을 입력하는 일 예를 설명하기 위한 도면이다.

도 22는 본 발명의 일실시예에 의한 디스플레이 디바이스의 제어 방법을 도시한 플로우 차트이다.FIG. 1 is a view for schematically explaining a service system including a display device according to an embodiment of the present invention. Referring to FIG.

2 is a block diagram illustrating a display device according to an exemplary embodiment of the present invention.

3 is a block diagram illustrating a display device according to another embodiment of the present invention.

4 is a block diagram illustrating a display device according to another embodiment of the present invention.

FIG. 5 is a block diagram illustrating a detailed configuration of the control unit of FIGS. 2 to 4 according to an embodiment of the present invention. Referring to FIG.

Figure 6 is a diagram illustrating input means coupled to the display device of Figures 2 through 4 in accordance with one embodiment of the present invention.

FIG. 7 is a diagram illustrating a Web OS architecture according to an embodiment of the present invention. Referring to FIG.

8 is a diagram illustrating an architecture of a Web OS device according to an embodiment of the present invention.

FIG. 9 is a diagram illustrating a graphic composition flow in a Web OS device according to an embodiment of the present invention. Referring to FIG.

FIG. 10 is a view for explaining a media server according to an embodiment of the present invention, FIG. 11 is a view for explaining a configuration block diagram of a media server according to an embodiment of the present invention, and FIG. 12 Is a diagram illustrating a relationship between a media server and a TV service according to an embodiment of the present invention.

13 is a detailed block diagram of a configuration module of a display device according to another embodiment of the present invention.

14 is a diagram for explaining an example in which a display device manages a plurality of time source data according to an embodiment of the present invention.

15 is a diagram for explaining a priority determination method for setting an application time using a plurality of time source data in a display device according to an embodiment of the present invention.

16 is another diagram for explaining a priority determination method for setting an application time using a plurality of time source data in a display device according to an embodiment of the present invention.

17 is a view for explaining an example of managing time of DRM contents in a display device according to an embodiment of the present invention.

18 is a flowchart for explaining an algorithm for setting a time of an application using a plurality of time source data by a display device according to an embodiment of the present invention.

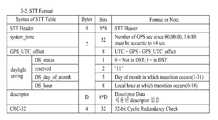

19 is a diagram for explaining an example of extracting broadcast time information from a broadcast signal in a display device according to an embodiment of the present invention.

20 to 21 are views for explaining an example in which a user inputs time information and a manual offset through a setting application of a display device according to an embodiment of the present invention.

22 is a flowchart illustrating a method of controlling a display device according to an embodiment of the present invention.

이하에서는 도면을 참조하여 본 발명을 더욱 상세하게 설명한다.Hereinafter, the present invention will be described in more detail with reference to the drawings.

이하의 설명에서 사용되는 구성요소에 대한 접미사 "모듈" 및 "부"는 단순히 본 명세서 작성의 용이함을 고려하여 부여되는 것으로서, 상기 "모듈" 및 "부"는 서로 혼용되어 사용될 수도 있다.The suffix "module" and " part "for components used in the following description are given merely for ease of description, and the" module "and" part "

나아가, 이하 첨부 도면들 및 첨부 도면들에 기재된 내용들을 참조하여 본 발명의 실시예를 상세하게 설명하지만, 본 발명이 실시예들에 의해 제한되거나 한정되는 것은 아니다.BRIEF DESCRIPTION OF THE DRAWINGS The above and other features and advantages of the present invention will be more apparent from the following detailed description taken in conjunction with the accompanying drawings, in which: FIG.

본 명세서에서 사용되는 용어는 본 발명에서의 기능을 고려하면서 가능한 현재 널리 사용되는 일반적인 용어를 선택하였으나, 이는 당 분야에 종사하는 기술자의 의도 또는 관례 또는 새로운 기술의 출현 등에 따라 달라질 수 있다. 또한, 특정한 경우는 출원인이 임의로 선정한 용어도 있으며, 이 경우 해당되는 발명의 설명 부분에서 그 의미를 기재할 것이다. 따라서 본 명세서에서 사용되는 용어는, 단순한 용어의 명칭이 아닌 그 용어가 가지는 실질적인 의미와 본 명세서의 전반에 걸친 내용을 토대로 해석되어야 함을 밝혀두고자 한다.As used herein, terms used in the present invention are selected from general terms that are widely used in the present invention while taking into account the functions of the present invention, but these may vary depending on the intention or custom of a person skilled in the art or the emergence of new technologies. In addition, in certain cases, there may be a term arbitrarily selected by the applicant, in which case the meaning thereof will be described in the description of the corresponding invention. Therefore, it is intended that the terminology used herein should be interpreted based on the meaning of the term rather than on the name of the term, and on the entire contents of the specification.

이하 본 명세서에서 기술되는 “디스플레이 디바이스(Display Device)”라 함은 예를 들어, 데이터(Data), 컨텐트(Content), 서비스(Service), 애플리케이션(Application) 등을 송신, 수신, 처리 및 출력 중 적어도 하나 이상을 수행하는 모든 디바이스를 포함한다. 상기 디스플레이 디바이스는, 유/무선 네트워크(Wire/wireless network)를 통하여 다른 디스플레이 디바이스, 외부 서버(External server) 등과 페어링 또는 연결(Pairing or connecting)(이하 '페어링') 가능하며, 그를 통해 소정 데이터를 송/수신할 수 있다. 이때, 필요에 따라, 상기 데이터는 그 송/수신 전에 적절히 변환(Converting)될 수 있다. 상기 디스플레이 디바이스에는 예를 들어, 네트워크 TV(Network TV), HBBTV(Hybrid Broadcast Broadband TV), 스마트 TV(Smart TV), IPTV(Internet Protocol TV), PC(Personal Computer) 등과 같은 고정형 디바이스(standing device)와, PDA(Personal Digital Assistant), 스마트 폰(Smart Phone), 태블릿 PC(Tablet PC), 노트북(Notebook) 등과 같은 모바일 디바이스(mobile device or handheld device)가 모두 포함될 수 있다. 본 명세서에서는 본 발명의 이해를 돕고 출원인의 설명의 편의상 후술하는 도 2에서는 디지털 TV(Digital TV)를 그리고, 도 3에서는 모바일 디바이스를 디스플레이 디바이스의 일 실시 예로 도시하고 설명한다. 또한, 본 명세서에서 기술되는 디스플레이 디바이스는, 패널(panel)만을 가진 구성일 수도 있고, 셋톱박스(STB: Set-Top Box) 등과 같은 구성, 디바이스, 시스템 등과 하나의 세트(SET) 구성일 수도 있다.Hereinafter, the term " display device " as used in this specification refers to, for example, transmission of data, content, service, And includes all devices that perform at least one or more. The display device can be paired or connected (hereinafter referred to as "pairing") with another display device, an external server, or the like through a wire / wireless network, Can be transmitted / received. At this time, if necessary, the data may be appropriately converted before the transmission / reception. Examples of the display device include a standing device such as a network TV, a Hybrid Broadcast Broadband TV, a Smart TV, an Internet Protocol TV (IPTV), a Personal Computer (PC) And a mobile device or handheld device such as a PDA (Personal Digital Assistant), a smart phone, a tablet PC, a notebook, and the like. In order to facilitate the understanding of the present invention and to facilitate the description of the present invention, a digital TV will be described with reference to FIG. 2, and a mobile device will be described with reference to FIG. Further, the display device described herein may be a configuration having only a panel, a configuration such as a set-top box (STB), a device, a system, etc., and a set configuration .

한편, 본 명세서에서 기술되는 “유/무선 네트워크”라 함은, 디스플레이 디바이스들 또는 디스플레이 디바이스와 외부 서버 사이에서 페어링 또는/및 데이터 송수신을 위해 다양한 통신 규격 내지 프로토콜을 지원하는 통신 네트워크를 통칭한다. 이러한 유/무선 네트워크는, 규격에 의해 현재 또는 향후 지원될 통신 네트워크를 모두 포함하며, 그를 위한 하나 또는 그 이상의 통신 프로토콜들을 모두 지원 가능하다. 이러한 유/무선 네트워크에는 예컨대, USB(Universal Serial Bus), CVBS(Composite Video Banking Sync), 컴포넌트(Component), S-비디오(아날로그), DVI(Digital Visual Interface), HDMI(High Definition Multimedia Interface), RGB, D-SUB와 같은 유선 연결을 위한 네트워크와 그를 위한 통신 규격 내지 프로토콜과, 블루투스(Bluetooth), RFID(Radio Frequency Identification), 적외선 통신(IrDA, infrared Data Association), UWB(Ultra Wideband), 지그비(ZigBee), DLNA(Digital Living Network Alliance), WLAN(Wireless LAN)(Wi-Fi), Wibro(Wireless broadband), Wimax(World Interoperability for Microwave Access), HSDPA(High Speed Downlink Packet Access), LTE/LTE-A(Long Term Evolution(LTE)/LTE-Advanced), Wi-Fi 다이렉트(direct)와 같은 무선 연결을 위한 네트워크와 그를 위한 통신 규격 내지 프로토콜에 의하여 형성될 수 있다.The term " wired / wireless network " as used herein collectively refers to a communication network that supports various communication standards or protocols for pairing and / or data transmission / reception between display devices or a display device and an external server. Such a wired / wireless network includes all of the communication networks to be supported by the standard now or in the future, and is capable of supporting one or more communication protocols therefor. Such a wired / wireless network includes, for example, a USB (Universal Serial Bus), a Composite Video Banking Sync (CVBS), a Component, an S-Video (Analog), a DVI (Digital Visual Interface) A communication standard or protocol for a wired connection such as an RGB or a D-SUB, a Bluetooth standard, a radio frequency identification (RFID), an infrared data association (IrDA), an ultra wideband (UWB) (ZigBee), DLNA (Digital Living Network Alliance), WLAN (Wi-Fi), Wibro (Wireless broadband), Wimax (World Interoperability for Microwave Access), HSDPA (High Speed Downlink Packet Access) -A (Long Term Evolution (LTE) / LTE-Advanced), Wi-Fi Direct, and a communication standard or protocol for the network.

그 밖에, 본 명세서에서 단지 디스플레이 디바이스로 명명하는 경우, 그 의미는 문맥에 따라 고정형 디바이스 또는 모바일 디바이스를 의미할 수도 있고 특별히 언급하지 않는다면 양자를 모두 포함하는 의미로 사용될 수 있다.In addition, if the term is simply referred to herein as a display device, its meaning may refer to a fixed device or a mobile device depending on the context, and may be used to mean both, unless specifically stated otherwise.

한편, 디스플레이 디바이스는 예컨대, 방송 수신 기능, 컴퓨터 기능 내지 지원, 적어도 하나의 외부 입력 등을 지원하는 지능형 디바이스로서, 상술한 유/무선 네트워크를 통해 이메일(E-mail), 웹 브라우징(Web browsing), 뱅킹(Banking), 게임(Game), 애플리케이션 등을 지원할 수 있다. 더불어, 상기 디스플레이 디바이스는, 수기 방식의 입력 디바이스, 터치-스크린(Touch-screen), 공간 리모콘 등 적어도 하나의 입력 또는 제어 수단(이하 ‘입력 수단’)을 지원하기 위한 인터페이스(Interface)를 구비할 수 있다.On the other hand, the display device is an intelligent device that supports, for example, a broadcast receiving function, a computer function or a support, at least one external input, and the like. The display device includes an e-mail, a web browsing, , Banking, games, applications, and the like. In addition, the display device may include an interface for supporting at least one input or control means (hereinafter referred to as 'input means') such as a handwriting input device, a touch-screen, .

그 밖에, 디스플레이 디바이스는, 표준화된 범용 OS를 이용할 수 있으나 특히, 본 명세에서 기술되는 디스플레이 디바이스는, Web OS를 이용하는 것을 일 실시 예로 한다. 따라서, 디스플레이 디바이스는 범용의 OS 커널(OS kernel) 또는 리눅스 커널(Linux kernel) 상에 다양한 서비스나 애플리케이션을 추가(Adding), 삭제(Deleting), 수정(Amending), 업데이트(Updating) 등을 처리가 가능하며, 그를 통해 더욱 사용자 친화적인(User-friendly) 환경을 구성하여 제공할 수 있다.In addition, the display device can use a standardized general-purpose OS, but in particular, the display device described in this specification uses the Web OS as an embodiment. Accordingly, the display device processes adding, deleting, amending, and updating various services or applications on a general-purpose OS kernel or a Linux kernel. And through which a more user-friendly environment can be constructed and provided.

한편, 상술한 디스플레이 디바이스는 외부 입력을 수신하여 처리할 수 있는데, 이때 상기 외부 입력은, 외부 입력 디바이스 즉, 상술한 디스플레이 디바이스와 유/무선 네트워크를 통해 연결되어 데이터를 송/수신하여 처리 가능한 모든 입력 수단 내지 디스플레이 디바이스를 포함한다. 예를 들어, 상기 외부 입력으로 HDMI(High-Definition Multimedia Interface), 플레이스테이션(Playstation)이나 엑스-박스(X-Box) 등과 같은 게임 디바이스(Game device), 스마트 폰, 태블릿 PC, 포켓포토(Pocket photo) 등과 같은 프린터기(Printing device), 스마트 TV, 블루-레이 디바이스(Blu-ray device) 등과 같은 디스플레이 디바이스들을 모두 포함한다.Meanwhile, the above-described display device can receive and process an external input, wherein the external input is connected to an external input device, that is, the above-described display device through a wired / wireless network, Input means or a display device. For example, the external input may be a game device such as a High-Definition Multimedia Interface (HDMI), a Playstation or an X-Box, a smart phone, a tablet PC, a Pocket photo devices such as a photo printer, a smart TV, a Blu-ray device, and the like.

그 밖에, 본 명세서에서 기술되는 “서버”라 함은, 상술한 디스플레이 디바이스 즉, 클라이언트(Client)로 데이터를 공급 또는 그로부터 데이터를 수신하는 디스플레이 디바이스 혹은 시스템을 의미하며, 프로세서(Processor)로 불리기도 한다. 상기 서버로 예컨대, 웹 페이지(Web page), 웹 컨텐트 또는 웹 서비스(Web content or Web service)를 제공하는 포털 서버(Portal server), 광고 데이터(Advertising data)를 제공하는 광고 서버(Advertising server), 컨텐트를 제공하는 컨텐트 서버(Content server), SNS(Social Network Service)를 제공하는 SNS 서버, 제조업체(Manufacturer)에서 제공하는 서비스 서버(Service server), 유료 서비스(Pay service)를 제공하는 유료 서비스 서버 등이 포함될 수 있다.In addition, the term "server" as used herein refers to a display device or system that supplies data to or receives data from the above-described display device, that is, a client, and may be referred to as a processor do. The server may include a portal server for providing a Web page, a web content or a web service, an advertisement server for providing advertisement data, A content server providing content, an SNS server providing a social network service (SNS), a service server provided by a manufacturer, a paid service server providing a pay service, and the like May be included.

이하 첨부된 도면을 참조하면 본 발명을 더욱 상세하게 설명하면, 다음과 같다.DETAILED DESCRIPTION OF THE PREFERRED EMBODIMENTS Hereinafter, the present invention will be described in detail with reference to the accompanying drawings.

도 1은 본 발명의 일 실시 예에 따른 디스플레이 디바이스를 포함한 서비스 시스템(Service system)을 개략적으로 설명하기 위해 도시한 도면이다.FIG. 1 is a view for schematically explaining a service system including a display device according to an embodiment of the present invention. Referring to FIG.

도 1을 참조하면, 서비스 시스템은, 컨텐트 제공자(CP: content provider)(10), 서비스 제공자(SP: service provider)(20), 네트워크 제공자(NP: network provider)(30) 및 HNED(Home Network End User)(Customer)(40)를 포함한다. 여기서, HNED(40)는 예를 들어, 클라이언트(100) 즉, 본 발명에 따른 디스플레이 디바이스를 포함한다.1, a service system includes a content provider (CP) 10, a service provider (SP) 20, a network provider (NP) 30, and a home network End User (Customer) 40. Here, the

컨텐트 제공자(10)는, 각종 컨텐트를 제작하여 제공한다. 도 1에 도시된 바와 같이, 이러한 컨텐트 제공자(10)로 지상파 방송 송출자, 케이블 방송 사업자(cable SO (System Operator)) 또는 MSO(Multiple SO), 위성 방송 송출자, 다양한 인터넷 방송 송출자, 개인 컨텐트 제공자들 등을 예시할 수 있다. 한편, 컨텐트 제공자(10)는, 방송 컨텐트 외에도 다양한 서비스나 애플리케이션 등을 제작하여 제공할 수 있다.The

서비스 제공자(20)는, 컨텐트 제공자(10)에 의해 제작된 컨텐트를 서비스 패키지화(service packetizing)하여 HNED(40)로 제공한다. 예컨대, 서비스 제공자(20)는, 제1 지상파 방송, 제2 지상파 방송, 케이블 MSO, 위성 방송, 다양한 인터넷 방송, 애플리케이션 등에 의해 제작된 컨텐트들 중 적어도 하나 이상을 서비스를 위해 패키지화하고, 이를 HNED(40)에게 제공한다.The

서비스 제공자(20)는, 유니-캐스트(uni-cast) 또는 멀티-캐스트(multi-cast) 방식으로 클라이언트(100)에 서비스를 제공한다. 한편, 서비스 제공자(20)는 데이터를 미리 등록된 다수의 클라이언트(100)로 한꺼번에 전송할 수 있는데, 이를 위해 IGMP(Internet Group Management Protocol) 프로토콜 등을 이용할 수 있다.The

상술한 컨텐트 제공자(10)와 서비스 제공자(20)는, 동일한 개체(entity)일 수 있다. 예를 들어, 컨텐트 제공자(10)가 제작한 컨텐트를 서비스 패키지화하여 HNED(40)로 제공함으로써 서비스 제공자(20)의 기능도 함께 수행하거나 그 반대일 수도 있다.The above-described

네트워크 제공자(30)는, 컨텐트 제공자(10) 또는/및 서비스 제공자(20)와 클라이언트(100) 사이의 데이터 교환을 위한 네트워크 망을 제공한다.The

클라이언트(100)는, HNED(40)에 속한 소비자(consumer)로서, 네트워크 제공자(30)를 통해 예컨대, 홈 네트워크(home network)를 구축하여 데이터를 수신하며, VoD(Video on Demand) 등 다양한 서비스나 애플리케이션 등에 관한 데이터를 송/수신할 수도 있다.The

한편, 서비스 시스템 내 컨텐트 제공자(10) 또는/및 서비스 제공자(20)는 전송되는 컨텐트의 보호를 위해 제한 수신(conditional access) 또는 컨텐트 보호(content protection) 수단을 이용할 수 있다. 따라서, 클라이언트(100)는 상기 제한 수신이나 컨텐트 보호에 대응하여 케이블카드(CableCARD)(또는 POD: Point of Deployment), DCAS(Downloadable CAS) 등과 같은 처리 수단을 이용할 수 있다.On the other hand, the

그 밖에, 클라이언트(100)도 네트워크 망을 통해, 양방향 서비스를 이용할 수 있다. 이러한 경우, 클라이언트(100)가 오히려 컨텐트 제공자의 역할 내지 기능을 수행할 수도 있으며, 서비스 제공자(20)는 이를 수신하여 다시 다른 클라이언트 등으로 전송할 수도 있다.In addition, the

도 1에서 컨텐트 제공자(10) 또는/및 서비스 제공자(20)는 본 명세서에서 후술하는 서비스를 제공하는 서버일 수 있다. 이 경우, 상기 서버는 필요에 따라 네트워크 제공자(30)도 소유 내지 포함하는 의미일 수 있다. 이하 특별히 언급하지 않더라도 서비스 또는 서비스 데이터는, 전술한 외부로부터 수신되는 서비스 내지 애플리케이션뿐만 아니라 내부 서비스 내지 애플리케이션을 포함하며, 이러한 서비스 내지 애플리케이션은 Web OS 기반의 클라이언(100)를 위한 서비스 내지 애플리케이션 데이터를 의미할 수 있다.In FIG. 1, the

도 2는 본 발명의 일 실시 예에 따른 디스플레이 디바이스를 설명하기 위해 도시한 구성 블록도이다.2 is a block diagram illustrating a display device according to an exemplary embodiment of the present invention.

이하 본 명세서에서 기술되는 디스플레이 디바이스는 전술한 도 1의 클라이언트(100)에 해당한다.Hereinafter, the display device described herein corresponds to the

일 실시 예로, 본 발명에 따른 디스플레이 디바이스는, 디스플레이 디바이스(200)는, 네트워크 인터페이스부(Network Interface)(201), TCP/IP 매니저(TCP/IP manager)(202), 서비스 전달 매니저(Service Delivery Manager)(203), SI 디코더(204), 역다중화부(Demux or demultiplexer)(205), 오디오 디코더(Audio Decoder)(206), 비디오 디코더(Video Decoder)(207), 디스플레이부(Display A/V and OSD module)(208), 서비스 제어 매니저(Service Control Manager)(209), 서비스 디스커버리 매니저(Service Discovery Manager)(210), SI&메타데이터 데이터베이스(SI&Metadata DB)(211), 메타데이터 매니저(Metadata Manager)(212), 서비스 매니저(213), UI 매니저(214) 등을 포함하여 구성된다.In one embodiment, the

네트워크 인터페이스부(201)는, 액세스하는 네트워크 망을 통하여 IP 패킷(들)(Internet Protocol (IP) packet(s)) 또는 IP 데이터그램(들)(IP datagram(s))(이하 IP 패킷(들)이라 한다)을 송/수신한다. 일 예로, 네트워크 인터페이스부(201)는 네트워크 망을 통해 도 1의 서비스 제공자(20)로부터 서비스, 애플리케이션, 컨텐트 등을 수신할 수 있다.The

TCP/IP 매니저(202)는, 디스플레이 디바이스(200)로 수신되는 IP 패킷들과 디스플레이 디바이스(200)가 전송하는 IP 패킷들에 대하여 즉, 소스(Source)와 목적지(Destination) 사이의 패킷 전달(Packet Delivery)에 관여한다. 상기 TCP/IP 매니저(202)는 수신된 패킷(들)을 적절한 프로토콜에 대응하도록 분류하고, 서비스 전달 매니저(205), 서비스 디스커버리 매니저(210), 서비스 제어 매니저(209), 메타데이터 매니저(212) 등으로 상기 분류된 패킷(들)을 출력한다.The TCP /

서비스 전달 매니저(203)는, 수신되는 서비스 데이터의 제어를 담당한다. 예를 들어, 서비스 전달 매니저(203)는 실시간 스트리밍(real-time streaming) 데이터를 제어하는 경우에는 RTP/RTCP를 사용할 수 있다. 상기 실시간 스트리밍 데이터를 RTP를 사용하여 전송하는 경우, 서비스 전달 매니저(203)는 상기 수신된 데이터 패킷을 RTP에 따라 파싱(parsing)하여 역다중화부(205)로 전송하거나 서비스 매니저(213)의 제어에 따라 SI&메타데이터 데이터베이스(211)에 저장한다. 그리고, 서비스 전달 매니저(203)는 RTCP를 이용하여 상기 네트워크 수신 정보를 서비스를 제공하는 서버 측에 피드백(feedback)한다.The

역다중화부(205)는, 수신된 패킷을 오디오, 비디오, SI(System Information) 데이터 등으로 역다중화하여 각각 오디오/비디오 디코더(206/207), SI 디코더(204)에 전송한다.The

SI 디코더(204)는, 역다중화된 SI 데이터 즉, PSI(Program Specific Information), PSIP(Program and System Information Protocol), DVB-SI(Digital Video Broadcasting-Service Information), DTMB/CMMB(Digital Television Terrestrial Multimedia Broadcasting/Coding Mobile Multimedia Broadcasting) 등의 서비스 정보를 디코딩한다. 또한, SI 디코더(204)는, 디코딩된 서비스 정보들을 SI&메타데이터 데이터베이스(211)에 저장할 수 있다. 저장된 서비스 정보는 예를 들어, 사용자의 요청 등에 의해 해당 구성에 의해 독출되어 이용될 수 있다.The

오디오/비디오 디코더(206/207)는, 역다중화된 각 오디오 데이터와 비디오 데이터를 디코딩한다. 이렇게 디코딩된 오디오 데이터 및 비디오 데이터는 디스플레이부(208)를 통하여 사용자에게 제공된다.The audio /

애플리케이션 매니저는 예를 들어, UI 매니저(214)와 서비스 매니저(213)를 포함하며 디스플레이 디바이스(200)의 제어부 기능을 수행할 수 있다. 다시 말해, 애플리케이션 매니저는, 디스플레이 디바이스(200)의 전반적인 상태를 관리하고 사용자 인터페이스(user interface)를 제공하며, 다른 매니저를 관리할 수 있다.The application manager includes, for example, a

UI 매니저(214)는, 사용자를 위한 GUI(Graphic User Interface)/UI를 OSD(On Screen Display) 등을 이용하여 제공하며, 사용자로부터 키 입력을 받아 상기 입력에 따른 디바이스 동작을 수행한다. 예를 들어, UI 매니저(214)는 사용자로부터 채널 선택에 관한 키 입력을 받으면 상기 키 입력 신호를 서비스 매니저(213)에 전송한다.The

서비스 매니저(213)는, 서비스 전달 매니저(203), 서비스 디스커버리 매니저(210), 서비스 제어 매니저(209), 메타데이터 매니저(212) 등 서비스와 연관된 매니저를 제어한다.The

또한, 서비스 매니저(213)는, 채널 맵(channel map)을 생성하고 UI 매니저(214)로부터 수신한 키 입력에 따라 상기 생성된 채널 맵을 이용하여 채널을 선택 등을 제어한다. 상기 서비스 매니저(213)는 SI 디코더(204)로부터 서비스 정보를 전송 받아 선택된 채널의 오디오/비디오 PID(Packet Identifier)를 역다중화부(205)에 설정한다. 이렇게 설정되는 PID는 상술한 역다중화 과정에 이용될 수 있다. 따라서, 역다중화부(205)는 상기 PID를 이용하여 오디오 데이터, 비디오 데이터 및 SI 데이터를 필터링(PID or section filtering) 한다.In addition, the

서비스 디스커버리 매니저(210)는, 서비스를 제공하는 서비스 제공자를 선택하는데 필요한 정보를 제공한다. 상기 서비스 매니저(213)로부터 채널 선택에 관한 신호를 수신하면, 서비스 디스커버리 매니저(210)는 상기 정보를 이용하여 서비스를 찾는다.The

서비스 제어 매니저(209)는, 서비스의 선택과 제어를 담당한다. 예를 들어, 서비스 제어 매니저(209)는 사용자가 기존의 방송 방식과 같은 생방송(live broadcasting) 서비스를 선택하는 경우 IGMP 또는 RTSP 등을 사용하고, VOD(Video on Demand)와 같은 서비스를 선택하는 경우에는 RTSP를 사용하여 서비스의 선택, 제어를 수행한다. 상기 RTSP 프로토콜은 실시간 스트리밍에 대해 트릭 모드(trick mode)를 제공할 수 있다. 또한, 서비스 제어 매니저(209)는 IMS(IP Multimedia Subsystem), SIP(Session Initiation Protocol)를 이용하여 IMS 게이트웨이(250)를 통하는 세션을 초기화하고 관리할 수 있다. 상기 프로토콜들은 일 실시 예이며, 구현 예에 따라 다른 프로토콜을 사용할 수도 있다.The

메타데이터 매니저(212)는, 서비스와 연관된 메타데이터를 관리하고 상기 메타데이터를 SI&메타데이터 데이터베이스(211)에 저장한다.The

SI&메타데이터 데이터베이스(211)는, SI 디코더(204)가 디코딩한 서비스 정보, 메타데이터 매니저(212)가 관리하는 메타데이터 및 서비스 디스커버리 매니저(210)가 제공하는 서비스 제공자를 선택하는데 필요한 정보를 저장한다. 또한, SI&메타데이터 데이터베이스(211)는 시스템에 대한 세트-업 데이터 등을 저장할 수 있다.The SI &

SI&메타데이터 데이터베이스(211)는, 비휘발성 메모리(Non-Volatile RAM: NVRAM) 또는 플래시 메모리(flash memory) 등을 사용하여 구현될 수도 있다.The SI &

한편, IMS 게이트웨이(250)는, IMS 기반의 IPTV 서비스에 접근하기 위해 필요한 기능들을 모아 놓은 게이트웨이이다.Meanwhile, the

도 3은 본 발명의 다른 실시 예에 따른 디스플레이 디바이스를 설명하기 위해 도시한 구성 블록도이다.3 is a block diagram illustrating a display device according to another embodiment of the present invention.

전술한 도 2가 고정 디바이스를 디스플레이 디바이스의 일 실시 예로 하여 설명하였다면, 도 3은 모바일 디바이스를 디스플레이 디바이스의 다른 실시 예로 한다.If the above-described Fig. 2 described the fixing device as one embodiment of the display device, Fig. 3 shows the mobile device as another embodiment of the display device.

도 3을 참조하면, 모바일 디바이스(300)는, 무선 통신부(310), A/V(Audio/Video) 입력부(320), 사용자 입력부(330), 센싱부(340), 출력부(350), 메모리(360), 인터페이스부(370), 제어부(380) 및 전원 공급부(390) 등을 포함할 수 있다.3, the

이하 각 구성요소에 대해 상세히 설명하면, 다음과 같다.Hereinafter, each component will be described in detail.

무선 통신부(310)는, 모바일 디바이스(300)와 무선 통신 시스템 사이 또는 모바일 디바이스와, 모바일 디바이스가 위치한 네트워크 사이의 무선 통신을 가능하게 하는 하나 또는 그 이상의 모듈을 포함할 수 있다. 예를 들어, 무선 통신부(310)는 방송 수신 모듈(311), 이동통신 모듈(312), 무선 인터넷 모듈(313), 근거리 통신 모듈(314) 및 위치정보 모듈(315) 등을 포함할 수 있다.The

방송 수신 모듈(311)은, 방송 채널을 통하여 외부의 방송 관리 서버로부터 방송 신호 및/또는 방송 관련된 정보를 수신한다. 여기서, 방송 채널은 위성 채널, 지상파 채널을 포함할 수 있다. 상기 방송 관리 서버는, 방송 신호 및/또는 방송 관련 정보를 생성하여 송신하는 서버 또는 기 생성된 방송 신호 및/또는 방송 관련 정보를 제공받아 단말기에 송신하는 서버를 의미할 수 있다. 상기 방송 신호는, TV 방송 신호, 라디오 방송 신호, 데이터 방송 신호를 포함할 뿐만 아니라, TV 방송 신호 또는 라디오 방송 신호에 데이터 방송 신호가 결합한 형태의 방송 신호도 포함할 수 있다.The

방송 관련 정보는, 방송 채널, 방송 프로그램 또는 방송 서비스 제공자에 관련한 정보를 의미할 수 있다. 상기 방송 관련 정보는, 이동통신망을 통하여도 제공될 수 있다. 이러한 경우에는 상기 이동통신 모듈(312)에 의해 수신될 수 있다.The broadcast-related information may mean information related to a broadcast channel, a broadcast program, or a broadcast service provider. The broadcast-related information may also be provided through a mobile communication network. In this case, it may be received by the

방송 관련 정보는 다양한 형태 예를 들어, EPG(Electronic Program Guide) 또는 ESG(Electronic Service Guide) 등의 형태로 존재할 수 있다.The broadcast-related information may exist in various forms, for example, in the form of an EPG (Electronic Program Guide) or an ESG (Electronic Service Guide).

방송수신 모듈(311)은 예를 들어, ATSC, DVB-T(Digital Video Broadcasting-Terrestrial), DVB-S(Satellite), MediaFLO(Media Forward Link Only), DVB-H(Handheld), ISDB-T(Integrated Services Digital Broadcast-Terrestrial) 등 디지털 방송 시스템을 이용하여 디지털 방송 신호를 수신할 수 있다. 물론, 방송수신모듈(311)은, 상술한 디지털 방송 시스템뿐만 아니라 다른 방송 시스템에 적합하도록 구성될 수도 있다.The

방송수신 모듈(311)을 통해 수신된 방송 신호 및/또는 방송 관련 정보는, 메모리(360)에 저장될 수 있다.The broadcast signal and / or broadcast related information received through the

이동통신 모듈(312)은, 이동 통신망 상에서 기지국, 외부 단말, 서버 중 적어도 하나와 무선 신호를 송수신한다. 무선 신호는, 음성 신호, 화상 통화 신호 또는 문자/멀티미디어 메시지 송수신에 따른 다양한 형태의 데이터를 포함할 수 있다.The

무선인터넷 모듈(313)은, 무선 인터넷 접속을 위한 모듈을 포함하여, 모바일 디바이스(300)에 내장되거나 외장될 수 있다. 무선 인터넷 기술로는 WLAN(Wireless LAN)(Wi-Fi), Wibro(Wireless broadband), Wimax(World Interoperability for Microwave Access), HSDPA(High Speed Downlink Packet Access) 등이 이용될 수 있다.The wireless Internet module 313 may be embedded or external to the

근거리통신 모듈(314)은, 근거리 통신을 위한 모듈을 말한다. 근거리 통신(short range communication) 기술로 블루투스(Bluetooth), RFID(Radio Frequency Identification), 적외선 통신(IrDA, infrared Data Association), UWB(Ultra Wideband), ZigBee, RS-232, RS-485 등이 이용될 수 있다.The short-

위치정보 모듈(315)은, 모바일 디바이스(300)의 위치 정보 획득을 위한 모듈로서, GPS(Global Position System) 모듈을 예로 할 수 있다.The

A/V 입력부(320)는, 오디오 또는/및 비디오 신호 입력을 위한 것으로, 이에는 카메라(321)와 마이크(322) 등이 포함될 수 있다. 카메라(321)는, 화상통화 모드 또는 촬영 모드에서 이미지 센서에 의해 얻어지는 정지영상 또는 동영상 등의 화상 프레임을 처리한다. 처리된 화상 프레임은 디스플레이부(351)에 표시될 수 있다.The A /

카메라(321)에서 처리된 화상 프레임은, 메모리(360)에 저장되거나 무선 통신부(310)를 통하여 외부로 전송될 수 있다. 카메라(321)는, 사용 환경에 따라 2개 이상이 구비될 수도 있다.The image frame processed by the

마이크(322)는, 통화 모드 또는 녹음 모드, 음성인식 모드 등에서 마이크로폰(Microphone)에 의해 외부의 음향 신호를 입력 받아 전기적인 음성 데이터로 처리한다. 처리된 음성 데이터는, 통화 모드인 경우 이동통신 모듈(312)을 통하여 이동통신 기지국으로 송신 가능한 형태로 변환되어 출력될 수 있다. 마이크(322)에는 외부의 음향 신호를 입력 받는 과정에서 발생하는 잡음(noise)을 제거하기 위한 다양한 잡음 제거 알고리즘이 구현될 수 있다.The

사용자 입력부(330)는, 사용자가 단말기의 동작 제어를 위한 입력 데이터를 발생시킨다. 사용자 입력부(330)는, 키 패드(key pad), 돔 스위치 (dome switch), 터치 패드(정압/정전), 조그 휠(jog wheel), 조그 스위치(jog switch) 등으로 구성될 수 있다.The

센싱부(340)는, 모바일 디바이스(300)의 개폐 상태, 모바일 디바이스(300)의 위치, 사용자 접촉 유무, 모바일 디바이스의 방위, 모바일 디바이스의 가속/감속 등과 같이 모바일 디바이스(300)의 현재 상태를 감지하여 모바일 디바이스(300)의 동작 제어를 위한 센싱 신호를 발생시킨다. 예를 들어, 모바일 디바이스(300)가 이동되거나 기울어진 경우 모바일 디바이스의 위치 내지 기울기 등을 센싱할 수 있다. 또한, 전원 공급부(390)의 전원 공급 여부, 인터페이스부(370)의 외부 디바이스 결합 여부 등도 센싱할 수도 있다. 한편, 센싱부(240)는, NFC(Near Field Communication) 등을 포함한 근접 센서(341)를 포함할 수 있다.The

출력부(350)는, 시각, 청각 또는 촉각 등과 관련된 출력을 발생시키기 위한 것으로, 디스플레이부(351), 음향 출력 모듈(352), 알람부(353), 및 햅틱 모듈(354) 등이 포함될 수 있다.The

디스플레이부(351)는, 모바일 디바이스(300)에서 처리되는 정보를 표시(출력)한다. 예를 들어, 모바일 디바이스가 통화 모드인 경우 통화와 관련된 UI 또는 GUI를 표시한다. 모바일 디바이스(300)가 화상 통화 모드 또는 촬영 모드인 경우에는, 촬영 또는/및 수신된 영상 또는 UI, GUI를 표시한다.The

디스플레이부(351)는, 액정 디스플레이(liquid crystal display, LCD), 박막 트랜지스터 액정 디스플레이(thin film transistor-liquid crystal display, TFT LCD), 유기 발광 다이오드(organic light-emitting diode, OLED), 플렉시블 디스플레이(flexible display), 3차원 디스플레이 중에서 적어도 하나를 포함할 수 있다.The

이들 중 일부 디스플레이는 그를 통해 외부를 볼 수 있도록 투명형 또는 광투과형으로 구성될 수 있다. 이는 투명 디스플레이라 호칭될 수 있는데, 상기 투명 디스플레이의 대표적인 예로는 TOLED(Transparant OLED) 등이 있다. 디스플레이부(351)의 후방 구조 또한 광 투과형 구조로 구성될 수 있다. 이러한 구조에 의하여, 사용자는 단말기 바디의 디스플레이부(351)가 차지하는 영역을 통해 단말기 바디(body)의 후방에 위치한 사물을 볼 수 있다.Some of these displays may be transparent or light transmissive so that they can be seen through. This can be referred to as a transparent display, and a typical example of the transparent display is TOLED (Transparent OLED) and the like. The rear structure of the

모바일 디바이스(300)의 구현 형태에 따라 디스플레이부(351)가 2개 이상 존재할 수 있다. 예를 들어, 모바일 디바이스(300)에는 복수의 디스플레이부들이 하나의 면에 이격되거나 일체로 배치될 수 있고, 또한 서로 다른 면에 각각 배치될 수도 있다.There may be two or

디스플레이부(351)와 터치 동작을 감지하는 센서(이하 '터치 센서'라 함)가 상호 레이어 구조를 이루는 경우(이하, '터치 스크린'이라 함)에, 디스플레이부(351)는 출력 디바이스 이외에 입력 디바이스로도 사용될 수 있다. 터치 센서는, 예를 들어, 터치 필름, 터치 시트, 터치 패드 등의 형태를 가질 수 있다.(Hereinafter, referred to as a 'touch screen') in which a

터치 센서는 디스플레이부(351)의 특정 부위에 가해진 압력 또는 디스플레이부(351)의 특정 부위에 발생하는 정전 용량 등의 변화를 전기적인 입력신호로 변환하도록 구성될 수 있다. 터치 센서는 터치 되는 위치 및 면적뿐만 아니라, 터치 시의 압력까지도 검출할 수 있도록 구성될 수 있다.The touch sensor may be configured to convert a change in a pressure applied to a specific portion of the

터치 센서에 대한 터치 입력이 있는 경우, 그에 대응하는 신호(들)는 터치 제어기로 보내진다. 터치 제어기는 그 신호(들)를 처리한 다음 대응하는 데이터를 제어부(380)로 전송한다. 이로써, 제어부(380)는 디스플레이부(351)의 어느 영역이 터치 되었는지 여부 등을 알 수 있게 된다.If there is a touch input to the touch sensor, the corresponding signal (s) is sent to the touch controller. The touch controller processes the signal (s) and transmits corresponding data to the

터치스크린에 의해 감싸지는 모바일 디바이스의 내부 영역 또는 상기 터치 스크린의 근처에 근접 센서(341)가 배치될 수 있다. 상기 근접 센서는 소정의 검출면에 접근하는 물체, 혹은 근방에 존재하는 물체의 유무를 전자계의 힘 또는 적외선을 이용하여 기계적 접촉이 없이 검출하는 센서를 말한다. 근접 센서는 접촉식 센서보다는 그 수명이 길며 그 활용도 또한 높다.A

상기 근접 센서의 예로는 투과형 광전 센서, 직접 반사형 광전 센서, 미러 반사형 광전 센서, 고주파 발진형 근접 센서, 정전용량형 근접 센서, 자기형 근접 센서, 적외선 근접 센서 등이 있다. 상기 터치스크린이 정전식인 경우에는 상기 포인터의 근접에 따른 전계의 변화로 상기 포인터의 근접을 검출하도록 구성된다. 이 경우 상기 터치 스크린(터치 센서)은 근접 센서로 분류될 수도 있다.Examples of the proximity sensor include a transmission type photoelectric sensor, a direct reflection type photoelectric sensor, a mirror reflection type photoelectric sensor, a high frequency oscillation type proximity sensor, a capacitive proximity sensor, a magnetic proximity sensor, and an infrared proximity sensor. And to detect the proximity of the pointer by the change of the electric field along the proximity of the pointer when the touch screen is electrostatic. In this case, the touch screen (touch sensor) may be classified as a proximity sensor.

이하에서는 설명의 편의를 위해, 상기 터치스크린 상에 포인터가 접촉되지 않으면서 근접되어 상기 포인터가 상기 터치스크린 상에 위치함이 인식되도록 하는 행위를 "근접 터치(proximity touch)"라고 칭하고, 상기 터치스크린 상에 포인터가 실제로 접촉되는 행위를 "접촉 터치(contact touch)"라고 칭한다. 상기 터치스크린 상에서 포인터로 근접 터치가 되는 위치라 함은, 상기 포인터가 근접 터치될 때 상기 포인터가 상기 터치스크린에 대해 수직으로 대응되는 위치를 의미한다.Hereinafter, for convenience of explanation, the act of recognizing that the pointer is positioned on the touch screen while the pointer is not in contact with the touch screen is referred to as "proximity touch" The act of actually touching the pointer on the screen is called "contact touch. &Quot; The position where the pointer is proximately touched on the touch screen means a position where the pointer is vertically corresponding to the touch screen when the pointer is touched.

상기 근접 센서는, 근접 터치와, 근접 터치 패턴(예를 들어, 근접 터치 거리, 근접 터치 방향, 근접 터치 속도, 근접 터치 시간, 근접 터치 위치, 근접 터치 이동 상태 등)을 감지한다. 상기 감지된 근접 터치 동작 및 근접 터치 패턴에 상응하는 정보는 터치 스크린상에 출력될 수 있다.The proximity sensor detects a proximity touch and a proximity touch pattern (e.g., a proximity touch distance, a proximity touch direction, a proximity touch speed, a proximity touch time, a proximity touch position, a proximity touch movement state, and the like). Information corresponding to the detected proximity touch operation and the proximity touch pattern may be output on the touch screen.

음향출력모듈(352)은, 호신호 수신, 통화 모드 또는 녹음 모드, 음성인식 모드, 방송수신 모드 등에서 무선 통신부(310)로부터 수신되거나 메모리(360)에 저장된 오디오 데이터를 출력할 수 있다. 음향 출력 모듈(352)은 모바일 디바이스(300)에서 수행되는 기능(예를 들어, 호신호 수신음, 메시지 수신음 등)과 관련된 음향 신호를 출력하기도 한다. 이러한 음향 출력 모듈(352)에는 리시버(receiver), 스피커(speaker), 버저(buzzer) 등이 포함될 수 있다.The

알람부(353)는, 모바일 디바이스(300)의 이벤트 발생을 알리기 위한 신호를 출력한다. 모바일 디바이스에서 발생 되는 이벤트의 예로는 호 신호 수신, 메시지 수신, 키 신호 입력, 터치 입력 등이 있다. 알람부(353)는, 비디오 신호나 오디오 신호 이외에 다른 형태, 예를 들어 진동으로 이벤트 발생을 알리기 위한 신호를 출력할 수도 있다. 상기 비디오 신호나 오디오 신호는 디스플레이부(351)나 음성 출력 모듈(352)을 통해서도 출력될 수 있어서, 그들(351,352)은 알람부(353)의 일부로 분류될 수도 있다.The

햅틱 모듈(haptic module)(354)은, 사용자가 느낄 수 있는 다양한 촉각 효과를 발생시킨다. 햅틱 모듈(354)이 발생시키는 촉각 효과의 대표적인 예로는 진동이 있다. 햅택 모듈(354)이 발생하는 진동의 세기와 패턴 등은 제어 가능하다. 예를 들어, 서로 다른 진동을 합성하여 출력하거나 순차적으로 출력할 수도 있다. 햅틱 모듈(354)은, 진동 외에도, 접촉 피부면에 대해 수직 운동하는 핀 배열, 분사구나 흡입구를 통한 공기의 분사력이나 흡입력, 피부 표면에 대한 스침, 전극(eletrode)의 접촉, 정전기력 등의 자극에 의한 효과와, 흡열이나 발열 가능한 소자를 이용한 냉온감 재현에 의한 효과 등 다양한 촉각 효과를 발생시킬 수 있다. 햅틱 모듈(354)은, 직접적인 접촉을 통해 촉각 효과의 전달할 수 있을 뿐만 아니라, 사용자가 손가락이나 팔 등의 근 감각을 통해 촉각 효과를 느낄 수 있도록 구현할 수도 있다. 햅틱 모듈(354)은, 모바일 디바이스(300)의 구성 태양에 따라 2개 이상이 구비될 수 있다.The

메모리(360)는, 제어부(380)의 동작을 위한 프로그램을 저장할 수 있고, 입/출력되는 데이터들(예를 들어, 폰 북, 메시지, 정지영상, 동영상 등)을 임시 저장할 수도 있다. 상기 메모리(360)는 상기 터치스크린 상의 터치 입력 시 출력되는 다양한 패턴의 진동 및 음향에 관한 데이터를 저장할 수 있다.The

메모리(360)는, 플래시 메모리 타입(flash memory type), 하드디스크 타입(hard disk type), 멀티미디어 카드 마이크로 타입(multimedia card micro type), 카드 타입의 메모리(예를 들어 SD 또는 XD 메모리 등), 램(Random Access Memory, RAM), SRAM(Static Random Access Memory), 롬(Read-Only Memory, ROM), EEPROM(Electrically Erasable Programmable Read-Only Memory), PROM(Programmable Read-Only Memory), 자기 메모리, 자기 디스크, 광디스크 중 적어도 하나의 타입의 저장매체를 포함할 수 있다. 모바일 디바이스(300)는 인터넷(internet)상에서 상기 메모리(360)의 저장 기능을 수행하는 웹 스토리지(web storage)와 관련되어 동작할 수도 있다.The

인터페이스부(370)는, 모바일 디바이스(300)에 연결되는 모든 외부 디바이스와의 통로 역할을 한다. 인터페이스부(370)는 외부 디바이스로부터 데이터를 전송 받거나, 전원을 공급받아 모바일 디바이스(300) 내부의 각 구성 요소에 전달하거나, 모바일 디바이스(300) 내부의 데이터가 외부 디바이스로 전송되도록 한다. 예를 들어, 유/무선 헤드셋 포트, 외부 충전기 포트, 유/무선 데이터 포트, 메모리 카드(memory card) 포트, 식별 모듈이 구비된 디바이스를 연결하는 포트, 오디오 I/O(Input/Output) 포트, 비디오 I/O 포트, 이어폰 포트 등이 인터페이스부(370)에 포함될 수 있다.The

식별 모듈은 모바일 디바이스(300)의 사용 권한을 인증하기 위한 각종 정보를 저장한 칩으로서, 사용자 인증 모듈(User Identify Module, UIM), 가입자 인증 모듈(Subscriber Identify Module, SIM), 범용 사용자 인증 모듈(Universal Subscriber Identity Module, USIM) 등을 포함할 수 있다. 식별 모듈이 구비된 디바이스(이하 '식별 디바이스')는, 스마트 카드(smart card) 형식으로 제작될 수 있다. 따라서 식별 디바이스는 포트를 통하여 단말기(200)와 연결될 수 있다.The identification module is a chip for storing various information for authenticating the usage right of the

인터페이스부(370)는, 모바일 디바이스(300)가 외부 크래들(cradle)과 연결될 때, 상기 크래들로부터의 전원이 상기 모바일 디바이스(300)에 공급되는 통로가 되거나, 사용자에 의해 상기 크래들에서 입력되는 각종 명령 신호가 상기 모바일 디바이스로 전달되는 통로가 될 수 있다. 크래들로부터 입력되는 각종 명령 신호 또는 상기 전원은, 모바일 디바이스가 상기 크래들에 정확히 장착되었음을 인지하기 위한 신호로 동작될 수도 있다.The

제어부(380)는, 통상적으로 모바일 디바이스(300)의 전반적인 동작을 제어한다. 제어부(380)는 예를 들어, 음성 통화, 데이터 통신, 화상 통화 등을 위한 관련된 제어 및 처리를 수행한다. 제어부(380)는, 멀티미디어 재생을 위한 멀티미디어 모듈(381)을 구비할 수도 있다. 멀티미디어 모듈(381)은, 제어부(380) 내에 구현될 수도 있고, 제어부(380)와 별도로 구현될 수도 있다. 제어부(380)는, 터치-스크린 상에서 행해지는 필기 입력 또는 그림 그리기 입력을 각각 문자 및 이미지로 인식할 수 있는 패턴 인식(pattern recognition) 처리를 행할 수 있다.The

전원 공급부(390)는, 제어부(380)의 제어에 의해 외부의 전원, 내부의 전원을 인가 받아 각 구성요소들의 동작에 필요한 전원을 공급한다.The

여기에 설명되는 다양한 실시예는 예를 들어, 소프트웨어, 하드웨어 또는 이들의 조합된 것을 이용하여 컴퓨터 또는 이와 유사한 디바이스로 읽을 수 있는 기록매체 내에서 구현될 수 있다.The various embodiments described herein may be implemented in a recording medium readable by a computer or similar device using, for example, software, hardware, or a combination thereof.

하드웨어적인 구현에 의하면, 여기에 설명되는 실시예는 ASICs(application specific integrated circuits), DSPs(digital signal processors), DSPDs(digital signal processing devices), PLDs(programmable logic devices), FPGAs(field programmable gate arrays, 프로세서, 제어기, 마이크로 컨트롤러(micro-controllers), 마이크로 프로세서(microprocessors), 기타 기능 수행을 위한 전기적인 유닛(unit) 중 적어도 하나를 이용하여 구현될 수 있다. 일부의 경우에 본 명세서에서 설명되는 실시 예들이 제어부(380) 자체로 구현될 수 있다.According to a hardware implementation, the embodiments described herein may be implemented as application specific integrated circuits (ASICs), digital signal processors (DSPs), digital signal processing devices (DSPDs), programmable logic devices (PLDs), field programmable gate arrays May be implemented using at least one of a processor, a controller, micro-controllers, microprocessors, and an electrical unit for performing other functions. In some cases, the implementation described herein Examples may be implemented by the

소프트웨어적인 구현에 의하면, 본 명세서에서 설명되는 절차 및 기능과 같은 실시 예들은 별도의 소프트웨어 모듈들로 구현될 수 있다. 소프트웨어 모듈들 각각은 본 명세서에서 설명되는 하나 이상의 기능 및 작동을 수행할 수 있다. 적절한 프로그램 언어로 쓰여진 소프트웨어 애플리케이션으로 소프트웨어 코드(software code)가 구현될 수 있다. 여기서, 소프트웨어 코드는, 메모리(360)에 저장되고, 제어부(380)에 의해 실행될 수 있다.According to a software implementation, embodiments such as the procedures and functions described herein may be implemented with separate software modules. Each of the software modules may perform one or more of the functions and operations described herein. Software code may be implemented in a software application written in a suitable programming language. Here, the software code is stored in the

도 4는 본 발명의 또 다른 실시 예에 따른 디스플레이 디바이스를 설명하기 위해 도시한 구성 블록도이다.4 is a block diagram illustrating a display device according to another embodiment of the present invention.

디스플레이 디바이스(400)의 다른 예는, 방송 수신부(405), 외부 디바이스 인터페이스부(435), 저장부(440), 사용자입력 인터페이스부(450), 제어부(470), 디스플레이부(480), 오디오 출력부(485), 전원 공급부(490) 및 촬영부(미도시)를 포함할 수 있다. 여기서, 상기 방송 수신부(405)는, 적어도 하나의 튜너(410), 복조부(420) 및 네트워크 인터페이스부(430)를 포함할 수 있다. 다만, 경우에 따라, 상기 방송 수신부(405)는 튜너(410)와 복조부(420)는 구비하나 네트워크 인터페이스부(430)는 포함하지 않을 수 있으며 그 반대의 경우일 수도 있다. 또한, 상기 방송 수신부(405)는 도시되진 않았으나, 다중화부(multiplexer)를 구비하여 상기 튜너(410)를 거쳐 복조부(420)에서 복조된 신호와 상기 네트워크 인터페이스부(430)를 거쳐 수신된 신호를 다중화할 수도 있다. 그 밖에 상기 방송 수신부(425)는 역시 도시되진 않았으나, 역다중화부(demultiplexer)를 구비하여 상기 다중화된 신호를 역다중화하거나 상기 복조된 신호 또는 상기 네트워크 인터페이스부(430)를 거친 신호를 역다중화할 수 있다.Another example of the

튜너(410)는, 안테나를 통해 수신되는 RF(Radio Frequency) 방송 신호 중 사용자에 의해 선택된 채널 또는 기 저장된 모든 채널을 튜닝하여 RF 방송 신호를 수신한다. 또한, 튜너(410)는, 수신된 RF 방송 신호를 중간 주파수(Intermediate Frequency; IF) 신호 혹은 베이스밴드(baseband) 신호로 변환한다.The

예를 들어, 수신된 RF 방송 신호가 디지털 방송 신호이면 디지털 IF 신호(DIF)로 변환하고, 아날로그 방송 신호이면 아날로그 베이스밴드 영상 또는 음성 신호(CVBS/SIF)로 변환한다. 즉, 튜너(410)는 디지털 방송 신호 또는 아날로그 방송 신호를 모두 처리할 수 있다. 튜너(410)에서 출력되는 아날로그 베이스 밴드 영상 또는 음성 신호(CVBS/SIF)는 제어부(470)로 직접 입력될 수 있다.For example, if the received RF broadcast signal is a digital broadcast signal, the signal is converted into a digital IF signal (DIF). If the received RF broadcast signal is an analog broadcast signal, the signal is converted into an analog baseband image or a voice signal (CVBS / SIF). That is, the

또한, 튜너(410)는, 싱글 캐리어(single carrier) 또는 멀티플 캐리어(multiple carrier)의 RF 방송 신호를 수신할 수 있다. 한편, 튜너(410)는, 안테나를 통해 수신되는 RF 방송 신호 중 채널 기억 기능을 통하여 저장된 모든 방송 채널의 RF 방송 신호를 순차로 튜닝 및 수신하여 이를 중간 주파수 신호 혹은 베이스 밴드 신호(DIF: Digital Intermediate Frequency or baseband signal)로 변환할 수 있다.In addition, the

복조부(420)는, 튜너(410)에서 변환된 디지털 IF 신호(DIF)를 수신하여 복조하고, 채널 복호화 등을 수행할 수도 있다. 이를 위해 복조부(420)는 트렐리스 디코더(Trellis Decoder), 디인터리버(De-interleaver), 리드 솔로먼 디코더(Reed-Solomon Decoder) 등을 구비하거나 컨벌루션 디코더(convolution decoder), 디인터리버 및 리드-솔로먼 디코더 등을 구비할 수 있다.The

복조부(420)는, 복조 및 채널 복호화를 수행한 후 스트림 신호(TS)를 출력할 수 있다. 이때, 스트림 신호는 영상 신호, 음성 신호 또는 데이터 신호가 다중화된 신호일 수 있다. 일 예로, 스트림 신호는 MPEG-2 규격의 영상 신호, 돌비(Dolby) AC-3 규격의 음성 신호 등이 다중화된 MPEG-2 TS(Transport Stream)일 수 있다.The

복조부(420)에서 출력한 스트림 신호는 제어부(470)로 입력될 수 있다. 제어부(470)는 역다중화, 영상/음성 신호 처리 등을 제어하고, 디스플레이부(480)를 통해 영상을, 오디오 출력부(485)를 통해 음성의 출력을 제어할 수 있다.The stream signal output from the

외부 디바이스 인터페이스부(435)는 디스플레이 디바이스(300)와 다양한 외부 디바이스 사이의 인터페이싱 환경을 제공한다. 이를 위해, 외부 디바이스 인터페이스부(335)는, A/V 입/출력부(미도시) 또는 무선 통신부(미도시)를 포함할 수 있다.The external

외부 디바이스 인터페이스부(435)는, DVD(Digital Versatile Disk), 블루-레이(Blu-ray), 게임 디바이스, 카메라, 캠코더(Camcorder), 컴퓨터(노트북), 태블릿 PC, 스마트 폰, 블루투스 디바이스(Bluetooth device), 클라우드(Cloud) 등과 같은 외부 디바이스 등과 유/무선으로 접속될 수 있다. 외부 디바이스 인터페이스부(435)는 연결된 외부 디바이스를 통하여 입력되는 이미지, 영상, 음성 등 데이터를 포함한 신호를 디스플레이 디바이스의 제어부(470)로 전달한다. 제어부(470)는 처리된 이미지, 영상, 음성 등을 데이터 신호를 연결된 외부 디바이스로 출력되도록 제어할 수 있다. 이를 위해, 외부 디바이스 인터페이스부(435)는, A/V 입/출력부(미도시) 또는 무선 통신부(미도시)를 더 포함할 수 있다.The external

A/V 입/출력부는, 외부 디바이스의 영상 및 음성 신호를 디스플레이 디바이스(400)로 입력할 수 있도록, USB 단자, CVBS(Composite Video Banking Sync) 단자, 컴포넌트 단자, S-비디오 단자(아날로그), DVI(Digital Visual Interface) 단자, HDMI(High Definition Multimedia Interface) 단자, RGB 단자, D-SUB 단자 등을 포함할 수 있다.The A / V input / output unit includes a USB terminal, a CVBS (Composite Video Banking Sync) terminal, a component terminal, an S-video terminal (analog) terminal, A DVI (Digital Visual Interface) terminal, an HDMI (High Definition Multimedia Interface) terminal, an RGB terminal, a D-SUB terminal, and the like.

무선 통신부는, 다른 디스플레이 디바이스와 근거리 무선 통신을 수행할 수 있다. 디스플레이 디바이스(400)는 예를 들어, 블루투스(Bluetooth), RFID(Radio Frequency Identification), 적외선 통신(IrDA, infrared Data Association), UWB(Ultra Wideband), 지그비(ZigBee), DLNA(Digital Living Network Alliance) 등의 통신 프로토콜에 따라 다른 디스플레이 디바이스와 네트워크 연결될 수 있다.The wireless communication unit can perform short-range wireless communication with another display device. The

또한, 외부 디바이스 인터페이스부(435)는, 셋톱-박스(STB)와 상술한 각종 단자 중 적어도 하나를 통해 접속되어, 셋톱-박스(STB)와 입력/출력 동작을 수행할 수도 있다.Also, the external

한편, 외부 디바이스 인터페이스부(435)는, 인접하는 외부 디바이스 내의 애플리케이션 또는 애플리케이션 목록(application list)을 수신하여, 제어부(470) 또는 저장부(440)로 전달할 수 있다.Meanwhile, the external

네트워크 인터페이스부(430)는, 디스플레이 디바이스(400)를 인터넷 망을 포함하는 유/무선 네트워크와 연결하기 위한 인터페이스를 제공한다. 네트워크 인터페이스부(430)는, 유선 네트워크와의 접속을 위해 예를 들어, 이더넷(Ethernet) 단자 등을 구비할 수 있으며, 무선 네트워크와의 접속을 위해 예를 들어, WLAN(Wireless LAN)(Wi-Fi), Wibro(Wireless broadband), Wimax(World Interoperability for Microwave Access), HSDPA(High Speed Downlink Packet Access) 통신 규격 등을 이용할 수 있다.The

네트워크 인터페이스부(430)는, 접속된 네트워크 또는 접속된 네트워크에 링크된 다른 네트워크를 통해, 다른 사용자 또는 다른 디스플레이 디바이스와 데이터를 송신 또는 수신할 수 있다. 특히, 디스플레이 디바이스(400)에 미리 등록된 다른 사용자 또는 다른 디스플레이 디바이스 중 선택된 사용자 또는 선택된 디스플레이 디바이스에, 상기 디스플레이 디바이스(400)에 저장된 일부의 컨텐트 데이터를 송신할 수 있다.The

한편, 네트워크 인터페이스부(430)는, 접속된 네트워크 또는 접속된 네트워크에 링크된 다른 네트워크를 통해, 소정 웹 페이지에 접속할 수 있다. 즉, 네트워크를 통해 소정 웹 페이지에 접속하여, 해당 서버와 데이터를 송신 또는 수신할 수 있다. 그 외, 컨텐트 제공자 또는 네트워크 운영자가 제공하는 컨텐트 또는 데이터들을 수신할 수 있다. 즉, 네트워크를 통하여 컨텐트 제공자 또는 네트워크 제공자로부터 제공되는 영화, 광고, 게임, VOD, 방송 신호 등의 컨텐트 및 그와 관련된 정보를 수신할 수 있다. 또한, 네트워크 운영자가 제공하는 펌웨어(firmware)의 업데이트 정보 및 업데이트 파일을 수신할 수 있다. 또한, 인터넷 또는 컨텐트 제공자 또는 네트워크 운영자에게 데이터들을 송신할 수 있다.Meanwhile, the

또한, 네트워크 인터페이스부(430)는, 네트워크를 통해 공개(open)된 애플리케이션들 중 원하는 애플리케이션을 선택하여 수신할 수 있다.In addition, the

저장부(440)는, 제어부(470) 내의 각 신호 처리 및 제어를 위한 프로그램을 저장할 수도 있고, 신호 처리된 영상, 음성 또는 데이터 신호를 저장할 수도 있다.The

또한, 저장부(440)는 외부 디바이스 인터페이스부(435) 또는 네트워크 인터페이스부(430)로부터 입력되는 영상, 음성, 또는 데이터 신호의 임시 저장을 위한 기능을 수행할 수도 있다. 저장부(440)는, 채널 기억 기능을 통하여 소정 방송 채널에 관한 정보를 저장할 수 있다.The

저장부(440)는, 외부 디바이스 인터페이스부(435) 또는 네트워크 인터페이스부(330)로부터 입력되는 애플리케이션 또는 애플리케이션 목록을 저장할 수 있다.The

또한, 저장부(440)는, 후술하여 설명하는 다양한 플랫폼(platform)을 저장할 수도 있다.In addition, the

저장부(440)는, 예를 들어 플래시 메모리 타입(flash memory type), 하드디스크 타입(hard disk type), 멀티미디어 카드 마이크로 타입(multimedia card micro type), 카드 타입의 메모리(예를 들어 SD 또는 XD 메모리 등), 램(RAM), 롬(EEPROM 등) 중 적어도 하나의 타입의 저장매체를 포함할 수 있다. 디스플레이 디바이스(400)는, 저장부(440) 내에 저장되어 있는 컨텐트 파일(동영상 파일, 정지영상 파일, 음악 파일, 문서 파일, 애플리케이션 파일 등)을 재생하여 사용자에게 제공할 수 있다.The

도 4는 저장부(440)가 제어부(470)와 별도로 구비된 실시 예를 도시하고 있으나, 본 발명은 이에 한정되지 않는다. 다시 말해, 저장부(440)는 제어부(470) 내에 포함될 수도 있다.4 illustrates an embodiment in which the

사용자 입력 인터페이스부(450)는, 사용자가 입력한 신호를 제어부(470)로 전달하거나 제어부(470)의 신호를 사용자에게 전달한다.The user

예를 들어, 사용자 입력 인터페이스부(450)는, RF 통신 방식, 적외선(IR) 통신 방식 등 다양한 통신 방식에 따라, 원격제어디바이스(500)로부터 전원 온/오프, 채널 선택, 화면 설정 등의 제어 신호를 수신하여 처리하거나, 제어부(470)의 제어 신호를 원격제어디바이스(500)로 송신하도록 처리할 수 있다.For example, the user

또한, 사용자 입력 인터페이스부(450)는, 전원 키, 채널 키, 볼륨 키, 설정치 등의 로컬 키(미도시)에서 입력되는 제어 신호를 제어부(470)에 전달할 수 있다.In addition, the user

사용자 입력 인터페이스부(450)는, 사용자의 제스처(gesture)를 센싱(sensing)하는 센싱부(미도시)로부터 입력되는 제어 신호를 제어부(470)에 전달하거나, 제어부(470)의 신호를 센싱부(미도시)로 송신할 수 있다. 여기서, 센싱부(미도시)는, 터치 센서, 음성 센서, 위치 센서, 동작 센서 등을 포함할 수 있다.The user

제어부(470)는, 튜너(410), 복조부(420) 또는 외부 디바이스 인터페이스부(435)를 통하여 입력되는 스트림을 역다중화하거나 역다중화된 신호들을 처리하여, 영상 또는 음성 출력을 위한 신호를 생성 및 출력할 수 있다.The

제어부(470)에서 처리된 영상 신호는, 디스플레이부(480)로 입력되어 해당 영상 신호에 대응하는 영상으로 표시될 수 있다. 또한, 제어부(470)에서 영상 처리된 영상 신호는 외부 디바이스 인터페이스부(435)를 통하여 외부 출력디바이스로 입력될 수 있다.The video signal processed by the

제어부(470)에서 처리된 음성 신호는 오디오 출력부(485)로 오디오 출력될 수 있다. 또한, 제어부(470)에서 처리된 음성 신호는 외부 디바이스 인터페이스부(435)를 통하여 외부 출력 디바이스로 입력될 수 있다.The audio signal processed by the

도 4에서는 도시되어 있지 않으나, 제어부(470)는 역다중화부, 영상 처리부 등을 포함할 수 있다.Although not shown in FIG. 4, the

제어부(470)는, 디스플레이 디바이스(400)의 전반적인 동작을 제어할 수 있다. 예를 들어, 제어부(470)는, 튜너(410)를 제어하여, 사용자가 선택한 채널 또는 기 저장된 채널에 해당하는 RF 방송을 튜닝(tuning)하도록 제어할 수 있다.The

제어부(470)는, 사용자 입력 인터페이스부(450)를 통하여 입력된 사용자 명령 또는 내부 프로그램에 의하여 디스플레이 디바이스(400)를 제어할 수 있다. 특히, 네트워크에 접속하여 사용자가 원하는 애플리케이션 또는 애플리케이션 목록을 디스플레이 디바이스(400) 내로 다운로드 받을 수 있도록 할 수 있다.The

예를 들어, 제어부(470)는, 사용자 입력 인터페이스부(450)를 통하여 수신한 소정 채널 선택 명령에 따라 선택한 채널의 신호가 입력되도록 튜너(410)를 제어한다. 그리고 선택한 채널의 영상, 음성 또는 데이터 신호를 처리한다. 제어부(470)는, 사용자가 선택한 채널 정보 등이 처리한 영상 또는 음성신호와 함께 디스플레이부(480) 또는 오디오 출력부(485)를 통하여 출력될 수 있도록 한다.For example, the

다른 예로, 제어부(470)는, 사용자 입력 인터페이스부(450)를 통하여 수신한 외부 디바이스 영상 재생 명령에 따라, 외부디바이스 인터페이스부(435)를 통하여 입력되는 외부 디바이스, 예를 들어, 카메라 또는 캠코더로부터의, 영상 신호 또는 음성 신호가 디스플레이부(480) 또는 오디오 출력부(485)를 통해 출력될 수 있도록 한다.The

한편, 제어부(470)는, 영상을 표시하도록 디스플레이부(480)를 제어할 수 있다. 예를 들어, 튜너(410)를 통해 입력되는 방송 영상, 또는 외부 디바이스 인터페이스부(435)를 통해 입력되는 외부 입력 영상, 또는 네트워크 인터페이스부를 통해 입력되는 영상, 또는 저장부(440)에 저장된 영상을, 디스플레이부(480)에 표시하도록 제어할 수 있다. 이때, 디스플레이부(480)에 표시되는 영상은, 정지영상 또는 동영상일 수 있으며, 2D 영상 또는 3D 영상일 수 있다.On the other hand, the

또한, 제어부(470)는, 컨텐트를 재생하도록 제어할 수 있다. 이때의 컨텐트는, 디스플레이 디바이스(400) 내에 저장된 컨텐트, 또는 수신된 방송 컨텐트, 외부로부터 입력되는 외부 입력 컨텐트일 수 있다. 컨텐트는, 방송 영상, 외부 입력 영상, 오디오 파일, 정지 영상, 접속된 웹 화면, 및 문서 파일 중 적어도 하나일 수 있다.In addition, the

한편, 제어부(470)는, 애플리케이션 보기 항목에 진입하는 경우, 디스플레이 디바이스(300) 내 또는 외부 네트워크로부터 다운로드 가능한 애플리케이션 또는 애플리케이션 목록을 표시하도록 제어할 수 있다.On the other hand, when entering the application viewing item, the

제어부(470)는, 다양한 사용자 인터페이스와 더불어, 외부 네트워크로부터 다운로드 되는 애플리케이션을 설치 및 구동하도록 제어할 수 있다. 또한, 사용자의 선택에 의해, 실행되는 애플리케이션에 관련된 영상이 디스플레이부(480)에 표시 되도록 제어할 수 있다.The

한편, 도면에 도시하지 않았지만, 채널 신호 또는 외부 입력 신호에 대응하는 썸네일 이미지를 생성하는 채널 브라우징 처리부가 더 구비되는 것도 가능하다.Although not shown in the drawing, a channel browsing processing unit for generating a channel signal or a thumbnail image corresponding to an external input signal may be further provided.

채널 브라우징 처리부는, 복조부(320)에서 출력한 스트림 신호(TS) 또는 외부 디바이스 인터페이스부(335)에서 출력한 스트림 신호 등을 입력받아, 입력되는 스트림 신호로부터 영상을 추출하여 썸네일 영상을 생성할 수 있다. 생성된 썸네일 영상은 그대로 또는 부호화되어 제어부(470)로 입력될 수 있다. 또한, 생성된 썸네일 영상은 스트림 형태로 부호화되어 제어부(470)로 입력되는 것도 가능하다. 제어부(470)는 입력된 썸네일 영상을 이용하여 복수의 썸네일 영상을 구비하는 썸네일 리스트를 디스플레이부(480)에 표시할 수 있다. 한편, 이러한 썸네일 리스트 내의 썸네일 영상들은 차례로 또는 동시에 업데이트 될 수 있다. 이에 따라 사용자는 복수의 방송 채널의 내용을 간편하게 파악할 수 있게 된다.The channel browsing processing unit receives a stream signal TS output from the

디스플레이부(480)는, 제어부(470)에서 처리된 영상 신호, 데이터 신호, OSD 신호 또는 외부 디바이스 인터페이스부(435)에서 수신되는 영상 신호, 데이터 신호 등을 각각 R, G, B 신호로 변환하여 구동 신호를 생성한다.The

디스플레이부(480)는 PDP, LCD, OLED, 플렉시블 디스플레이(flexible display), 3차원 디스플레이(3D display) 등이 가능할 수 있다.The

한편, 디스플레이부(480)는, 터치 스크린으로 구성되어 출력 디바이스 이외에 입력 디바이스로 사용되는 것도 가능하다.Meanwhile, the

오디오 출력부(485)는, 제어부(470)에서 음성 처리된 신호, 예를 들어, 스테레오 신호, 3.1 채널 신호 또는 5.1 채널 신호를 입력 받아 음성으로 출력한다. 음성 출력부(485)는 다양한 형태의 스피커로 구현될 수 있다.The

한편, 사용자의 제스처를 감지하기 위해, 상술한 바와 같이, 터치 센서, 음성 센서, 위치 센서, 동작 센서 중 적어도 하나를 구비하는 센싱부(미도시)가 디스플레이 디바이스(400)에 더 구비될 수 있다. 센싱부(미도시)에서 감지된 신호는 사용자입력 인터페이스부(450)를 통해 제어부(3470)로 전달될 수 있다.Meanwhile, in order to detect the user's gesture, a sensing unit (not shown) having at least one of a touch sensor, an audio sensor, a position sensor, and an operation sensor may be further included in the

한편, 사용자를 촬영하는 촬영부(미도시)가 더 구비될 수 있다. 촬영부(미도시)에서 촬영된 영상 정보는 제어부(470)에 입력될 수 있다.On the other hand, a photographing unit (not shown) for photographing a user may be further provided. The image information photographed by the photographing unit (not shown) may be input to the

제어부(470)는, 촬영부(미도시)로부터 촬영된 영상, 또는 센싱부(미도시)로부터의 감지된 신호를 각각 또는 조합하여 사용자의 제스처를 감지할 수도 있다.The

전원 공급부(490)는, 디스플레이 디바이스(400) 전반에 걸쳐 해당 전원을 공급한다.The

특히, 시스템 온 칩(System on Chip; SoC)의 형태로 구현될 수 있는 제어부(470)와, 영상 표시를 위한 디스플레이부(480), 및 오디오 출력을 위한 오디오 출력부(485)에 전원을 공급할 수 있다.Particularly, it is possible to supply power to a

이를 위해, 전원 공급부(490)는, 교류 전원을 직류 전원으로 변환하는 컨버터(미도시)를 구비할 수 있다. 한편, 예를 들어, 디스플레이부(480)가 다수의 백라이트 램프(backlight lamp)를 구비하는 액정 패널로서 구현되는 경우, 휘도 가변 또는 디밍(dimming) 구동을 위해, PWM(Pulse Width Modulation) 동작 가능한 인버터(inverter)(미도시)를 더 구비할 수도 있다.To this end, the

원격제어디바이스(500)는, 사용자 입력을 사용자입력 인터페이스부(450)로 송신한다. 이를 위해, 원격제어디바이스(500)는, 블루투스(Bluetooth), RF(Radio Frequency) 통신, 적외선(IR) 통신, UWB(Ultra Wideband), 지그비(ZigBee) 방식 등을 사용할 수 있다.The

또한, 원격제어디바이스(500)는, 사용자입력 인터페이스부(450)에서 출력한 영상, 음성 또는 데이터 신호 등을 수신하여, 이를 원격제어디바이스(500)에서 표시하거나 음성 또는 진동을 출력할 수 있다.Also, the

상술한 디스플레이 디바이스(400)는, 고정형 또는 이동형의 ATSC 방식 또는 DVB 방식의 디지털 방송 신호의 처리가 가능한 디지털 방송 수신기일 수 있다.The

그 밖에 본 발명에 따른 디스플레이 디바이스는 도시된 구성 중 필요에 따라 일부 구성을 생략하거나 반대로 도시되진 않은 구성을 더 포함할 수도 있다. 한편, 디스플레이 디바이스는 상술한 바와 달리, 튜너와 복조부를 구비하지 않고, 네트워크 인터페이스부 또는 외부디바이스 인터페이스부를 통해서 컨텐트를 수신하여 재생할 수도 있다.In addition, the display device according to the present invention may further include a configuration that omits some of the configuration shown in FIG. On the other hand, the display device may not receive the tuner and the demodulator, and may receive and reproduce the content through the network interface unit or the external device interface unit.

도 5는 본 발명의 일 실시 예에 따라 도 2 내지 4의 제어부의 상세 구성을 설명하기 위해 도시한 구성 블록도이다.FIG. 5 is a block diagram illustrating a detailed configuration of the control unit of FIGS. 2 to 4 according to an embodiment of the present invention. Referring to FIG.

제어부의 일 예는, 역다중화부(510), 영상 처리부(5520), OSD 생성부(540), 믹서(mixer)(550), 프레임 레이트 변환부(FRC: Frame Rate Converter)(555), 및 포맷터(formatter)(560)를 포함할 수 있다. 그 외 상기 제어부는 도시되진 않았으나 음성 처리부와 데이터 처리부를 더 포함할 수 있다.An example of the control unit includes a

역다중화부(510)는, 입력되는 스트림을 역다중화한다. 예를 들어, 역다중화부(510)는 입력되는 MPEG-2 TS 영상, 음성 및 데이터 신호로 역다중화할 수 있다. 여기서, 역다중화부(510)에 입력되는 스트림 신호는, 튜너 또는 복조부 또는 외부디바이스 인터페이스부에서 출력되는 스트림 신호일 수 있다.The

영상 처리부(420)는, 역다중화된 영상 신호의 영상 처리를 수행한다. 이를 위해, 영상 처리부(420)는, 영상 디코더(425) 및 스케일러(435)를 구비할 수 있다.The

영상 디코더(425)는 역다중화된 영상 신호를 복호하며, 스케일러(435)는 복호된 영상 신호의 해상도를 디스플레이부에서 출력 가능하도록 스케일링(scaling)한다.The video decoder 425 decodes the demultiplexed video signal, and the

영상 디코더(525)는 다양한 규격을 지원할 수 있다. 예를 들어, 영상 디코더(525)는 영상 신호가 MPEG-2 규격으로 부호화된 경우에는 MPEG-2 디코더의 기능을 수행하고, 영상 신호가 DMB(Digital Multimedia Broadcasting) 방식 또는 H.264 규격으로 부호화된 경우에는 H.264 디코더의 기능을 수행할 수 있다.The

한편, 영상 처리부(520)에서 복호된 영상 신호는, 믹서(450)로 입력된다.On the other hand, the video signal decoded by the

OSD 생성부(540)는, 사용자 입력에 따라 또는 자체적으로 OSD 데이터를 생성한다. 예를 들어, OSD 생성부(440)는 사용자입력 인터페이스부의 제어 신호에 기초하여 디스플레이부(380)의 화면에 각종 데이터를 그래픽(Graphic)이나 텍스트(Text) 형태로 표시하기 위한 데이터를 생성한다. 생성되는 OSD 데이터는, 디스플레이 디바이스의 사용자 인터페이스 화면, 다양한 메뉴 화면, 위젯(widget), 아이콘(icon), 시청률 정보(viewing rate information) 등의 다양한 데이터를 포함한다. OSD 생성부(540)는, 방송 영상의 자막 또는 EPG에 기반한 방송 정보를 표시하기 위한 데이터를 생성할 수도 있다.The

믹서(550)는, OSD 생성부(540)에서 생성된 OSD 데이터와 영상 처리부에서 영상 처리된 영상 신호를 믹싱(mixing)하여 포맷터(560)로 제공한다. 복호된 영상 신호와 OSD 데이터가 믹싱됨으로 인하여, 방송 영상 또는 외부 입력 영상 상에 OSD가 오버레이(overlay) 되어 표시된다.The

프레임 레이트 변환부(FRC)(555)는, 입력되는 영상의 프레임 레이트(frame rate)를 변환한다. 예를 들어, 프레임 레이트 변환부(555)는 입력되는 60Hz 영상의 프레임 레이트를 디스플레이부의 출력 주파수에 따라 예를 들어, 120Hz 또는 240Hz의 프레임 레이트를 가지도록 변환할 수 있다. 상기와 같이, 프레임 레이트를 변환하는 방법에는 다양한 방법이 존재할 수 있다. 일 예로, 프레임 레이트 변환부(555)는 프레임 레이트를 60Hz에서 120Hz로 변환하는 경우, 제1 프레임과 제2 프레임 사이에 동일한 제1 프레임을 삽입하거나, 제1 프레임과 제2 프레임으로부터 예측된 제3 프레임을 삽입함으로써 변환할 수 있다. 다른 예로, 프레임 레이트 변환부(555)는 프레임 레이트를 60Hz에서 240Hz로 변환하는 경우, 기존 프레임 사이에 동일한 프레임 또는 예측된 프레임을 3개 더 삽입하여 변환할 수 있다. 한편, 별도의 프레임 변환을 수행하지 않는 경우에는 프레임 레이트 변환부(555)를 바이패스(bypass) 할 수도 있다.A frame rate conversion unit (FRC) 555 converts a frame rate of an input image. For example, the frame

포맷터(560)는, 입력되는 프레임 레이트 변환부(555)의 출력을 디스플레이부의 출력 포맷에 맞게 변경한다. 예를 들어, 포맷터(560)는 R, G, B 데이터 신호를 출력할 수 있으며, 이러한 R, G, B 데이터 신호는, 낮은 전압 차분 신호(LVDS: Low voltage differential signal) 또는 mini-LVDS로 출력될 수 있다. 또한, 포맷터(560)는 입력되는 프레임 레이트 변환부(555)의 출력이 3D 영상 신호인 경우에는 디스플레이부의 출력 포맷에 맞게 3D 형태로 구성하여 출력함으로써, 상기 디스플레이부를 통해 3D 서비스를 지원할 수도 있다.The

한편, 제어부 내 음성 처리부(미도시)는, 역다중화된 음성 신호의 음성 처리를 수행할 수 있다. 이러한 음성 처리부(미도시)는 다양한 오디오 포맷을 처리하도록 지원할 수 있다. 일 예로, 음성 신호가 MPEG-2, MPEG-4, AAC, HE-AAC, AC-3, BSAC 등의 포맷으로 부호화된 경우에도 이에 대응되는 디코더를 구비하여 처리할 수 있다.On the other hand, the voice processing unit (not shown) in the control unit can perform the voice processing of the demultiplexed voice signal. Such a voice processing unit (not shown) may support processing various audio formats. For example, even when a voice signal is coded in a format such as MPEG-2, MPEG-4, AAC, HE-AAC, AC-3, or BSAC, a corresponding decoder can be provided.

또한, 제어부 내 음성 처리부(미도시)는, 베이스(Base), 트레블(Treble), 음량 조절 등을 처리할 수 있다.In addition, the voice processing unit (not shown) in the control unit can process the base, the treble, the volume control, and the like.

제어부 내 데이터 처리부(미도시)는, 역다중화된 데이터 신호의 데이터 처리를 수행할 수 있다. 예를 들어, 데이터 처리부는 역다중화된 데이터 신호가 부호화된 경우에도 이를 복호할 수 있다. 여기서, 부호화된 데이터 신호로는, 각 채널에서 방영되는 방송 프로그램의 시작시각, 종료시각 등의 방송 정보가 포함된 EPG 정보일 수 있다.A data processing unit (not shown) in the control unit can perform data processing of the demultiplexed data signal. For example, the data processing unit can decode the demultiplexed data signal even when it is coded. Here, the encoded data signal may be EPG information including broadcast information such as a start time and an end time of a broadcast program broadcasted on each channel.

한편, 상술한 디스플레이 디바이스는 본 발명에 따른 예시로서, 각 구성요소는 실제 구현되는 디스플레이 디바이스의 사양에 따라 통합, 추가, 또는 생략될 수 있다. 즉, 필요에 따라, 2 이상의 구성요소가 하나의 구성요소로 합쳐지거나 하나의 구성요소가 2 이상의 구성요소로 세분화될 수 있다. 또한, 각 블록에서 수행하는 기능은 본 발명의 실시 예를 설명하기 위한 것이며, 그 구체적인 동작이나 디바이스는 본 발명의 권리범위를 제한하지 아니한다.On the other hand, the above-described display device is an example according to the present invention, and each component can be integrated, added, or omitted according to specifications of a display device actually implemented. That is, if necessary, two or more components may be combined into one component, or one component may be divided into two or more components. In addition, the functions performed in each block are intended to illustrate the embodiments of the present invention, and the specific operations and devices thereof do not limit the scope of rights of the present invention.

한편, 디스플레이 디바이스는, 디바이스 내에 저장된 영상 또는 입력되는 영상의 신호 처리를 수행하는 영상신호 처리디바이스일 수 있다. 영상신호 처리디바이스의 다른 예로는, 도 4에서 도시된 디스플레이부(480)와 오디오 출력부(485)가 제외된 셋톱-박스(STB), 상술한 DVD 플레이어, 블루-레이 플레이어, 게임 디바이스, 컴퓨터 등이 더 예시될 수 있다.Meanwhile, the display device may be a video signal processing device that performs signal processing of an image stored in the device or an input image. Other examples of the video signal processing device include a set-top box (STB), a DVD player, a Blu-ray player, a game device, a computer Etc. can be further exemplified.

도 6은 본 발명의 일 실시 예에 따른 도 2 내지 4의 디스플레이 디바이스와 연결된 입력 수단을 도시한 도면이다.Figure 6 is a diagram illustrating input means coupled to the display device of Figures 2 through 4 in accordance with one embodiment of the present invention.

디스플레이 디바이스(600)를 제어하기 위해 상기 디스플레이 디바이스(600) 상에 구비된 프론트 패널(front panel)(미도시)이나 제어 수단(입력 수단)이 이용된다.A front panel (not shown) or a control means (input means) provided on the

한편, 제어 수단은 유, 무선 통신 가능한 사용자 인터페이스 디바이스(UID; User Interface Device)로써, 주로 디스플레이 디바이스(600)의 제어 목적으로 구현된 리모컨(610), 키보드(630), 포인팅 디바이스(620), 터치패드(touch-pad) 등이 포함되나, 상기 디스플레이 디바이스(600)에 연결된 외부 입력 전용의 제어 수단 역시 포함될 수 있다. 그 밖에, 디스플레이 디바이스(600) 제어 목적이 아니나 모드 전환 등을 통해 상기 디스플레이 디바이스(600)를 제어하는 스마트 폰, 태블릿 PC 등 모바일 디바이스 등도 제어 수단에 포함된다. 다만, 본 명세서에서는 편의상 포인팅 디바이스(pointing device)를 일 실시 예로 하여 설명하나, 이에 한정되는 것은 아니다.The control means includes a

입력 수단은, 블루투스(Bluetooth), RFID(Radio Frequency Identification), 적외선 통신(IrDA, infrared Data Association), UWB(Ultra Wideband), 지그비(ZigBee), DLNA(Digital Living Network Alliance), RS 등의 통신 프로토콜을 필요에 따라 적어도 하나 이상 채용하여 디스플레이 디바이스와 통신 가능하다.The input means may be a communication protocol such as Bluetooth, Radio Frequency Identification (RFID), Infrared Data Association (UDA), Ultra Wideband (UWB), ZigBee, Digital Living Network Alliance (DLNA) At least one can be employed as needed to communicate with the display device.

리모컨(610)은, 디스플레이 디바이스(600) 제어를 위해 필요한 다양한 키 버튼들이 구비된 통상의 입력 수단을 말한다.The

포인팅 디바이스(620)는, 자이로 센서(Gyro Sensor) 등을 탑재하여 사용자의 움직임, 압력, 회전 등에 기초하여 디스플레이 디바이스(600)의 화면상에 대응되는 포인터(pointer)를 구현하여 상기 디스플레이 디바이스(600)에 소정 제어 명령을 전달한다. 이러한 포인팅 디바이스(620)는, 매직 리모컨, 매직 컨트롤러 등 다양한 이름으로 명명될 수 있다.The

키보드(630)는, 디스플레이 디바이스(600)가 종래 방송만을 제공하던 것을 넘어 지능형 통합 디스플레이 디바이스로서 웹 브라우저, 애플리케이션, SNS(Social Network Service) 등 다양한 서비스를 제공함에 따라 종래 리모컨(610)만으로는 제어가 쉽지 않아 이를 보완하여 PC의 키보드와 유사하게 구현하여 텍스트 등의 입력 편의를 도모하기 위해 구현되었다.Since the

한편, 리모컨(610), 포인팅 디바이스(620), 키보드(630) 등 제어수단은, 필요에 따라 터치패드를 구비함으로써 텍스트 입력, 포인터 이동, 사진 내지 동영상의 확대/축소 등 더욱 편리하고 다양한 제어 목적에 이용할 수 있다.The control means such as the

본 명세서에서 설명하는 디스플레이 디바이스는, OS 및/또는 플랫폼(platform)으로 Web OS를 이용한다. 이하 Web OS 기반의 구성 내지 알고리즘 등 처리 과정은, 전술한 디스플레이 디바이스의 제어부 등에서 수행될 수 있다. 여기서, 상기 제어부는 전술한 도 2 내지 5에서의 제어부를 포함하여 광의의 개념으로 사용한다. 따라서, 이하에서는 디스플레이 디바이스 내 Web OS 기반의 또는 그와 관련된 서비스, 애플리케이션, 컨텐트 등의 처리를 위해 구성은 관련 소프트웨어(software), 펌웨어(firmware) 등을 포함한 하드웨어 내지 구성요소는 제어부(controller)로 명명하여 설명한다.The display device described in this specification uses the Web OS as an OS and / or platform. Hereinafter, a process such as a configuration or an algorithm based on the Web OS can be performed in the control unit of the above-described display device or the like. Here, the control unit includes the control unit in FIGS. 2 to 5 described above and uses it as a broad concept. Accordingly, in order to process a service, an application, a content, and the like related to the Web OS in the display device, the hardware and components including related software, firmware, and the like are controlled by a controller Named and explained.

이러한 Web OS 기반 플랫폼은 예컨대, 루나-서비스 버스(Luna-service Bus)에 기반하여 서비스와 애플리케이션 등을 통합함으로써, 개발 독립성과 기능 확장성을 제고하기 위한 것으로, Web 응용 프레임워크에 기반하여 응용 개발 생산성도 높일 수 있다. 또한, Web OS 프로세스와 자원 관리(resource management)를 통해 시스템 자원(system resource)을 효율적으로 활용하여 멀티-태스킹도 지원할 수 있다.Such a Web OS-based platform is intended to enhance development independence and function scalability by integrating services and applications based on, for example, a luna-service bus, Productivity can be increased. Also, multi-tasking can be supported by efficiently utilizing system resources through Web OS process and resource management.

한편, 상기 Web OS는 PC, TV, 셋톱박스(STB)와 같은 고정 디바이스뿐만 아니라 휴대폰, 스마트 폰, 태블릿 pc, 노트북 등과 같은 모바일 디바이스에서도 이용 가능하다.Meanwhile, the Web OS can be used not only as a fixed device such as a PC, a TV, and a set-top box (STB) but also as a mobile device such as a mobile phone, a smart phone, a tablet PC,

디스플레이 디바이스를 위한 소프트웨어의 구조는, 종래에는 문제 해결과 시장에 의존적인 모놀리틱 구조(monolithic structure)로 멀티쓰레딩 기술(multi-threading)에 기반한 단일 프로세스(single process)와 클로우즈드 제품(closed product)으로 외부 응용에 어려움이 있었고, 그 이후 글로벌 대응 플랫폼 기반 개발을 지향하고 칩-셋(chip-set) 교체를 통한 비용 혁신과 UI 응용 및 외부 응용 개발 효율화를 추구하여 레이어링 및 콤포넌티제이션(layering & componentization)이 이루어져 3-레이어드 구조와 애드-온(add-on), 싱글 소스(single source) 제품, 오픈 애플리케이션(open application)을 위한 애드-온 구조를 가졌었다. 최근에는 더 나아가 소프트웨어 구조가 기능 단위의 모듈화 아키텍처(modulating architecture), 에코-시스템(echo-system)을 위한 Web 오픈 API(Web Open API (Application Programming Interface)) 제공, 게임 엔진(game engine)을 위한 네이티브 오픈 API(Native Open API) 등을 위한 모듈화 디자인이 이루어지고 있으며, 이에 따라 서비스 구조 기반의 멀티-프로세스 구조(multi-process structure)로 생성되고 있다.The structure of the software for a display device has traditionally been a single process and a closed product based on multi-threading in a monolithic structure that is problem-solving and market-dependent. ), And has since been struggling with external applications. Since then, it has been pursuing global-based platform development, pursuing cost innovation through chip-set replacement and streamlining of UI application and external application development, layering and composing and componentization were done to have a three-layered structure and an add-on structure for add-ons, single source products, and open applications. More recently, the software architecture has provided a modular architecture for functional units, a Web Open API (Application Programming Interface) for the echo-system, and a game engine And a native open API (Native Open API), and thus, a multi-process structure based on a service structure is being created.

도 7은 본 발명의 일 실시 예에 따른 Web OS 아키텍처를 설명하기 위해 도시한 도면이다.FIG. 7 is a diagram illustrating a Web OS architecture according to an embodiment of the present invention. Referring to FIG.

도 7을 참조하여, Web OS 플랫폼의 아키텍처에 대해 설명하면, 다음과 같다.Referring to FIG. 7, the architecture of the Web OS platform will be described below.

상기 플랫폼은 크게 커널, 시스템 라이브러리 기반의 Web OS 코어 플랫폼, 애플리케이션, 서비스 등으로 구분할 수 있다.The platform can be largely classified into a kernel, a system library-based Web OS core platform, an application, and a service.

Web OS 플랫폼의 아키텍처는, 레이어드 구조(layered structure)로 최하위의 레이어에는 OS, 다음 레이어에는 시스템 라이브러리(들)(system libraries) 그리고 최상위에는 서비스들(services)이 존재한다.The architecture of the Web OS platform is layered structure, with OS at the lowest layer, system libraries at the next layer, and services at the top.

먼저, 최하위 레이어는, OS레이어로 리눅스 커널(Linux Kernel)이 포함되어 상기 디스플레이 디바이스의 OS로 리눅스를 포함할 수 있다.First, the lowest layer includes a Linux kernel as an OS layer, and can include Linux as an OS of the display device.

상기 OS 레이어 상위에는, BSP(Board Support Package)/HAL(Hardware Abstraction Layer) 레이어, Web OS 코어 모듈 레이어(Web OS core modules layer), 서비스 레이어(service layer), 루나-서비스 버스 레이어(Luna-Service Bus layer), 엔요 프레임워크/NDK(Native Developer’s Kit)/QT 레이어(Enyo framework/NDK/QT layer) 그리고 최상위 레이어에는 애플리케이션 레이어(Application layer)가 순차로 존재한다.The OS layer is provided with a BOS (Board Support Package) / HAL (Hardware Abstraction Layer) layer, a Web OS core modules layer, a service layer, a Luna-Service layer Bus layer, Native Developer's Kit (NDK) / QT layer (Enyo framework / NDK / QT layer), and Application layer in the uppermost layer.

한편, 상술한 Web OS 레이어 구조 중 일부 레이어는 생략될 수도 있고, 복수의 레이어가 하나의 레이어화 되거나 반대로 하나의 레이어가 복수의 레이어 구조를 가질 수도 있다.Meanwhile, some layers of the above-described Web OS layer structure may be omitted, or a plurality of layers may be one layer, or one layer may have a plurality of layer structures.

상기 Web OS 코어 모듈 레이어는, 서피스 윈도우(surface window) 등을 관리하는 LSM(Luna Surface Manager), 애플리케이션의 실행과 수행 상태 등을 관리하는 SAM(System & Application Manage), 웹키트(WebKit)에 기반하여 웹 애플리케이션 등을 관리하는 WAM(Web Application Manager) 등이 포함될 수 있다.The Web OS core module layer is based on LSM (Luna Surface Manager) for managing surface windows and the like, SAM (System & Application Management) for managing application execution and execution status, and Web kit And a WAM (Web Application Manager) for managing a web application and the like.

상기 LSM은, 화면에 보이는 애플리케이션 윈도우(application window)를 관리한다. 상기 LSM은, 디스플레이 하드웨어(Display HW)를 관장하며, 애플리케이션들에게 필요한 내용을 렌더링(rendering)할 수 있는 버퍼(buffer)를 제공하며, 복수의 애플리케이션들이 렌더링한 결과를 합성(Composition)하여 화면에 출력할 수 있다.The LSM manages an application window displayed on the screen. The LSM manages display hardware (Display HW) and provides a buffer for rendering contents necessary for applications. The LSM composes the results of rendering by a plurality of applications, Can be output.

상기 SAM은, 시스템과 애플리케이션의 여러 조건 별 수행 폴리시(policy)를 관리한다.The SAM manages various conditional execution policies of the system and the application.

한편, WAM은, web OS는 웹 애플리케이션(Web App)을 기본 애플리케이션으로 볼 수 있는바, 엔요 프레임워크(Enyo Framework)에 기반한 애플리케이션 개발을 권장한다.WAM, on the other hand, recommends application development based on the Enyo Framework because webOS can be regarded as a basic application.

애플리케이션의 서비스 사용은, 루나-서비스 버스(Luna-service Bus)를 통해 이루어지며, 신규로 서비스를 버스에 등록할 수 있고, 애플리케이션은 자신이 필요로 하는 서비스를 찾아서 사용할 수도 있다.The use of an application's service is done via a luna-service bus, a new service can be registered on the bus, and an application can find and use the service it needs.

상기 서비스 레이어는, TV 서비스, Web OS 서비스 등 다양한 서비스 레벨(service level)의 서비스들이 포함될 수 있다. 한편, 상기 Web OS 서비스에는, 미디어 서버, Node.JS 등이 포함될 수 있다. 여기서, Node.JS 서비스는 예컨대, 자바스크립트(javascript)를 지원한다.The service layer may include various service level services such as TV service and Web OS service. The Web OS service may include a media server, a Node.JS, and the like. Here, the Node.JS service supports, for example, javascript.

Web OS 서비스는, 기능 로직(function logic)을 구현한 리눅스 프로세스(Linux process)로 버스를 통해 커뮤니케이션 할 수 있다. 이는 크게 네 파트로 구분될 수 있으며, TV 프로세스와 기존 넷캐스트(NetCast)로부터 Web OS에 미티그레이션(Migration)되거나 제조사 차별화 서비스인 서비스들, Web OS 공통 서비스와 자바스크립트로 개발되고 Node.js를 통해 사용되는 Node.js 서비스로 구성된다.Web OS services can communicate over the bus to a Linux process that implements function logic. It can be divided into four parts. It is developed by TV process and existing netcast (NetCast) to be migrated to Web OS, services that are differentiated by manufacturer, Web OS common service and JavaScript, and Node.js And a Node.js service that is used over the Internet.

상기 애플리케이션 레이어는, TV 애플리케이션, 쇼케이스(showcase) 애플리케이션, 네이티브 애플리케이션(native application), Web 애플리케이션 등 디스플레이 디바이스에서 지원 가능한 모든 애플리케이션들을 포함할 수 있다.The application layer may include all applications that can be supported on a display device, such as a TV application, a showcase application, a native application, a Web application, and the like.

Web OS 상의 애플리케이션은, 구현 방법에 따라 웹 애플리케이션(Web Application), PDK(Palm Development Kit) 애플리케이션, QML(Qt Markup Language) 애플리케이션 등으로 구분될 수 있다.An application on the Web OS can be classified into a Web application, a PDK (Palm Development Kit) application, a Qt (Qt Markup Language) application, and the like depending on the implementation method.

상기 웹 애플리케이션은, 웹키트 엔진(WebKit engine) 에 기반하고, WAM 런타임(Runtime) 상에서 수행된다. 이러한 웹 애플리케이션은 엔요 프레임워크에 기반하거나, 일반 HTML5, CSS, 자바스크립트 기반으로 개발되어 수행될 수 있다.The web application is based on a WebKit engine and is executed on a WAM runtime. These web applications can be based on the ENI framework or developed on the basis of regular HTML5, CSS, and JavaScript.

상기 PDK 애플리케이션은, 써드-파티(3rd-Party) 또는 외부 개발자를 위해 제공된 PDK에 기반하여 C/C++로 개발되는 네이티브 애플리케이션 등을 포함한다. 상기 PDK는, 게임 등 써드 파티가 네이티브 애플리케이션(C/C++)을 개발할 수 있도록 제공된 개발 라이브러리 및 도구 집합을 말한다. 예를 들어, PDK 애플리케이션은, 그 성능이 중요한 애플리케이션의 개발에 이용될 수 있다.The PDK application includes a native application developed in C / C ++ based on a PDK provided for third-party or external developers. The PDK refers to a development library and a tool set provided for a third party such as a game to develop a native application (C / C ++). For example, PDK applications can be used to develop applications where performance is critical.

상기 QML 애플리케이션은, Qt 기반의 네이티브 애플리케이션으로, 카드 뷰(card view), 홈 대시보드(Home dashboard), 가상 키보드(virtual keyboard) 등 Web OS 플랫폼과 함께 제공되는 기본 애플리케이션 등을 포함한다. 여기서, QML은, C++ 대신 스크립트 형태의 마크-업 언어(mark-up language)로 애플리케이션을 개발할 수 있어 개발 생산성을 높일 수 있다.The QML application is a native application based on Qt, and includes a basic application provided with the Web OS platform such as a card view, a home dashboard, and a virtual keyboard. Here, QML can develop an application in a mark-up language as a script instead of C ++, thereby improving development productivity.