KR20090107364A - Mobile terminal and its menu control method - Google Patents

Mobile terminal and its menu control methodDownload PDFInfo

- Publication number

- KR20090107364A KR20090107364AKR1020080032841AKR20080032841AKR20090107364AKR 20090107364 AKR20090107364 AKR 20090107364AKR 1020080032841 AKR1020080032841 AKR 1020080032841AKR 20080032841 AKR20080032841 AKR 20080032841AKR 20090107364 AKR20090107364 AKR 20090107364A

- Authority

- KR

- South Korea

- Prior art keywords

- information

- menu

- voice command

- voice

- mobile terminal

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Ceased

Links

Images

Classifications

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04M—TELEPHONIC COMMUNICATION

- H04M1/00—Substation equipment, e.g. for use by subscribers

- H04M1/72—Mobile telephones; Cordless telephones, i.e. devices for establishing wireless links to base stations without route selection

- H04M1/724—User interfaces specially adapted for cordless or mobile telephones

- H04M1/72403—User interfaces specially adapted for cordless or mobile telephones with means for local support of applications that increase the functionality

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F1/00—Details not covered by groups G06F3/00 - G06F13/00 and G06F21/00

- G06F1/16—Constructional details or arrangements

- G06F1/1613—Constructional details or arrangements for portable computers

- G06F1/1633—Constructional details or arrangements of portable computers not specific to the type of enclosures covered by groups G06F1/1615 - G06F1/1626

- G06F1/1684—Constructional details or arrangements related to integrated I/O peripherals not covered by groups G06F1/1635 - G06F1/1675

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0481—Interaction techniques based on graphical user interfaces [GUI] based on specific properties of the displayed interaction object or a metaphor-based environment, e.g. interaction with desktop elements like windows or icons, or assisted by a cursor's changing behaviour or appearance

- G06F3/0482—Interaction with lists of selectable items, e.g. menus

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/14—Digital output to display device ; Cooperation and interconnection of the display device with other functional units

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/16—Sound input; Sound output

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- General Engineering & Computer Science (AREA)

- Human Computer Interaction (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Computer Hardware Design (AREA)

- Health & Medical Sciences (AREA)

- Audiology, Speech & Language Pathology (AREA)

- General Health & Medical Sciences (AREA)

- Computer Networks & Wireless Communication (AREA)

- Signal Processing (AREA)

- Telephone Function (AREA)

Abstract

Translated fromKoreanDescription

Translated fromKorean본 발명은 음성명령의 인식을 위한 정보 검색범위를 특정 메뉴나 서비스 영역에 관련된 정보들로 특정하여 음성 인식률을 향상시킬 수 있도록 한 이동 단말기 및 그 메뉴 제어방법에 관한 것이다.The present invention relates to a mobile terminal and a menu control method for improving a voice recognition rate by specifying an information search range for recognizing a voice command with information related to a specific menu or service area.

이동 단말기는 다양한 기능을 수행할 수 있도록 구성될 수 있다.The mobile terminal may be configured to perform various functions.

그러한 다양한 기능들의 예로 데이터 및 음성 통신 기능, 카메라를 통해 사진이나 동영상을 촬영하는 기능, 음성 저장 기능, 스피커 시스템을 통한 음악 파일의 재생 기능, 이미지나 비디오의 디스플레이 기능 등이 있다. 일부 이동 단말기는 게임을 실행할 수 있는 추가적 기능을 포함하고, 다른 일부 이동 단말기는 멀티미디어 기기로서 구현되기도 한다. 더욱이 최근의 이동 단말기는 방송이나 멀티캐스트(multicast) 신호를 수신하여 비디오나 텔레비전 프로그램을 시청할 수 있다.Examples of such various functions include data and voice communication functions, taking pictures or videos through a camera, storing voices, playing music files through a speaker system, and displaying images or videos. Some mobile terminals include additional functionality to play games, while others are implemented as multimedia devices. Moreover, recent mobile terminals can receive broadcast or multicast signals to watch video or television programs.

또한, 상기 이동 단말기의 기능 지지 및 증대를 위한 노력들이 계속되고 있다. 상술한 노력은 이동 단말기를 형성하는 구조적인 구성요소의 변화 및 개량뿐만 아니라 소프트웨어나 하드웨어의 개량도 포함한다. 이러한 디자인 형태로서는 폴더 형태, 슬라이드 형태, 바 형태 또는 로테이션 형태의 디자인이 이동 단말기에 적용되고 있다.In addition, efforts to support and increase the function of the mobile terminal continue. The foregoing efforts include not only changes and improvements in the structural components forming the mobile terminal, but also improvements in software or hardware. As such a design form, a folder form, a slide form, a bar form or a rotation form design is applied to the mobile terminal.

또한, 상기 이동 단말기는 특정 기능이나 서비스 실행을 위한 다양한 사용자 인터페이스가 적용되어 있다. 예를 들어, 음성인식, 터치패드, 키패드, 또는 펜 입력을 위한 기능이 적용되어 있다. 그러나, 상기 사용자 인터페이스는 각각의 특성에 따라 인식 에러율이 높거나 사용자의 만족도가 낮은 문제점이 있다.In addition, the mobile terminal is applied with various user interfaces for executing a specific function or service. For example, a function for voice recognition, a touch pad, a keypad, or a pen input is applied. However, the user interface has a problem in that a recognition error rate is high or user satisfaction is low according to each characteristic.

본 발명은 음성의 인식이 가능한 이동 단말기에서 음성으로 입력되는 명령의 문맥이나 내용에 포함된 의미를 인식하여 단말기에 구비된 특정 기능이나 서비스에 관련된 메뉴를 제어할 수 있도록 한 이동 단말기 및 그 메뉴 제어방법을 제공하기 위한 것이다.The present invention provides a mobile terminal capable of controlling a menu related to a specific function or service provided in the terminal by recognizing the meaning included in the context or content of a command inputted by the voice in a mobile terminal capable of recognizing voice. It is to provide a method.

또한, 본 발명은 단말기의 동작상태나 모드에 따라 음성명령의 인식을 위한 정보범위를 특정 메뉴나 서비스 영역에 관련된 정보영역으로 설정할 수 있도록 함으로써 음성 인식률을 향상시킬 수 있도록 한 이동 단말기 및 그 메뉴 제어방법을 제공하기 위한 것이다.In addition, the present invention is to control the mobile terminal and its menu to improve the speech recognition rate by setting the information range for the recognition of the voice command according to the operation state or mode of the terminal to the information area associated with a specific menu or service area It is to provide a method.

또한, 본 발명은 사용자의 조작을 검출하기 위하여 단말기에 구비된 다수의 사용자 인터페이스 중, 적어도 한 가지를 음성명령 인식 기능의 동작 중에도 적용하여, 특정 기능이나 서비스에 관련된 메뉴를 제어할 수 있도록 한 이동 단말기 및 그 메뉴 제어방법을 제공하기 위한 것이다.In addition, the present invention is applied to at least one of the plurality of user interfaces provided in the terminal to detect the user's operation during the operation of the voice command recognition function, the movement to control the menu related to a specific function or service It is to provide a terminal and a menu control method thereof.

또한, 본 발명은 단말기의 동작상태나 모드에 따라 음성명령의 입력에 관련된 도움말 정보를 제공함으로써, 처음 사용자라도 특정 기능이나 서비스에 관련된 메뉴를 음성명령으로 제어할 수 있도록 한 이동 단말기 및 그 메뉴 제어방법을 제공하기 위한 것이다.In addition, the present invention provides the help information associated with the input of the voice command according to the operation state or mode of the terminal, so that even a first time user can control the menu related to a specific function or service with the voice command and its menu control It is to provide a method.

상기한 과제를 실현하기 위한 본 발명의 일 예와 관련된 이동 단말기는 음성 명령을 입력받는 마이크와, 음성인식 기능의 활성화를 제어하는 신호를 입력받는 신호 입력부와, 이동 단말기에 구비된 각 메뉴나 기능에 관련된 복수의 정보를 데이터베이스로 구성하는 메모리와, 상기 데이터베이스에서 참조할 정보의 범위를 기설정된 범위로 특정하고, 그 특정된 범위의 정보를 참조하여, 상기 입력받은 음성명령의 내용과 문맥을 바탕으로 그 의미를 판단하고, 상기 판단된 의미에 대응하는 결과를 단말기의 특정 구성요소에 출력하는 제어부로 구성된다.Mobile terminal according to an embodiment of the present invention for realizing the above object is a microphone for receiving a voice command, a signal input unit for receiving a signal for controlling the activation of the voice recognition function, and each menu or function provided in the mobile terminal A memory configured to configure a plurality of pieces of information related to a database, and a range of information to be referred to in the database in a predetermined range, and based on the contents and context of the received voice command with reference to the specified range of information. The controller is configured to determine the meaning and output a result corresponding to the determined meaning to a specific component of the terminal.

또한, 상기한 과제를 실현하기 위한 본 발명은 음성인식 기능의 활성화에 따라 음성명령을 입력받아 특정 정보 형식으로 변환하고, 참조할 수 있는 정보 범위를 한정한 데이터베이스의 정보들과, 상기 형식 변환된 음성명령의 내용과 문맥을 비교하여 상기 음성명령의 의미를 판단한 후, 상기 판단된 음성명령의 의미에 대응하는 결과를 단말기의 특정 구성요소에 출력하도록 이루어진다.In addition, the present invention for realizing the above object is to receive the voice command in accordance with the activation of the voice recognition function to convert the information into a specific information format, the information of the database that limits the range of information that can be referred to, and the format conversion After comparing the contents and the context of the voice command to determine the meaning of the voice command, a result corresponding to the meaning of the determined voice command is output to a specific component of the terminal.

상기와 같이 구성되는 본 발명에 관련된 이동 단말기는 음성의 인식이 가능한 이동 단말기에서 음성으로 입력되는 명령의 문맥이나 내용에 포함된 의미를 인식하여 단말기에 구비된 특정 기능이나 서비스에 관련된 메뉴를 제어할 수 있도록 하는 효과가 있다.The mobile terminal according to the present invention configured as described above may control a menu related to a specific function or service provided in the terminal by recognizing a meaning included in a context or content of a command inputted by voice in a mobile terminal capable of recognizing voice. It has the effect of making it possible.

또한, 본 발명에 관련된 이동 단말기는 음성명령의 인식을 위한 정보범위를 단말기의 동작 상태나 모드에 따른 특정 메뉴나 서비스 영역에 관련된 영역으로 특정하여 설정할 수 있도록 함으로써 음성 인식률을 향상시키는 효과가 있다.In addition, the mobile terminal according to the present invention has an effect of improving the voice recognition rate by allowing the information range for recognizing the voice command to be set to an area related to a specific menu or service area according to the operation state or mode of the terminal.

또한, 본 발명에 관련된 이동 단말기는 사용자의 조작을 검출하기 위하여 단 말기에 구비된 다수의 사용자 인터페이스 중, 적어도 한 가지를 음성명령 인식 기능의 동작 중에도 적용하여 동시에 특정 기능이나 서비스에 관련된 메뉴를 선택하거나 실행할 수 있도록 하는 효과가 있다.In addition, the mobile terminal according to the present invention selects a menu related to a specific function or service at the same time by applying at least one of a plurality of user interfaces provided in the terminal to detect a user's operation during the operation of the voice command recognition function. To be able to run or run.

또한, 본 발명에 관련된 이동 단말기는 동작상태나 모드에 따라 음성명령의 입력에 관련된 도움말 정보를 선택적으로 제공하여, 음성명령에 대한 사용자의 숙련도에 관계없이 음성으로 특정 기능이나 서비스에 관련된 메뉴를 선택하거나 실행할 수 있도록 하는 효과가 있다.In addition, the mobile terminal according to the present invention selectively provides help information related to input of a voice command according to an operation state or mode, so that a menu related to a specific function or service is selected by voice regardless of the user's proficiency with the voice command. To be able to run or run.

이하, 발명에 따른 다양한 실시 예들을 첨부한 도면을 참조하여 상세히 설명하기로 한다. 다만, 본 발명의 요지를 흐릴 수 있다고 판단되는 공지기술 및 그 구성에 대한 구체적인 설명은 생략하기로 한다. 또한, 도면을 참조하여 본 발명을 설명함에 있어서, 동일한 기능을 수행하는 구성 요소에 대하여는 동일한 부호를 부여하여 설명하기로 한다.Hereinafter, various embodiments of the present invention will be described in detail with reference to the accompanying drawings. However, the detailed description of the well-known technology and its configuration which are determined to obscure the gist of the present invention will be omitted. In addition, in describing the present invention with reference to the drawings, components that perform the same function will be described with the same reference numerals.

이하, 본 발명과 관련된 이동 단말기에 대하여 도면을 참조하여 더욱 상세하게 설명한다.Hereinafter, a mobile terminal according to the present invention will be described in more detail with reference to the drawings.

도1은 본 발명의 일 실시예와 관련된 이동 단말기의 블록 구성도(block diagram)이다.1 is a block diagram of a mobile terminal according to an embodiment of the present invention.

이동 단말기는 다양한 형태로 구현될 수 있다. 예를 들어, 본 명세서에서 기술되는 이동 단말기는 휴대폰, 스마트 폰(smart phone), 노트북 컴퓨터(notebook computer), 디지털방송용 단말기, PDA(Personal Digital Assistants), PMP(Portable Multimedia Player), 네비게이션, 등이 있다.The mobile terminal can be implemented in various forms. For example, the mobile terminal described herein may be a mobile phone, a smart phone, a notebook computer, a digital broadcasting terminal, a personal digital assistant (PDA), a portable multimedia player (PMP), navigation, or the like. have.

도시된 이동 단말기(100)는 무선 통신부(110), A/V(Audio/Video) 입력부(120), 사용자 입력부(130), 센싱부(140), 출력부(150), 메모리(160), 인터페이스부(170), 제어부(180) 및 전원 공급부(190) 등을 포함할 수 있다. 도1은 다양한 구성요소를 가지고 있는 이동 단말기를 나타내고 있다. 그러나 도시된 구성요소 모두가 필수구성요소인 것은 아니다. 도시된 구성요소 보다 많은 구성요소에 의해 이동 단말기가 구현될 수도 있고, 그 보다 적은 구성요소에 의해서도 이동 단말기가 구현될 수 있다.The illustrated

이하 상기 구성요소들에 대해 차례로 살펴본다.Hereinafter, the components will be described in turn.

무선 통신부(110)는 이동 단말기(100)와 무선 통신 시스템 간의 무선 통신 또는 이동 단말기(100)와 이동 단말기(100)가 위치한 네트웍간의 무선 통신을 하게 하는 하나 이상의 구성요소를 포함할 수 있다. 예를 들어, 무선 통신부(110)는 방송 수신 모듈(111), 이동통신 모듈(112), 무선 인터넷 모듈(113), 근거리 통신 모듈(114) 및 위치정보 모듈(115) 등을 포함할 수 있다.The

방송 수신 모듈(111)은 방송 채널을 통하여 외부의 방송 관리 서버로부터 방송 신호 및/또는 방송 관련된 정보를 수신한다. 상기 방송 채널은 위성 채널, 지상파 채널을 포함할 수 있다. 상기 방송 관리 서버는, 방송 신호 및/또는 방송 관련 정보를 생성하여 송신하는 서버 또는 기 생성된 방송 신호 및/또는 방송 관련 정보를 제공받아 단말기에 송신하는 서버를 의미할 수 있다. 상기 방송 관련 정보는, 방송 채널, 방송 프로그램 또는 방송 서비스 제공자에 관련한 정보를 의미할 수 있 다. 상기 방송 신호는, TV 방송 신호, 라디오 방송 신호, 데이터 방송 신호를 포함할 뿐만 아니라, TV 방송 신호 또는 라디오 방송 신호에 데이터 방송 신호가 결합한 형태의 방송 신호도 포함할 수 있다.The broadcast receiving module 111 receives a broadcast signal and / or broadcast related information from an external broadcast management server through a broadcast channel. The broadcast channel may include a satellite channel and a terrestrial channel. The broadcast management server may mean a server that generates and transmits a broadcast signal and / or broadcast related information or a server that receives a previously generated broadcast signal and / or broadcast related information and transmits the same to a terminal. The broadcast associated information may mean information related to a broadcast channel, a broadcast program, or a broadcast service provider. The broadcast signal may include not only a TV broadcast signal, a radio broadcast signal, and a data broadcast signal, but also a broadcast signal having a data broadcast signal combined with a TV broadcast signal or a radio broadcast signal.

한편, 상기 방송 관련 정보는, 이동통신망을 통하여도 제공될 수 있으며, 이러한 경우에는 상기 이동통신 모듈(112)에 의해 수신될 수 있다.Meanwhile, the broadcast related information may be provided through a mobile communication network, and in this case, may be received by the mobile communication module 112.

상기 방송 관련 정보는 다양한 형태로 존재할 수 있다. 예를 들어, DMB(Digital Multimedia Broadcasting)의 EPG(Electronic Program Guide) 또는 DVB-H(Digital Video Broadcast-Handheld)의 ESG(Electronic Service Guide) 등의 형태로 존재할 수 있다.The broadcast related information may exist in various forms. For example, it may exist in the form of Electronic Program Guide (EPG) of Digital Multimedia Broadcasting (DMB) or Electronic Service Guide (ESG) of Digital Video Broadcast-Handheld (DVB-H).

상기 방송 수신 모듈(111)은, 각종 방송 시스템을 이용하여 방송 신호를 수신하는데, 특히, DMB-T(Digital Multimedia Broadcasting-Terrestrial), DMB-S(Digital Multimedia Broadcasting-Satellite), MediaFLO(Media Forward Link Only), DVB-H(Digital Video Broadcast-Handheld), ISDB-T(Integrated Services Digital Broadcast-Terrestrial) 등의 디지털 방송 시스템을 이용하여 디지털 방송 신호를 수신할 수 있다. 물론, 상기 방송 수신 모듈(111)은, 상술한 디지털 방송 시스템뿐만 아니라 방송 신호를 제공하는 모든 방송 시스템에 적합하도록 구성된다.The broadcast receiving module 111 receives broadcast signals using various broadcasting systems, and in particular, digital multimedia broadcasting-terrestrial (DMB-T), digital multimedia broadcasting-satellite (DMB-S), and media forward link (MediaFLO). Digital broadcast signals can be received using digital broadcasting systems such as only), digital video broadcast-handheld (DVB-H), integrated services digital broadcast-terrestrial (ISDB-T), and the like. Of course, the broadcast receiving module 111 is configured to be suitable for all broadcast systems providing broadcast signals as well as the digital broadcast system described above.

방송 수신 모듈(111)을 통해 수신된 방송 신호 및/또는 방송 관련 정보는 메모리(160)에 저장될 수 있다.The broadcast signal and / or broadcast related information received through the broadcast receiving module 111 may be stored in the

또한, 이동통신 모듈(112)은, 이동 통신망 상에서 기지국, 외부의 단말, 서 버 중 적어도 하나와 무선 신호를 송수신한다. 여기에서, 상기 무선 신호는, 음성 호 신호, 화상 통화 호 신호 또는 문자/멀티미디어 메시지 송수신에 따른 다양한 형태의 데이터를 포함할 수 있다.In addition, the mobile communication module 112 transmits and receives a radio signal with at least one of a base station, an external terminal, and a server on a mobile communication network. The wireless signal may include various types of data according to transmission and reception of a voice call signal, a video call call signal, or a text / multimedia message.

무선 인터넷 모듈(113)은 무선 인터넷 접속을 위한 모듈을 말하는 것으로, 무선 인터넷 모듈(113)은 내장되거나 외장될 수 있다.The wireless internet module 113 refers to a module for wireless internet access, and the wireless internet module 113 may be internal or external.

근거리 통신 모듈(114)은 근거리 통신을 위한 모듈을 말한다. 근거리 통신 기술로 블루투스(Bluetooth), RFID(Radio Frequency Identification), 적외선 통신(IrDA, infrared Data Association), UWB(Ultra Wideband), ZigBee 등이 이용될 수 있다.The short

또한, 위치정보 모듈(115)은 이동 단말기의 위치를 확인하거나 얻기 위한 모듈이다. 일례로 GPS(Global Position System) 모듈이 있다. GPS 모듈은 복수 개의 인공위성으로부터 위치 정보를 수신한다. 여기에서, 위치 정보는 위도 및 경도로 표시되는 좌표 정보를 포함할 수 있다. 예를 들어, GPS 모듈은, 3개 이상의 위성으로부터 정확한 시간과 거리를 측정하여 3개의 각각 다른 거리를 삼각 방법에 따라서 현 위치를 정확히 계산할 수 있다. 3개의 위성으로부터 거리와 시간 정보를 얻고 1개 위성으로 오차를 수정하는 방법이 사용될 수 있다. 특히, GPS 모듈은 위성으로부터 수신한 위치 정보로부터, 위도, 경도, 고도의 위치뿐만 아니라 3차원의 속도 정보와 함께 정확한 시간까지 얻을 수 있다.In addition, the

한편, A/V(Audio/Video) 입력부(120)는 오디오 신호 또는 비디오 신호 입력을 위한 것으로, 이에는 카메라(121)와 마이크(122) 등이 포함될 수 있다. 카메 라(121)은 화상 통화모드 또는 촬영 모드에서 이미지 센서에 의해 얻어지는 정지영상 또는 동영상 등의 화상 프레임을 처리한다. 그리고, 처리된 화상 프레임은 디스플레이부(151)에 표시될 수 있다.Meanwhile, the A /

카메라(121)에서 처리된 화상 프레임은 메모리(160)에 저장되거나 무선 통신부(110)를 통하여 외부로 전송될 수 있다. 카메라(121)은 단말기의 구성 태양에 따라 2개 이상이 구비될 수도 있다.The image frame processed by the

마이크(122)은 통화모드 또는 녹음모드, 음성인식 모드 등에서 마이크로폰(Microphone)에 의해 외부의 음향 신호를 입력받아 전기적인 음성 데이터로 처리한다. 그리고, 처리된 음성 데이터는 통화 모드인 경우 이동통신 모듈(112)를 통하여 이동통신 기지국으로 송신 가능한 형태로 변환되어 출력될 수 있다. 마이크(122)는 외부의 음향 신호를 입력 받는 과정에서 발생되는 잡음(noise)를 제거하기 위한 다양한 잡음 제거 알고리즘이 구현될 수 있다.The

사용자 입력부(130)는 사용자가 단말기의 동작 제어를 위한 입력 데이터를 발생시킨다. 사용자 입력부(130)는 키 패드(key pad) 돔 스위치 (dome switch), 터치 패드(정압/정전), 조그 휠, 조그 스위치 등으로 구성될 수 있다. 특히, 터치 패드가 후술하는 디스플레이부(151)과 상호 레이어 구조를 이룰 경우, 이를 터치 스크린이라 부를 수 있다.The

센싱부(140)는 이동 단말기(100)의 개폐 상태, 이동 단말기(100)의 위치, 사용자 접촉 유무, 이동 단말기의 방위, 이동 단말기의 가속/감속 등과 같이 이동 단말기(100)의 현 상태를 감지하여 이동 단말기(100)의 동작을 제어하기 위한 센싱 신호를 발생시킨다. 예를 들어 이동 단말기(100)가 슬라이드 폰 형태인 경우 슬라이드 폰의 개폐 여부를 센싱할 수 있다. 또한, 전원 공급부(190)의 전원 공급 여부, 인터페이스부(170)의 외부 기기 결합 여부 등과 관련된 센싱 기능을 담당한다.The

인터페이스부(170)는 이동 단말기(100)에 연결되는 모든 외부기기와의 인터페이스 역할을 한다. 예를 들어, 유/무선 헤드셋 포트, 외부 충전기 포트, 유/무선 데이터 포트, 메모리 카드(memory card) 포트, 식별 모듈이 구비된 장치를 연결하는 포트, 오디오 I/O(Input/Output) 포트, 비디오 I/O(Input/Output) 포트, 이어폰 포트 등이 포함될 수 있다.The

여기에서, 식별 모듈은 이동 단말기(100)의 사용 권한을 인증하기 위한 각종 정보를 저장한 칩으로서, 사용자 인증 모듈(User Identify Module; 'UIM'), 가입자 인증 모듈(Subscriber Identify Module; 'SIM'), 범용 사용자 인증 모듈(Universal Subscriber Identity Module; 'USIM') 등을 포함할 수 있다. 또한, 식별 모듈이 구비된 장치(이하 '식별 장치')는, 스마트 카드(smart card) 형식으로 제작될 수 있다. 따라서 식별 장치는 포트를 통하여 단말기(100)와 연결될 수 있다. 이와 같은 인터페이스부(170)는 외부 기기로부터 데이터를 전송받거나 전원을 공급받아 이동 단말기(100) 내부의 각 구성 요소에 전달하거나 이동 단말기(100) 내부의 데이터가 외부 기기로 전송되도록 한다.Here, the identification module is a chip that stores various types of information for authenticating the use authority of the

출력부(150)는 오디오 신호 또는 비디오 신호 또는 알람(alarm) 신호의 출력을 위한 것으로, 이에는 디스플레이부(151)과 음향 출력 모듈(152), 알람부(153) 등이 포함될 수 있다.The

디스플레이부(151)는 이동 단말기(100)에서 처리되는 정보를 표시 출력한다. 예를 들어 이동 단말기가 통화 모드인 경우 통화와 관련된 UI(User Interface) 또는 GUI(Graphic User Interface)를 표시한다. 그리고 이동 단말기(100)가 화상 통화 모드 또는 촬영 모드인 경우 촬영 또는/및 수신된 영상 또는 UI, GUI를 표시한다.The

한편, 전술한 바와 같이, 디스플레이부(13)과 터치패드가 상호 레이어 구조를 이루어 터치 스크린으로 구성되는 경우, 디스플레이부(151)은 출력 장치 이외에 입력 장치로도 사용될 수 있다. 디스플레이부(151)은 액정 디스플레이(liquid crystal display), 박막 트랜지스터 액정 디스플레이(thin film transistor-liquid crystal display), 유기 발광 다이오드(organic light-emitting diode), 플렉시블 디스플레이(flexible display), 3차원 디스플레이(3D display) 중에서 적어도 하나를 포함할 수 있다. 그리고 이동 단말기(100)의 구현 형태에 따라 디스플레이부(151)이 2개 이상 존재할 수도 있다. 예를 들어, 이동 단말기(100)에 외부 디스플레이부(미도시)와 내부 디스플레이부(미도시)가 동시에 구비될 수 있다.Meanwhile, as described above, when the display unit 13 and the touch pad form a mutual layer structure to form a touch screen, the

음향 출력 모듈(152)는 호신호 수신, 통화모드 또는 녹음 모드, 음성인식 모드, 방송수신 모드 등에서 무선 통신부(110)로부터 수신되거나 메모리(160)에 저장된 오디오 데이터를 출력한다. 또한, 음향 출력 모듈(152)은 이동 단말기(100)에서 수행되는 기능(예를 들어, 호신호 수신음, 메시지 수신음 등)과 관련된 음향 신호를 출력한다. 이러한 음향 출력 모듈(152)에는 스피커(speaker), 버저(Buzzer) 등이 포함될 수 있다.The

알람부(153)는 이동 단말기(100)의 이벤트 발생을 알리기 위한 신호를 출력한다. 이동 단말기에서 발생되는 이벤트의 예로는 호 신호 수신, 메시지 수신, 키 신호 입력 등이 있다. 알람부(153)은 오디오 신호나 비디오 신호 이외에 다른 형태로 이벤트 발생을 알리기 위한 신호를 출력할 수도 있다. 예를 들면, 진동 형태로 신호를 출력할 수 있다. 호 신호가 수신되거나 메시지가 수신된 경우, 이를 알리기 위해 알람부(153)은 진동을 출력할 수 있다. 또는, 키 신호가 입력된 경우, 키 신호 입력에 대한 피드백으로 알람부(153)은 진동을 출력할 수 있다. 상기와 같은 진동 출력을 통해 사용자는 이벤트 발생을 인지할 수 있다. 물론 이벤트 발생 알림을 위한 신호는 디스플레이부(151)이나 음성 출력 모듈(152)을 통해서도 출력될 수 있다.The

메모리(160)는 제어부(180)의 처리 및 제어를 위한 프로그램이 저장될 수도 있고, 입/출력되는 데이터들(예를 들어, 폰북, 메시지, 정지영상, 동영상 등)의 임시 저장을 위한 기능을 수행할 수도 있다.The

메모리(160)는 플래시 메모리 타입(flash memory type), 하드디스크 타입(hard disk type), 멀티미디어 카드 마이크로 타입(multimedia card micro type), 카드 타입의 메모리(예를 들어 SD 또는 XD 메모리 등), 램(RAM, Random Access Memory) SRAM(Static Random Access Memory), 롬(ROM, Read-Only Memory), EEPROM(Electrically Erasable Programmable Read-Only Memory), PROM(Programmable Read-Only Memory) 자기 메모리, 자기 디스크, 광디스크 중 적어도 하나의 타입의 저장매체를 포함할 수 있다. 또한, 이동 단말기(100)는 인터 넷(internet)상에서 메모리(150)의 저장 기능을 수행하는 웹 스토리지(web storage)를 운영할 수도 있다.The

그리고 제어부(180)는 통상적으로 이동 단말기의 전반적인 동작을 제어한다. 예를 들어 음성 통화, 데이터 통신, 화상 통화 등을 위한 관련된 제어 및 처리를 수행한다. 또한, 제어부(180)는 멀티 미디어 재생을 위한 멀티미디어 모듈(181)을 구비할 수도 있다. 멀티미디어 모듈(181)은 제어부(180) 내에 구현될 수도 있고, 제어부(180)와 별도로 구현될 수도 있다.The

전원 공급부(190)는 제어부(180)의 제어에 의해 외부의 전원, 또는 내부의 전원을 인가받아 각 구성요소들의 동작에 필요한 전원을 공급한다.The

여기에 설명되는 다양한 실시 예는 예를 들어, 소프트웨어, 하드웨어 또는 이들의 조합된 것을 이용하여 컴퓨터로 읽을 수 있는 기록매체 내에서 구현될 수 있다.Various embodiments described herein may be implemented in a computer-readable recording medium using, for example, software, hardware or a combination thereof.

하드웨어적인 구현에 의하면, 여기에 설명되는 실시예는 ASICs (application specific integrated circuits), DSPs (digital signal processors), DSPDs (digital signal processing devices), PLDs (programmable logic devices), FPGAs (field programmable gate arrays, 프로세서(processors), 제어기(controllers), 마이크로 컨트롤러(micro-controllers), 마이크로 프로세서(microprocessors), 기능 수행을 위한 전기적인 유닛 중 적어도 하나를 이용하여 구현될 수 있다. 일부의 경우에 그러한 실시 예들이 제어부(180)에 의해 구현될 수 있다.According to a hardware implementation, the embodiments described herein include application specific integrated circuits (ASICs), digital signal processors (DSPs), digital signal processing devices (DSPDs), programmable logic devices (PLDs), field programmable gate arrays (FPGAs), and the like. It may be implemented using at least one of processors, controllers, micro-controllers, microprocessors, and electrical units for performing the functions. It may be implemented by the

소프트웨어적인 구현에 의하면, 절차나 기능과 같은 실시 예들은 적어도 하 나의 기능 또는 작동을 수행하게 하는 별개의 소프트웨어 모듈과 함께 구현될 수 있다. 소프트웨어 코드는 적절한 프로그램 언어로 쓰여진 소프트웨어 어플리케이션에 의해 구현될 수 있다. 또한, 소프트웨어 코드는 메모리(160)에 저장되고, 제어부(180)에 의해 실행될 수 있다.In a software implementation, embodiments such as procedures or functions may be implemented with separate software modules that allow at least one function or operation to be performed. The software code may be implemented by a software application written in a suitable programming language. In addition, the software code may be stored in the

이상에서는 본 발명과 관련된 이동 단말기를 기능에 따른 구성요소 관점에서 살펴보았다. 이하에서는 도 2 및 도 3을 더욱 참조하여, 본 발명과 관련된 이동 단말기를 외형에 따른 구성요소 관점에서 더욱 살펴보겠다. 이하에서는 설명의 간명함을 위해 폴더 타입, 바 타입, 스윙타입, 슬라이더 타입, 등과 같은 여러 타입의 이동 단말기들 중에서 슬라이더 타입의 이동 단말기를 예로 들어 설명한다. 따라서 본 발명은 슬라이더 타입의 이동 단말기에 특정되는 것은 아니고 상기 전술한 타입을 포함한 모든 타입의 이동 단말기에 적용될 수 있다. In the above, the mobile terminal related to the present invention has been described in terms of components according to functions. Hereinafter, referring to FIGS. 2 and 3, the mobile terminal related to the present invention will be further described in terms of components according to appearance. Hereinafter, for simplicity, a slider type mobile terminal is described as an example among various types of mobile terminals such as a folder type, a bar type, a swing type, a slider type, and the like. Therefore, the present invention is not specific to the slider type mobile terminal, but can be applied to all types of mobile terminals including the above-described type.

도2는 본 발명과 관련된 이동 단말기의 일 예를 전면에서 바라본 사시도이다.2 is a front perspective view of an example of a mobile terminal according to the present invention;

본 발명의 이동 단말기는 제1바디(200)와, 상기 제1바디(200)에 적어도 일 방향을 따라 슬라이딩 가능하게 구성된 제2바디(205)를 포함한다.The mobile terminal of the present invention includes a

제1바디(200)가 제2바디(205)와 중첩되게 배치된 상태를 닫힌 상태(closed configuration)라 칭할 수 있으며, 본 도면에 도시된 바와 같이 제1바디(200)가 제2바디(205)의 적어도 일 부분을 노출한 상태를 열린 상태(open configuration)라 칭할 수 있다.A state in which the

상기 이동 단말기는 닫힌 상태에서 주로 대기 모드로 작동하지만 사용자의 조작에 의해 대기 모드가 해제되기도 한다. 그리고, 상기 이동 단말기는 열린 상태에서 주로 통화 모드 등으로 작동하지만 사용자의 조작 또는 소정 시간의 경과에 의해 대기 모드로 전환되기도 한다.The mobile terminal mainly operates in a standby mode in a closed state, but the standby mode may be released by a user's operation. In addition, although the mobile terminal operates mainly in a call mode or the like in an open state, the mobile terminal may be switched to a standby mode by a user's manipulation or a lapse of a predetermined time.

상기 제1 바디(200)의 외관을 이루는 케이스(케이싱, 하우징, 커버 등)는 제 1 프론트 케이스(220)와 제1 리어 케이스(225)에 의해 형성된다. 상기 제1 프론트 케이스(220)와 제1 리어 케이스(225)에 의해 형성된 공간에는 각종 전자부품들이 내장된다. 제1 프론트 케이스(220)와 제1 리어 케이스(225) 사이에는 적어도 하나의 중간 케이스들이 추가로 배치될 수도 있다.The case (casing, housing, cover, etc.) forming the exterior of the

상기 케이스들은 합성수지를 사출하여 형성되거나 금속 재질, 예를 들어 스테인레스 스틸(STS) 또는 티타늄(Ti) 등과 같은 금속 재질을 갖도록 형성될 수도 있다.The cases may be formed by injecting a synthetic resin or may be formed of a metal material, for example, a metal material such as stainless steel (STS) or titanium (Ti).

제1 바디(200), 구체적으로 제1 프론트 케이스(220)에는 디스플레이모듈(151), 음향출력모듈(152), 카메라(121) 또는 제1 사용자 입력부(210)가 배치될 수 있다.The

상기 디스플레이모듈(151)은 정보를 시각적으로 표현하는 LCD(liquid crystal display), OLED(Organic Light Emitting Diodes) 등을 포함한다.The

그리고 상기 디스플레이모듈(151)에는 터치패드가 레이어 구조로 중첩됨으로써, 상기 디스플레이모듈(151)이 터치 스크린으로 동작하여 사용자의 터치에 의한 정보의 입력 또한 가능하게 할 수도 있다.In addition, since the touch pad is superimposed on the

상기 음향출력모듈(152)은 스피커의 형태로 구현될 수 있다.The

카메라(121)은 사용자 등에 대한 이미지 또는 동영상을 촬영하기에 적절하도록 구현될 수 있다.The

제1 바디(200)와 마찬가지로, 제2 바디(205)의 외관을 이루는 케이스는 제 2 프론트 케이스(230)와 제 2 리어 케이스(235)에 의해 형성된다.Like the

제2 바디(205), 구체적으로 제2 프론트 케이스(230)의 전면(front face)에는 제2 사용자 입력부(215)가 배치될 수 있다.The second

제2 프론트 케이스(230) 또는 제2 리어 케이스(235) 중 적어도 하나에는 제3 사용자 입력부(245), 마이크(122), 인터페이스부(170)가 배치될 수 있다.The third

상기 제1 내지 제3 사용자 입력부(210, 215, 245)는 사용자 입력부(manipulating portion)(130)라 통칭될 수 있으며, 사용자가 촉각적인 느낌을 주면서 조작하게 되는 방식(tactile manner)이라면 어떤 방식이든 채용될 수 있다.The first to

예를 들어, 상기 사용자 입력부는 사용자의 푸시 또는 터치 조작에 의해 명령 또는 정보를 입력받을 수 있는 돔 스위치 또는 터치 패드로 구현되거나, 키를 회전시키는 휠 또는 조그 방식이나 조이스틱과 같이 조작하는 방식 등으로도 구현될 수 있다.For example, the user input unit may be implemented as a dome switch or a touch pad capable of receiving a command or information by a user's push or touch operation, or a wheel or jog method of rotating a key, or a manipulation method such as a joystick. May also be implemented.

기능적인 면에서, 제1 사용자 입력부(210)는 시작, 종료, 스크롤 등과 같은 명령을 입력하기 위한 것이고, 제2 사용자 입력부(215)는 숫자 또는 문자, 심볼(symbol) 등을 입력하기 위한 것이다.In functional terms, the first

또한, 제3 사용자 입력부(245)는 상기 휴대단말기 내의 특수한 기능을 활성화하기 위한 핫 키(hot-key)로서 작동할 수 있다.In addition, the third

상기 마이크(122)는 사용자의 음성, 기타 소리 등을 입력 받기에 적절한 형태로 구현될 수 있다.The

상기 인터페이스부(170)는 본 발명과 관련된 이동 단말기가 외부 기기와 데이터 교환 등을 할 수 있게 하는 통로가 된다. 예를 들어, 상기 인터페이스부(170)는 유선 또는 무선으로, 이어폰과 연결하기 위한 접속단자, 근거리 통신을 위한 포트{예를 들어 적외선 포트(IrDA port), 블루투스 포트(Bluetooth port), 무선 랜 포트(wireless Lan port)등}, 또는 상기 이동 단말기에 전원을 공급하기 위한 전원공급 단자들 중 적어도 하나일 수 있다.The

상기 인터페이스부(170)는 SIM(subscriber identification module) 또는 UIM(user identity module), 정보 저장을 위한 메모리 카드 등의 외장형 카드를 수용하는 카드 소켓일 수도 있다.The

제2 리어 케이스(235) 측에는 상기 이동 단말기에 전원을 공급하기 위한 전원공급부(190)가 장착된다.The

상기 전원공급부(190)는, 예를 들어 충전 가능한 배터리로서 충전 등을 위하여 착탈 가능하게 결합될 수 있다.The

도3은 도2의 이동 단말기의 후면 사시도이다.3 is a rear perspective view of the mobile terminal of FIG.

도3을 참조하면, 제2 바디(205)의 제2 리어 케이스(235)의 후면에는 카메라(121)가 추가로 장착될 수 있다. 상기 제2 바디(205)의 카메라(121)는 제1 바디(200)의 카메라(121)와 실질적으로 반대되는 촬영 방향을 가지며, 제1 바디(200)의 카메라(121)와 카메라(121)와 서로 다른 화소를 가질 수 있다.Referring to FIG. 3, a

예를 들어, 제1 바디(200)의 카메라(121)는 화상 통화 등의 경우에 사용자의 얼굴을 촬영하여 상대방에 전송함에 무리가 없도록 저화소를 가지며, 제2 바디의 카메라(121)는 일반적인 피사체를 촬영하고 바로 전송하지는 않는 경우가 많기에 고 화소를 가지는 것이 바람직하다.For example, the

제2 바디(205)의 카메라(121)에 인접하게는 플래쉬(250)와 거울(255)가 추가로 배치될 수 있다. 상기 플래쉬(250)는 제2바디(205)의 카메라(121)로 피사체를 촬영하는 경우에 상기 피사체를 향해 빛을 비추게 된다. 상기 거울(255)는 사용자가 제2바디(205)의 카메라(121)을 이용하여 자신을 촬영(셀프 촬영)하고자 하는 경우에, 사용자 자신의 얼굴 등을 비춰볼 수 있게 한다.The flash 250 and the

제2 리어 케이스(235)에는 음향출력모듈 (152)가 추가로 배치될 수도 있다.The

상기 제2 바디(205)의 음향출력모듈(152)는 제1 바디(200)의 음향출력모듈(152)과 함께 스테레오 기능을 구현할 수 있으며, 스피커폰 모드로 통화를 위하여 사용될 수도 있다.The

또한, 제2 리어 케이스(235)의 일 측에는 통화 등을 위한 안테나 외에 방송신호 수신용 안테나(260)가 배치될 수 있다. 상기 안테나(260)는 제2 바디(205)에서 인출 가능하게 설치될 수 있다.In addition, an

제1 바디(200)의 제1 리어 케이스(225) 측에는 제1 바디(200)와 제2 바디(205)를 슬라이딩 가능하게 결합하는 슬라이드 모듈(265)의 일 부분이 배치된다.A portion of the

슬라이드 모듈(265)의 다른 부분은 제2 바디(205)의 제2 프론트 케이스(230) 측에 배치되어, 본 도면에서와 같이 외부로 드러나지 않는 형태일 수 있다.The other part of the

이상에서는 제2 카메라(121) 등이 제2 바디(205)에 배치되는 것으로 설명하였으나, 반드시 그에 제한되는 것은 아니다.In the above description, the

예를 들어, 제2 바디의 카메라(121) 등과 같이 제2 리어 케이스(235)에 배치되는 것으로 설명한 구성들(260, 121 내지 250, 152) 중 적어도 하나 이상이 제1 바디(200), 주로는 제1 리어 케이스(225)에 장착되는 것도 가능하다. 그러한 경우라면, 상기 닫힌 상태에서 제1 리어 케이스(225)에 배치되는 구성(들)이 제2바디(205)에 의해 보호되는 이점이 있다. 나아가, 제2 바디의 카메라(121)가 별도로 구비되지 않더라도, 제1 바디의 카메라(121)가 회전 가능하게 형성되어 제2 바디의 카메라(121)의 촬영 방향까지 촬영이 가능하도록 구성될 수도 있다.For example, at least one or more of the

도1 내지 도3에 도시된 단말기(100)는, 유무선 통신 시스템 및 위성 기반 통신 시스템을 포함하여, 프레임(frame) 또는 패킷(packet)을 통하여 데이터(data)를 전송할 수 있는 통신 시스템에서 동작 가능하도록 구성될 수 있다.The terminal 100 illustrated in FIGS. 1 to 3 may operate in a communication system capable of transmitting data through a frame or packet, including a wired / wireless communication system and a satellite-based communication system. It can be configured to.

이하에서는, 도4를 참조하여, 본 발명에 관련된 단말기가 동작 가능한 통신 시스템에 대하여 살펴보겠다.Hereinafter, referring to FIG. 4, a communication system capable of operating a terminal according to the present invention will be described.

통신 시스템은, 서로 다른 무선 인터페이스 및/또는 물리 계층을 이용할 수도 있다. 예를 들어, 통신 시스템에 의해 이용 가능한 무선 인터페이스에는, 주파수 분할 다중 접속(Frequency Division Multiple Access; 'FDMA'), 시분할 다중 접속(Time Division Multiple Access; 'TDMA'), 코드 분할 다중 접속(Code Division Multiple Access; 'CDMA'), 범용 이동통신 시스템(Universal Mobile Telecommunications Systems; 'UMTS')(특히, LTE(Long Term Evolution), 이동통신 글로벌 시스템(Global System for Mobile Communications; 'GSM') 등이 포함될 수 있다. 이하에서는, 설명의 편의를 위하여, CDMA에 한정하여 설명하도록 한다. 그러나, 본 발명은, CDMA 무선 통신 시스템을 포함한 모든 통신 시스템 적용될 있음은 당연하다.The communication system may use different air interfaces and / or physical layers. For example, a radio interface usable by a communication system may include frequency division multiple access (FDMA), time division multiple access (TDMA), and code division multiple access (Code Division). Multiple Access (CDMA), Universal Mobile Telecommunications Systems (UMTS) (especially Long Term Evolution (LTE), Global System for Mobile Communications (GSM), etc.) In the following, for convenience of explanation, the description will be limited to CDMA, but the present invention is naturally applicable to all communication systems including the CDMA wireless communication system.

도4에 도시된 바와 같이, CDMA 무선 통신 시스템은, 복수의 단말기들(100), 복수의 기지국(Base Station; 'BS')(270), 기지국 제어부(Base Station Controllers; 'BSCs')(275), 이동 스위칭 센터(Mobile Switching Center; 'MSC')(280)를 포함할 수 있다. MSC(280)는, 일반 전화 교환망(Public Switched Telephone Network; 'PSTN')(290)과 연결되도록 구성되고, BSCs(275)와도 연결되도록 구성된다. BSCs(275)는, 백홀 라인(backhaul line)을 통하여, BS(270)과 짝을 이루어 연결될 수 있다. 백홀 라인은, E1/T1, ATM, IP, PPP, Frame Relay, HDSL, ADSL 또는 xDSL 중 적어도 하나에 따라서 구비될 수 있다. 따라서, 복수의 BSCs(275)가 도 4에 도시된 시스템에 포함될 수 있다.As shown in FIG. 4, the CDMA wireless communication system includes a plurality of

각각의 BS(270)는, 적어도 하나의 섹터를 포함할 수 있고, 각각의 섹터는, 전방향성 안테나 또는 BS(270)으로부터 방사상의 특정 방향을 가리키는 안테나를 포함할 수 있다. 또한, 각각의 섹터는, 다양한 형태의 안테나를 두 개 이상 포함할 수도 있다. 각각의 BS(270)는, 복수의 주파수 할당을 지원하도록 구성될 수 있고, 복수의 주파수 할당 각각은, 특정 스펙트럼(예를 들어, 1.25MHz, 5MHz 등)을 갖는다.Each

섹터와 주파수 할당의 교차는, CDMA 채널이라고 불릴 수 있다. BS(270)은 기 지국 송수신 하부 시스템(Base Station Transceiver Subsystem; 'BTSs')이라고 불릴수 있다. 이러한 경우, "기지국"이라는 단어는, 하나의 BSC(275) 및 적어도 하나의 BS(270)을 합하여 불릴 수도 있다. 기지국은, 또한 "셀 사이트"를 나타낼 수도 있다. 또는, 특정 BS(270)에 대한 복수의 섹터들 각각은, 복수의 셀 사이트로 불릴 수도 있다.The intersection of sectors and frequency assignments may be called a CDMA channel.

도4에 도시된 바와 같이, 방송 송신부(Broadcasting Transmitter; 'BT')(295)는, 시스템 내에서 동작하는 단말기들(100)에게 방송 신호를 송신한다. 도 1에 도시된 방송용 모듈(111)은, BT(295)에 의해 전송되는 방송 신호를 수신하기 위해 단말기(100) 내에 구비된다.As shown in FIG. 4, a broadcasting transmitter (BT) 295 transmits a broadcast signal to

뿐만 아니라, 도4에서는, 여러 개의 위성 위치 확인 시스템(Global Positioning System; 'GPS') 위성(300)을 도시한다. 상기 위성들(300)은, 복수의 단말기(100) 중 적어도 하나의 단말기의 위치를 파악하는 것을 돕는다. 도4에서는 두 개의 위성이 도시되어 있지만, 유용한 위치 정보는, 두 개 이하 또는 이상의 위성들에 의해 획득될 수도 있다. 도1에 도시된 GPS 모듈(115)은, 원하는 위치 정보를 획득하기 위하여 위성들(300)과 협력한다. 여기에서는, GPS 추적 기술뿐만 아니라 위치를 추적할 수 있는 모든 기술들을 이용하여 위치를 추적할 수 있다. 또한, GPS 위성들(300) 중 적어도 하나는, 선택적으로 또는 추가로 위성 DMB 전송을 담당할 수도 있다.In addition, FIG. 4 illustrates several satellite positioning systems (GPS)

무선 통신 시스템의 전형적인 동작 중, BS(270)은, 다양한 단말기들(100)로부터 역 링크 신호를 수신한다. 이때, 단말기들(100)은, 호를 연결 중이거나, 메시 지를 송수신 중이거나 또는 다른 통신 동작을 수행중에 있다. 특정 기지국(270)에 의해 수신된 역 링크 신호들 각각은, 특정 기지국(270)에 의해 내에서 처리된다. 상기 처리 결과 생성된 데이터는, 연결된 BSC(275)로 송신된다. BSC(275)는, 기지국들(270) 간의 소프트 핸드오프(soft handoff)들의 조직화를 포함하여, 호 자원 할당 및 이동성 관리 기능을 제공한다. 또한, BSC(275)는, 상기 수신된 데이터를 MSC(280)으로 송신하고, MSC(280)은, PSTN(290)과의 연결을 위하여 추가적인 전송 서비스를 제공한다. 유사하게, PSTN(290)은 MSC(280)과 연결하고, MSC(280)은 BSCs(275)와 연결하고, BSCs(275)는 단말기들(100)로 순 링크 신호를 전송하도록 BS들(270)을 제어한다.During typical operation of a wireless communication system,

본 실시 예에서 이동 단말기는 음성명령의 인식을 위해 참조할 데이터베이스의 정보범위를 특정 메뉴나 서비스 영역에 관련된 정보들로 특정할 수 있다. 상기와 같이 음성명령의 인식을 위해 참조할 데이터베이스의 정보범위, 또는 정보 검색범위를 특정함으로써 음성명령에 대한 인식률을 향상시키고, 또한 정보 검색범위가 줄어듦으로써 단말기의 자원(Resource)소모를 감소시킬 수 있다.In the present embodiment, the mobile terminal may specify the information range of the database to be referred for recognizing the voice command with information related to a specific menu or service area. As described above, the recognition rate for the voice command can be improved by specifying the information range or the information search range of the database to be referred for recognition of the voice command, and the resource consumption of the terminal can be reduced by reducing the information search range. have.

상기 음성명령의 인식을 위해 참조할 데이터베이스의 정보범위는, 단말기의 환경설정 메뉴를 통해 설정할 수 있도록 구성할 수 있으며, 음성인식 기능이 활성화됨에 따라 상기 설정된 정보범위가 자동으로 적용될 수 있다.The information range of the database to be referred to for recognizing the voice command may be configured to be set through an environment setting menu of the terminal, and the set information range may be automatically applied as the voice recognition function is activated.

이하, 본 실시 예에서는 상기 음성명령의 인식을 위해 설정된 데이터베이스의 정보범위가 현재 디스플레이부(151)에 표시된 메뉴들이나 그 메뉴들 중 선택된 어느 한 메뉴의 하위 메뉴들에 관련된 정보들인 것으로 가정하여 설명한다.Hereinafter, in the present embodiment, it is assumed that the information range of the database set for the recognition of the voice command is information related to menus currently displayed on the

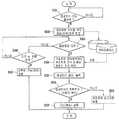

도5는 본 발명에 관련된 이동 단말기의 음성을 이용한 메뉴 제어방법을 설명하는 일 예의 흐름도로서, 이동 단말기의 제어부(180)는 활성화 제어신호를 입력받아 음성인식 기능의 활성화를 시작할 수 있다(S101). 상기 활성화 제어신호는 음성인식 기능의 활성화를 종료시킬 경우에도 이용될 수 있다.FIG. 5 is a flowchart illustrating a menu control method using a voice of a mobile terminal according to the present invention. The

상기 활성화 제어신호는 단말기에 구비된 특정 하드웨어 버튼, 또는 디스플레이부(151)에 표시된 소프트웨어 버튼, 또는 터치 입력, 또는 디스플레이부(151)에 표시된 특정 메뉴의 조작에 의해 생성될 수 있다. 또는, 특정 사운드나 음향, 근거리나 원거리의 무선신호, 또는 사용자의 손짓이나 몸짓(Gesture)을 포함한 신체의 동작 정보에 의해서도 생성될 수 있다.The activation control signal may be generated by operating a specific hardware button included in the terminal, a software button displayed on the

상기 특정 사운드나 음향은 박수 소리와 같이 특정레벨 이상을 갖는 일종의 충격음을 포함할 수 있다. 상기 특정레벨 이상의 사운드나 음향은 간단한 음향레벨 검출 알고리즘(도시하지 않음)을 이용해서 검출할 수 있다.The specific sound or sound may include a kind of impact sound having a specific level or more, such as a clapping sound. Sound or sound above the specified level can be detected using a simple sound level detection algorithm (not shown).

상기 음향레벨 검출 알고리즘은 음성인식 알고리즘보다 상대적으로 간단하며 단말기의 자원을 적게 소모할 수 있다. 상기 음향레벨 검출 알고리즘(또는 회로)은 음성인식 알고리즘(또는 회로)과 별도로 구성할 수 있고, 음성인식 알고리즘의 일부 기능을 제한하는 방식으로 구현할 수도 있다.The sound level detection algorithm is relatively simpler than the speech recognition algorithm and can consume less resources of the terminal. The sound level detection algorithm (or circuit) may be configured separately from the voice recognition algorithm (or circuit), or may be implemented in a manner that limits some functions of the voice recognition algorithm.

상기 무선신호는 무선 통신부(110)를 통해 입력받을 수 있으며, 상기 사용자의 손짓이나 몸짓은 센싱부(140)를 통해 입력받을 수 있다. 상기 활성화 제어신호를 입력받는 무선 통신부(110), 사용자 입력부(130), 센싱부(140)를 통칭하여 신호 입력부라고 할 수 있다.The wireless signal may be input through the

상기 음성인식 기능이 활성화되면, 제어부(180)는 특정 데이터베이스를 참조하여, 마이크(122)를 통해 입력받은 상기 음성명령의 문맥(context)이나 내용(content)을 분석하고, 그 음성명령에 포함된 의미를 판단할 수 있다(S103, S104).When the voice recognition function is activated, the

여기서, 상기 음성명령의 의미를 인식하기 위해 참조하는 데이터베이스는, 상기 음성인식 기능이 활성화되면서 그 정보범위(domain)가 특정 기능이나 메뉴에 관련된 정보들로 특정될 수 있다(S102). 예를 들어, 상기 특정되는 정보범위는 현재 디스플레이부(151)에 출력된 메뉴들이나 그 메뉴들 중 선택된 특정 메뉴의 하위 메뉴들에 관련된 정보들로 특정될 수 있다.In this case, the database referred to for recognizing the meaning of the voice command may be specified as information related to a specific function or menu while the voice recognition function is activated (S102). For example, the specified information range may be specified by menus currently output on the

상기와 같이 음성명령을 인식하기 위해 참조할 데이터베이스의 정보범위가 특정됨으로써, 음성명령에 대한 인식률을 더욱 높일 수 있게 된다.As described above, the information range of the database to be referred to for recognizing the voice command is specified, thereby further increasing the recognition rate of the voice command.

상기 하위 메뉴들에 관련된 정보들은 데이터베이스로 구성될 수 있다.Information related to the submenus may be configured in a database.

상기 정보들은 키 워드 형태일 수 있으며, 한가지 기능이나 메뉴에 대하여 복수의 정보가 대응될 수 있다. 또한, 상기 데이터베이스는 정보의 특성에 따라 복수로 구성될 수 있으며, 메모리(160)에 저장될 수 있다. 또한, 상기 각 데이터베이스에 구성된 정보들은 학습을 통해 갱신될 수 있다. 또한, 상기 각 데이터베이스의 정보들은 음성명령의 인식률 향상을 위하여, 현재 출력되고 있는 기능이나 메뉴들에 관련된 정보들로 특정될 수 있다. 또한, 상기 정보범위는 메뉴의 단계(depth)가 깊어짐에 따라 변경될 수 있다.The information may be in the form of keywords, and a plurality of information may correspond to one function or menu. In addition, the database may be configured in plural according to the characteristics of the information, and may be stored in the

상기 음성명령의 의미판단 동작은, 상기 입력된 음성명령을 임시 저장해두었다가 음성인식 기능의 활성화가 종료되면 곧바로 시작하거나, 음성인식 기능의 활성화 상태에서 음성명령이 입력됨과 동시에 수행할 수 있다.The semantic determination operation of the voice command may be performed immediately after the voice command is temporarily stored and the voice command is activated, or at the same time the voice command is input in the activated state of the voice recognition function.

한편, 상기 음성인식 기능이 활성화 상태에 있더라도, 제어부(180)는 터치나 버튼의 입력을 검출하는 알고리즘을 계속해서 구동할 수 있다. 따라서, 상기 제어부(180)는 음성인식 기능이 활성화된 상태에서도, 음성명령 이외의 터치나 버튼과 같은 다른 입력수단을 통해서 특정 메뉴를 선택받거나 실행할 수 있다(S109, S110).Meanwhile, even when the voice recognition function is in an activated state, the

상기 제어부(180)는 상기 음성명령의 의미가 판단되면 그 결과를 출력할 수 있다(S105). 상기 결과는 상기 음성명령의 의미에 대응하는 기능이나 서비스에 관련된 메뉴를 실행시키거나, 단말기의 특정 구성요소를 제어하기 위한 제어신호, 또는 상기 인식된 음성명령에 관련된 정보를 표시하기 위한 데이터를 포함할 수 있다.If it is determined that the meaning of the voice command is determined, the

한편, 상기 제어부(180)는 상기 결과를 출력하거나 실행할 때, 그 결과가 정확한지 여부에 대하여 사용자의 확인을 받을 수 있다(S106). 예를 들어, 상기 제어부(180)는 상기 음성명령의 인식률이 낮거나 복수의 의미로 인식될 경우, 각 의미에 관련된 복수의 메뉴들을 출력한 후, 사용자의 선택을 받아 실행할 수 있다. 또는 단순히 인식률이 높은 특정 메뉴의 실행 여부를 묻고, 사용자의 선택이나 응답을 받아 해당하는 기능이나 메뉴를 실행하거나 표시할 수 있다.Meanwhile, when outputting or executing the result, the

상기 특정 메뉴에 대한 실행 여부는 메시지나 음성을 출력하여 사용자에게 확인할 수 있다(예 : 포토앨범 메뉴를 실행할까요? 예/아니오 로 응답해 주세요. 응답이 없으면 5초 후에 자동으로 포토앨범 메뉴를 실행합니다).The user can confirm whether or not the specific menu is executed by outputting a message or voice (for example: Do you want to run the photo album menu? Answer Yes / No. If there is no response, the photo album menu is automatically executed after 5 seconds. ).

이에 따라, 사용자는 음성이나 다른 입력수단을 이용하여 응답(예 : 1. 그래(Yes), 2.아니오(No))할 수 있으며, 상기 다른 입력수단으로는 하드웨어 버튼이나 소프트웨어 버튼, 또는 터치 방식으로 입력할 수 있다. 만약, 사용자의 응답이 없을 경우, 제어부(180)는 긍정 응답으로 판단하여 상기 기능이나 메뉴를 자동으로 실행할 수 있다(S107).Accordingly, the user may respond by using voice or other input means (eg, 1. Yes, 2. No), and the other input means may include a hardware button, a software button, or a touch method. Can be entered. If there is no response from the user, the

만약, 사용자의 응답이 부정적인 경우, 즉 상기 음성명령의 의미를 정확하게 판단하지 못하였을 경우에는 에러처리 과정을 수행할 수 있다(S108).If the user's response is negative, that is, if the meaning of the voice command is not correctly determined, an error processing process may be performed (S108).

상기 에러처리 과정은 음성명령을 다시 입력받거나, 특정 인식률 이상을 갖는 복수의 메뉴들(또는, 유사한 의미로 해석될 수 있는 복수의 메뉴들)을 표시한 후, 사용자에 의해 어느 하나의 메뉴를 선택받을 수 있다. 만약, 특정 인식률 이상을 갖는 기능이나 메뉴가 특정 개수(예 : 2개) 미만인 경우 그 기능이나 메뉴를 자동으로 실행할 수 있다.The error processing process selects any one menu by a user after receiving a voice command again or displaying a plurality of menus (or a plurality of menus that can be interpreted in a similar sense) having a specific recognition rate or more. I can receive it. If a function or menu having a specific recognition rate or more is less than a certain number (for example, two), the function or menu may be automatically executed.

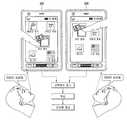

도6A는 본 발명에 관련된 이동 단말기의 음성인식 기능을 활성화하는 방법을 설명하기 위한 예시도이다.6A is an exemplary view for explaining a method of activating a voice recognition function of a mobile terminal according to the present invention.

상기 음성인식 기능을 계속 활성화 상태로 유지할 경우, 음성인식 알고리즘의 계속된 구동에 따라 자원소모와 전력소모가 증가하게 된다. 따라서, 이동 단말기의 불필요한 전력소모를 방지하고, 자원소모를 줄이기 위해서 음성인식 기능의 활성화 시작과 종료를 제어할 필요가 있다.If the voice recognition function is kept active, resource consumption and power consumption increase according to the continuous operation of the voice recognition algorithm. Therefore, it is necessary to control the start and end of activation of the voice recognition function in order to prevent unnecessary power consumption of the mobile terminal and to reduce resource consumption.

따라서, 본 발명에서는 사용자 입력부(130)에 구비된 임의의 버튼을 입력받아 활성화를 제어할 수 있다(410). 상기 임의의 버튼은 하드웨어 버튼일 수도 있고, 디스플레이부(151)에 표시된 소프트웨어 버튼이나 아이콘(411)일 수 있다.Therefore, in the present invention, the activation can be controlled by receiving an arbitrary button provided in the user input unit 130 (410). The arbitrary button may be a hardware button or may be a software button or an

상기 소프트웨어 버튼은 대기상태에서의 메뉴호출 버튼을 포함한다.The software button includes a menu call button in the standby state.

즉, 대기상태에서 메뉴호출 버튼이 입력되면, 제어부(180)는 메뉴 리스트를 출력하면서 동시에 음성인식 기능을 활성화할 수 있다.That is, when the menu call button is input in the standby state, the

또한, 상기 제어부(180)는 디스플레이부(151)에 아무것도 표시되지 않은 임의의 영역(버튼이나 메뉴 아이콘이 표시되지 않은 영역)이 터치될 경우, 상기 음성인식 기능의 활성화를 제어할 수 있다(420).In addition, the

또한, 상기 제어부(180)는 특정레벨 이상의 사운드나 음향이 입력될 경우, 상기 음성인식 기능의 활성화를 제어할 수 있다(430). 예를 들어, 본 발명에서는 상기 음성인식 기능을 2가지 모드로 구동할 수 있다. 즉, 단순히 특정레벨 이상의 사운드나 음향을 검출하는 제1 모드와, 음성명령을 인식하여 그 음성명령의 의미를 판단하는 제2 모드로 구동할 수 있으며, 상기 제1 모드에서 특정레벨 이상의 사운드나 음향이 입력될 경우 제2 모드를 활성화함으로써 음성명령을 인식할 수 있다.In addition, the

또한, 상기 음성인식 기능의 활성화는 근거리나 원거리의 무선신호, 또는 사용자의 손짓이나 몸짓(Gesture)을 포함한 신체의 동작 정보가 입력될 경우 제어할 수 있다(440).In addition, the activation of the voice recognition function may be controlled when the motion information of the body including a short or long distance wireless signal or a gesture or gesture of the user is input (440).

한편, 상기와 같이 음성인식 기능이 활성화됨에 따라, 제어부(180)는 음성인식을 위해 참조할 수 있는 특정 데이터베이스의 정보범위를 상기 디스플레이 부(151)에 표시된 메뉴 리스트에 관련된 정보들로 특정할 수 있다. 만약, 상기 메뉴 리스트에서 특정 메뉴가 선택되거나 실행될 경우, 상기 데이터베이스의 정보범위는 그 선택된 메뉴나 그 하위 메뉴들에 관련된 정보들로 특정될 수 있다.Meanwhile, as the voice recognition function is activated as described above, the

또한, 상기 특정 메뉴가 음성명령이나 터치 입력에 의해서 선택되거나 실행될 경우, 제어부(180)는 하위 메뉴들에 관련된 도움말 정보를 음성이나 풍선 도움말 형식으로 출력할 수 있다.In addition, when the specific menu is selected or executed by a voice command or a touch input, the

예를 들어, 도6B에 도시된 바와 같이, '멀티미디어 메뉴'가 선택될 경우, 그 하위 메뉴들(예 : 방송, 카메라, 텍스트 뷰어, 게임 등)에 관련된 정보가 도움말 정보(441, 442)로서 출력될 수 있다.For example, as shown in FIG. 6B, when the 'multimedia menu' is selected, information related to submenus (e.g., broadcast, camera, text viewer, game, etc.) is referred to as the help information 441,442. Can be output.

또는, 도6C에 도시된 바와 같이, 특정 메뉴를 선택하기 위해 손가락이 메뉴 터치를 위해 접근하는 경우, 하위 메뉴 리스트(443)를 출력할 수 있다. 상기 도움말 정보는 디스플레이부(151)에 출력될 때 접근 거리에 따라 투명도나 명암이 조절될 수 있다.Alternatively, as shown in FIG. 6C, when a finger approaches for a menu touch to select a specific menu, the

상기 제어부(180)는 활성화 상태를 일정시간 동안 유지한 후 자동으로 활성화 상태를 종료시킬 수 있다. 또한, 상기 제어부(180)는 특정 버튼이나 터치가 입력되고 있는 동안에만 활성화 상태를 유지한 후, 그 입력이 해제되면 활성화 상태를 종료시킬 수 있다. 또한, 상기 제어부(180)는 활성화 상태가 시작된 후, 특정시간 이상 음성이 입력되지 않으면 자동으로 활성화 상태를 종료시킬 수 있다.The

도7A는 본 발명에 관련된 이동 단말기의 음성명령 인식방법을 설명하기 위한 흐름도이다.7A is a flowchart illustrating a voice command recognition method of a mobile terminal according to the present invention.

상기와 같이 음성인식 기능이 활성화됨에 따라, 제어부(180)는 음성인식에 참조할 수 있는 데이터베이스의 정보범위를 디스플레이부(151)에 표시된 메뉴 리스트, 또는 그의 하위 메뉴들에 관련된 정보들로 특정할 수 있다(S201).As the voice recognition function is activated as described above, the

상기 음성인식 기능이 활성화된 후 입력받은 음성명령은 메모리(160)의 특정 데이터베이스에 저장될 수 있다(S202, S203).The voice command received after the voice recognition function is activated may be stored in a specific database of the memory 160 (S202 and S203).

상기와 같이 정보범위가 특정된 상태에서 음성명령을 입력받으면, 제어부(180)는 음성인식 알고리즘을 이용하여, 상기 데이터베이스의 특정된 정보범위 내에서 음성명령의 내용과 문맥을 분석한다. 상기 음성명령을 분석하기 위하여 텍스트 형식의 정보로 변환할 수 있으며, 그 텍스트 형식의 정보를 메모리(160)의 특정 데이터베이스에 저장할 수 있다(S204). 그러나, 상기 음성명령을 반드시 텍스트 형식의 정보로 변환해야 하는 것은 아니다.When the voice command is input in the state in which the information range is specified as described above, the

상기 제어부(180)는 내용과 문맥의 분석을 위하여, 상기 음성명령에 포함된 특정 단어 또는 키 워드를 검출할 수 있다(S205). 상기 검출된 단어 또는 키 워드를 바탕으로, 특정 데이터베이스에 저장된 정보를 참조하여, 상기 음성명령의 내용이나 문맥을 분석하고 그 의미를 판단할 수 있다(S206). 그리고, 상기 참조되는 데이터베이스는 그 정보범위가 특정될 수 있으며, 그 데이터베이스를 참조하여 판단된 음성명령의 의미에 해당하는 기능이나 메뉴를 실행할 수 있다(S207).The

상기와 같이 음성인식을 위한 정보범위가 특정 메뉴들에 관련된 정보들로 특정됨으로써, 음성인식을 위한 속도와 인식률이 향상되고 자원소모를 줄일 수 있게 된다. 상기 인식률은 특정 메뉴에 설정된 명칭과 일치하는 정도를 의미할 수 있다.As described above, the information range for speech recognition is specified by information related to specific menus, thereby improving speed and recognition rate for speech recognition and reducing resource consumption. The recognition rate may mean a degree that matches the name set in a specific menu.

상기 음성명령의 인식률은 상기 음성명령에 포함된 정보 중, 특정 기능이나 메뉴에 관련된 정보들의 개수에 의해서 판단할 수 있다. 따라서, 상기 음성명령의 인식률은 특정 기능이나 메뉴와 정확히 일치하는 정보(예 : 메뉴 명칭)이 음성명령에 포함되어 있을 경우에 음성명령 인식률이 높아질 수 있다.The recognition rate of the voice command may be determined by the number of information related to a specific function or menu among information included in the voice command. Therefore, the recognition rate of the voice command may be increased when the voice command includes information (eg, a menu name) that exactly matches a specific function or menu.

예를 들어, 도7B에 도시된 바와 같이 상기 음성명령이 6개의 단어로 이루어진 자연어(예 : I want to see my pictures)로 입력되었다고 가정할 경우, 특정 메뉴(예 : photo album)에 관련된 의미있는 단어(예 : see, pictures)의 개수에 의해서 인식률을 판단할 수 있다. 상기 음성명령에 포함된 단어가 특정 기능이나 메뉴에 관련된 의미있는 단어인지 여부는 데이터베이스에 저장된 정보에 따라 다를 수 있다. 예컨대, 상기 자연어 음성명령에서(예 : I want to see my pictures) 메뉴와 관련없는 의미없는 단어는 문법적으로는 주어(I) 또는 전치사(to) 또는 소유 대명사(my)가 될 수 있다.For example, assuming that the voice command is input in a natural language consisting of six words (eg, I want to see my pictures) as shown in FIG. 7B, the voice command may be meaningful to a particular menu (eg, photo album). The recognition rate can be determined by the number of words (eg, see, pictures). Whether a word included in the voice command is a meaningful word related to a specific function or menu may vary depending on information stored in a database. For example, in the natural language voice command (eg, I want to see my pictures), a meaningless word that is not related to a menu may be a subject (I) or a preposition (to) or a possessive pronoun (my).

상기 자연어는 사람들이 일상적으로 쓰는 언어를 인공적으로 만들어진 언어인 인공어와 구분하여 부르는 개념으로서, 자연어 처리 알고리즘을 이용해 처리할 수 있다. 상기 자연어에는 특정 메뉴에 관련된 정확한 명칭이 포함될 수도 있고 포함되지 않을 수도 있기 때문에, 사실상 음성명령을 100% 정확하게 인식하는 것은 어려울 수 있다. 따라서, 인식률이 특정 값(예 : 80%) 이상이면 정확하다고 판단할 수 있으며, 상기 인식률을 갖는 의미가 복수로 있을 경우(즉, 비슷한 인식률을 갖는 여러가지 의미로 해석될 수 있는 음성명령이 입력된 경우)에는 해당하는 메뉴들을 표시하고, 그 중 사용자의 선택을 받아 적어도 한가지 기능이나 메뉴를 실행할 수 있다. 상기 인식률은 제조 단계에서 설정될 수 있고 사용자에 의해 설정될 수도 있다.The natural language is a concept of calling a language that people commonly use from an artificial language, which is an artificially created language, and may be processed using a natural language processing algorithm. Since the natural language may or may not include the exact name associated with a particular menu, it may be difficult to recognize voice commands 100% accurately. Therefore, if the recognition rate is above a certain value (eg, 80%), it can be determined to be accurate, and if there are a plurality of meanings having the recognition rate (that is, a voice command that can be interpreted as various meanings having a similar recognition rate is inputted). In this case, corresponding menus may be displayed, and at least one function or menu may be executed by the user's selection. The recognition rate may be set at the manufacturing stage or may be set by the user.

상기 메뉴들을 표시함에 있어서 인식률이 상대적으로 높은 메뉴의 순서로 표시할 수 있다.In displaying the menus, the menus may be displayed in order of relatively high recognition rates.

예를 들어, 도8에 도시된 바와 같이 인식률이 높은 메뉴 아이콘을 화면의 중심에 더욱 가깝게 표시할 수 있다(510). 또는 인식률이 높은 메뉴 아이콘을 더욱 크게 표시하거나 더욱 진하게 표시할 수 있다(520).For example, as illustrated in FIG. 8, a menu icon having a high recognition rate may be displayed closer to the center of the screen (510). Alternatively, the menu icon having a high recognition rate may be displayed larger or darker (520).

또한, 상기 복수의 메뉴 중 인식률이 높은 순서에 따라, 크기, 위치, 컬러, 명암 중 적어도 하나를 다르게 표시할 수 있으며, 하이라이트 시키거나 투명도를 조정할 수도 있다.In addition, at least one of a size, a position, a color, and a contrast may be differently displayed and the highlight or the transparency may be adjusted according to the order of recognition rate among the plurality of menus.

이때, 상기 복수로 표시된 메뉴 중 사용자의 선택도가 높은 메뉴의 인식률을 더 높게 변경할 수 있다. 즉, 상기 인식률은 사용자가 자주 선택하는 메뉴에 대하여 그 선택 회수를 학습할 수 있고, 그 선택된 메뉴에 대한 인식률을 변경할 수 있다. 따라서, 이 후에 동일하거나 유사한 발음 또는 내용으로 입력되는 음성명령에 대하여 인식률이 달라질 수 있다.In this case, a recognition rate of a menu having a high user selectivity among the plurality of displayed menus may be changed higher. That is, the recognition rate may learn the number of selections for a menu frequently selected by a user, and change the recognition rate for the selected menu. Therefore, the recognition rate may be different for voice commands input after the same or similar pronunciation or content.

도9는 본 발명에 관련된 이동 단말기의 음성명령 인식방법을 설명하기 위한 예시도이다.9 is an exemplary view for explaining a voice command recognition method of a mobile terminal according to the present invention.

이동 단말기가 대기상태에 있는 것으로 가정하고, 상기 대기상태에서 사용자에 의해 특정 메뉴(예 : 멀티미디어 메뉴)가 선택될 경우, 제어부(180)는 상기 선택된 메뉴의 하위 메뉴들을 디스플레이한다(610).It is assumed that the mobile terminal is in a standby state, and when a specific menu (eg, a multimedia menu) is selected by the user in the standby state, the

그리고, 내부적으로 음성인식 기능의 활성화를 시작한다.Then, the voice recognition function is activated internally.

상기 음성인식 기능의 활성화가 시작되면, 제어부(180)는 기설정된 환경설정 옵션에 따라, 상기 음성명령의 인식을 위한 데이터베이스의 정보범위를 상기 디스플레이된 하위 메뉴들(610)에 관련된 정보들로 특정하여 설정할 수 있다.When the activation of the voice recognition function starts, the

상기와 같이 하위 메뉴들이 디스플레이된 상태에서 제어부(180)는 사용자의 음성명령, 또는 터치나 버튼을 입력받아 특정 메뉴(621)를 선택할 수 있다. 상기와 같이 음성명령 또는 터치나 버튼 입력을 받아 특정 메뉴(621)가 선택되면, 제어부(180)는 그 하위 메뉴들을 디스플레이할 수 있다(620).In the state in which the lower menus are displayed as described above, the

상기 하위 메뉴가 디스플레이된 상태(620)에서 자연어 음성명령(예 : I want to see my pictures)이 입력될 경우, 제어부(180)는 상기 음성명령의 내용과 문맥에 따라, 특정 기능이나 메뉴에 관련된 의미 있는 단어 또는 키 워드(예 : see, pictures)를 검출하고, 특정 데이터베이스에서 상기 하위 메뉴들에 관련된 정보들과 비교하여 인식률이 가장 높은 의미를 판단한다.When a natural language voice command (eg, I want to see my pictures) is input in the state in which the sub-menu is displayed 620, the

그리고, 상기 판단된 의미에 관련된 메뉴(예 : photo album)를 실행한다.Then, a menu (eg, photo album) related to the determined meaning is executed.

이때, 상기 메뉴의 정확한 명칭은 "photo album"이지만, 그 메뉴에 관련된 정보로서 "photo, picture, album"과 같은 복수의 정보들이 데이터베이스에 추가로 저장될 수 있다.At this time, the correct name of the menu is "photo album", but a plurality of information such as "photo, picture, album" may be additionally stored in the database as information related to the menu.

또한, 제어부(180)는 단말기의 동작상태나 동작모드(예 : 음성인식 기능을 안내하는 모드)에 따라, 특정 메뉴가 음성명령이나 터치 입력에 의해서 선택되거나 실행될 경우, 제어부(180)는 도6B 내지 도6C에 도시된 바와 같이, 하위 메뉴들에 관련된 도움말 정보를 음성이나 텍스트 형식의 풍선 도움말로 출력할 수 있다.In addition, the

상기 도움말을 출력하는 동작모드는 환경설정 메뉴에 관련된 옵션을 구비하여 설정할 수 있다. 이에 따라, 본 발명은 음성명령에 대한 사용자의 숙련도에 관계없이, 버튼이나 터치 입력 및 음성명령에 의해서 특정 기능이나 서비스에 관련된 메뉴를 제어할 수 있다.The operation mode for outputting the help may be set to include an option related to an environment setting menu. Accordingly, the present invention can control a menu related to a specific function or service by a button or a touch input and a voice command regardless of the user's proficiency with the voice command.

한편, 상기 음성명령의 의미가 복수로 인식된 경우, 즉, 자연어 음성명령에 정확한 메뉴의 명칭이 포함되어 있지 않은 경우, 예를 들어, "멀티미디어" 카테고리에 포함되지만, "카메라", "포토 앨범", "비디오" 중, 사용자가 선택하기를 원하는 메뉴가 정확히 어떤 메뉴에 관련된 것인지 판단되지 않을 경우, 제어부(180)는 특정 값(예 : 80%) 이상의 인식률을 갖는 복수의 메뉴를 표시할 수 있다.On the other hand, when a plurality of meanings of the voice command are recognized, that is, when the natural language voice command does not include the correct menu name, for example, it is included in the "multimedia" category, but "camera" and "photo album" are included. If it is not determined exactly which menu the user wants to select among the "videos" is related to, the

그러나, 특정 값 이상의 인식률을 갖는 메뉴가 둘 미만인 경우에는 해당 기능이나 메뉴를 자동으로 실행시킬 수 있다.However, when there are less than two menus having a recognition rate more than a certain value, the corresponding function or menu can be automatically executed.

도10은 본 발명에 관련된 이동 단말기의 음성명령 인식을 위한 데이터베이스의 구성을 설명하기 위한 예시도이다.10 is an exemplary view for explaining the configuration of a database for voice command recognition of a mobile terminal according to the present invention.

상기 데이터베이스는 음성명령의 의미를 판단하기 위한 정보들을 저장하는 것으로, 그 정보들의 특성에 따라 복수의 데이터베이스를 구성할 수 있다. 상기 정보들의 특성에 따라 구성된 각 데이터베이스는 제어부(180)의 제어를 받아 지속적인 학습을 통해 정보를 업데이트 할 수 있다.The database stores information for determining the meaning of the voice command, and may configure a plurality of databases according to the characteristics of the information. Each database configured according to the characteristics of the information may be updated under continuous learning under the control of the

상기 데이터베이스의 학습이란, 사용자가 발음하는 음성을 그에 해당하는 단어와 대응시키는 것으로, 예를 들어, 사용자가 "생일"이라고 발음했으나 "생활"이 라고 인식되었을 경우, 사용자가 "생활"을 "생일"로 수정해 줌으로써, 이후부터 동일한 발음에 대하여 "생일"로 인식될 수 있도록 학습하는 것이다.The learning of the database is to match the voice of the user with a word corresponding thereto. For example, when the user pronounces "birthday" but recognizes that "life", the user "birthday" By correcting it to "," it will learn to be recognized as "birthday" for the same pronunciation from now on.

상기 학습을 통해 데이터베이스의 각 정보들에 복수의 음성정보가 대응될 수 있다.Through the learning, a plurality of pieces of voice information may correspond to pieces of information in the database.

상기 정보들의 특성에 따른 각 데이터베이스는, 마이크를 통해 입력받은 음성을 음소, 음절, 또는 형태소 단위로 인식하기 위한 음성 정보를 저장하는 제1 데이터베이스(161), 상기 인식된 음성정보를 바탕으로 음성명령의 전체적인 의미를 판단하기 위한 정보(예 : 문법, 발음 정확도, 문장 구조 등)를 저장하는 제2 데이터베이스(162), 이동 단말기에 구비된 기능이나 서비스를 위한 메뉴에 관련된 정보들을 저장하는 제3 데이터베이스(163), 상기 판단된 음성명령의 의미를 사용자로부터 확인받기 위해 단말기에서 출력할 메시지 또는 음성 정보를 저장하는 제4 데이터베이스(164)를 포함할 수 있다.Each database according to the characteristics of the information may include a

상기 제3 데이터베이스(163)는 상술한 음성명령 인식을 위해 설정된 정보범위에 따라, 특정 카테고리의 메뉴들에 관련된 정보로 특정될 수 있다.The

상기 각 데이터베이스에는 음성(발음) 정보 및 그 음성(발음) 정보에 대응하는 음소, 음절, 형태소, 단어, 키 워드, 또는 문장 정보가 저장될 수 있다.Each database may store voice (pronounced) information and phoneme, syllable, morpheme, word, keyword, or sentence information corresponding to the voice (pronounced) information.

따라서, 제어부(180)는 상기 복수의 데이터베이스(161 ~ 164) 중 적어도 어느 하나를 이용하여, 음성명령에 포함된 의미를 판단하는 동작을 수행하고, 그 판단된 음성명령의 의미에 해당하는 기능이나 서비스에 관련된 메뉴를 실행할 수 있다.Accordingly, the

도11은 본 발명에 관련된 이동 단말기에서 음성명령 인식 기능이 수행되고 있음을 표시하는 방법을 설명하기 위한 예시도이다.11 is an exemplary view for explaining a method for indicating that a voice command recognition function is performed in a mobile terminal according to the present invention.

이에 도시된 바와 같이 본 발명은 음성명령 인식 기능이 적용되고 있는 동작상태나 동작모드를 특정 모양의 인디케이터(Indicator, 500)나 아이콘을 이용해 표시할 수 있다. 상기 인디케이터나 아이콘의 출력 시 특정 음향이나 음성을 출력하여 사용자에게 통보할 수 있다.As shown in the drawing, the present invention may display an operation state or operation mode to which a voice command recognition function is applied using an

또한, 본 발명의 일 실시 예에 의하면, 상술한 방법은 프로그램이 기록된 매체에 컴퓨터가 읽을 수 있는 코드로서 구현하는 것이 가능하다. 컴퓨터가 읽을 수 있는 매체는, 컴퓨터 시스템에 의하여 읽혀질 수 있는 데이터가 저장되는 모든 종류의 기록장치를 포함한다. 컴퓨터가 읽을 수 있는 매체의 예로는, ROM, RAM, CD-ROM, 자기 테이프, 플로피 디스크, 광 데이터 저장장치 등이 있으며, 또한 캐리어 웨이브(예를 들어, 인터넷을 통한 전송)의 형태로 구현되는 것도 포함한다. 또한, 상기 컴퓨터는, 단말기의 제어부(180)를 포함할 수도 있다.According to an embodiment of the present invention, the above-described method may be embodied as computer readable code on a medium in which a program is recorded. The computer-readable medium includes all kinds of recording devices in which data that can be read by a computer system is stored. Examples of computer-readable media include ROM, RAM, CD-ROM, magnetic tape, floppy disks, optical data storage devices, and the like, which are also implemented in the form of carrier waves (eg, transmission over the Internet). It also includes. In addition, the computer may include the

상기와 같이 설명된 본 발명의 이동 단말기는 상기 설명된 실시 예들의 구성과 방법이 특정되게 적용될 수 있는 것이 아니라, 상기 실시 예들은 다양한 변형이 이루어질 수 있도록 각 실시 예들의 전부 또는 일부가 선택적으로 조합되어 구성될 수도 있다.In the mobile terminal of the present invention described above, the configuration and method of the embodiments described above may not be specifically applied, but the embodiments may be a combination of all or some of the embodiments selectively so that various modifications may be made. It may be configured.

도 1은 본 발명의 일 실시예와 관련된 이동 단말기의 블록 구성도.1 is a block diagram of a mobile terminal associated with one embodiment of the present invention;

도 2는 본 발명과 관련된 이동 단말기의 일예를 전면에서 바라본 사시도.Figure 2 is a front perspective view of an example of a mobile terminal according to the present invention.

도 3은 도2의 이동 단말기의 후면 사시도.3 is a rear perspective view of the mobile terminal of FIG. 2;

도 4는 본 발명에 관련된 단말기가 동작 가능한 통신 시스템의 예시도.4 is an exemplary diagram of a communication system operable by a terminal according to the present invention;

도 5는 본 발명에 관련된 이동 단말기의 음성을 이용한 메뉴 제어방법을 설명하는 일 예의 흐름도.5 is a flowchart illustrating an example of a method of controlling a menu using voice of a mobile terminal according to the present invention;

도 6a는 본 발명에 관련된 이동 단말기의 음성인식 기능을 활성화하는 방법을 설명하기 위한 예시도.6A is an exemplary diagram for explaining a method of activating a voice recognition function of a mobile terminal according to the present invention;

도 6b와 도 6c는 본 발명에 관련된 이동 단말기의 도움말 정보 출력방법을 설명하기 위한 예시도.6B and 6C are exemplary views for explaining a method of outputting help information of a mobile terminal according to the present invention.

도 7a는 본 발명에 관련된 이동 단말기의 음성명령 인식방법을 설명하기 위한 흐름도.7A is a flowchart for explaining a voice command recognition method of a mobile terminal according to the present invention;

도 7b는 본 발명에 관련된 이동 단말기의 음성인식 방법을 설명하기 위한 예시도.Figure 7b is an exemplary view for explaining a voice recognition method of a mobile terminal according to the present invention.

도 8은 본 발명에 관련된 이동 단말기의 음성 인식률에 따른 메뉴 표시 방법을 설명하기 위한 예시도.8 is an exemplary view for explaining a menu display method according to a voice recognition rate of a mobile terminal according to the present invention.

도 9는 본 발명에 관련된 이동 단말기의 음성명령 인식방법을 설명하기 위한 예시도.9 is an exemplary view for explaining a voice command recognition method of a mobile terminal according to the present invention.

도 10은 본 발명에 관련된 이동 단말기의 음성명령 인식을 위한 데이터베이 스의 구성을 설명하기 위한 예시도.10 is an exemplary view for explaining the configuration of a database for voice command recognition of a mobile terminal according to the present invention.

도 11은 본 발명에 관련된 이동 단말기에서 음성명령 인식 기능이 수행되고 있음을 표시하는 방법을 설명하기 위한 예시도.11 is an exemplary view for explaining a method for indicating that a voice command recognition function is performed in a mobile terminal according to the present invention;

Claims (14)

Translated fromKoreanPriority Applications (9)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020080032841AKR20090107364A (en) | 2008-04-08 | 2008-04-08 | Mobile terminal and its menu control method |

| US12/140,111US8958848B2 (en) | 2008-04-08 | 2008-06-16 | Mobile terminal and menu control method thereof |

| RU2008126780/08ARU2412463C2 (en) | 2008-04-08 | 2008-07-01 | Mobile communication terminal and menu navigation method for said terminal |

| CN2008101279100ACN101557432B (en) | 2008-04-08 | 2008-07-02 | Mobile terminal and menu control method thereof |

| JP2008274952AJP2009253970A (en) | 2008-04-08 | 2008-10-24 | Mobile terminal and menu control method therefor |

| EP08018655.4AEP2109295B1 (en) | 2008-04-08 | 2008-10-24 | Mobile terminal and menu control method thereof |

| US14/594,959US9497305B2 (en) | 2008-04-08 | 2015-01-12 | Mobile terminal and menu control method thereof |

| US15/282,523US9692865B2 (en) | 2008-04-08 | 2016-09-30 | Mobile terminal and menu control method thereof |

| US15/601,922US9900414B2 (en) | 2008-04-08 | 2017-05-22 | Mobile terminal and menu control method thereof |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020080032841AKR20090107364A (en) | 2008-04-08 | 2008-04-08 | Mobile terminal and its menu control method |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| KR20090107364Atrue KR20090107364A (en) | 2009-10-13 |

Family

ID=41175373

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020080032841ACeasedKR20090107364A (en) | 2008-04-08 | 2008-04-08 | Mobile terminal and its menu control method |

Country Status (2)

| Country | Link |

|---|---|

| KR (1) | KR20090107364A (en) |

| CN (1) | CN101557432B (en) |

Cited By (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20140064118A (en)* | 2012-11-19 | 2014-05-28 | 엘지전자 주식회사 | Mobil terminal and operating method for the same |

| KR20160125190A (en)* | 2015-04-21 | 2016-10-31 | 삼성전자주식회사 | Electronic apparatus for displaying screen and method for controlling thereof |

Families Citing this family (143)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US8677377B2 (en) | 2005-09-08 | 2014-03-18 | Apple Inc. | Method and apparatus for building an intelligent automated assistant |

| US10002189B2 (en) | 2007-12-20 | 2018-06-19 | Apple Inc. | Method and apparatus for searching using an active ontology |

| US9330720B2 (en) | 2008-01-03 | 2016-05-03 | Apple Inc. | Methods and apparatus for altering audio output signals |

| US10496753B2 (en) | 2010-01-18 | 2019-12-03 | Apple Inc. | Automatically adapting user interfaces for hands-free interaction |

| US20100030549A1 (en) | 2008-07-31 | 2010-02-04 | Lee Michael M | Mobile device having human language translation capability with positional feedback |

| US8676904B2 (en) | 2008-10-02 | 2014-03-18 | Apple Inc. | Electronic devices with voice command and contextual data processing capabilities |

| CN102056021A (en)* | 2009-11-04 | 2011-05-11 | 李峰 | Chinese and English command-based man-machine interactive system and method |

| US10553209B2 (en) | 2010-01-18 | 2020-02-04 | Apple Inc. | Systems and methods for hands-free notification summaries |

| US10679605B2 (en) | 2010-01-18 | 2020-06-09 | Apple Inc. | Hands-free list-reading by intelligent automated assistant |

| US10276170B2 (en) | 2010-01-18 | 2019-04-30 | Apple Inc. | Intelligent automated assistant |

| US10705794B2 (en) | 2010-01-18 | 2020-07-07 | Apple Inc. | Automatically adapting user interfaces for hands-free interaction |

| US9413869B2 (en) | 2010-02-10 | 2016-08-09 | Qualcomm Incorporated | Mobile device having plurality of input modes |

| US8682667B2 (en) | 2010-02-25 | 2014-03-25 | Apple Inc. | User profiling for selecting user specific voice input processing information |

| CN101931701A (en)* | 2010-08-25 | 2010-12-29 | 宇龙计算机通信科技(深圳)有限公司 | Method, system and mobile terminal for prompting contact information in communication process |

| CN102467336B (en)* | 2010-11-19 | 2013-10-30 | 联想(北京)有限公司 | Electronic equipment and object selection method thereof |

| CN102685307A (en)* | 2011-03-15 | 2012-09-19 | 中兴通讯股份有限公司 | Method, device and system for processing command information |

| US9262612B2 (en) | 2011-03-21 | 2016-02-16 | Apple Inc. | Device access using voice authentication |

| US10057736B2 (en) | 2011-06-03 | 2018-08-21 | Apple Inc. | Active transport based notifications |

| US20130143525A1 (en)* | 2011-12-02 | 2013-06-06 | The Boeing Company | Point of Use Verified Aircraft Assembly Time Collection |

| US8793136B2 (en)* | 2012-02-17 | 2014-07-29 | Lg Electronics Inc. | Method and apparatus for smart voice recognition |

| KR101889836B1 (en)* | 2012-02-24 | 2018-08-20 | 삼성전자주식회사 | Method and apparatus for cotrolling lock/unlock state of terminal through voice recognition |

| US10134385B2 (en) | 2012-03-02 | 2018-11-20 | Apple Inc. | Systems and methods for name pronunciation |

| CN103366743A (en)* | 2012-03-30 | 2013-10-23 | 北京千橡网景科技发展有限公司 | Voice-command operation method and device |

| KR20240045365A (en) | 2012-05-11 | 2024-04-05 | 가부시키가이샤 한도오따이 에네루기 켄큐쇼 | Electronic device, storage medium, program, and displaying method |

| US10417037B2 (en) | 2012-05-15 | 2019-09-17 | Apple Inc. | Systems and methods for integrating third party services with a digital assistant |

| US9721563B2 (en) | 2012-06-08 | 2017-08-01 | Apple Inc. | Name recognition system |

| CN103514882B (en)* | 2012-06-30 | 2017-11-10 | 北京百度网讯科技有限公司 | A kind of audio recognition method and system |

| US9093072B2 (en)* | 2012-07-20 | 2015-07-28 | Microsoft Technology Licensing, Llc | Speech and gesture recognition enhancement |

| CN103593134B (en)* | 2012-08-17 | 2018-01-23 | 上海博泰悦臻电子设备制造有限公司 | The control method of mobile unit and phonetic function |

| CN103593081B (en)* | 2012-08-17 | 2017-11-07 | 上海博泰悦臻电子设备制造有限公司 | The control method of mobile unit and phonetic function |

| US10042603B2 (en) | 2012-09-20 | 2018-08-07 | Samsung Electronics Co., Ltd. | Context aware service provision method and apparatus of user device |

| KR102070196B1 (en) | 2012-09-20 | 2020-01-30 | 삼성전자 주식회사 | Method and apparatus for providing context aware service in a user device |

| CN103885661A (en)* | 2012-12-20 | 2014-06-25 | 联想(北京)有限公司 | Control method and control device |

| CN103064530B (en)* | 2012-12-31 | 2017-03-08 | 华为技术有限公司 | input processing method and device |

| DE212014000045U1 (en) | 2013-02-07 | 2015-09-24 | Apple Inc. | Voice trigger for a digital assistant |

| KR102057629B1 (en) | 2013-02-19 | 2020-01-22 | 엘지전자 주식회사 | Mobile terminal and method for controlling of the same |

| US9691382B2 (en)* | 2013-03-01 | 2017-06-27 | Mediatek Inc. | Voice control device and method for deciding response of voice control according to recognized speech command and detection output derived from processing sensor data |

| CN104049722B (en)* | 2013-03-11 | 2017-07-25 | 联想(北京)有限公司 | A kind of information processing method and electronic equipment |

| CN104077105B (en)* | 2013-03-29 | 2018-04-27 | 联想(北京)有限公司 | An information processing method and an electronic device |

| US20140337031A1 (en)* | 2013-05-07 | 2014-11-13 | Qualcomm Incorporated | Method and apparatus for detecting a target keyword |

| WO2014197335A1 (en) | 2013-06-08 | 2014-12-11 | Apple Inc. | Interpreting and acting upon commands that involve sharing information with remote devices |

| WO2014197730A1 (en)* | 2013-06-08 | 2014-12-11 | Apple Inc. | Application gateway for providing different user interfaces for limited distraction and non-limited distraction contexts |

| DE112014002747T5 (en) | 2013-06-09 | 2016-03-03 | Apple Inc. | Apparatus, method and graphical user interface for enabling conversation persistence over two or more instances of a digital assistant |

| US10176167B2 (en) | 2013-06-09 | 2019-01-08 | Apple Inc. | System and method for inferring user intent from speech inputs |

| CN103699293A (en)* | 2013-12-02 | 2014-04-02 | 联想(北京)有限公司 | Operation method and electronic equipment |

| US10296160B2 (en) | 2013-12-06 | 2019-05-21 | Apple Inc. | Method for extracting salient dialog usage from live data |

| KR102218906B1 (en)* | 2014-01-17 | 2021-02-23 | 엘지전자 주식회사 | Mobile terminal and controlling method thereof |

| CN103885596B (en)* | 2014-03-24 | 2017-05-24 | 联想(北京)有限公司 | Information processing method and electronic device |

| US9715875B2 (en) | 2014-05-30 | 2017-07-25 | Apple Inc. | Reducing the need for manual start/end-pointing and trigger phrases |

| CN110797019B (en) | 2014-05-30 | 2023-08-29 | 苹果公司 | Multi-command single speech input method |

| US9430463B2 (en) | 2014-05-30 | 2016-08-30 | Apple Inc. | Exemplar-based natural language processing |

| US9633004B2 (en) | 2014-05-30 | 2017-04-25 | Apple Inc. | Better resolution when referencing to concepts |

| US10170123B2 (en) | 2014-05-30 | 2019-01-01 | Apple Inc. | Intelligent assistant for home automation |

| CN104239043B (en)* | 2014-09-04 | 2017-10-31 | 百度在线网络技术(北京)有限公司 | The execution method and apparatus of instruction |

| US9818400B2 (en) | 2014-09-11 | 2017-11-14 | Apple Inc. | Method and apparatus for discovering trending terms in speech requests |

| US10127911B2 (en) | 2014-09-30 | 2018-11-13 | Apple Inc. | Speaker identification and unsupervised speaker adaptation techniques |

| US9668121B2 (en) | 2014-09-30 | 2017-05-30 | Apple Inc. | Social reminders |

| US10074360B2 (en) | 2014-09-30 | 2018-09-11 | Apple Inc. | Providing an indication of the suitability of speech recognition |

| CN104715754A (en)* | 2015-03-05 | 2015-06-17 | 北京华丰亨通科贸有限公司 | Method and device for rapidly responding to voice commands |

| US10152299B2 (en) | 2015-03-06 | 2018-12-11 | Apple Inc. | Reducing response latency of intelligent automated assistants |

| US10567477B2 (en) | 2015-03-08 | 2020-02-18 | Apple Inc. | Virtual assistant continuity |

| US9886953B2 (en) | 2015-03-08 | 2018-02-06 | Apple Inc. | Virtual assistant activation |

| US9721566B2 (en) | 2015-03-08 | 2017-08-01 | Apple Inc. | Competing devices responding to voice triggers |

| US10460227B2 (en) | 2015-05-15 | 2019-10-29 | Apple Inc. | Virtual assistant in a communication session |

| US10083688B2 (en) | 2015-05-27 | 2018-09-25 | Apple Inc. | Device voice control for selecting a displayed affordance |

| US9578173B2 (en) | 2015-06-05 | 2017-02-21 | Apple Inc. | Virtual assistant aided communication with 3rd party service in a communication session |

| US11025565B2 (en) | 2015-06-07 | 2021-06-01 | Apple Inc. | Personalized prediction of responses for instant messaging |

| US20160378747A1 (en) | 2015-06-29 | 2016-12-29 | Apple Inc. | Virtual assistant for media playback |

| CN105094331B (en)* | 2015-07-27 | 2018-08-07 | 联想(北京)有限公司 | A kind of information processing method and electronic equipment |

| CN105208204A (en)* | 2015-08-27 | 2015-12-30 | 北京羽乐创新科技有限公司 | Communication service processing method and apparatus |

| US10956666B2 (en) | 2015-11-09 | 2021-03-23 | Apple Inc. | Unconventional virtual assistant interactions |

| US10049668B2 (en) | 2015-12-02 | 2018-08-14 | Apple Inc. | Applying neural network language models to weighted finite state transducers for automatic speech recognition |

| CN105573582A (en)* | 2015-12-14 | 2016-05-11 | 魅族科技(中国)有限公司 | Display method and terminal |

| US10223066B2 (en) | 2015-12-23 | 2019-03-05 | Apple Inc. | Proactive assistance based on dialog communication between devices |

| CN105679315A (en)* | 2016-03-22 | 2016-06-15 | 谢奇 | Voice-activated and voice-programmed control method and control system |

| CN105976157A (en)* | 2016-04-25 | 2016-09-28 | 中兴通讯股份有限公司 | Task creating method and task creating device |

| US11227589B2 (en) | 2016-06-06 | 2022-01-18 | Apple Inc. | Intelligent list reading |

| US10049663B2 (en) | 2016-06-08 | 2018-08-14 | Apple, Inc. | Intelligent automated assistant for media exploration |

| US10586535B2 (en) | 2016-06-10 | 2020-03-10 | Apple Inc. | Intelligent digital assistant in a multi-tasking environment |

| DK179415B1 (en) | 2016-06-11 | 2018-06-14 | Apple Inc | Intelligent device arbitration and control |

| DK201670540A1 (en) | 2016-06-11 | 2018-01-08 | Apple Inc | Application integration with a digital assistant |

| US10474753B2 (en) | 2016-09-07 | 2019-11-12 | Apple Inc. | Language identification using recurrent neural networks |

| US10043516B2 (en) | 2016-09-23 | 2018-08-07 | Apple Inc. | Intelligent automated assistant |

| US11281993B2 (en) | 2016-12-05 | 2022-03-22 | Apple Inc. | Model and ensemble compression for metric learning |

| US11204787B2 (en) | 2017-01-09 | 2021-12-21 | Apple Inc. | Application integration with a digital assistant |

| CN106683675A (en)* | 2017-02-08 | 2017-05-17 | 张建华 | Control method and voice operating system |

| US10417266B2 (en) | 2017-05-09 | 2019-09-17 | Apple Inc. | Context-aware ranking of intelligent response suggestions |

| DK201770383A1 (en) | 2017-05-09 | 2018-12-14 | Apple Inc. | User interface for correcting recognition errors |

| DK201770439A1 (en) | 2017-05-11 | 2018-12-13 | Apple Inc. | Offline personal assistant |

| US10726832B2 (en) | 2017-05-11 | 2020-07-28 | Apple Inc. | Maintaining privacy of personal information |

| US10395654B2 (en) | 2017-05-11 | 2019-08-27 | Apple Inc. | Text normalization based on a data-driven learning network |

| DK179496B1 (en) | 2017-05-12 | 2019-01-15 | Apple Inc. | USER-SPECIFIC Acoustic Models |

| US11301477B2 (en) | 2017-05-12 | 2022-04-12 | Apple Inc. | Feedback analysis of a digital assistant |

| DK179745B1 (en) | 2017-05-12 | 2019-05-01 | Apple Inc. | SYNCHRONIZATION AND TASK DELEGATION OF A DIGITAL ASSISTANT |

| DK201770427A1 (en) | 2017-05-12 | 2018-12-20 | Apple Inc. | Low-latency intelligent automated assistant |

| DK201770431A1 (en) | 2017-05-15 | 2018-12-20 | Apple Inc. | Optimizing dialogue policy decisions for digital assistants using implicit feedback |

| DK201770432A1 (en) | 2017-05-15 | 2018-12-21 | Apple Inc. | Hierarchical belief states for digital assistants |

| US10311144B2 (en) | 2017-05-16 | 2019-06-04 | Apple Inc. | Emoji word sense disambiguation |

| US10403278B2 (en) | 2017-05-16 | 2019-09-03 | Apple Inc. | Methods and systems for phonetic matching in digital assistant services |

| DK179549B1 (en) | 2017-05-16 | 2019-02-12 | Apple Inc. | Far-field extension for digital assistant services |

| US10303715B2 (en) | 2017-05-16 | 2019-05-28 | Apple Inc. | Intelligent automated assistant for media exploration |

| US10657328B2 (en) | 2017-06-02 | 2020-05-19 | Apple Inc. | Multi-task recurrent neural network architecture for efficient morphology handling in neural language modeling |

| CN107544827A (en)* | 2017-08-23 | 2018-01-05 | 金蝶软件(中国)有限公司 | The method and relevant apparatus of a kind of funcall |

| US10445429B2 (en) | 2017-09-21 | 2019-10-15 | Apple Inc. | Natural language understanding using vocabularies with compressed serialized tries |

| US10755051B2 (en) | 2017-09-29 | 2020-08-25 | Apple Inc. | Rule-based natural language processing |

| US10636424B2 (en) | 2017-11-30 | 2020-04-28 | Apple Inc. | Multi-turn canned dialog |