KR102352477B1 - Video analysis system capable of determining false detection of fire sensor - Google Patents

Video analysis system capable of determining false detection of fire sensorDownload PDFInfo

- Publication number

- KR102352477B1 KR102352477B1KR1020210126129AKR20210126129AKR102352477B1KR 102352477 B1KR102352477 B1KR 102352477B1KR 1020210126129 AKR1020210126129 AKR 1020210126129AKR 20210126129 AKR20210126129 AKR 20210126129AKR 102352477 B1KR102352477 B1KR 102352477B1

- Authority

- KR

- South Korea

- Prior art keywords

- fire

- camera

- detection

- image

- grid

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

- G—PHYSICS

- G08—SIGNALLING

- G08B—SIGNALLING OR CALLING SYSTEMS; ORDER TELEGRAPHS; ALARM SYSTEMS

- G08B17/00—Fire alarms; Alarms responsive to explosion

- G08B17/12—Actuation by presence of radiation or particles, e.g. of infrared radiation or of ions

- G08B17/125—Actuation by presence of radiation or particles, e.g. of infrared radiation or of ions by using a video camera to detect fire or smoke

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/10—Segmentation; Edge detection

- G06T7/12—Edge-based segmentation

- H04N5/23296—

- H04N5/23299—

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N7/00—Television systems

- H04N7/18—Closed-circuit television [CCTV] systems, i.e. systems in which the video signal is not broadcast

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Signal Processing (AREA)

- Business, Economics & Management (AREA)

- Emergency Management (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Theoretical Computer Science (AREA)

- Fire-Detection Mechanisms (AREA)

- Alarm Systems (AREA)

Abstract

Translated fromKoreanDescription

Translated fromKorean본 발명은 화재 오검지 조건을 고도화하여 환경 요인에 의한 오검지 확률은 낮으며 화재 감지기의 오작동을 검출할 수 있는 영상 분석 기반의 화재 검출 기술에 관한 것이다.The present invention relates to an image analysis-based fire detection technology capable of detecting a malfunction of a fire detector with a low probability of false detection due to environmental factors by upgrading the fire false detection condition.

화재 감지기는 열, 연기, 불꽃 등을 검출할 수 있다. 화염이나 연기를 검출하면, 화재 감지기는 검출 신호를 발생하여 소방 수신기 및 소방 중계기를 통해 건물 내에 화재 신호를 송출할 뿐 아니라, 관제 서버에 검출 신호를 전송한다. 소방 관련 법규에 따르면, 화재 감지기는 공동 주택, 오피스텔, 숙박시설 같은 건물에 반드시 설치되어야 하며, 복도에는 30 미터마다 그리고 계단의 경우 수직거리 15미터마다 설치되어야 한다.A fire detector can detect heat, smoke, flame, and the like. When flame or smoke is detected, the fire detector not only generates a detection signal and transmits a fire signal in the building through a fire receiver and a fire repeater, but also transmits a detection signal to the control server. According to fire-fighting regulations, fire detectors must be installed in buildings such as multi-unit dwellings, officetels, and lodging facilities, every 30 meters in hallways and every 15 meters in vertical distance in the case of stairs.

센서 기반의 화재 감지기는 도입이 용이한 반면 에러율 보정이 어렵고 다양한 문제를 야기한다. 화재 감지기의 빈번한 오작동은 안전 불감증을 증가시키며, 소방 인력이 실제로 필요한 상황에 적절히 대응할 수 없게 만드는 요인이다. 장마철의 높은 습도, 무더운 날씨로 인해 밀폐된 공간의 급격한 온도 상승 또는 요리할 때 발생하는 연기 등은 화재 감지기 오작동의 주요 원인으로 파악되고 있다. 이외에도 화재 감지기 내부에 쌓인 먼지도 화재 감지기의 오작동을 유발하는 원인이다. 화재 감지기는 화재를 조기에 검출하여 신속한 진화를 가능하게 하며, 입주민이 대피할 시간을 충분히 가질 수 있게 하는 중요한 장치이다. 그러나 잦은 오작동은 입주민의 경계심을 풀어지게 하여 실제 화재 발생시 인명 피해를 초래할 수 있다. 또한 소방 담당자는 화재 감지기의 오작동 여부와 상관 없이 화재 신호가 발생하면 현장에 가서 화재 발생 가능성을 파악하여야 한다.The sensor-based fire detector is easy to introduce, but it is difficult to correct the error rate and causes various problems. The frequent malfunction of fire detectors increases the sense of safety, and is a factor that makes it impossible for firefighters to adequately respond to actual needs. High humidity during the monsoon season, rapid temperature rise in an enclosed space due to hot weather, or smoke generated during cooking are identified as major causes of malfunction of fire detectors. In addition, dust accumulated inside the fire detector is also a cause of malfunction of the fire detector. A fire detector is an important device that detects a fire early, enables rapid extinguishing, and allows residents to have sufficient time to evacuate. However, frequent malfunctions can relieve the occupants' vigilance and cause loss of life in case of an actual fire. In addition, firefighters should go to the site and determine the possibility of a fire when a fire signal occurs regardless of whether the fire detector is malfunctioning.

한편 종래의 영상 분석을 통한 화재 감지 방식의 대부분은 오픈 소스 기반의 단순 검출방식이기 때문에, 정확도가 낮고 빈번한 오검지가 발생한다. 따라서 영상 분석에 의한 화재 검출 방식의 고도화가 요구되고 있다.On the other hand, since most of the conventional fire detection methods through image analysis are open source-based simple detection methods, the accuracy is low and frequent false detections occur. Therefore, there is a demand for upgrading the fire detection method by image analysis.

본 발명의 실시예는 건물을 포함한 다양한 장소에서 빈번하게 발생하는 화재 오검지와 실제 화재를 구분할 수 있는 화재 검출 시스템을 제공하고자 한다. 한편, 화재 감지기의 오작동을 식별할 수 있는 화재 검출 시스템을 제공하고자 한다.SUMMARY OF THE INVENTION An embodiment of the present invention is to provide a fire detection system capable of distinguishing between an actual fire and a false fire detection that frequently occurs in various places including a building. Meanwhile, an object of the present invention is to provide a fire detection system capable of identifying a malfunction of a fire detector.

본 발명의 일측면에 따르면, 화재 오검지 조건을 고도화한 화재 검출 시스템이 제공된다. 화재 검출 시스템은 감시 공간을 촬영하는 카메라, 상기 카메라가 제공한 정상 상태 영상을 m x n 그리드로 분할하며, 분할된 그리드별로 빅데이터 학습을 수행하여 상기 정상 상태에서 검출되는 특징에 대한 정상 프로파일을 그리드별로 생성하는 그리드기반 빅데이터 모듈 및 상기 카메라가 제공하는 실시간 영상의 m x n 그리드 중에서 화재 후보영역을 검출하며, 검출된 화재 후보영역에서 검출된 특징과 상기 검출된 화재 후보영역의 정상 프로파일을 비교하여 화재 발생을 확정하는 화재 검출 모듈을 포함할 수 있다.According to one aspect of the present invention, there is provided a fire detection system with advanced fire false detection conditions. The fire detection system divides the steady state image provided by the camera and the camera for capturing the surveillance space into mxn grids, and performs big data learning for each divided grid to generate the normal profile for the features detected in the normal state by grid. Detects a fire candidate area from the mxn grid of the real-time image provided by the grid-based big data module and the camera, and compares the features detected in the detected fire candidate area with the normal profile of the detected fire candidate area to generate a fire It may include a fire detection module to determine.

일 실시예로, 상기 화재 검출 모듈은 상기 화재 후보영역 중 화재와 유사한 특징을 가진 화재 후보영역을 제거하는 오검지 필터링을 수행할 수 있다.In an embodiment, the fire detection module may perform false detection filtering to remove a fire candidate area having characteristics similar to fire among the fire candidate areas.

일 실시예로, 상기 그리드기반 빅데이터 모듈 및 상기 화재 검출 모듈은 상기 감시 공간에 설치된 지능형 에지장치를 구성하며, 화재 검출 시스템은 상기 지능형 에지장치가 영상을 분석하여 생성한 메타 데이터를 통신망을 통해 수신하며, 상기 메타 데이터를 분석하여 화재 발생을 확정하는 에지기반 화재 검출 서버를 더 포함할 수 있다.In one embodiment, the grid-based big data module and the fire detection module constitute an intelligent edge device installed in the monitoring space, and the fire detection system transmits metadata generated by the intelligent edge device by analyzing an image through a communication network. It may further include an edge-based fire detection server that receives and analyzes the metadata to determine the occurrence of a fire.

일 실시예로, 상기 정상 프로파일은 상기 정상 상태 영상에서 시간별로 식별되는 특징일 수 있다.In an embodiment, the normal profile may be a feature identified by time in the normal state image.

일 실시예로, 상기 그리드기반 빅데이터 모듈은 상기 정상 프로파일은 지속적으로 갱신할 수 있다.In an embodiment, the grid-based big data module may continuously update the normal profile.

일 실시예로, 화재 검출 시스템은 상기 감시 공간에 설치된 복수의 화재 감지기 중 어느 하나가 화재 신호를 발생하면 상기 화재 신호를 발생한 구역에 설치된 카메라를 제어하여 상기 감시 공간을 스캔하도록 하는 카메라 제어 모듈을 더 포함할 수 있다.In one embodiment, the fire detection system includes a camera control module that, when any one of a plurality of fire detectors installed in the monitoring space generates a fire signal, controls a camera installed in the area where the fire signal is generated to scan the monitoring space. may include more.

일 실시예로, 상기 화재 신호를 발생한 구역에 설치된 카메라는 PTZ(Pan-tilt-zoom) 카메라이며, 상기 스캔은 상기 PTZ 카메라를 회전 및 틸팅하도록 제어하여 상기 화재 신호 발생시 시야에 포함되지 않은 공간을 촬영할 수 있다.In one embodiment, the camera installed in the area where the fire signal is generated is a PTZ (Pan-tilt-zoom) camera, and the scan controls the PTZ camera to rotate and tilt to detect a space not included in the field of view when the fire signal occurs. can be filmed

일 실시예로, 화재 검출 시스템은 상기 실시간 영상에서 하나 이상의 객체를 검출하는 객체 검출 모듈 및 검출된 객체, 객체의 움직임 및 객체의 주변 환경 중 어느 하나 또는 이들의 조합에 기초하여, 이벤트 조건에 부합하는 이벤트를 검출하는 이벤트 검출 모듈을 더 포함할 수 있다.In one embodiment, the fire detection system meets an event condition based on any one or a combination of an object detection module for detecting one or more objects in the real-time image, the detected object, the movement of the object, and the surrounding environment of the object. It may further include an event detection module for detecting an event to be performed.

일 실시예로, 상기 카메라 제어 모듈은 상기 화재 신호가 발생한 감시 공간의 주변에 설치된 카메라가 상기 감시 공간을 스캔하도록 제어하며, 상기 화재 검출 모듈은 상기 화재 신호가 발생한 감시 공간 및 상기 주변을 스캔 중에 촬영한 복수의 영상을 분석하여 상기 화재 신호를 오작동 화재 신호 및 실제 화재 신호 중 어느 하나로 식별할 수 있다.In an embodiment, the camera control module controls a camera installed in the vicinity of the monitoring space where the fire signal is generated to scan the monitoring space, and the fire detection module scans the monitoring space and the surroundings where the fire signal is generated. By analyzing a plurality of captured images, the fire signal may be identified as one of a malfunctioning fire signal and an actual fire signal.

본 발명에 따르면, 영상 분석을 이용하여 화재 검출 시스템의 오검지율을 크게 감소시킬 수 있다. 또한, 화재 신호 발생시 실제 화재 발생 여부를 영상 분석을 통해 확인할 수 있게 되어, 화재 감지기의 오작동으로 인한 부작용을 현저히 감소시킬 수 있다.According to the present invention, it is possible to significantly reduce the false detection rate of the fire detection system using image analysis. In addition, when a fire signal is generated, it is possible to check whether an actual fire has occurred through image analysis, thereby remarkably reducing side effects due to malfunction of the fire detector.

이하에서 본 발명은 첨부된 도면에 도시된 실시예를 참조하여 설명된다. 이해를 돕기 위해, 첨부된 전체 도면에 걸쳐, 동일한 구성 요소에는 동일한 도면 부호가 할당되었다. 첨부된 도면에 도시된 구성은 본 발명을 설명하기 위해 예시적으로 구현된 실시예에 불과하며, 본 발명의 범위를 이에 한정하기 위한 것은 아니다. 특히, 첨부된 도면들은 발명의 이해를 돕기 위해서, 도면에 표현된 요소 중 일부를 다소 과장하여 표현하고 있다.

도 1은 건물에 설치된 소방 시스템 및 화재 검출 시스템을 예시적으로 도시한 도면이다.

도 2는 화재 감지기의 오작동을 검출하는 화재 검출 시스템을 예시적으로 도시한 도면이다.

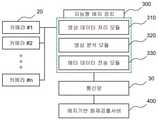

도 3은 화재 감지기의 오작동을 검출하는 과정을 예시적으로 도시한 도면이다.

도 4는 고도화된 화재 오검지 조건을 예시적으로 설명하기 위한 도면이다.

도 5는 도 2에 도시된 화재검출서버를 기능적으로 도시한 도면이다.

도 6은 도 2에 도시된 지능형 에지장치를 기능적으로 도시한 도면이다.DETAILED DESCRIPTION OF THE PREFERRED EMBODIMENTS Hereinafter, the present invention will be described with reference to the embodiments shown in the accompanying drawings. For ease of understanding, like elements have been assigned like reference numerals throughout the accompanying drawings. The configuration shown in the accompanying drawings is merely an exemplary embodiment for explaining the present invention, and is not intended to limit the scope of the present invention. In particular, in the accompanying drawings, some of the elements represented in the drawings are somewhat exaggerated to help the understanding of the invention.

1 is a view illustrating a fire fighting system and a fire detection system installed in a building by way of example.

2 is a diagram exemplarily illustrating a fire detection system for detecting a malfunction of a fire detector.

3 is a diagram exemplarily illustrating a process of detecting a malfunction of a fire detector.

4 is a view for explaining an advanced fire false detection condition by way of example.

FIG. 5 is a functional diagram illustrating the fire detection server shown in FIG. 2 .

FIG. 6 is a functional diagram illustrating the intelligent edge device shown in FIG. 2 .

본 발명은 다양한 변경을 가할 수 있고 여러 가지 실시예를 가질 수 있는 바, 특정 실시예들을 도면에 예시하고 이를 상세한 설명을 통해 상세히 설명하고자 한다. 그러나 이는 본 발명을 특정한 실시 형태에 대해 한정하려는 것이 아니며, 본 발명의 사상 및 기술 범위에 포함되는 모든 변경, 균등물 내지 대체물을 포함하는 것으로 이해되어야 한다. 특히, 이하에서 첨부된 도면을 참조하여 설명될 기능, 특징, 실시예들은 단독으로 또는 다른 실시예와 결합하여 구현될 수 있다. 따라서 본 발명의 범위가 첨부된 도면에 도시된 형태에만 한정되는 것이 아님을 유의하여야 한다.Since the present invention can have various changes and can have various embodiments, specific embodiments are illustrated in the drawings and will be described in detail through the detailed description. However, this is not intended to limit the present invention to specific embodiments, and it should be understood to include all modifications, equivalents, and substitutes included in the spirit and scope of the present invention. In particular, functions, features, and embodiments to be described below with reference to the accompanying drawings may be implemented alone or in combination with other embodiments. Therefore, it should be noted that the scope of the present invention is not limited to the forms shown in the accompanying drawings.

첨부된 도면 전체에 걸쳐서, 동일하거나 유사한 요소는 동일한 도면 부호를 사용하여 인용된다.Throughout the appended drawings, identical or similar elements are referenced using the same reference numerals.

도 1은 건물에 설치된 소방 시스템 및 화재 검출 시스템을 예시적으로 도시한 도면이다.1 is a view illustrating a fire fighting system and a fire detection system installed in a building by way of example.

도 1을 참조하면, 화재 감지기(30) 및 카메라(20)가 건물 실내에 설치되어 있다. 소방 시스템은 건물에서 발생한 화재를 감지하여 화재 신호를 전송하는 화재 감지기(30) 및 화재 신호를 수신하며 이를 관제 단말(미도시)에 표출하는 관제 서버(40)를 포함한다. 한편, 카메라(20)는 건물뿐 아니라 다양한 감시 공간, 예를 들어, 도로, 산 등을 촬영할 수 있다.Referring to FIG. 1 , a

화재 감지기(30)는, 열이나 연기, 불꽃을 직접 감지할 수 있다. 차동식, 보상식, 또는 정온식 감지기는 설치 위치의 온도에 따라 동작하여 열을 감지한다. 이온화식, 광전식, 공기 흡입식 감지기는 연기로 인한 전기적 특성 변화를 이용하여 연기를 감지한다. 자외선식, 또는 적외선식 감지기는 화재시 발생하는 빛을 검출하여 불꽃을 감지한다. 동일 구역에 설치된 복수의 화재 감지기(30)는 동일한 중계기 또는 공통선을 통해 화재 신호를 소방 수신기로 전달한다. 이를 통해 어느 구역에서 화재가 발생하였는지를 파악할 수는 있지만, 구역 내 어느 위치에서 화재가 발생하였는지를 파악할 수는 없다.The

화재 감지기(30)가 생성한 화재 신호는 건물의 소방 수신기를 통해 관제 서버(40)로 전달된다. 관제 서버(40)는 공동 주택 단지나 상업용 건물의 관리실 등에 위치하여 해당 단지나 건물만 관리할 수도 있으며, 통신망을 통해 원격지에 위치하며 다수의 공동 주택 단지나 건물을 관리할 수도 있다.The fire signal generated by the

화재 검출 시스템은 건물의 보안, 안전, 에너지 관리 등의 목적으로 촬영된 영상을 분석할 수 있다. 화재 검출 시스템은 관심 영역을 촬영하여 영상을 출력하는 카메라(20), 복수의 카메라(20)로부터 수신한 영상을 분석하여 객체 관련 이벤트를 검출하며 검출된 이벤트에 대한 메타 데이터를 생성하는 지능형 에지장치(300) 및 에지기반 화재 검출 서버(400)를 포함할 수 있다. 카메라(20)는 2차원 영상 또는 3차원 영상을 생성하는 CCTV, IP 카메라 등을 포함하며, 고정식 카메라나 PTZ(Pan-Tlit-Zoom) 카메라를 모두 포함할 수 있다. 한편, 영상 분석 시스템의 다른 구성은 도 2를 참조하여 설명한다.The fire detection system may analyze the captured image for the purpose of building security, safety, energy management, and the like. The fire detection system detects an object-related event by analyzing an image received from a

화재 검출 시스템은 영상에서 객체를 식별하며 식별된 객체에 연관된 이벤트를 검출한다. 객체는 분석을 위해서 영상에서 식별되는 대상으로, 사람, 차량, 동물 등과 같이 이벤트로 검출되는 행위를 하는 물체뿐 아니라, 사무용 가구, 화분 등과 같이 설치 위치나 상태만 분석에 이용되는 물체를 포함할 수 있다. 특히, 화재 검출 시스템은 화재 이벤트를 검출할 수 있어서 화재 감지기의 오작동을 조기에 판단할 수 있다.The fire detection system identifies an object in the image and detects an event associated with the identified object. An object is an object identified in an image for analysis, and may include not only objects that are detected as events, such as people, vehicles, animals, etc. have. In particular, the fire detection system can detect a fire event so that a malfunction of the fire detector can be determined early.

한편, 건물 내부에 설치된 카메라(20)는 다양한 목적을 위해 공용 공간 및 전용 공간을 촬영한 영상을 이미 제공하고 있으므로, 화재 감지기 오작동을 검출하기 위해서 신규 설비의 설치가 요구되지 않을 수 있다.On the other hand, since the

도 2는 화재 감지기의 오작동을 검출하는 과정을 예시적으로 도시한 도면이다. 도 2의 (a)는 영상을 화재 검출 서버로 전달하여 분석하는 영상 분석 시스템을 나타내며, (b)는 카메라가 설치된 지역에서 영상을 분석한 후 메타 데이터를 에지 기반 화재 검출 서버로 전달하는 영상 분석 시스템을 각각 나타낸다.2 is a diagram exemplarily illustrating a process of detecting a malfunction of a fire detector. (a) of FIG. 2 shows an image analysis system that transmits an image to a fire detection server and analyzes it, and (b) shows an image analysis system that analyzes the image in the area where the camera is installed and then delivers metadata to the edge-based fire detection server represents each system.

화재 감지기(30)가 화재 신호를 발생한다. 화재 신호는 열, 연기, 및 불꽃 중 적어도 어느 하나로 검출되는 실제 화재로 인해 발생할 수 있지만(이하 실제 화재 신호), 단순한 온도 상승, 음식 조리시 생긴 연기, 또는 먼지와 같이 화재가 아님에도 발생할 수 있다(이하 오작동 화재 신호). 한편, 화재 신호는 화재 감지기(30) 고장시에도 발생할 수 있다. 따라서 화재 신호가 발생한 시점에서, 해당 화재 신호가 실제 화재 신호인지 아니면 오작동 화재 신호인지는 판단하기 어렵다. 또한, 복수의 화재 감지기(30)가 동일한 소방 중계기 또는 공통선을 통해 화재 신호를 소방 수신기에 전달하기 때문에, 화재가 발생한 구역을 파악할 수는 있지만, 해당 구역 내 어느 위치에서 화재가 발생하였는지는 파악할 수 없다.The

도 2의 (a)를 참조하면, S10에서, 화재 감지기(30)가 화재 신호를 발생하며, 이를 수신한 소방 수신기가 화재 신호를 관제 서버(40)로 전송한다.Referring to FIG. 2A , in S10 , the

S11에서, 관제 서버(40)는 오작동 화재 신호 확인을 화재 검출 서버(100)에 요청한다. 오작동 화재 신호 확인 요청은 화재 신호가 발생한 건물을 식별할 수 있는 정보, 예를 들어, 경위도, 주소, 건물에 부여된 고유 식별자 등을 포함할 수 있다. 한편, 오작동 화재 신호 확인 요청은 화재 신호 발생 시각을 더 포함할 수 있다.In S11 , the

S12에서, 화재 검출 서버(100)는 건물 식별 정보를 이용하여 해당 건물에 설치된 카메라(20)를 파악하며, 파악된 카메라(20)로부터 수신한 영상을 분석한다. 카메라(20)가 PTZ 카메라이면, 화재 신호 발생 시각에 촬영한 영상이 시야 밖에 있을 수 있다. 따라서 화재 검출 서버(100)는 화재 신호를 수신한 시각에 시야에 속하지 않은 영역을 카메라(20)로 스캔한다.In S12 , the

한편, 화재 검출 서버(100)는 화재 신호 발생 시각 이전에 분석한 메타 데이터에 고도화된 화재 오검지 조건을 적용하여 화재를 검출할 수 있다. 예를 들어, 연기나 불꽃을 나타내는 메타 데이터가 검색되면, 화재 검출 서버(100)는 관제 서버(40)로 화재 검출을 즉시 통지한다. 화재 검출 통지시 화재 발생 위치가 함께 통지될 수 있다. 화재 검출을 수신하면, 관제 서버(40)는 관제 단말에 표출한 화재 신호에 대한 확인이 완료되었으며, 화재가 발생한 위치를 관제 단말에 표출한다.Meanwhile, the

S13에서, 카메라(20)는 영상을 화재 검출 서버(100)로 전송한다. 카메라(20)가 전송한 영상은 화재 신호 발생 시각에 촬영된 영상에 포함되지 않은 영역을 촬영한 영상일 수 있다.In S13 , the

S14에서, 화재 검출 서버(100)는 화재 신호 발생 시각 이후에 수신한 영상에 고도화된 화재 오검지 조건을 적용하여 분석할 수 있다.In S14, the

실제 화재 신호로 확정되면, 화재 검출 서버(100)는 관제 서버(40)로 실제 화재 신호를 통지한다. 화재 검출 서버(100)는 화재가 발생한 위치를 특정할 수 있다. 영상에 표출된 객체의 지리적 위치는 카메라의 위치, 회전 각도, 틸트 각도 등을 이용하여 다양한 방식을 이용하여 특정될 수 있다. 특정된 화재 발생 위치는 화재 검출 신호와 함께 관제 서버(40)로 전송될 수 있다. 실제 화재 신호를 수신하면, 관제 서버(40)는 관제 단말에 표출한 화재 신호를 화재 발생으로 변경하며, 화재가 발생한 위치를 관제 단말에 표출한다. 한편, 화재 검출 서버(100)는 카메라(20)가 화재를 지속적으로 촬영하도록 제어하여 화재의 확산속도, 확산방향, 불꽃의 크기를 검출하며, 이를 관제 서버(40)로 전송할 수 있다.When it is confirmed as the actual fire signal, the

오작동 화재 신호로 확정되면, 화재 검출 서버(100)는 관제 서버(40)로 오작동 화재 신호를 통지한다. 오작동 화재 신호를 수신하면, 관제 서버(40)는 관제 단말에 표출한 화재 신호를 화재 감지기 오작동으로 변경한다.When it is confirmed as a malfunctioning fire signal, the

도 2의 (b)를 참조하면, S20에서, 관제 서버(40)가 화재 신호를 수신한다. 동시에, 지능형 에지장치(300)도 화재 신호를 수신할 수 있다. 지능형 에지장치(300)는 카메라(20)뿐 아니라 건물에 설치된 환경 센서로부터 측정값을 수신할 수 있다. 여기서 환경 변수는, 예를 들어, 온도, 습도, 조도, 가스 농도, 미세먼지 농도 등 일 수 있다. 도면에 예시된 바와 같이, 화재 감지기(30)도 일종의 환경 센서이므로, 화재 신호도 지능형 에지장치(300)에 전달되도록 할 수 있다. 관제 서버(40)는 화재 신호를 수신하면 화재 신호 수신 및 확인중임을 관제 단말에 표출할 수 있다.Referring to FIG. 2B , in S20 , the

S21에서, 지능형 에지장치(300)는 화재 신호를 수신하면 화재가 발생한 구역에 배치된 카메라(20)를 파악하며, S22에서 카메라(20)부터 수신한 영상을 분석한다. 화재가 발생한 구역을 화재 신호로부터 파악할 수 있으면, 지능형 에지장치(300)는 해당 구역에 설치된 카메라(20)만 제어하여 화재 이벤트를 검출할 수 있다. 반면 화재가 발생한 구역을 파악할 수 없으면, 지능형 에지장치(300)는 화재 신호가 발생한 건물에 설치된 모든 카메라(20)를 제어하여 화재 이벤트를 검출할 수 있다. 이하에서는 화재 신호가 발생한 구역을 알 수 있는 경우를 설명하지만, 동일한 방식이 화재 신호가 발생한 구역을 알 수 없는 경우에 적용 가능하다.In S21, the

지능형 에지장치(300)는 카메라(20)로부터 수신한 영상에 고도화된 화재 오검지 조건을 적용한다. 지능형 에지장치(300)는 영상을 분석하여 메타 데이터를 생성하며, 이를 저장한다. 따라서, 지능형 에지장치(300)는 화재 신호를 수신한 시각을 기준으로 일정 시간 이전에 수신한 영상을 분석하여 획득한 메타 데이터에 고도화된 화재 오검지 조건을 적용하여 연기 또는 불꽃을 검출할 수 있다.The

한편, 화재가 발생한 위치가 일시적으로 카메라(20)의 시야 밖에 있을 수 있다. 따라서 지능형 에지장치(300)는 화재 신호가 발생한 구역에 배치된 카메라(20)가 고정식 카메라인지 아니면 PTZ 카메라인지 확인한다. PTZ 카메라인 경우, 지능형 에지장치(300)는 화재 신호를 수신한 시각에 시야에 속하지 않은 영역을 카메라(20)로 스캔한다. 여기서 스캔은 카메라의 회전 및 틸팅 중 어느 하나 또는 모두를 수행하여 카메라(20)가 촬영할 수 있는 공간의 적어도 일부를 촬영하는 동작을 의미한다. 화재 신호 발생 후 스캔은 카메라(20)의 현재 시야에 포함되지 않은 영역에 대해 이루어질 수 있다.On the other hand, the location where the fire occurred may be temporarily out of the field of view of the

S23에서, 지능형 에지장치(300)는 수신한 화재 신호가 실제 화재 신호인지 아니면 오작동 화재 신호인지를 1차 분석한다. 1차 분석 결과에 따라 이후 절차가 달라질 수 있다. 고도화된 화재 오검지 조건을 영상에 적용하여 분석하는 과정은 도 4를 참조하여 상세히 설명한다.In S23, the

불꽃 및 연기 중 어느 하나가 검출되어 실제 화재 신호인 것으로 분석되면, 지능형 에지장치(300)는 화재가 발생한 위치를 특정할 수 있다. 영상에 표출된 객체의 지리적 위치는 카메라의 위치, 회전 각도, 틸트 각도 등을 이용하여 다양한 방식을 이용하여 특정될 수 있다. 특정된 화재 발생 위치는 화재 검출을 나타내는 메타 데이터와 함께 에지기반 화재 검출 서버(400) 또는 관제 서버(40)로 전송될 수 있다. 한편, 지능형 에지장치(300)는 카메라(20)가 화재를 지속적으로 촬영하도록 제어하여 화재의 확산속도, 확산방향, 불꽃의 크기를 검출하며, 이를 에지기반 화재 검출 서버(400) 또는 관제 서버(40)로 전송할 수 있다.When any one of flame and smoke is detected and analyzed to be an actual fire signal, the

불꽃 및 연기 중 어느 하나도 검출되지 않아 오작동 화재 신호인 것으로 분석되면, 지능형 에지장치(300)는 오작동 화재 신호임을 나타내는 메타 데이터를 에지기반 화재 검출 서버(400) 또는 관제 서버(40)로 전송할 수 있다.When neither flame nor smoke is detected and it is analyzed that it is a malfunctioning fire signal, the

1차 분석 결과 화재 여부를 판단할 수 없으면, 지능형 에지장치(300)는 화재 신호가 발생한 구역에서 촬영된 영상 또는 스냅샷을 에지기반 화재 검출 서버(400)로 전송한다. 예를 들어, 불꽃이나 연기를 검출했지만 주변에 위치한 사람들의 움직임이 없으면, 화재가 발생했지만 진화했거나 진화 가능한 상황인지 아니면 음식 조리와 같이 화재가 발생하지 않은 상황인지를 판단하기 어렵다. 이 경우, 지능형 에지장치(300)는 영상 분석의 결과를 도출하지 못하는 영상 구간 또는 스냅샷을 에지기반 화재 검출 서버(400)로 전송할 수 있다.If it is not possible to determine whether there is a fire as a result of the primary analysis, the

S24에서, 에지기반 화재 검출 서버(400)는 지능형 에지장치(300)의 1차 분석 결과를 검증하거나 2차 분석하여 화재 신호의 유형을 확정한다. 실제 화재 신호임을 나타내는 메타 데이터 및 오작동 화재 신호임을 나타내는 메타 데이터를 수신하면, 에지기반 화재 검출 서버(400)는 메타 데이터를 2차 분석하여 지능형 에지장치(300)에 의한 분석 결과를 검증할 수 있다. 에지기반 화재 검출 서버(400)는 지능형 에지장치(300)에 비해 상대적으로 많은 컴퓨팅 파워 및 리소스를 활용할 수 있으므로, 지능형 에지장치(300)에서 적용된 이벤트 조건보다 더욱 상세한 이벤트 조건을 적용한 분석이 가능하다. 또한 에지기반 화재 검출 서버(400)는 학습된 이벤트 검출기로 검출할 수 없는 이벤트도 빅데이터를 활용하여 분석할 수 있다.In S24, the edge-based

2차 분석 결과 오작동 화재 신호로 확정되면, 에지기반 화재 검출 서버(400)는 관제 서버(40)로 오작동 화재 신호를 통지한다. 오작동 화재 신호를 수신하면, 관제 서버(40)는 관제 단말에 표출한 화재 신호를 화재 감지기 오작동으로 변경한다.If the secondary analysis result is confirmed as a malfunctioning fire signal, the edge-based

반면 2차 분석 결과 실제 화재 신호로 확정되면, 에지기반 화재 검출 서버(400)는 관제 서버(40)로 실제 화재 신호를 통지한다. 실제 화재 신호를 수신하면, 관제 서버(40)는 관제 단말에 표출한 화재 신호를 화재 발생으로 변경하며 화재가 발생한 위치를 관제 단말에 표출한다.On the other hand, if the secondary analysis result is confirmed as an actual fire signal, the edge-based

도 3은 화재 감지기의 오작동을 검출하는 과정을 예시적으로 도시한 도면이다.3 is a diagram exemplarily illustrating a process of detecting a malfunction of a fire detector.

S30에서, 화재 신호를 발생한 화재 감지기가 설치된 구역을 촬영할 수 있는 카메라가 선택된다. 선택된 카메라가 PZT 카메라인지 확인하며, PZT 카메라이면 화재 신호를 수신한 시각에 시야에 속하지 않은 영역을 카메라(20)로 스캔한다. 예시된 화면은 PZT 카메라의 시야가 부억의 가장 우측을 향해 있는 상황이며, 화재는 부엌의 좌측에서 발생하였다. 예를 들어, 카메라(20)는 시계 방향 또는 반시계 방향으로 일정 각도만큼 회전한 후, 위아래 방향으로 틸팅하여 시야에 속하지 않았던 영역을 스캔할 수 있다. 스캔을 완료하였으나 화재를 검출하지 못하면, 오작동 화재 신호로 판단할 수 있다.In S30, a camera capable of photographing an area in which a fire detector generating a fire signal is installed is selected. It is checked whether the selected camera is a PZT camera, and if it is a PZT camera, an area not belonging to the field of view is scanned with the

추가적으로, 해당 구역 주변에 설치된 카메라도 선택될 수 있다. 마찬가지로 주변에 설치된 카메라가 PTZ 카메라이면, 화재 신호를 수신한 시각에 시야에 속하지 않은 영역을 카메라로 스캔할 수 있다.Additionally, cameras installed around the area may be selected. Similarly, if the camera installed in the vicinity is a PTZ camera, the area outside the field of view can be scanned with the camera at the time the fire signal is received.

S31에서, 스캔 동작 중 카메라(20)가 촬영한 영상에서 화재를 검출한다. 고도화된 화재 오검지 조건은 영상을 그리드 기반으로 분석할 때 적용될 수 있다. 화재를 실제로 검출하면, 카메라(20)는 화재 발생 위치를 지속적으로 촬영하며, 불꽃 및 연기의 확산속도, 확산방향, 크기 등과 같은 화재 특성을 검출한다. 검출된 화재 특성은 관제 서버(40)로 전송되어 관제 단말에 표출되며, 입주자 대피, 소방 활동 등에 활용될 수 있다.In S31, a fire is detected in the image captured by the

도 4는 고도화된 화재 오검지 조건을 적용한 화재 검출 방식을 예시적으로 설명하기 위한 도면이다.4 is a view for explaining a fire detection method to which an advanced fire false detection condition is applied.

도 3에 예시된 방식은 화재 신호 발생 후 카메라 스캔을 통해 화재를 검출하는 방식이며, 도 4에 예시된 방식은 도 3의 화재 감지기 오작동 감지뿐 아니라 화재 신호가 발생하지 않는 상황에서도 화재를 감지할 수 있다. 따라서 도 4에 예시된 방식만 실행될 수 있다.The method illustrated in FIG. 3 is a method of detecting a fire through a camera scan after a fire signal is generated, and the method illustrated in FIG. 4 detects a fire not only for detecting malfunction of the fire detector of FIG. can Accordingly, only the scheme illustrated in FIG. 4 can be implemented.

S40은 화재가 일어나지 않은 정상 상황에서 촬영한 영상이다. 고도화된 화재 오검지 조건은 그리드 기반 빅데이터 자가학습을 통해 화재 발생 판단의 정확도를 고도화할 수 있다. 영상은 m x n 그리드로 분할되며, 각 그리드별로 정상 프로파일이 생성될 수 있다. 정상 프로파일은 정상 상태에서만 식별되는 특징, 규칙 또는 주기적인 변화이며, 그리드별로 빅데이터 자가학습을 통해 결정될 수 있다. 예를 들어, 정상 프로파일은 시간에 따라 변하는 색상일 수 있다.S40 is a video taken under normal conditions where there is no fire. Advanced fire detection conditions can improve the accuracy of fire detection through grid-based big data self-learning. The image is divided into an m x n grid, and a normal profile may be generated for each grid. A normal profile is a characteristic, rule, or periodic change that is identified only in a normal state, and can be determined through self-learning of big data for each grid. For example, a normal profile may be a color that changes over time.

그리드 기반은 화면 전체에 대한 정상 프로파일보다 더 정확한 화재 검출을 가능하게 한다. 예시된 화면은 부엌을 촬영한 영상으로, 우측에 있는 가스 레인지는 음식 조리를 위해 불꽃이 자주 검출되는 반면, 그 외의 영역은 창문을 통해 들어오는 햇빛 및 반사된 조명에 의해 규칙적으로 밝기가 변화한다. 따라서 화면 전체에 대해 정상 프로파일을 생성하면, 화면의 일부에서만 검출되는 특징들이 평균화되어서 어느 한 특징의 변화가 화면 전체의 정상 프로파일에 미치는 영향이 미미해진다. 그에 반해, 그리드별로 정상 프로파일을 생성하면, 그리드간에 구분이 가능하여 어느 한 그리드에 생긴 변화를 정확하게 검출할 수 있게 된다. 예를 들어, 빅데이터 자가학습을 통해 가스 레인지가 포함된 그리드는 위험 영역으로 분류되며, 일정 범위 이하로 검출되는 불꽃은 정상 상태, 즉, 음식 조리에 의해 발생한 것으로 식별될 수 있다.Grid-based enables more accurate fire detection than a normal profile for the entire screen. The exemplified screen is an image of a kitchen, and while the gas stove on the right frequently detects flames for cooking, the brightness of other areas is regularly changed by sunlight and reflected light coming through the window. Therefore, when a normal profile is generated for the entire screen, features detected only in a part of the screen are averaged, so that the effect of a change in one feature on the normal profile of the entire screen is insignificant. On the other hand, if a normal profile is generated for each grid, it is possible to distinguish between grids, so that a change occurring in one grid can be accurately detected. For example, a grid including a gas range is classified as a dangerous area through big data self-learning, and a flame detected below a certain range may be identified as being generated by a normal state, that is, cooking food.

S41에서, 복수의 그리드 중에서 화재 후보영역이 검출된다. 화재 후보영역은 다양한 공지의 방식을 적용하여 검출될 수 있다. 예를 들어, 화재 후보영역은 색상정보를 이용하여 검출될 수 있다. 불꽃 또는 연기는 객체 유형을 특정할 수 없는 비정형이기 때문에 색상정보가 화재 검출에 주로 사용된다. 영상에서, 불꽃은 가장 밝으며, 불꽃 주변에는 적색 및 황색의 화염이 존재하는 특성을 가지며, 연기는 백색, 회색 또는 흑색을 띄며, 상당한 넓은 영역에 걸쳐 검출되는 특성을 가진다. 예시된 화면에서, 2개의 화재 후보영역이 검출되었다. 좌측 후보영역은 화재로 인한 불꽃이며, 우측 후보영역은 가스 레인지 불꽃이다.In S41, a fire candidate area is detected from among the plurality of grids. The fire candidate area may be detected by applying various known methods. For example, the fire candidate area may be detected using color information. Since flame or smoke is an atypical object type that cannot be specified, color information is mainly used for fire detection. In the image, the flame is the brightest, and red and yellow flames exist around the flame, and the smoke is white, gray or black, and has the characteristic of being detected over a fairly wide area. In the illustrated screen, two fire candidate areas were detected. The left candidate area is a flame caused by a fire, and the right candidate area is a gas stove flame.

상술한 특징들은 화재가 아닌 경우에도 검출될 수 있어서, 유사한 특징을 갖는 화재 후보영역을 제거하는 오검지 필터링을 적용하면 오검지율을 더욱 감소시킬 수 있다. 예를 들어, 석양, 빨간색 객체, 네온사인, 붉은 조명, 가로등(이하 오검지 화재)은 불꽃으로 검출될 수 있다.Since the above-described characteristics can be detected even when not a fire, the false detection rate can be further reduced by applying false detection filtering that removes fire candidate areas having similar characteristics. For example, a sunset, a red object, a neon sign, a red light, or a street lamp (hereinafter, false detection fire) may be detected as a flame.

S42에서, 오검지 필터링을 통해 화재 후보영역 중에서 화재가 아닌 영역이 제거된다. 오검지 필터는 영상에서 분석하지 않을 영역이나 객체를 제거하는 환경 필터이다. 오검지 필터링은 실제 화재와 다른 특징을 가진 영역을 제외하는 방식으로 수행될 수 있다. 일 예로, 오검지 필터링은 화재 후보영역별로 히스토그램을 생성하며, 생성된 히스토그램을 실제 화재에 대한 히스토그램 또는 오검지 화재에 대한 히스토그램과 비교 및 분류하여 오검지 화재를 제거할 수 있다. 다른 예로, 화재 후보영역이 미리 설정된 분석이 필요 없는 영역에 해당하면 오검지 필터는 해당 화재 후보영역을 제거할 수 있다.In S42, a non-fire area is removed from the fire candidate areas through false detection filtering. The false detection filter is an environmental filter that removes areas or objects that are not to be analyzed from the image. False detection filtering may be performed in a manner that excludes areas having different characteristics from actual fires. For example, the false detection filtering generates a histogram for each fire candidate area, and compares and classifies the generated histogram with a histogram for an actual fire or a histogram for a falsely detected fire to remove a false detection fire. As another example, if the fire candidate area corresponds to an area that does not require a preset analysis, the false detection filter may remove the fire candidate area.

S43에서, 오검지 필터링을 통과한 화재 후보영역을 정상 프로파일과 비교하여 비정상 상태의 발생을 확정할 수 있다. 정상 프로파일은 정상 상태가 유지되는 동안에 생성되므로, 정상 상태의 특징을 나타낸다. 예를 들면, 그리드별로 생성된 정상 프로파일과 실시간으로 수집된 영상의 색상정보를 비교하여 해당 그리드에서 비정상 상태를 검출할 수 있다. 예시된 그리드 G24와 G34의 색상정보는 정상 프로파일을 가진다. 한편 실시간 영상에서 그리드 G24와 G34에 대응하는 영역에서 발생한 화재는 그리드 G24와 G34가 정상 프로파일과는 다른 색상정보를 가지게 한다. 따라서 비정상 상태, 즉, 화재가 발생한 경우이다.In S43, the occurrence of the abnormal state may be determined by comparing the fire candidate region that has passed the false detection filtering with the normal profile. Since the normal profile is generated while the steady state is maintained, it characterizes the steady state. For example, an abnormal state may be detected in the corresponding grid by comparing a normal profile generated for each grid with color information of an image collected in real time. The color information of the illustrated grids G24 and G34 has a normal profile. Meanwhile, in the real-time image, a fire occurring in the area corresponding to the grids G24 and G34 causes the grids G24 and G34 to have different color information from the normal profile. Therefore, it is an abnormal state, that is, a case of fire.

화재가 검출되면, 화재의 확산속도, 확산방향, 불꽃의 크기와 같은 화재 특성을 지속적으로 추적할 수 있다. 그리드로 분할된 영상은 그리드별로 비정상 상태를 검출할 수 있으므로, 그리드별 상태 변화를 통해 화재를 신속하게 추적할 수 있다.When a fire is detected, fire characteristics such as the rate of spread of the fire, the direction of its spread, and the size of the flame can be continuously tracked. Since an image divided into grids can detect an abnormal state for each grid, it is possible to quickly track a fire through state changes for each grid.

상술한 과정은 화재 후보영역을 검출한 후 정상 프로파일을 이용하는 경우이다. 화재 후보영역 검출 과정은 생략가능하며, 실시간 영상을 정상 프로파일과 그리드별 비교를 통해 비정상 상태 발생을 검출할 수도 있다.The above-described process is a case of using a normal profile after detecting a fire candidate area. The fire candidate area detection process can be omitted, and the occurrence of an abnormal state can be detected by comparing the real-time image with the normal profile for each grid.

도 5는 도 2에 도시된 화재 검출 서버를 기능적으로 도시한 도면이다.FIG. 5 is a functional diagram illustrating the fire detection server shown in FIG. 2 .

도 5를 참조하면, 화재 검출 서버(100)는 영상데이터 처리모듈(110) 및 영상분석모듈(200)을 포함할 수 있다. 영상데이터 처리모듈(110)은 하나 이상의 카메라(20)로부터 통신망(10)을 통해 영상을 수신하며, 수신한 영상을 영상 분석에 적합하게 전처리한다. 영상분석모듈(200)은 전처리된 영상에서 객체를 검출하고, 객체의 움직임을 추적하며, 추적중인 객체의 행위를 분석하여 이벤트를 검출한다. 또한 영상분석모듈(200)은 영상에서 화재를 검출하며, 필요한 경우 카메라(20)로 화재를 추적할 수 있다.Referring to FIG. 5 , the

영상데이터 처리모듈(110)과 영상분석모듈(200)은 물리적으로 하나의 서버에서 독립적으로 실행되거나, 통신망을 통해 연결된 둘 이상의 서버에서 실행되는 모듈 형태의 소프트웨어일 수 있다. 즉, 영상데이터 처리모듈(110)과 영상분석모듈(200), 및 각 모듈에 포함된 서브 모듈들은 지능형 에지 장치와 서버에 분산되어 실행될 수도 있다. 서버는 하나 이상의 중앙처리장치(예를 들어, CPU, GPU 등), 반도체 메모리, 통신 모뎀 칩 등과 같은 물리적 구성 요소를 포함하며, 영상데이터 처리모듈(110) 및 영상분석모듈(200)은 메모리에 로딩된 프로그램이 CPU에 의해 실행되는 동작을 기능적으로 구분하여 표현한 것이다.The image

통신망(30)은 영상의 전송이 가능한 유선, 무선 또는 유무선 혼합 데이터 통신망일 수 있다. 유선 통신망은 패킷 형태의 디지털 데이터 전송을 위한 통신 프로토콜을 지원하는 전용선이나 케이블망 등일 수 있으며, 무선 통신망은 CDMA, WCDMA, GSM, EPC, LTE, 와이브로 뿐 아니라, 와이파이 이외에 블루투스, 지그비 등과 같이, 무선 신호를 이용하여 데이터를 전송하는 통신 시스템일 수 있다.The

영상데이터 처리모듈(110)은 RTSP 클라이언트(111), 디코더(112) 및 영상 전처리 모듈(113)을 포함할 수 있다. RTSP 클라이언트(111)는 영상 전송 프로토콜, 예를 들어, RTSP를 지원하는 통신 모뎀으로, 통신망(30)을 통해 카메라(20)로부터 영상 데이터를 수신한다. 디코더(112)는 수신된 영상 데이터를 디코딩하여 영상을 복원한다. 영상 전처리 모듈(113)은 영상 분석에 적합하도록, 복원된 영상의 해상도, 크기 등을 변경하거나 컬러 영상을 흑백 영상으로 변환한다. 디코더(112) 및 영상 전처리 모듈(113)은 CPU 또는 GPU에 의해 실행되는 모듈일 수 있다.The image

영상분석모듈(200)은 객체 검출 모듈(210), 이벤트 검출 모듈(220), 카메라 제어 모듈(230), 그리드 기반 빅데이터 모듈(240) 및 화재 검출 모듈(250)을 포함할 수 있다. 참고로, 화재 검출 모듈(250)의 기능 및 동작은 객체 검출 모듈(210) 및 이벤트 검출 모듈(220)으로도 구현할 수 있으며, 여기서는 화재 검출을 주로 설명하기 위하여 별도의 모듈로 표현하였다. 한편, 객체 검출 모듈(210) 및 이벤트 검출 모듈(220)은 화재 발생시 사람, 동물 및 차량 객체와 이에 관련된 이벤트를 검출할 수 있다.The

객체 검출 모듈(210)은 전처리 영상에서 하나 이상의 객체를 전처리 영상에서 검출하며, 검출된 객체를 유형별로 분류할 수 있다. 객체 검출 모듈(210)은, 예를 들어, 객체 이미지를 이용하여 학습된 객체 검출부 또는 객체를 표현한 템플릿을 이용하는 객체 검출부일 수 있다.The

이벤트 검출 모듈(220)은 둘 이상의 상이한 영상 분석 방식으로 이벤트를 검출할 수 있다. 이벤트 검출 모듈(220)은 검출된 객체, 객체의 움직임, 및 객체의 주변 환경 중 어느 하나 또는 이들의 조합에 기초하여, 이벤트 조건에 부합하는 이벤트를 검출한다. 딥러닝 이벤트 검출 모듈은 검출된 객체의 속성을 추출하고, 속성에 기초하여 설정된 이벤트 조건에 부합하는지를 판단한다. 룰 기반 이벤트 검출 모듈은 관심 영역에서 객체의 움직임에 기초하여 이벤트 조건에 부합하는 이벤트를 검출한다. 한편, 딥러닝 이벤트 검출 모듈은 제1 이벤트 조건에 부합하는 객체를 룰 기반 이벤트 검출 모듈에 전달하여, 룰 기반 이벤트 검출 모듈은 전달받은 객체가 제2 이벤트 조건에 부합하는지 판단하도록 할 수 있다.The

딥러닝 방식으로 수행하도록 설정된 이벤트 조건이 복수이면, 각 이벤트 조건에 따라 동작하는 딥러닝 이벤트 검출 모듈도 복수일 수 있다. 동일하게, 룰 기반 방식을 수행하도록 설정된 이벤트 조건이 복수이면, 각 이벤트 조건에 따라 동작하는 룰 기반 이벤트 검출 모듈도 복수개일 수 있다. 여기서, 이벤트 조건이 복수개인 상황은 화재 검출 서버가 분석할 영상이 둘 이상인 경우뿐 아니라, 하나의 영상에 둘 이상의 이벤트 조건이 적용된 경우를 포함할 수 있다.If there are a plurality of event conditions set to be performed in the deep learning method, there may also be a plurality of deep learning event detection modules operating according to each event condition. Similarly, if there are a plurality of event conditions set to perform the rule-based method, there may be a plurality of rule-based event detection modules operating according to each event condition. Here, the situation in which there are a plurality of event conditions may include a case in which two or more event conditions are applied to one image as well as a case in which there are two or more images to be analyzed by the fire detection server.

카메라 제어 모듈(230)은 화재 신호 검출시 화재 신호가 발행한 위치에 설치된 카메라(20)를 제어한다. 구체적으로, 화재 신호가 발생한 위치에 설치된 카메라가 PTZ 카메라이면 화재 신호를 수신한 시각에 시야에 속하지 않은 영역을 카메라(20)로 스캔하도록 한다.The

추가적으로 또는 선택적으로, 카메라 제어 모듈(230)은 화재 신호가 발생한 위치 주변에 설치된 카메라(20)도 제어할 수 있다. 화재로 인한 연기 및 불꽃은 실제 발생 장소에 설치된 화재 감지기에는 감지되지 않을 수 있다. 예를 들어, 연기만 발생하고 있는 장소에 설치된 화재 감지기가 불꽃만 감지할 수 있거나 고장중이면, 주변에 위치한 다른 화재 감지기가 화재 신호를 발생할 수 있다. 따라서 화재 신호가 발생한 위치뿐 아니라 주변까지 영상 분석이 필요하다. 따라서 카메라 제어 모듈(310)은 화재 신호가 발생된 층 전체 또는 그 아래층에 설치된 복수의 카메라(20)를 제어하여 화재를 검출할 영상을 확보할 수 있다.Additionally or alternatively, the

그리드기반 빅데이터 모듈(240)은 그리드별 정상 프로파일을 생성한다. 정상 상태의 영상은 m x n 그리드로 분할되며, 그리드기반 빅데이터 모듈(240)은 그리드 단위로 빅데이터 자가학습을 통해 정상 프로파일을 생성할 수 있다. 정상 프로파일은 정상 상태에서만 식별되는 그리드별 특징, 규칙 또는 주기적인 변화이다. 그리드기반 빅데이터 모듈(240)은 정상 상태가 지속되는 동안 정상 프로파일을 갱신할 수 있다. 즉, 그리드기반 빅데이터 모듈(240)은 정상 프로파일이 최초 생성된 이후에 검출되는 새로운 특징이나 변화를 지속적으로 정상 프로파일에 반영할 수 있다.The grid-based

화재 검출 모듈(250)은 영상을 구성하는 m x n 그리드 중에서 화재 후보영역을 검출하고, 검출된 화재 후보영역에서 실제로 발생한 화재를 검출한다. 화재 후보영역은 그리드별 색상정보를 이용하여 검출될 수 있다. 여기서 색상정보는 화재 영상이 가지는 특징적인 색상정보일 수 있다. 추가적으로 화재 검출 모듈(250)은 오검지 필터링을 화재 후보영역에 적용하여 오검지 화재를 제거할 수 있다.The

화재 검출 모듈(250)은 화재 후보영역에 해당하는 그리드의 정상 프로파일을 이용하여 화재 발생을 확정할 수 있다. 화재 검출 모듈(250)은 화재 후보영역으로 검출된 그리드의 특징과 검출된 그리드의 정상 프로파일로 표현된 특징을 비교한다. 비교결과, 화재 후보영역의 특징이 정상 프로파일과 실질적으로 일치하거나 경향이 유사하면 화재가 아니라고 판단된다. 반면에, 화재 후보영역의 특징이 정상 프로파일과 차이가 있거나 차이가 점점 커지면, 비정상 상태가 발생하였다고 할 수 있다.The

한편, 화재 검출 모듈(250)은 화재 신호가 발생한 위치에서 촬영한 영상만으로 화재 검출 과정을 수행할 수도 있으며, 화재 신호 발생 위치 주변에서 촬영한 영상까지 포함해서 수행할 수도 있다. 화재 신호 발생시, 화재 검출 모듈(250)은 영상에서 연기 및 불꽃이 검출되지 않으면 카메라 제어 모듈(230)에 스캔을 요청하여 화재 신호 발생 시점에서 촬영되지 않은 공간에 대한 영상까지 분석한 후 오작동 화재 신호로 판단할 수 있다. 한편, 이벤트 검출 모듈(230)은 연기 또는 불꽃이 검출되었더라도 오작동 화재 신호로 판단할 수 있다. 예를 들어, 부엌의 가스 레인지와 같이 사용자에 의해 제어된 불꽃은 화재에 해당하지 않는다.On the other hand, the

도 6은 도 2에 도시된 지능형 에지장치를 기능적으로 도시한 도면이다.FIG. 6 is a functional diagram illustrating the intelligent edge device shown in FIG. 2 .

지능형 에지장치(300)는 건물에 설치된 카메라(20)가 촬영한 영상을 1차 분석하여 메타 데이터를 생성할 수 있다. 한편, 지능형 에지장치(300)는 공간별로 설치된 환경 센서가 생성한 측정 데이터를 수신하여 측정 데이터 또는 측정 데이터에 대한 메타 데이터를 에지기반 화재 검출 서버(400)로 전송할 수 있다. 상술한 바와 같이, 화재 감지기(30)도 환경 센서의 한 유형이며, 화재 감지기(30)가 발생한 화재 신호는 지능형 에지장치(300)로 하여금 오작동 화재 신호 검출 과정을 수행하게 할 수 있다.The

지능형 에지장치(300)는 카메라(20)가 설치된 위치 및 현장 상황에 적합하게 학습하며, 수행한 학습에 기초하여 영상을 분석할 수 있다. 지능형 에지장치(300)는, 예를 들어, 사람 객체, 사람 객체 관련 이벤트 및 화재 이벤트 중 어느 하나 또는 이들의 조합을 검출하도록 학습될 수 있다. 생성된 메타 데이터는 에지기반 화재 검출 서버(400)에 의해 2차 분석될 수 있다. 특히, 영상은 에지기반 화재 검출 서버(400)가 요청하는 경우에 한하여 전송될 수 있으므로, 통신망의 종류, 접근성, 대역폭 등의 제한을 받지 않으며, 신속한 영상 분석을 통한 이벤트 검출이 가능하다. The

메타 데이터는 영상에서 검출된 사람 객체, 사람 객체 관련 이벤트, 화재 이벤트 및 측정 데이터 중 어느 하나에 대한 정보를 포함하며, 추가적으로 화재 신호가 발생한 위치에 대한 정보를 더 포함할 수 있다. 위치 정보는 카메라가 설치된 위치에 의해 특정될 수 있다.The metadata includes information on any one of a human object detected from an image, a human object-related event, a fire event, and measurement data, and may further include information on a location where a fire signal is generated. The location information can be specified by the location where the camera is installed.

지능형 에지장치(300)는 영상데이터 처리모듈(310), 영상분석모듈(320) 및 메타데이터 전송모듈(330)을 포함한다. 영상데이터 처리모듈(310)과 영상분석모듈(320)은 도 5의 영상데이터 처리모듈(110)과 영상분석모듈(200)에 각각 대응한다. 따라서 중복된 설명은 생략하며, 차이점만 설명한다.The

오작동 화재 신호에 관해서, 영상분석모듈(320)은 영상에서 연기 및 불꽃이 검출되지 않으면 오작동 화재 신호로 판단할 수 있다. 한편, 영상분석모듈(320)은 연기 또는 불꽃이 검출되었더라도 오작동 화재 신호로 판단할 수 있다. 예를 들어, 영상분석모듈(320)은 화재 신호 발생 전 영상에 관한 메타 데이터를 참고하여, 검출된 연기가 화재로 인해 발생한 연기가 아니면 오작동 화재 신호로 판단한다. 다른 예로, 영상분석모듈(320)은 화재 신호 발생 전 영상에 관한 메타 데이터를 참고하여, 검출된 불꽃이 화재로 인해 발생한 불꽃이 아니면 오작동 화재 신호로 판단한다. 예를 들어, 주방을 촬영한 영상은 음식 조리시 발생하는 연기 및 가열 기구에서 발생한 불꽃을 포함할 수 있으며, 주방 영상으로 학습한 영상분석모듈(320)은 화재 신호 발생 전 영상과 비교하여 검출된 연기 또는 불꽃이 화재에 해당하는지를 판단할 수 있다. 예를 들어, 오작동 화재 신호일 가능성과 실제 화재 신호일 가능성이 거의 비슷하여 판단을 하기가 어려우면, 2차 분석을 에지기반 화재 검출 서버(400)에 요청할 수 있다.With respect to the malfunctioning fire signal, the

실제 화재 신호에 관해서, 영상분석모듈(320)은 영상에서 연기 및 불꽃이 검출되면 실제 화재 신호로 판단할 수 있다. 여기서, 영상분석모듈(320)은 화재 신호 발생 전 영상에 관한 메타 데이터를 참고할 수 있다. 예를 들어, 동일한 공간임에도 불구하고 화재 신호 발생 전 영상에서는 검출되지 않았던 연기 또는 불꽃이 검출되면, 영상분석모듈(320)은 실제 화재 신호로 판단할 수 있다.With respect to the actual fire signal, the

메타 데이터 전송 모듈(330)은 영상분석모듈(320)이 생성한 메타 데이터를 통신망(30)을 통해 에지기반 화재 검출 서버(400)로 전송한다. 추가적으로, 메타 데이터 전송 모듈(330)은 환경 센서가 생성한 측정 데이터 또는 측정 데이터에 대한 메타 데이터를 에지기반 화재 검출 서버(400)로 전송할 수 있다.The

전술한 본 발명의 설명은 예시를 위한 것이며, 본 발명이 속하는 기술분야의 통상의 지식을 가진 자는 본 발명의 기술적 사상이나 필수적인 특징을 변경하지 않고서 다른 구체적인 형태로 쉽게 변형이 가능하다는 것을 이해할 수 있을 것이다. 그러므로 이상에서 기술한 실시 예들은 모든 면에서 예시적인 것이며 한정적이 아닌 것으로 이해해야만 한다. 특히, 도면을 참조하여 설명된 본 발명의 특징은 특정 도면에 도시된 구조에 한정되는 것이 아니며, 독립적으로 또는 다른 특징에 결합되어 구현될 수 있다.The above description of the present invention is for illustration, and those of ordinary skill in the art to which the present invention pertains can understand that it can be easily modified into other specific forms without changing the technical spirit or essential features of the present invention. will be. Therefore, it should be understood that the embodiments described above are illustrative in all respects and not restrictive. In particular, the features of the present invention described with reference to the drawings are not limited to the structures shown in the specific drawings, and may be implemented independently or in combination with other features.

본 발명의 범위는 상기 상세한 설명보다는 후술하는 특허청구범위에 의하여 나타나며, 특허청구범위의 의미 및 범위 그리고 그 균등 개념으로부터 도출되는 모든 변경 또는 변형된 형태가 본 발명의 범위에 포함되는 것으로 해석되어야 한다.The scope of the present invention is indicated by the following claims rather than the above detailed description, and all changes or modifications derived from the meaning and scope of the claims and their equivalent concepts should be construed as being included in the scope of the present invention. .

Claims (9)

Translated fromKorean상기 카메라가 제공한 정상 상태 영상을 m x n 그리드로 분할하며, 분할된 그리드별로 빅데이터 학습을 수행하여 상기 정상 상태에서 검출되는 특징에 대한 정상 프로파일을 그리드별로 생성하는 그리드기반 빅데이터 모듈; 및

상기 카메라가 제공하는 실시간 영상의 m x n 그리드 중에서 화재 후보영역을 검출하며, 검출된 화재 후보영역에서 검출된 특징과 상기 검출된 화재 후보영역의 정상 프로파일을 비교하여 화재 발생을 확정하는 화재 검출 모듈을 포함하되,

상기 정상 프로파일은 상기 정상 상태 영상에서 시간별로 식별되는 특징인 화재 오검지 조건을 고도화한 화재 검출 시스템.a camera to photograph the surveillance space;

a grid-based big data module that divides the steady state image provided by the camera into an mxn grid, performs big data learning for each divided grid, and generates a normal profile for the features detected in the steady state for each grid; and

A fire detection module that detects a fire candidate area from the mxn grid of the real-time image provided by the camera, and determines the occurrence of a fire by comparing features detected in the detected fire candidate area with the normal profile of the detected fire candidate area but,

The fire detection system advanced the fire false detection condition, wherein the normal profile is a characteristic identified by time in the steady state image.

상기 지능형 에지장치가 영상을 분석하여 생성한 메타 데이터를 통신망을 통해 수신하며, 상기 메타 데이터를 분석하여 화재 발생을 확정하는 에지기반 화재 검출 서버를 더 포함하는 화재 오검지 조건을 고도화한 화재 검출 시스템.The method according to claim 1, wherein the grid-based big data module and the fire detection module constitute an intelligent edge device installed in the monitoring space,

The intelligent edge device receives metadata generated by analyzing an image through a communication network, and further includes an edge-based fire detection server that analyzes the metadata to determine the occurrence of a fire. Fire detection system with advanced fire false detection conditions .

상기 스캔은 상기 PTZ 카메라를 회전 및 틸팅하도록 제어하여 상기 화재 신호 발생시 시야에 포함되지 않은 공간을 촬영하는 화재 오검지 조건을 고도화한 화재 검출 시스템.The method according to claim 6, The camera installed in the area where the fire signal is generated is a PTZ (Pan-tilt-zoom) camera,

The scan controls the rotation and tilt of the PTZ camera to photograph a space not included in the field of view when the fire signal occurs.

상기 실시간 영상에서 하나 이상의 객체를 검출하는 객체 검출 모듈; 및

검출된 객체, 객체의 움직임 및 객체의 주변 환경 중 어느 하나 또는 이들의 조합에 기초하여, 이벤트 조건에 부합하는 이벤트를 검출하는 이벤트 검출 모듈을 더 포함하는 화재 오검지 조건을 고도화한 화재 검출 시스템.7. The method of claim 6,

an object detection module for detecting one or more objects in the real-time image; and

Based on any one or a combination of the detected object, the movement of the object, and the surrounding environment of the object, the fire detection system advanced the false fire detection condition further comprising an event detection module for detecting an event that meets the event condition.

상기 화재 검출 모듈은 상기 화재 신호가 발생한 감시 공간 및 상기 주변을 스캔 중에 촬영한 복수의 영상을 분석하여 상기 화재 신호를 오작동 화재 신호 및 실제 화재 신호 중 어느 하나로 식별하는 화재 오검지 조건을 고도화한 화재 검출 시스템.The method according to claim 6, wherein the camera control module controls the camera installed in the vicinity of the monitoring space where the fire signal is generated to scan the monitoring space,

The fire detection module analyzes a plurality of images taken while scanning the monitoring space and the surroundings where the fire signal is generated, and identifies the fire signal as either a malfunctioning fire signal or an actual fire signal. detection system.

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020210126129AKR102352477B1 (en) | 2021-09-24 | 2021-09-24 | Video analysis system capable of determining false detection of fire sensor |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020210126129AKR102352477B1 (en) | 2021-09-24 | 2021-09-24 | Video analysis system capable of determining false detection of fire sensor |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| KR102352477B1true KR102352477B1 (en) | 2022-01-18 |

Family

ID=80052314

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020210126129AActiveKR102352477B1 (en) | 2021-09-24 | 2021-09-24 | Video analysis system capable of determining false detection of fire sensor |

Country Status (1)

| Country | Link |

|---|---|

| KR (1) | KR102352477B1 (en) |

Cited By (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20240098472A (en)* | 2022-12-21 | 2024-06-28 | (주) 일진앤드 | System for monitoring fire accident of engine room in ship |

| KR20250108500A (en) | 2024-01-08 | 2025-07-15 | 주식회사 다누시스 | Flame Detecting Device for Sequentially Executing Multiple Filters |

Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR200486357Y1 (en) | 2017-09-29 | 2018-05-08 | 윤은상 | Fire detector integrated with camera |

| KR20190103855A (en)* | 2018-02-28 | 2019-09-05 | 주식회사 비젼하이텍 | Apparatus and method of searching fire image based on imaging area of the ptz camera |

- 2021

- 2021-09-24KRKR1020210126129Apatent/KR102352477B1/enactiveActive

Patent Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR200486357Y1 (en) | 2017-09-29 | 2018-05-08 | 윤은상 | Fire detector integrated with camera |

| KR20190103855A (en)* | 2018-02-28 | 2019-09-05 | 주식회사 비젼하이텍 | Apparatus and method of searching fire image based on imaging area of the ptz camera |

Non-Patent Citations (2)

| Title |

|---|

| 비특허1(전기전자학회논문지 23(1), 2019.3, 112-119(8 pages))** |

| 비특허2(전기학회논문지 69(3), 2020.3, 474-479(6 pages))** |

Cited By (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20240098472A (en)* | 2022-12-21 | 2024-06-28 | (주) 일진앤드 | System for monitoring fire accident of engine room in ship |

| KR102777435B1 (en) | 2022-12-21 | 2025-03-10 | (주) 일진앤드 | System for monitoring fire accident of engine room in ship |

| KR20250108500A (en) | 2024-01-08 | 2025-07-15 | 주식회사 다누시스 | Flame Detecting Device for Sequentially Executing Multiple Filters |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| KR102407327B1 (en) | Apparatus for Monitoring Fire And System having the same | |

| US20210049885A1 (en) | Method and system for monitoring fire | |

| US7786877B2 (en) | Multi-wavelength video image fire detecting system | |

| CN101334924B (en) | Fire detection system and fire detection method thereof | |

| KR100839090B1 (en) | Image-based Fire Surveillance System | |

| KR102060045B1 (en) | Fire detector and system capable of measuring heat distribution | |

| KR20140127574A (en) | Fire detecting system using unmanned aerial vehicle for reducing of fire misinformation | |

| KR102713573B1 (en) | Video analysis device using a multi camera consisting of a plurality of fixed cameras | |

| US20080137906A1 (en) | Smoke Detecting Method And Device | |

| US8497904B2 (en) | System and method of target based smoke detection | |

| CN108389359B (en) | Deep learning-based urban fire alarm method | |

| US20140254878A1 (en) | System and method for scanning vehicle license plates | |

| KR102352477B1 (en) | Video analysis system capable of determining false detection of fire sensor | |

| CN101458865A (en) | Fire disaster probe system and method | |

| CN111488802B (en) | Temperature curve synthesis algorithm utilizing thermal imaging and fire disaster early warning system | |

| CN101609589A (en) | Multi-frequency image fire detection system | |

| KR101741107B1 (en) | Apparatus and method for monitoring fire by using cctv | |

| KR102507540B1 (en) | Integrated fire monitoring system based on artificial intelligence | |

| KR102174606B1 (en) | Sense integrated IP network camera, and monitoring system for the same | |

| KR102088198B1 (en) | Integrated fire control system using triple detectors and method thereof | |

| KR20070028813A (en) | Forest fire detection method and system | |

| CN114913663A (en) | Anomaly detection method and device, computer equipment and storage medium | |

| KR102113527B1 (en) | Thermal ip cctv system and method for detecting fire by using the same | |

| KR101656642B1 (en) | Group action analysis method by image | |

| KR20220134379A (en) | Real-time wildfire monitoring method and system |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| PA0109 | Patent application | Patent event code:PA01091R01D Comment text:Patent Application Patent event date:20210924 | |

| PA0201 | Request for examination | ||

| PA0302 | Request for accelerated examination | Patent event date:20211028 Patent event code:PA03022R01D Comment text:Request for Accelerated Examination Patent event date:20210924 Patent event code:PA03021R01I Comment text:Patent Application | |

| E701 | Decision to grant or registration of patent right | ||

| PE0701 | Decision of registration | Patent event code:PE07011S01D Comment text:Decision to Grant Registration Patent event date:20220106 | |

| GRNT | Written decision to grant | ||

| PR0701 | Registration of establishment | Comment text:Registration of Establishment Patent event date:20220113 Patent event code:PR07011E01D | |

| PR1002 | Payment of registration fee | Payment date:20220113 End annual number:3 Start annual number:1 | |

| PG1601 | Publication of registration |