KR101631754B1 - Mobile terminal - Google Patents

Mobile terminalDownload PDFInfo

- Publication number

- KR101631754B1 KR101631754B1KR1020140093190AKR20140093190AKR101631754B1KR 101631754 B1KR101631754 B1KR 101631754B1KR 1020140093190 AKR1020140093190 AKR 1020140093190AKR 20140093190 AKR20140093190 AKR 20140093190AKR 101631754 B1KR101631754 B1KR 101631754B1

- Authority

- KR

- South Korea

- Prior art keywords

- mobile terminal

- information

- user

- unit

- input

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Expired - Fee Related

Links

Images

Classifications

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04B—TRANSMISSION

- H04B1/00—Details of transmission systems, not covered by a single one of groups H04B3/00 - H04B13/00; Details of transmission systems not characterised by the medium used for transmission

- H04B1/38—Transceivers, i.e. devices in which transmitter and receiver form a structural unit and in which at least one part is used for functions of transmitting and receiving

- H04B1/40—Circuits

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L15/00—Speech recognition

- G10L15/26—Speech to text systems

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04M—TELEPHONIC COMMUNICATION

- H04M1/00—Substation equipment, e.g. for use by subscribers

- H04M1/72—Mobile telephones; Cordless telephones, i.e. devices for establishing wireless links to base stations without route selection

- H04M1/725—Cordless telephones

Landscapes

- Engineering & Computer Science (AREA)

- Computer Networks & Wireless Communication (AREA)

- Signal Processing (AREA)

- Computational Linguistics (AREA)

- Health & Medical Sciences (AREA)

- Audiology, Speech & Language Pathology (AREA)

- Human Computer Interaction (AREA)

- Physics & Mathematics (AREA)

- Acoustics & Sound (AREA)

- Multimedia (AREA)

- Telephone Function (AREA)

- User Interface Of Digital Computer (AREA)

Abstract

Translated fromKoreanDescription

Translated fromKorean본 발명은 이동 단말기에 관한 것이다.The present invention relates to a mobile terminal.

단말기는 이동 가능여부에 따라 이동 단말기(mobile/portable terminal) 및 고정 단말기(stationary terminal)으로 나뉠 수 있다. 다시 이동 단말기는 사용자의 직접 휴대 가능 여부에 따라 휴대(형) 단말기(handheld terminal) 및 거치형 단말기(vehicle mounted terminal)로 나뉠 수 있다.A terminal can be divided into a mobile terminal (mobile / portable terminal) and a stationary terminal according to whether the terminal can be moved. The mobile terminal can be divided into a handheld terminal and a vehicle mounted terminal according to whether the user can directly carry the mobile terminal.

이동 단말기의 기능은 다양화 되고 있다. 예를 들면, 데이터와 음성통신, 카메라를 통한 사진촬영 및 비디오 촬영, 음성녹음, 스피커 시스템을 통한 음악파일 재생 그리고 디스플레이부에 이미지나 비디오를 출력하는 기능이 있다. 일부 단말기는 전자게임 플레이 기능이 추가되거나, 멀티미디어 플레이어 기능을 수행한다. 특히 최근의 이동 단말기는 방송과 비디오나 텔레비전 프로그램과 같은 시각적 컨텐츠를 제공하는 멀티캐스트 신호를 수신할 수 있다.The functions of mobile terminals are diversified. For example, there are data and voice communication, photographing and video shooting through a camera, voice recording, music file playback through a speaker system, and outputting an image or video on a display unit. Some terminals are equipped with an electronic game play function or a multimedia player function. In particular, modern mobile terminals can receive multicast signals that provide visual content such as broadcast and video or television programs.

이와 같은 단말기(terminal)는 기능이 다양화됨에 따라 예를 들어, 사진이나 동영상의 촬영, 음악이나 동영상 파일의 재생, 게임, 방송의 수신 등의 복합적인 기능들을 갖춘 멀티미디어 기기(Multimedia player) 형태로 구현되고 있다.Such a terminal has various functions, for example, in the form of a multimedia device having multiple functions such as photographing and photographing of a moving picture, reproduction of a music or video file, reception of a game and broadcasting, etc. .

이러한 단말기의 기능 지지 및 증대를 위해, 단말기의 구조적인 부분 및/또는 소프트웨어적인 부분을 개량하는 것이 고려될 수 있다.In order to support and enhance the functionality of such terminals, it may be considered to improve the structural and / or software parts of the terminal.

본 발명은 이동 단말기를 이용하여 문서와 같은 파일을 적극적으로 생산할 수 있는 방안에 대해서 제안하고자 한다.The present invention proposes a method for positively producing a file such as a document using a mobile terminal.

예를 들어, 사용자가 메모를 하고자 하는 경우에, 내장된 음성 인식 기능을 이용하여 수신되는 음성에 대하여 텍스트 표시함으로써, 사용자가 필요한 영역에 대한 메모나 기록을 수행하고, 적극적인 필기를 가능하도록 할 수 있다.For example, when a user wishes to take a note, the user can memorize or record the necessary area by using a built-in voice recognition function to display a text with respect to the received voice to enable active writing have.

또한, 문서 파일과 같은 전자 파일의 생산이 보다 용이하게 이루어질 수 있도록 하는 다양한 제스처 기반의 문서 입력 방법에 대해서도 제안하고자 한다.The present invention also proposes various gesture-based document input methods for facilitating the production of electronic files such as document files.

본 실시예의 이동 단말기는, 터치 입력이 가능한 디스플레이부와, 음성 데이터를 수신하는 입력부와, 상기 입력부를 통하여 수신된 음성 데이터에 대해서 음성 인식을 수행하고, 그 결과의 변환된 텍스트를 상기 디스플레이부에 표시하도록 제어하는 제어부를 포함하고, 상기 제어부는 수신되거나 저장된 전자 문서를 분석하고, 분석된 결과를 이용하여 상기 전자 문서에 포함된 적어도 일부 정보를 사용자가 편집가능하도록 한다.The mobile terminal of the present embodiment includes a display unit capable of touch input, an input unit for receiving voice data, and a voice recognition unit for performing voice recognition on the voice data received through the input unit and transmitting the converted text to the display unit And the control unit analyzes the received or stored electronic document and uses the analyzed result to make at least some information included in the electronic document editable by the user.

제안되는 바와 같은 실시예의 이동 단말기에 의해서, 이동 단말기를 이용하여 문서와 같은 파일을 적극적으로 생산할 수 있으며, 사용자가 메모를 하고자 하는 경우에, 내장된 음성 인식 기능을 이용하여 수신되는 음성에 대하여 텍스트 표시함으로써, 사용자가 필요한 영역에 대한 메모나 기록을 수행하고, 적극적인 필기를 가능하도록 할 수 있다.According to the mobile terminal of the embodiment as proposed, a file such as a document can be positively produced using a mobile terminal. When a user wants to take a memo, By doing so, the user can memorize or record the necessary area and make active writing possible.

도 1a는 본 발명과 관련된 이동 단말기를 설명하기 위한 블록도이다.

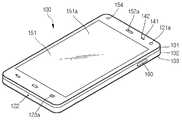

도 1b 및 1c는 본 발명과 관련된 이동 단말기의 일 예를 서로 다른 방향에서 바라본 개념도이다.

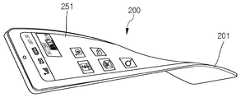

도 2는 본 발명에 따른 변형 가능한 이동 단말기(200)의 다른 예를 설명하기 위한 개념도이다.

도 3은 본 발명의 일 실시예에 따른 이동 단말기의 동작 방법을 설명하는 흐름도이다.

도 4는 이동 단말기에 표시되는 전자 문서의 예를 도시한 도면이다.

도 5는 본 실시예에 따라 전자 문서에 포함된 정보를 이용한 사용자 문서를 예시한 도면이다.

도 6은 본 발명의 일 실시예에 따라 전자 문서를 분석한 다음 스케쥴 정보를 확인하는 동작을 설명하는 흐름도이다.

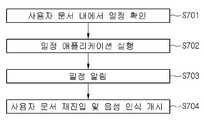

도 7은 본 실시예에 따라 전자 문서로부터 일정을 확인하고 일정에 기반한 음성 인식 동작을 설명하기 위한 흐름도이다.

도 8 내지 도 10은 본 실시예에 따라 일정 확인 및 음성 인식을 수행하는 과정을 보여주는 UI의 예이다.

도 11은 본 발명의 다른 실시예에 따른 음성 인식 결과의 테스트를 사용자가 편집하는 방법을 설명하는 흐름도이다.

도 12 내지 도 15는 본 실시예에 따라 텍스트 수정을 수행하는 경우의 UI의 예를 도시한 도면이다.

도 16 내지 도 19는 본 실시예에 따라 사용자 제스처에 기반한 텍스트 편집 방법을 설명하는 도면이다.

도 20과 도 21은 본 실시예에 따라 사용자의 터치 제스처에 기반한 문서 편집의 다른 방법을 설명하기 위한 도면이다.1A is a block diagram illustrating a mobile terminal according to the present invention.

1B and 1C are conceptual diagrams illustrating an example of a mobile terminal according to the present invention in different directions.

2 is a conceptual diagram for explaining another example of the

3 is a flowchart illustrating an operation method of a mobile terminal according to an embodiment of the present invention.

4 is a diagram showing an example of an electronic document displayed on the mobile terminal.

5 is a diagram illustrating a user document using information included in an electronic document according to an exemplary embodiment of the present invention.

6 is a flowchart illustrating an operation of analyzing an electronic document and confirming schedule information according to an embodiment of the present invention.

FIG. 7 is a flowchart for explaining a schedule-based speech recognition operation by confirming a schedule from an electronic document according to the present embodiment.

FIGS. 8 to 10 are examples of a UI showing a process of performing schedule confirmation and speech recognition according to the present embodiment.

11 is a flowchart illustrating a method for a user to edit a test of speech recognition result according to another embodiment of the present invention.

FIGS. 12 to 15 are diagrams showing examples of UIs when text modification is performed according to the present embodiment.

16 to 19 are diagrams for explaining a text editing method based on a user gesture according to the present embodiment.

FIGS. 20 and 21 are diagrams for explaining another method of document editing based on the user's touch gesture according to the present embodiment.

이하, 첨부된 도면을 참조하여 본 명세서에 개시된 실시 예를 상세히 설명하되, 도면 부호에 관계없이 동일하거나 유사한 구성요소는 동일한 참조 번호를 부여하고 이에 대한 중복되는 설명은 생략하기로 한다. 이하의 설명에서 사용되는 구성요소에 대한 접미사 "모듈" 및 "부"는 명세서 작성의 용이함만이 고려되어 부여되거나 혼용되는 것으로서, 그 자체로 서로 구별되는 의미 또는 역할을 갖는 것은 아니다. 또한, 본 명세서에 개시된 실시 예를 설명함에 있어서 관련된 공지 기술에 대한 구체적인 설명이 본 명세서에 개시된 실시 예의 요지를 흐릴 수 있다고 판단되는 경우 그 상세한 설명을 생략한다. 또한, 첨부된 도면은 본 명세서에 개시된 실시 예를 쉽게 이해할 수 있도록 하기 위한 것일 뿐, 첨부된 도면에 의해 본 명세서에 개시된 기술적 사상이 제한되지 않으며, 본 발명의 사상 및 기술 범위에 포함되는 모든 변경, 균등물 내지 대체물을 포함하는 것으로 이해되어야 한다.Hereinafter, embodiments of the present invention will be described in detail with reference to the accompanying drawings, wherein like reference numerals are used to designate identical or similar elements, and redundant description thereof will be omitted. The suffix "module" and " part "for the components used in the following description are given or mixed in consideration of ease of specification, and do not have their own meaning or role. In the following description of the embodiments of the present invention, a detailed description of related arts will be omitted when it is determined that the gist of the embodiments disclosed herein may be blurred. It is to be understood that both the foregoing general description and the following detailed description are exemplary and explanatory and are intended to provide further explanation of the invention as claimed. , ≪ / RTI > equivalents, and alternatives.

제1, 제2 등과 같이 서수를 포함하는 용어는 다양한 구성요소들을 설명하는데 사용될 수 있지만, 상기 구성요소들은 상기 용어들에 의해 한정되지는 않는다. 상기 용어들은 하나의 구성요소를 다른 구성요소로부터 구별하는 목적으로만 사용된다.Terms including ordinals, such as first, second, etc., may be used to describe various elements, but the elements are not limited to these terms. The terms are used only for the purpose of distinguishing one component from another.

어떤 구성요소가 다른 구성요소에 "연결되어" 있다거나 "접속되어" 있다고 언급된 때에는, 그 다른 구성요소에 직접적으로 연결되어 있거나 또는 접속되어 있을 수도 있지만, 중간에 다른 구성요소가 존재할 수도 있다고 이해되어야 할 것이다. 반면에, 어떤 구성요소가 다른 구성요소에 "직접 연결되어" 있다거나 "직접 접속되어" 있다고 언급된 때에는, 중간에 다른 구성요소가 존재하지 않는 것으로 이해되어야 할 것이다.It is to be understood that when an element is referred to as being "connected" or "connected" to another element, it may be directly connected or connected to the other element, . On the other hand, when an element is referred to as being "directly connected" or "directly connected" to another element, it should be understood that there are no other elements in between.

단수의 표현은 문맥상 명백하게 다르게 뜻하지 않는 한, 복수의 표현을 포함한다.The singular expressions include plural expressions unless the context clearly dictates otherwise.

본 출원에서, "포함한다" 또는 "가지다" 등의 용어는 명세서상에 기재된 특징, 숫자, 단계, 동작, 구성요소, 부품 또는 이들을 조합한 것이 존재함을 지정하려는 것이지, 하나 또는 그 이상의 다른 특징들이나 숫자, 단계, 동작, 구성요소, 부품 또는 이들을 조합한 것들의 존재 또는 부가 가능성을 미리 배제하지 않는 것으로 이해되어야 한다.In the present application, the terms "comprises", "having", and the like are used to specify that a feature, a number, a step, an operation, an element, a component, But do not preclude the presence or addition of one or more other features, integers, steps, operations, elements, components, or combinations thereof.

본 명세서에서 설명되는 이동 단말기에는 휴대폰, 스마트 폰(smart phone), 노트북 컴퓨터(laptop computer), 디지털방송용 단말기, PDA(personal digital assistants), PMP(portable multimedia player), 네비게이션, 슬레이트 PC(slate PC), 태블릿 PC(tablet PC), 울트라북(ultrabook), 웨어러블 디바이스(wearable device, 예를 들어, 워치형 단말기 (smartwatch), 글래스형 단말기 (smart glass), HMD(head mounted display)) 등이 포함될 수 있다.The mobile terminal described in this specification includes a mobile phone, a smart phone, a laptop computer, a digital broadcasting terminal, a personal digital assistant (PDA), a portable multimedia player (PMP), a navigation device, a slate PC A tablet PC, an ultrabook, a wearable device such as a smartwatch, a smart glass, and a head mounted display (HMD). have.

그러나, 본 명세서에 기재된 실시 예에 따른 구성은 이동 단말기에만 적용 가능한 경우를 제외하면, 디지털 TV, 데스크탑 컴퓨터, 디지털 사이니지 등과 같은 고정 단말기에도 적용될 수도 있음을 본 기술분야의 당업자라면 쉽게 알 수 있을 것이다.However, it will be appreciated by those skilled in the art that the configuration according to the embodiments described herein may be applied to fixed terminals such as a digital TV, a desktop computer, a digital signage, and the like, will be.

도 1a 내지 도 1c를 참조하면, 도 1a는 본 발명과 관련된 이동 단말기를 설명하기 위한 블록도이고, 도 1b 및 1c는 본 발명과 관련된 이동 단말기의 일 예를 서로 다른 방향에서 바라본 개념도이다.1A to 1C are block diagrams for explaining a mobile terminal according to the present invention, and FIGS. 1B and 1C are conceptual diagrams showing an example of a mobile terminal according to the present invention in different directions.

상기 이동 단말기(100)는 무선 통신부(110), 입력부(120), 센싱부(140), 출력부(150), 인터페이스부(160), 메모리(170), 제어부(180) 및 전원 공급부(190) 등을 포함할 수 있다. 도 1a에 도시된 구성요소들은 이동 단말기를 구현하는데 있어서 필수적인 것은 아니어서, 본 명세서 상에서 설명되는 이동 단말기는 위에서 열거된 구성요소들 보다 많거나, 또는 적은 구성요소들을 가질 수 있다.The

보다 구체적으로, 상기 구성요소들 중 무선 통신부(110)는, 이동 단말기(100)와 무선 통신 시스템 사이, 이동 단말기(100)와 다른 이동 단말기(100) 사이, 또는 이동 단말기(100)와 외부서버 사이의 무선 통신을 가능하게 하는 하나 이상의 모듈을 포함할 수 있다. 또한, 상기 무선 통신부(110)는, 이동 단말기(100)를 하나 이상의 네트워크에 연결하는 하나 이상의 모듈을 포함할 수 있다.The

이러한 무선 통신부(110)는, 방송 수신 모듈(111), 이동통신 모듈(112), 무선 인터넷 모듈(113), 근거리 통신 모듈(114), 위치정보 모듈(115) 중 적어도 하나를 포함할 수 있다.The

입력부(120)는, 영상 신호 입력을 위한 카메라(121) 또는 영상 입력부, 오디오 신호 입력을 위한 마이크로폰(microphone, 122), 또는 오디오 입력부, 사용자로부터 정보를 입력받기 위한 사용자 입력부(123, 예를 들어, 터치키(touch key), 푸시키(mechanical key) 등)를 포함할 수 있다. 입력부(120)에서 수집한 음성 데이터나 이미지 데이터는 분석되어 사용자의 제어명령으로 처리될 수 있다.The

센싱부(140)는 이동 단말기 내 정보, 이동 단말기를 둘러싼 주변 환경 정보 및 사용자 정보 중 적어도 하나를 센싱하기 위한 하나 이상의 센서를 포함할 수 있다. 예를 들어, 센싱부(140)는 근접센서(141, proximity sensor), 조도 센서(142, illumination sensor), 터치 센서(touch sensor), 가속도 센서(acceleration sensor), 자기 센서(magnetic sensor), 중력 센서(G-sensor), 자이로스코프 센서(gyroscope sensor), 모션 센서(motion sensor), RGB 센서, 적외선 센서(IR 센서: infrared sensor), 지문인식 센서(finger scan sensor), 초음파 센서(ultrasonic sensor), 광 센서(optical sensor, 예를 들어, 카메라(121 참조)), 마이크로폰(microphone, 122 참조), 배터리 게이지(battery gauge), 환경 센서(예를 들어, 기압계, 습도계, 온도계, 방사능 감지 센서, 열 감지 센서, 가스 감지 센서 등), 화학 센서(예를 들어, 전자 코, 헬스케어 센서, 생체 인식 센서 등) 중 적어도 하나를 포함할 수 있다. 한편, 본 명세서에 개시된 이동 단말기는, 이러한 센서들 중 적어도 둘 이상의 센서에서 센싱되는 정보들을 조합하여 활용할 수 있다.The

출력부(150)는 시각, 청각 또는 촉각 등과 관련된 출력을 발생시키기 위한 것으로, 디스플레이부(151), 음향 출력부(152), 햅팁 모듈(153), 광 출력부(154) 중 적어도 하나를 포함할 수 있다. 디스플레이부(151)는 터치 센서와 상호 레이어 구조를 이루거나 일체형으로 형성됨으로써, 터치 스크린을 구현할 수 있다. 이러한 터치 스크린은, 이동 단말기(100)와 사용자 사이의 입력 인터페이스를 제공하는 사용자 입력부(123)로써 기능함과 동시에, 이동 단말기(100)와 사용자 사이의 출력 인터페이스를 제공할 수 있다.The

인터페이스부(160)는 이동 단말기(100)에 연결되는 다양한 종류의 외부 기기와의 통로 역할을 수행한다. 이러한 인터페이스부(160)는, 유/무선 헤드셋 포트(port), 외부 충전기 포트(port), 유/무선 데이터 포트(port), 메모리 카드(memory card) 포트, 식별 모듈이 구비된 장치를 연결하는 포트(port), 오디오 I/O(Input/Output) 포트(port), 비디오 I/O(Input/Output) 포트(port), 이어폰 포트(port) 중 적어도 하나를 포함할 수 있다. 이동 단말기(100)에서는, 상기 인터페이스부(160)에 외부 기기가 연결되는 것에 대응하여, 연결된 외부 기기와 관련된 적절할 제어를 수행할 수 있다.The

또한, 메모리(170)는 이동 단말기(100)의 다양한 기능을 지원하는 데이터를 저장한다. 메모리(170)는 이동 단말기(100)에서 구동되는 다수의 응용 프로그램(application program 또는 애플리케이션(application)), 이동 단말기(100)의 동작을 위한 데이터들, 명령어들을 저장할 수 있다. 이러한 응용 프로그램 중 적어도 일부는, 무선 통신을 통해 외부 서버로부터 다운로드 될 수 있다. 또한 이러한 응용 프로그램 중 적어도 일부는, 이동 단말기(100)의 기본적인 기능(예를 들어, 전화 착신, 발신 기능, 메시지 수신, 발신 기능)을 위하여 출고 당시부터 이동 단말기(100)상에 존재할 수 있다. 한편, 응용 프로그램은, 메모리(170)에 저장되고, 이동 단말기(100) 상에 설치되어, 제어부(180)에 의하여 상기 이동 단말기의 동작(또는 기능)을 수행하도록 구동될 수 있다.In addition, the

제어부(180)는 상기 응용 프로그램과 관련된 동작 외에도, 통상적으로 이동 단말기(100)의 전반적인 동작을 제어한다. 제어부(180)는 위에서 살펴본 구성요소들을 통해 입력 또는 출력되는 신호, 데이터, 정보 등을 처리하거나 메모리(170)에 저장된 응용 프로그램을 구동함으로써, 사용자에게 적절한 정보 또는 기능을 제공 또는 처리할 수 있다.In addition to the operations related to the application program, the

또한, 제어부(180)는 메모리(170)에 저장된 응용 프로그램을 구동하기 위하여, 도 1a와 함께 살펴본 구성요소들 중 적어도 일부를 제어할 수 있다. 나아가, 제어부(180)는 상기 응용 프로그램의 구동을 위하여, 이동 단말기(100)에 포함된 구성요소들 중 적어도 둘 이상을 서로 조합하여 동작시킬 수 있다.In addition, the

전원공급부(190)는 제어부(180)의 제어 하에서, 외부의 전원, 내부의 전원을 인가 받아 이동 단말기(100)에 포함된 각 구성요소들에 전원을 공급한다. 이러한 전원공급부(190)는 배터리를 포함하며, 상기 배터리는 내장형 배터리 또는 교체가능한 형태의 배터리가 될 수 있다.The

상기 각 구성요소들 중 적어도 일부는, 이하에서 설명되는 다양한 실시 예들에 따른 이동 단말기의 동작, 제어, 또는 제어방법을 구현하기 위하여 서로 협력하여 동작할 수 있다. 또한, 상기 이동 단말기의 동작, 제어, 또는 제어방법은 상기 메모리(170)에 저장된 적어도 하나의 응용 프로그램의 구동에 의하여 이동 단말기 상에서 구현될 수 있다.At least some of the components may operate in cooperation with one another to implement a method of operation, control, or control of a mobile terminal according to various embodiments described below. In addition, the operation, control, or control method of the mobile terminal may be implemented on the mobile terminal by driving at least one application program stored in the

이하에서는, 위에서 살펴본 이동 단말기(100)를 통하여 구현되는 다양한 실시 예들을 살펴보기에 앞서, 위에서 열거된 구성요소들에 대하여 도 1a를 참조하여 보다 구체적으로 살펴본다.Hereinafter, the various components of the

먼저, 무선 통신부(110)에 대하여 살펴보면, 무선 통신부(110)의 방송 수신 모듈(111)은 방송 채널을 통하여 외부의 방송 관리 서버로부터 방송 신호 및/또는 방송 관련된 정보를 수신한다. 상기 방송 채널은 위성 채널, 지상파 채널을 포함할 수 있다. 적어도 두 개의 방송 채널들에 대한 동시 방송 수신 또는 방송 채널 스위칭을 위해 둘 이상의 상기 방송 수신 모듈이 상기 이동단말기(100)에 제공될 수 있다.First, referring to the

이동통신 모듈(112)은, 이동통신을 위한 기술표준들 또는 통신방식(예를 들어, GSM(Global System for Mobile communication), CDMA(Code Division Multi Access), CDMA2000(Code Division Multi Access 2000), EV-DO(Enhanced Voice-Data Optimized or Enhanced Voice-Data Only), WCDMA(Wideband CDMA), HSDPA(High Speed Downlink Packet Access), HSUPA(High Speed Uplink Packet Access), LTE(Long Term Evolution), LTE-A(Long Term Evolution-Advanced) 등)에 따라 구축된 이동 통신망 상에서 기지국, 외부의 단말, 서버 중 적어도 하나와 무선 신호를 송수신한다.The

상기 무선 신호는, 음성 호 신호, 화상 통화 호 신호 또는 문자/멀티미디어 메시지 송수신에 따른 다양한 형태의 데이터를 포함할 수 있다.The wireless signal may include various types of data depending on a voice call signal, a video call signal or a text / multimedia message transmission / reception.

무선 인터넷 모듈(113)은 무선 인터넷 접속을 위한 모듈을 말하는 것으로, 이동 단말기(100)에 내장되거나 외장될 수 있다. 무선 인터넷 모듈(113)은 무선 인터넷 기술들에 따른 통신망에서 무선 신호를 송수신하도록 이루어진다.The wireless Internet module 113 is a module for wireless Internet access, and may be built in or externally attached to the

무선 인터넷 기술로는, 예를 들어 WLAN(Wireless LAN), Wi-Fi(Wireless-Fidelity), Wi-Fi(Wireless Fidelity) Direct, DLNA(Digital Living Network Alliance), WiBro(Wireless Broadband), WiMAX(World Interoperability for Microwave Access), HSDPA(High Speed Downlink Packet Access), HSUPA(High Speed Uplink Packet Access), LTE(Long Term Evolution), LTE-A(Long Term Evolution-Advanced) 등이 있으며, 상기 무선 인터넷 모듈(113)은 상기에서 나열되지 않은 인터넷 기술까지 포함한 범위에서 적어도 하나의 무선 인터넷 기술에 따라 데이터를 송수신하게 된다.Wireless Internet technologies include, for example, wireless LAN (WLAN), wireless fidelity (Wi-Fi), wireless fidelity (Wi-Fi) Direct, DLNA (Digital Living Network Alliance), WiBro Interoperability for Microwave Access, High Speed Downlink Packet Access (HSDPA), High Speed Uplink Packet Access (HSUPA), Long Term Evolution (LTE) and Long Term Evolution-Advanced (LTE-A) 113 transmit and receive data according to at least one wireless Internet technology, including Internet technologies not listed above.

WiBro, HSDPA, HSUPA, GSM, CDMA, WCDMA, LTE, LTE-A 등에 의한 무선인터넷 접속은 이동통신망을 통해 이루어진다는 관점에서 본다면, 상기 이동통신망을 통해 무선인터넷 접속을 수행하는 상기 무선 인터넷 모듈(113)은 상기 이동통신 모듈(112)의 일종으로 이해될 수도 있다.The wireless Internet module 113 for performing a wireless Internet connection through the mobile communication network can be used for wireless Internet access by WiBro, HSDPA, HSUPA, GSM, CDMA, WCDMA, LTE or LTE- May be understood as a kind of the

근거리 통신 모듈(114)은 근거리 통신(Short range communication)을 위한 것으로서, 블루투스(Bluetooth™), RFID(Radio Frequency Identification), 적외선 통신(Infrared Data Association; IrDA), UWB(Ultra Wideband), ZigBee, NFC(Near Field Communication), Wi-Fi(Wireless-Fidelity), Wi-Fi Direct, Wireless USB(Wireless Universal Serial Bus) 기술 중 적어도 하나를 이용하여, 근거리 통신을 지원할 수 있다. 이러한, 근거리 통신 모듈(114)은, 근거리 무선 통신망(Wireless Area Networks)을 통해 이동 단말기(100)와 무선 통신 시스템 사이, 이동 단말기(100)와 다른 이동 단말기(100) 사이, 또는 이동 단말기(100)와 다른 이동 단말기(100, 또는 외부서버)가 위치한 네트워크 사이의 무선 통신을 지원할 수 있다. 상기 근거리 무선 통신망은 근거리 무선 개인 통신망(Wireless Personal Area Networks)일 수 있다.The short-

여기에서, 다른 이동 단말기(100)는 본 발명에 따른 이동 단말기(100)와 데이터를 상호 교환하는 것이 가능한(또는 연동 가능한) 웨어러블 디바이스(wearable device, 예를 들어, 스마트워치(smartwatch), 스마트 글래스(smart glass), HMD(head mounted display))가 될 수 있다. 근거리 통신 모듈(114)은, 이동 단말기(100) 주변에, 상기 이동 단말기(100)와 통신 가능한 웨어러블 디바이스를 감지(또는 인식)할 수 있다. 나아가, 제어부(180)는 상기 감지된 웨어러블 디바이스가 본 발명에 따른 이동 단말기(100)와 통신하도록 인증된 디바이스인 경우, 이동 단말기(100)에서 처리되는 데이터의 적어도 일부를, 상기 근거리 통신 모듈(114)을 통해 웨어러블 디바이스로 전송할 수 있다. 따라서, 웨어러블 디바이스의 사용자는, 이동 단말기(100)에서 처리되는 데이터를, 웨어러블 디바이스를 통해 이용할 수 있다. 예를 들어, 이에 따르면 사용자는, 이동 단말기(100)에 전화가 수신된 경우, 웨어러블 디바이스를 통해 전화 통화를 수행하거나, 이동 단말기(100)에 메시지가 수신된 경우, 웨어러블 디바이스를 통해 상기 수신된 메시지를 확인하는 것이 가능하다.Here, the other

위치정보 모듈(115)은 이동 단말기의 위치(또는 현재 위치)를 획득하기 위한 모듈로서, 그의 대표적인 예로는 GPS(Global Positioning System) 모듈 또는 WiFi(Wireless Fidelity) 모듈이 있다. 예를 들어, 이동 단말기는 GPS모듈을 활용하면, GPS 위성에서 보내는 신호를 이용하여 이동 단말기의 위치를 획득할 수 있다. 다른 예로서, 이동 단말기는 Wi-Fi모듈을 활용하면, Wi-Fi모듈과 무선신호를 송신 또는 수신하는 무선 AP(Wireless Access Point)의 정보에 기반하여, 이동 단말기의 위치를 획득할 수 있다. 필요에 따라서, 위치정보모듈(115)은 치환 또는 부가적으로 이동 단말기의 위치에 관한 데이터를 얻기 위해 무선 통신부(110)의 다른 모듈 중 어느 기능을 수행할 수 있다. 위치정보모듈(115)은 이동 단말기의 위치(또는 현재 위치)를 획득하기 위해 이용되는 모듈로, 이동 단말기의 위치를 직접적으로 계산하거나 획득하는 모듈로 한정되지는 않는다.The

다음으로, 입력부(120)는 영상 정보(또는 신호), 오디오 정보(또는 신호), 데이터, 또는 사용자로부터 입력되는 정보의 입력을 위한 것으로서, 영상 정보의 입력을 위하여, 이동 단말기(100) 는 하나 또는 복수의 카메라(121)를 구비할 수 있다. 카메라(121)는 화상 통화모드 또는 촬영 모드에서 이미지 센서에 의해 얻어지는 정지영상 또는 동영상 등의 화상 프레임을 처리한다. 처리된 화상 프레임은 디스플레이부(151)에 표시되거나 메모리(170)에 저장될 수 있다. 한편, 이동 단말기(100)에 구비되는 복수의 카메라(121)는 매트릭스 구조를 이루도록 배치될 수 있으며, 이와 같이 매트릭스 구조를 이루는 카메라(121)를 통하여, 이동 단말기(100)에는 다양한 각도 또는 초점을 갖는 복수의 영상정보가 입력될 수 있다. 또한, 복수의 카메라(121)는 입체영상을 구현하기 위한 좌 영상 및 우 영상을 획득하도록, 스트레오 구조로 배치될 수 있다.Next, the

마이크로폰(122)은 외부의 음향 신호를 전기적인 음성 데이터로 처리한다. 처리된 음성 데이터는 이동 단말기(100)에서 수행 중인 기능(또는 실행 중인 응용 프로그램)에 따라 다양하게 활용될 수 있다. 한편, 마이크로폰(122)에는 외부의 음향 신호를 입력 받는 과정에서 발생되는 잡음(noise)을 제거하기 위한 다양한 잡음 제거 알고리즘이 구현될 수 있다.The

사용자 입력부(123)는 사용자로부터 정보를 입력받기 위한 것으로서, 사용자 입력부(123)를 통해 정보가 입력되면, 제어부(180)는 입력된 정보에 대응되도록 이동 단말기(100)의 동작을 제어할 수 있다. 이러한, 사용자 입력부(123)는 기계식 (mechanical) 입력수단(또는, 메커니컬 키, 예를 들어, 이동 단말기(100)의 전·후면 또는 측면에 위치하는 버튼, 돔 스위치 (dome switch), 조그 휠, 조그 스위치 등) 및 터치식 입력수단을 포함할 수 있다. 일 예로서, 터치식 입력수단은, 소프트웨어적인 처리를 통해 터치스크린에 표시되는 가상 키(virtual key), 소프트 키(soft key) 또는 비주얼 키(visual key)로 이루어지거나, 상기 터치스크린 이외의 부분에 배치되는 터치 키(touch key)로 이루어질 수 있다. 한편, 상기 가상키 또는 비주얼 키는, 다양한 형태를 가지면서 터치스크린 상에 표시되는 것이 가능하며, 예를 들어, 그래픽(graphic), 텍스트(text), 아이콘(icon), 비디오(video) 또는 이들의 조합으로 이루어질 수 있다.The

한편, 센싱부(140)는 이동 단말기 내 정보, 이동 단말기를 둘러싼 주변 환경 정보 및 사용자 정보 중 적어도 하나를 센싱하고, 이에 대응하는 센싱 신호를 발생시킨다. 제어부(180)는 이러한 센싱 신호에 기초하여, 이동 단말기(100)의 구동 또는 동작을 제어하거나, 이동 단말기(100)에 설치된 응용 프로그램과 관련된 데이터 처리, 기능 또는 동작을 수행 할 수 있다. 센싱부(140)에 포함될 수 있는 다양한 센서 중 대표적인 센서들의 대하여, 보다 구체적으로 살펴본다.Meanwhile, the

먼저, 근접 센서(141)는 소정의 검출면에 접근하는 물체, 혹은 근방에 존재하는 물체의 유무를 전자계의 힘 또는 적외선 등을 이용하여 기계적 접촉이 없이 검출하는 센서를 말한다. 이러한 근접 센서(141)는 위에서 살펴본 터치 스크린에 의해 감싸지는 이동 단말기의 내부 영역 또는 상기 터치 스크린의 근처에 근접 센서(141)가 배치될 수 있다.First, the

근접 센서(141)의 예로는 투과형 광전 센서, 직접 반사형 광전 센서, 미러 반사형 광전 센서, 고주파 발진형 근접 센서, 정전 용량형 근접 센서, 자기형 근접 센서, 적외선 근접 센서 등이 있다. 터치 스크린이 정전식인 경우에, 근접 센서(141)는 전도성을 갖는 물체의 근접에 따른 전계의 변화로 상기 물체의 근접을 검출하도록 구성될 수 있다. 이 경우 터치 스크린(또는 터치 센서) 자체가 근접 센서로 분류될 수 있다.Examples of the

한편, 설명의 편의를 위해, 터치 스크린 상에 물체가 접촉되지 않으면서 근접되어 상기 물체가 상기 터치 스크린 상에 위치함이 인식되도록 하는 행위를 "근접 터치(proximity touch)"라고 명명하고, 상기 터치 스크린 상에 물체가 실제로 접촉되는 행위를 "접촉 터치(contact touch)"라고 명명한다. 상기 터치 스크린 상에서 물체가 근접 터치 되는 위치라 함은, 상기 물체가 근접 터치될 때 상기 물체가 상기 터치 스크린에 대해 수직으로 대응되는 위치를 의미한다. 상기 근접 센서(141)는, 근접 터치와, 근접 터치 패턴(예를 들어, 근접 터치 거리, 근접 터치 방향, 근접 터치 속도, 근접 터치 시간, 근접 터치 위치, 근접 터치 이동 상태 등)을 감지할 수 있다. 한편, 제어부(180)는 위와 같이, 근접 센서(141)를 통해 감지된 근접 터치 동작 및 근접 터치 패턴에 상응하는 데이터(또는 정보)를 처리하며, 나아가, 처리된 데이터에 대응하는 시각적인 정보를 터치 스크린상에 출력시킬 수 있다. 나아가, 제어부(180)는, 터치 스크린 상의 동일한 지점에 대한 터치가, 근접 터치인지 또는 접촉 터치인지에 따라, 서로 다른 동작 또는 데이터(또는 정보)가 처리되도록 이동 단말기(100)를 제어할 수 있다.On the other hand, for convenience of explanation, the act of recognizing that the object is located on the touch screen in proximity with no object touching the touch screen is referred to as "proximity touch & The act of actually touching an object on the screen is called a "contact touch. &Quot; The position at which the object is closely touched on the touch screen means a position where the object corresponds to the touch screen vertically when the object is touched. The

터치 센서는 저항막 방식, 정전용량 방식, 적외선 방식, 초음파 방식, 자기장 방식 등 여러 가지 터치방식 중 적어도 하나를 이용하여 터치 스크린(또는 디스플레이부(151))에 가해지는 터치(또는 터치입력)을 감지한다.The touch sensor uses a touch (or touch input) applied to the touch screen (or the display unit 151) by using at least one of various touch methods such as a resistance film type, a capacitive type, an infrared type, an ultrasonic type, Detection.

일 예로서, 터치 센서는, 터치 스크린의 특정 부위에 가해진 압력 또는 특정 부위에 발생하는 정전 용량 등의 변화를 전기적인 입력신호로 변환하도록 구성될 수 있다. 터치 센서는, 터치 스크린 상에 터치를 가하는 터치 대상체가 터치 센서 상에 터치 되는 위치, 면적, 터치 시의 압력, 터치 시의 정전 용량 등을 검출할 수 있도록 구성될 수 있다. 여기에서, 터치 대상체는 상기 터치 센서에 터치를 인가하는 물체로서, 예를 들어, 손가락, 터치펜 또는 스타일러스 펜(Stylus pen), 포인터 등이 될 수 있다.For example, the touch sensor may be configured to convert a change in a pressure applied to a specific portion of the touch screen or a capacitance generated in a specific portion to an electrical input signal. The touch sensor may be configured to detect a position, an area, a pressure at the time of touch, a capacitance at the time of touch, and the like where a touch object touching the touch screen is touched on the touch sensor. Here, the touch object may be a finger, a touch pen, a stylus pen, a pointer, or the like as an object to which a touch is applied to the touch sensor.

이와 같이, 터치 센서에 대한 터치 입력이 있는 경우, 그에 대응하는 신호(들)는 터치 제어기로 보내진다. 터치 제어기는 그 신호(들)를 처리한 다음 대응하는 데이터를 제어부(180)로 전송한다. 이로써, 제어부(180)는 디스플레이부(151)의 어느 영역이 터치 되었는지 여부 등을 알 수 있게 된다. 여기에서, 터치 제어기는, 제어부(180)와 별도의 구성요소일 수 있고, 제어부(180) 자체일 수 있다.Thus, when there is a touch input to the touch sensor, the corresponding signal (s) is sent to the touch controller. The touch controller processes the signal (s) and transmits the corresponding data to the

한편, 제어부(180)는, 터치 스크린(또는 터치 스크린 이외에 구비된 터치키)을 터치하는, 터치 대상체의 종류에 따라 서로 다른 제어를 수행하거나, 동일한 제어를 수행할 수 있다. 터치 대상체의 종류에 따라 서로 다른 제어를 수행할지 또는 동일한 제어를 수행할 지는, 현재 이동 단말기(100)의 동작상태 또는 실행 중인 응용 프로그램에 따라 결정될 수 있다.On the other hand, the

한편, 위에서 살펴본 터치 센서 및 근접 센서는 독립적으로 또는 조합되어, 터치 스크린에 대한 숏(또는 탭) 터치(short touch), 롱 터치(long touch), 멀티 터치(multi touch), 드래그 터치(drag touch), 플리크 터치(flick touch), 핀치-인 터치(pinch-in touch), 핀치-아웃 터치(pinch-out 터치), 스와이프(swype) 터치, 호버링(hovering) 터치 등과 같은, 다양한 방식의 터치를 센싱할 수 있다.On the other hand, the touch sensors and the proximity sensors discussed above can be used independently or in combination to provide a short touch (touch), a long touch, a multi touch, a drag touch ), Flick touch, pinch-in touch, pinch-out touch, swipe touch, hovering touch, and the like. Touch can be sensed.

초음파 센서는 초음파를 이용하여, 감지대상의 위치정보를 인식할 수 있다. 한편 제어부(180)는 광 센서와 복수의 초음파 센서로부터 감지되는 정보를 통해, 파동 발생원의 위치를 산출하는 것이 가능하다. 파동 발생원의 위치는, 광이 초음파보다 매우 빠른 성질, 즉, 광이 광 센서에 도달하는 시간이 초음파가 초음파 센서에 도달하는 시간보다 매우 빠름을 이용하여, 산출될 수 있다. 보다 구체적으로 광을 기준 신호로 초음파가 도달하는 시간과의 시간차를 이용하여 파동 발생원의 위치가 산출될 수 있다.The ultrasonic sensor can recognize the position information of the object to be sensed by using ultrasonic waves. Meanwhile, the

한편, 입력부(120)의 구성으로 살펴본, 카메라(121)는 카메라 센서(예를 들어, CCD, CMOS 등), 포토 센서(또는 이미지 센서) 및 레이저 센서 중 적어도 하나를 포함한다.The

카메라(121)와 레이저 센서는 서로 조합되어, 3차원 입체영상에 대한 감지대상의 터치를 감지할 수 있다. 포토 센서는 디스플레이 소자에 적층될 수 있는데, 이러한 포토 센서는 터치 스크린에 근접한 감지대상의 움직임을 스캐닝하도록 이루어진다. 보다 구체적으로, 포토 센서는 행/열에 Photo Diode와 TR(Transistor)를 실장하여 Photo Diode에 인가되는 빛의 양에 따라 변화되는 전기적 신호를 이용하여 포토 센서 위에 올려지는 내용물을 스캔한다. 즉, 포토 센서는 빛의 변화량에 따른 감지대상의 좌표 계산을 수행하며, 이를 통하여 감지대상의 위치정보가 획득될 수 있다.The

디스플레이부(151)는 이동 단말기(100)에서 처리되는 정보를 표시(출력)한다. 예를 들어, 디스플레이부(151)는 이동 단말기(100)에서 구동되는 응용 프로그램의 실행화면 정보, 또는 이러한 실행화면 정보에 따른 UI(User Interface), GUI(Graphic User Interface) 정보를 표시할 수 있다.The

또한, 상기 디스플레이부(151)는 입체영상을 표시하는 입체 디스플레이부로서 구성될 수 있다.Also, the

상기 입체 디스플레이부에는 스테레오스코픽 방식(안경 방식), 오토 스테레오스코픽 방식(무안경 방식), 프로젝션 방식(홀로그래픽 방식) 등의 3차원 디스플레이 방식이 적용될 수 있다.In the stereoscopic display unit, a three-dimensional display system such as a stereoscopic system (glasses system), an autostereoscopic system (no-glasses system), and a projection system (holographic system) can be applied.

음향 출력부(152)는 호신호 수신, 통화모드 또는 녹음 모드, 음성인식 모드, 방송수신 모드 등에서 무선 통신부(110)로부터 수신되거나 메모리(170)에 저장된 오디오 데이터를 출력할 수 있다. 음향 출력부(152)는 이동 단말기(100)에서 수행되는 기능(예를 들어, 호신호 수신음, 메시지 수신음 등)과 관련된 음향 신호를 출력하기도 한다. 이러한 음향 출력부(152)에는 리시버(receiver), 스피커(speaker), 버저(buzzer) 등이 포함될 수 있다.The

햅틱 모듈(haptic module)(153)은 사용자가 느낄 수 있는 다양한 촉각 효과를 발생시킨다. 햅틱 모듈(153)이 발생시키는 촉각 효과의 대표적인 예로는 진동이 될 수 있다. 햅틱 모듈(153)에서 발생하는 진동의 세기와 패턴 등은 사용자의 선택 또는 제어부의 설정에 의해 제어될 수 있다. 예를 들어, 상기 햅틱 모듈(153)은 서로 다른 진동을 합성하여 출력하거나 순차적으로 출력할 수도 있다.The

햅틱 모듈(153)은, 진동 외에도, 접촉 피부면에 대해 수직 운동하는 핀 배열, 분사구나 흡입구를 통한 공기의 분사력이나 흡입력, 피부 표면에 대한 스침, 전극(electrode)의 접촉, 정전기력 등의 자극에 의한 효과와, 흡열이나 발열 가능한 소자를 이용한 냉온감 재현에 의한 효과 등 다양한 촉각 효과를 발생시킬 수 있다.In addition to vibration, the

햅틱 모듈(153)은 직접적인 접촉을 통해 촉각 효과를 전달할 수 있을 뿐만 아니라, 사용자가 손가락이나 팔 등의 근 감각을 통해 촉각 효과를 느낄 수 있도록 구현할 수도 있다. 햅틱 모듈(153)은 이동 단말기(100)의 구성 태양에 따라 2개 이상이 구비될 수 있다.The

광출력부(154)는 이동 단말기(100)의 광원의 빛을 이용하여 이벤트 발생을 알리기 위한 신호를 출력한다. 이동 단말기(100)에서 발생 되는 이벤트의 예로는 메시지 수신, 호 신호 수신, 부재중 전화, 알람, 일정 알림, 이메일 수신, 애플리케이션을 통한 정보 수신 등이 될 수 있다.The

광출력부(154)가 출력하는 신호는 이동 단말기가 전면이나 후면으로 단색이나 복수색의 빛을 발광함에 따라 구현된다. 상기 신호 출력은 이동 단말기가 사용자의 이벤트 확인을 감지함에 의하여 종료될 수 있다.The signal output from the

인터페이스부(160)는 이동 단말기(100)에 연결되는 모든 외부 기기와의 통로 역할을 한다. 인터페이스부(160)는 외부 기기로부터 데이터를 전송받거나, 전원을 공급받아 이동 단말기(100) 내부의 각 구성요소에 전달하거나, 이동 단말기(100) 내부의 데이터가 외부 기기로 전송되도록 한다. 예를 들어, 유/무선 헤드셋 포트(port), 외부 충전기 포트(port), 유/무선 데이터 포트(port), 메모리 카드(memory card) 포트(port), 식별 모듈이 구비된 장치를 연결하는 포트(port), 오디오 I/O(Input/Output) 포트(port), 비디오 I/O(Input/Output) 포트(port), 이어폰 포트(port) 등이 인터페이스부(160)에 포함될 수 있다.The

한편, 식별 모듈은 이동 단말기(100)의 사용 권한을 인증하기 위한 각종 정보를 저장한 칩으로서, 사용자 인증 모듈(user identify module; UIM), 가입자 인증 모듈(subscriber identity module; SIM), 범용 사용자 인증 모듈(universal subscriber identity module; USIM) 등을 포함할 수 있다. 식별 모듈이 구비된 장치(이하 '식별 장치')는, 스마트 카드(smart card) 형식으로 제작될 수 있다. 따라서 식별 장치는 상기 인터페이스부(160)를 통하여 단말기(100)와 연결될 수 있다.The identification module is a chip for storing various information for authenticating the use right of the

또한, 상기 인터페이스부(160)는 이동 단말기(100)가 외부 크래들(cradle)과 연결될 때 상기 크래들로부터의 전원이 상기 이동 단말기(100)에 공급되는 통로가 되거나, 사용자에 의해 상기 크래들에서 입력되는 각종 명령 신호가 상기 이동 단말기(100)로 전달되는 통로가 될 수 있다. 상기 크래들로부터 입력되는 각종 명령 신호 또는 상기 전원은 상기 이동 단말기(100)가 상기 크래들에 정확히 장착되었음을 인지하기 위한 신호로 동작될 수 있다.The

메모리(170)는 제어부(180)의 동작을 위한 프로그램을 저장할 수 있고, 입/출력되는 데이터들(예를 들어, 폰북, 메시지, 정지영상, 동영상 등)을 임시 저장할 수도 있다. 상기 메모리(170)는 상기 터치 스크린 상의 터치 입력시 출력되는 다양한 패턴의 진동 및 음향에 관한 데이터를 저장할 수 있다.The

메모리(170)는 플래시 메모리 타입(flash memory type), 하드디스크 타입(hard disk type), SSD 타입(Solid State Disk type), SDD 타입(Silicon Disk Drive type), 멀티미디어 카드 마이크로 타입(multimedia card micro type), 카드 타입의 메모리(예를 들어 SD 또는 XD 메모리 등), 램(random access memory; RAM), SRAM(static random access memory), 롬(read-only memory; ROM), EEPROM(electrically erasable programmable read-only memory), PROM(programmable read-only memory), 자기 메모리, 자기 디스크 및 광디스크 중 적어도 하나의 타입의 저장매체를 포함할 수 있다. 이동 단말기(100)는 인터넷(internet)상에서 상기 메모리(170)의 저장 기능을 수행하는 웹 스토리지(web storage)와 관련되어 동작될 수도 있다.The

한편, 앞서 살펴본 것과 같이, 제어부(180)는 응용 프로그램과 관련된 동작과, 통상적으로 이동 단말기(100)의 전반적인 동작을 제어한다. 예를 들어, 제어부(180)는 상기 이동 단말기의 상태가 설정된 조건을 만족하면, 애플리케이션들에 대한 사용자의 제어 명령의 입력을 제한하는 잠금 상태를 실행하거나, 해제할 수 있다.Meanwhile, as described above, the

또한, 제어부(180)는 음성 통화, 데이터 통신, 화상 통화 등과 관련된 제어 및 처리를 수행하거나, 터치 스크린 상에서 행해지는 필기 입력 또는 그림 그리기 입력을 각각 문자 및 이미지로 인식할 수 있는 패턴 인식 처리를 행할 수 있다. 나아가 제어부(180)는 이하에서 설명되는 다양한 실시 예들을 본 발명에 따른 이동 단말기(100) 상에서 구현하기 위하여, 위에서 살펴본 구성요소들을 중 어느 하나 또는 복수를 조합하여 제어할 수 있다.In addition, the

전원 공급부(190)는 제어부(180)의 제어에 의해 외부의 전원, 내부의 전원을 인가 받아 각 구성요소들의 동작에 필요한 전원을 공급한다. 전원공급부(190)는 배터리를 포함하며, 배터리는 충전 가능하도록 이루어지는 내장형 배터리가 될 수 있으며, 충전 등을 위하여 단말기 바디에 착탈 가능하게 결합될 수 있다.The

또한, 전원공급부(190)는 연결포트를 구비할 수 있으며, 연결포트는 배터리의 충전을 위하여 전원을 공급하는 외부 충전기가 전기적으로 연결되는 인터페이스(160)의 일 예로서 구성될 수 있다.In addition, the

다른 예로서, 전원공급부(190)는 상기 연결포트를 이용하지 않고 무선방식으로 배터리를 충전하도록 이루어질 수 있다. 이 경우에, 전원공급부(190)는 외부의 무선 전력 전송장치로부터 자기 유도 현상에 기초한 유도 결합(Inductive Coupling) 방식이나 전자기적 공진 현상에 기초한 공진 결합(Magnetic Resonance Coupling) 방식 중 하나 이상을 이용하여 전력을 전달받을 수 있다.As another example, the

한편, 이하에서 다양한 실시 예는 예를 들어, 소프트웨어, 하드웨어 또는 이들의 조합된 것을 이용하여 컴퓨터 또는 이와 유사한 장치로 읽을 수 있는 기록매체 내에서 구현될 수 있다.In the following, various embodiments may be embodied in a recording medium readable by a computer or similar device using, for example, software, hardware, or a combination thereof.

도 1 b 및 1c를 참조하면, 개시된 이동 단말기(100)는 바 형태의 단말기 바디를 구비하고 있다. 다만, 본 발명은 여기에 한정되지 않고 와치 타입, 클립 타입, 글래스 타입 또는 2 이상의 바디들이 상대 이동 가능하게 결합되는 폴더 타입, 플립 타입, 슬라이드 타입, 스윙 타입, 스위블 타입 등 다양한 구조에 적용될 수 있다. 이동 단말기의 특정 유형에 관련될 것이나, 이동 단말기의 특정유형에 관한 설명은 다른 타입의 이동 단말기에 일반적으로 적용될 수 있다.Referring to FIGS. 1B and 1C, the disclosed

여기에서, 단말기 바디는 이동 단말기(100)를 적어도 하나의 집합체로 보아 이를 지칭하는 개념으로 이해될 수 있다.Here, the terminal body can be understood as a concept of referring to the

이동 단말기(100)는 외관을 이루는 케이스(예를 들면, 프레임, 하우징, 커버 등)를 포함한다. 도시된 바와 같이, 이동 단말기(100)는 프론트 케이스(101)와 리어 케이스(102)를 포함할 수 있다. 프론트 케이스(101)와 리어 케이스(102)의 결합에 의해 형성되는 내부공간에는 각종 전자부품들이 배치된다. 프론트 케이스(101)와 리어 케이스(102) 사이에는 적어도 하나의 미들 케이스가 추가로 배치될 수 있다.The

단말기 바디의 전면에는 디스플레이부(151)가 배치되어 정보를 출력할 수 있다. 도시된 바와 같이, 디스플레이부(151)의 윈도우(151a)는 프론트 케이스(101)에 장착되어 프론트 케이스(101)와 함께 단말기 바디의 전면을 형성할 수 있다.A

경우에 따라서, 리어 케이스(102)에도 전자부품이 장착될 수 있다. 리어 케이스(102)에 장착 가능한 전자부품은 착탈 가능한 배터리, 식별 모듈, 메모리 카드 등이 있다. 이 경우, 리어 케이스(102)에는 장착된 전자부품을 덮기 위한 후면커버(103)가 착탈 가능하게 결합될 수 있다. 따라서, 후면 커버(103)가 리어 케이스(102)로부터 분리되면, 리어 케이스(102)에 장착된 전자부품은 외부로 노출된다.In some cases, electronic components may also be mounted on the

도시된 바와 같이, 후면커버(103)가 리어 케이스(102)에 결합되면, 리어 케이스(102)의 측면 일부가 노출될 수 있다. 경우에 따라서, 상기 결합시 리어 케이스(102)는 후면커버(103)에 의해 완전히 가려질 수도 있다. 한편, 후면커버(103)에는 카메라(121b)나 음향 출력부(152b)를 외부로 노출시키기 위한 개구부가 구비될 수 있다.As shown, when the

이러한 케이스들(101, 102, 103)은 합성수지를 사출하여 형성되거나 금속, 예를 들어 스테인레스 스틸(STS), 알루미늄(Al), 티타늄(Ti) 등으로 형성될 수도 있다.These

이동 단말기(100)는, 복수의 케이스가 각종 전자부품들을 수용하는 내부 공간을 마련하는 위의 예와 달리, 하나의 케이스가 상기 내부 공간을 마련하도록 구성될 수도 있다. 이 경우, 합성수지 또는 금속이 측면에서 후면으로 이어지는 유니 바디의 이동 단말기(100)가 구현될 수 있다.The

한편, 이동 단말기(100)는 단말기 바디 내부로 물이 스며들지 않도록 하는 방수부(미도시)를 구비할 수 있다. 예를 들어, 방수부는 윈도우(151a)와 프론트 케이스(101) 사이, 프론트 케이스(101)와 리어 케이스(102) 사이 또는 리어 케이스(102)와 후면 커버(103) 사이에 구비되어, 이들의 결합 시 내부 공간을 밀폐하는 방수부재를 포함할 수 있다.Meanwhile, the

이동 단말기(100)에는 디스플레이부(151), 제1 및 제2 음향 출력부(152a, 152b), 근접 센서(141), 조도 센서(142), 광 출력부(154), 제1 및 제2 카메라(121a, 121b), 제1 및 제2 조작유닛(123a, 123b), 마이크로폰(122), 인터페이스부(160) 등이 구비될 수 있다.The

이하에서는, 도 1b 및 도 1c에 도시된 바와 같이, 단말기 바디의 전면에 디스플레이부(151), 제1 음향 출력부(152a), 근접 센서(141), 조도 센서(142), 광 출력부(154), 제1 카메라(121a) 및 제1 조작유닛(123a)이 배치되고, 단말기 바디의 측면에 제2 조작유닛(123b), 마이크로폰(122) 및 인터페이스부(160)이 배치되며, 단말기 바디의 후면에 제2 음향 출력부(152b) 및 제2 카메라(121b)가 배치된 이동 단말기(100)를 일 예로 들어 설명한다.1B and 1C, a

다만, 이들 구성은 이러한 배치에 한정되는 것은 아니다. 이들 구성은 필요에 따라 제외 또는 대체되거나, 다른 면에 배치될 수 있다. 예를 들어, 단말기 바디의 전면에는 제1 조작유닛(123a)이 구비되지 않을 수 있으며, 제2 음향 출력부(152b)는 단말기 바디의 후면이 아닌 단말기 바디의 측면에 구비될 수 있다.However, these configurations are not limited to this arrangement. These configurations may be excluded or replaced as needed, or placed on different planes. For example, the

디스플레이부(151)는 이동 단말기(100)에서 처리되는 정보를 표시(출력)한다. 예를 들어, 디스플레이부(151)는 이동 단말기(100)에서 구동되는 응용 프로그램의 실행화면 정보, 또는 이러한 실행화면 정보에 따른 UI(User Interface), GUI(Graphic User Interface) 정보를 표시할 수 있다.The

디스플레이부(151)는 액정 디스플레이(liquid crystal display, LCD), 박막 트랜지스터 액정 디스플레이(thin film transistor-liquid crystal display, TFT LCD), 유기 발광 다이오드(organic light-emitting diode, OLED), 플렉서블 디스플레이(flexible display), 3차원 디스플레이(3D display), 전자잉크 디스플레이(e-ink display) 중에서 적어도 하나를 포함할 수 있다.The

또한, 디스플레이부(151)는 이동 단말기(100)의 구현 형태에 따라 2개 이상 존재할 수 있다. 이 경우, 이동 단말기(100)에는 복수의 디스플레이부들이 하나의 면에 이격되거나 일체로 배치될 수 있고, 또한 서로 다른 면에 각각 배치될 수도 있다.In addition, the

디스플레이부(151)는 터치 방식에 의하여 제어 명령을 입력 받을 수 있도록, 디스플레이부(151)에 대한 터치를 감지하는 터치센서를 포함할 수 있다. 이를 이용하여, 디스플레이부(151)에 대하여 터치가 이루어지면, 터치센서는 상기 터치를 감지하고, 제어부(180)는 이에 근거하여 상기 터치에 대응하는 제어명령을 발생시키도록 이루어질 수 있다. 터치 방식에 의하여 입력되는 내용은 문자 또는 숫자이거나, 각종 모드에서의 지시 또는 지정 가능한 메뉴항목 등일 수 있다.The

한편, 터치센서는, 터치패턴을 구비하는 필름 형태로 구성되어 윈도우(151a)와 윈도우(151a)의 배면 상의 디스플레이(미도시) 사이에 배치되거나, 윈도우(151a)의 배면에 직접 패터닝되는 메탈 와이어가 될 수도 있다. 또는, 터치센서는 디스플레이와 일체로 형성될 수 있다. 예를 들어, 터치센서는, 디스플레이의 기판 상에 배치되거나, 디스플레이의 내부에 구비될 수 있다.The touch sensor may be a film having a touch pattern and disposed between the

이처럼, 디스플레이부(151)는 터치센서와 함께 터치 스크린을 형성할 수 있으며, 이 경우에 터치 스크린은 사용자 입력부(123, 도 1a 참조)로 기능할 수 있다. 경우에 따라, 터치 스크린은 제1조작유닛(123a)의 적어도 일부 기능을 대체할 수 있다.In this way, the

제1 음향 출력부(152a)는 통화음을 사용자의 귀에 전달시키는 리시버(receiver)로 구현될 수 있으며, 제2 음향 출력부(152b)는 각종 알람음이나 멀티미디어의 재생음을 출력하는 라우드 스피커(loud speaker)의 형태로 구현될 수 있다.The first

디스플레이부(151)의 윈도우(151a)에는 제1 음향 출력부(152a)로부터 발생되는 사운드의 방출을 위한 음향홀이 형성될 수 있다. 다만, 본 발명은 이에 한정되는 것은 아니고, 상기 사운드는 구조물 간의 조립틈(예를 들어, 윈도우(151a)와 프론트 케이스(101) 간의 틈)을 따라 방출되도록 구성될 수 있다. 이 경우, 외관상 음향 출력을 위하여 독립적으로 형성되는 홀이 보이지 않거나 숨겨져 이동 단말기(100)의 외관이 보다 심플해질 수 있다.The

광 출력부(154)는 이벤트의 발생시 이를 알리기 위한 빛을 출력하도록 이루어진다. 상기 이벤트의 예로는 메시지 수신, 호 신호 수신, 부재중 전화, 알람, 일정 알림, 이메일 수신, 애플리케이션을 통한 정보 수신 등을 들 수 있다. 제어부(180)는 사용자의 이벤트 확인이 감지되면, 빛의 출력이 종료되도록 광 출력부(154)를 제어할 수 있다.The

제1 카메라(121a)는 촬영 모드 또는 화상통화 모드에서 이미지 센서에 의해 얻어지는 정지영상 또는 동영상의 화상 프레임을 처리한다. 처리된 화상 프레임은 디스플레이부(151)에 표시될 수 있으며, 메모리(170)에 저장될 수 있다.The

제1 및 제2 조작유닛(123a, 123b)은 이동 단말기(100)의 동작을 제어하기 위한 명령을 입력 받기 위해 조작되는 사용자 입력부(123)의 일 예로서, 조작부(manipulating portion)로도 통칭될 수 있다. 제1 및 제2 조작유닛(123a, 123b)은 터치, 푸시, 스크롤 등 사용자가 촉각적인 느낌을 받으면서 조작하게 되는 방식(tactile manner)이라면 어떤 방식이든 채용될 수 있다. 또한, 제1 및 제2 조작유닛(123a, 123b)은 근접 터치(proximity touch), 호버링(hovering) 터치 등을 통해서 사용자의 촉각적인 느낌이 없이 조작하게 되는 방식으로도 채용될 수 있다.The first and

본 도면에서는 제1 조작유닛(123a)이 터치키(touch key)인 것으로 예시하나, 본 발명이 이에 한정되는 것은 아니다. 예를 들어, 제1 조작유닛(123a)은 푸시키(mechanical key)가 되거나, 터치키와 푸시키의 조합으로 구성될 수 있다.In this figure, the

제1 및 제2 조작유닛(123a, 123b)에 의하여 입력되는 내용은 다양하게 설정될 수 있다. 예를 들어, 제1 조작유닛(123a)은 메뉴, 홈키, 취소, 검색 등의 명령을 입력 받고, 제2 조작유닛(123b)은 제1 또는 제2 음향 출력부(152a, 152b)에서 출력되는 음향의 크기 조절, 디스플레이부(151)의 터치 인식 모드로의 전환 등의 명령을 입력 받을 수 있다.The contents input by the first and

한편, 단말기 바디의 후면에는 사용자 입력부(123)의 다른 일 예로서, 후면 입력부(미도시)가 구비될 수 있다. 이러한 후면 입력부는 이동 단말기(100)의 동작을 제어하기 위한 명령을 입력 받기 위해 조작되는 것으로서, 입력되는 내용은 다양하게 설정될 수 있다. 예를 들어, 전원의 온/오프, 시작, 종료, 스크롤 등과 같은 명령, 제1 및 제2 음향 출력부(152a, 152b)에서 출력되는 음향의 크기 조절, 디스플레이부(151)의 터치 인식 모드로의 전환 등과 같은 명령을 입력 받을 수 있다. 후면 입력부는 터치입력, 푸시입력 또는 이들의 조합에 의한 입력이 가능한 형태로 구현될 수 있다.On the other hand, a rear input unit (not shown) may be provided on the rear surface of the terminal body as another example of the

후면 입력부는 단말기 바디의 두께방향으로 전면의 디스플레이부(151)와 중첩되게 배치될 수 있다. 일 예로, 사용자가 단말기 바디를 한 손으로 쥐었을 때 검지를 이용하여 용이하게 조작 가능하도록, 후면 입력부는 단말기 바디의 후면 상단부에 배치될 수 있다. 다만, 본 발명은 반드시 이에 한정되는 것은 아니며, 후면 입력부의 위치는 변경될 수 있다.The rear input unit may be disposed so as to overlap with the

이처럼 단말기 바디의 후면에 후면 입력부가 구비되는 경우, 이를 이용한 새로운 형태의 유저 인터페이스가 구현될 수 있다. 또한, 앞서 설명한 터치 스크린 또는 후면 입력부가 단말기 바디의 전면에 구비되는 제1 조작유닛(123a)의 적어도 일부 기능을 대체하여, 단말기 바디의 전면에 제1 조작유닛(123a)이 미배치되는 경우, 디스플레이부(151)가 보다 대화면(大畵面)으로 구성될 수 있다.When a rear input unit is provided on the rear surface of the terminal body, a new type of user interface using the rear input unit can be realized. When the

한편, 이동 단말기(100)에는 사용자의 지문을 인식하는 지문인식센서가 구비될 수 있으며, 제어부(180)는 지문인식센서를 통하여 감지되는 지문정보를 인증수단으로 이용할 수 있다. 상기 지문인식센서는 디스플레이부(151) 또는 사용자 입력부(123)에 내장될 수 있다.Meanwhile, the

마이크로폰(122)은 사용자의 음성, 기타 소리 등을 입력 받도록 이루어진다. 마이크로폰(122)은 복수의 개소에 구비되어 스테레오 음향을 입력 받도록 구성될 수 있다.The

인터페이스부(160)는 이동 단말기(100)를 외부기기와 연결시킬 수 있는 통로가 된다. 예를 들어, 인터페이스부(160)는 다른 장치(예를 들어, 이어폰, 외장 스피커)와의 연결을 위한 접속단자, 근거리 통신을 위한 포트[예를 들어, 적외선 포트(IrDA Port), 블루투스 포트(Bluetooth Port), 무선 랜 포트(Wireless LAN Port) 등], 또는 이동 단말기(100)에 전원을 공급하기 위한 전원공급단자 중 적어도 하나일 수 있다. 이러한 인터페이스부(160)는 SIM(Subscriber Identification Module) 또는 UIM(User Identity Module), 정보 저장을 위한 메모리 카드 등의 외장형 카드를 수용하는 소켓의 형태로 구현될 수도 있다.The

단말기 바디의 후면에는 제2카메라(121b)가 배치될 수 있다. 이 경우, 제2카메라(121b)는 제1카메라(121a)와 실질적으로 반대되는 촬영 방향을 가지게 된다.And a

제2카메라(121b)는 적어도 하나의 라인을 따라 배열되는 복수의 렌즈를 포함할 수 있다. 복수의 렌즈는 행렬(matrix) 형식으로 배열될 수도 있다. 이러한 카메라는, '어레이(array) 카메라'로 명명될 수 있다. 제2카메라(121b)가 어레이 카메라로 구성되는 경우, 복수의 렌즈를 이용하여 다양한 방식으로 영상을 촬영할 수 있으며, 보다 나은 품질의 영상을 획득할 수 있다.The

플래시(124)는 제2카메라(121b)에 인접하게 배치될 수 있다. 플래시(124)는 제2카메라(121b)로 피사체를 촬영하는 경우에 피사체를 향하여 빛을 비추게 된다.The

단말기 바디에는 제2 음향 출력부(152b)가 추가로 배치될 수 있다. 제2 음향 출력부(152b)는 제1 음향 출력부(152a)와 함께 스테레오 기능을 구현할 수 있으며, 통화시 스피커폰 모드의 구현을 위하여 사용될 수도 있다.And a second

단말기 바디에는 무선 통신을 위한 적어도 하나의 안테나가 구비될 수 있다. 안테나는 단말기 바디에 내장되거나, 케이스에 형성될 수 있다. 예를 들어, 방송 수신 모듈(111, 도 1a 참조)의 일부를 이루는 안테나는 단말기 바디에서 인출 가능하게 구성될 수 있다. 또는, 안테나는 필름 타입으로 형성되어 후면 커버(103)의 내측면에 부착될 수도 있고, 도전성 재질을 포함하는 케이스가 안테나로서 기능하도록 구성될 수도 있다.The terminal body may be provided with at least one antenna for wireless communication. The antenna may be embedded in the terminal body or formed in the case. For example, an antenna constituting a part of the broadcast receiving module 111 (see FIG. 1A) may be configured to be able to be drawn out from the terminal body. Alternatively, the antenna may be formed in a film type and attached to the inner surface of the

단말기 바디에는 이동 단말기(100)에 전원을 공급하기 위한 전원 공급부(190, 도 1a 참조)가 구비된다. 전원 공급부(190)는 단말기 바디에 내장되거나, 단말기 바디의 외부에서 착탈 가능하게 구성되는 배터리(191)를 포함할 수 있다.The terminal body is provided with a power supply unit 190 (see FIG. 1A) for supplying power to the

배터리(191)는 인터페이스부(160)에 연결되는 전원 케이블을 통하여 전원을 공급받도록 구성될 수 있다. 또한, 배터리(191)는 무선충전기기를 통하여 무선충전 가능하도록 구성될 수도 있다. 상기 무선충전은 자기유도방식 또는 공진방식(자기공명방식)에 의하여 구현될 수 있다.The

한편, 본 도면에서는 후면 커버(103)가 배터리(191)를 덮도록 리어 케이스(102)에 결합되어 배터리(191)의 이탈을 제한하고, 배터리(191)를 외부 충격과 이물질로부터 보호하도록 구성된 것을 예시하고 있다. 배터리(191)가 단말기 바디에 착탈 가능하게 구성되는 경우, 후면 커버(103)는 리어 케이스(102)에 착탈 가능하게 결합될 수 있다.The

이동 단말기(100)에는 외관을 보호하거나, 이동 단말기(100)의 기능을 보조 또는 확장시키는 액세서리가 추가될 수 있다. 이러한 액세서리의 일 예로, 이동 단말기(100)의 적어도 일면을 덮거나 수용하는 커버 또는 파우치를 들 수 있다. 커버 또는 파우치는 디스플레이부(151)와 연동되어 이동 단말기(100)의 기능을 확장시키도록 구성될 수 있다. 액세서리의 다른 일 예로, 터치 스크린에 대한 터치입력을 보조 또는 확장하기 위한 터치펜을 들 수 있다.The

한편, 본 발명에서는 이동 단말기에서 처리되는 정보를 플렉서블 디스플레이(flexible display)를 이용하여 표시할 수 있다. 이하, 첨부된 도면을 바탕으로 이에 대하여 보다 구체적으로 살펴본다.Meanwhile, in the present invention, information processed in the mobile terminal can be displayed using a flexible display. Hereinafter, the present invention will be described in detail with reference to the accompanying drawings.

도 2는 본 발명에 따른 변형 가능한 이동 단말기(200)의 다른 예를 설명하기 위한 개념도이다.2 is a conceptual diagram for explaining another example of the

도시된 바와 같이, 디스플레이부(251)는 외력에 의하여 변형 가능하게 구성될 수 있다. 그리고, 이러한 변형 가능한 디스플레이부(251)를 갖는 기기에도, 본 발명의 사상에 따라 상태 정보에 기초하여 기기의 동작 또는 디스플레이부(251)로 표시되는 이미지가 제어될 수 있다.As shown, the

상기 변형은 디스플레이부(251)의 휘어짐, 구부러짐, 접힘, 비틀림, 말림 중 적어도 하나일 수 있다. 이러한 변형 가능한 디스플레이부(251)는 '플렉서블 디스플레이부'로 명명될 수 있다. 여기에서, 플렉서블 디스플레이부(251)는 일반적인 플렉서블 디스플레이와 전자 종이(e-paper) 및 그 조합을 모두 포함할 수 있다. 일반적으로 이동 단말기(200)는 도1a 내지 도 1c의 이동 단말기(100)의 특징 또는 그와 유사한 특징을 포함할 수 있다.The deformation may be at least one of warping, bending, folding, twisting, and curling of the

일반적인 플렉서블 디스플레이는 기존의 평판 디스플레이의 특성을 유지하면서, 종이와 같이 휘어짐, 구부러짐, 접힘, 비틀림 또는 말림이 가능한 얇고 유연한 기판 위에 제작되어, 가볍고 쉽게 깨지지 않는 튼튼한 디스플레이를 말한다.A typical flexible display refers to a sturdy display that is lightweight and does not break easily, such as paper, formed on a thin, flexible substrate that can flex, bend, fold, twist, or curl like a conventional flat panel display.

또한, 전자 종이는 일반적인 잉크의 특징을 적용한 디스플레이 기술로서, 반사광을 사용하는 점이 기존의 평판 디스플레이와 다른 점일 수 있다. 전자 종이는 트위스트 볼을 이용하거나, 캡슐을 이용한 전기영동(電氣泳動, electrophoresis)을 이용하여, 정보를 변경할 수 있다.In addition, the electronic paper is a display technology to which general ink characteristics are applied, and the point that the reflected light is used is different from the conventional flat panel display. The electronic paper can be changed by using a twist ball or electrophoresis (electrophoresis) using a capsule.

플렉서블 디스플레이부(251)가 변형되지 않는 상태(예를 들어, 무한대의 곡률반경을 가지는 상태, 이하 제1 상태라 한다)에서, 플렉서블 디스플레이부(251)의 디스플레이 영역은 평면이 된다. 상기 제1 상태에서 외력에 의하여 변형된 상태(예를 들어, 유한의 곡률반경을 가지는 상태, 이하, 제2 상태라 한다)에서는 상기 디스플레이 영역이 곡면이 될 수 있다. 도시된 바와 같이, 상기 제2 상태에서 표시되는 정보는 곡면상에 출력되는 시각 정보가 될 수 있다. 이러한 시각 정보는 매트릭스 형태로 배치되는 단위 화소(sub-pixel)의 발광이 독자적으로 제어됨에 의하여 구현된다. 상기 단위 화소는 하나의 색을 구현하기 위한 최소 단위를 의미한다.In a state in which the

플렉서블 디스플레이부(251)는 상기 제1 상태에서 평평한 상태가 아닌, 휘어진 상태(예를 들어, 상하 또는 좌우로 휘어진 상태)에 놓일 수 있다. 이 경우, 플렉서블 디스플레이부(251)에 외력이 가해지면, 플렉서블 디스플레이부(251)는 평평한 상태(혹은 보다 덜 휘어진 상태) 또는 보다 많이 휘어진 상태로 변형될 수 있다.The

한편, 플렉서블 디스플레이부(251)는 터치센서와 조합되어 플렉서블 터치 스크린을 구현할 수 있다. 플렉서블 터치 스크린에 대하여 터치가 이루어지면, 제어부(180, 도 1a 참조)는 이러한 터치입력에 상응하는 제어를 수행할 수 있다. 플렉서블 터치 스크린은 상기 제1 상태뿐만 아니라 상기 제2 상태에서도 터치입력을 감지하도록 이루어질 수 있다.Meanwhile, the

한편, 본 변형 예에 따른 이동 단말기(200)에는 플렉서블 디스플레이부(251)의 변형을 감지할 수 있는 변형감지수단이 구비될 수 있다. 이러한 변형감지수단은 센싱부(140, 도 1a 참조)에 포함될 수 있다.Meanwhile, the

상기 변형감지수단은 플렉서블 디스플레이부(251) 또는 케이스(201)에 구비되어, 플렉서블 디스플레이부(251)의 변형과 관련된 정보를 감지할 수 있다. 여기에서, 변형과 관련된 정보는, 플렉서블 디스플레이부(251)가 변형된 방향, 변형된 정도, 변형된 위치, 변형된 시간 및 변형된 플렉서블 디스플레이부(251)가 복원되는 가속도 등이 될 수 있으며, 이 밖에도 플렉서블 디스플레이부(251)의 휘어짐으로 인하여 감지 가능한 다양한 정보일 수 있다.The deformation detecting unit may be provided in the

또한, 제어부(180)는 상기 변형감지수단에 의하여 감지되는 플렉서블 디스플레이부(251)의 변형과 관련된 정보에 근거하여, 플렉서블 디스플레이부(251) 상에 표시되는 정보를 변경하거나, 이동 단말기(200)의 기능을 제어하기 위한 제어신호를 생성할 수 있다.The

한편, 본 변형 예에 따른 이동 단말기(200)는 플렉서블 디스플레이부(251)를 수용하는 케이스(201)를 포함할 수 있다. 케이스(201)는 플렉서블 디스플레이부(251)의 특성을 고려하여, 외력에 의하여 플렉서블 디스플레이부(251)와 함께 변형 가능하도록 구성될 수 있다.Meanwhile, the

아울러, 이동 단말기(200)에 구비되는 배터리(미도시) 또한 플렉서블 디스플레이부(251)의 특성을 고려하여, 외력에 의하여 플렉서블 디스플레이부(251)와 함께 변형 가능하도록 구성될 수 있다. 상기 배터리를 구현하기 위하여, 배터리 셀을 위로 쌓은 스택앤폴딩(stack and folding) 방식이 적용될 수 있다.In addition, the battery (not shown) included in the

플렉서블 디스플레이부(251)의 상태 변형은 외력에 의한 것으로만 국한되지는 않는다. 예를 들어, 플렉서블 디스플레이부(251)가 제 1 상태를 가지고 있을 때, 사용자 혹은 애플리케이션의 명령에 의해서, 제 2 상태로 변형될 수도 있다.The state change of the

한편, 이동 단말기는 사용자가 주로 손에 쥐고 사용하는 차원을 넘어서, 신체에 착용할 수 있는 웨어러블 디바이스(wearable device)로 확장될 수 있다. 이러한 웨어러블 디바이스에는 스마트 워치(smart watch), 스마트 글래스(smart glass), HMD(head mounted display) 등이 있다. 이하, 웨어러블 디바이스로 확장된 이동 단말기의 예들에 대하여 설명하기로 한다.Meanwhile, the mobile terminal can be extended to a wearable device that can be worn on the body beyond the dimension that the user mainly grasps and uses. These wearable devices include smart watch, smart glass, and head mounted display (HMD). Hereinafter, examples of a mobile terminal extended to a wearable device will be described.

웨어러블 디바이스는 다른 이동 단말기(100)와 데이터를 상호 교환(또는 연동) 가능하게 이루어질 수 있다. 근거리 통신 모듈(114)은, 이동 단말기(100) 주변에 통신 가능한 웨어러블 디바이스를 감지(또는 인식)할 수 있다. 나아가, 제어부(180)는 감지된 웨어러블 디바이스가 이동 단말기(100)와 통신하도록 인증된 디바이스인 경우, 이동 단말기(100)에서 처리되는 데이터의 적어도 일부를, 근거리 통신 모듈(114)을 통하여 웨어러블 디바이스로 전송할 수 있다. 따라서, 사용자는 이동 단말기(100)에서 처리되는 데이터를 웨어러블 디바이스를 통하여 이용할 수 있다. 예를 들어, 이동 단말기(100)에 전화가 수신된 경우 웨어러블 디바이스를 통해 전화 통화를 수행하거나, 이동 단말기(100)에 메시지가 수신된 경우 웨어러블 디바이스를 통해 상기 수신된 메시지를 확인하는 것이 가능하다.The wearable device can be made to be able to exchange (or interlock) data with another

다음으로, 본 발명에 따른 이동 단말기(100)를 통해 실시 가능한 통신 시스템에 대하여 살펴본다.Next, a communication system that can be implemented through the

먼저, 통신 시스템은, 서로 다른 무선 인터페이스 및/또는 물리 계층을 이용할 수도 있다. 예를 들어, 통신 시스템에 의해 이용 가능한 무선 인터페이스에는, 주파수 분할 다중 접속(Frequency Division Multiple Access, FDMA), 시분할 다중 접속(Time Division Multiple Access, TDMA), 코드 분할 다중 접속(Code Division Multiple Access, CDMA), 범용 이동통신 시스템(Universal Mobile Telecommunications Systems, UMTS)(특히, LTE(Long Term Evolution), LTE-A(Long Term Evolution-Advanced)), 이동통신 글로벌 시스템(Global System for Mobile Communications, GSM) 등이 포함될 수 있다.First, the communication system may use different wireless interfaces and / or physical layers. For example, wireless interfaces that can be used by a communication system include Frequency Division Multiple Access (FDMA), Time Division Multiple Access (TDMA), Code Division Multiple Access (CDMA) ), Universal mobile telecommunication systems (UMTS) (in particular Long Term Evolution (LTE), Long Term Evolution-Advanced (LTE-A)), Global System for Mobile Communications May be included.

이하에서는, 설명의 편의를 위하여, CDMA에 한정하여 설명하도록 한다. 그러나, 본 발명은, CDMA 무선 통신 시스템뿐만 아니라 OFDM(Orthogonal Frequency Division Multiplexing) 무선 통신 시스템을 포함한 모든 통신 시스템 적용될 수 있음은 자명하다.Hereinafter, for the sake of convenience of description, the description will be limited to CDMA. However, it is apparent that the present invention can be applied to all communication systems including an OFDM (Orthogonal Frequency Division Multiplexing) wireless communication system as well as a CDMA wireless communication system.

CDMA 무선 통신 시스템은, 적어도 하나의 단말기(100), 적어도 하나의 기지국(Base Station, BS (Node B 혹은 Evolved Node B로 명칭될 수도 있다.)), 적어도 하나의 기지국 제어부(Base Station Controllers, BSCs), 이동 스위칭 센터(Mobile Switching Center, MSC)를 포함할 수 있다. MSC는, 일반 전화 교환망(Public Switched Telephone Network, PSTN) 및 BSCs와 연결되도록 구성된다. BSCs는, 백홀 라인(backhaul line)을 통하여, BS와 짝을 이루어 연결될 수 있다. 백홀 라인은, E1/T1, ATM, IP, PPP, Frame Relay, HDSL, ADSL 또는 xDSL 중 적어도 하나에 따라서 구비될 수 있다. 따라서, 복수의 BSCs가 CDMA 무선 통신 시스템에 포함될 수 있다.A CDMA wireless communication system includes at least one

복수의 BS 각각은 적어도 하나의 섹터를 포함할 수 있고, 각각의 섹터는, 전방향성 안테나 또는 BS로부`터 방사상의 특정 방향을 가리키는 안테나를 포함할 수 있다. 또한, 각각의 섹터는, 다양한 형태의 안테나를 두 개 이상 포함할 수도 있다. 각각의 BS는, 복수의 주파수 할당을 지원하도록 구성될 수 있고, 복수의 주파수 할당은 각각 특정 스펙트럼(예를 들어, 1.25MHz, 5MHz 등)을 가질 수 있다.Each of the plurality of BSs may comprise at least one sector, and each sector may comprise an omnidirectional antenna or an antenna pointing to a particular direction of radial emission from the BS. In addition, each sector may include two or more antennas of various types. Each BS may be configured to support a plurality of frequency assignments, and a plurality of frequency assignments may each have a specific spectrum (e.g., 1.25 MHz, 5 MHz, etc.).

섹터와 주파수 할당의 교차는, CDMA 채널이라고 불릴 수 있다. BS는, 기지국 송수신 하부 시스템(Base Station Transceiver Subsystem, BTSs)이라고 불릴 수 있다. 이러한 경우, 하나의 BSC 및 적어도 하나의 BS를 합하여 ?誰仄?이라고 칭할 수 있다. 기지국은, 또한 "셀 사이트"를 나타낼 수도 있다. 또는, 특정 BS에 대한 복수의 섹터들 각각은, 복수의 셀 사이트로 불릴 수도 있다.The intersection of sector and frequency assignment may be referred to as a CDMA channel. The BS may be referred to as a base station transceiver subsystem (BTSs). In this case, one BSC and at least one BS can be summed together. The base station may also indicate a "cell site ". Alternatively, each of the plurality of sectors for a particular BS may be referred to as a plurality of cell sites.

방송 송신부(Broadcasting Transmitter, BT) 는, 시스템 내에서 동작하는 단말기들(100)에게 방송 신호를 송신한다. 도 1a에 도시된 방송 수신 모듈(111)은, BT에 의해 전송되는 방송 신호를 수신하기 위해 단말기(100) 내에 구비된다.A broadcast transmission unit (BT) transmits a broadcast signal to

뿐만 아니라, CDMA 무선 통신 시스템에는 이동 단말기(100)의 위치를 확인하기 위한, 위성 위치 확인 시스템(Global Positioning System, GPS)이 연계될 수 있다. 상기 위성(300)은, 이동 단말기(100)의 위치를 파악하는 것을 돕는다. 유용한 위치 정보는, 두 개 이하 또는 이상의 위성들에 의해 획득될 수도 있다. 여기에서는, GPS 추적 기술뿐만 아니라 위치를 추적할 수 있는 모든 기술들을 이용하여 이동 단말기(100)의 위치가 추적될 수 있다. 또한, GPS 위성 중 적어도 하나는, 선택적으로 또는 추가로 위성 DMB 전송을 담당할 수도 있다.In addition, a Global Positioning System (GPS) may be associated with the CDMA wireless communication system to identify the location of the

이동 단말기에 구비된 위치정보 모듈(115)은 이동 단말기의 위치를 탐지, 연산 또는 식별하기 위한 것으로, 대표적인 예로는 GPS(Global Position System) 모듈 및 WiFi(Wireless Fidelity) 모듈을 포함할 수 있다. 필요에 따라서, 위치정보모듈(115)은 치환 또는 부가적으로 이동 단말기의 위치에 관한 데이터를 얻기 위해 무선 통신부(110)의 다른 모듈 중 어느 기능을 수행할 수 있다.The

상기 GPS모듈(115)은 3개 이상의 위성으로부터 떨어진 거리 정보와 정확한 시간 정보를 산출한 다음 상기 산출된 정보에 삼각법을 적용함으로써, 위도, 경도, 및 고도에 따른 3차원의 현 위치 정보를 정확히 산출할 수 있다. 현재, 3개의 위성을 이용하여 위치 및 시간 정보를 산출하고, 또 다른 1개의 위성을 이용하여 상기 산출된 위치 및 시간 정보의 오차를 수정하는 방법이 널리 사용되고 있다. 또한, GPS 모듈(115)은 현 위치를 실시간으로 계속 산출함으로써 속도 정보를 산출할 수 있다. 다만, 실내와 같이 위성 신호의 음영 지대에서는 GPS 모듈을 이용하여 정확히 이동 단말기의 위치를 측정하는 것이 어렵다. 이에 따라, GPS 방식의 측위를 보상하기 위해, WPS (WiFi Positioning System)이 활용될 수 있다.The

와이파이 위치추적 시스템(WPS: WiFi Positioning System)은 이동 단말기(100)에 구비된 WiFi모듈 및 상기 WiFi모듈과 무선신호를 송신 또는 수신하는 무선 AP(Wireless Access Point)를 이용하여, 이동 단말기(100)의 위치를 추적하는 기술로서, WiFi를 이용한 WLAN(Wireless Local Area Network)기반의 위치 측위 기술을 의미한다.The WiFi Positioning System (WPS) is a system in which a

와이파이 위치추적 시스템은 와이파이 위치측위 서버, 이동 단말기(100), 상기 이동 단말기(100)와 접속된 무선 AP, 임의의 무선 AP정보가 저장된 데이터 베이스를 포함할 수 있다.The WiFi location tracking system may include a Wi-Fi location server, a

무선 AP와 접속 중인 이동 단말기(100)는 와이파이 위치 측위 서버로 위치정보 요청 메시지를 전송할 수 있다.The

와이파이 위치측위 서버는 이동 단말기(100)의 위치정보 요청 메시지(또는 신호)에 근거하여, 이동 단말기(100)와 접속된 무선 AP의 정보를 추출한다. 상기 이동 단말기(100)와 접속된 무선 AP의 정보는 이동 단말기(100)를 통해 상기 와이파이 위치측위 서버로 전송되거나, 무선 AP에서 와이파이 위치측위 서버로 전송될 수 있다.The Wi-Fi position location server extracts information of the wireless AP connected to the

상기 이동 단말기(100)의 위치정보 요청 메시지에 근거하여, 추출되는 무선 AP의 정보는 MAC Address, SSID(Service Set IDentification), RSSI(Received Signal Strength Indicator), RSRP(Reference Signal Received Power), RSRQ(Reference Signal Received Quality), 채널정보, Privacy, Network Type, 신호세기(Signal Strength) 및 노이즈 세기(Noise Strength)중 적어도 하나일 수 있다.The information of the wireless AP to be extracted based on the location information request message of the

와이파이 위치측위 서버는 위와 같이, 이동 단말기(100)와 접속된 무선 AP의 정보를 수신하여, 미리 구축된 데이터베이스로부터 이동 단말기가 접속 중인 무선 AP와 대응되는 무선 AP 정보를 추출할 수 있다. 이때, 상기 데이터 베이스에 저장되는 임의의 무선 AP 들의 정보는 MAC Address, SSID, 채널정보, Privacy, Network Type, 무선 AP의 위경도 좌표, 무선 AP가 위치한 건물명, 층수, 실내 상세 위치정보(GPS 좌표 이용가능), AP소유자의 주소, 전화번호 등의 정보일 수 있다. 이때, 측위 과정에서 이동형 AP나 불법 MAC 주소를 이용하여 제공되는 무선 AP를 측위 과정에서 제거하기 위해, 와이파이 위치측위 서버는 RSSI 가 높은 순서대로 소정 개수의 무선 AP 정보만을 추출할 수도 있다.As described above, the Wi-Fi position location server can receive the information of the wireless AP connected to the

이후, 와이파이 위치측위 서버는 데이터 베이스로부터 추출된 적어도 하나의 무선 AP 정보를 이용하여 이동 단말기(100)의 위치정보를 추출(또는 분석)할 수 있다. 포함된 정보와 상기 수신된 무선 AP 정보를 비교하여, 상기 이동 단말기(100)의 위치정보를 추출(또는 분석)한다.Then, the Wi-Fi location server can extract (or analyze) the location information of the

이동 단말기(100)의 위치정보를 추출(또는 분석)하기 위한 방법으로, Cell-ID 방식, 핑거 프린트 방식, 삼각 측량 방식 및 랜드마크 방식 등이 활용될 수 있다.As a method for extracting (or analyzing) the position information of the

Cell-ID 방식은 이동 단말기가 수집한 주변의 무선 AP 정보 중 신호 세기가 가장 강한 무선 AP의 위치를 이동 단말기의 위치로 결정하는 방법이다. 구현이 단순하고 별도의 비용이 들지 않으며 위치 정보를 신속히 얻을 수 있다는 장점이 있지만 무선 AP의 설치 밀도가 낮으면 측위 정밀도가 떨어진다는 단점이 있다.The Cell-ID method is a method of determining the position of the mobile station with the strongest signal strength among neighboring wireless AP information collected by the mobile terminal. Although the implementation is simple, it does not cost extra and it can acquire location information quickly, but there is a disadvantage that positioning accuracy is lowered when the installation density of the wireless AP is low.

핑거프린트 방식은 서비스 지역에서 참조위치를 선정하여 신호 세기 정보를 수집하고, 수집한 정보를 바탕으로 이동 단말기에서 전송하는 신호 세기 정보를 통해 위치를 추정하는 방법이다. 핑거프린트 방식을 이용하기 위해서는, 사전에 미리 전파 특성을 데이터베이스화할 필요가 있다.The fingerprint method collects signal strength information by selecting a reference position in a service area, and estimates the position based on the signal strength information transmitted from the mobile terminal based on the collected information. In order to use the fingerprint method, it is necessary to previously convert the propagation characteristics into a database.

삼각 측량 방식은 적어도 세개의 무선 AP의 좌표와 이동 단말기 사이의 거리를 기초로 이동 단말기의 위치를 연산하는 방법이다. 이동 단말기와 무선 AP사이의 거리를 측정하기 위해, 신호 세기를 거리 정보로 변환하거나, 무선 신호가 전달되는 시간(Time of Arrival, ToA), 신호가 전달되는 시간 차이(Time Difference of Arrival, TDoA), 신호가 전달되는 각도(Angle of Arrival, AoA) 등을 이용할 수 있다.The triangulation method is a method of calculating the position of the mobile terminal based on the coordinates of at least three wireless APs and the distance between the mobile terminals. (Time of Arrival, ToA), Time Difference of Arrival (TDoA) in which a signal is transmitted, and the time difference between the wireless AP and the wireless AP, in order to measure the distance between the mobile terminal and the wireless AP. , An angle at which a signal is transmitted (Angle of Arrival, AoA), or the like.

랜드마크 방식은 위치를 알고 있는 랜드마크 발신기를 이용하여 이동 단말기의 위치를 측정하는 방법이다.The landmark method is a method of measuring the position of a mobile terminal using a landmark transmitter that knows the location.

열거된 방법 이외에도 다양한 알고리즘이 이동 단말기의 위치정보를 추출(또는 분석)하기 위한 방법으로 활용될 수 있다.Various algorithms can be utilized as a method for extracting (or analyzing) the location information of the mobile terminal.

이렇게 추출된 이동 단말기(100)의 위치정보는 상기 와이파이 위치측위 서버를 통해 이동 단말기(100)로 전송됨으로써, 이동 단말기(100)는 위치정보를 획득할 수 있다.The extracted location information of the

이동 단말기(100)는 적어도 하나의 무선 AP 에 접속됨으로써, 위치 정보를 획득할 수 있다. 이때, 이동 단말기(100)의 위치 정보를 획득하기 위해 요구되는 무선 AP의 개수는 이동 단말기(100)가 위치한 무선 통신환경에 따라 다양하게 변경될 수 있다.The

앞서 도 1a를 통해 살펴본 바와 같이, 본 발명에 따른 이동 단말기에는 블루투스(Bluetooth™), RFID(Radio Frequency Identification), 적외선 통신(Infrared Data Association; IrDA), UWB(Ultra Wideband), ZigBee, NFC(Near Field Communication), Wireless USB(Wireless Universal Serial Bus) 등의 근거리 통신 기술이 적용될 수 있다.As shown in FIG. 1A, a mobile terminal according to the present invention includes Bluetooth ™, Radio Frequency Identification (RFID), Infrared Data Association (IrDA), UWB (Ultra Wideband), ZigBee, NFC Field Communication), and Wireless USB (Wireless Universal Serial Bus).

이 중, 이동 단말기에 구비된 NFC 모듈은 10cm 안팎의 거리에서 단말 간 비접촉식 근거리 무선 통신을 지원한다. NFC 모듈은 카드 모드, 리더 모드 및 P2P 모드 중 어느 하나로 동작할 수 있다. NFC 모듈이 카드 모드로 운용되기 위해서, 이동 단말기(100)는 카드 정보를 저장하는 보안 모듈을 더 포함할 수도 있다. 여기서, 보안 모듈이란 UICC(Universal Integrated Circuit Card)(예컨대, SIM(Subscriber Identification Module) 또는 USIM(Universal SIM)), Secure micro SD 및 스티커 등 물리적 매체일 수도 있고, 이동 단말기에 임베디드되어 있는 논리적 매체(예컨대, embeded SE(Secure element))일 수도 있다. NFC 모듈과 보안 모듈 사이에는 SWP(Single Wire Protocol)에 기반한 데이터 교환이 이루어질 수 있다.Among them, the NFC module provided in the mobile terminal supports the non-contact type short-range wireless communication between the terminals at a distance of about 10 cm. The NFC module may operate in either a card mode, a reader mode, or a P2P mode. In order for the NFC module to operate in the card mode, the

NFC 모듈이 카드 모드로 운용되는 경우, 이동 단말기는 전통적인 IC 카드처럼 저장하고 있는 카드 정보를 외부로 전달할 수 있다. 구체적으로, 신용카드 또는 버스 카드 등 결제용 카드의 카드 정보를 저장하는 이동 단말기를 요금 결제기에 근접시키면, 모바일 근거리 결제가 처리될 수 있고, 출입용 카드의 카드 정보를 저장하는 이동 단말기를 출입 승인기에 근접 시키면, 출입의 승인 절차가 시작될 수 있다. 신용카드, 교통카드 및 출입카드 등의 카드는 애플릿(applet) 형태로 보안 모듈에 탑재되고, 보안 모듈은 탑재된 카드에 대한 카드 정보를 저장할 수 있다. 여기서, 결제용 카드의 카드 정보는 카드 번호, 잔액, 사용 내역 중 적어도 하나일 수 있고, 출입용 카드의 카드 정보는, 사용자의 이름, 번호(예컨대, 사용자의 학번 또는 사번), 출입 내역 중 적어도 하나일 수 있다.When the NFC module is operated in the card mode, the mobile terminal can transmit the stored card information to the outside such as a conventional IC card. Specifically, if the mobile terminal storing the card information of the payment card such as a credit card or a bus card is brought close to the fare payment machine, the mobile local payment can be processed, and the mobile terminal storing the card information of the access card can be accessed If you are close to the time, the approval process for access may begin. Cards such as credit cards, transportation cards, and access cards are mounted on the security module in the form of an applet, and the security module can store card information on the mounted card. Here, the card information of the payment card may be at least one of a card number, balance, and usage details, and the card information of the access card may include at least one of a name, a number (e.g., It can be one.

NFC 모듈이 리더 모드로 운용되는 경우, 이동 단말기는 외부의 태그(Tag)로부터 데이터를 독출할 수 있다. 이때, 이동 단말기가 태그로부터 수신하는 데이터는 NFC 포럼에서 정하는 데이터 교환 포맷(NFC Data Exchange Format)으로 코딩될 수 있다. 아울러, NFC 포럼에서는 4개의 레코드 타입을 규정한다. 구체적으로, NFC 포럼에서는 스마트 포스터(Smart Poster), 텍스트(Text), URI(Uniform Resource Identifier) 및 일반 제어(General Control) 등 4개의 RTD(Record Type Definition)를 규정한다. 태그로부터 수신한 데이터가 스마트 포스터 타입인 경우, 제어부는 브라우저(예컨대, 인터넷 브라우저)를 실행하고, 태그로부터 수신한 데이터가 텍스트 타입인 경우, 제어부는 텍스트 뷰어를 실행할 수 있다. 태그로부터 수신한 데이터가 URI 타입인 경우, 제어부는 브라우저를 실행하거나 전화를 걸고, 태그로부터 수신한 데이터가 일반 제어 타입인 경우, 제어 내용에 따라 적절한 동작을 실행할 수 있다.When the NFC module is operated in the reader mode, the mobile terminal can read data from an external tag. At this time, the data received from the mobile terminal by the tag may be coded into a data exchange format (NFC Data Exchange Format) defined by the NFC Forum. In addition, the NFC Forum defines four record types. Specifically, the NFC forum defines four RTDs (Record Type Definitions) such as Smart Poster, Text, Uniform Resource Identifier (URI), and General Control. If the data received from the tag is a smart poster type, the control unit executes a browser (e.g., an Internet browser), and if the data received from the tag is a text type, the control unit can execute the text viewer. When the data received from the tag is a URI type, the control unit executes the browser or makes a telephone call, and if the data received from the tag is a general control type, it can execute appropriate operations according to the control contents.

NFC 모듈이 P2P(Peer-to-Peer) 모드로 운용되는 경우, 이동 단말기는 다른 이동 단말기와 P2P 통신을 수행할 수 있다. 이때, P2P 통신에는 LLCP(Logical Link Control Protocol) 가 적용될 수 있다. P2P 통신을 위해 이동 단말기와 다른 이동 단말기 사이에는 커넥션(connection)이 생성될 수 있다. 이때, 생성되는 커넥션은 1개의 패킷을 교환하고 종료되는 비접속형 모드(connectionless mode)와 연속적으로 패킷을 교환하는 접속형 지향 모드(connection-oriented mode)로 구분될 수 있다. P2P 통신을 통해, 전자적 형태의 명함, 연락처 정보, 디지털 사진, URL 등의 데이터 및 블루투스, Wi-Fi 연결을 위한 셋업 파라미터 등이 교환될 수 있다. 다만, NFC 통신의 가용 거리는 짧으므로, P2P 모드는 크기가 작은 데이터를 교환하는 것에 효과적으로 활용될 수 있을 것이다.When the NFC module is operated in a peer-to-peer (P2P) mode, the mobile terminal can perform P2P communication with another mobile terminal. At this time, LLCP (Logical Link Control Protocol) may be applied to P2P communication. For P2P communication, a connection can be created between the mobile terminal and another mobile terminal. At this time, the generated connection can be divided into a connectionless mode in which one packet is exchanged and terminated, and a connection-oriented mode in which packets are exchanged consecutively. Through P2P communications, data such as business cards, contact information, digital photos, URLs in electronic form, and setup parameters for Bluetooth and Wi-Fi connectivity can be exchanged. However, since the usable distance of NFC communication is short, the P2P mode can be effectively used to exchange small-sized data.

이하에서는 이와 같이 구성된 이동 단말기에서 구현될 수 있는 제어 방법과 관련된 실시 예들에 대해 첨부된 도면을 참조하여 살펴본다. 본 발명은 본 발명의 정신 및 필수적 특징을 벗어나지 않는 범위에서 다른 특정한 형태로 구체화될 수 있음은 당업자에게 자명하다.Hereinafter, embodiments related to a control method that can be implemented in a mobile terminal configured as above will be described with reference to the accompanying drawings. It will be apparent to those skilled in the art that the present invention may be embodied in other specific forms without departing from the spirit or essential characteristics thereof.

실시예의 이동 단말기에서 마이크로폰(122)은 외부의 음향 신호를 전기적인 음성 데이터로 처리하며, 상기 제어부(180)는 내장되거나 단말기 내 더 마련된 음성 인식 모듈을 이용하여 상기 음성 데이터를 텍스트 변환할 수 있다. 그리고, 상기 제어부(180)는 변환된 텍스트를 디스플레이부(151)에 표시할 수 있으며, 사용자에 의한 변환된 텍스트의 편집을 허용할 수 있다.In the mobile terminal of the embodiment, the

예를 들면, 변환된 텍스트에 대한 사용자의 글꼴 편집(언더라인, 하이라이트등)을 허용하거나, 변환된 텍스트에 기반한 애플리케이션의 실행(일정 관리, 전화 등)을 허용할 수 있다.For example, you can allow the user to edit the font (underline, highlight, etc.) of the converted text, or allow the application to run (schedule, call, etc.) based on the converted text.

이동 단말기의 제어부(180)가 음성 인식 모듈을 포함하는 개념으로 사용될 수 있으며, 별도의 구성으로서 수신된 음성 데이터에 대한 텍스트 변환을 수행하는 모듈이 구비되는 경우도 가능하다.The

이러한 음성 인식 모듈은, 문맥에 의존하는 부분단어 모델링 단위를 사용하여 음향 프레임에 점수를 부여하는 방식으로 구성될 수 있다. 예를 들면, 각 부분단어 모델링 단위, 또는 음소는 히든 마르코프 모델(HMM:Hidden Markov Model)에 의해 모델링될 수 있으며, 이 모델링은 세 가지의 상태(status)를 갖을 수 있다. 각 상태는 가우시안 혼합 모델(GMM:Gaussian Mixture Model)을 사용하여 하나 이상의 다차원 음향 프레임에 대해 가능도 점수를 할당할 수 있다. GMM의 각 혼합 성분은 대각 공분산 행렬을 사용한다.Such a speech recognition module can be configured in such a manner that a score is given to an acoustic frame using a context-dependent partial word modeling unit. For example, each partial word modeling unit, or phoneme, can be modeled by a Hidden Markov Model (HMM), which can have three statuses. Each state can be assigned a likelihood score for one or more multidimensional sound frames using a Gaussian Mixture Model (GMM). Each mixed component of the GMM uses a diagonal covariance matrix.

또한, 음성 인식 모듈은 서로 다른 길이의 다양한 음소 문맥(phonetic context)을 사용하여 학습시킬 수 있다. 예를 들어, 음성 인식 모듈은 중앙 음소의 앞 및/또는 뒤에 있는 1개, 2개, 3개 또는 그 이상의 음소들 각각 포함하는 트레이닝 시퀀스를 사용하여 학습할 수 있다.In addition, the speech recognition module can learn using various phonetic contexts of different lengths. For example, the speech recognition module may learn using a training sequence that includes one, two, three, or more phonemes preceding and / or after the central phoneme.

다양한 방법들과 알고리즘으로 구현되는 음성 인식 모듈이 실시예에 적용될 수 있으며, 이러한 음성 인식은 사용자 요청에 의하여 수행되는 경우도 있겠으나, 전자 메일, 웹페이지 등의 전자 문서에 보관된 정보를 이용하여 제어부(180)가 자동 개시할 수도 있다. 여기서, 전자 문서는 반드시 텍스트만을 포함하면서 이동 단말기 화면 상에 표시할 수 있는 파일만을 가리키는 것이 아니며, 디스플레이부(151) 화면 상에 표시할 수 있는 사진, 영상, 음악 등을 모두 포함하는 것이라 할 수 있다.The speech recognition module implemented by various methods and algorithms may be applied to the embodiment. The speech recognition may be performed by a user request, but it is also possible to use the information stored in an electronic document such as an electronic mail or a web page The

도 3은 본 발명의 일 실시예에 따른 이동 단말기의 동작 방법을 설명하는 흐름도이고, 도 4는 이동 단말기에 표시되는 전자 문서의 예를 도시한 도면이고, 도 5는 본 실시예에 따라 전자 문서에 포함된 정보를 이용한 사용자 문서를 예시한 도면이다.FIG. 3 is a flowchart illustrating an operation method of a mobile terminal according to an embodiment of the present invention. FIG. 4 is a diagram illustrating an example of an electronic document displayed on a mobile terminal, FIG. 3 is a diagram illustrating a user document using information included in the document. FIG.

먼저, 도 3을 참조하면, 실시예의 제어부 또는 음성 인식 모듈은 이동 단말기에 저장된 전자 문서, 또는 애플리케이션의 구동에 따라 표시되는 전자 문서에 대한 분석을 수행한다(S301). 음성 인식 모듈은 제어부와 동일한 하드웨어 내에 구성되거나, 별도의 구성으로 마련될 수 있지만, 이하의 설명에서는 음성 인식과 관련되는 사항은 편의상 제어부에 의하여 수행되는 것으로 설명하여 본다.Referring to FIG. 3, the controller or the speech recognition module of the embodiment analyzes an electronic document stored in the mobile terminal or an electronic document displayed according to the application's operation (S301). The voice recognition module may be configured in the same hardware as the control unit, or may be provided in a separate configuration. However, in the following description, matters related to voice recognition are performed by the control unit for convenience.

상기 제어부(180)가 수행하는 전자 문서의 분석은, 전자 문서에 기재된 사항으로부터 사용자 문서를 추가로 생성할지 여부를 판단하기 위한 것으로도 볼 수 있다. 여기서, 사용자 문서는 저장되거나 수신된 전자 문서에 대하여 사용자가 해당 전자 문서를 편집하거나 새로운 사항을 기입하는 등 사용자가 입력, 수정하여 만들어진 전자 문서가 된다.The analysis of the electronic document performed by the

예를 들어, 도 4에 도시된 바와 같이, 전자 문서가 이메일이고, 해당 이메일 내에 스케쥴에 대한 정보임을 나타내는 'Agenda'의 키워드가 포함되어 있는 경우에, 상기 제어부(180)는 사용자 문서를 생성하도록 단말기를 제어할 수 있다.For example, as shown in FIG. 4, when the electronic document is an e-mail and the e-mail includes a keyword 'Agenda' indicating that the e-mail is information on a schedule, the

그리고, 상기 제어부(180)는 사용자 문서의 생성이 가능한 경우임을 나타내는 확인 이미지(410)를 해당 전자 문서(401)내에 표시할 수 있다(S302). 상기 확인 이미지(410)는 제어부(180)의 판단에 기초하여 해당 전자 문서에 대해서는 사용자 문서의 생성 가능성이 높음을 나타내는 것이 되고, 한편으로는, 해당 전자 문서에 대해서 사용자가 직접 편집/기입하는 것이 가능한 문서임을 나타내는 것이 될 수 있다.The

또한, 상기 제어부(180)가 수행하는 전자 문서에 대한 분석은, 음성 인식 모듈의 구동에 따른 음성 데이터의 텍스트 변환이 필요한지 여부를 판단하기 위한 자료가 될 수 있다. 실시예에 따라서는, 상기 제어부(180)는 음성 인식이 필요할 것으로 예상되는 정보가 포함된 전자 문서에 대해서 상기 확인 이미지(410)를 표시할 수 있다. 예를 들면, 상기 제어부(180)는 수업, 미팅 또는 컨퍼런스 등의 단어에 가중치를 부여하고, 이러한 스케쥴이 포함되는 경우라면 해당 시간에 음성 인식이 자동으로 구동될 수 있음을 상기 확인 이미지(410)를 통하여 사용자에게 알릴 수 있다.The analysis of the electronic document performed by the

한편, 사용자가 상기 확인 이미지(410)를 선택하는 경우에, 상기 제어부(180)는 해당 전자 문서(401) 내에서 사용자 문서 생성을 위하여 필요한 것으로 판단한 정보를 사용자 문서 내에 표시할 수 있다(S303).Meanwhile, when the user selects the

상기 제어부(180)는 사용자에 의하여 상기 확인 이미지(410)가 선택되면, 새로운 전자 문서로서 사용자 문서를 생성하고, 상기 전자 문서(401) 내에서 사용자 문서로 가지고 정보를 확인한다. 예를 들면, 상기 전자 문서(401)가 회의 스케쥴을 나타내는 정보라고 판단한 경우에, 해당 스케쥴에 대한 사항을 입력 정보로서, 생성한 사용자 문서(501)내에 삽입 기재(510)한다.When the user selects the

그리고, 해당 스케쥴의 시간에 회의가 진행되면, 상기 제어부(180)는 마이크로폰을 통하여 수신된 음성 데이터를 텍스트 변환하고, 이동 단말기 주위에서 발생되는 음성 데이터들을 실시간으로 변환하여 표시한다.Then, when the conference is performed at the time of the corresponding schedule, the

이러한 사용자 문서의 생성과, 음성 인식에 기반하여 변환된 텍스트의 표시는 시간적 선후관계가 이루어질 수 있으며, 상기 사용자 문서(501)가 생성되는 때에 자동으로 음성 인식 모듈이 동작되거나, 전자 문서(301)로부터 사용자 문서(401)로 가지고 온 정보에 기초하여 음성 인식 모듈이 자동 동작될 수 있다. 예를 들면, 사용자 문서(401)로 끌어들어온 정보에 시간 정보가 포함되어 있는 경우, 해당 시간에 음성 인식 모듈이 자동 실행될 수 있다.The generation of the user document and the display of the converted text based on the speech recognition may be temporally related to each other and the speech recognition module may be operated automatically when the

도 6에 도시된 바와 같이, 제어부에 의한 전자 문서의 분석이 수행(S601)된 다음에는, 상기 제어부(180)는 해당 전자 문서 내에서 스케쥴 정보를 확인(S602)한다. 그리고, 해당 전자 문서 내에 시간에 대한 정보와 함께, 회의 또는 미팅 등의 대화를 나타내는 단어가 함께 포함되는 경우에 해당 시간에 자동 음성 인식을 개시(S603)할 수 있다.6, after the analysis of the electronic document by the control unit is performed (S601), the

한편, 실시간 음성 인식되는 데이터들이 텍스트 변환되어 표시되는 때에, 도 5에 도시된 바와 같이, 특정 문단 또는 문장의 텍스트에 대해서 음성 데이터가 수신된 시간에 대한 정보(520)가 함께 표시될 수 있다. 즉, 변환된 텍스트와 함께, 해당 텍스트에 대응되는 음성 데이터가 단말기로 수신된 시간 정보가 표시될 수 있다.On the other hand, when the real-time voice-recognized data is displayed as text converted, the

본 발명의 다른 실시예로서, 사용자 문서에서의 일정 생성과, 일정에 기반한 음성 인식 모듈의 동작에 대해서 설명하여 본다.As another embodiment of the present invention, the generation of the schedule in the user document and the operation of the speech recognition module based on the schedule will be described.

도 7은 본 실시예에 따라 전자 문서로부터 일정을 확인하고 일정에 기반한 음성 인식 동작을 설명하기 위한 흐름도이고, 도 8 내지 도 10은 본 실시예에 따라 일정 확인 및 음성 인식을 수행하는 과정을 보여주는 UI의 예이다.FIG. 7 is a flowchart for explaining a schedule-based speech recognition operation by confirming a schedule from an electronic document according to the embodiment of the present invention. FIGS. 8 to 10 illustrate a process of performing schedule confirmation and speech recognition according to the present embodiment. This is an example of a UI.

사용자는 단말기에 저장된 전자 문서나 인터넷으로 연결된 전자 문서에 대해서 직접 전자 문서에 대한 편집(입력, 수정 등)이 가능하다. 이와 같이 사용자에 의하여 편집 가능한 문서에 대해서 사용자 문서라 할 수 있으며, 상기 전자 문서는 이러한 사용자 문서를 포함하는 의미로도 볼 수 있다.The user can directly edit (input, modify, etc.) an electronic document stored in the terminal or directly to an electronic document connected to the Internet. As such, a user-editable document can be referred to as a user document, and the electronic document can also be regarded as including the user document.

단말기의 제어부(180)는 사용자 문서(또는 전자 문서)에 포함된 정보 중에 일정에 관한 정보가 있는지 여부를 확인한다(S701). 제어부(180)는 텍스트의 키워드 검색에 기반하여 월일 또는 시간을 나타내는 텍스트가 포함된 경우에, 해당 일자 또는 해당 시간을 파악할 수 있다.The

예를 들어, 도 8에 도시된 바와 같이, 본 실시예의 전자 문서(801)에는 사용자가 가상 키보드를 입력하거나 스타일러스 펜으로 텍스트를 입력할 수 있는 입력 페이지(810)와, 마이크로폰을 통하여 수신되는 음성 데이터에 대한 음성 인식 후 변환된 텍스트가 표시되는 음성 인식 페이지(820)가 표시될 수 있다.8, the

앞서 설명한 바와 같이, 상기 음성 인식 페이지(820)에는 이동 단말기 주위에서 발생된 음성 데이터에 대해서 자동 음성 인식 후, 변환된 텍스트가 표시되는 영역이다.As described above, the

그리고, 사용자가 입력 페이지(810)에 입력한 텍스트 또는 다른 전자 문서로부터 가져온 정보에 해당하는 텍스트를 선택하게 되면, 해당 선택된 텍스트가 일정과 관련되는 정보라고 판단되는 경우에, 제어부(180)는 일정 애플리케이션을 구동할지 여부를 확인하는 메시지(830)를 출력시킨다.When the user selects text corresponding to information input from the

그리고, 사용자에 의하여 일정을 추가하는 명령이 수신되면, 상기 제어부(180)는 일정 애플리케이션을 구동시킨다(S702). 예를 들면, 도 9에 도시된 바와 같이, 디스플레이부 화면의 일부 또는 전체에 일정 애플리케이션의 UI가 표시되고, 인식된 일정의 내용을 사용자가 입력하도록 유도할 수 있다. 도 8에서는 사용자가 입력 페이지(810)에 표시되는 일정 관련 텍스트를 선택한 경우가 도시되어 있지만, 음성 인식된 결과의 텍스트가 표시되는 음성 인식 페이지(820)의 텍스트가 선택되는 경우에도, 관련 애플리케이션이 실행되도록 할 수 있다.Then, when an instruction to add a schedule is received by the user, the

한편, 상기 제어부(180)는 설정된 일정 또는 사용자에 의해 알람이 설정된 시간이 다가온 경우에, 도 10에 도시된 바와 같이, 사용자에게 해당 일정을 전달하는 알림 메시지(1001)를 출력한다. 그리고, 상기 일정에 대한 알림 메시지(1001)에는, 해당 일정에 대한 확인 또는 무시를 사용자가 선택할 수 있을 뿐만 아니라, 해당 일정과 관련된 사용자 문서를 생성할 수 있도록 하는 메뉴(Note)가 포함된다.Meanwhile, the

저장된 일정에 대해서 사용자가 Note 메뉴를 선택하는 경우에, 상기 제어부(180)는 상기 일정과 관련하여 미리 저장된 정보, 또는 상기 일정과 관련되는 정보를 추출하여 사용자가 편집할 수 있도록 하는 전자 문서(1002)를 화면에 표시한다.When the user selects the Note menu with respect to the stored schedule, the

일정 알림 메시지(1001)에 대해서 사용자가 해당 일정과 관련된 전자 문서 편집(Note)을 선택한 경우에, 해당 일정이 기록될 때에 편집되었던 전자 문서 또는 해당 일정과 관련되는 정보가 포함된 전자 문서가 화면에 표시된다. 그 전자 문서(1002)는 사용자의 텍스트 입력이 가능한 입력 페이지(1010)와, 음성 인식될 결과의 텍스트가 표시되는 음성 인식 페이지(1020)를 모두 포함할 수 있다.

When the user selects an electronic document edit (Note) related to the schedule, the electronic document that has been edited when the schedule is recorded or an electronic document including information related to the schedule is displayed on the screen Is displayed. The

다음으로, 음성 인식된 결과의 텍스트를 이용한 사용자 경험에 대해서 다른 실시예를 더 설명하여 본다.Next, another embodiment will be further described with respect to the user experience using the text of the speech recognition result.

도 11은 본 발명의 다른 실시예에 따른 음성 인식 결과의 테스트를 사용자가 편집하는 방법을 설명하는 흐름도이고, 도 12 내지 도 15는 본 실시예에 따라 텍스트 수정을 수행하는 경우의 UI의 예를 도시한 도면이다.FIG. 11 is a flowchart illustrating a method of editing a test result of a speech recognition result according to another embodiment of the present invention. FIGS. 12 to 15 show an example of a UI when text modification is performed according to the present embodiment Fig.

도 11 내지 도 15를 참조하여 설명하면, 실시예에 따르면 음성 인식 모듈의 동작에 의하여 변환된 텍스트가 표시되고, 해당 텍스트는 사용자의 입력에 따라 이동과 편집이 가능하다.Referring to FIGS. 11 to 15, according to the embodiment, the converted text is displayed by the operation of the speech recognition module, and the text can be moved and edited according to the user's input.

예를 들어, 본 실시예에 따라 음성 인식이 수행되고 있는 경우에는, 화면에 표시되는 전자 문서(1201)는 음성 인식될 결과가 표시되는 음성 인식 페이지(1220)와, 사용자가 스타일러스 펜 또는 가상 키보드 등을 이용하여 입력할 수 있는 공간이 되는 입력 페이지(1210)를 포함할 수 있다.For example, when speech recognition is being performed according to the present embodiment, the

사용자는 필요에 따라 음성 인식된 텍스트를 편집하거나, 중요하다고 생각되는 일 부분에 대해서만 관리 저장하고자 하는 경우가 있다. 이 경우, 사용자는 음성 인식 페이지(1220) 내의 텍스트에 대해서 일부 텍스트를 터치 등의 입력으로 선택하는 것이 가능하다(S1101). 예를 들어, 도 13에 도시된 바와 같이, 음성 인식된 결과의 텍스트 중 일부를 선택하는 경우에, 선택된 텍스트에 대해서는 하이라이트 또는 해칭(1221)으로 표시될 수 있다.The user may want to edit the voice-recognized text as needed, or to manage and store only a portion that is considered important. In this case, the user can select some text with respect to the text in the

그리고, 사용자가 텍스트 선택을 유지한 상태에서, 텍스트 입력이 가능한 영역인 입력 페이지(1210)로 이동시키는 경우에(S1102), 도 14에 도시된 바와 같이, 선택된 텍스트가 마치 드래그 앤 드랍과 같이 입력 페이지(1210)로 복사될 수 있다(S1103). 용도나 역할이 다르게 정의될 수 있는 입력 페이지(1210)와 음성 인식 페이지(1220) 사이에 사용자의 터치 제스처 등으로 텍스트의 이동 복사가 가능하다. 입력 페이지(1210)로 이동된 해당 텍스트 영역은 사용자가 쉽게 확인할 수 있도록 박스 내에 표시될 수 있다(S1103).When the user moves to the

또한, 도 15에 도시된 바와 같이, 사용자는 입력 페이지(1210) 영역으로 삽입된 텍스트 영역(1410)에 대해서 하이트라이트 처리 또는 밑줄 등의 텍스트 편집을 수행할 수 있다(S1104).In addition, as shown in FIG. 15, the user can perform text editing such as highlight processing or underline on the

다만, 이러한 텍스트의 편집은 반드시 입력 페이지(1210)에서만 가능한 것은 아니며, 수신되는 음성 데이터를 텍스트로 변환한 결과가 표시되는 음성 인식 페이지(1220)에 대해서도 가능하다. 그리고, 이후에 설명할 텍스트 편집에 대한 다양한 실시예들 역시 입력 페이지와 음성 인식 페이지 모두에 적용될 수 있다.However, editing of such a text is not necessarily possible only on the

도 16 내지 도 19는 본 실시예에 따라 사용자 제스처에 기반한 텍스트 편집 방법을 설명하는 도면이다.16 to 19 are diagrams for explaining a text editing method based on a user gesture according to the present embodiment.

사용자가 특정 텍스트를 선택하는 것은, 가상 키보드 또는 스타일러스 펜을 이용해서도 가능하며, 사용자의 터치 및 상기 터치의 드래그 이동에 의해서도 가능하다.The user can select a specific text by using a virtual keyboard or a stylus pen, or by dragging the user's touch and the touch.

먼저, 도 16을 참조하면, 사용자가 특정 텍스트 영역을 선택한 다음, 해당 터치가 해제되지 않은 상태에서 상측으로 드래그할 경우에, 선택되었던 텍스트에 대해서 볼드 편집이 이루어질 수 있다.Referring to FIG. 16, when a user selects a specific text area and then drags the text to the upper side without releasing the corresponding touch, the selected text can be bold edited.

그리고, 도 17을 참조하면, 사용자가 특정 텍스트 영역을 선택한 다음, 해당 터치가 해제되지 않은 상태에서 하측으로 드래그할 경우에, 선택되었던 텍스트에 대해서 언더라인 표시가 이루어질 수 있다.Referring to FIG. 17, if a user selects a specific text area and then drags the selected text area downward without releasing the corresponding touch, underline display may be performed on the selected text.

그리고, 도 18을 참조하면, 사용자가 특정 텍스트 영역을 선택한 다음, 해당 터치가 해제되지 않은 상태에서 우측으로 드래그할 경우에, 선택되었던 텍스트에 대해서 이탤릭 표시가 이루어질 수 있다.Referring to FIG. 18, when a user selects a specific text area and then drags the text to the right in a state where the corresponding touch is not released, the selected text may be italicized.

그리고, 도 19를 참조하면, 사용자가 특정 텍스트 영역을 선택한 다음, 해당 터치가 해제되지 않은 상태에서 좌측으로 드래그할 경우에, 선택되었던 텍스트에 대해서 해칭 또는 하이라이트 표시가 될 수 있다.Referring to FIG. 19, when a user selects a specific text area and then drags the text to the left in a state in which the corresponding touch is not released, the selected text may be hatched or highlighted.

다만, 이러한 제스처에 기반한 텍스트 편집의 방법은, 실시예의 변경에 따라 그 효과가 다르게 나타나거나, 추가적인 제스처가 더 부가될 수 있다.However, the method of text editing based on such a gesture may have different effects depending on the modification of the embodiment, or an additional gesture may be added.

도 20과 도 21은 본 실시예에 따라 사용자의 터치 제스처에 기반한 문서 편집의 다른 방법을 설명하기 위한 도면이다.FIGS. 20 and 21 are diagrams for explaining another method of document editing based on the user's touch gesture according to the present embodiment.

본 실시예에 따르면, 전자 문서(2001)의 입력 페이지(2010) 또는 음성 인식 페이지(2020) 내에서 사용자의 터치에 기반한 제스처 입력이 가능하고, 미리 저장된 제스처에 대응되는 터치 입력이 수신되는 경우에, 미리 결정된 동작이 수행될 수 있다.According to the present embodiment, when a gesture input based on a user's touch is possible in the

예를 들면, 도 20에 도시된 바와 같이, 사용자가 입력 페이지(2010) 내에서 사각형을 그리는 제스처를 입력하고, 해당 사각형 내에 두 가지의 숫자를 입력하는 경우(2002)에, 해당 숫자의 row와 column을 갖는 표(table)(2003)가 입력 페이지(2010) 내에 생성될 수 있다.For example, as shown in FIG. 20, when a user inputs a gesture for drawing a quadrangle in the

또한, 도시되어 있지는 않지만, 음성 인식 페이지(2020) 내에서도 사용자의 제스처가 입력되는 경우에, 다양한 입력이 이루어질 수 있으며, 예를 들면, 음성 인식 페이지(2020) 내의 변환된 텍스트를 선택하는 경우에, 해당 선택된 텍스트가 변환되는 때에 녹음된 음성 파일을 재생하거나, 해당 음성이 수신된 시간에 사용자가 수행한 메모 입력을 확인하는 등의 동작도 가능하다.

In addition, although not shown, various inputs can be made when the user's gesture is input in the

Claims (5)

Translated fromKorean음성 데이터를 수신하는 입력부와,

상기 입력부를 통하여 수신된 음성 데이터에 대해서 음성 인식을 수행하고, 그 결과의 변환된 텍스트를 상기 디스플레이부에 표시하도록 제어하는 제어부를 포함하고,

상기 제어부는 수신되거나 저장된 전자 문서를 분석하고, 분석된 결과를 이용하여 상기 전자 문서에 포함된 적어도 일부 정보를 사용자가 편집가능하도록 하고,

상기 제어부는 상기 전자 문서 내에 스케쥴을 가리키는 정보가 포함된 경우에, 상기 스케쥴에 해당하는 정보를 불러들여 사용자가 편집가능하도록 하는 사용자 문서를 생성하고,

상기 사용자의 문서의 텍스트 영역을 선택하는 터치 제스처가 입력되고, 상기 터치 제스처가 해제되지 않은 상태에서 터치된 영역의 특정 방향으로 드래그 되는 경우 상기 드래그 방향에 대응하는 효과를 부여하고,

상기 스케쥴의 일정이나 미리 지정된 알람 일정이 되면, 사용자가 편집된 상기 사용자 문서 및 상기 스케쥴에 해당하는 정보를 표시하는 이동 단말기.A display unit capable of touch input,

An input unit for receiving voice data;