サクサク読めて、

アプリ限定の機能も多数!

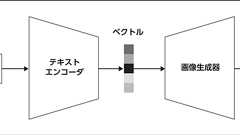

A small cabin ontop of a snowy mountain in the style of Disney, artstation さらに、その多くはユーザーがテキストを入力するだけで画像を生成できるアプリケーションを備えていたため、人々が気軽に使える身近な存在として急速に普及しました。これまでにも囲碁AIのAlphaGoや言語AIのBERTやGPT-3を始め、強力なAIは多数登場していますが、ここまで多くの人が積極的に利用するAIはありませんでした。 生成AIとは何者なのか画像生成AIという言葉から想像できるように、「文章生成AI」や「音楽生成AI」なども存在します。本記事ではこれらをまとめて「生成AI」と呼ぶことにします[1]。 生成AIはこれまでのAIと何が違うのでしょうか。従来のAIの例として、入力画像がホットドッグかどうかを判別する画像分類AIを考えましょ

2025-08-22: The CAPTCHA system have been migrated from reCAPTCHA toCloudflare Turnstile. Issue.

$k$は定数で、だいたい0.04~0.06くらいです。Rの値によって以下のように分類できます。 Rが大きい: corner Rが小さい: flat R < 0: edge 図にすると、以下のようになります。 CSE/EE486 Computer Vision I, Lecture 06, Corner Detection, p22 これで手早くcornerを検出できるようになりました。ここで、corner検出についてまとめておきます。 cornerは複数のedgeが集まる箇所と定義できる 変化量をまとめた行列の固有ベクトルからedgeの向き、固有値の大きさから変化量の大きさ(edgeらしさ)がわかる 2つの固有値の値を基に、edge、corner、flatを判定できる 固有値の計算は手間であるため、判定式を利用し計算を簡略化する なお、Harrisはedgeの向きである固有ベクトルを考慮す

いよいよ週末はGGJ!どんなゲームを作ろうかなーなんて考えるだけでも結構楽しかったりしますよね! もちろんユニティちゃんもバッチリテンション上がっております! 今年はビッグな燃料をドバーン!と投下しちゃいますよ! 一つ目はFullHDゲームでも使えるUnity-Chan HD image pack vol.1 今まで公開されていたサイズよりも高解像度での提供です! タイトル画面に使うもヨシ、カットインとして使うもヨシ! 二つ目はUnity-chan Pixel Art Pack for Action games Vol.2 アクションゲームに特化したドット絵素材第二段! なんと、コーゲン・シティの住人達が総出演です! ユニティちゃん、ホルガー、トーコちゃんは複数の攻撃モーションも持っているので主人公にするもよし、敵として登場させるもよし! 続く三つ目もコーゲンシティ・オールスターズ!

Fast & efficient imagecompressionOptimize JPEG, PNG,SVG, GIF and WEBP

WebGLのシェーダーGLSLでの画像処理の作り方(モノクロ、セピア、モザイク、渦巻き) WebGLを使うと画像処理が実現でき、HTMLコンテンツに多彩なグラフィカル表現をもたらすことができます。たとえば、表示をモノクロームやモザイクにするといった画像エフェクトは簡単に実現できます。 WebGLはGPUの恩恵を受けられるため高速に実行でき、他の代替手法(canvas要素Context2Dオブジェクトによる画像処理等)よりも負荷が軽いのが利点です。 今回はWebGLの定番JSライブラリ「Three.js」とGLSLというシェーダー言語を使った、9種類の画像処理の実装方法を紹介します。ソースコードは「GitHub」からダウンロードして読み進めてください。 サンプルを試してみよう 次のサンプルでは複数のシェーダーを適用できます。画面左上のチェックボックスで画像加工を選択でき、ラジオボタンから画像

はじめにVR 向け Leap Motion アセットに再び神アップデートがきました。Unity Core Assets 2.3.0 + ImageHands - Development - Leap Motion (Ultraleap) Community Forums https://developer.leapmotion.com/gallery/category/image-hand いくつかアップデートがある中で目玉は「Image Hand」という機能で、従来は 3D のモデルを認識した手の形状に合わせて動かしていたのに対し、カメラで取得した実際の手の領域を直接描画するモードが追加されました。従来同様当たり判定も効く上にオクルージョン(VR 内の 3D オブジェクトの後ろに回りこむような表現)も再現されています。本エントリでは、Image Hand に焦点を当てながら、前回(

うまくできましたか? ボヤけたり、ギザギザになったりしませんでしたか? waifu2xをお試しください。 (ブラウザの処理に影響されないようクリックで拡大おねがいします) waifu2xは、二次元画像を2倍に拡大するソフトウェアです。多くの二次元画像についてスゴイ級のクオリティで拡大できます。 waifu2xは、最新鋭の人工知能技術 Deep Convolutional NeuralNetworks を使って開発されました。 waifu2xの人工知能は、次の問に答えます。 いまから与える画像はある画像を半分に縮小したものである。縮小される前の画像を求めよ。 画像を拡大するのではなく、縮小される前の状態に戻します。 縮小されてないオリジナル画像を与えた場合も、やはり縮小される前の画像を答えます。 その画像は本来存在しないものですが、waifu2xはそれを想像で創ります。 二次元画像のJPE

精度95%以上! ソースコードは指紋、作者はほぼ特定できる2015.02.11 19:0011,088 ほぼドンピシャでバレバレです。 スペースやタブ、大文字やアンダーバーを組み合わせた命名規則、コメント…コードの書き方には、人によってスタイルがありますよね。それはもう指紋のようなもので、それさえ見えれば、誰がコードを書いたかほとんどわかってしまう…そんな驚きの研究結果が発表されました。 米ドレクセル大学、メリーランド大学、プリンストン大学、独ゲッティンゲン大学の共同チームの研究によると、自然言語処理と機械学習によるコード分析により、95%の精度で作者は特定できるそうです。 解析されるのは、レイアウトや語彙の特性と、「抽象構文木(AST)」です。ASTとは、「コードの書き方からまったく影響を受けずに、コードの型の特性をとらえる」もので、つまり、関数の名前、コメント、スペース入れ方などのクセ

Or to betechnical, I made a thing that makes things like that thing. (If your device doesn’t renderit,it looks like this.) Backstory: a month and a half ago I left my job to make an indie game. One of the many things on my to-do list was “Learn shaderprogramming”, and around that time I ran across thisblog post by Roger Alsing about using genetic algorithms tocreate images. So I tried the sa

はじめに 8月末に Leap Motion が公式でステレオの赤外画の取得のAPI の公開と、VR 用のソフトウェア群、および Oculus Rift DK2 マウンタを公開しました。 Ultraleap Docs | Ultraleap DocsGuidelines for Hand Tracking and Haptics XR | Ultraleap サンプルも幾つか用意されていて試すことが出来ます。マウンタは買わずとも両面テープやマジックテープでくっつければ問題なく動作しますし、3D プリンタをお持ちであればデータも公開されているので、自分で用意することも可能です。 Ultraleap Gallery – Demos and experiments from the Ultraleap and our community. Share yours today. Leap Mot

Deep Visual-Semantic Alignments for Generating Image Descriptions We present a model that generates natural language descriptions of images and their regions. Our approach leverages datasets of images and their sentence descriptions to learn about the inter-modal correspondences between language and visual data. Our alignment model is based on a novel combination of Convolutional NeuralNetworks o

Like many of you, I have been very busy upgrading my apps to make them fit for iOS 7. The latest version of iOS introduces lots of visual changes. From a developer’s perspective, the navigation bar and status bar are two noticeable changes that need to cater. The status bar is now transparent, that means the navigation bar behindit shows through. In some cases, the background image for a navigati

以下のガイドラインにはテンプレートとして描画するとかステンシルとして描画するとかいろいろ述べられていますが、いまいちピンときません。Template Images |UIKit User Interface Catalog | iOS Developer Library In iOS 7, you can choose to treat any of the images in your app as atemplate—or stencil—image. ということでUIImageRenderingMode の設定値をいろいろ変えて確かめてみました。UIImageRenderingMode を使ってみる では早速、下図の画像をUIImage にセットして試していきたいと思います!RDS のアイコンの意味は全くこれっぽっちもありませんwUIImageRenderingMode

![[iOS 7] UIImage の新しいプロパティ UIImageRenderingMode とは? | DevelopersIO](/image.pl?url=https%3a%2f%2fcdn-ak-scissors.b.st-hatena.com%2fimage%2fsquare%2f5771c24e024f12a499edf770981086568ca369b4%2fheight%3d288%3bversion%3d1%3bwidth%3d512%2fhttps%253A%252F%252Fdevio2023-media.developers.io%252Fwp-content%252Fuploads%252F2013%252F09%252Fios7_logo_api.png&f=jpg&w=240)

Few days ago,Apple introducediPhone 6 Plus. The newiPhone substantially changes the way graphics are rendered on screen. We've made an infographic to demystify this. 320 × 480 375 × 667 414 × 736 320 × 480 750 × 1334 1242 × 2208 1080 × 1920 3.5″ 4.7″ 5.5″iPhone 6 Plus has screen with lower pixel resolution than the image rendered in previous step. Before the image can be displayed on the scree

$200K 1 10th birthday 4 abusive ads 1 abusive notifications 2 accessibility 3 adblockers 1 adblocking 2 advanced capabilities 1android 2 anti abuse 1 anti-deception 1 background periodic sync 1 badging 1 benchmarks 1 beta 83 better ads standards 1 billing 1 birthday 4blink 2 browser 2 browser interoperability 1bundles 1 capabilities 6 capable web 1 cds 1 cds18 2 cds2018 1chrome 35chrome 81

UIViewの表示内容は、画像コンテキストからUIImageとして取得できるので、そのまま画像に保存することが可能です。 以下のコードは、MKPinAnnotationViewを、ピンのカラーを指定して画像に出力するコードです。 - (void)writePinAnnotationView:(MKPinAnnotationColor)pinColor { static NSString *annotationIdentifier = @"Annotation"; MKPinAnnotationView *view =[[MKPinAnnotationView alloc] initWithAnnotation:annotation reuseIdentifier:annotationIdentifier]; view.pinColor = pinColor; NSString *file

前回のポストで反響がいいので、もう一発。 前回はがっつりUIKitを使っているため、メインスレッドで合成が行われる。 つまり、大きい寸法のUIImageを合成する時など、処理に時間がかかる場合は、合成処理中に画面上での次の処理がしばらく止まることがある。 んじゃぁどぉするの?ってことで、GCDを使って別スレッドでUIKitを使わずに合成を行う。 実際のサンプルコードの前に、方法の概要から説明すると、以下のようなメソッドで処理を行う - (void)foo:[終了blocks] { // 1. 合成処理の下準備を行う dispatch_async(dispatch_get_global_queue(DISPATCH_QUEUE_PRIORITY_LOW, 0), ^{ // 2. ここで合成処理を行う dispatch_async(dispatch_get_main_queue(), ^{

リリース、障害情報などのサービスのお知らせ

最新の人気エントリーの配信

処理を実行中です

j次のブックマーク

k前のブックマーク

lあとで読む

eコメント一覧を開く

oページを開く